Содержание

- 2. План лекции Модель информационной системы Шеннона Информационная емкость сообщений для сигналов с заданным распределением частот символов

- 3. Claude Shannon “A Mathematical Theory of Communication” The Bell System Technical Journal Vol. 27, pp. 379–423,

- 4. Три вопроса, на которые ответил Шеннон: Какой нужен канал, чтобы передать данный сигнал (последовательность символов) за

- 5. Каким должен быть канал, чтобы передать данный сигнал за данное время? За какое время можно передать

- 6. Пусть N(T) – число сигналов, передача которых занимает время T через данный канал Размер пропускной способности

- 7. За какое время нельзя передать данный сигнал по данному каналу без потерь? Наименьшее число двоичных символов,

- 8. На практике важен приблизительный объем информации в сигналах определенного вида Точный объём информации в произвольном сигнале

- 9. Частота появления символа в длинном тексте не зависит от текста -- верно для всех известных языков

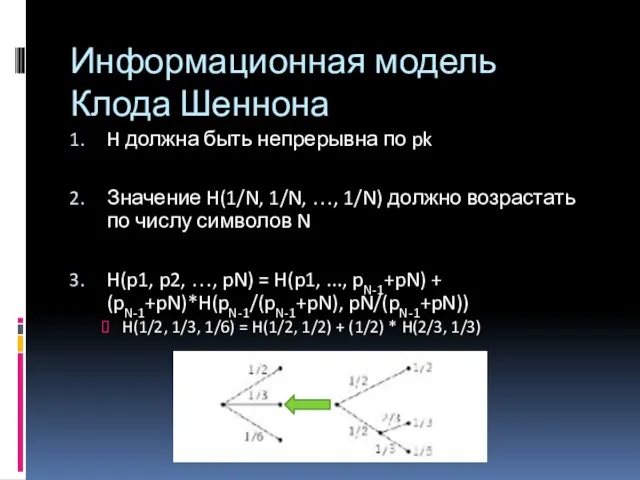

- 10. H должна быть непрерывна по pk Значение H(1/N, 1/N, …, 1/N) должно возрастать по числу символов

- 11. Все функции, удовлетворяющие условиям 1-3, имеют вид H(р1, ..., рN) = - c ∑ pk log2(pk)

- 12. Заключение Модель информационной системы Шеннона Информационная емкость сообщений для сигналов с заданным распределением частот символов Формулы

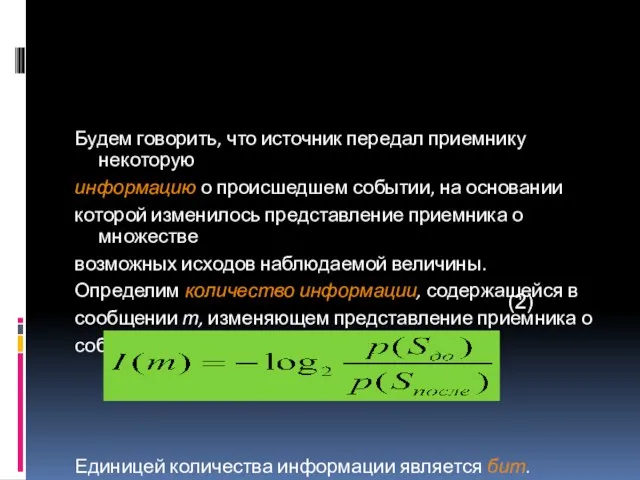

- 13. Будем говорить, что источник передал приемнику некоторую информацию о происшедшем событии, на основании которой изменилось представление

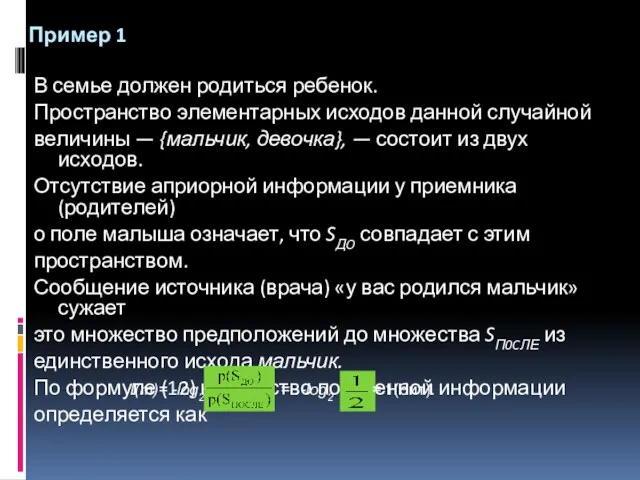

- 14. Пример 1 В семье должен родиться ребенок. Пространство элементарных исходов данной случайной величины — {мальчик, девочка},

- 15. log22 = 1 – ? 1 бит соответствует сообщению о том, что произошло одно из двух

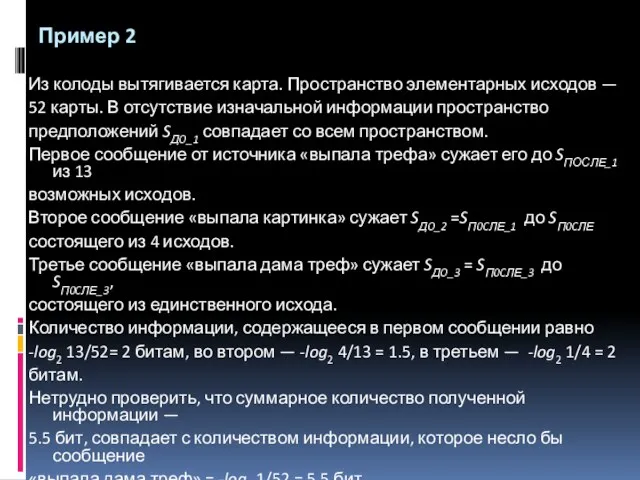

- 16. Пример 2 Из колоды вытягивается карта. Пространство элементарных исходов — 52 карты. В отсутствие изначальной информации

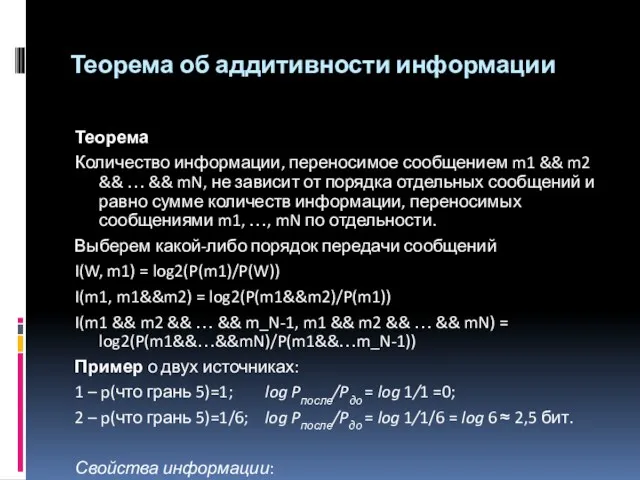

- 17. Теорема об аддитивности информации Теорема Количество информации, переносимое сообщением m1 && m2 && … && mN,

- 18. Предположим теперь, что источник является генератором символов из некоторого множества {х1, х2, ...,хn} (назовем его алфавитом

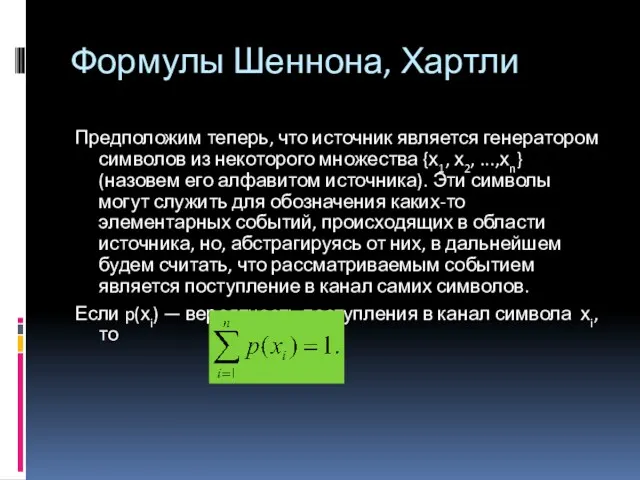

- 19. Рассмотрим теперь модель, в которой элементарным исходом является текстовое сообщение. Таким образом, Ω — это множество

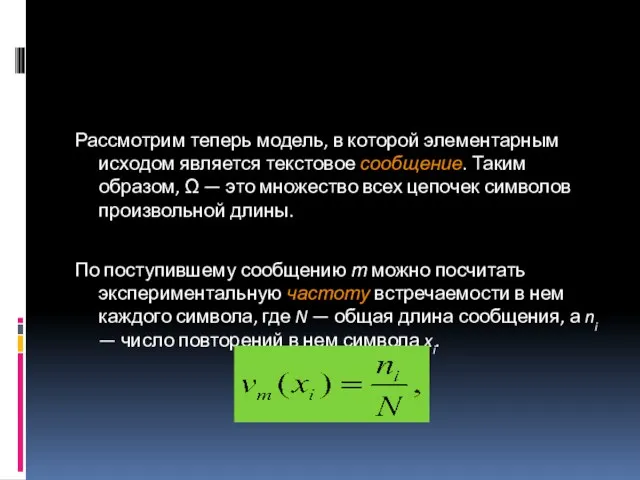

- 20. Понятно, что анализируя различные сообщения, мы будем получать различные экспериментальные частоты символов, но для источников, характеризующихся

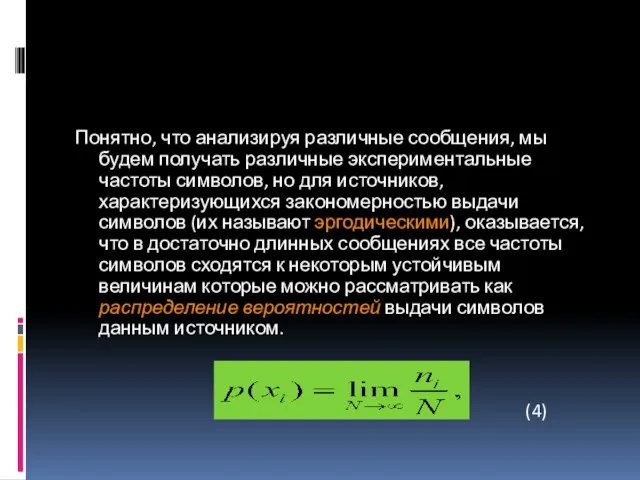

- 21. Рассмотрим сообщение m, состоящее из n1 символов x1, n2 символов x2 и т. д. в произвольном

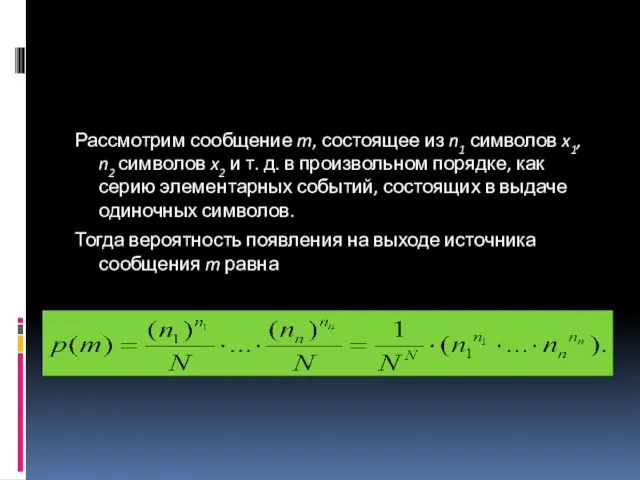

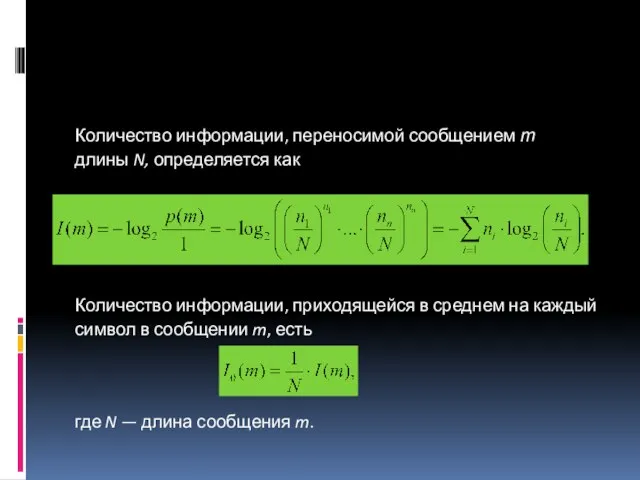

- 22. Количество информации, переносимой сообщением т длины N, определяется как Количество информации, приходящейся в среднем на каждый

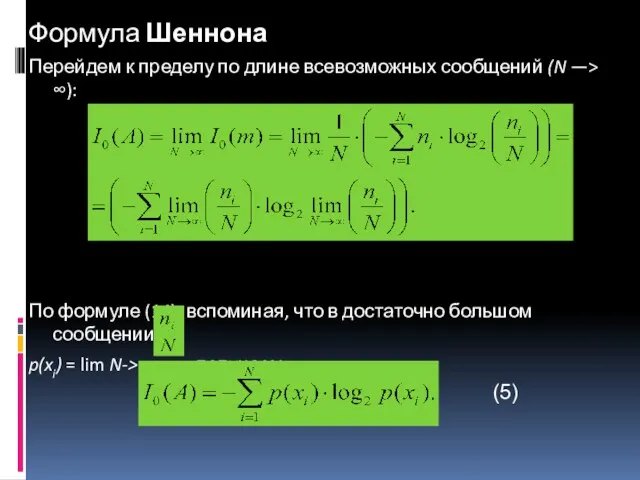

- 23. Формула Шеннона Перейдем к пределу по длине всевозможных сообщений (N —> ∞): По формуле (14), вспоминая,

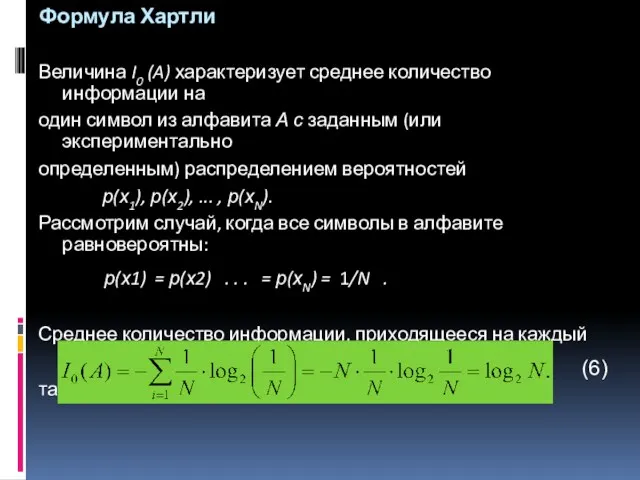

- 24. Формула Хартли Величина I0 (A) характеризует среднее количество информации на один символ из алфавита А с

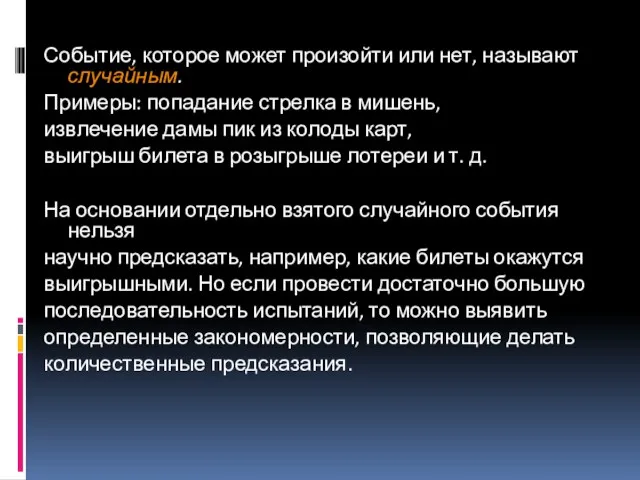

- 25. Событие, которое может произойти или нет, называют случайным. Примеры: попадание стрелка в мишень, извлечение дамы пик

- 26. Определение Пространство элементарных событий (исходов) Ω – множество всех различных событий, возможных при проведении эксперимента. Элементарность

- 27. Примеры: Будем бросать монету до тех пор, пока не выпадет герб. После этого эксперимент закончим. «Элементарный

- 28. Формула ω∈Ω означает, что элементарное событие ω является элементом пространства Ω. Многие события естественно описывать множествами,

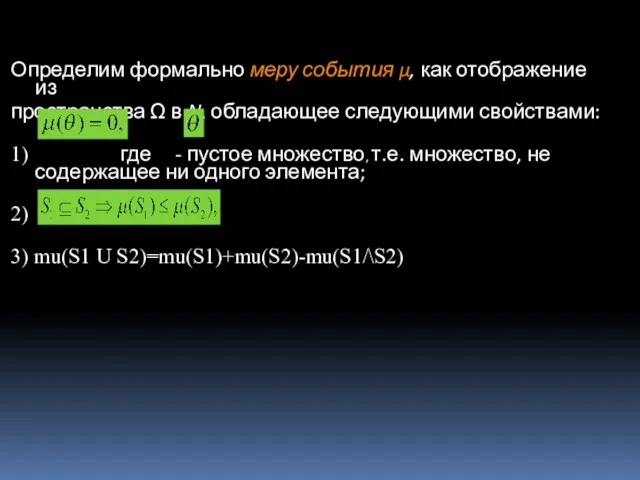

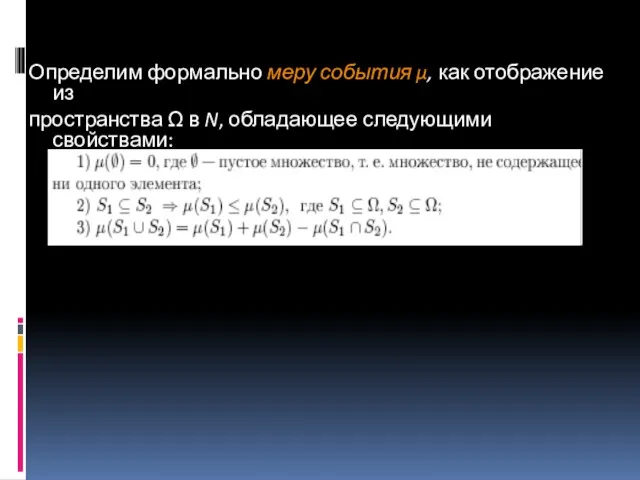

- 29. Определим формально меру события µ, как отображение из пространства Ω в N, обладающее следующими свойствами: 1)

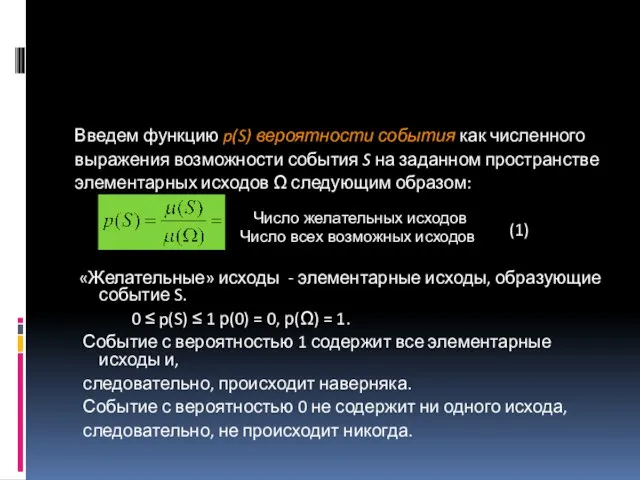

- 30. Введем функцию p(S) вероятности события как численного выражения возможности события S на заданном пространстве элементарных исходов

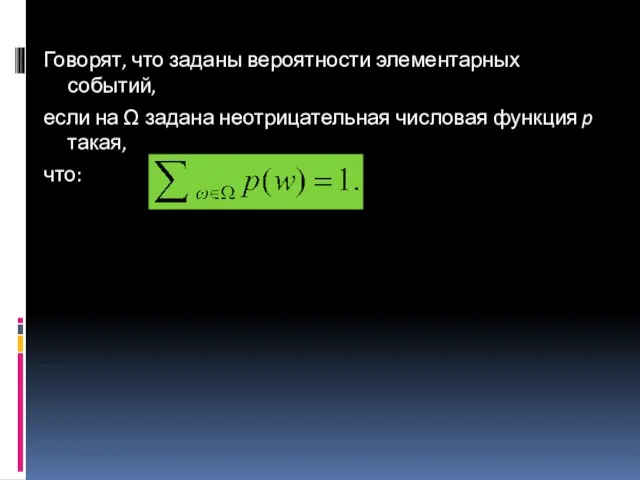

- 31. Говорят, что заданы вероятности элементарных событий, если на Ω задана неотрицательная числовая функция p такая, что:

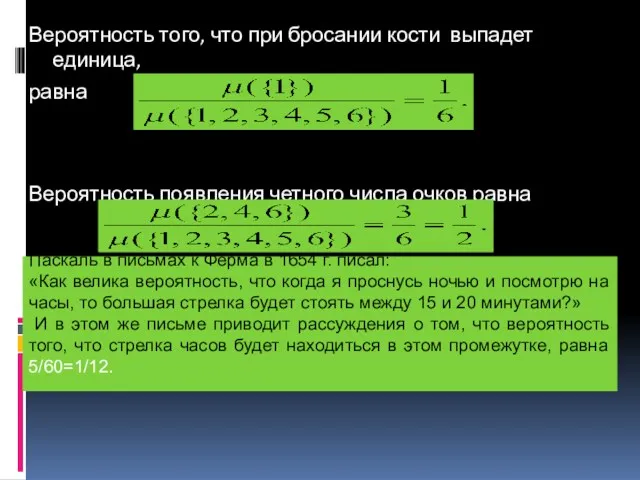

- 32. Вероятность того, что при бросании кости выпадет единица, равна Вероятность появления четного числа очков равна Паскаль

- 33. Теорема о сложении вероятностей Если пересечение событий А и В непусто, то р(А U В) =

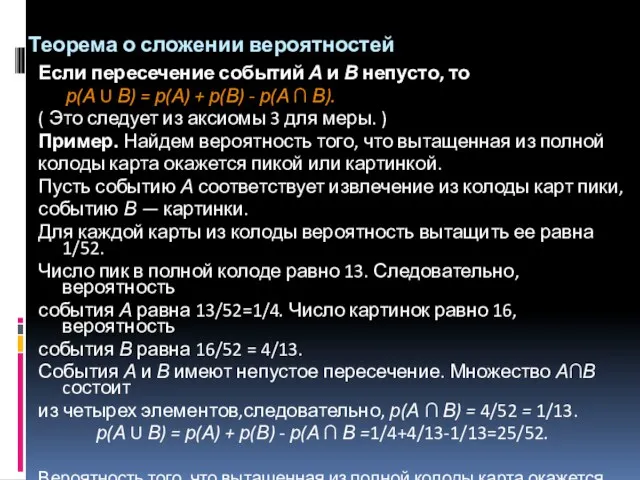

- 34. Теорема об умножении вероятностей Рассмотрим теперь серию экспериментов, в которой некоторая случайная величина наблюдается последовательно несколько

- 35. Определим формально меру события µ, как отображение из пространства Ω в N, обладающее следующими свойствами:

- 36. КОНЕЦ ЛЕКЦИИ

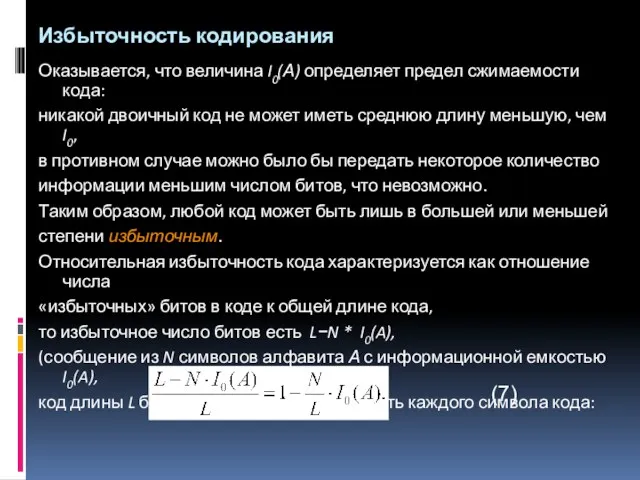

- 37. Избыточность кодирования Оказывается, что величина I0(А) определяет предел сжимаемости кода: никакой двоичный код не может иметь

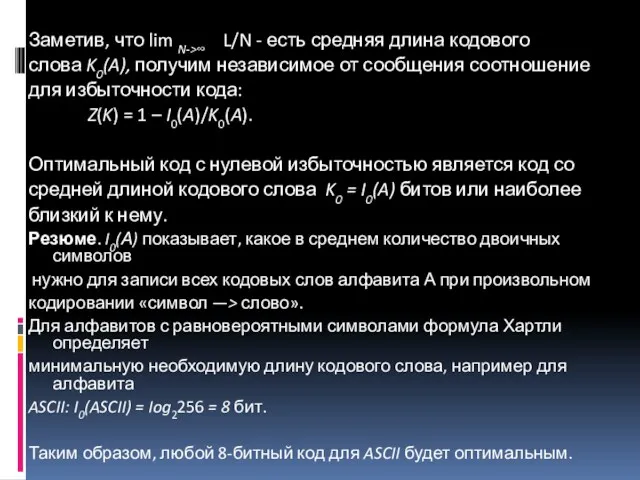

- 38. Заметив, что lim N->∞ L/N - есть средняя длина кодового слова K0(A), получим независимое от сообщения

- 39. Посчитаем информационную емкость кода: длина исходного сообщения N = 18, длина кода L = 39 битов.

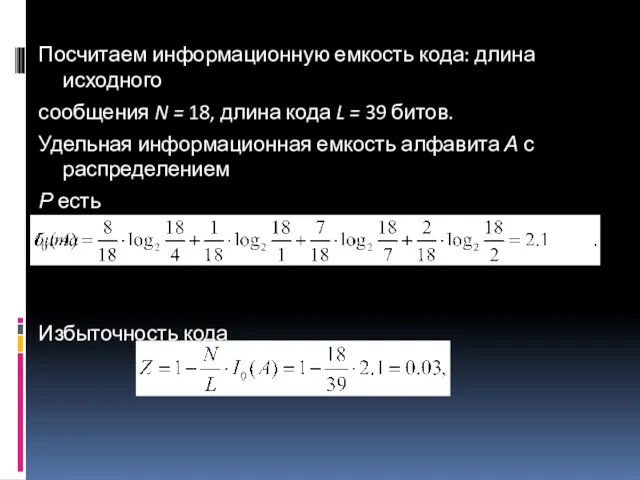

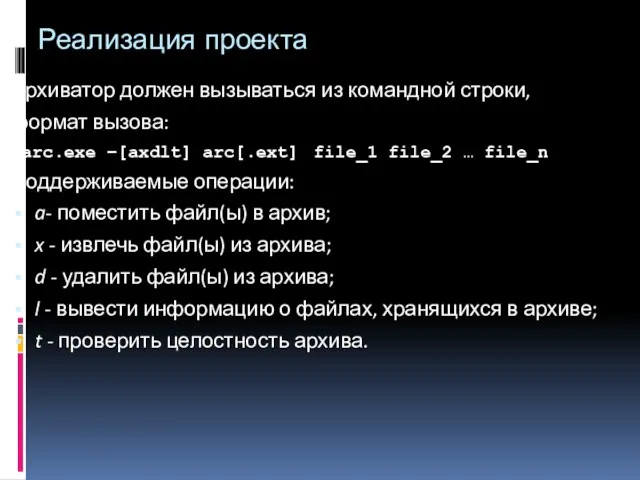

- 40. Реализация проекта Архиватор должен вызываться из командной строки, формат вызова: harc.exe –[axdlt] arc[.ext] file_1 file_2 …

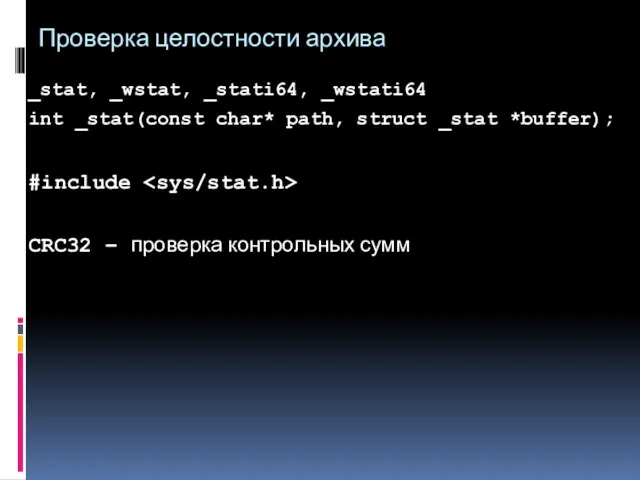

- 41. Проверка целостности архива _stat, _wstat, _stati64, _wstati64 int _stat(const char* path, struct _stat *buffer); #include CRC32

- 42. Построение дерева Хаффмана Вход: A – исходный набор символов , P= - распределение их частот; –

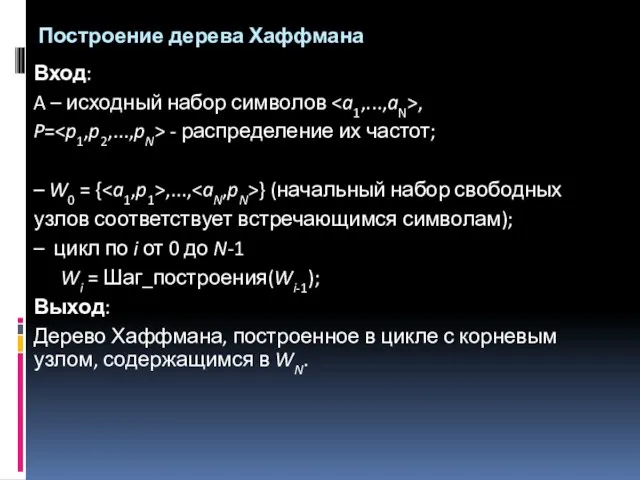

- 43. Алгоритм: Определить алфавит А = { с1, с2 , ... , сn } сообщения S и

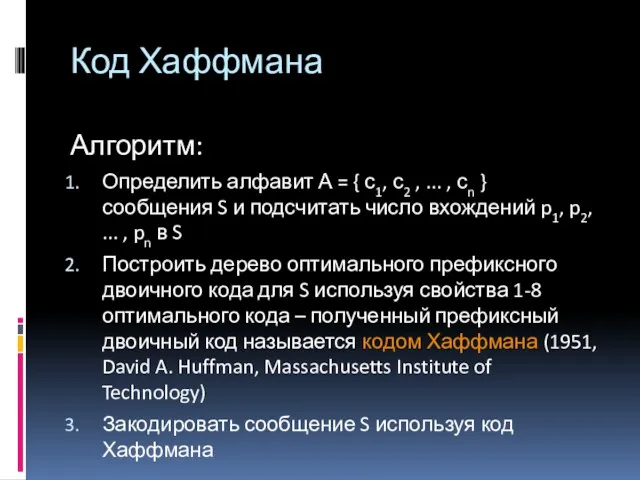

- 44. Критерии качества кодирования: — минимальная длина кода; — однозначное декодирование.

- 46. Скачать презентацию

Paint графикалық редакторы. Нысанды бұру

Paint графикалық редакторы. Нысанды бұру Электронные ресурсы для подготовки к Всероссийской олимпиаде школьников по русскому языку и литературе

Электронные ресурсы для подготовки к Всероссийской олимпиаде школьников по русскому языку и литературе Информационные процессы и системы автоматизации в профессиональной деятельности

Информационные процессы и системы автоматизации в профессиональной деятельности Носители информации

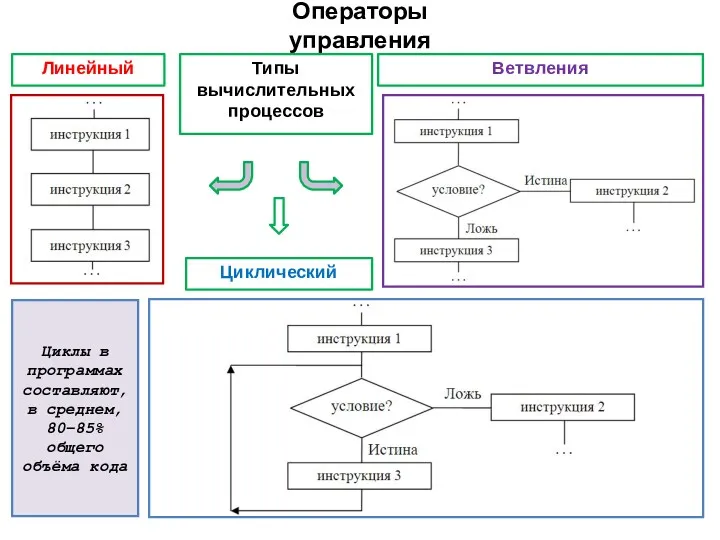

Носители информации Операторы управления

Операторы управления Архитектура операционных систем

Архитектура операционных систем Количество информации. Единицы измерения количества информации

Количество информации. Единицы измерения количества информации Виртуализация сетевых функций (NFV)

Виртуализация сетевых функций (NFV) Разработка электронной доски объявлений по поиску работы Найти IT

Разработка электронной доски объявлений по поиску работы Найти IT Простые таблицы

Простые таблицы Подписные кампании

Подписные кампании Методы и средства анализа уязвимостей

Методы и средства анализа уязвимостей Презентация Локальные сети + самостоятельная работа

Презентация Локальные сети + самостоятельная работа Информационная памятка для обучающихся

Информационная памятка для обучающихся Циклы. Основные понятия

Циклы. Основные понятия Блочная верстка сайта. Урок 18 - 19

Блочная верстка сайта. Урок 18 - 19 Тест по правилам техники безопасности при работе в кабинете информатики

Тест по правилам техники безопасности при работе в кабинете информатики Структурное программирование. Основные сведения об алгоритмах

Структурное программирование. Основные сведения об алгоритмах Информационные технологии на уроке

Информационные технологии на уроке Безопасность в интернете

Безопасность в интернете Организация вычислений в электронных таблицах. Обработка числовой информации в электронных таблицах. Информатика. 9 класс

Организация вычислений в электронных таблицах. Обработка числовой информации в электронных таблицах. Информатика. 9 класс Использование компьютерных технологий в современном ДОУ

Использование компьютерных технологий в современном ДОУ MS Word 2007. Стилевое форматирование. Лекция № 2

MS Word 2007. Стилевое форматирование. Лекция № 2 Locators XPATH, CSS, DOM

Locators XPATH, CSS, DOM Введение в информатику и программирование

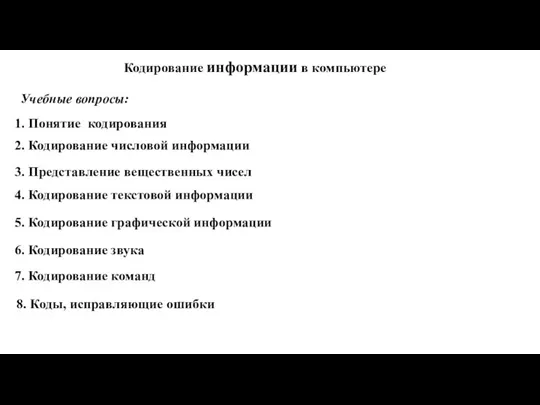

Введение в информатику и программирование Кодирование информации в компьютере

Кодирование информации в компьютере Основы информатики. Виды алгоритмов. Алгоритмы сортировки

Основы информатики. Виды алгоритмов. Алгоритмы сортировки Interaction to operating system

Interaction to operating system