Содержание

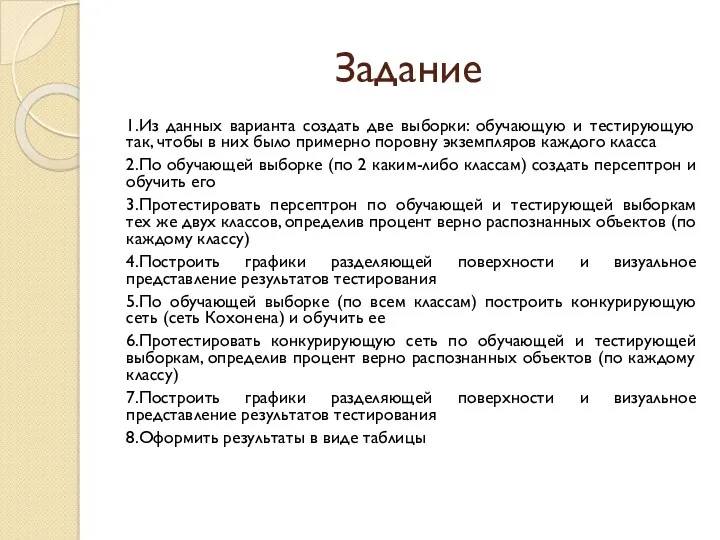

- 2. Задание 1.Из данных варианта создать две выборки: обучающую и тестирующую так, чтобы в них было примерно

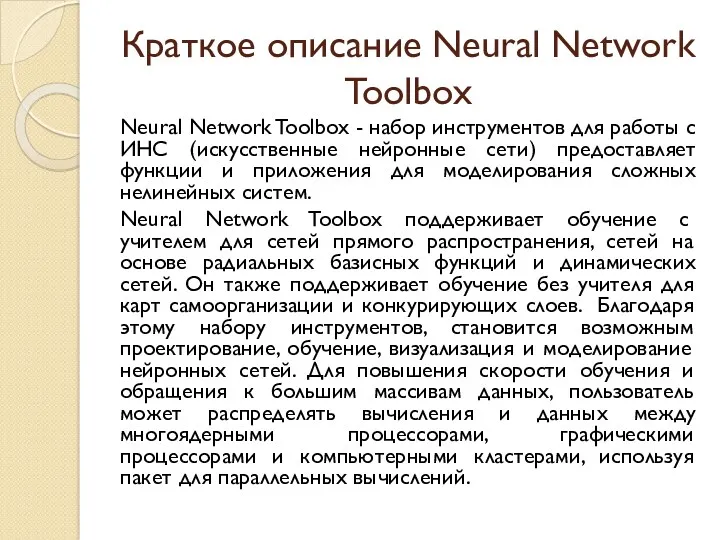

- 4. Краткое описание Neural Network Toolbox Neural Network Toolbox - набор инструментов для работы с ИНС (искусственные

- 5. Краткое описание Neural Network Toolbox Ключевые понятия: Сети обучающиеся с учителем: многослойные, радиальные базисные, LVQ, нелинейной

- 6. Введение в нейронные сети Нейронные сети состоят из простых элементов функционирующих параллельно. Название этих элементов пришло

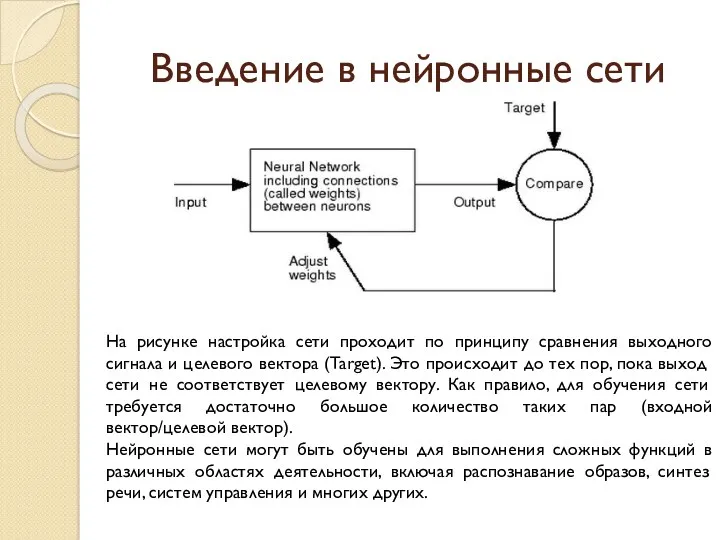

- 7. Введение в нейронные сети На рисунке настройка сети проходит по принципу сравнения выходного сигнала и целевого

- 8. Как использовать NNT? Существует 4 способа использовать набор инструментов для работы с ИНС. Первый способ –

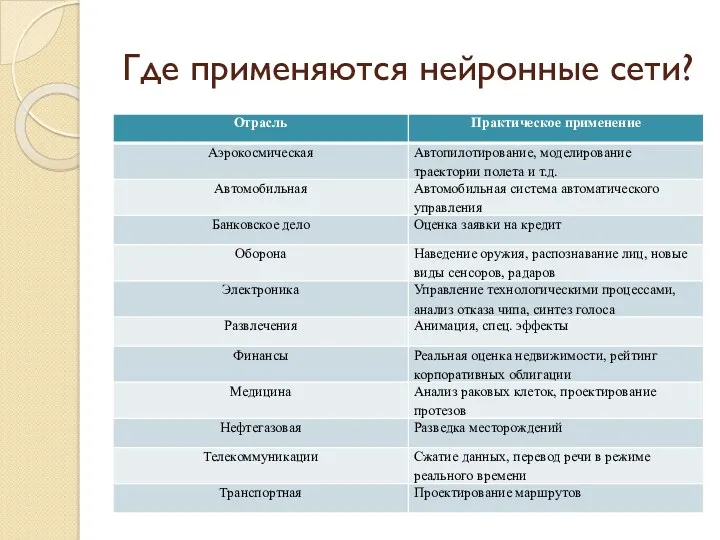

- 9. Где применяются нейронные сети?

- 10. Основные этапы проектирования ИНС Приведены стандартные этапы проектирования нейронной сети. Всего их можно поделить на 7

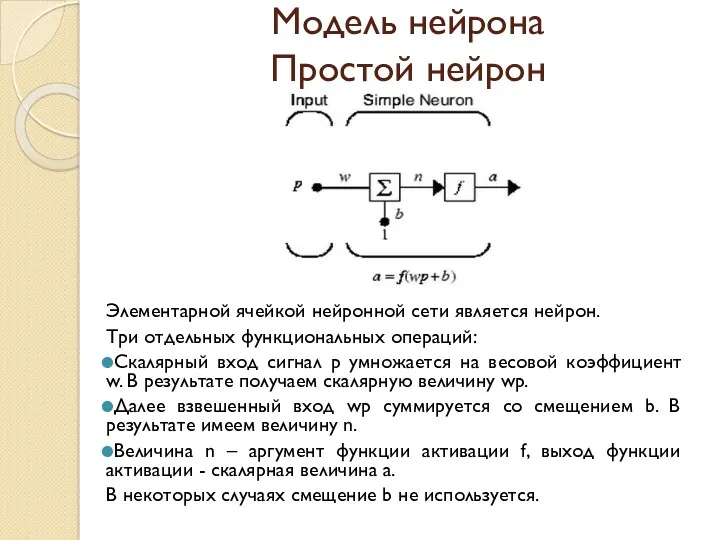

- 11. Модель нейрона Простой нейрон Элементарной ячейкой нейронной сети является нейрон. Три отдельных функциональных операций: Скалярный вход

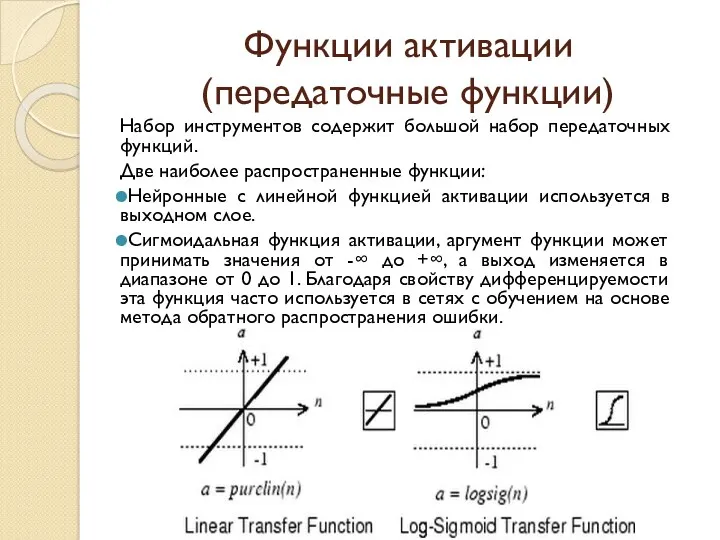

- 12. Функции активации (передаточные функции) Набор инструментов содержит большой набор передаточных функций. Две наиболее распространенные функции: Нейронные

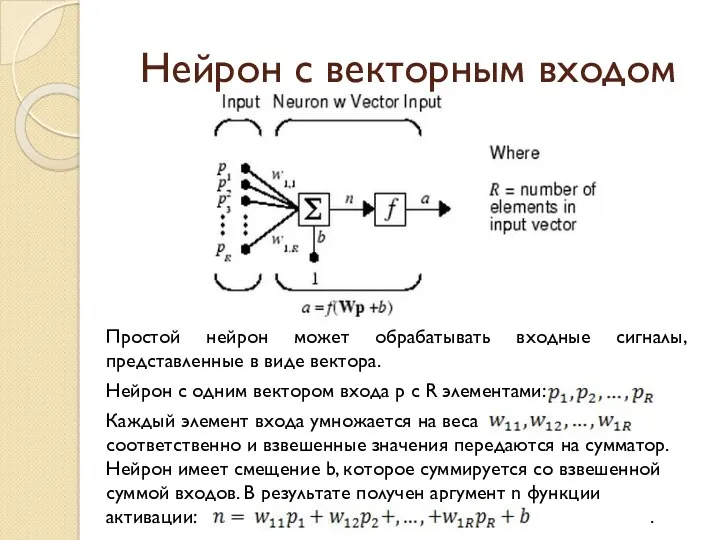

- 13. Нейрон с векторным входом Простой нейрон может обрабатывать входные сигналы, представленные в виде вектора. Нейрон с

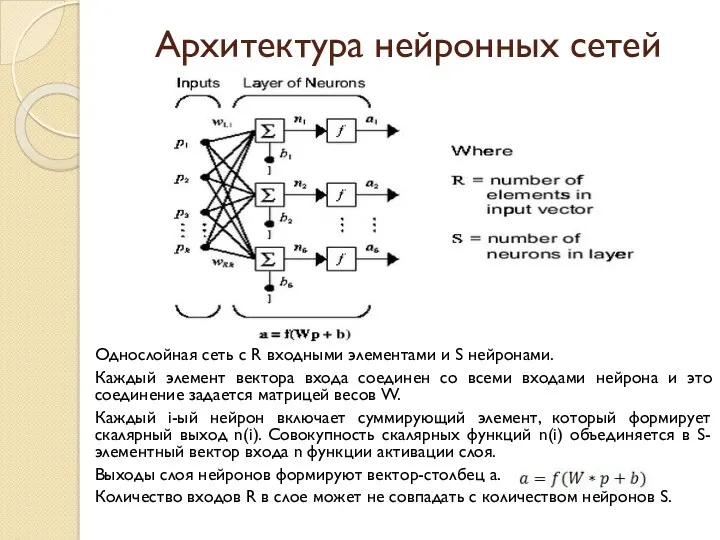

- 14. Архитектура нейронных сетей Однослойная сеть с R входными элементами и S нейронами. Каждый элемент вектора входа

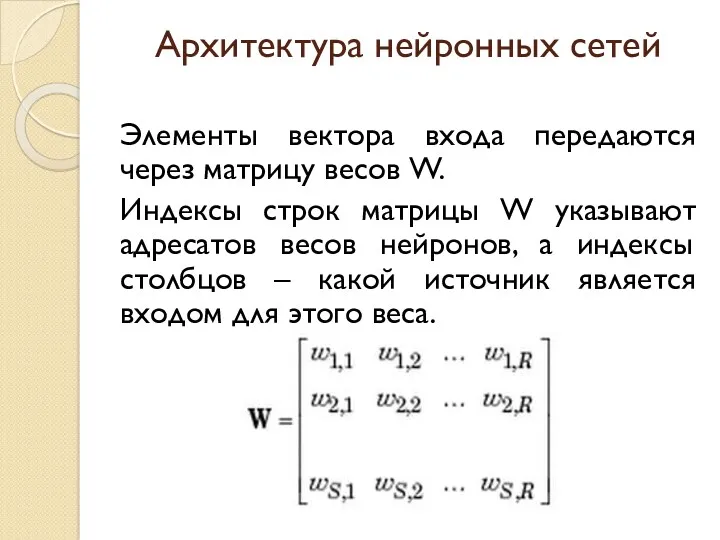

- 15. Архитектура нейронных сетей Элементы вектора входа передаются через матрицу весов W. Индексы строк матрицы W указывают

- 16. Персептрон Большое количество моделей персептрона представлено в основополагающей работе Розенблатта. Простейшая из таких моделей – однослойный

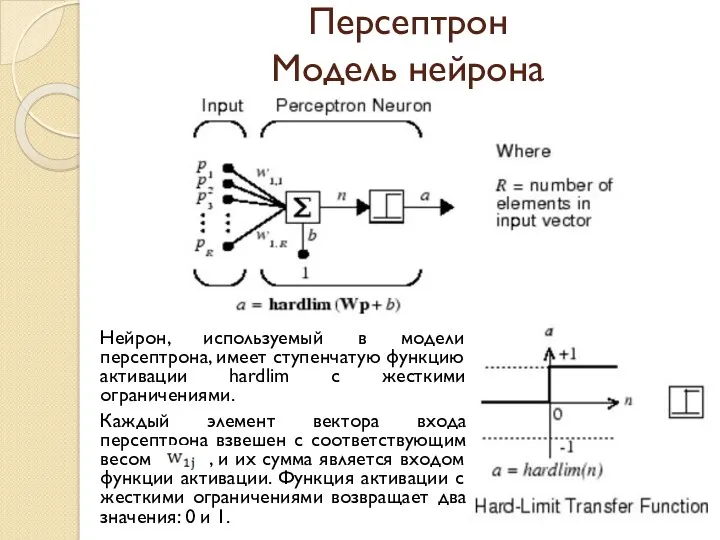

- 17. Персептрон Модель нейрона Нейрон, используемый в модели персептрона, имеет ступенчатую функцию активации hardlim с жесткими ограничениями.

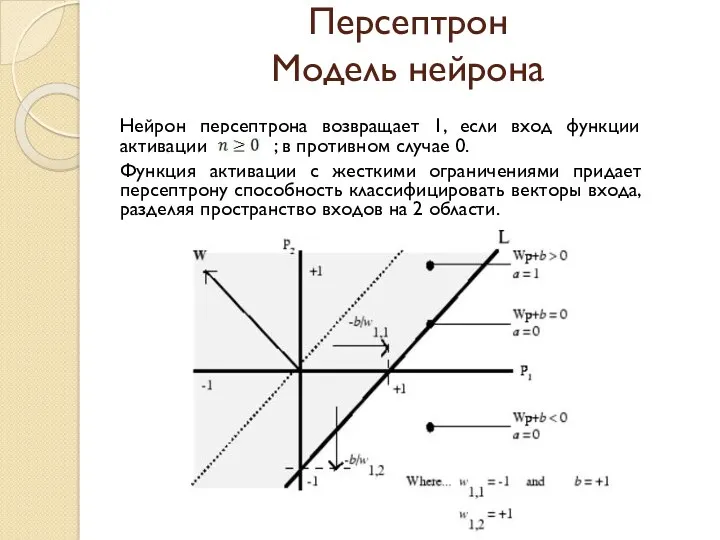

- 18. Персептрон Модель нейрона Нейрон персептрона возвращает 1, если вход функции активации ; в противном случае 0.

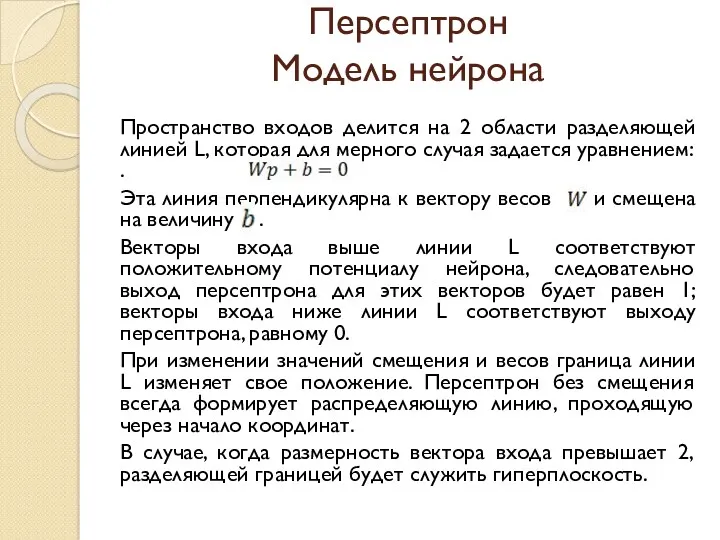

- 19. Персептрон Модель нейрона Пространство входов делится на 2 области разделяющей линией L, которая для мерного случая

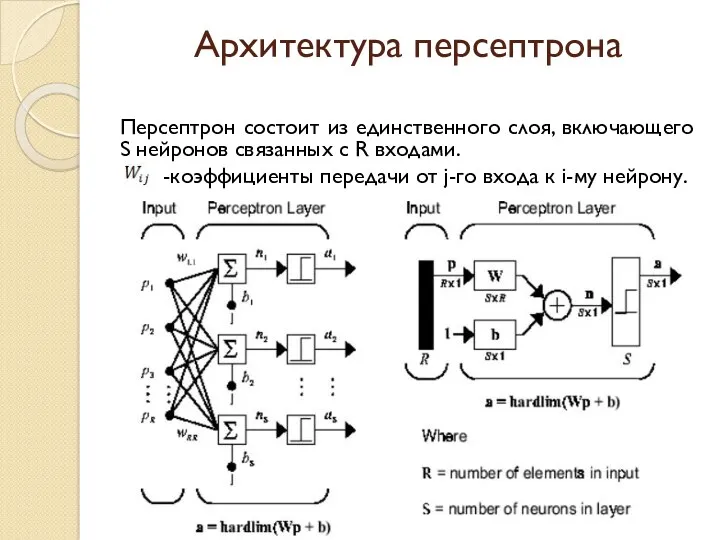

- 20. Архитектура персептрона Персептрон состоит из единственного слоя, включающего S нейронов связанных с R входами. -коэффициенты передачи

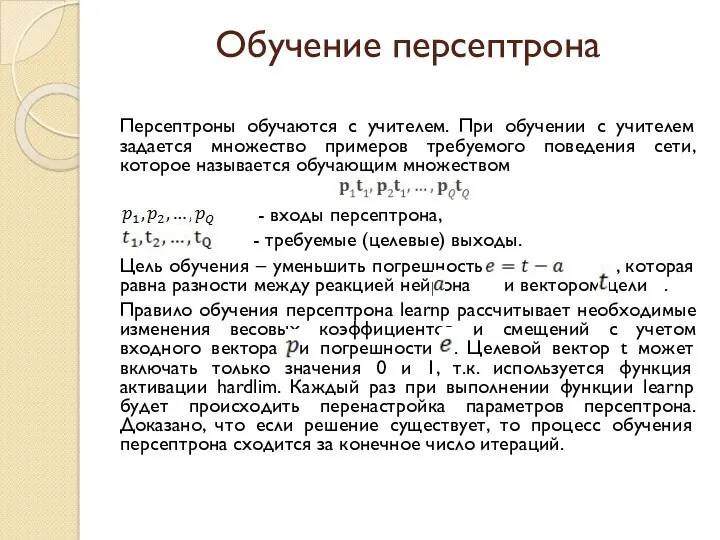

- 21. Обучение персептрона Персептроны обучаются с учителем. При обучении с учителем задается множество примеров требуемого поведения сети,

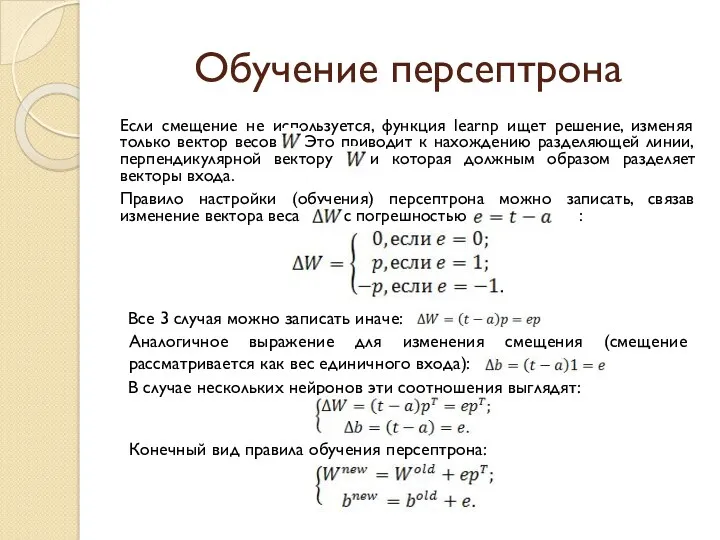

- 22. Обучение персептрона Если смещение не используется, функция learnp ищет решение, изменяя только вектор весов . Это

- 23. Слой Кохонена (конкурирующий слой) В процессе анализа больших информационных массивов данных неизменно возникают задачи, связанные с

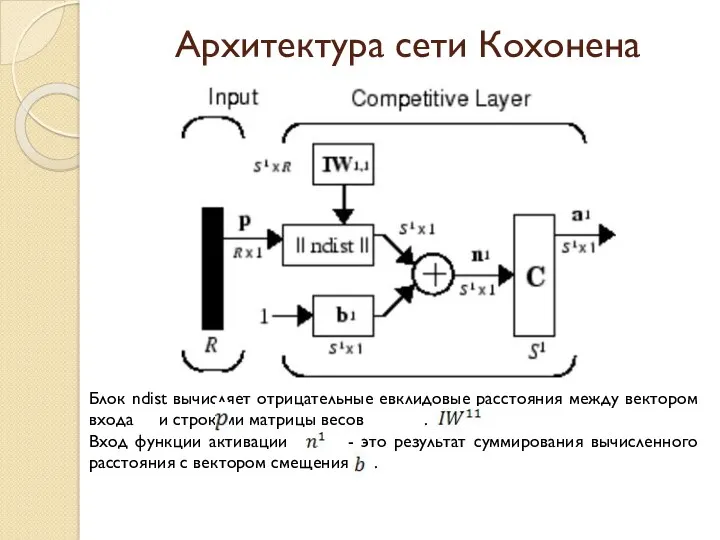

- 24. Архитектура сети Кохонена Блок ndist вычисляет отрицательные евклидовые расстояния между вектором входа и строками матрицы весов

- 25. Архитектура сети Кохонена Если все смещения нулевые, максимальное значение не может превышать 0. Нулевое значение возможно

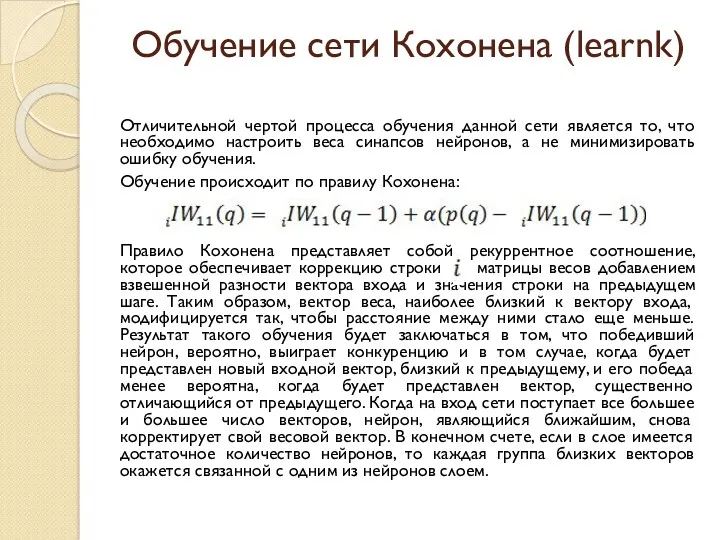

- 26. Обучение сети Кохонена (learnk) Отличительной чертой процесса обучения данной сети является то, что необходимо настроить веса

- 27. Правило настройки смещений (learncon) Одно из ограничений любого конкурирующего слоя состоит в том, что некоторые нейроны

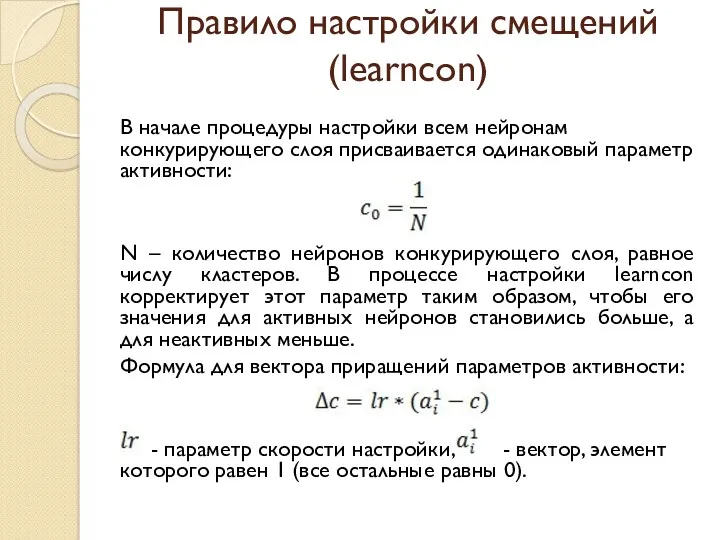

- 28. Правило настройки смещений (learncon) В начале процедуры настройки всем нейронам конкурирующего слоя присваивается одинаковый параметр активности:

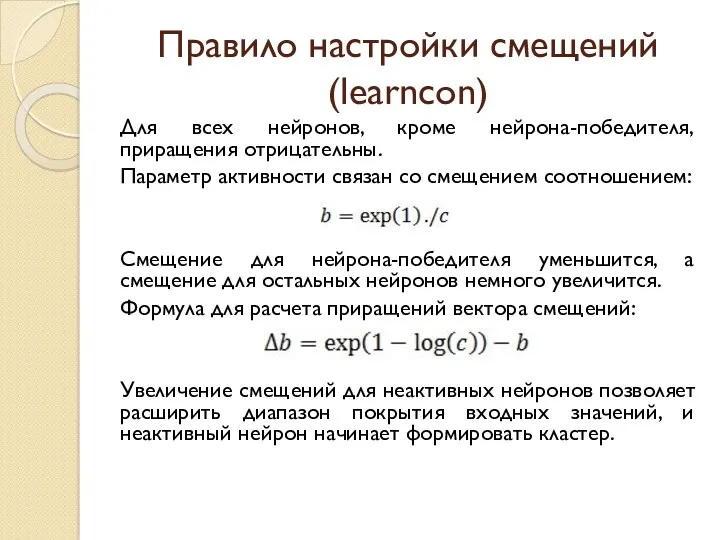

- 29. Правило настройки смещений (learncon) Для всех нейронов, кроме нейрона-победителя, приращения отрицательны. Параметр активности связан со смещением

- 30. Правило настройки смещений (learncon) Два преимущества функции learncon: Если нейрон не выигрывает конкуренции, потому что его

- 31. Команды Matlab для работы с нейронными сетями (работа с персептроном) Net=newp(minmax,p) Создание персептрона Minmax – матрица

- 32. Команды Matlab для работы с нейронными сетями (работа с персептроном) Распознавание по нейронной сети Y =

- 33. Команды Matlab для работы с нейронными сетями (работа с персептроном) С помощью функции plotpv можно изображать

- 34. Команды Matlab для работы с нейронными сетями (работа с персептроном) Функция minmax определяет диапазоны каждого признака

- 35. Команды Matlab для работы с нейронными сетями (работа с персептроном) Пример с распознаванием ирисов Фишера: load

- 36. Команды Matlab для работы с нейронными сетями (работа с персептроном) net=newp(mmx,1); subplot(2,2,1); plotpv(P,out); hold on plotpc(net.IW{1},net.b{1});%Разделяющая

- 37. Команды Matlab для работы с нейронными сетями (работа с персептроном) hold on; plotpc(net.IW{1},net.b{1});%Разделяющая поверхность по весам

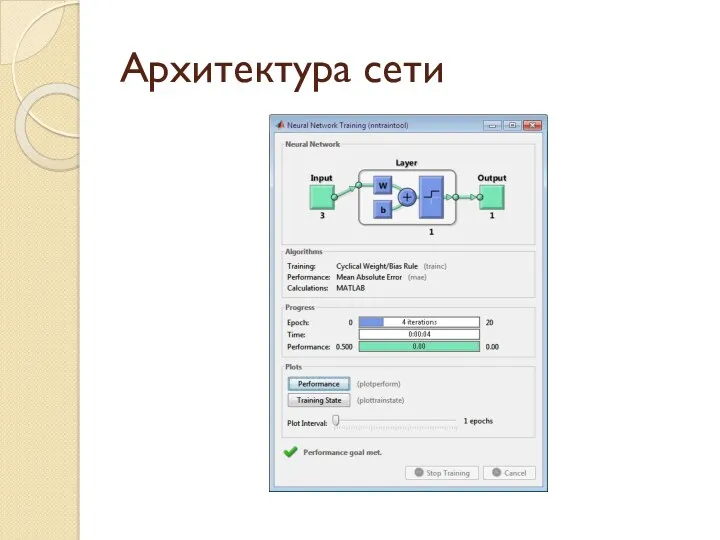

- 38. Архитектура сети

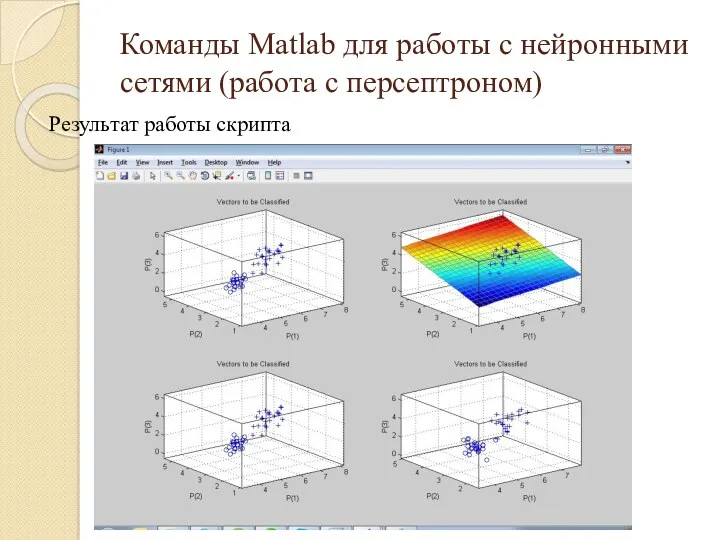

- 39. Команды Matlab для работы с нейронными сетями (работа с персептроном) Результат работы скрипта

- 40. Команды Matlab для работы с нейронными сетями (работа с сетью Кохонена) Для формирования слоя Кохонена предназначена

- 41. Команды Matlab для работы с нейронными сетями (работа с сетью Кохонена) Пример с ирисами Фишера, в

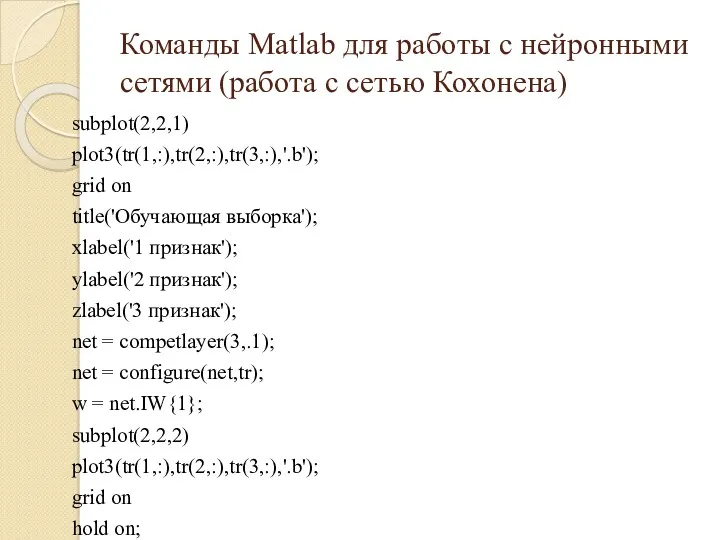

- 42. Команды Matlab для работы с нейронными сетями (работа с сетью Кохонена) subplot(2,2,1) plot3(tr(1,:),tr(2,:),tr(3,:),'.b'); grid on title('Обучающая

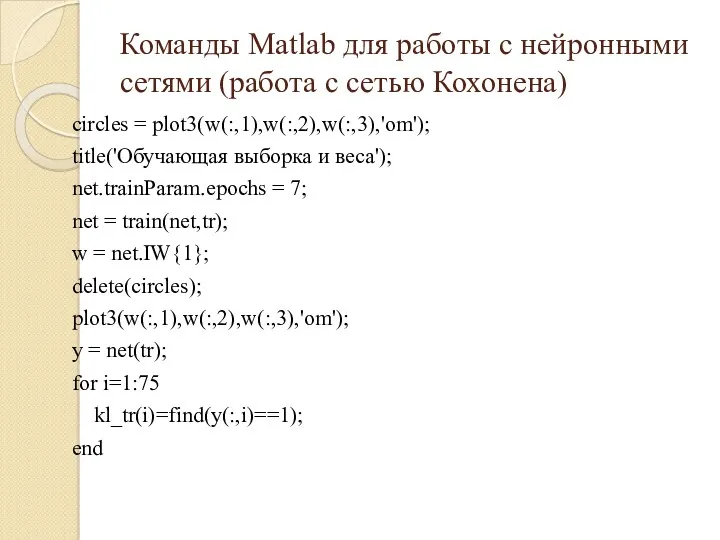

- 43. Команды Matlab для работы с нейронными сетями (работа с сетью Кохонена) circles = plot3(w(:,1),w(:,2),w(:,3),'om'); title('Обучающая выборка

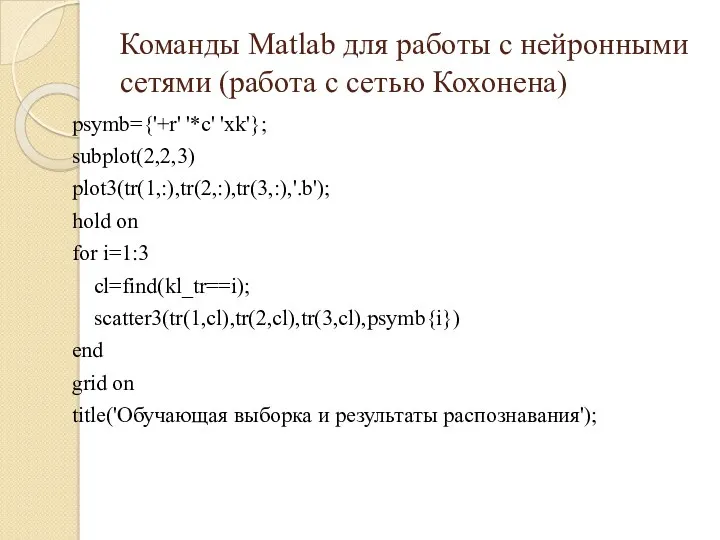

- 44. Команды Matlab для работы с нейронными сетями (работа с сетью Кохонена) psymb={'+r' '*c' 'xk'}; subplot(2,2,3) plot3(tr(1,:),tr(2,:),tr(3,:),'.b');

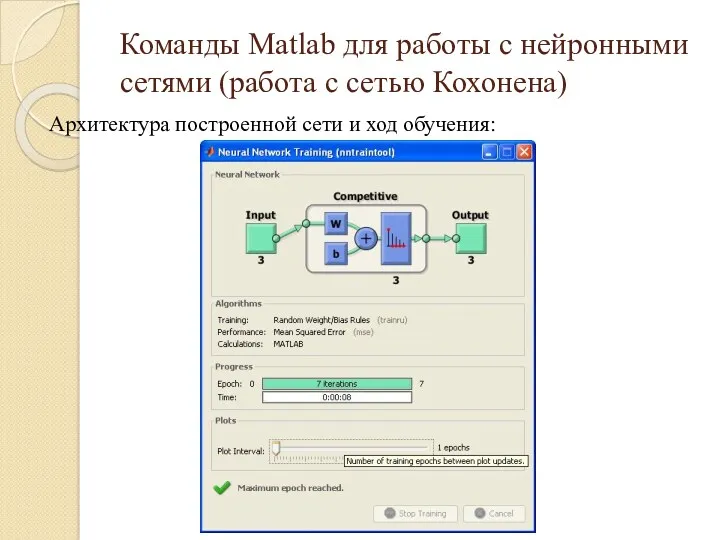

- 45. Команды Matlab для работы с нейронными сетями (работа с сетью Кохонена) Архитектура построенной сети и ход

- 47. Скачать презентацию

Безопасность и Интернет

Безопасность и Интернет Процесс регистрации контрагента на обучающей платформе ISmart

Процесс регистрации контрагента на обучающей платформе ISmart C++ тілінде бағдарламалау

C++ тілінде бағдарламалау Что такое блог. Какие бывают блоги

Что такое блог. Какие бывают блоги Дыбыстық ақпаратты өңдеу. Дыбыс жазу

Дыбыстық ақпаратты өңдеу. Дыбыс жазу Алгоритм, 4 класс

Алгоритм, 4 класс Представления о технических и программных средствах телекоммуникационных технологий. Лекция 33. Тема 5.1

Представления о технических и программных средствах телекоммуникационных технологий. Лекция 33. Тема 5.1 Информационный процесс представления знаний

Информационный процесс представления знаний Landmin бот

Landmin бот Сайты для саморазвития и обучения

Сайты для саморазвития и обучения Шаблоны параллельного проектирования

Шаблоны параллельного проектирования Открытый урок по топологии локальных сетей

Открытый урок по топологии локальных сетей Техническое обеспечение реализации информационных технологий

Техническое обеспечение реализации информационных технологий Профессии связанные с компьютером

Профессии связанные с компьютером Мессенджеры - интернет-программы обмена мгновенными сообщениями

Мессенджеры - интернет-программы обмена мгновенными сообщениями Электронная почта

Электронная почта Автоматическая обработка информации. Машина Поста

Автоматическая обработка информации. Машина Поста Формирование личностных УУД через внеурочную деятельность по информатике в 5 классе

Формирование личностных УУД через внеурочную деятельность по информатике в 5 классе Правовые основы защиты информации

Правовые основы защиты информации Основи JavaScript. (Лекцiя 6)

Основи JavaScript. (Лекцiя 6) Реляционные базы данных

Реляционные базы данных Юридическая обработка правовой информации

Юридическая обработка правовой информации Кроссбраузерность

Кроссбраузерность Алгоритмы и структуры данных. Лекция 2-4

Алгоритмы и структуры данных. Лекция 2-4 Прорывные технологии

Прорывные технологии Перечисления и массивы

Перечисления и массивы XAMPP. Basic objects of MySQL. Data types of MySQL

XAMPP. Basic objects of MySQL. Data types of MySQL Поняття електронної таблиці

Поняття електронної таблиці