Содержание

- 2. Две переменные X и Y

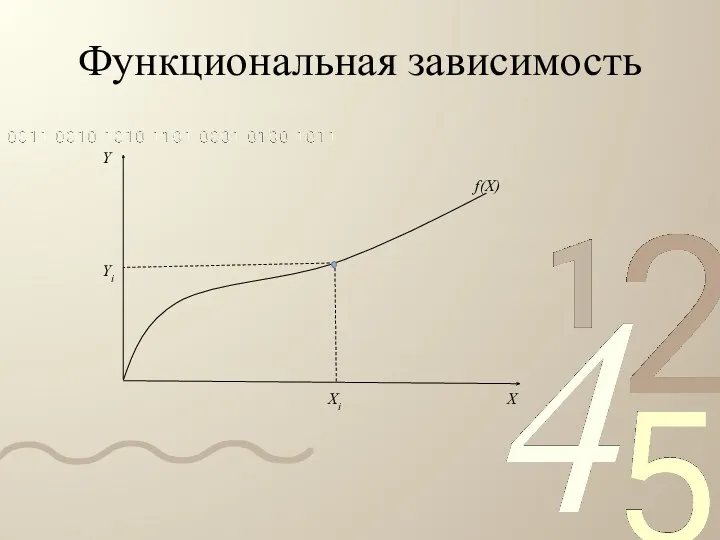

- 3. Функциональная зависимость

- 4. Независимость

- 5. Статистическая зависимость Если при изменении X меняется закон распределения случайной величины Y, то говорят, что величины

- 6. Статистическая зависимость Здесь будет красивый рисунок (когда-нибудь)

- 7. Статистическая зависимость Статистическая зависимость называется корреляционной, если при изменении X меняется математическое ожидание случайной величины Y.

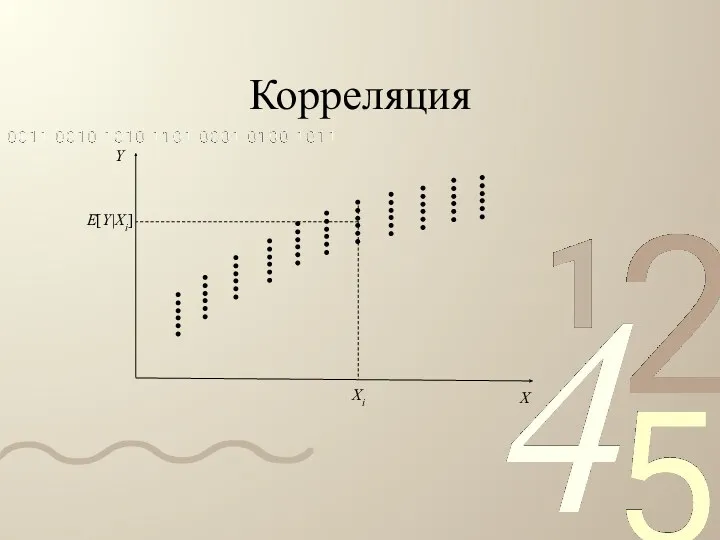

- 8. Корреляция

- 9. Корреляция

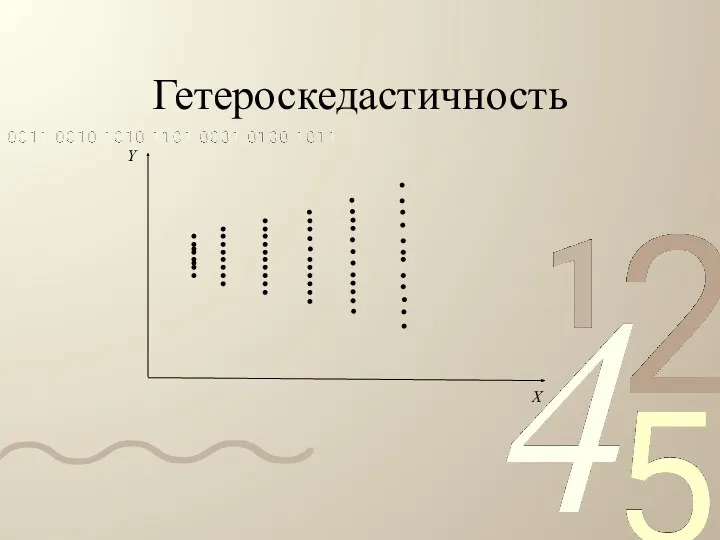

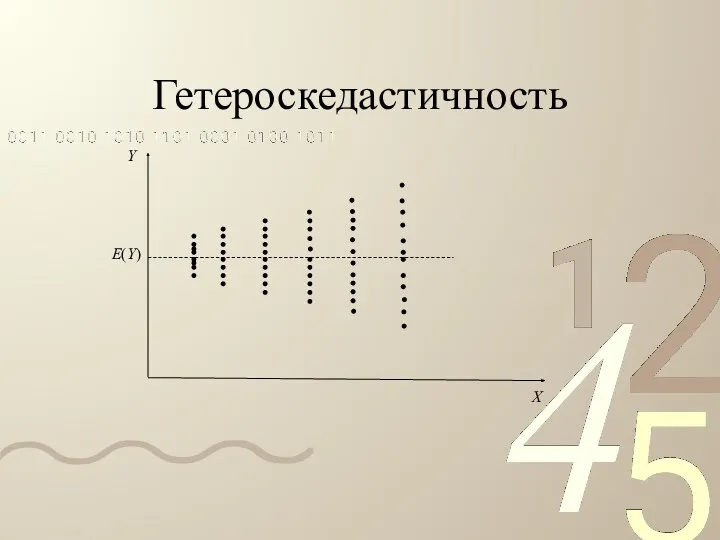

- 10. Гетероскедастичность

- 11. Гетероскедастичность

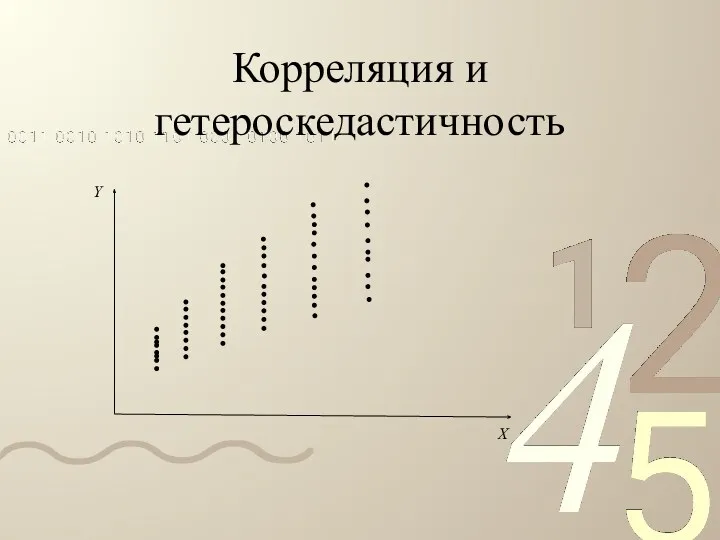

- 12. Корреляция и гетероскедастичность

- 13. Корреляция и гетероскедастичность

- 14. Корреляционная зависимость Если каждому значению величины X соответствует свое значение то говорят, что существует регрессионная функция

- 15. Случайная составляющая Отклонение переменной Y от математического ожидания для соответствующего значения переменной X называется ошибкой и

- 16. Регрессионное уравнение Уравнение называется уравнением регрессии переменной Y на переменную X

- 17. Компоненты Y

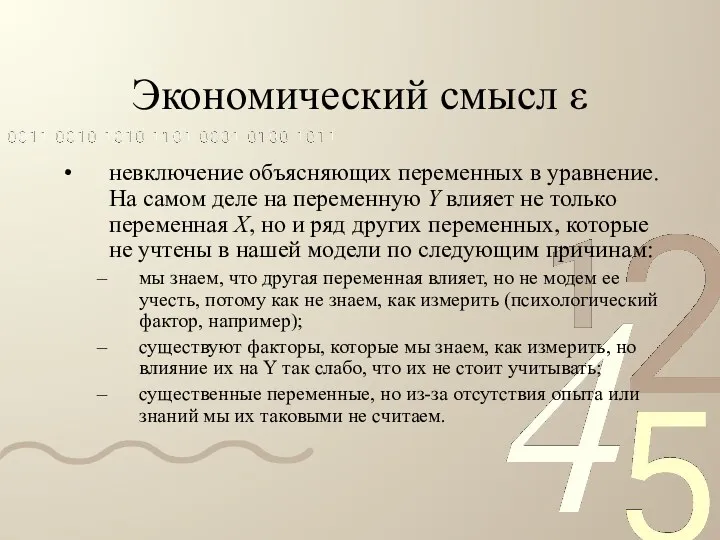

- 18. Экономический смысл ε невключение объясняющих переменных в уравнение. На самом деле на переменную Y влияет не

- 19. Экономический смысл ε (продолжение) Неправильная функциональная спецификация. Функциональное соотношение между Y и Х может быть определено

- 20. Способы определения регрессионной функции f(X) параметрический – предполагаем, что вид регрессионной функции известен, неизвестны параметры функции

- 21. Выбор вида f(X) экономическая теория опыт, интуиция исследователя эмпирический анализ данных

- 22. Эмпирический анализ данных В парном случае материал наблюдений представляет собой набор пар чисел: .

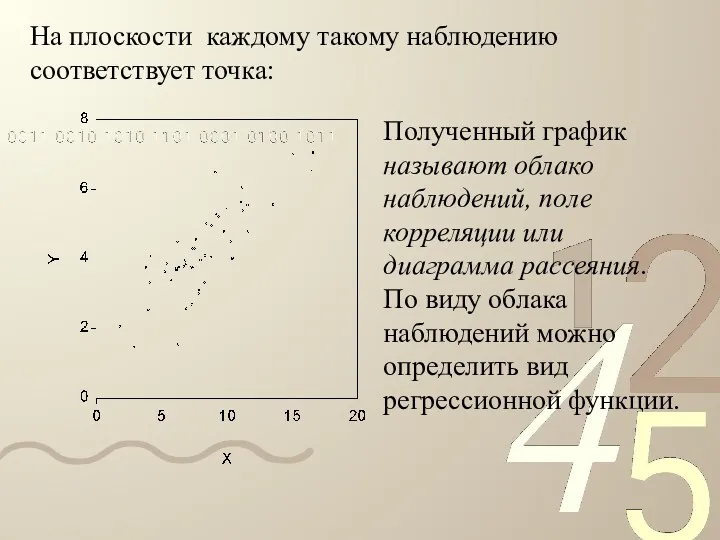

- 23. На плоскости каждому такому наблюдению соответствует точка: Полученный график называют облако наблюдений, поле корреляции или диаграмма

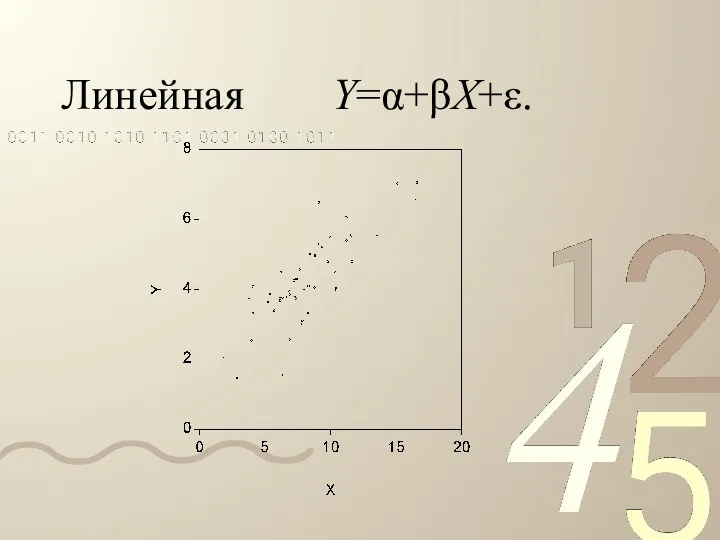

- 24. Линейная Y=α+βX+ε.

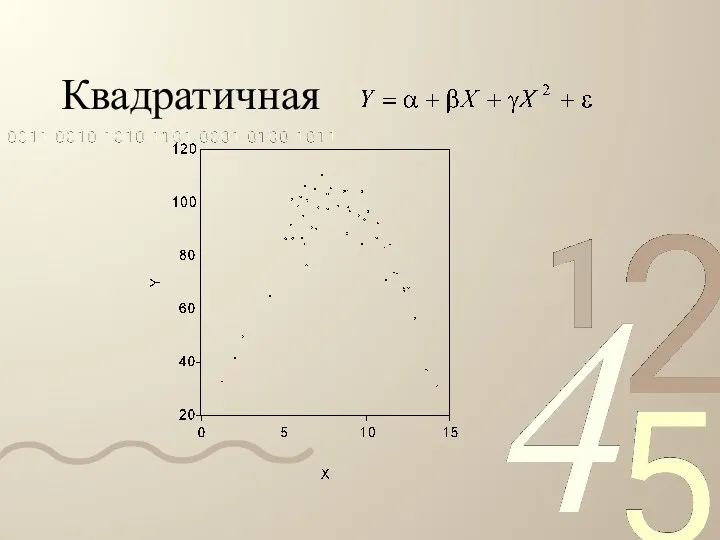

- 25. Квадратичная

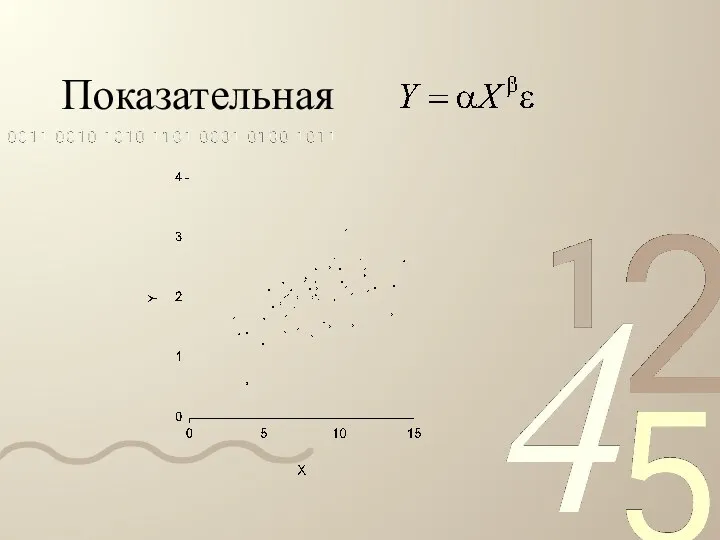

- 26. Показательная

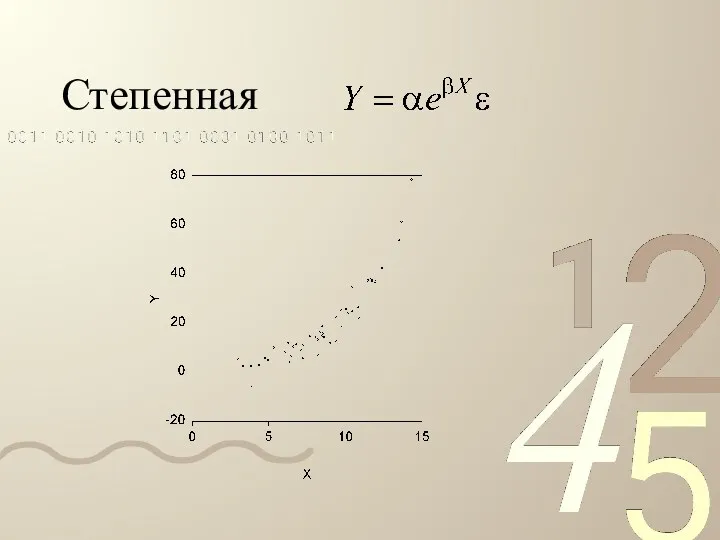

- 27. Степенная

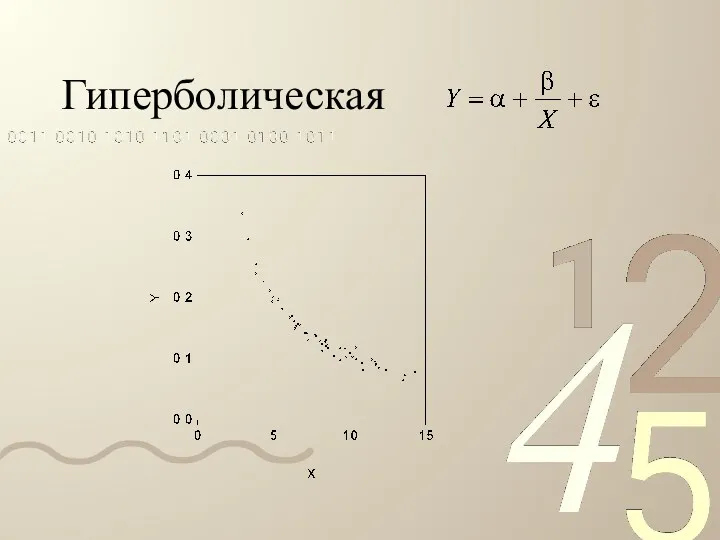

- 28. Гиперболическая

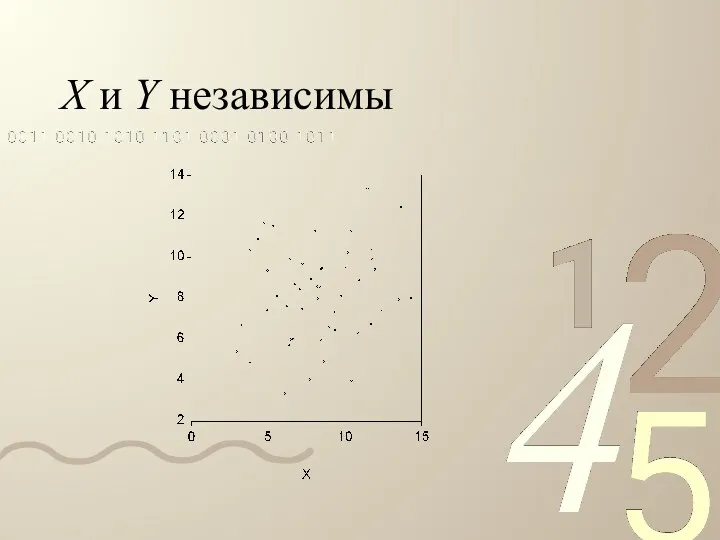

- 29. X и Y независимы

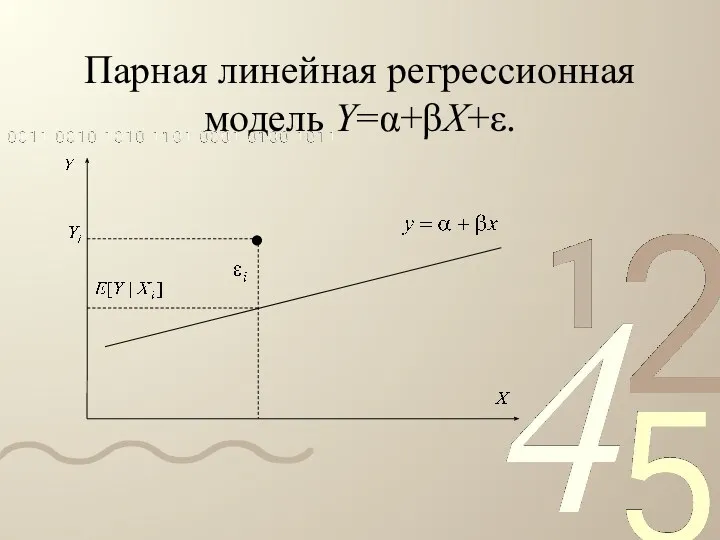

- 30. Парная линейная регрессионная модель Y=α+βX+ε.

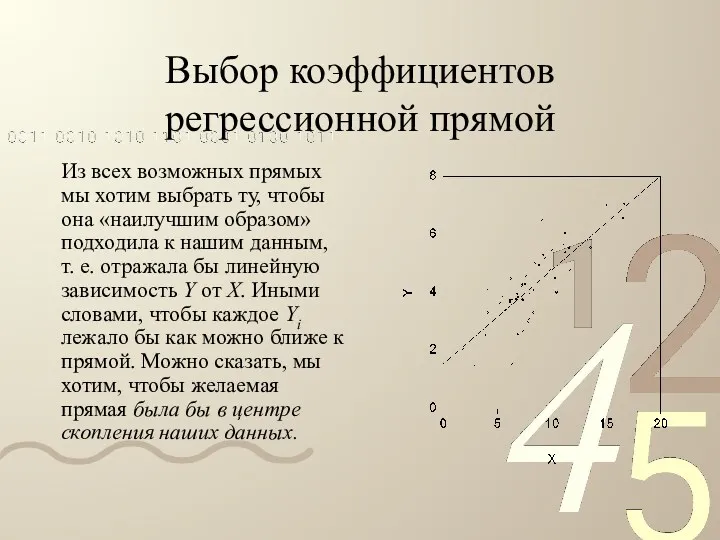

- 31. Выбор коэффициентов регрессионной прямой Из всех возможных прямых мы хотим выбрать ту, чтобы она «наилучшим образом»

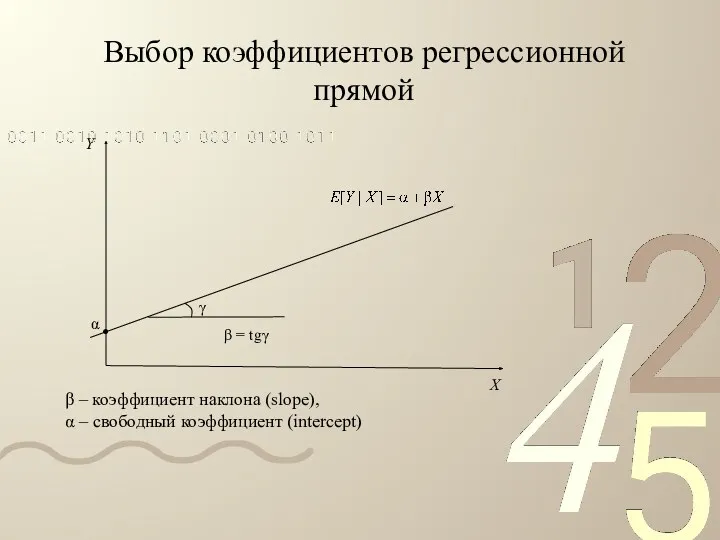

- 32. Выбор коэффициентов регрессионной прямой β – коэффициент наклона (slope), α – свободный коэффициент (intercept)

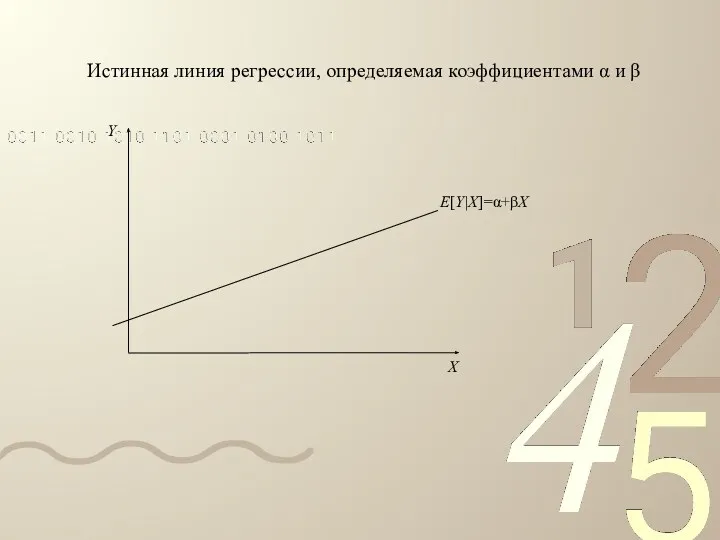

- 33. Истинная линия регрессии, определяемая коэффициентами α и β

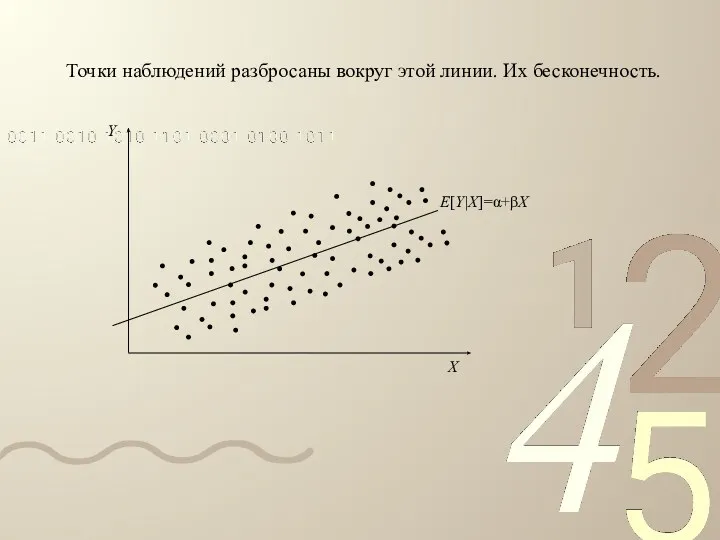

- 34. Точки наблюдений разбросаны вокруг этой линии. Их бесконечность.

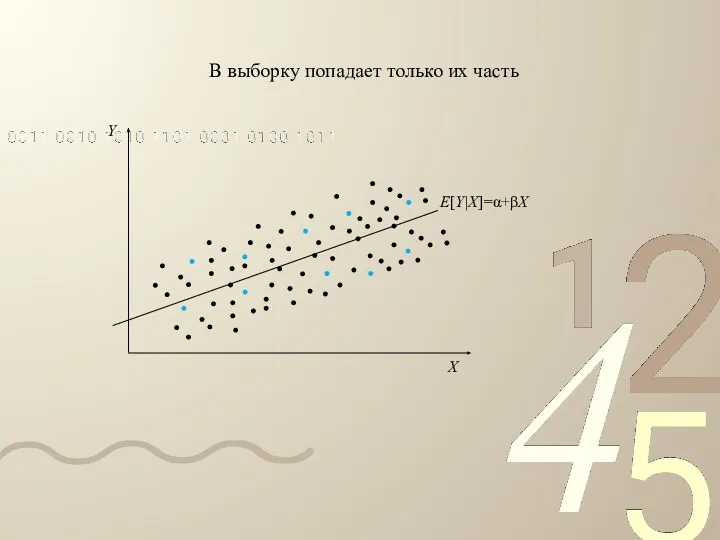

- 35. В выборку попадает только их часть

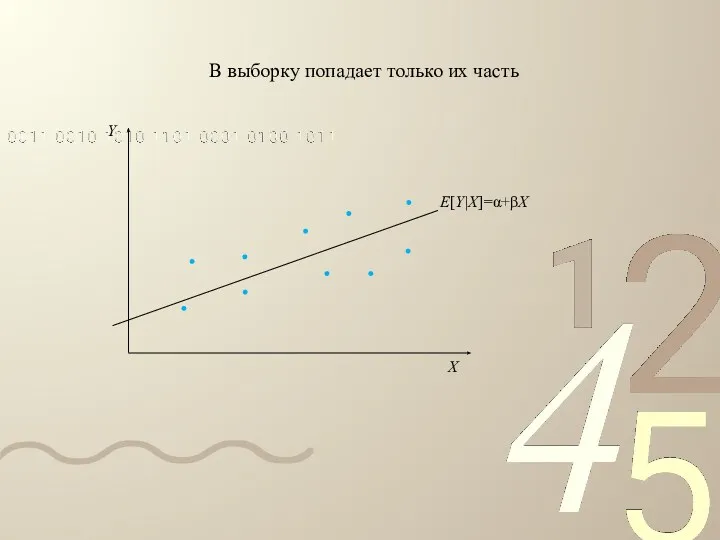

- 36. В выборку попадает только их часть

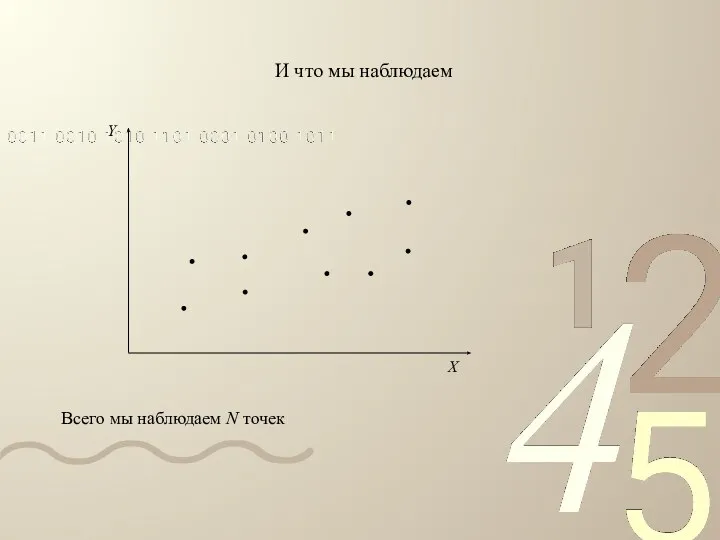

- 37. И что мы наблюдаем Всего мы наблюдаем N точек

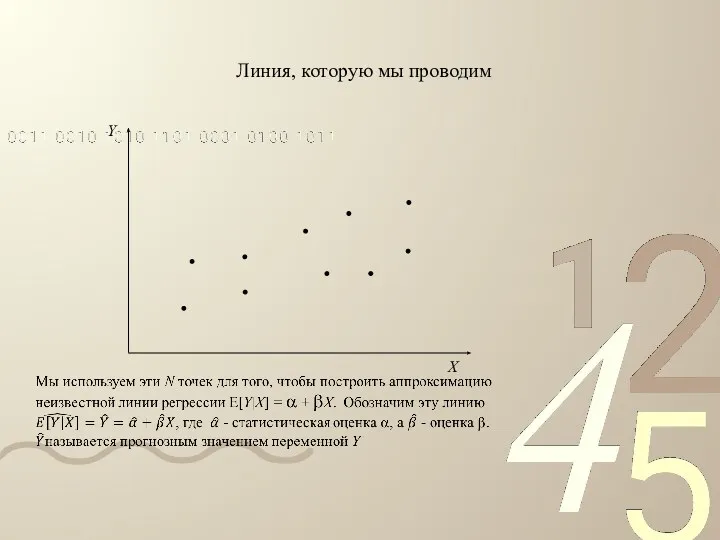

- 38. Линия, которую мы проводим

- 39. Линия, которую мы проводим Проводим прямую через центр скопления точек облака наблюдений, т. е. таким образом,

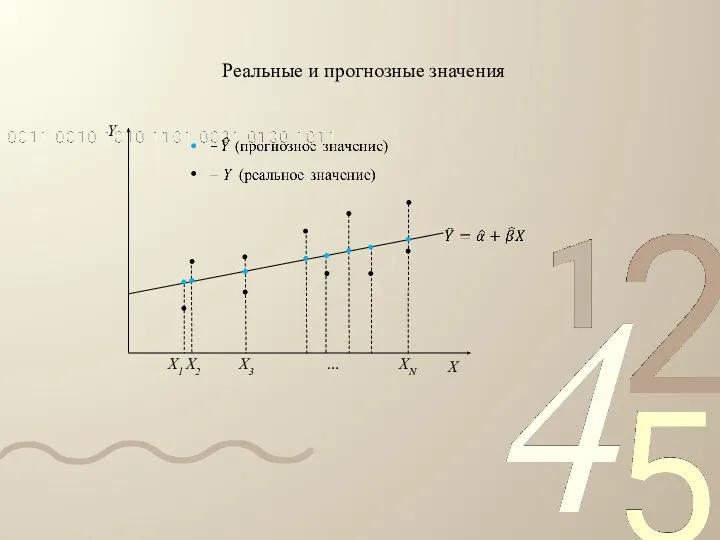

- 40. Реальные и прогнозные значения

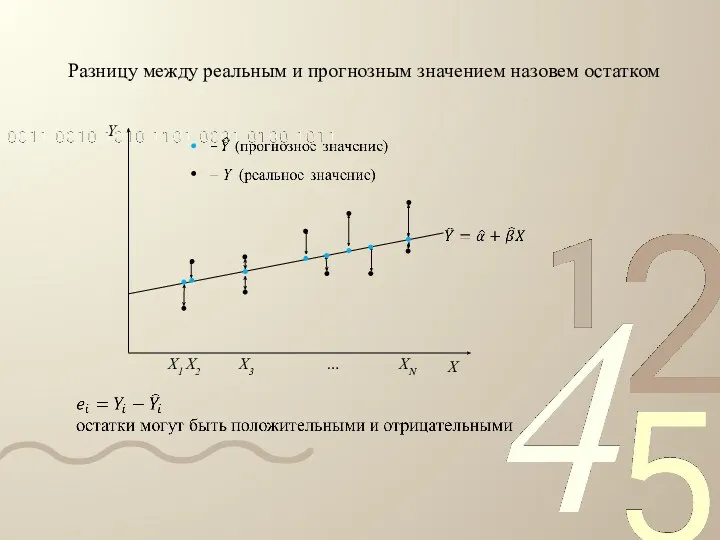

- 41. Разницу между реальным и прогнозным значением назовем остатком

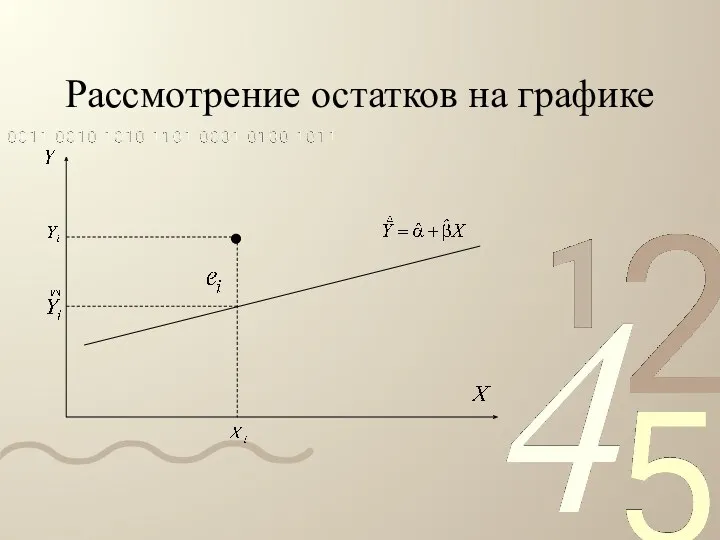

- 42. Рассмотрение остатков на графике

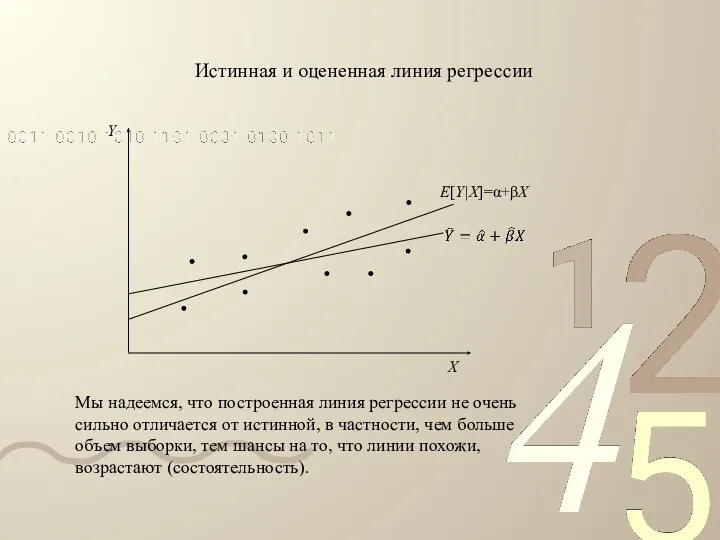

- 43. Истинная и оцененная линия регрессии Мы надеемся, что построенная линия регрессии не очень сильно отличается от

- 44. Грусть печаль Метод наименьших квадратов не всегда состоятельный

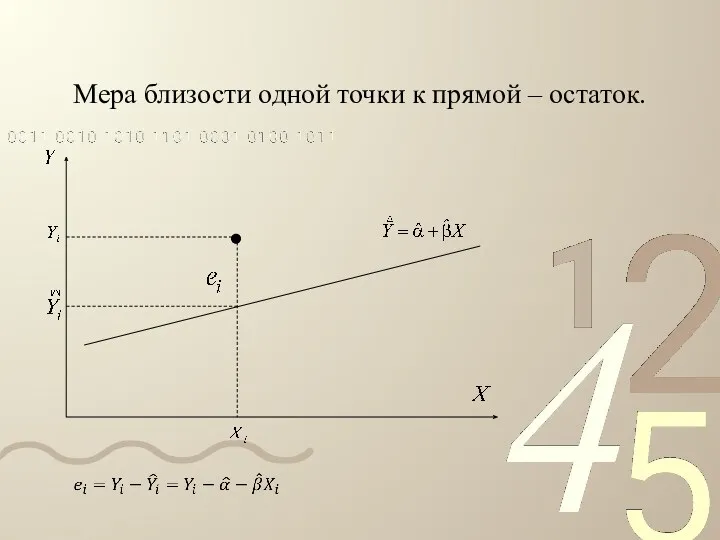

- 45. Как найти «наилучшую» прямую аналитически? Выберем меру близости одной точки к прямой. Построим интегральную меру близости

- 46. Мера близости одной точки к прямой – остаток.

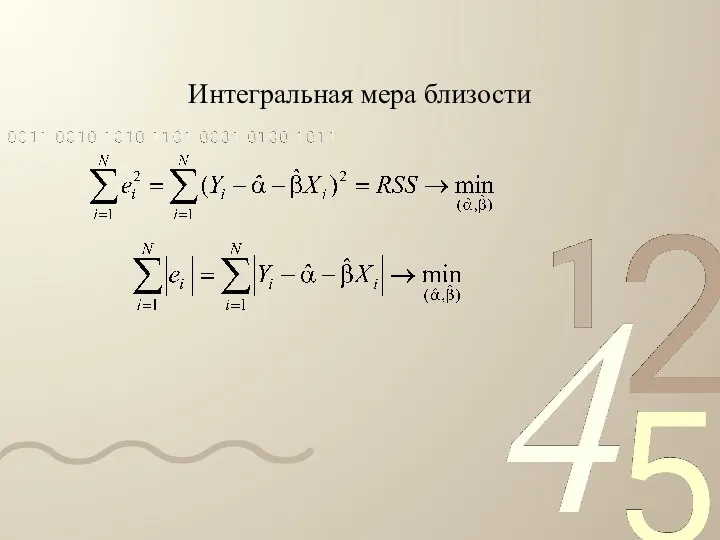

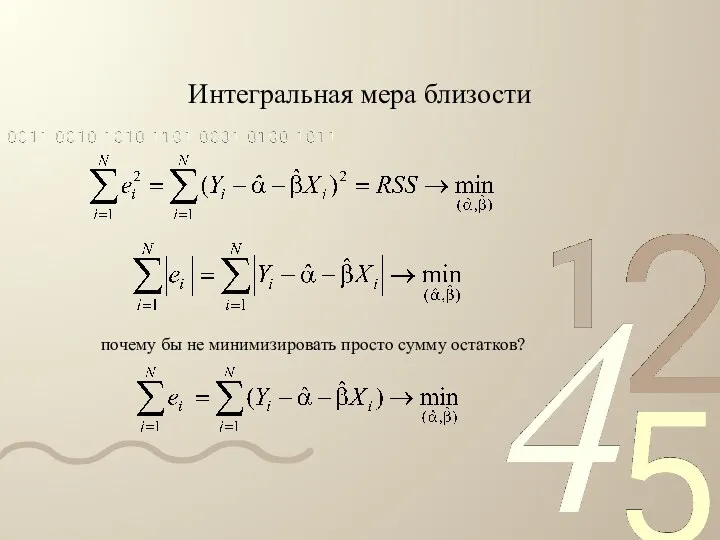

- 47. Интегральная мера близости

- 48. Интегральная мера близости почему бы не минимизировать просто сумму остатков?

- 49. Для какой прямой сумма остатков равна 0?

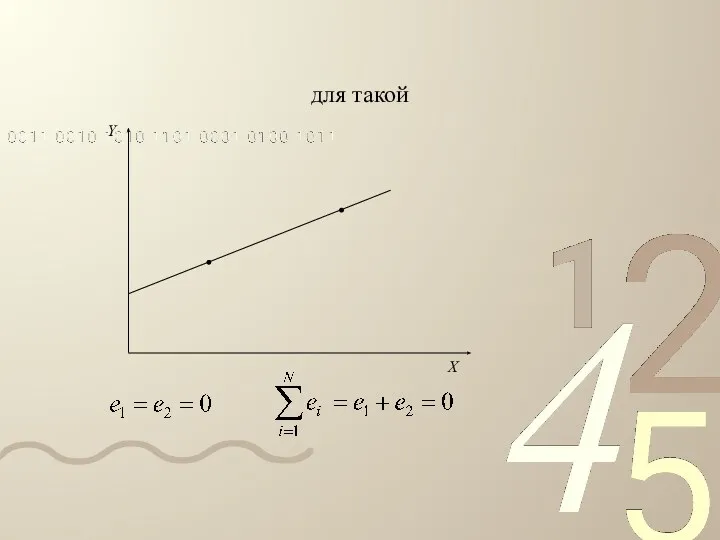

- 50. для такой

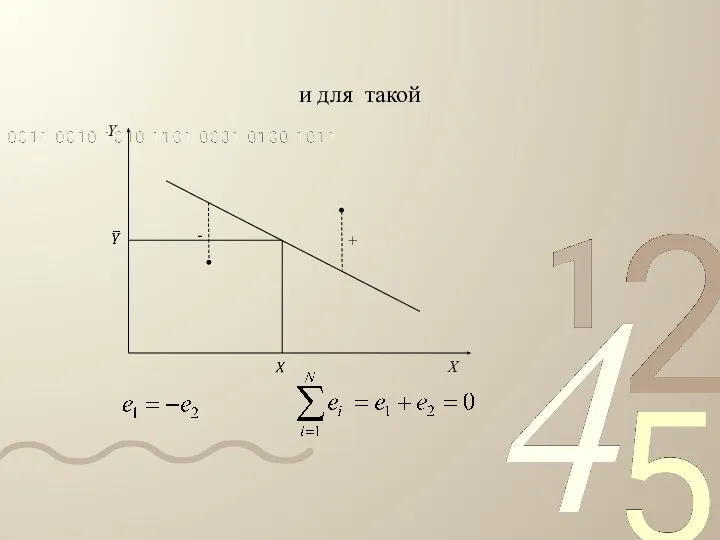

- 51. и для такой

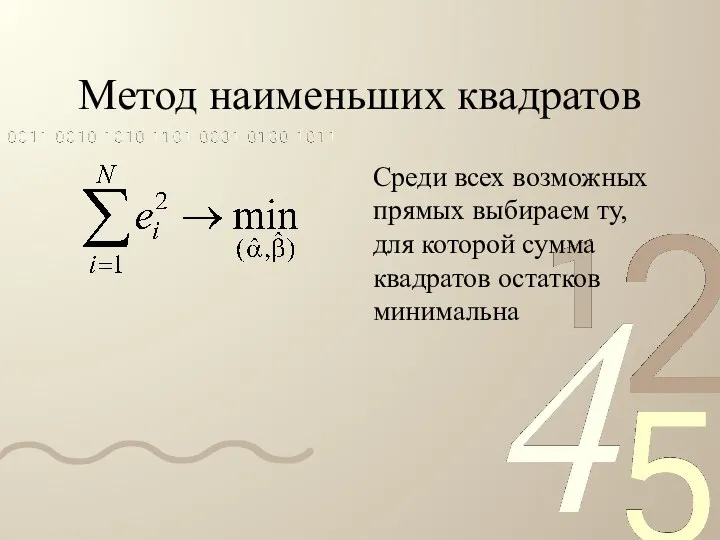

- 52. Метод наименьших квадратов Среди всех возможных прямых выбираем ту, для которой сумма квадратов остатков минимальна

- 53. Минимизация или

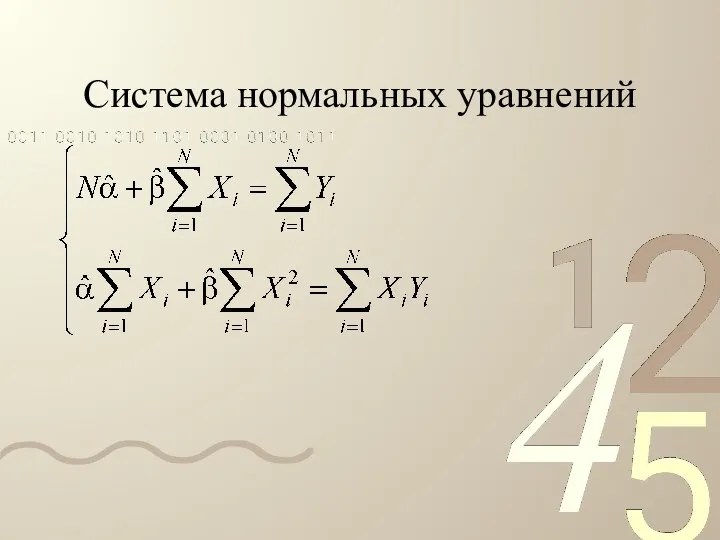

- 54. Система нормальных уравнений

- 55. МНК-коэффициенты ПЛРМ - коэффициент наклона - свободный коэффициент

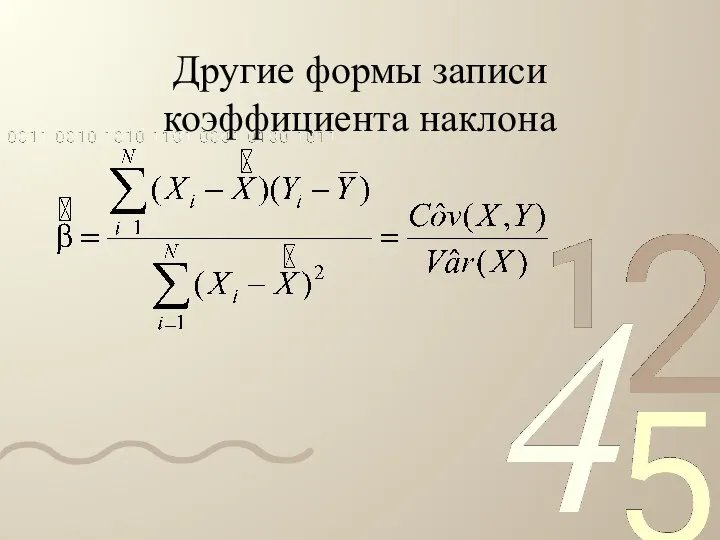

- 56. Другие формы записи коэффициента наклона

- 57. Замечания Линия регрессии проходит через точку Мы предполагаем, что среди Xi есть разные, тогда dX ≠

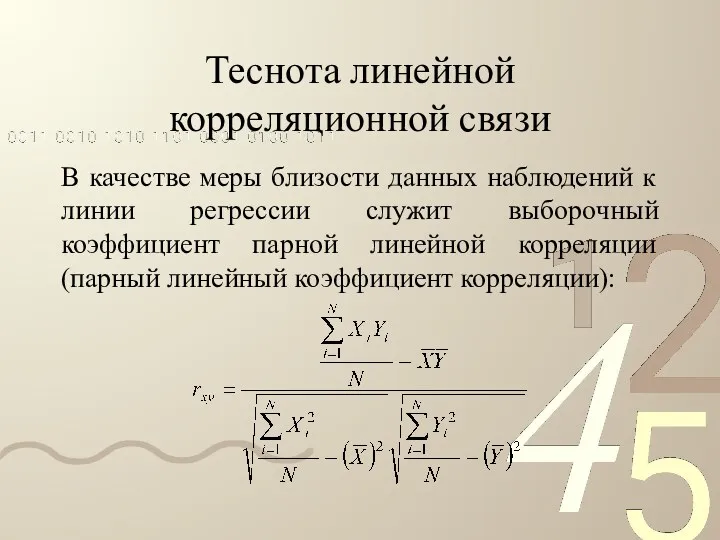

- 58. Теснота линейной корреляционной связи В качестве меры близости данных наблюдений к линии регрессии служит выборочный коэффициент

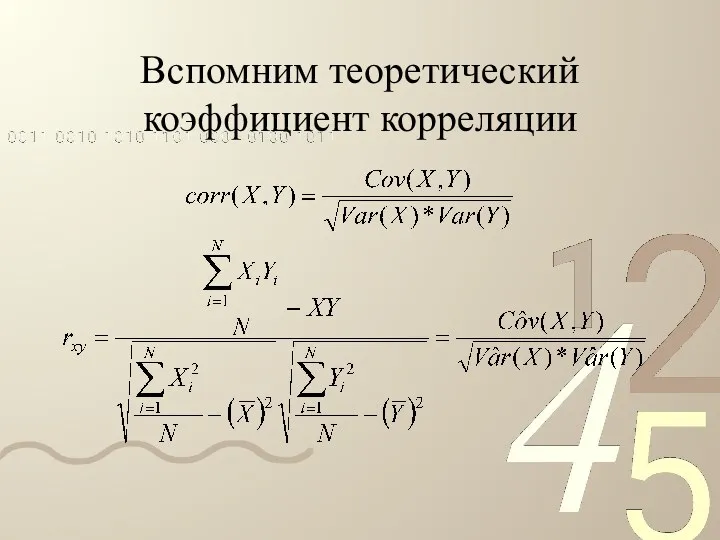

- 59. Вспомним теоретический коэффициент корреляции

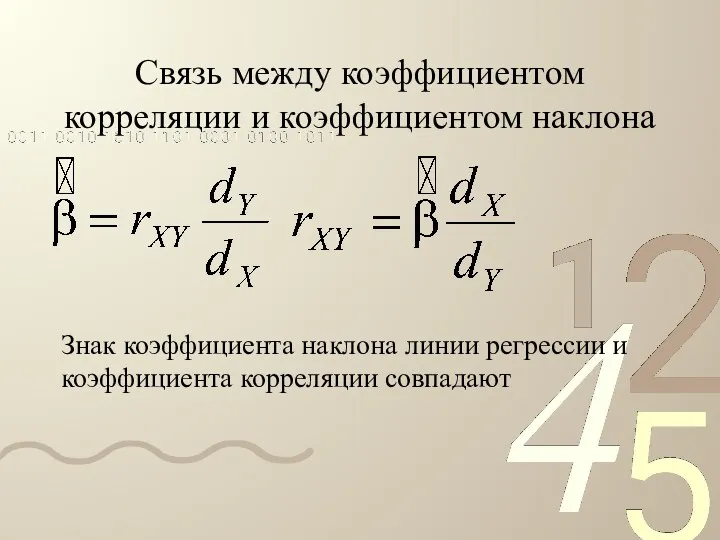

- 60. Связь между коэффициентом корреляции и коэффициентом наклона Знак коэффициента наклона линии регрессии и коэффициента корреляции совпадают

- 61. Положительная корреляция С ростом переменной X переменная Y в среднем растет (имеет тенденцию к росту)

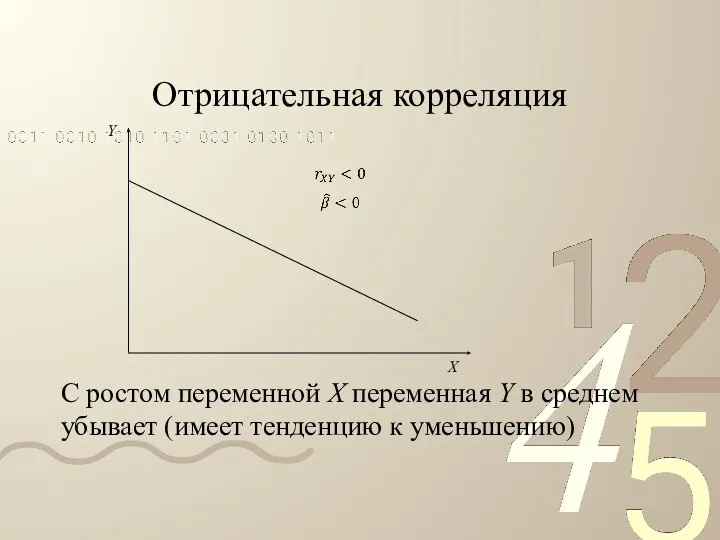

- 62. Отрицательная корреляция С ростом переменной X переменная Y в среднем убывает (имеет тенденцию к уменьшению)

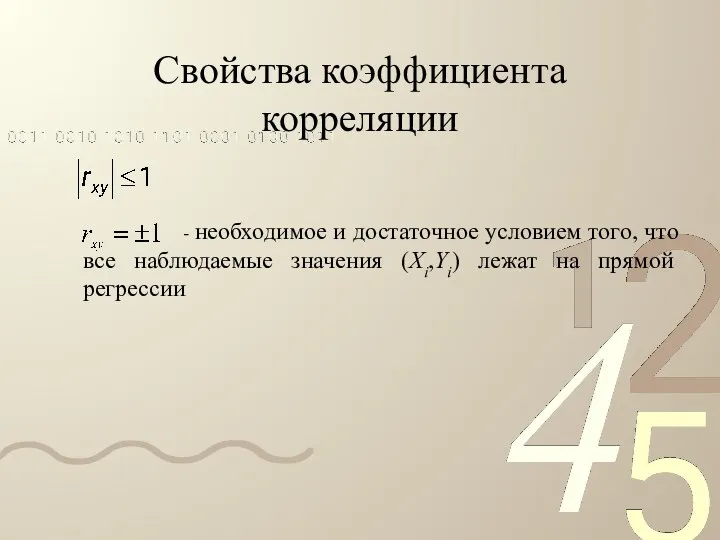

- 63. Свойства коэффициента корреляции - необходимое и достаточное условием того, что все наблюдаемые значения (Xi,Yi) лежат на

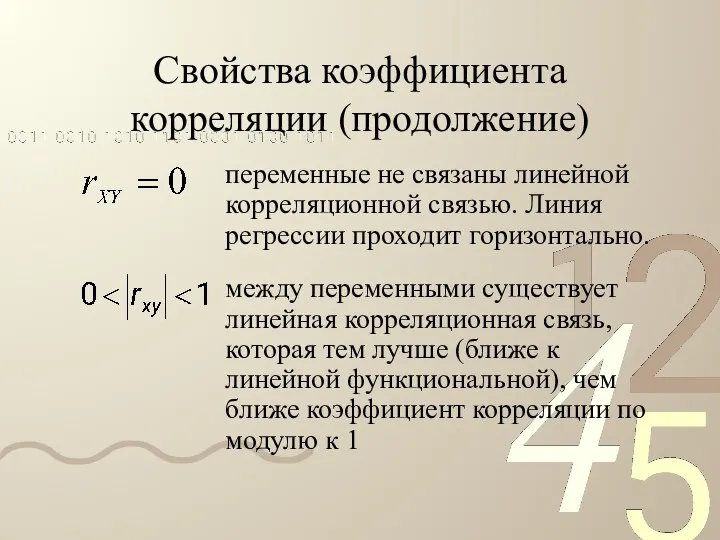

- 64. Свойства коэффициента корреляции (продолжение) переменные не связаны линейной корреляционной связью. Линия регрессии проходит горизонтально. между переменными

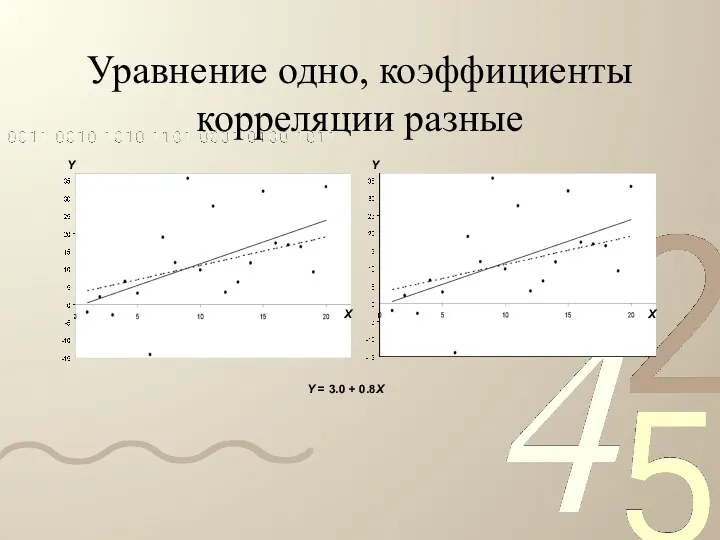

- 65. Уравнение одно, коэффициенты корреляции разные

- 67. Скачать презентацию

Математический ринг. Игра

Математический ринг. Игра Числовые и буквенные выражения. Урок математики 5 класс

Числовые и буквенные выражения. Урок математики 5 класс Вычисление периметра прямоугольника (квадрата). 6 класс

Вычисление периметра прямоугольника (квадрата). 6 класс Математический калейдоскоп

Математический калейдоскоп Величины. Арифметический диктант

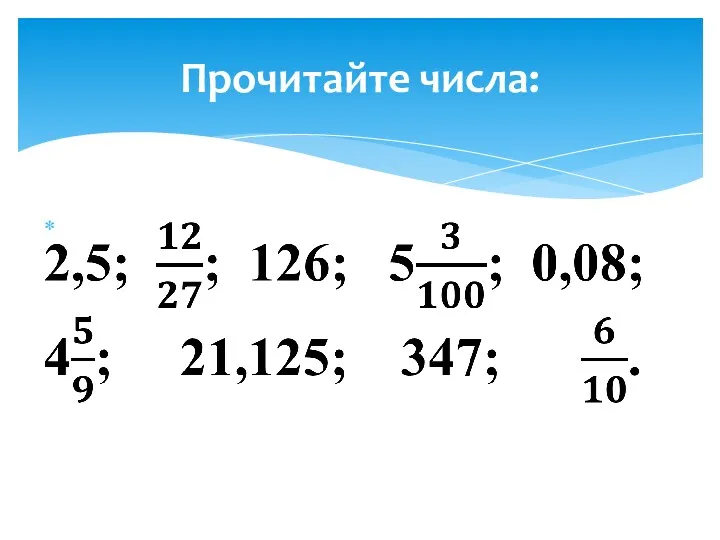

Величины. Арифметический диктант Сложение и вычитание десятичных дробей. 6 класс

Сложение и вычитание десятичных дробей. 6 класс История космонавтики в цифрах

История космонавтики в цифрах Сложение чисел с помощью координатной прямой

Сложение чисел с помощью координатной прямой Своя игра. Четырехугольники

Своя игра. Четырехугольники Произведение положительных и отрицательных чисел

Произведение положительных и отрицательных чисел Теоремы сложения и умножения вероятностей

Теоремы сложения и умножения вероятностей Случаи вычитания 14-, 15 -

Случаи вычитания 14-, 15 - Единицы длины

Единицы длины Презентация Прямая (геометрический материал)

Презентация Прямая (геометрический материал) Действия с дробями (урок-обобщение). 6 класс

Действия с дробями (урок-обобщение). 6 класс Вписанные и центральные углы

Вписанные и центральные углы Правильные многогранники. Симметрия в пространстве

Правильные многогранники. Симметрия в пространстве Периметр треугольника. Построение треугольника по заданным сторонам

Периметр треугольника. Построение треугольника по заданным сторонам Ознакомление детей младшего возраста с общими математическими понятиями

Ознакомление детей младшего возраста с общими математическими понятиями ЦОР Система заданий, упражнений по развитию математических способностей для детей с ОНР

ЦОР Система заданий, упражнений по развитию математических способностей для детей с ОНР Задачи в стихах

Задачи в стихах Сравнение трёхзначных чисел. 3 класс

Сравнение трёхзначных чисел. 3 класс Арксинус. Решение уравнений вида arcsin t=a

Арксинус. Решение уравнений вида arcsin t=a Формулы сложения

Формулы сложения Сложение и вычитание десятичных дробей

Сложение и вычитание десятичных дробей Путешествие в страну дробей. Из истории дробей. 5 класс

Путешествие в страну дробей. Из истории дробей. 5 класс Математический зоопарк

Математический зоопарк Сравнение предметов.

Сравнение предметов.