Слайд 2

Два подхода к измерению информации

Можно измерять количество информации в контексте

компьютерного представления информации такой подход называется "алфавитным". Он не связан с содержанием текста.

Содержательный подход подразумевает оценку содержания полученной информации с точки зрения ее полезности. При этом под полезной частью информации понимается та часть сообщения, которая снимает полностью или уменьшает существовавшую до ее получения неопределенность какой-либо ситуации.

Слайд 3

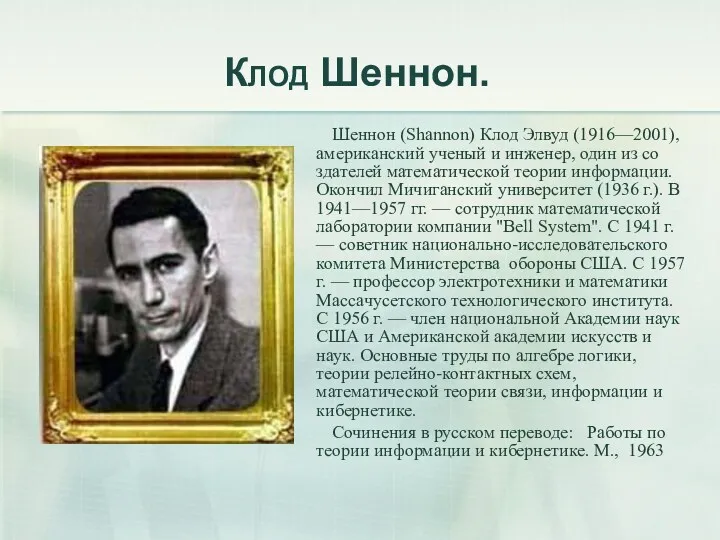

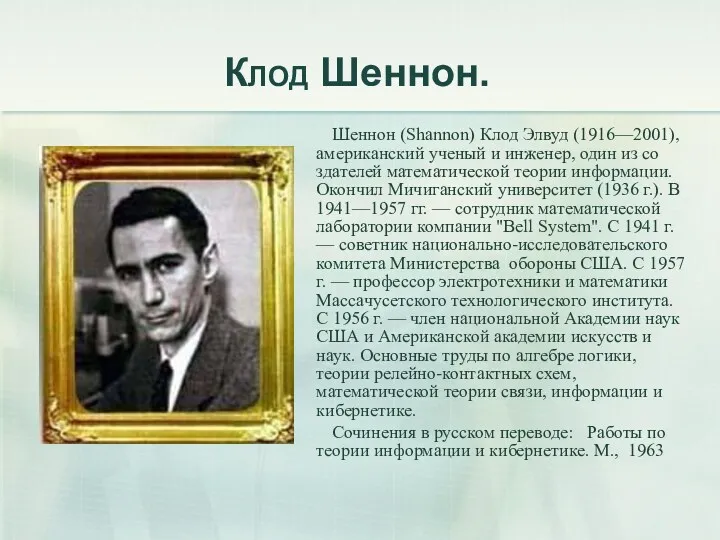

Клод Шеннон.

Шеннон (Shannon) Клод Элвуд (1916—2001), американский ученый и инженер,

один из создателей математической теории информации. Окончил Мичиганский университет (1936 г.). В 1941—1957 гг. — сотрудник математической лаборатории компании "Bell System". С 1941 г. — советник национально-исследовательского комитета Министерства обороны США. С 1957 г. — профессор электротехники и математики Массачусетского технологического института. С 1956 г. — член национальной Академии наук США и Американской академии искусств и наук. Основные труды по алгебре логики, теории релейно-контактных схем, математической теории связи, информации и кибернетике.

Сочинения в русском переводе: Работы по теории информации и кибернетике. М., 1963

Слайд 4

Столица России — Москва.

Сумма квадратов катетов равна

квадрату гипотенузы.

Дифракцией света называется

совокупность явлений, которые обусловлены волновой природой света и наблюдаются при его распространении в среде с резко выраженной оптической неоднородностью.

Эйфелева башня имеет высоту 300 метров и вес 9000 тонн.

Слайд 5

Сообщение несет больше информации, если в нем содержатся новые и

понятные сведения. Такое сообщение называется информативным.

Количество информации зависит от информативности.

Количество информации в некотором сообщении равно нулю, если оно с точки зрения конкретного человека неинформативно. Количество информации в информативном сообщении больше нуля.

Слайд 6

Если некоторое сообщение является информативным, следовательно, оно пополняет нас знаниями или

уменьшает неопределенность наших знаний. Другими словами сообщение содержит информацию, если оно приводит к уменьшению неопределенности наших знаний.

Слайд 7

Такое количество информации, которое находится в сообщении о том, что произошло

одно событие из двух равновероятных, принято за единицу измерения информации и равно 1 биту.

1 бит — это количество информации, уменьшающее неопределенность знаний в два раза.

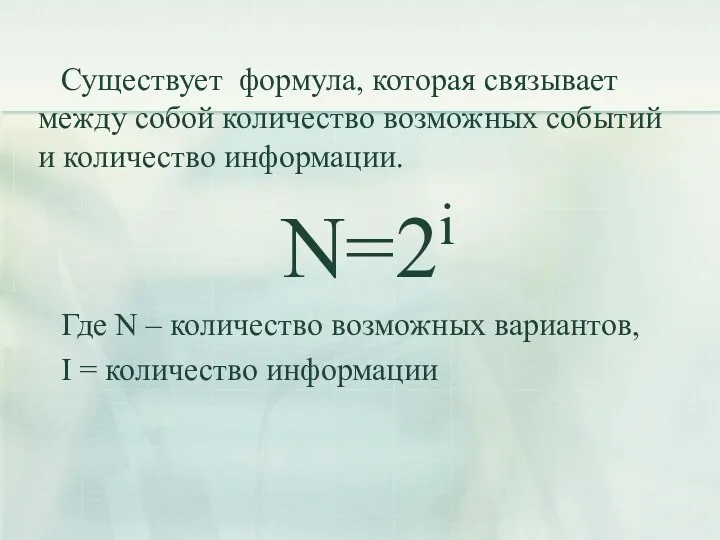

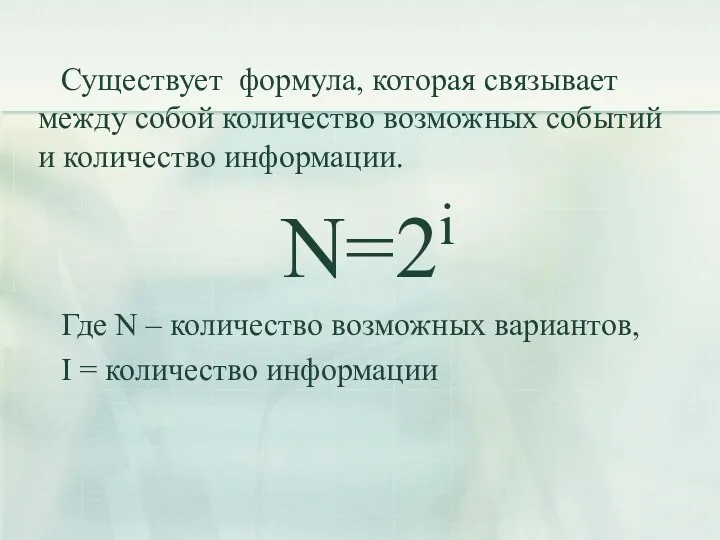

Слайд 8

Существует формула, которая связывает между собой количество возможных событий и количество

информации.

N=2i

Где N – количество возможных вариантов,

I = количество информации

Слайд 9

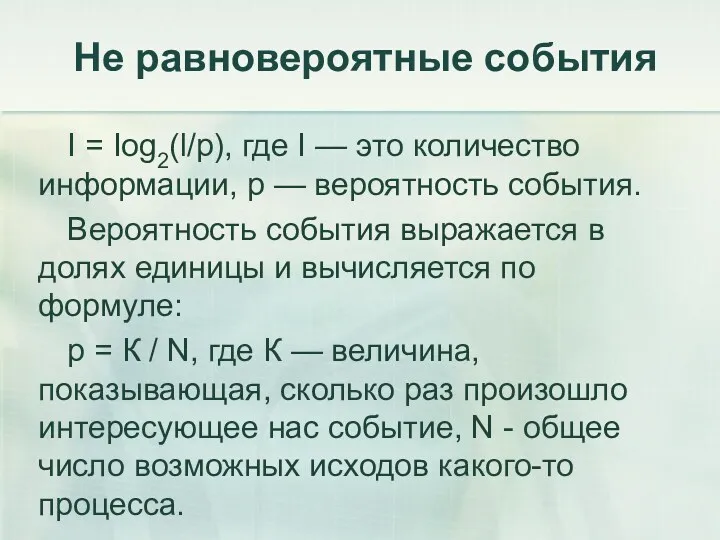

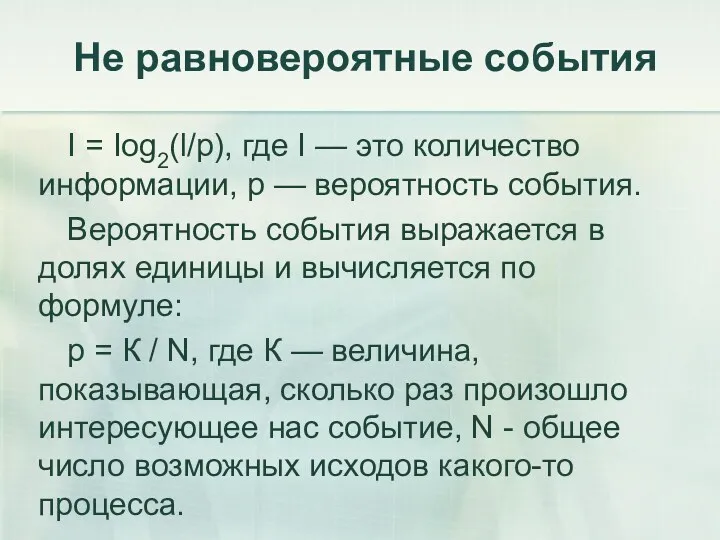

Не равновероятные события

I = Iog2(l/p), где I — это количество информации,

р — вероятность события.

Вероятность события выражается в долях единицы и вычисляется по формуле:

р = К / N, где К — величина, показывающая, сколько раз произошло интересующее нас событие, N - общее число возможных исходов какого-то процесса.

Компьютерные сети

Компьютерные сети Криминалистический анализ реестра операционной системы Windows

Криминалистический анализ реестра операционной системы Windows Рекурсия. Перебор. Методы сокращения перебора

Рекурсия. Перебор. Методы сокращения перебора SignalR, Xamarin и Azure - проверка на прочность

SignalR, Xamarin и Azure - проверка на прочность Строим свой сайт

Строим свой сайт Использование голосового помощника Маруся в образовании

Использование голосового помощника Маруся в образовании Основные принципы построения и применения CПО МПС

Основные принципы построения и применения CПО МПС создание_приложений_2

создание_приложений_2 Java SE 5. ООП в Java. Основные понятия

Java SE 5. ООП в Java. Основные понятия Является ли интернет важной частью нашей жизни

Является ли интернет важной частью нашей жизни Компьютерная лексикография (электронные словари в интернете)

Компьютерная лексикография (электронные словари в интернете) Informatics. Introduction

Informatics. Introduction CSMA/CD. Carrier-Sense Multiple Access with Collision Detection множественный доступ с контролем несущей и обнаружением коллизий

CSMA/CD. Carrier-Sense Multiple Access with Collision Detection множественный доступ с контролем несущей и обнаружением коллизий Компьютеры в современном мире

Компьютеры в современном мире Глобальные сети

Глобальные сети Использование электронных средств обучения

Использование электронных средств обучения Разработка урока Информация и знания

Разработка урока Информация и знания Збереження інформації

Збереження інформації Использование MS Office для автоматизации профессиональной деятельности. Microsoft Word. Microsoft Office XP. ч.2

Использование MS Office для автоматизации профессиональной деятельности. Microsoft Word. Microsoft Office XP. ч.2 Обзор онлайн аудитории Беларуси

Обзор онлайн аудитории Беларуси Queue

Queue Решение задач с использованием ввода-вывода из файлов

Решение задач с использованием ввода-вывода из файлов Интернет-ресурсы успешного педагога

Интернет-ресурсы успешного педагога Штриховое кодирование и маркировка товаров

Штриховое кодирование и маркировка товаров Работа с дефектами

Работа с дефектами двоичное кодирование графической информации в компьютере

двоичное кодирование графической информации в компьютере Двоичная арифметика

Двоичная арифметика Основы криптографии

Основы криптографии