Содержание

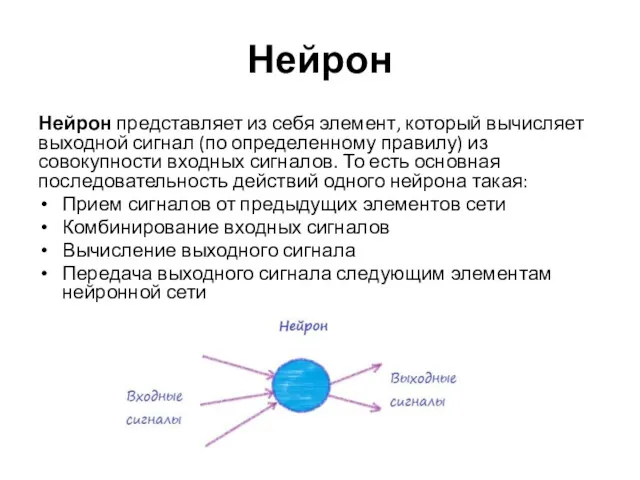

- 2. Нейрон Нейрон представляет из себя элемент, который вычисляет выходной сигнал (по определенному правилу) из совокупности входных

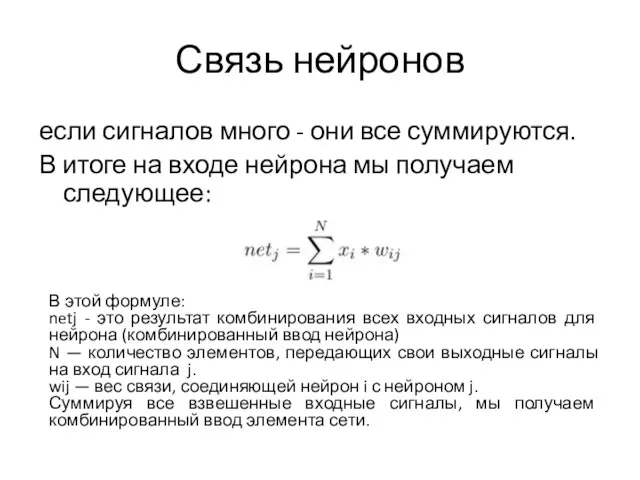

- 3. Связь нейронов Выходной сигнал нейрона 1 равен 5. Вес связи между нейронами равен 2. Таким образом,

- 4. Связь нейронов В этой формуле: netj - это результат комбинирования всех входных сигналов для нейрона (комбинированный

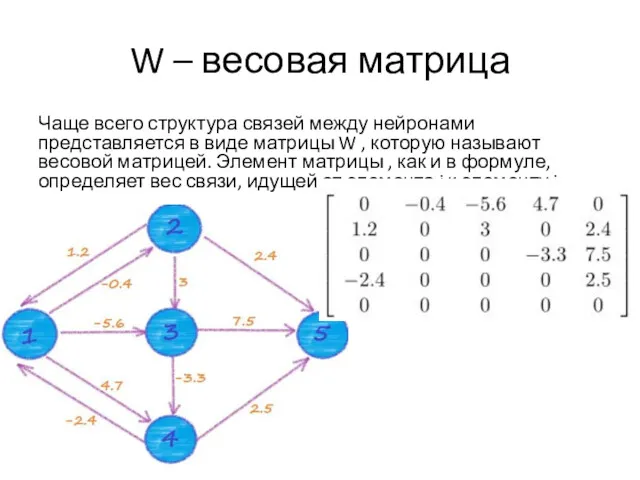

- 5. W – весовая матрица Чаще всего структура связей между нейронами представляется в виде матрицы W ,

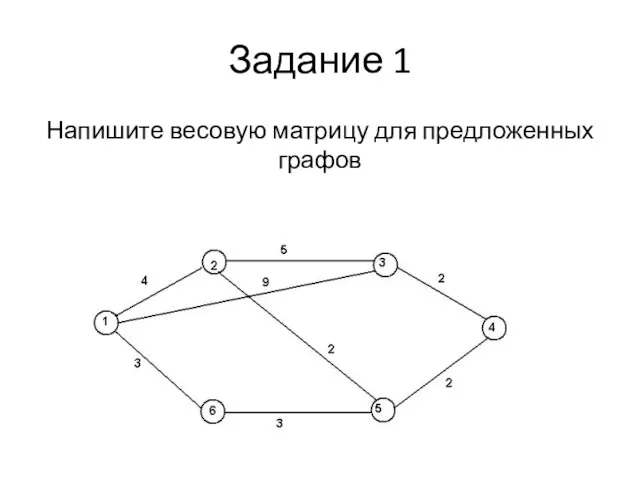

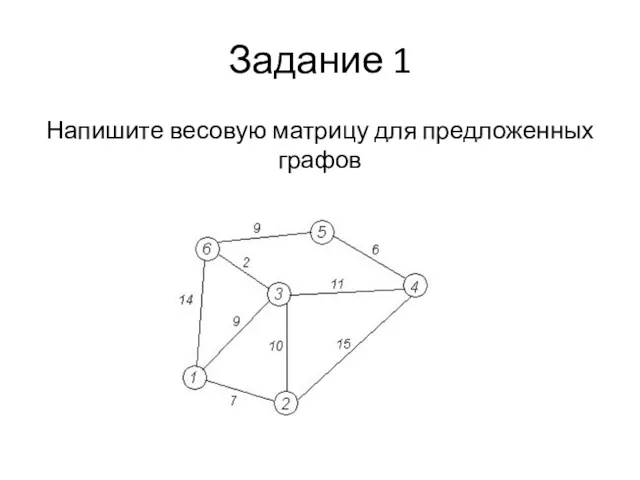

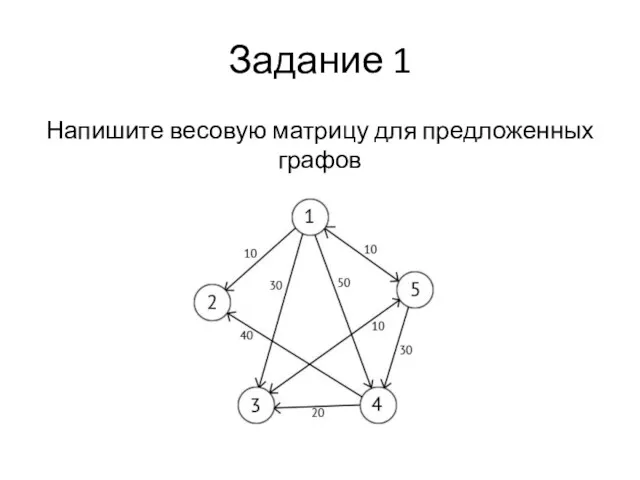

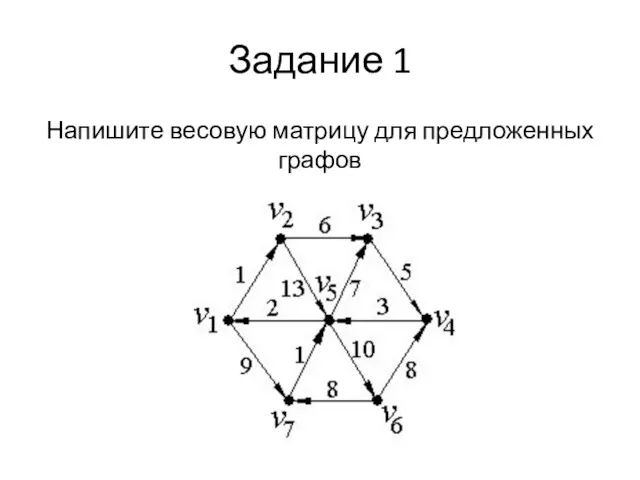

- 6. Задание 1 Напишите весовую матрицу для предложенных графов

- 7. Задание 1 Напишите весовую матрицу для предложенных графов

- 8. Задание 1 Напишите весовую матрицу для предложенных графов

- 9. Задание 1 Напишите весовую матрицу для предложенных графов

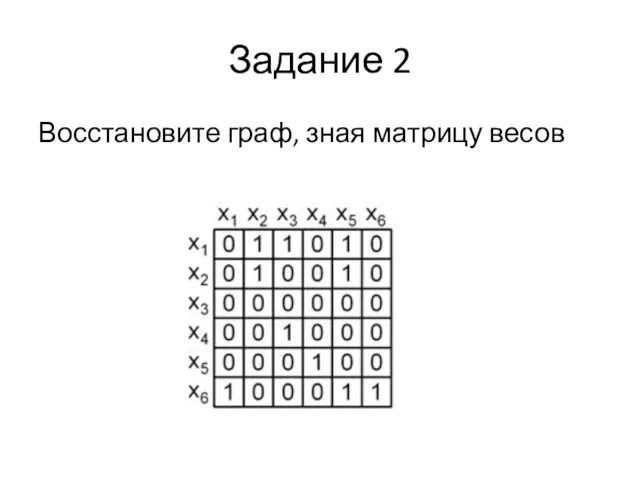

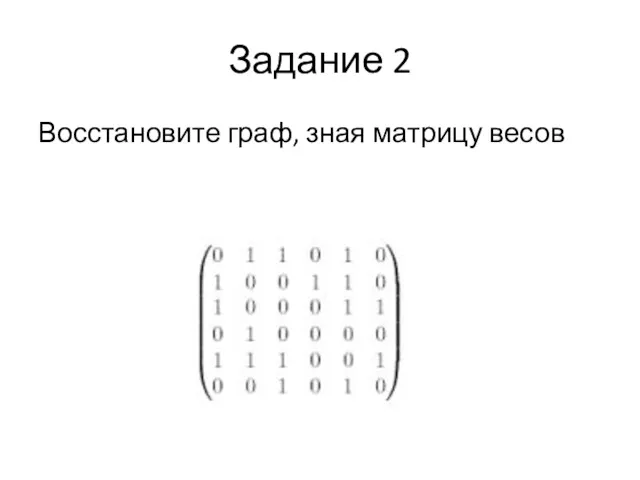

- 10. Задание 2 Восстановите граф, зная матрицу весов

- 11. Задание 2 Восстановите граф, зная матрицу весов

- 12. Задание 2 Восстановите граф, зная матрицу весов

- 13. Задание 2 Восстановите граф, зная матрицу весов

- 14. Функция активности элемента (активационная функция нейрона) Для каждого элемента сети имеется определенное правило, в соответствии с

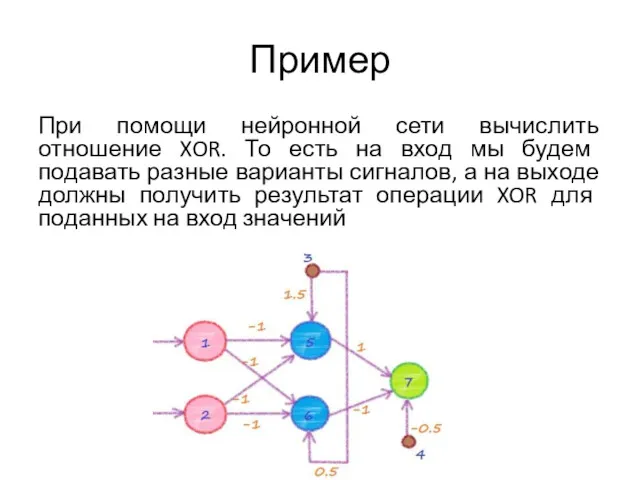

- 15. Пример При помощи нейронной сети вычислить отношение XOR. То есть на вход мы будем подавать разные

- 16. Пример Элементы 1 и 2 являются входными, а элемент 7 — выходным. Нейроны 5 и 6

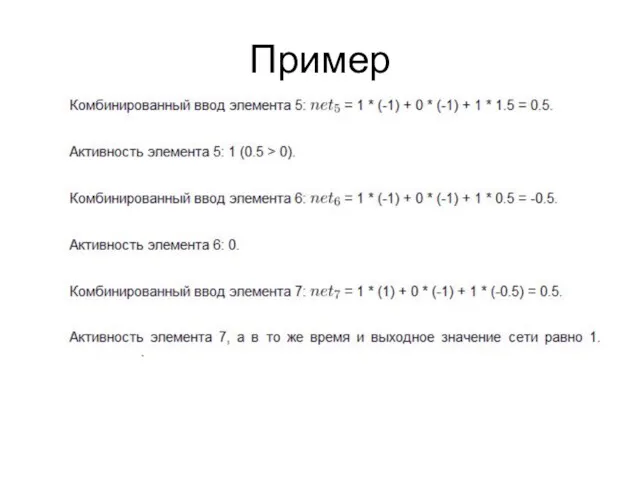

- 17. Пример

- 18. Задание 3 Для предложенной ранее сети, рассчитывающей значение операции XOR для остальных возможных активаций.

- 19. Особенность задания 3 В данном случае все значения весовых коэффициентов нам были известны заранее, но главной

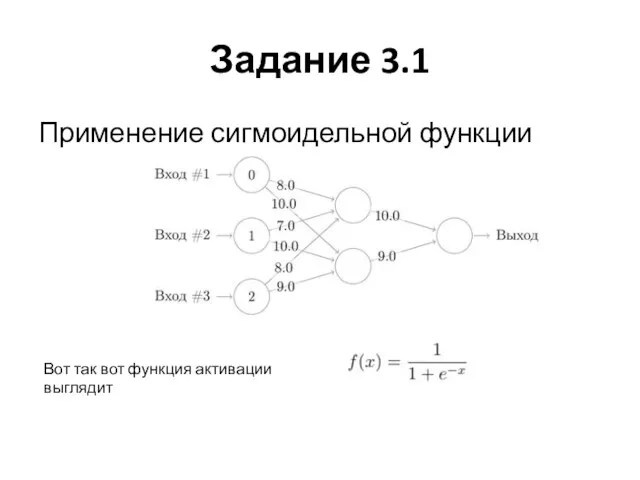

- 20. Задание 3.1 Применение сигмоидельной функции Вот так вот функция активации выглядит

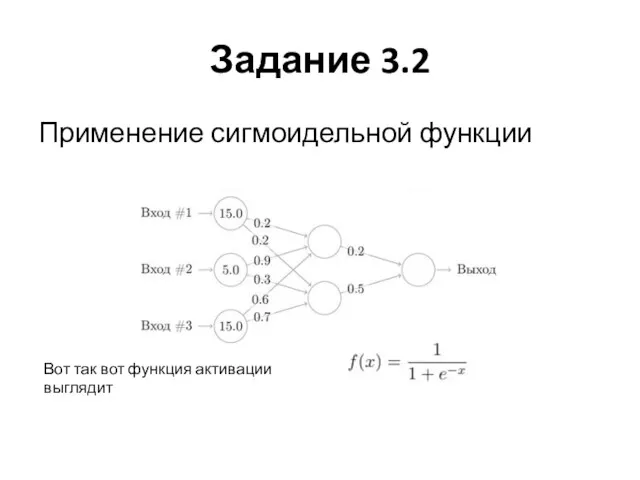

- 21. Задание 3.2 Применение сигмоидельной функции Вот так вот функция активации выглядит

- 22. Обучение нейронной сети Цель обучения: корректировка весовых коэффициентов связей сети. Одним из самых типичных способов является

- 23. Обучение нейронной сети Мы подаем на вход сети данные, после чего сеть вычисляет выходное значение. Мы

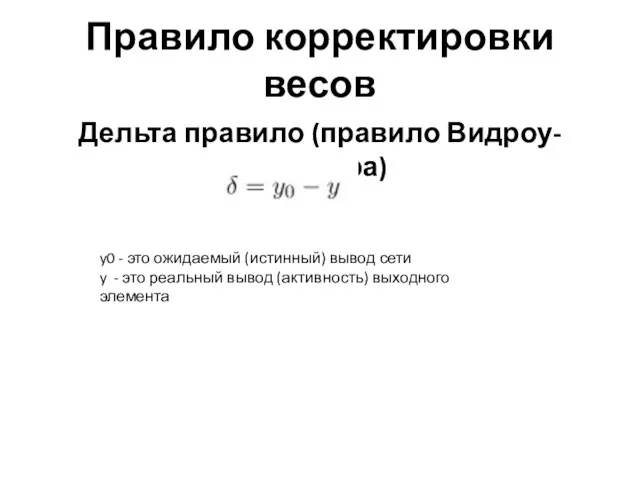

- 24. Правило корректировки весов Дельта правило (правило Видроу-Хоффа) y0 - это ожидаемый (истинный) вывод сети y -

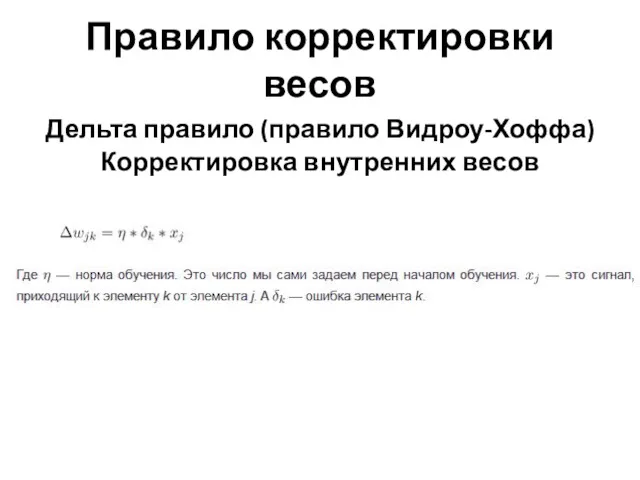

- 25. Правило корректировки весов Дельта правило (правило Видроу-Хоффа) Корректировка внутренних весов

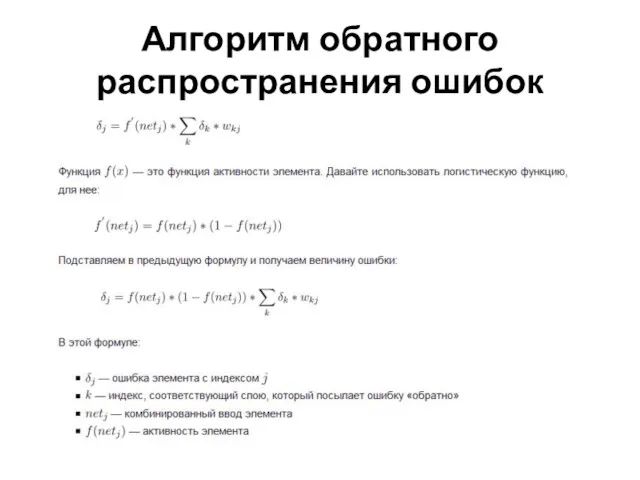

- 26. Алгоритм обратного распространения ошибок

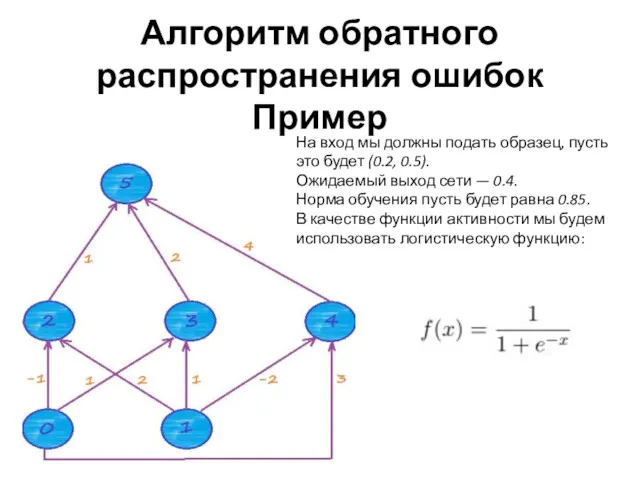

- 27. Алгоритм обратного распространения ошибок Пример На вход мы должны подать образец, пусть это будет (0.2, 0.5).

- 28. Алгоритм обратного распространения ошибок Пример

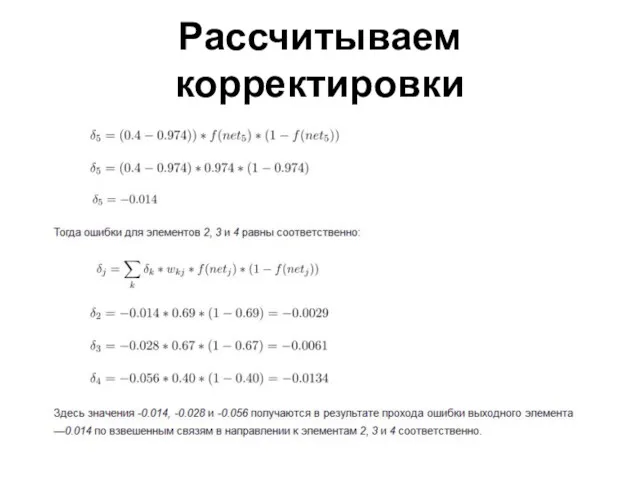

- 29. Рассчитываем корректировки

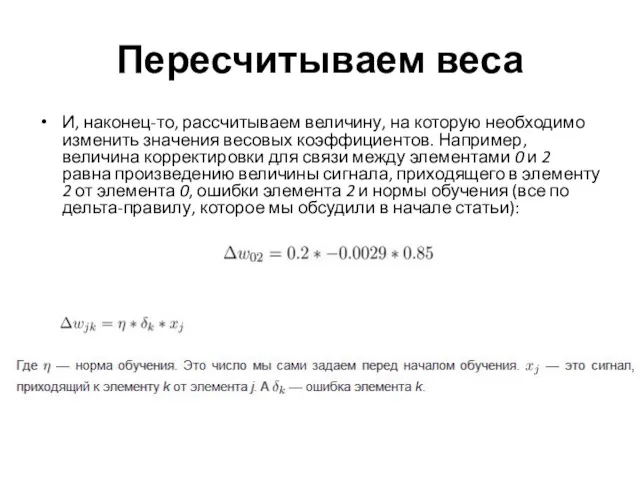

- 30. Пересчитываем веса И, наконец-то, рассчитываем величину, на которую необходимо изменить значения весовых коэффициентов. Например, величина корректировки

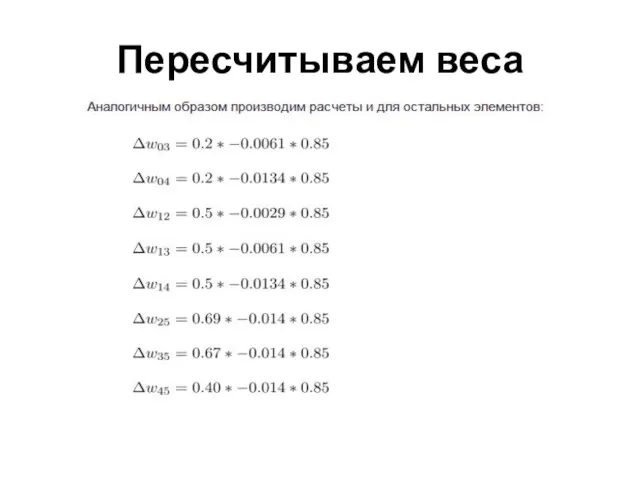

- 31. Пересчитываем веса

- 32. Алгоритм обратного распространения ошибок Пример На этом обратный проход по сети закончен, цель достигнута Именно так

- 34. Скачать презентацию

Оператор цикла с предусловием

Оператор цикла с предусловием Другие нейросети. Урок 4.3

Другие нейросети. Урок 4.3 Методы сортировок массивов

Методы сортировок массивов Динамикалық SQL

Динамикалық SQL Программирование на Паскале - первый уровень. Простые (линейные) программы

Программирование на Паскале - первый уровень. Простые (линейные) программы Основы алгебры логики. Логические основы компьютера

Основы алгебры логики. Логические основы компьютера Числовые данные 2 класс

Числовые данные 2 класс Структура и функции MS DOS

Структура и функции MS DOS Организация труда в конвергентной редакции мультимедийного СМИ

Организация труда в конвергентной редакции мультимедийного СМИ Массивы

Массивы Quicksort

Quicksort Основные понятия и принципы математического моделирования

Основные понятия и принципы математического моделирования География сферы услуг (инфографика)

География сферы услуг (инфографика) Разработка клиентских веб-приложений

Разработка клиентских веб-приложений Кодирование графической информации

Кодирование графической информации Этапы проектирования базы данных

Этапы проектирования базы данных Информационное общество

Информационное общество MobileTrans. Поддержка 3000 + телефонов и различных сетей

MobileTrans. Поддержка 3000 + телефонов и различных сетей Общие сведения о языке программирования Паскаль

Общие сведения о языке программирования Паскаль Умовні і циклічні конструкції JavaScript

Умовні і циклічні конструкції JavaScript Зачем нужна информатика

Зачем нужна информатика Параллельные и последовательные интерфейсы. ААС 05

Параллельные и последовательные интерфейсы. ААС 05 MS Excel в курсовой работе

MS Excel в курсовой работе Электронное пособие для оказания профориентационной поддержки школьникам

Электронное пособие для оказания профориентационной поддержки школьникам Основы логики.

Основы логики. Основы алгоритмизации и программирования

Основы алгоритмизации и программирования Website redesign

Website redesign ВКР: Совершенствование системы управления персоналом сервисного предприятия

ВКР: Совершенствование системы управления персоналом сервисного предприятия