Содержание

- 4. Физическая аналогия

- 5. Как он работает?

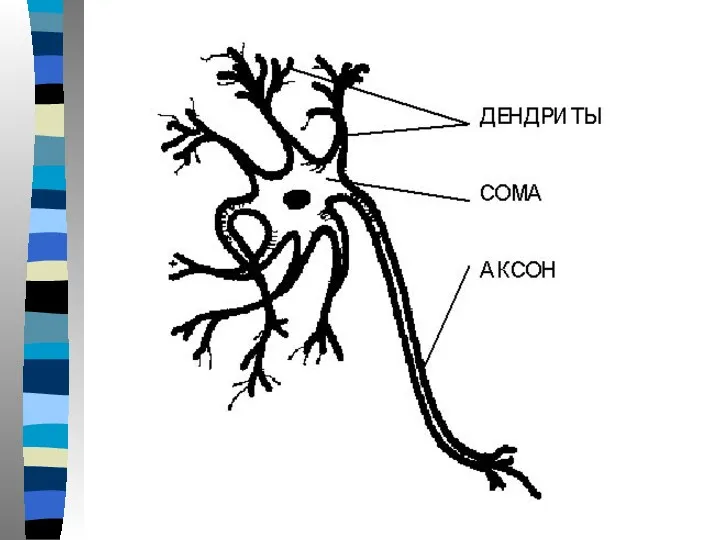

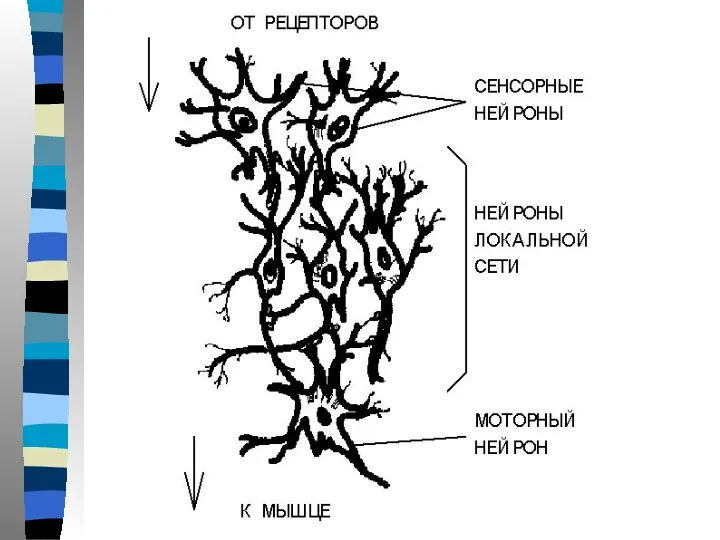

- 6. Современная биология: Клетка - элементарный процессор, способный к простейшей обработке информации Нейрон - элемент клеточной структуры

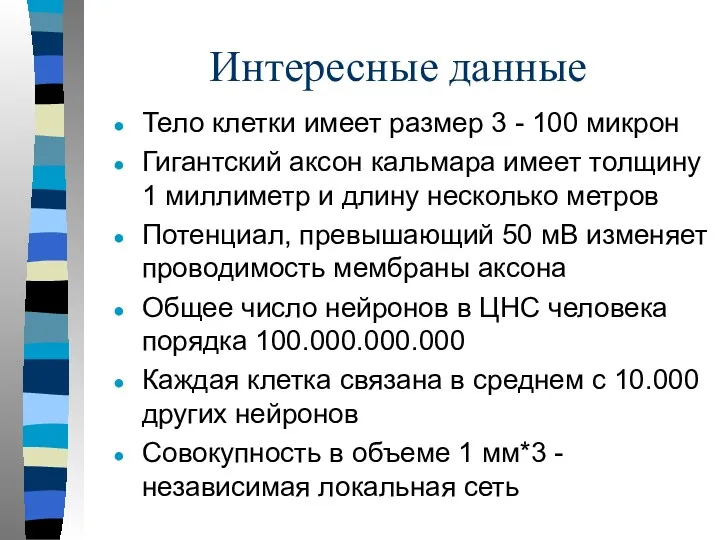

- 8. Интересные данные Тело клетки имеет размер 3 - 100 микрон Гигантский аксон кальмара имеет толщину 1

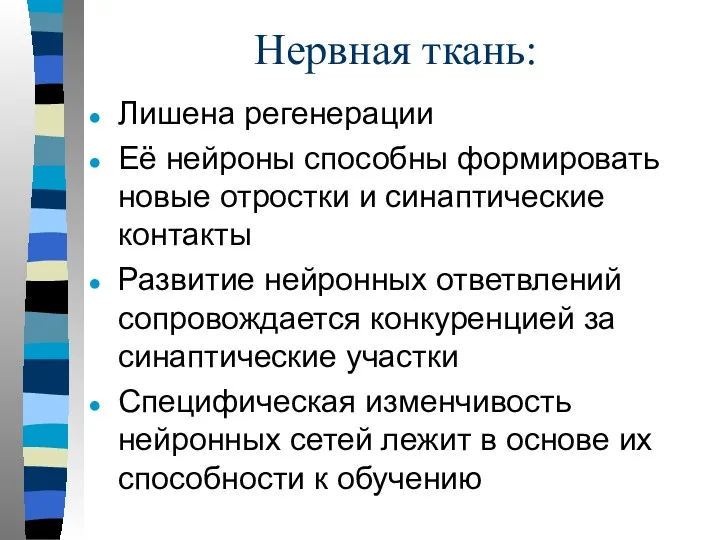

- 10. Нервная ткань: Лишена регенерации Её нейроны способны формировать новые отростки и синаптические контакты Развитие нейронных ответвлений

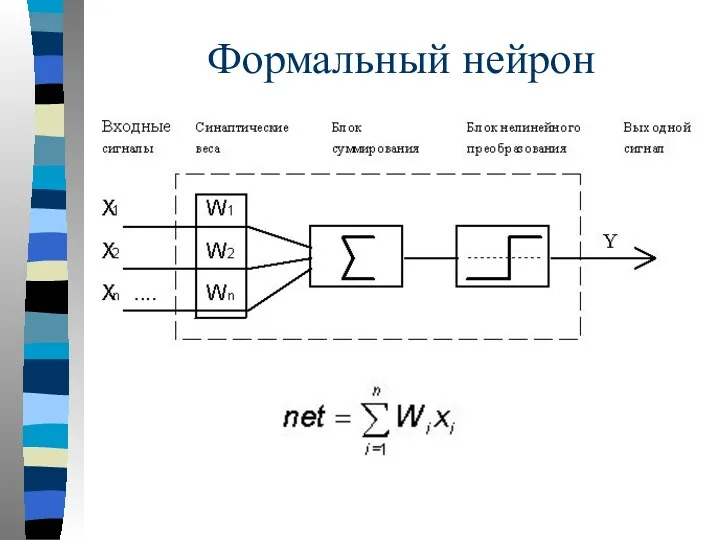

- 11. Формальный нейрон

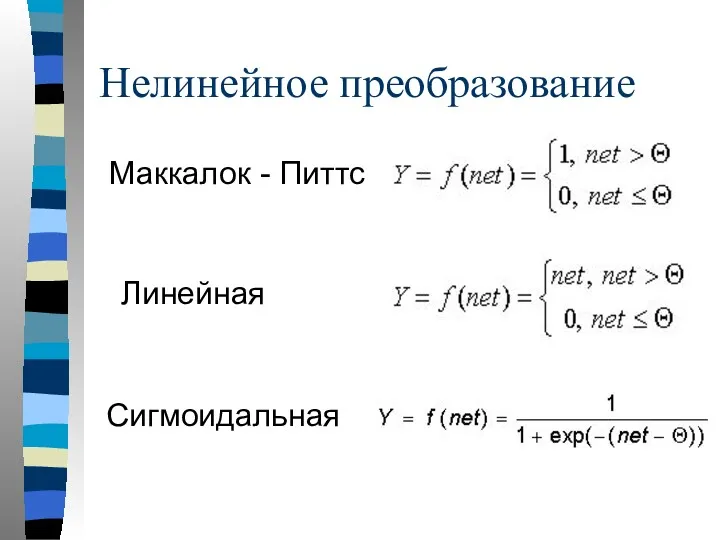

- 12. Нелинейное преобразование Маккалок - Питтс Линейная Сигмоидальная

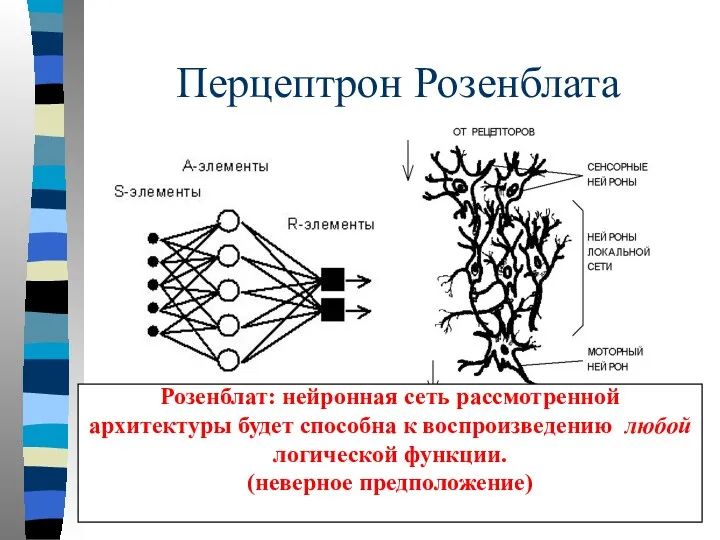

- 13. Перцептрон Розенблата S- сенсорные, А - ассоциативные, R - рефлекторные Розенблат: нейронная сеть рассмотренной архитектуры будет

- 14. Обучение сети Обучить нейронную сеть это значит, сообщить ей, чего от нее добиваются. Показав ребенку изображение

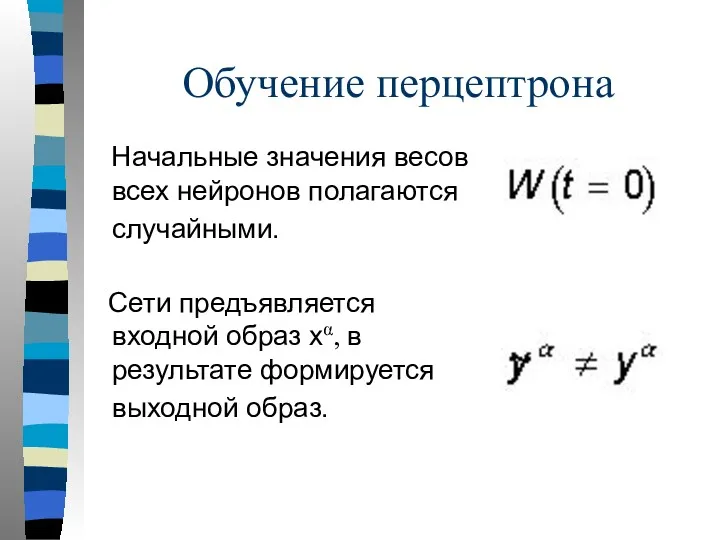

- 15. Обучение перцептрона Начальные значения весов всех нейронов полагаются случайными. Сети предъявляется входной образ xα, в результате

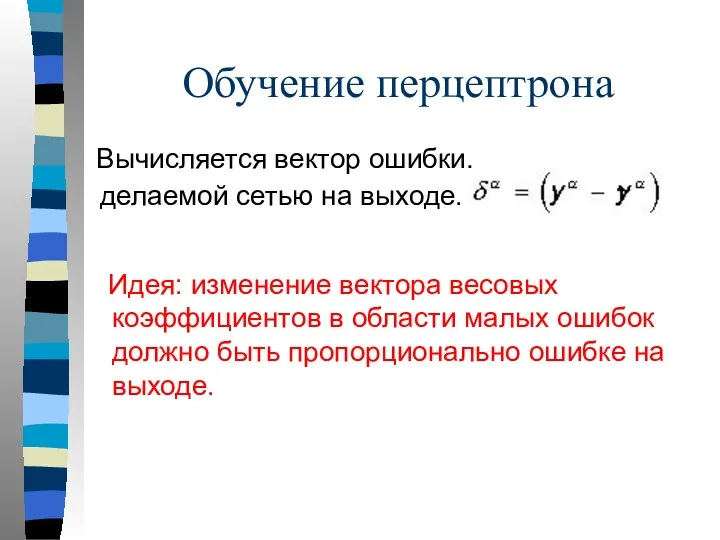

- 16. Обучение перцептрона Вычисляется вектор ошибки, делаемой сетью на выходе. Идея: изменение вектора весовых коэффициентов в области

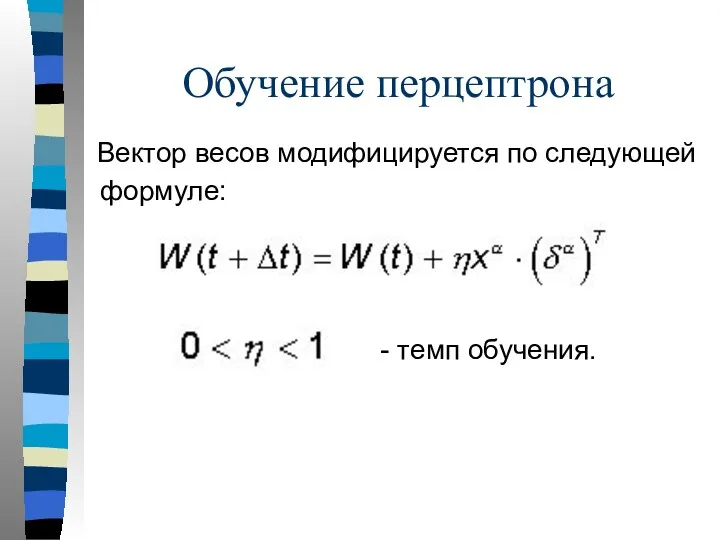

- 17. Обучение перцептрона Вектор весов модифицируется по следующей формуле: - темп обучения.

- 18. Параметры Обучение проводится для всех обучающих векторов. Один цикл предъявления всей выборки называется эпохой. Обучение завершается

- 19. Возможности применения Теорема о полноте: Любая непрерывная функция может быть приближена функциями, вычисляемыми нейронными сетями. Нейронные

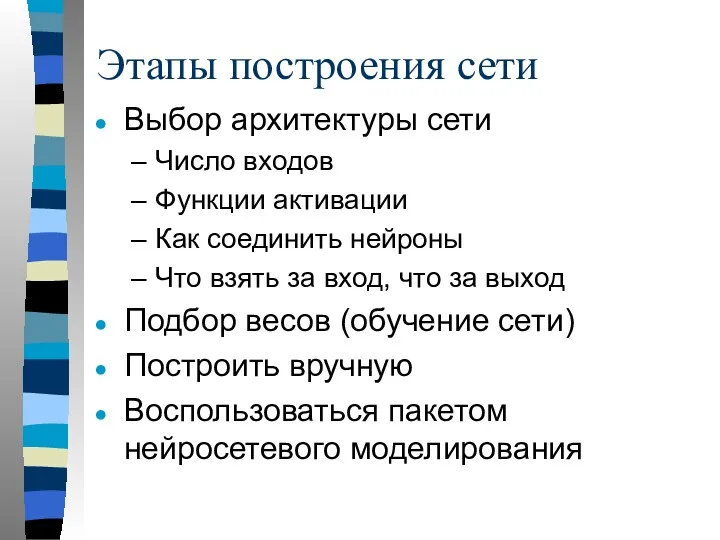

- 20. Этапы построения сети Выбор архитектуры сети Число входов Функции активации Как соединить нейроны Что взять за

- 21. STATISTICA Neural Networks Программный пакет для создания и обучения нейронных сетей и работы с нейросетевыми моделями

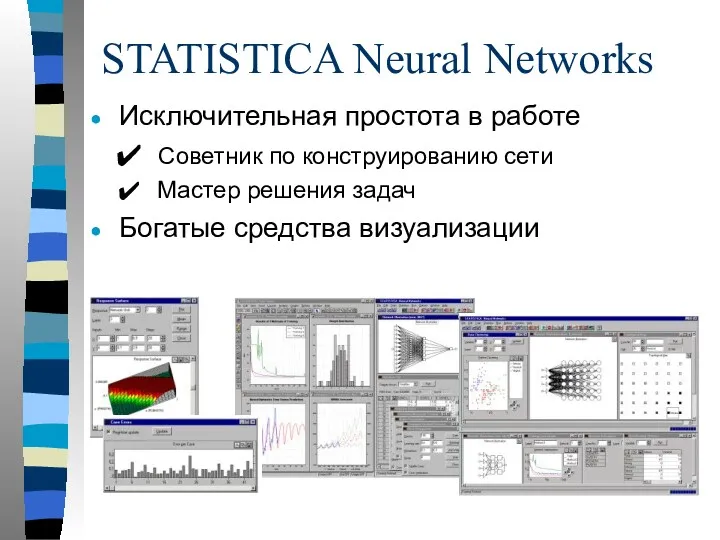

- 22. Исключительная простота в работе Советник по конструированию сети Мастер решения задач Богатые средства визуализации STATISTICA Neural

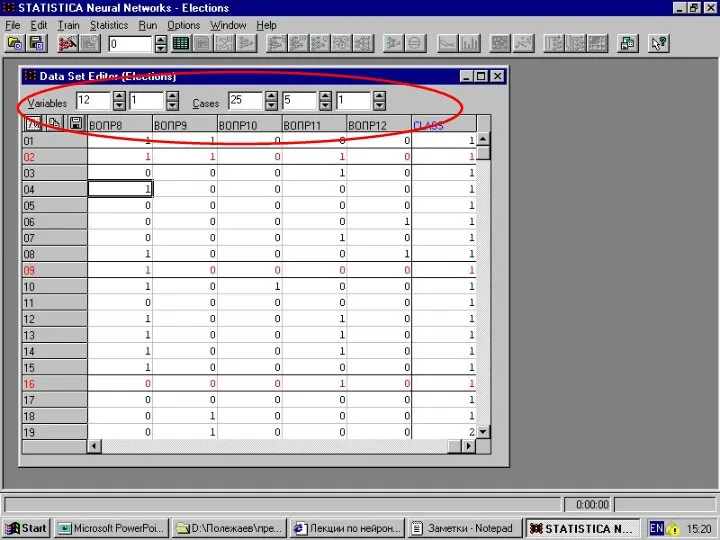

- 23. STATISTICA Neural Networks: работа с данными Структура таблиц исходных данных: числовые и номинальные переменные; входные и

- 24. STATISTICA Neural Networks: построение сетей Создание и сохранение наборов сетей. Выбор типа сети: многослойные персептроны (MLP);

- 25. STATISTICA Neural Networks: обучение сетей Большой выбор алгоритмов обучения: обратное распространение ошибки; спуск по сопряженным градиентам;

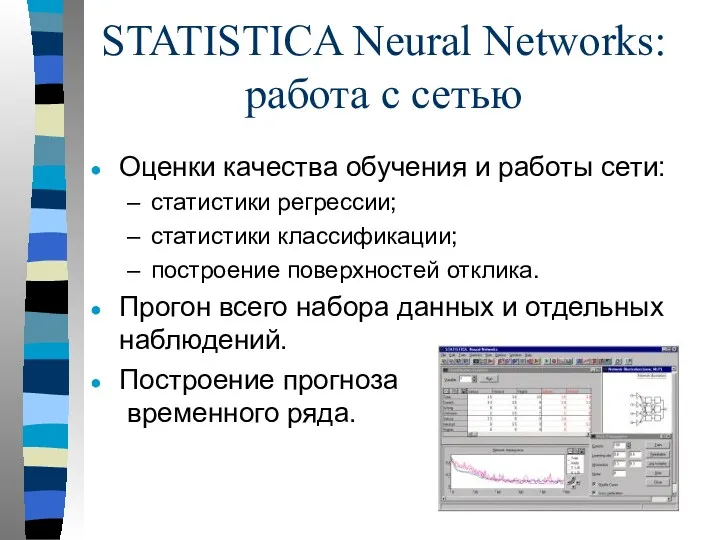

- 26. STATISTICA Neural Networks: работа с сетью Оценки качества обучения и работы сети: статистики регрессии; статистики классификации;

- 27. STATISTICA Neural Network: дополнительные функции Генетический алгоритм отбора входных данных Нелинейное понижение размерности Регуляризация весов по

- 28. STATISTICA Neural Networks: создание приложений Взаимодействие с системой STATISTICA: передача данных и графиков. Встроенный интерфейс прикладного

- 29. Прогнозирование результатов выборов президента США

- 30. Условия моделирования Предвыборные компании кандидатов отработаны добросовестно Все участники сделали все возможное Выбор практически предопределяется лишь

- 31. Входные данные Правящая партия у власти более 1 срока? Правящая партия получила больше 50% на прошлых

- 32. Входные данные Кандидат от правящей партии был президентом в год выборов? Был ли год выборов временем

- 33. Входные данные Во время правления были существенные социальные волнения? Администрация правящей партии виновна в серьезной ошибке

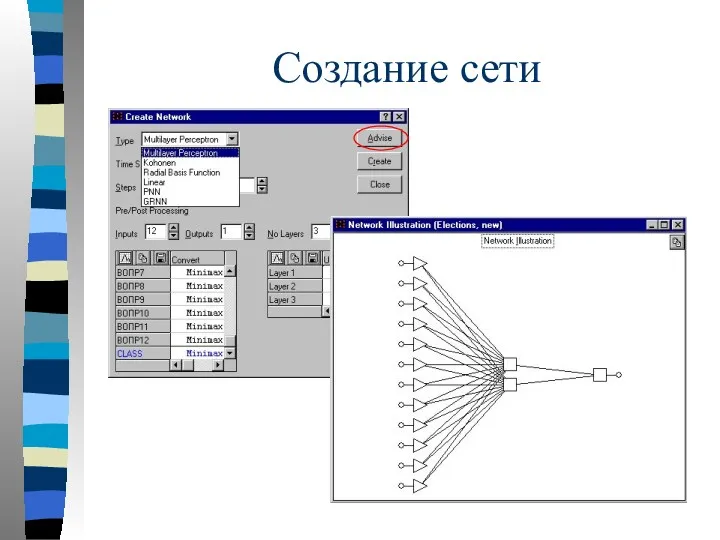

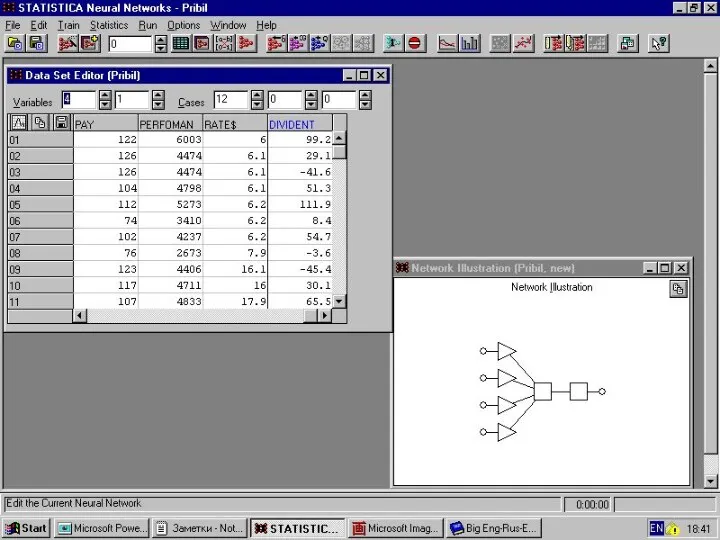

- 35. Создание сети

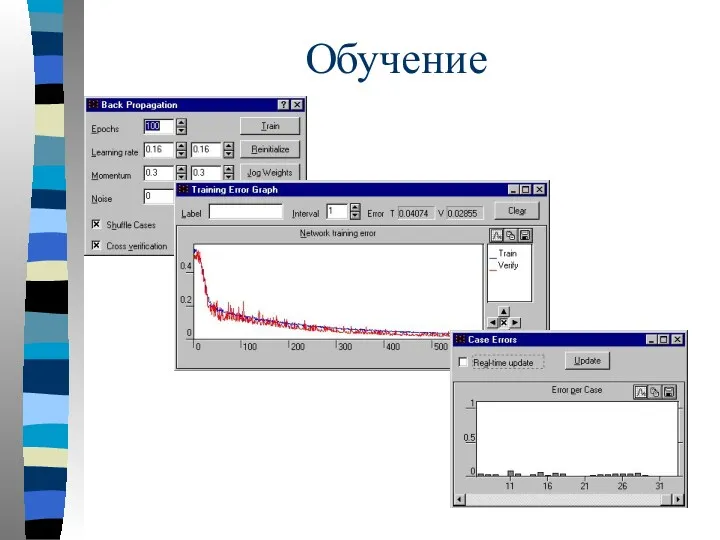

- 36. Обучение

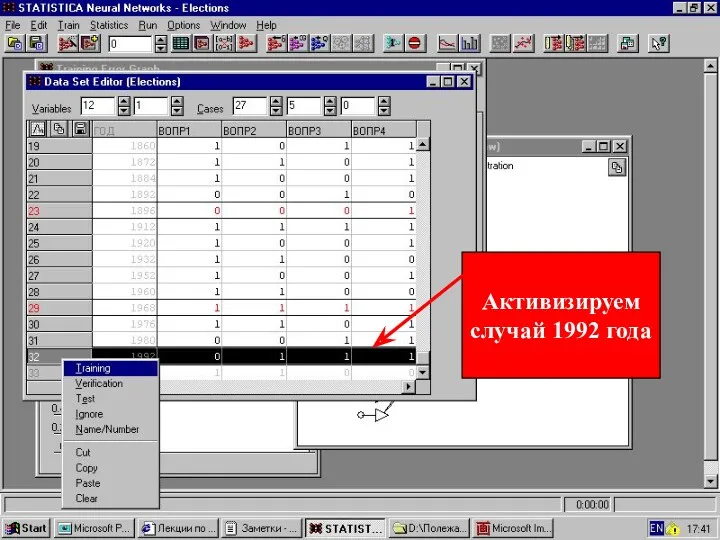

- 37. Активизируем случай 1992 года

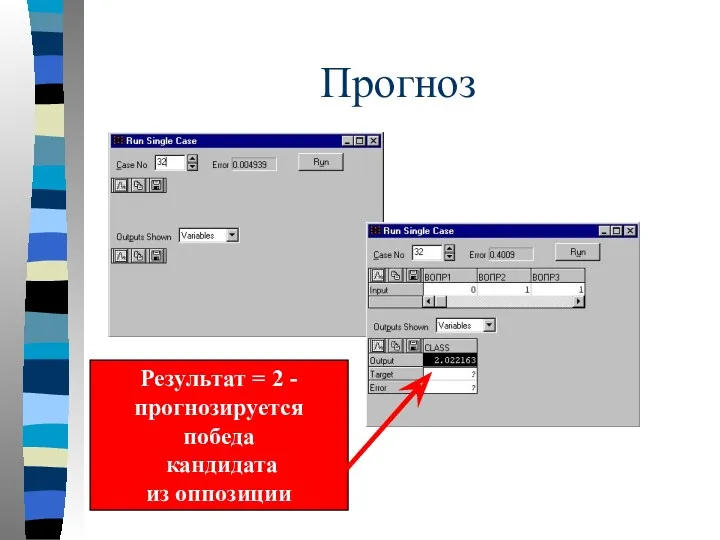

- 38. Прогноз Результат = 2 - прогнозируется победа кандидата из оппозиции

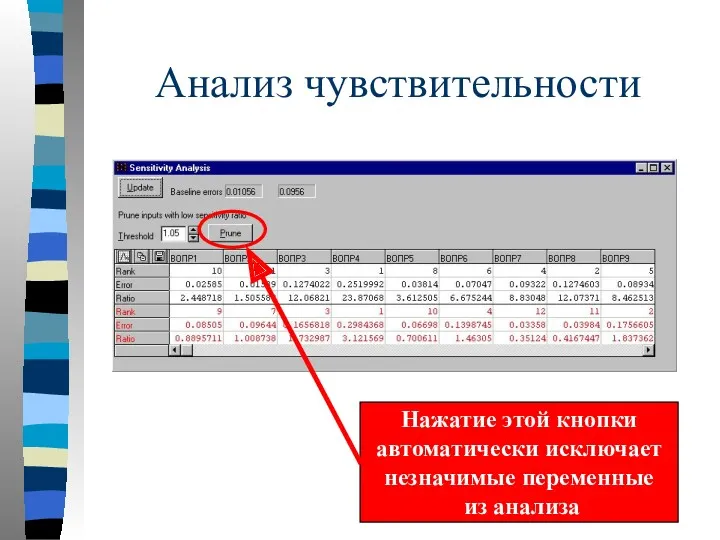

- 39. Анализ чувствительности Нажатие этой кнопки автоматически исключает незначимые переменные из анализа

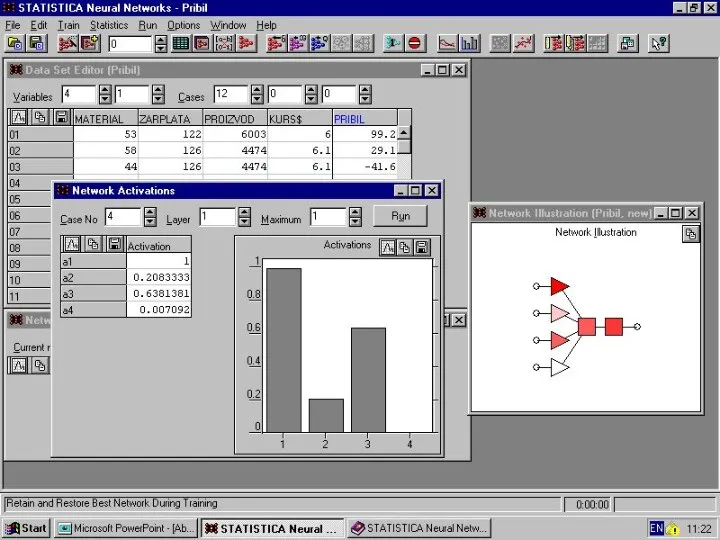

- 40. На основе экспертных данных выявить факторы, наиболее влияющие на прибыль предприятия

- 41. Представлены факторы Затраты на материалы Объем зарплаты Производительность труда Курс доллара США

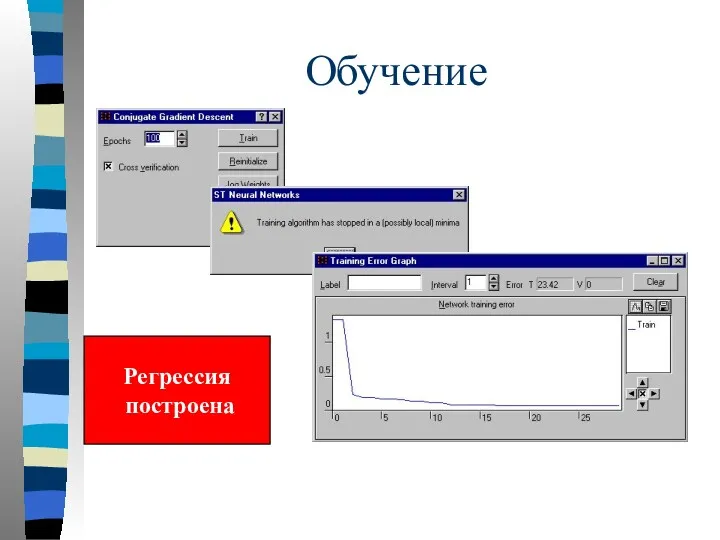

- 43. Обучение Регрессия построена

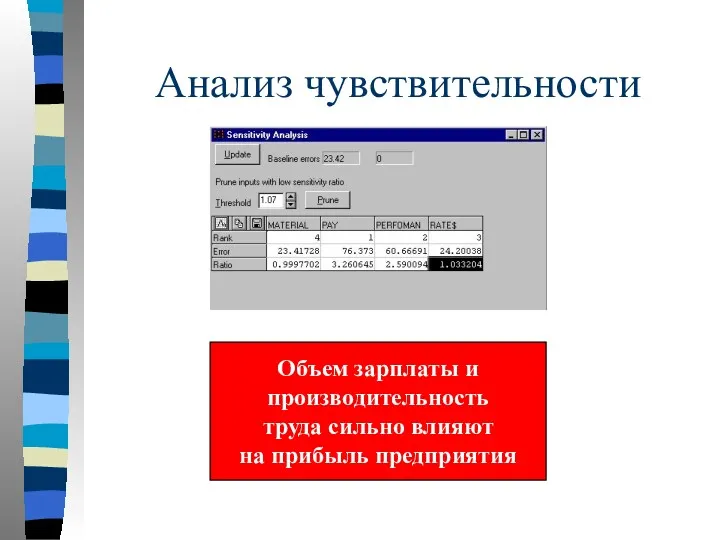

- 44. Анализ чувствительности Объем зарплаты и производительность труда сильно влияют на прибыль предприятия

- 46. Анализ и прогнозирование объема продаж сетей автозаправочных станций в США

- 47. График временного ряда

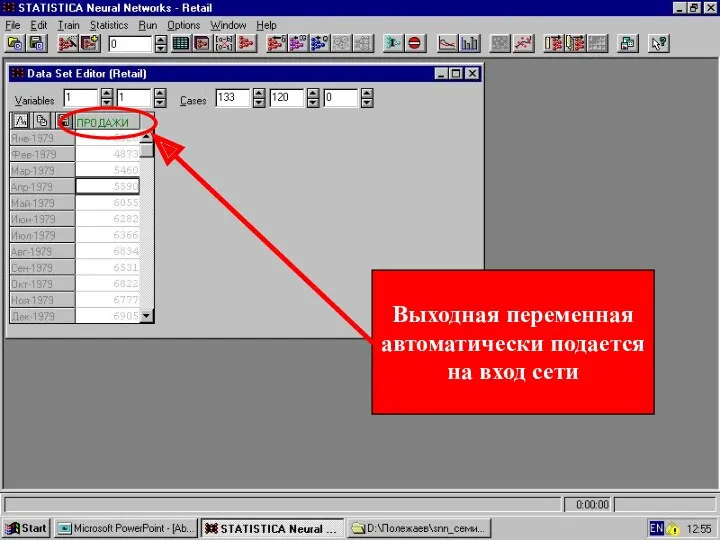

- 48. Выходная переменная автоматически подается на вход сети

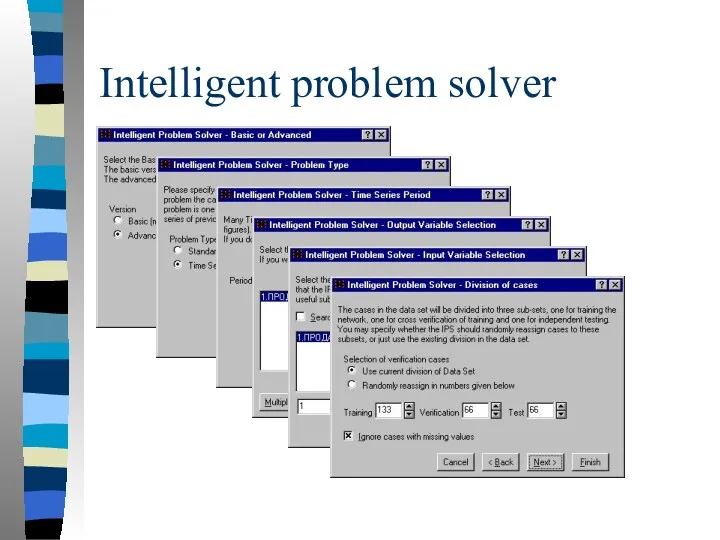

- 49. Intelligent problem solver

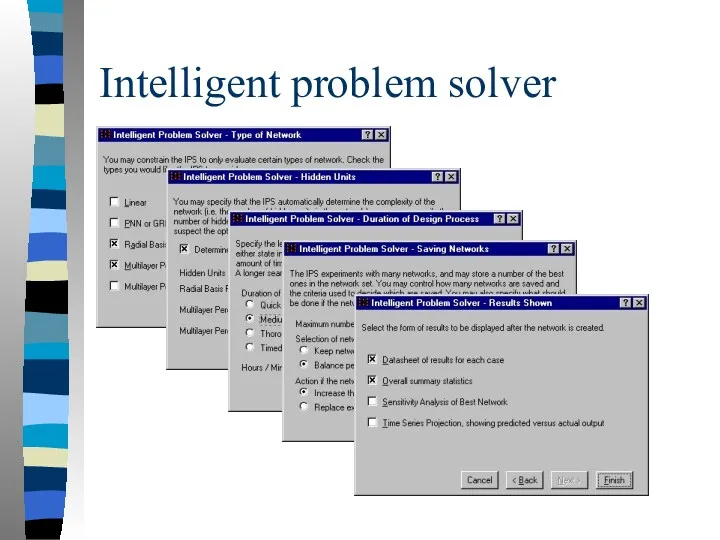

- 50. Intelligent problem solver

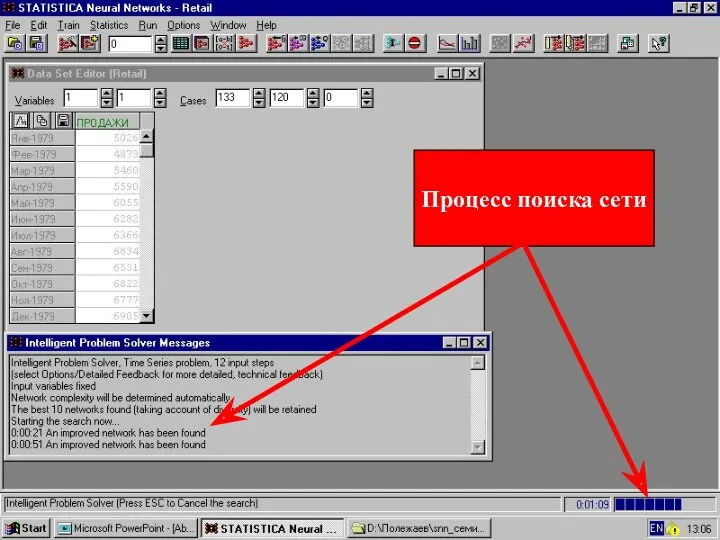

- 51. Процесс поиска сети

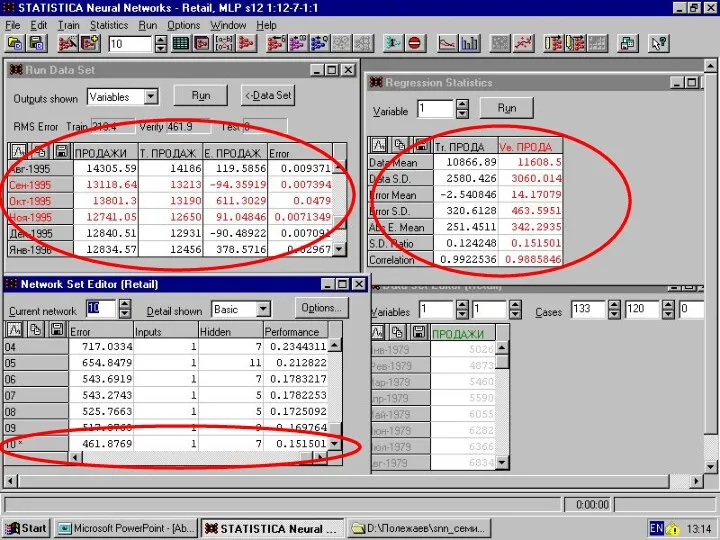

- 53. Обсуждение результатов Глубина прогноза Отправная точка

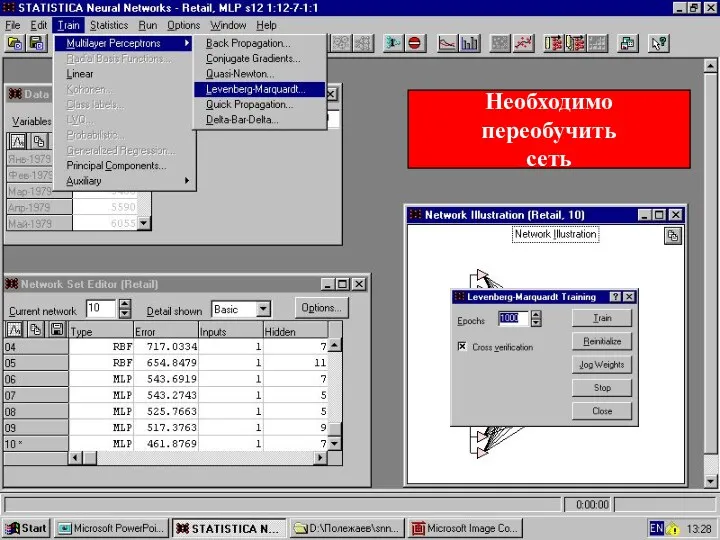

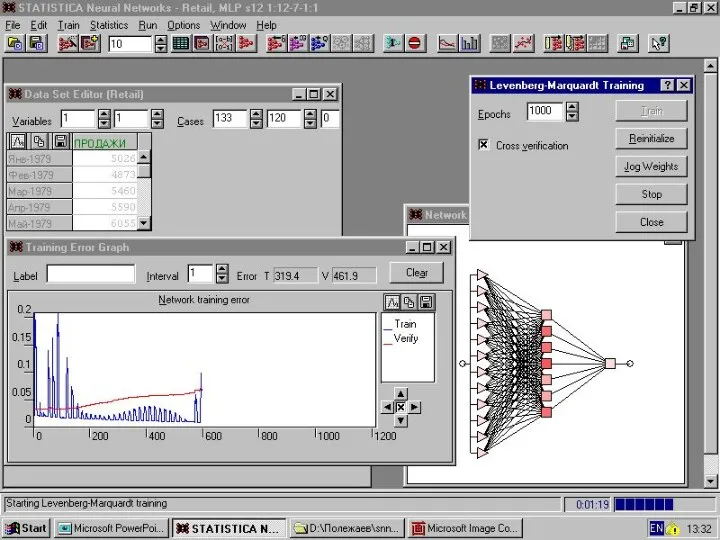

- 54. Необходимо переобучить сеть

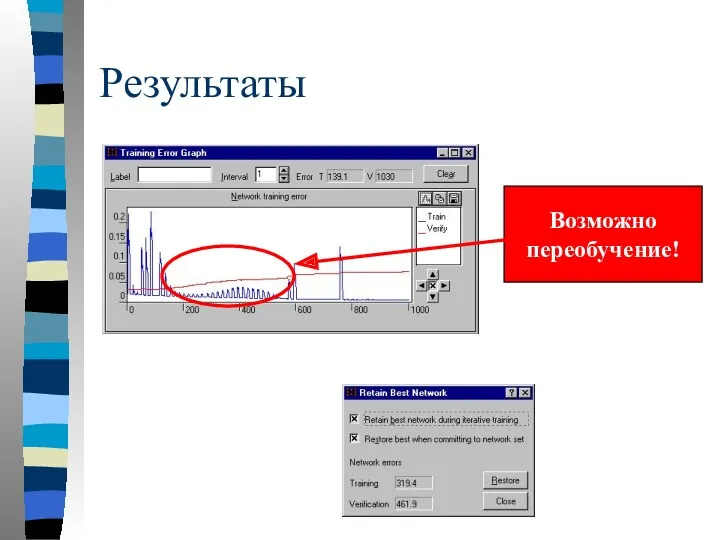

- 56. Результаты Возможно переобучение!

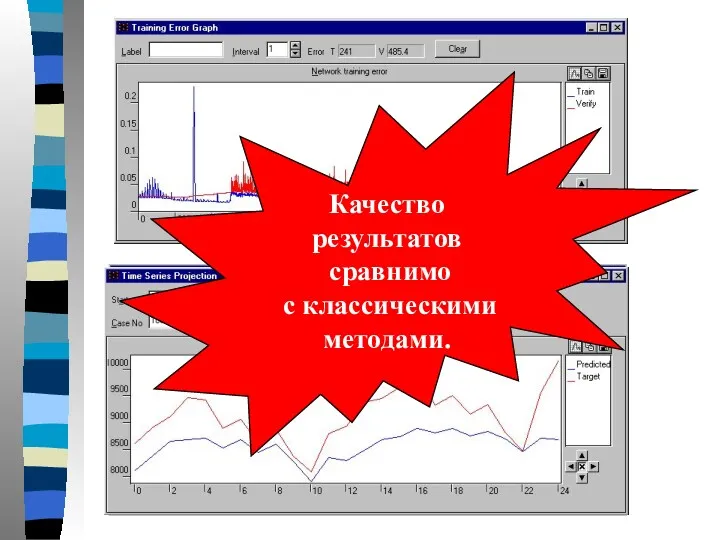

- 57. Качество результатов сравнимо с классическими методами.

- 58. Качество прогноза Для повышения качества прогноза рекомендуется добавить к исходной переменной ряд, определяемый как Dy(t)=y(t)-y(t-1) Точность

- 59. Модель распределенной нейронной памяти Каждый нейрон может находиться в двух состояниях: S1 = +1 - возбужденное

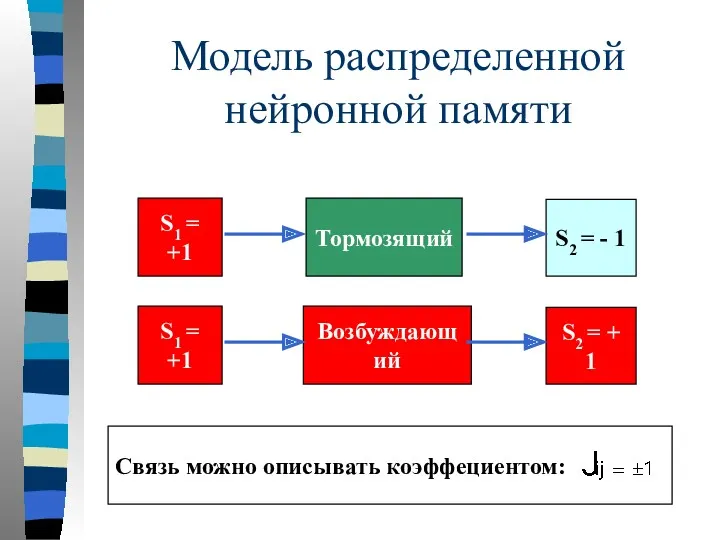

- 60. Модель распределенной нейронной памяти Тормозящий S1 = +1 S2 = - 1 Возбуждающий S1 = +1

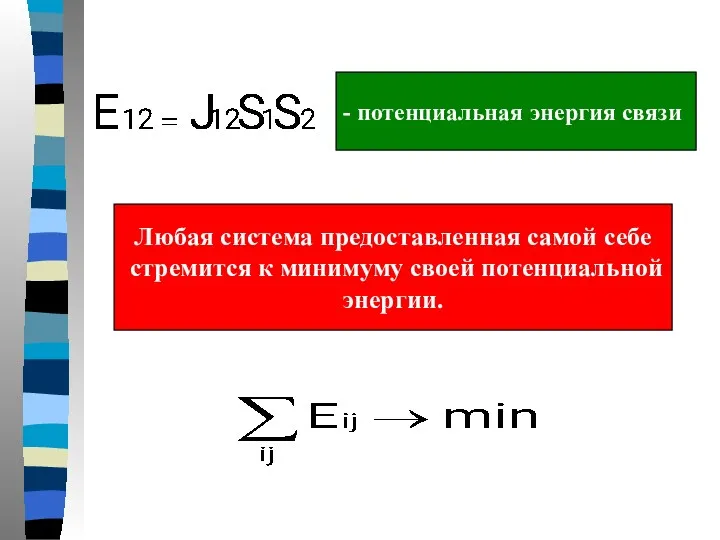

- 61. - потенциальная энергия связи Любая система предоставленная самой себе стремится к минимуму своей потенциальной энергии.

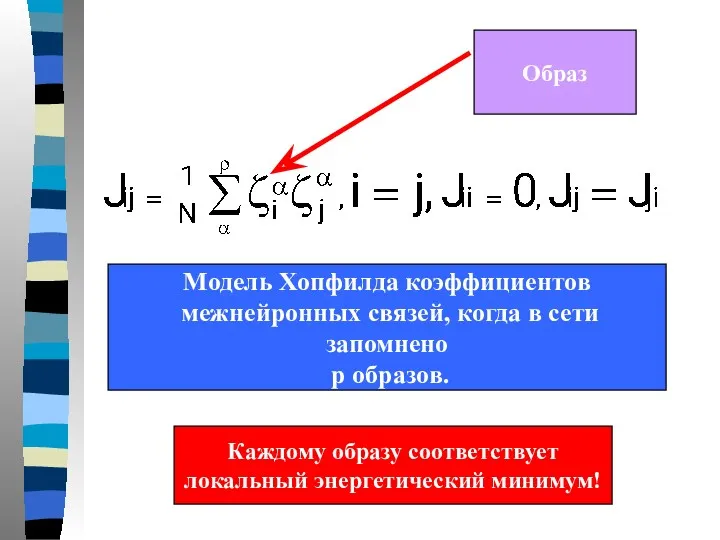

- 62. Модель Хопфилда коэффициентов межнейронных связей, когда в сети запомнено p образов. Образ Каждому образу соответствует локальный

- 63. Бимодальный образ Качественный вид потенциальной функции Хопфилда

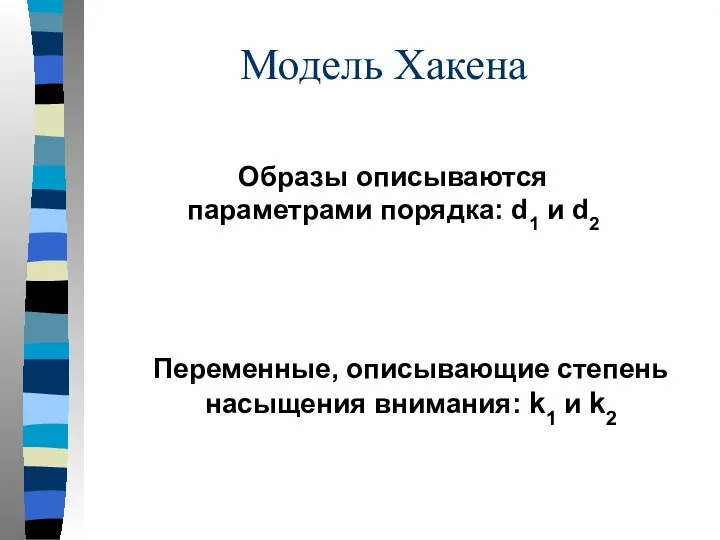

- 64. Модель Хакена Образы описываются параметрами порядка: d1 и d2 Переменные, описывающие степень насыщения внимания: k1 и

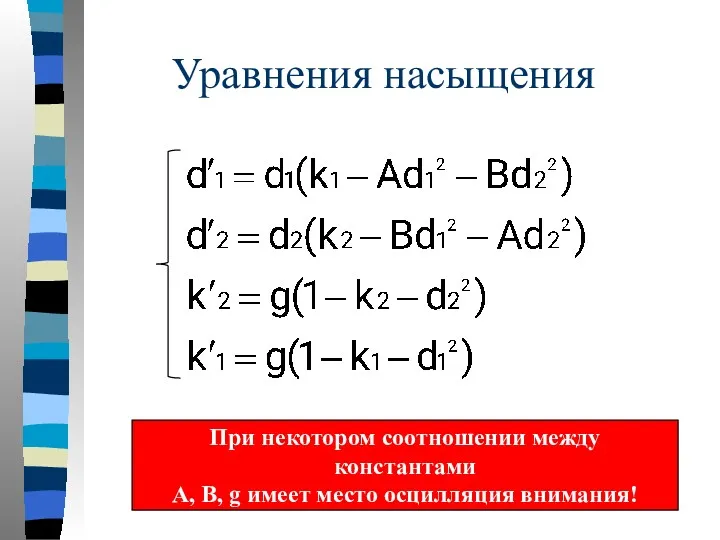

- 65. Уравнения насыщения При некотором соотношении между константами А, B, g имеет место осцилляция внимания!

- 66. Период колебаний При зрительном восприятии: T = 10c При смысловой неоднозначности: «Продается собака. Неприхотлива в еде.

- 67. Мы обсудили Проблему неоднозначности в искусстве Биологические нейронные сети Математические модели нейронных сетей Возможности пакета SNN

- 68. Мы обсудили Задачу: выявление показателей, влияющих на валовую прибыль предприятия (регрессионная модель) Задачу: прогнозирование временного ряда

- 70. Скачать презентацию

Тест демонстрационный

Тест демонстрационный Данные типа Array и Of

Данные типа Array и Of Впровадження бітрікс24

Впровадження бітрікс24 Устройство компьютера

Устройство компьютера Программирование на Python. Итоговое занятие. Презентация проектов. 30 занятие. 5-8 классы

Программирование на Python. Итоговое занятие. Презентация проектов. 30 занятие. 5-8 классы Кибербезопасность. Что такое кибербезопасность?

Кибербезопасность. Что такое кибербезопасность? Проектный менеджмент информационных систем. Раздел 1. Общие подходы к управлению программными проектами

Проектный менеджмент информационных систем. Раздел 1. Общие подходы к управлению программными проектами Математичні функцій в С++

Математичні функцій в С++ Сетевое взаимодействие: перспективы и проблемы осуществления

Сетевое взаимодействие: перспективы и проблемы осуществления 3D-ручка. Как появилась 3D-ручка

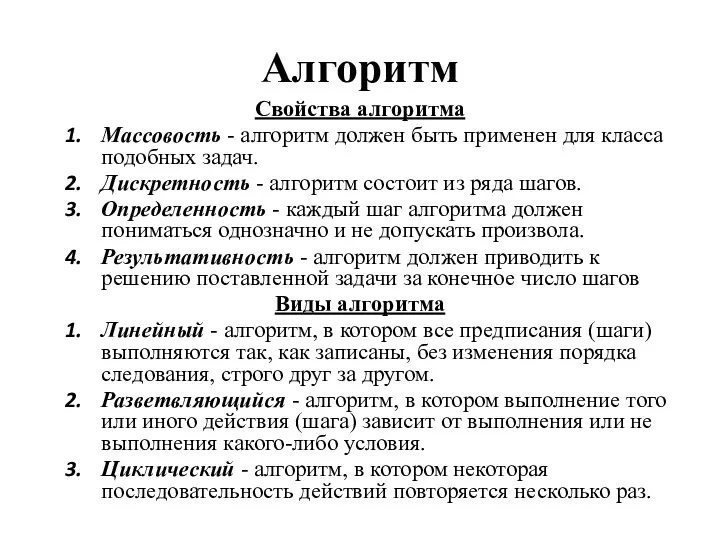

3D-ручка. Как появилась 3D-ручка Алгоритм. Свойства алгоритма

Алгоритм. Свойства алгоритма Информационные ресурсы Интернета. 8 класс

Информационные ресурсы Интернета. 8 класс КМиСЗИ. Криптография

КМиСЗИ. Криптография Введение в программную инженерию

Введение в программную инженерию Digital Twin. Занятие 2

Digital Twin. Занятие 2 Search Engine

Search Engine Место информатики в начальной школе

Место информатики в начальной школе Database 5.1

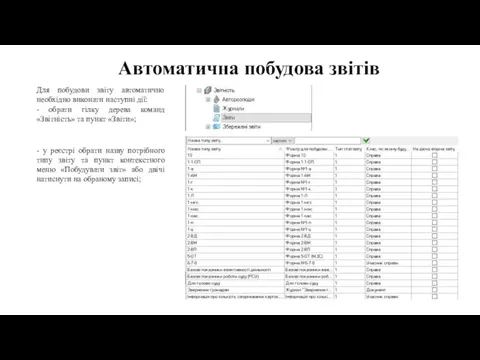

Database 5.1 Побудова звітів

Побудова звітів Язык гипертекстовой раз метки HTML

Язык гипертекстовой раз метки HTML Компьютерные сети

Компьютерные сети Введение в технологию создания Web-сайтов

Введение в технологию создания Web-сайтов Архитектура и принципы работы ЭВМ

Архитектура и принципы работы ЭВМ Подготовка к ОГЭ (информатика)

Подготовка к ОГЭ (информатика) Клавиатура. Монитор

Клавиатура. Монитор Интернет. Его плюсы и минусы

Интернет. Его плюсы и минусы Моделирование, как метод познания

Моделирование, как метод познания Троянские программы и защита от них

Троянские программы и защита от них