Содержание

- 2. План. MPI: основные понятия и определения Введение в MPI Инициализация и завершение MPI программ Определение количества

- 3. Понятие MPI MPI используется в вычислительных системах с распределенной памятью, в которых процессоры работают независимо друг

- 4. Стандарт MPI 1993 г. – объединение нескольких групп в MPI Forum для создания единых требований к

- 5. Стандарт MPI 1997 г – стандарт MPI 2.0 Возможности, заложенные в стандарт превышают возможности самих машин,

- 6. В рамках MPI для решения задачи разрабатывается одна программа, она запускается на выполнение одновременно на всех

- 7. В MPI существует множество операций передачи данных: обеспечиваются разные способы пересылки данных; реализованы практически все основные

- 8. Библиотека MPI Существует для двух языков: Fortran C/C++ Представляет собой реализацию общих положений стандарта под тот

- 9. Работа на кластере Необходимое ПО устанавливается (как правило) на кластерных системах. Доступ к кластеру КГПУ осуществляется

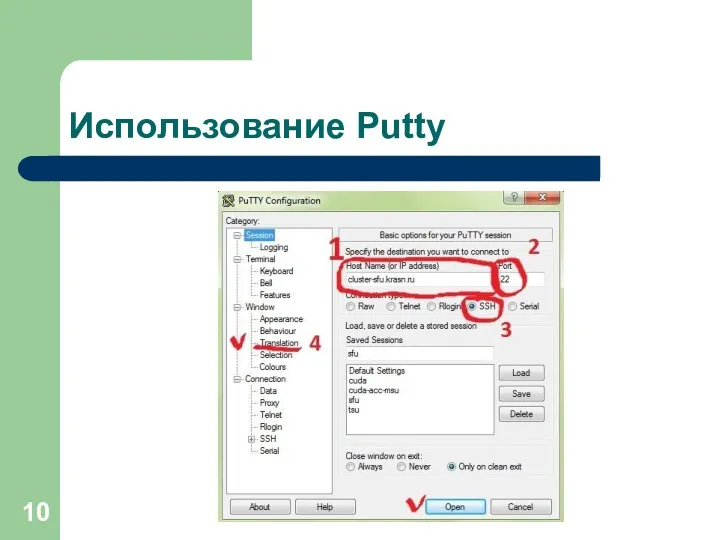

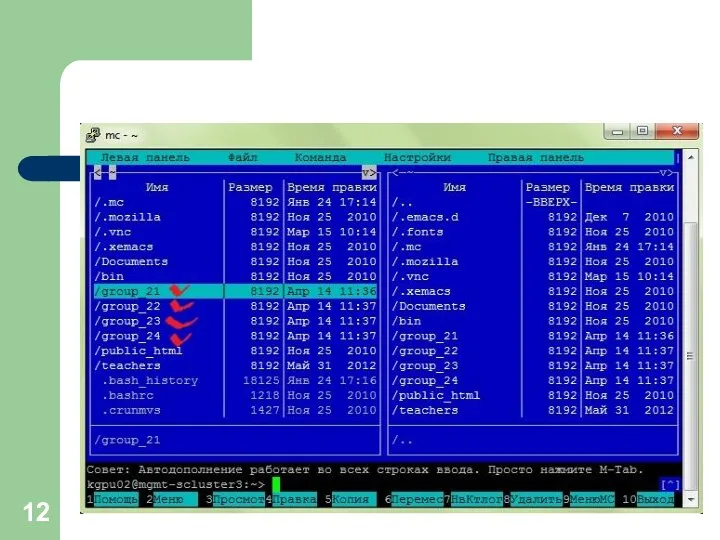

- 10. Использование Putty

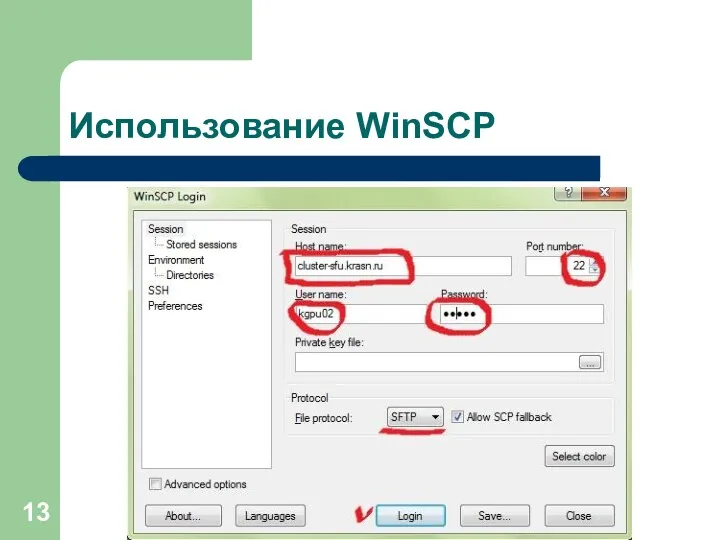

- 13. Использование WinSCP

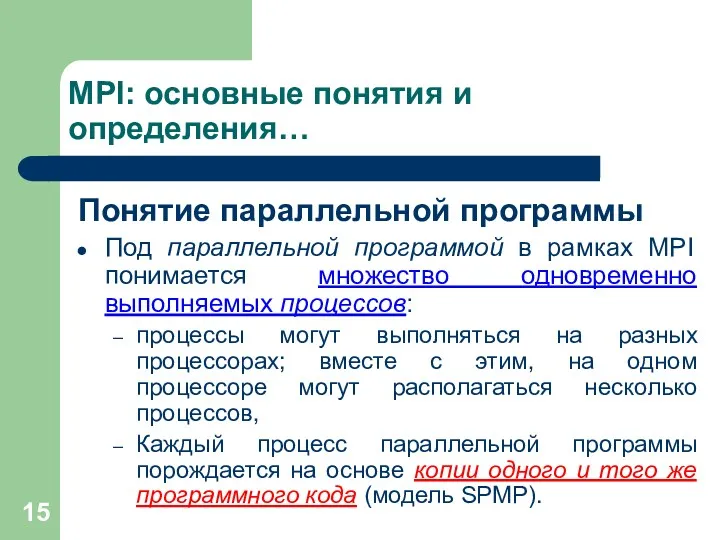

- 15. MPI: основные понятия и определения… Понятие параллельной программы Под параллельной программой в рамках MPI понимается множество

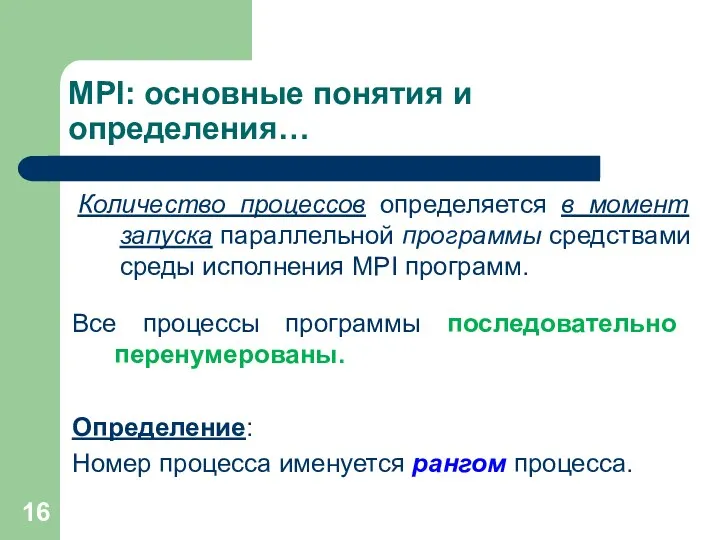

- 16. MPI: основные понятия и определения… Количество процессов определяется в момент запуска параллельной программы средствами среды исполнения

- 17. MPI: основные понятия и определения… В основу MPI положены четыре основных понятия: Тип операции передачи сообщения

- 18. MPI: основные понятия и определения… Операции передачи данных Основу MPI составляют операции передачи сообщений. Среди предусмотренных

- 19. MPI: основные понятия и определения… Понятие коммуникаторов Определение: Коммуникатор в MPI - специально создаваемый служебный объект,

- 20. MPI: основные понятия и определения… В ходе вычислений могут создаваться новые и удаляться существующие коммуникаторы. Один

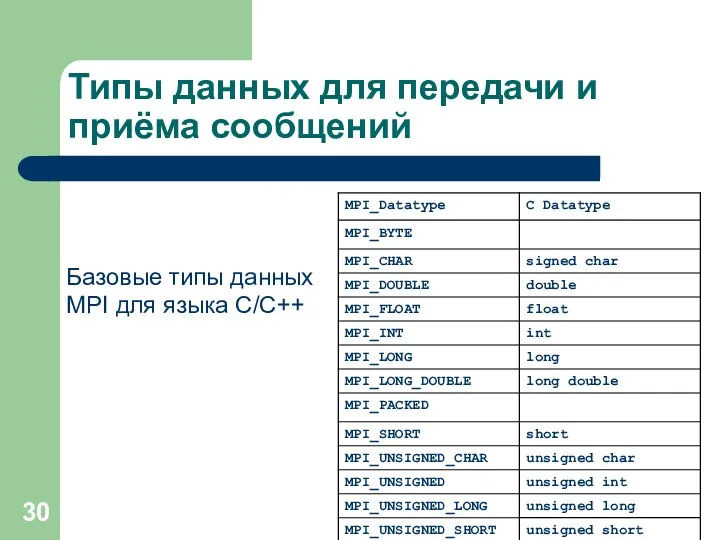

- 21. Типы данных MPI При выполнении операций передачи сообщений для определения передаваемых или получаемых данных в функциях

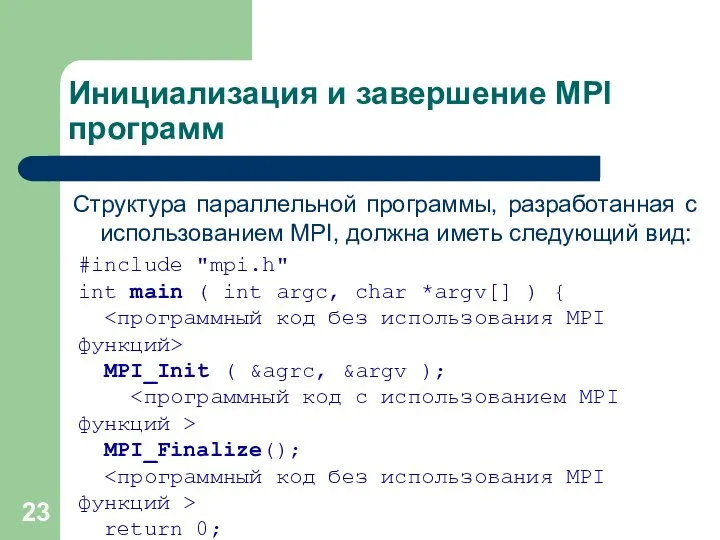

- 22. Инициализация и завершение MPI программ Первой вызываемой функцией MPI должна быть функция: int MPI_Init ( int

- 23. Инициализация и завершение MPI программ Структура параллельной программы, разработанная с использованием MPI, должна иметь следующий вид:

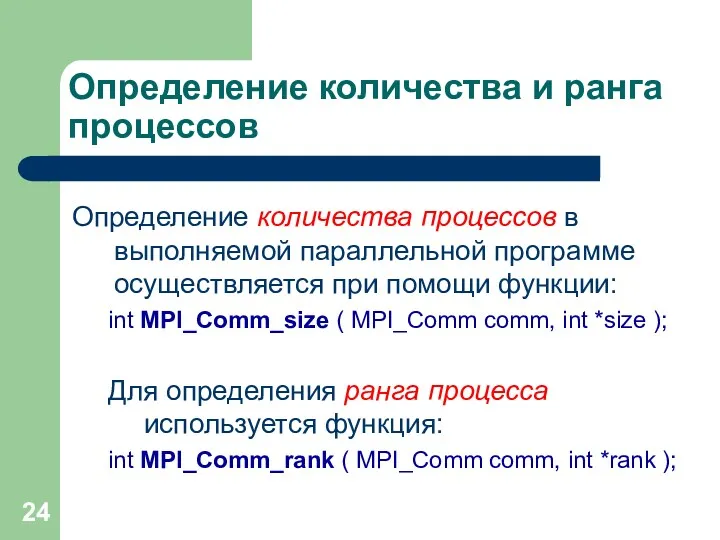

- 24. Определение количества и ранга процессов Определение количества процессов в выполняемой параллельной программе осуществляется при помощи функции:

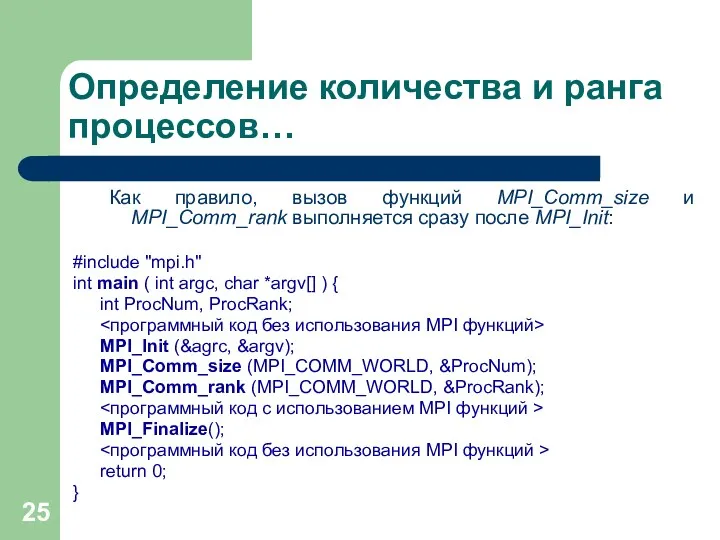

- 25. Определение количества и ранга процессов… Как правило, вызов функций MPI_Comm_size и MPI_Comm_rank выполняется сразу после MPI_Init:

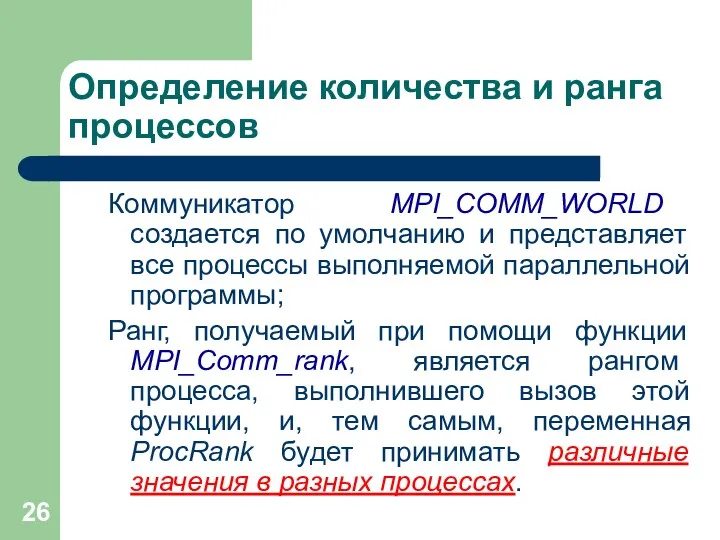

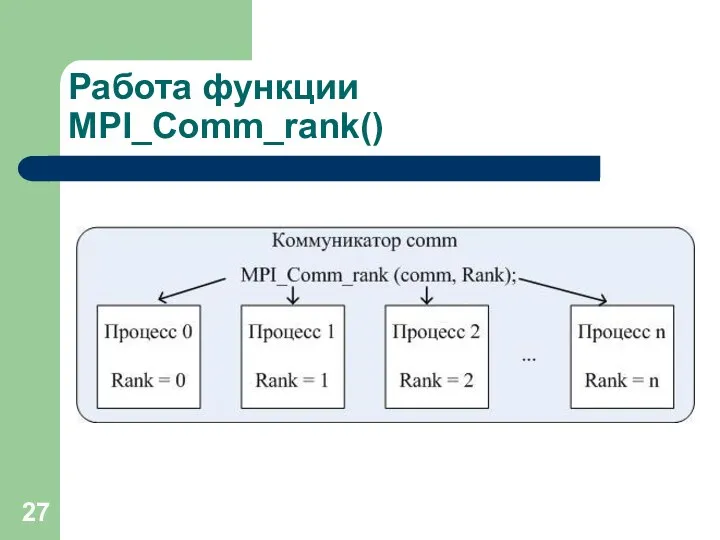

- 26. Определение количества и ранга процессов Коммуникатор MPI_COMM_WORLD создается по умолчанию и представляет все процессы выполняемой параллельной

- 27. Работа функции MPI_Comm_rank()

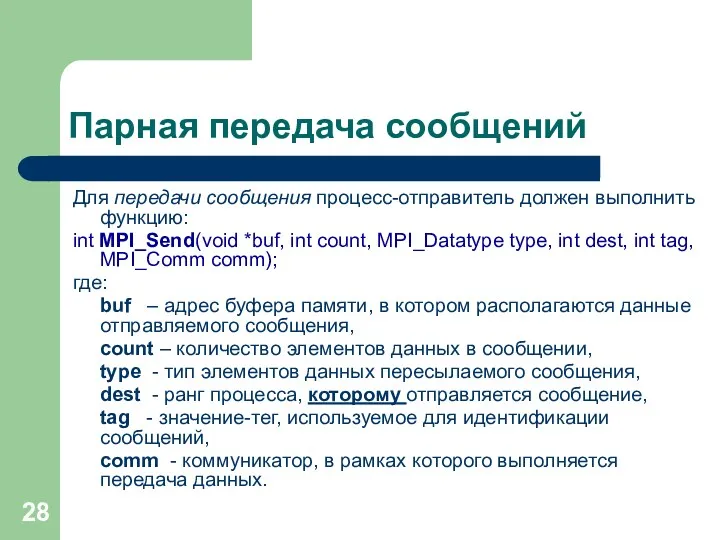

- 28. Парная передача сообщений Для передачи сообщения процесс-отправитель должен выполнить функцию: int MPI_Send(void *buf, int count, MPI_Datatype

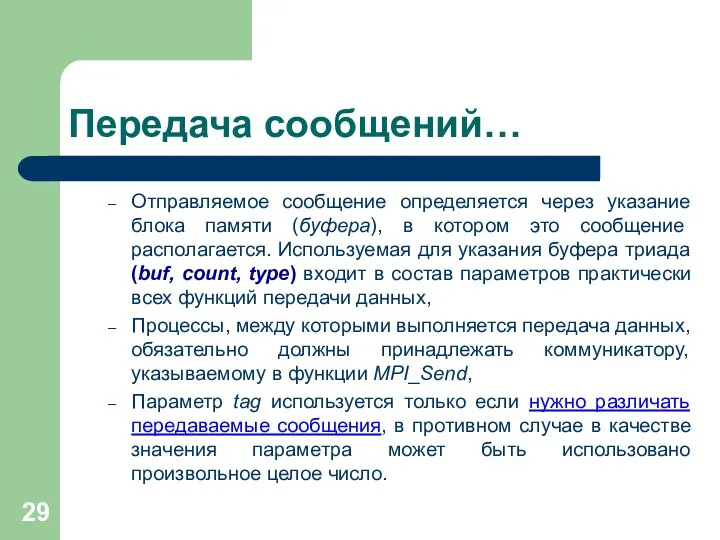

- 29. Передача сообщений… Отправляемое сообщение определяется через указание блока памяти (буфера), в котором это сообщение располагается. Используемая

- 30. Типы данных для передачи и приёма сообщений Базовые типы данных MPI для языка C/С++

- 31. Прием сообщений Для приема сообщения процесс-получатель должен выполнить функцию: int MPI_Recv(void *buf, int count, MPI_Datatype type,

- 32. Прием сообщений… Буфер памяти должен быть достаточным для приема сообщения, а тип элементов передаваемого и принимаемого

- 33. Прием сообщений… Параметр status позволяет определить ряд характеристик принятого сообщения: status.MPI_SOURCE – ранг процесса-отправителя принятого сообщения,

- 34. Прием сообщений… Функция MPI_Recv является блокирующей для процесса-получателя, т.е. его выполнение приостанавливается до завершения работы функции.

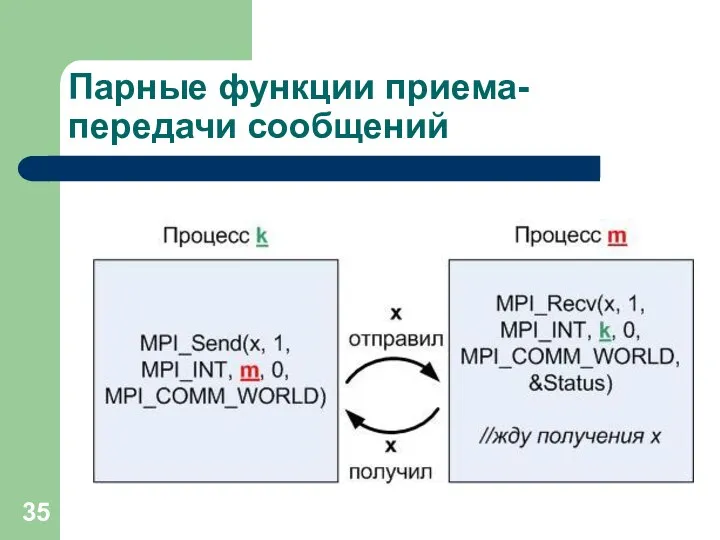

- 35. Парные функции приема-передачи сообщений

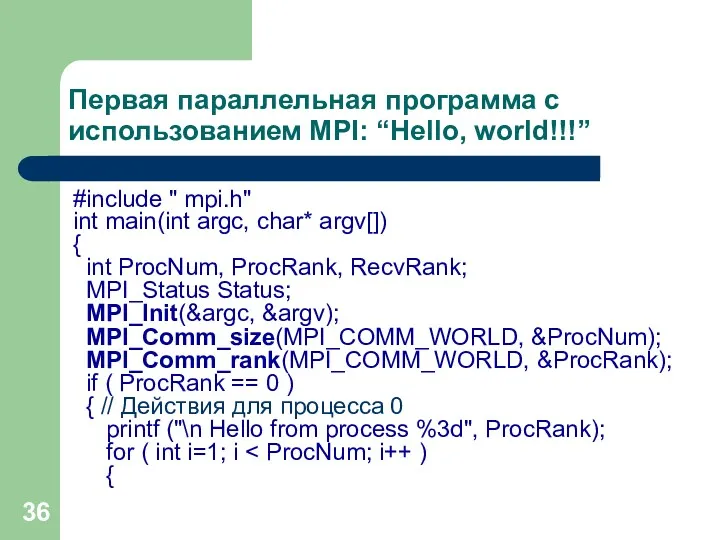

- 36. Первая параллельная программа с использованием MPI: “Hello, world!!!” #include " mpi.h" int main(int argc, char* argv[])

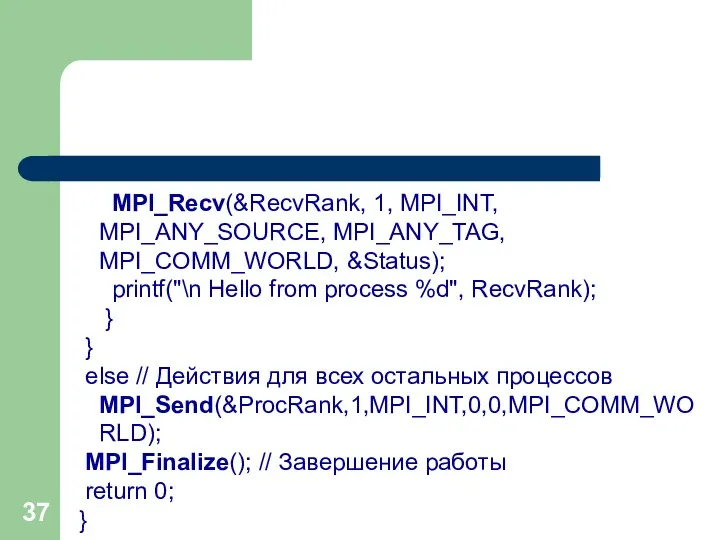

- 37. MPI_Recv(&RecvRank, 1, MPI_INT, MPI_ANY_SOURCE, MPI_ANY_TAG, MPI_COMM_WORLD, &Status); printf("\n Hello from process %d", RecvRank); } } else

- 38. Первая параллельная программа с использованием MPI… Каждый процесс определяет свой ранг, после чего действия в программе

- 39. Первая параллельная программа с использованием MPI… Порядок приема сообщений заранее не определен и зависит от условий

- 41. Скачать презентацию

Информационные ресурсы интернета

Информационные ресурсы интернета Работа со строками. Методы строк. Лекция

Работа со строками. Методы строк. Лекция Порядок работы с модулем ФГИС ЕГРН

Порядок работы с модулем ФГИС ЕГРН Специалист в автоматизации

Специалист в автоматизации Мистерия Игры Богов – I. Квадрант Инициации

Мистерия Игры Богов – I. Квадрант Инициации Внутренние устройства ПК

Внутренние устройства ПК Deep learning in computer vision. Нейронные сети

Deep learning in computer vision. Нейронные сети Виды компьютерной графики. 8 класс

Виды компьютерной графики. 8 класс История становления информатики как научной дисциплины, её предмет и задачи, структура информатики

История становления информатики как научной дисциплины, её предмет и задачи, структура информатики How to Download the Firmware image over the USB

How to Download the Firmware image over the USB Brining Governance to the clouds. Module 3. Policy. Stages of Policy Making

Brining Governance to the clouds. Module 3. Policy. Stages of Policy Making Классическая криптография и кодирование

Классическая криптография и кодирование Splender browser plug-in user flows

Splender browser plug-in user flows Использование ИКТ в учебном процессе

Использование ИКТ в учебном процессе Понятие информационная безопасность. Понятие информационная безопасность

Понятие информационная безопасность. Понятие информационная безопасность Программные средства информационных технологий. Тема 3

Программные средства информационных технологий. Тема 3 Информация - инструмент, орудие, средство

Информация - инструмент, орудие, средство Что изучает информатика?

Что изучает информатика? Язык запросов к данным QBE

Язык запросов к данным QBE Общая архитектура ОС. (Лекция 2)

Общая архитектура ОС. (Лекция 2) Формат издания

Формат издания Командные соревнования для специалистов по информационной безопасности

Командные соревнования для специалистов по информационной безопасности Скрипты и механика акции. Газпромнефть. Сентябрь

Скрипты и механика акции. Газпромнефть. Сентябрь Текстовая информация. Текст как форма представления информации. Текстовые документы

Текстовая информация. Текст как форма представления информации. Текстовые документы Разработка урока на тему Вспомогательные алгоритмы 9 класс

Разработка урока на тему Вспомогательные алгоритмы 9 класс Внешние международные информационные ресурсы

Внешние международные информационные ресурсы Урок Модели и моделирование

Урок Модели и моделирование Інноваційний IT-проект, додаток iis

Інноваційний IT-проект, додаток iis