Содержание

- 2. Что такое дерево принятия решений? 2 Решающее дерево предсказывает значение целевой переменной с помощью применения последовательности

- 3. Зачем нам деревья принятия решений? 3 Решающие деревья часто используют как кирпичики для построения ансамблей —

- 4. Бустинг (Boosting) 4 Каждый следующий базовый алгоритм в бустинге обучается так, чтобы уменьшить общую ошибку всех

- 5. Гиперпараметры моделей МО 5 параметры настраиваются в процессе обучения модели на данных. Например, структура решающего дерева;

- 6. Интерпретируемость модели 6 Получили модель с хорошей предсказательной точностью – всё? НЕТ. Нужно понять, как работает

- 8. Скачать презентацию

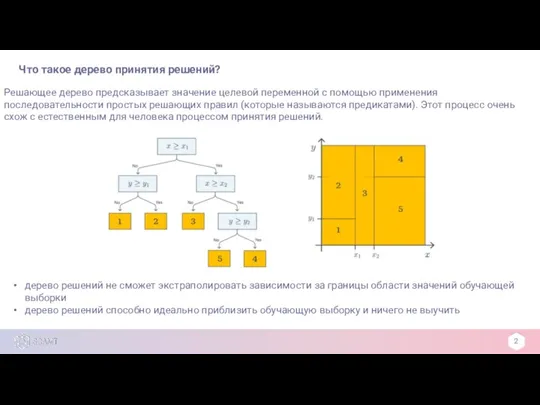

Что такое дерево принятия решений?

2

Решающее дерево предсказывает значение целевой переменной с помощью применения

Что такое дерево принятия решений?

2

Решающее дерево предсказывает значение целевой переменной с помощью применения

дерево решений не сможет экстраполировать зависимости за границы области значений обучающей выборки

дерево решений способно идеально приблизить обучающую выборку и ничего не выучить

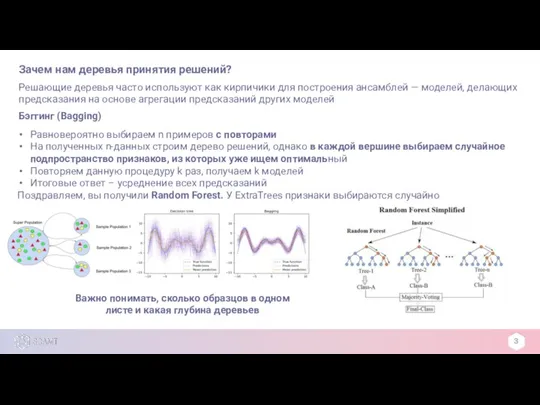

Зачем нам деревья принятия решений?

3

Решающие деревья часто используют как кирпичики для построения ансамблей

Зачем нам деревья принятия решений?

3

Решающие деревья часто используют как кирпичики для построения ансамблей

Бэггинг (Bagging)

Равновероятно выбираем n примеров с повторами

На полученных n-данных строим дерево решений, однако в каждой вершине выбираем случайное подпространство признаков, из которых уже ищем оптимальный

Повторяем данную процедуру k раз, получаем k моделей

Итоговые ответ – усреднение всех предсказаний

Поздравляем, вы получили Random Forest. У ExtraTrees признаки выбираются случайно

Важно понимать, сколько образцов в одном листе и какая глубина деревьев

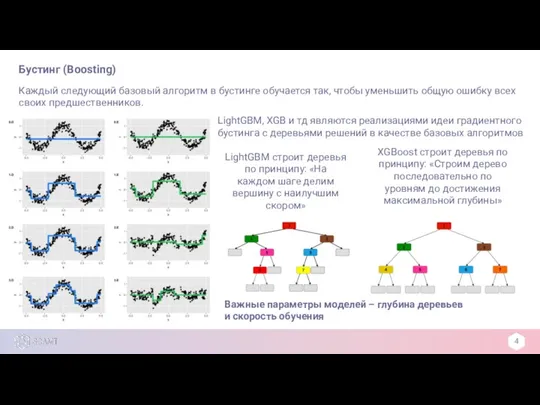

Бустинг (Boosting)

4

Каждый следующий базовый алгоритм в бустинге обучается так, чтобы уменьшить общую ошибку

Бустинг (Boosting)

4

Каждый следующий базовый алгоритм в бустинге обучается так, чтобы уменьшить общую ошибку

LightGBM строит деревья по принципу: «На каждом шаге делим вершину с наилучшим скором»

LightGBM, XGB и тд являются реализациями идеи градиентного бустинга с деревьями решений в качестве базовых алгоритмов

XGBoost строит деревья по принципу: «Строим дерево последовательно по уровням до достижения максимальной глубины»

Важные параметры моделей – глубина деревьев и скорость обучения

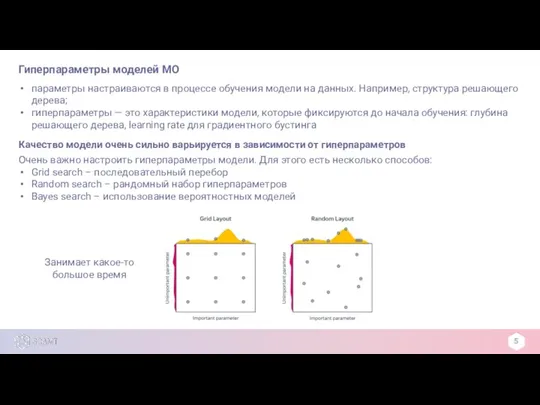

Гиперпараметры моделей МО

5

параметры настраиваются в процессе обучения модели на данных. Например, структура решающего

Гиперпараметры моделей МО

5

параметры настраиваются в процессе обучения модели на данных. Например, структура решающего

гиперпараметры — это характеристики модели, которые фиксируются до начала обучения: глубина решающего дерева, learning rate для градиентного бустинга

Качество модели очень сильно варьируется в зависимости от гиперпараметров

Очень важно настроить гиперпараметры модели. Для этого есть несколько способов:

Grid search – последовательный перебор

Random search – рандомный набор гиперпараметров

Bayes search – использование вероятностных моделей

Занимает какое-то большое время

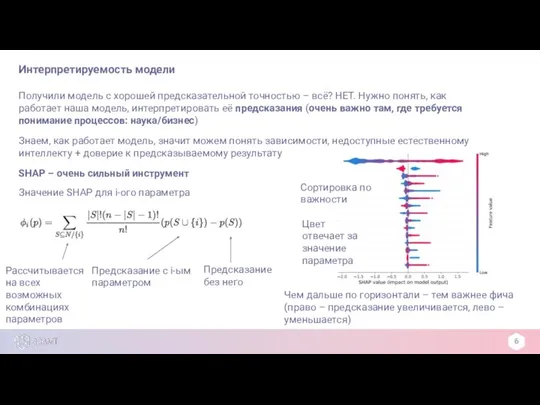

Интерпретируемость модели

6

Получили модель с хорошей предсказательной точностью – всё? НЕТ. Нужно понять, как

Интерпретируемость модели

6

Получили модель с хорошей предсказательной точностью – всё? НЕТ. Нужно понять, как

Знаем, как работает модель, значит можем понять зависимости, недоступные естественному интеллекту + доверие к предсказываемому результату

SHAP – очень сильный инструмент

Значение SHAP для i-ого параметра

Предсказание с i-ым параметром

Предсказание без него

Рассчитывается на всех возможных комбинациях параметров

Чем дальше по горизонтали – тем важнее фича (право – предсказание увеличивается, лево – уменьшается)

Цвет отвечает за значение параметра

Сортировка по важности

Мочекаменная болезнь (уролитиаз)

Мочекаменная болезнь (уролитиаз) Операции на костях. Остеотомия и остеосинтез. Реплантация конечностей. Протезирование тазобедренного сустава

Операции на костях. Остеотомия и остеосинтез. Реплантация конечностей. Протезирование тазобедренного сустава Эндодонтия

Эндодонтия Фунготерапия. Грибы в качестве лекарственных препаратов

Фунготерапия. Грибы в качестве лекарственных препаратов Патофизиология водно-электролитного обмена

Патофизиология водно-электролитного обмена Гигиенические требования к рентгенологическим и радиологическим отделениям больниц

Гигиенические требования к рентгенологическим и радиологическим отделениям больниц Слуховая система. Стойкие нарушения слуха

Слуховая система. Стойкие нарушения слуха Порядок ведения учета и оформление списания медицинского имущества воинских частей и учреждений

Порядок ведения учета и оформление списания медицинского имущества воинских частей и учреждений Вирус краснухи

Вирус краснухи Идиопатический гемосидероз лёгких

Идиопатический гемосидероз лёгких Lobular pneumonia

Lobular pneumonia Методы лучевой диагностики. Магнитно–резонансная томография

Методы лучевой диагностики. Магнитно–резонансная томография Черепно-мозкова травма

Черепно-мозкова травма Ампутация конечности и протезирование

Ампутация конечности и протезирование Архітектурні споруди для дітей з фізичними порушеннями

Архітектурні споруди для дітей з фізичними порушеннями Коронавирусная инфекция COVID-19

Коронавирусная инфекция COVID-19 Новообразования кожи животных. Саркома мягких тканей

Новообразования кожи животных. Саркома мягких тканей Қолайсыз жағдайларда және апаттарда жедел жәрдем беру қызметінің ұйымдастырылуы

Қолайсыз жағдайларда және апаттарда жедел жәрдем беру қызметінің ұйымдастырылуы Обеспечение оптимальной позиции пациентам с различными патологическими состояниями

Обеспечение оптимальной позиции пациентам с различными патологическими состояниями Воспалительные заболевания глазного яблока и зрительного нерва

Воспалительные заболевания глазного яблока и зрительного нерва Орталық жүйке жүйесі. Ми.Мидың баған бөлімі. Сопақша ми,артқы ми: көпір және мишық,ортаңғы ми,аралық ми

Орталық жүйке жүйесі. Ми.Мидың баған бөлімі. Сопақша ми,артқы ми: көпір және мишық,ортаңғы ми,аралық ми Врачебно-профессиональное консультирование подростков

Врачебно-профессиональное консультирование подростков Аптечка первой медицинской помощи. Классификация лекарственных средств

Аптечка первой медицинской помощи. Классификация лекарственных средств Гемопоэз. Теория кроветворения

Гемопоэз. Теория кроветворения Операции на желчевыводящих путях

Операции на желчевыводящих путях Материалы, применяемые в ортопедической стоматологии

Материалы, применяемые в ортопедической стоматологии История медицины как наука и предмет преподавания. Врачевание в первобытном обществе и Древнем мире

История медицины как наука и предмет преподавания. Врачевание в первобытном обществе и Древнем мире Полигенді аурулар

Полигенді аурулар