Содержание

- 2. Порядок выполнения работы Вариант выбирается из папки Варианты для контрольной и лабораторной. Данные варианта импортируются в

- 3. Деревья решений Деревья решений – это способ представления правил в иерархической, последовательной структуре, где каждому объекту

- 4. Как построить дерево решений? Пусть нам задано некоторое обучающее множество T, содержащее объекты (примеры), каждый из

- 6. Вышеописанная процедура лежит в основе многих современных алгоритмов построения деревьев решений, этот метод известен еще под

- 7. CART (Classification and Regression Tree) – это алгоритм построения бинарного дерева решений – дихотомической классификационной модели.

- 8. Большинство из известных алгоритмов являются "жадными алгоритмами". Если один раз был выбран признак, и по нему

- 9. Этапы построения деревьев решений При построении деревьев решений особое внимание уделяется следующим вопросам: выбору признака, по

- 10. Правило разбиения Каким образом следует выбрать признак? Для построения дерева на каждом внутреннем узле необходимо найти

- 11. Были разработаны различные критерии, один из них - Статистический критерий Алгоритм CART использует так называемый индекс

- 12. Функции Matlab для работы с деревьями решений Расчет бинарного дерева классификации наблюдений T = treefit(X,y) функция

- 13. Графическое представление бинарного дерева классификации treedisp(T) функция позволяет получить графическое представление бинарного дерева для классификации наблюдений

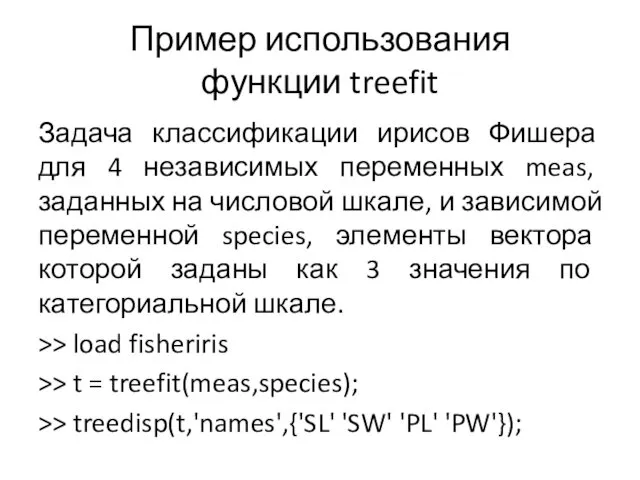

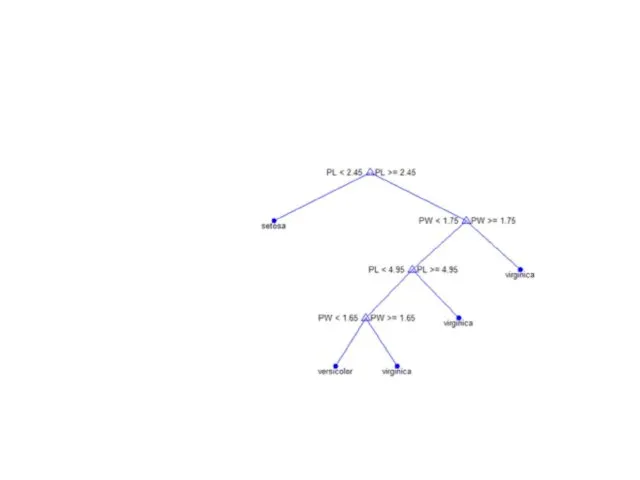

- 14. Пример использования функции treefit Задача классификации ирисов Фишера для 4 независимых переменных meas, заданных на числовой

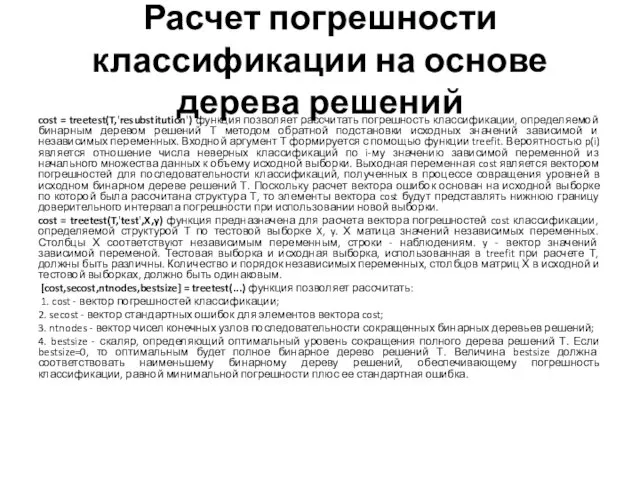

- 16. Расчет погрешности классификации на основе дерева решений cost = treetest(T,'resubstitution') функция позволяет рассчитать погрешность классификации, определяемой

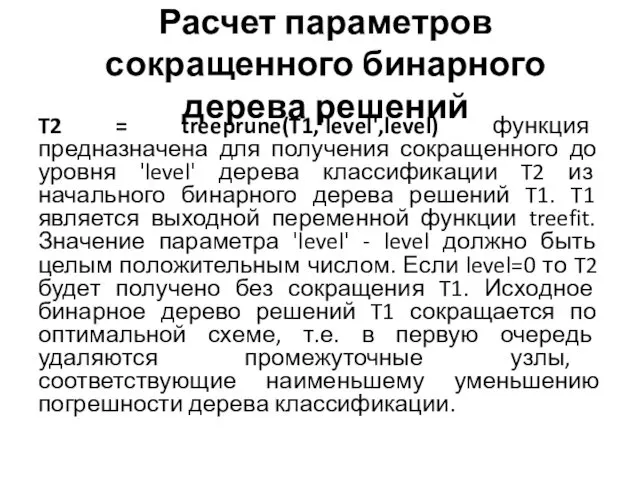

- 17. Расчет параметров сокращенного бинарного дерева решений T2 = treeprune(T1,'level',level) функция предназначена для получения сокращенного до уровня

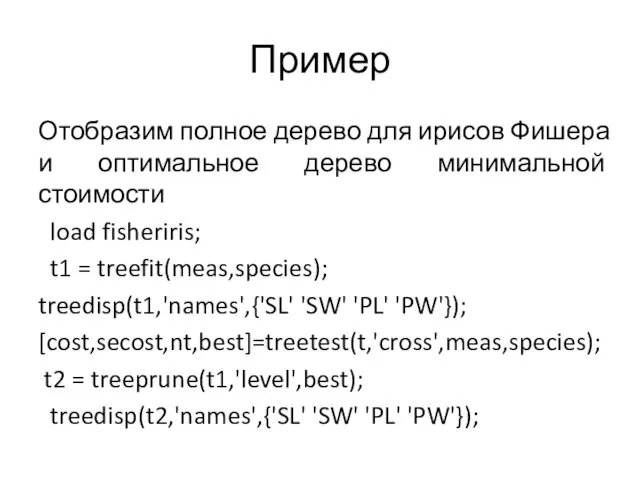

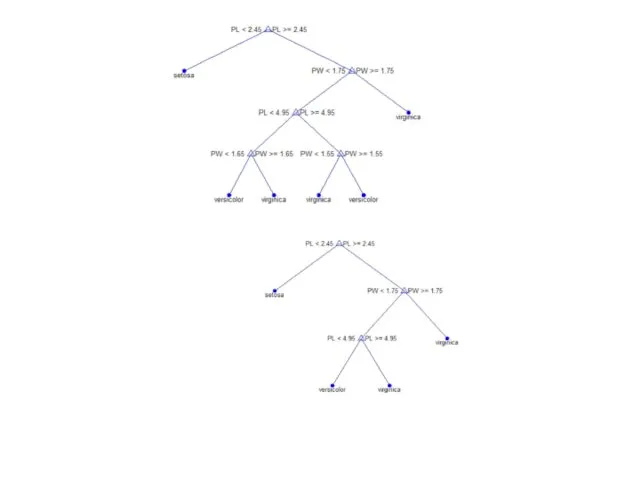

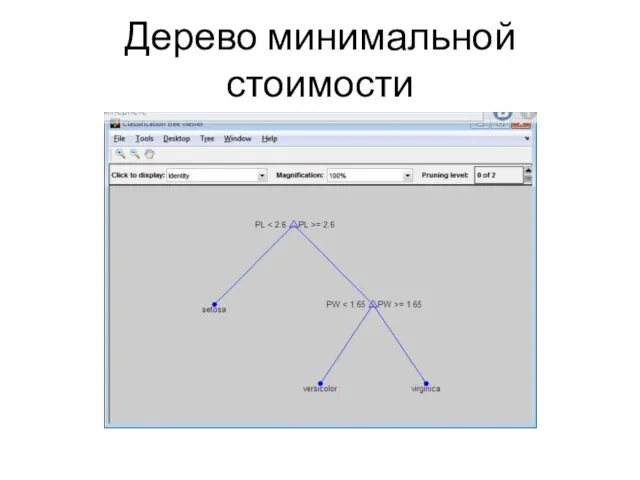

- 18. Пример Отобразим полное дерево для ирисов Фишера и оптимальное дерево минимальной стоимости load fisheriris; t1 =

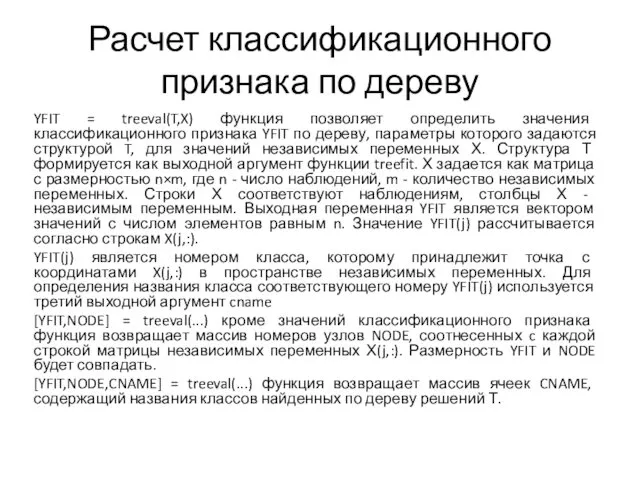

- 20. Расчет классификационного признака по дереву YFIT = treeval(T,X) функция позволяет определить значения классификационного признака YFIT по

- 21. Пример load fisheriris; t = treefit(meas,species); [cost,secost,ntnodes,bestsize] = treetest(t,'cross',meas,species); t2 = treeprune(t,'level',bestsize); treedisp(t2,'names',{'SL' 'SW' 'PL' 'PW'});

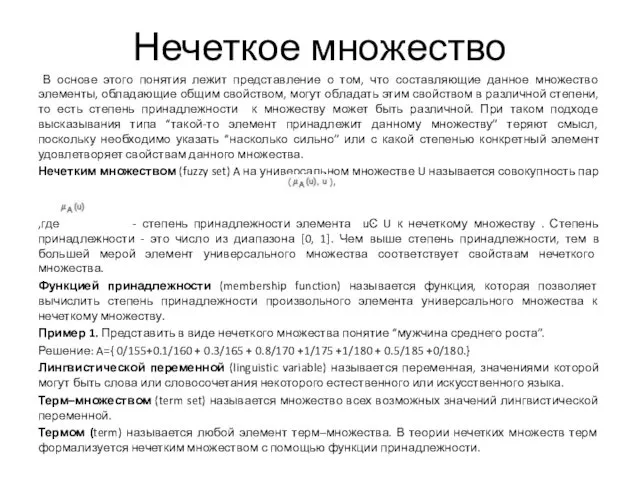

- 22. Нечеткое множество В основе этого понятия лежит представление о том, что составляющие данное множество элементы, обладающие

- 23. Нечеткая база знаний Нечеткой базой знаний называется совокупность нечетких правил "Если - то", определяющих взаимосвязь между

- 24. Пример 2. Рассмотрим переменную “скорость автомобиля”, которая оценивается по шкале “низкая", "средняя", "высокая” и “очень высокая".

- 25. Пример. Следующая нечеткая база знаний описывает зависимость между возрастом водителя (x) и возможностью дорожно-транспортного происшествия (y):

- 26. Нечеткий логический вывод Обычный, булев логический вывод базируется на правиле модус поненс, которое можно записать так:

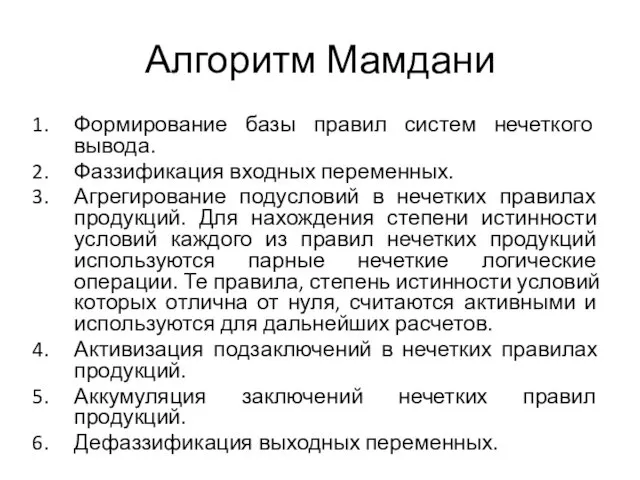

- 27. Алгоритм Мамдани Формирование базы правил систем нечеткого вывода. Фаззификация входных переменных. Агрегирование подусловий в нечетких правилах

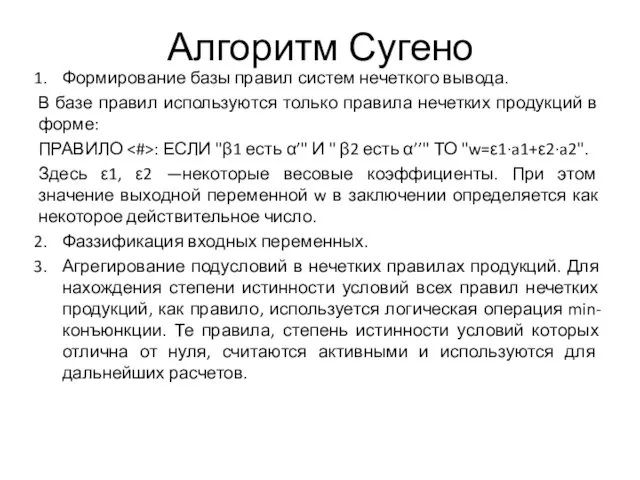

- 28. Алгоритм Сугено Формирование базы правил систем нечеткого вывода. В базе правил используются только правила нечетких продукций

- 29. Активизация подзаключений в нечетких правилах продукций. Во-первых, с использованием метода (8.6) находятся значения степеней истинности всех

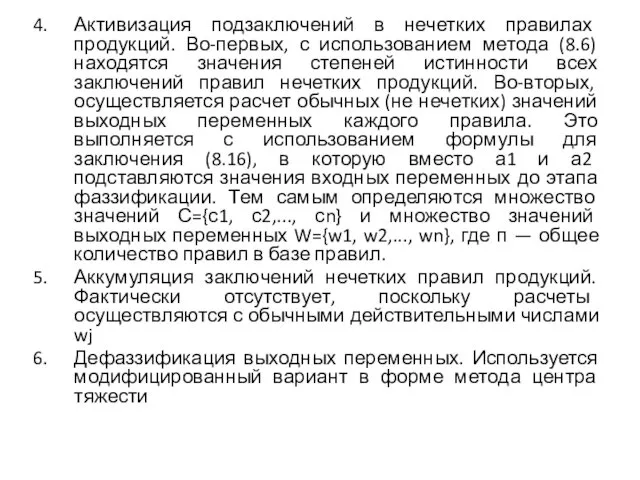

- 30. Функции matlab для работы с fis EVALFIS Выполнение нечеткого логического вывода output = evalfis(input, fis) Выполняет

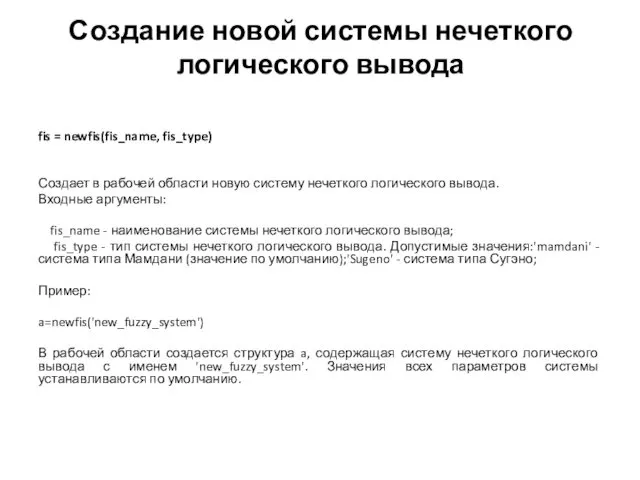

- 31. Создание новой системы нечеткого логического вывода fis = newfis(fis_name, fis_type) Создает в рабочей области новую систему

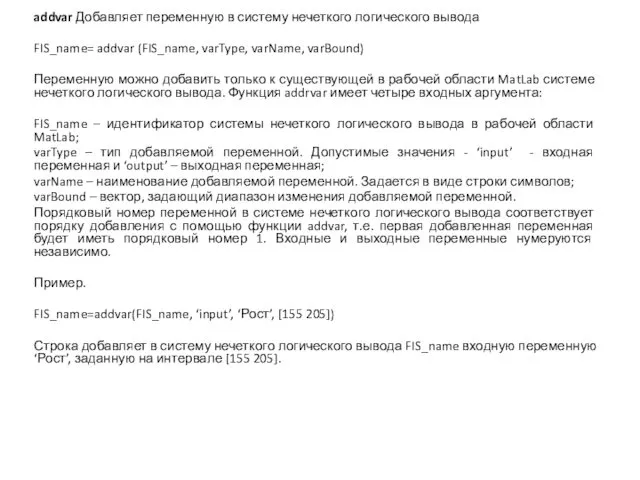

- 32. addvar Добавляет переменную в систему нечеткого логического вывода FIS_name= addvar (FIS_name, varType, varName, varBound) Переменную можно

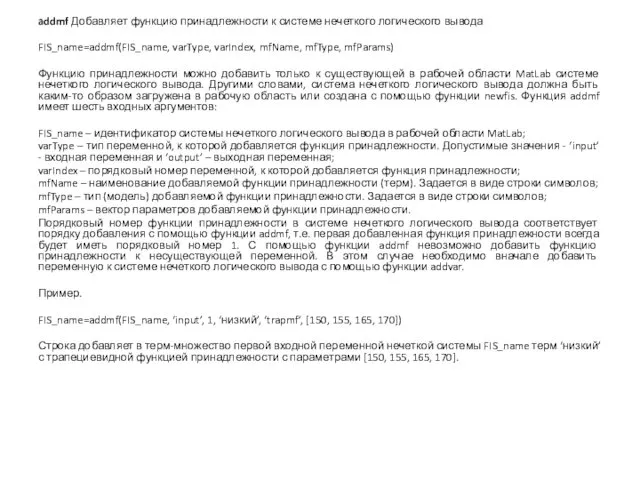

- 33. addmf Добавляет функцию принадлежности к системе нечеткого логического вывода FIS_name=addmf(FIS_name, varType, varIndex, mfName, mfType, mfParams) Функцию

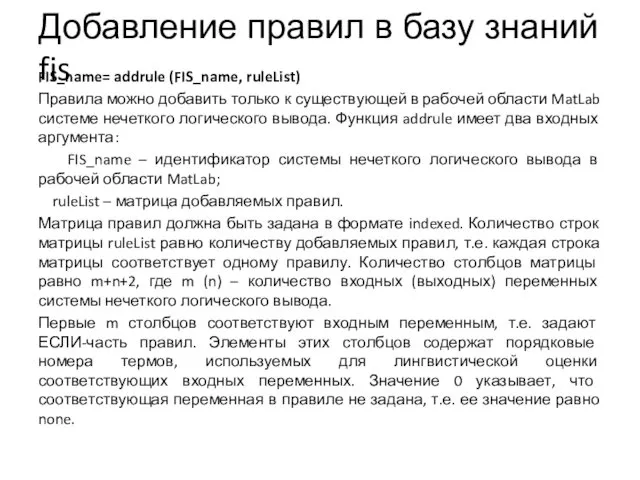

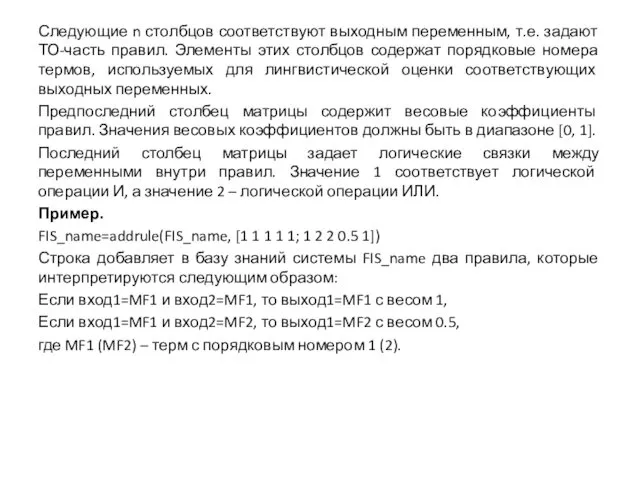

- 34. Добавление правил в базу знаний fis FIS_name= addrule (FIS_name, ruleList) Правила можно добавить только к существующей

- 35. Следующие n столбцов соответствуют выходным переменным, т.е. задают ТО-часть правил. Элементы этих столбцов содержат порядковые номера

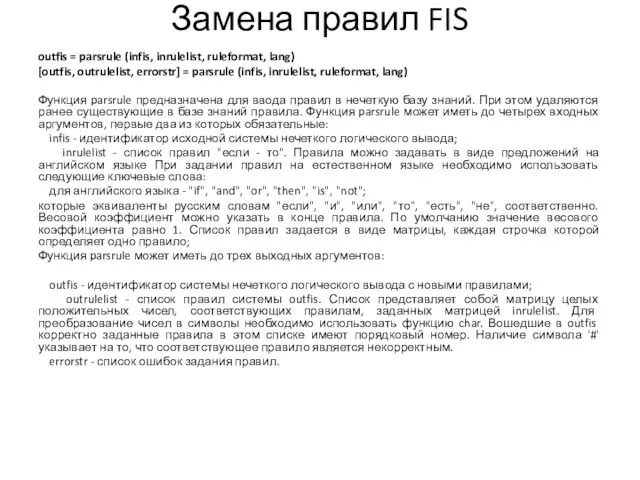

- 36. Замена правил FIS outfis = parsrule (infis, inrulelist, ruleformat, lang) [outfis, outrulelist, errorstr] = parsrule (infis,

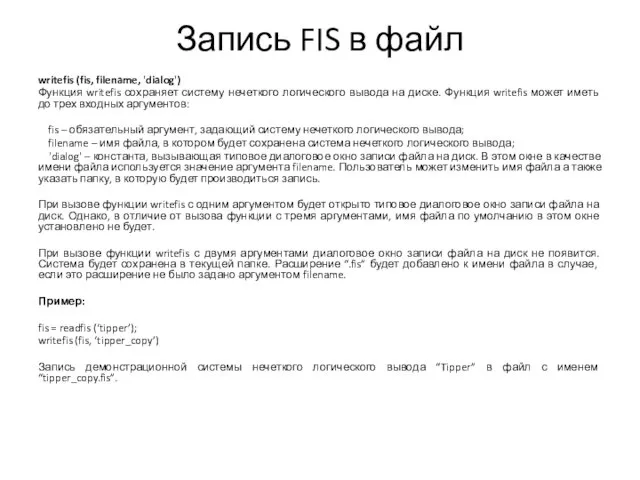

- 37. Пример infis=readfis('tipper'); r1='if service is good then tip is average '; r2='if service is poor and

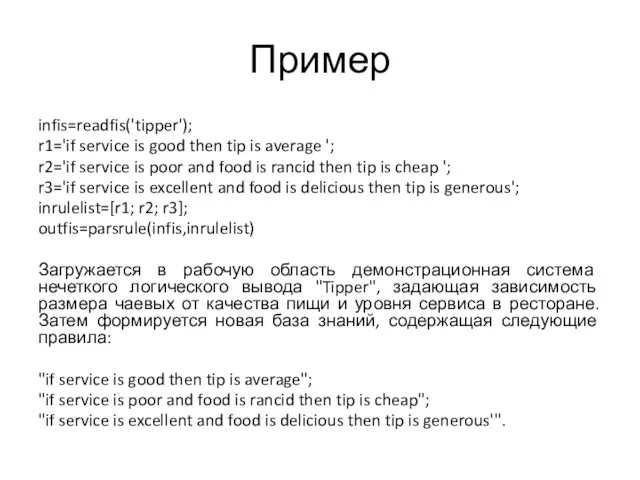

- 38. Запись FIS в файл writefis (fis, filename, 'dialog') Функция writefis сохраняет систему нечеткого логического вывода на

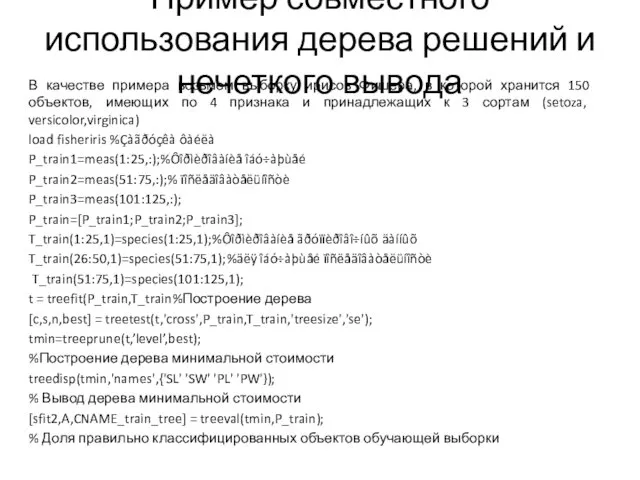

- 39. Пример совместного использования дерева решений и нечеткого вывода В качестве примера возьмем выборку ирисов Фишера, в

- 40. %Ôîðìèðîâàíèå êîíòðîëèðóþùåéâûáîðêè P_ch1=meas(26:50,:); P_ch2=meas(76:100,:); P_ch3=meas(126:150,:); P_ch=[P_ch1;P_ch2;P_ch3]; %Âû÷èñëåíèå çíà÷åíèé ãðóïïèðîâî÷íîãî ïðèçíàêà %äëÿ êîíòðîëèðóþùåé âûáîðêè T_ch(1:25,1)=species(26:50,1); T_ch(26:50,1)=species(76:100,1); T_ch(51:75,1)=species(126:150,1);

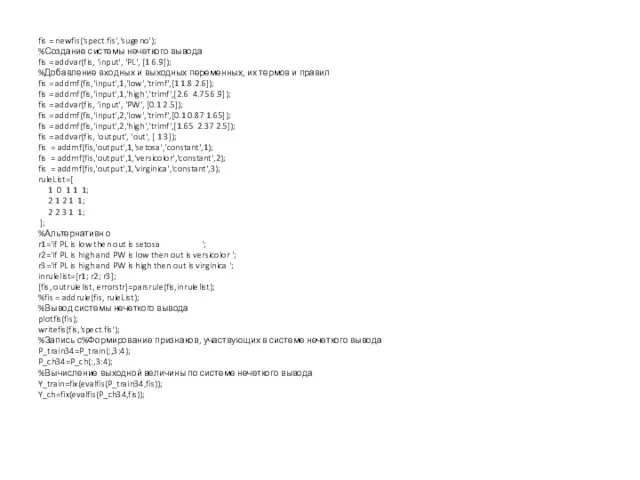

- 41. fis = newfis('spect.fis','sugeno'); %Создание системы нечеткого вывода fis = addvar(fis, 'input', 'PL', [1 6.9]); %Добавление входных

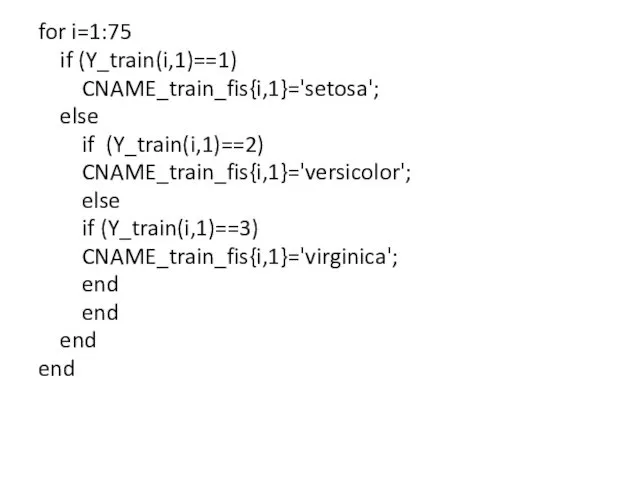

- 42. for i=1:75 if (Y_train(i,1)==1) CNAME_train_fis{i,1}='setosa'; else if (Y_train(i,1)==2) CNAME_train_fis{i,1}='versicolor'; else if (Y_train(i,1)==3) CNAME_train_fis{i,1}='virginica'; end end end

- 43. for i=1:75 if (Y_ch(i,1)==1) CNAME_ch_fis{i,1}='setosa'; else if (Y_ch(i,1)==2) CNAME_ch_fis{i,1}='versicolor'; else if (Y_ch(i,1)==3) CNAME_ch_fis{i,1}='virginica'; end end end

- 44. Дерево минимальной стоимости

- 46. Скачать презентацию

![Пример load fisheriris; t = treefit(meas,species); [cost,secost,ntnodes,bestsize] = treetest(t,'cross',meas,species); t2](/_ipx/f_webp&q_80&fit_contain&s_1440x1080/imagesDir/jpg/39557/slide-20.jpg)

![%Ôîðìèðîâàíèå êîíòðîëèðóþùåéâûáîðêè P_ch1=meas(26:50,:); P_ch2=meas(76:100,:); P_ch3=meas(126:150,:); P_ch=[P_ch1;P_ch2;P_ch3]; %Âû÷èñëåíèå çíà÷åíèé ãðóïïèðîâî÷íîãî ïðèçíàêà](/_ipx/f_webp&q_80&fit_contain&s_1440x1080/imagesDir/jpg/39557/slide-39.jpg)

Артикуляционная гимнастика.

Артикуляционная гимнастика. Focusing ground penetrating radar images with vertical offset filtering

Focusing ground penetrating radar images with vertical offset filtering Конспект урока по химии в 8 классе по теме Простые вещества - металлы

Конспект урока по химии в 8 классе по теме Простые вещества - металлы Конспект урока в 7-ом классе по географии Движение воды в океане

Конспект урока в 7-ом классе по географии Движение воды в океане Сабриново. Создание сети домов-пансионатов для пожилых людей

Сабриново. Создание сети домов-пансионатов для пожилых людей Smart home. Technologies. Automation and robotics

Smart home. Technologies. Automation and robotics Автоледи

Автоледи Моя семья - моё богатство

Моя семья - моё богатство Шкала самооценки Спилбергера-Ханина

Шкала самооценки Спилбергера-Ханина методическое пособие Разложи по порядку

методическое пособие Разложи по порядку Порядковое числительное. 6 класс

Порядковое числительное. 6 класс Загадки на звуки (Р и Р`) (логопедические упражнения)

Загадки на звуки (Р и Р`) (логопедические упражнения) Развитие туризма в Древнем Китае

Развитие туризма в Древнем Китае Анализ сегментов рынка земли. Характеристики цен на товарном рынке. Определение типа рынка и выбор методов ценообразования

Анализ сегментов рынка земли. Характеристики цен на товарном рынке. Определение типа рынка и выбор методов ценообразования Игра Найди 10 мышек

Игра Найди 10 мышек Дерматомиозит/ полимиозит

Дерматомиозит/ полимиозит Тест. Планеты Солнечной системы

Тест. Планеты Солнечной системы Дети военных лет

Дети военных лет Опыт проведения православного фестиваля детского художественного творчества Светлая Пасха

Опыт проведения православного фестиваля детского художественного творчества Светлая Пасха Михаил Юрьевич Лермонтов Бородино

Михаил Юрьевич Лермонтов Бородино презентация на тему Игрушки Диск

презентация на тему Игрушки Диск Изменение климата

Изменение климата Презентация Жанры изобразительного искусства

Презентация Жанры изобразительного искусства Минеральные ресурсы мира

Минеральные ресурсы мира Теорія Надлюдини Фрідріха Ніцше та її місце у романі Кена Кізі Політ над гніздом зозулі

Теорія Надлюдини Фрідріха Ніцше та її місце у романі Кена Кізі Політ над гніздом зозулі Электронная база викторин по безопасности.

Электронная база викторин по безопасности. Фотосинтез

Фотосинтез Безопасное колесо. Конкурс юных инспекторов движения

Безопасное колесо. Конкурс юных инспекторов движения