Содержание

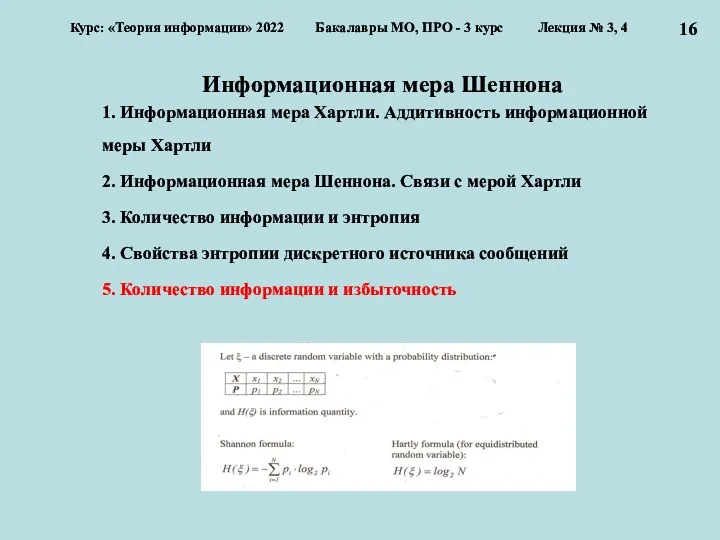

- 2. Информационная мера Шеннона 1. Информационная мера Хартли. Аддитивность информационной меры Хартли 2. Информационная мера Шеннона. Связи

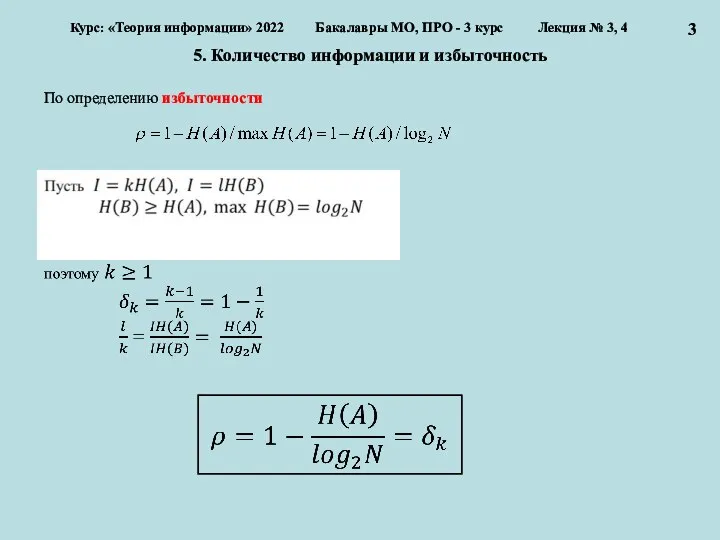

- 3. 5. Количество информации и избыточность По определению избыточности Курс: «Теория информации» 2022 Бакалавры МО, ПРО -

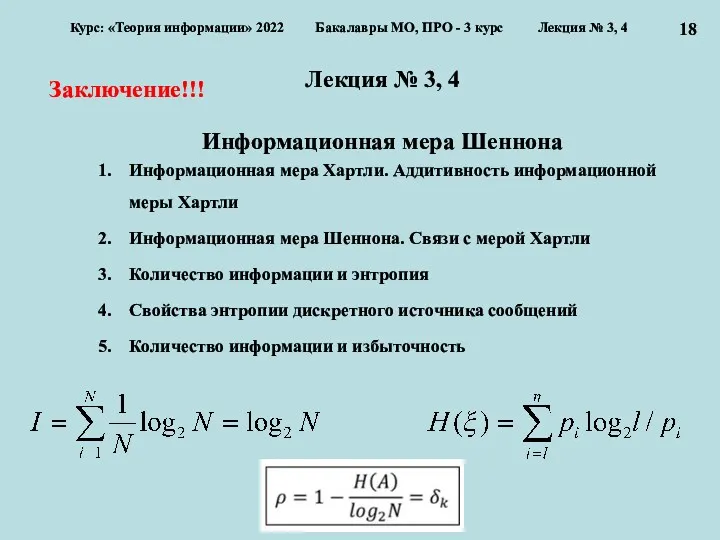

- 4. Лекция № 3, 4 Информационная мера Шеннона Информационная мера Хартли. Аддитивность информационной меры Хартли Информационная мера

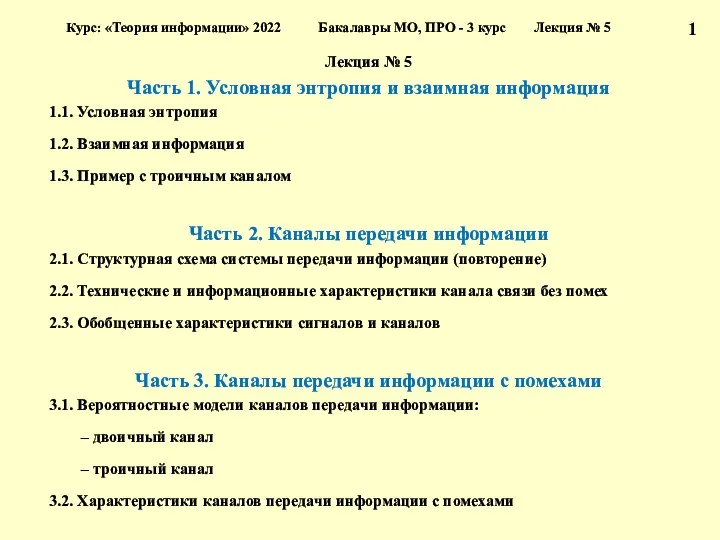

- 5. Лекция № 5 Часть 1. Условная энтропия и взаимная информация 1.1. Условная энтропия 1.2. Взаимная информация

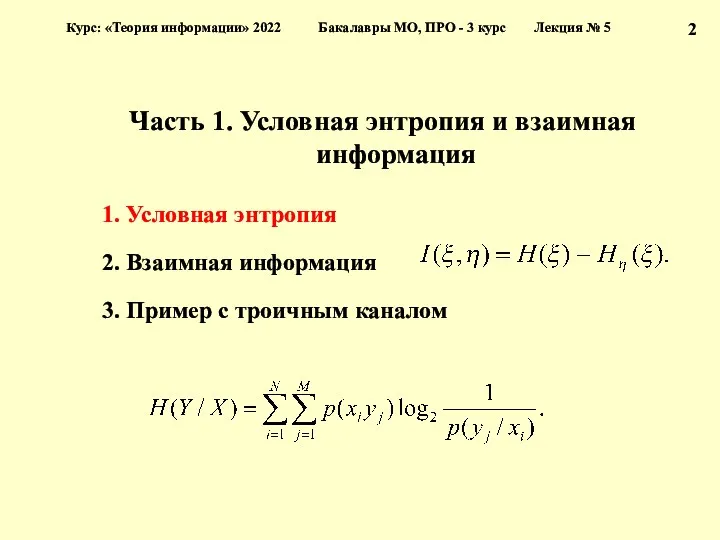

- 6. Часть 1. Условная энтропия и взаимная информация 1. Условная энтропия 2. Взаимная информация 3. Пример с

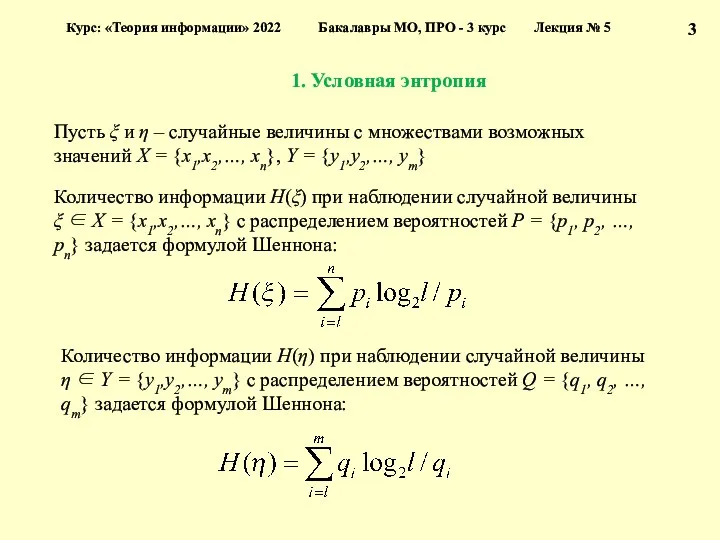

- 7. 1. Условная энтропия Курс: «Теория информации» 2022 Бакалавры МО, ПРО - 3 курс Лекция № 5

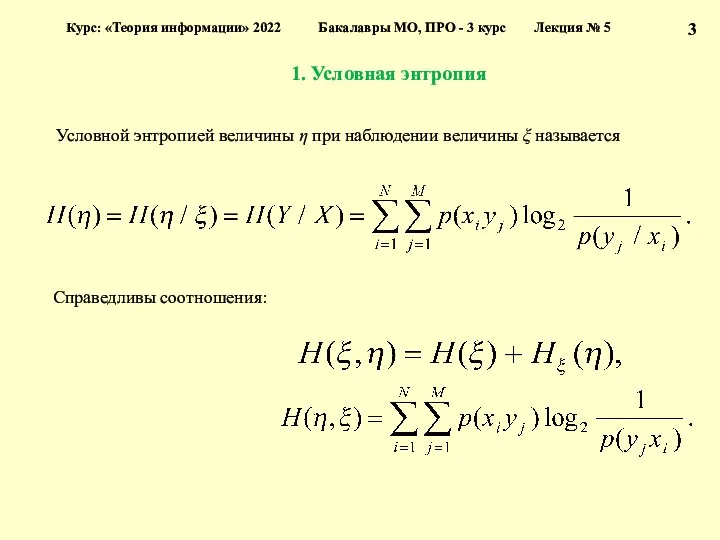

- 8. 1. Условная энтропия Курс: «Теория информации» 2022 Бакалавры МО, ПРО - 3 курс Лекция № 5

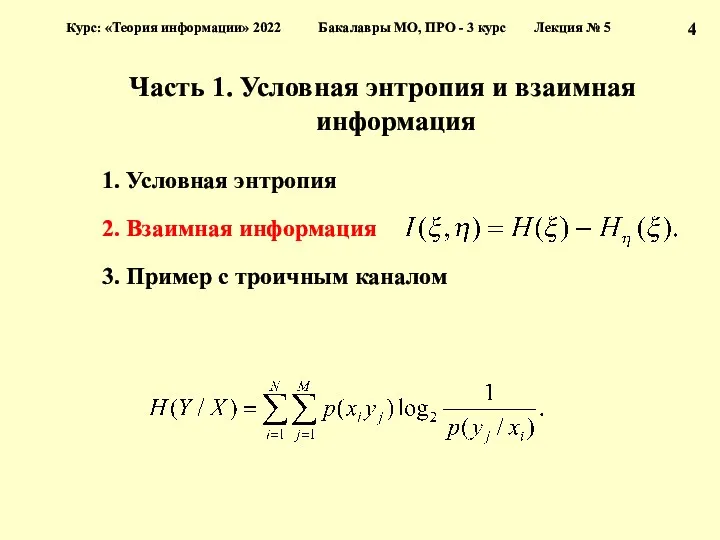

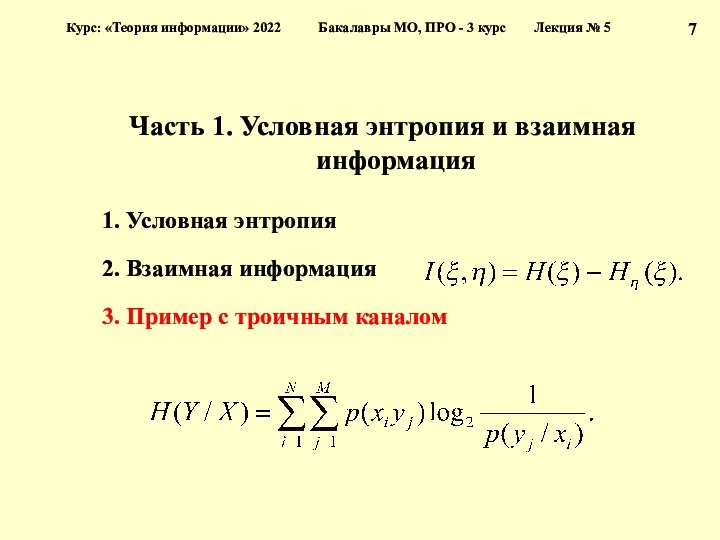

- 9. Часть 1. Условная энтропия и взаимная информация 1. Условная энтропия 2. Взаимная информация 3. Пример с

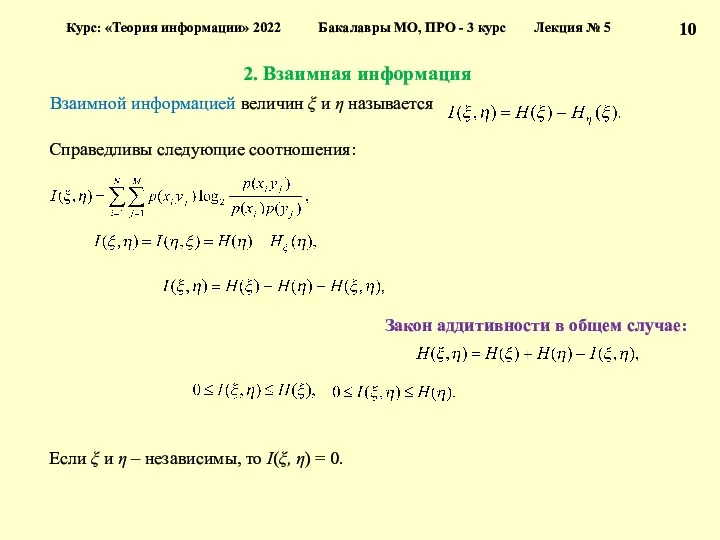

- 10. 2. Взаимная информация Курс: «Теория информации» 2022 Бакалавры МО, ПРО - 3 курс Лекция № 5

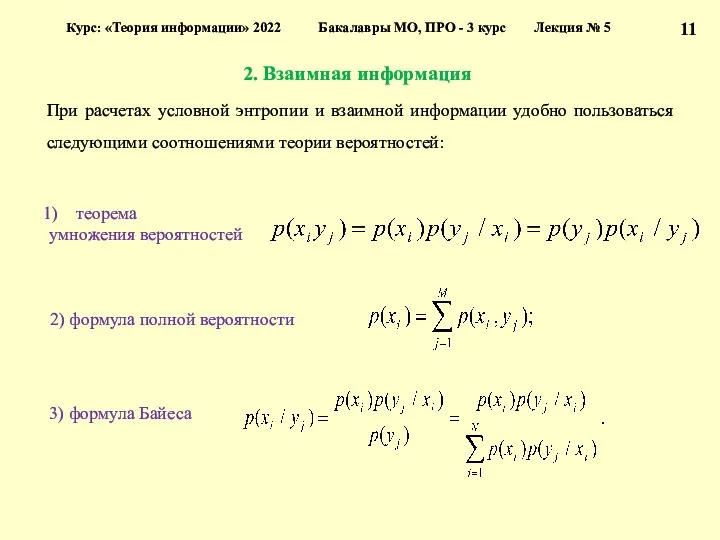

- 11. 2. Взаимная информация Курс: «Теория информации» 2022 Бакалавры МО, ПРО - 3 курс Лекция № 5

- 12. Часть 1. Условная энтропия и взаимная информация 1. Условная энтропия 2. Взаимная информация 3. Пример с

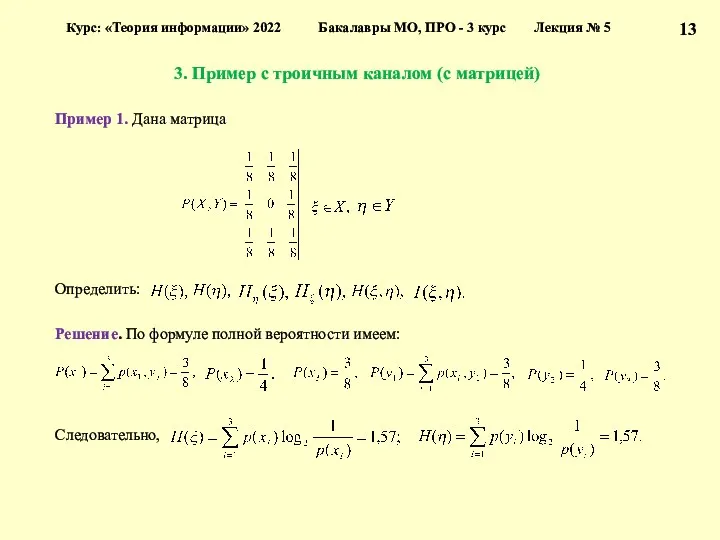

- 13. 3. Пример с троичным каналом (с матрицей) Курс: «Теория информации» 2022 Бакалавры МО, ПРО - 3

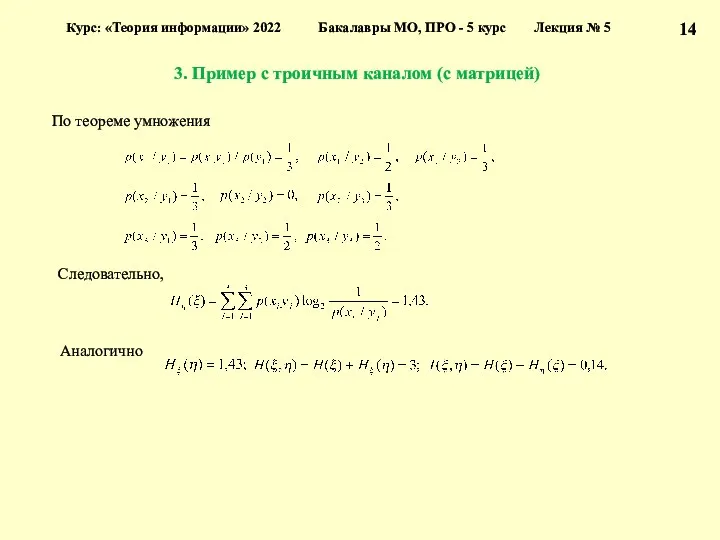

- 14. 3. Пример с троичным каналом (с матрицей) Курс: «Теория информации» 2022 Бакалавры МО, ПРО - 5

- 15. Лекция № 5 Часть 2. Каналы передачи информации 2.1. Структурная схема системы передачи информации (повторение) 2.2.

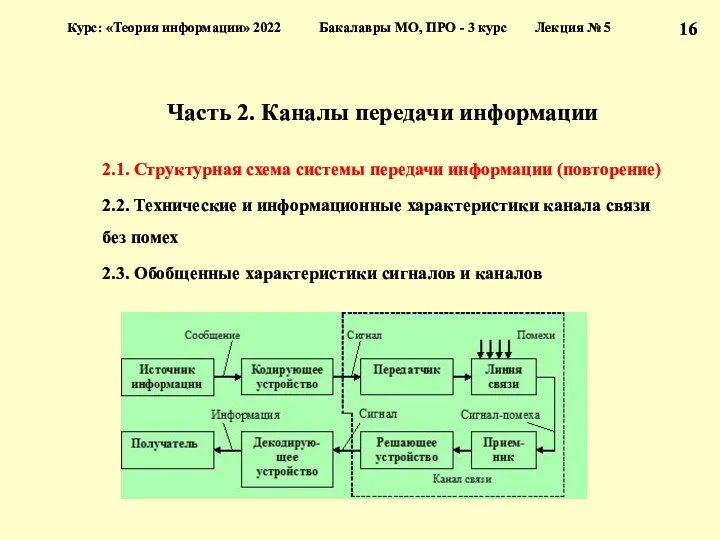

- 16. Часть 2. Каналы передачи информации 2.1. Структурная схема системы передачи информации (повторение) 2.2. Технические и информационные

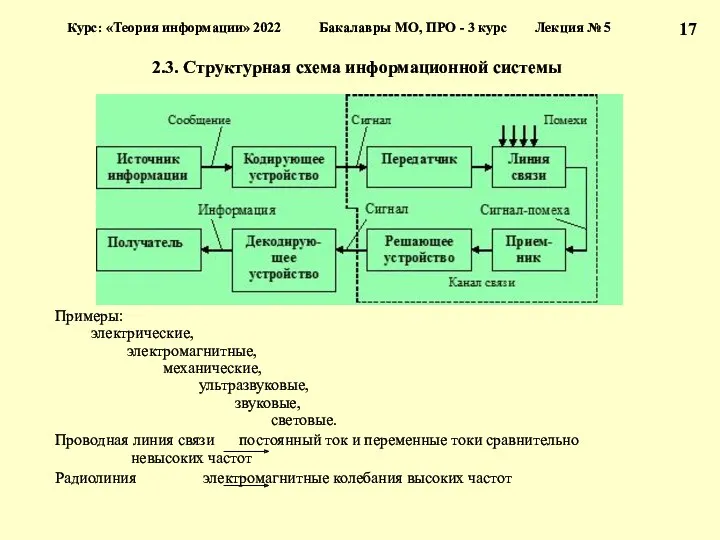

- 17. 2.3. Структурная схема информационной системы Примеры: электрические, электромагнитные, механические, ультразвуковые, звуковые, световые. Проводная линия связи постоянный

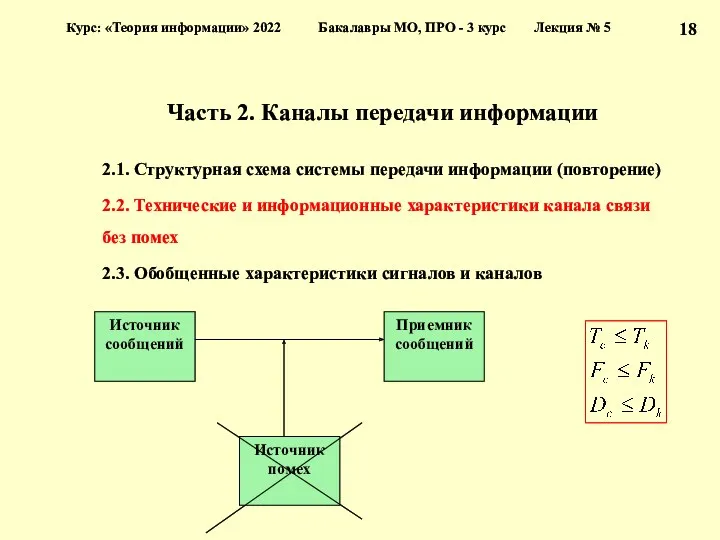

- 18. Часть 2. Каналы передачи информации 2.1. Структурная схема системы передачи информации (повторение) 2.2. Технические и информационные

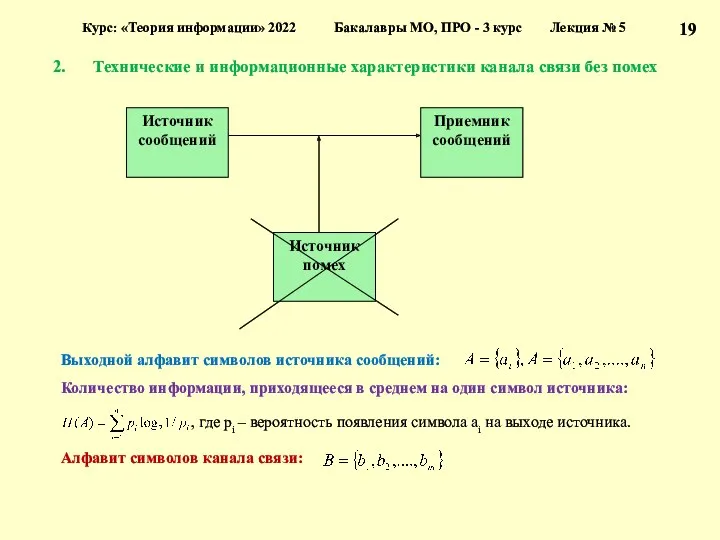

- 19. Технические и информационные характеристики канала связи без помех Курс: «Теория информации» 2022 Бакалавры МО, ПРО -

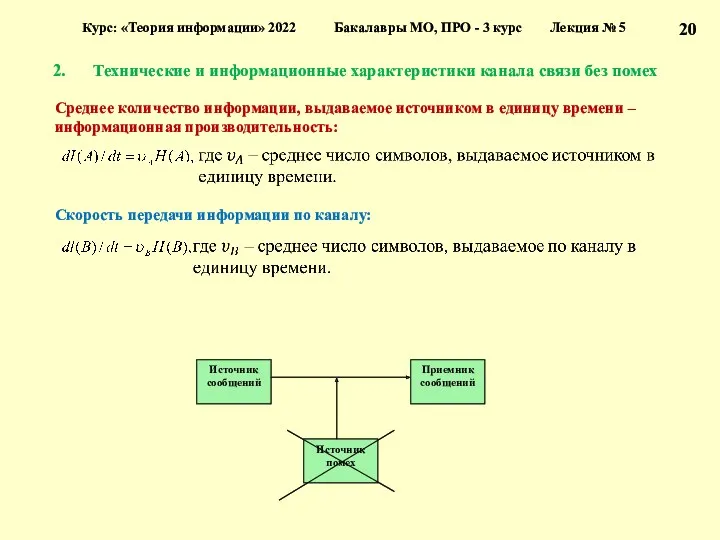

- 20. Технические и информационные характеристики канала связи без помех Курс: «Теория информации» 2022 Бакалавры МО, ПРО -

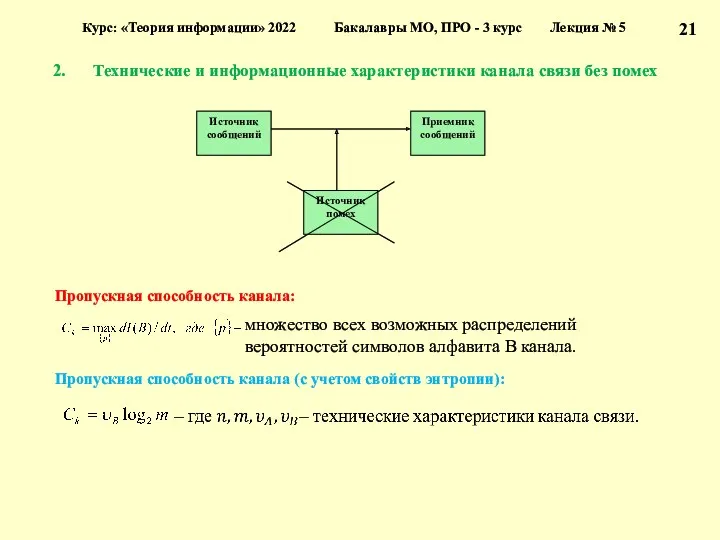

- 21. Технические и информационные характеристики канала связи без помех Курс: «Теория информации» 2022 Бакалавры МО, ПРО -

- 22. Часть 2. Каналы передачи информации 2.1. Структурная схема системы передачи информации (повторение) 2.2. Технические и информационные

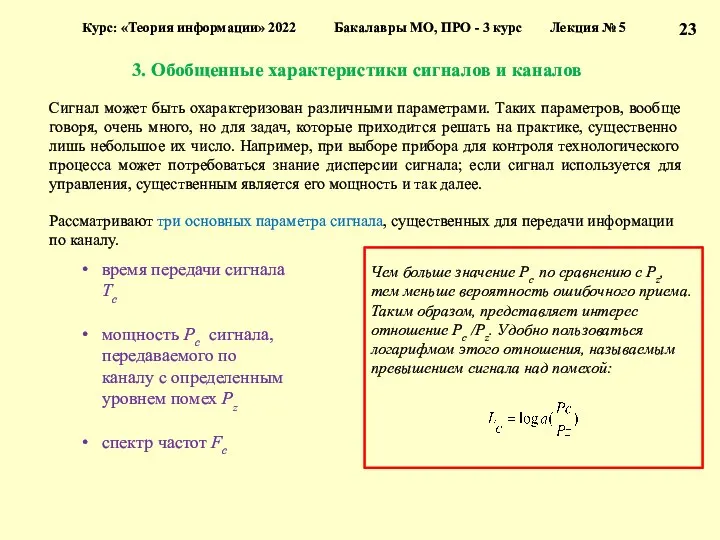

- 23. 3. Обобщенные характеристики сигналов и каналов Курс: «Теория информации» 2022 Бакалавры МО, ПРО - 3 курс

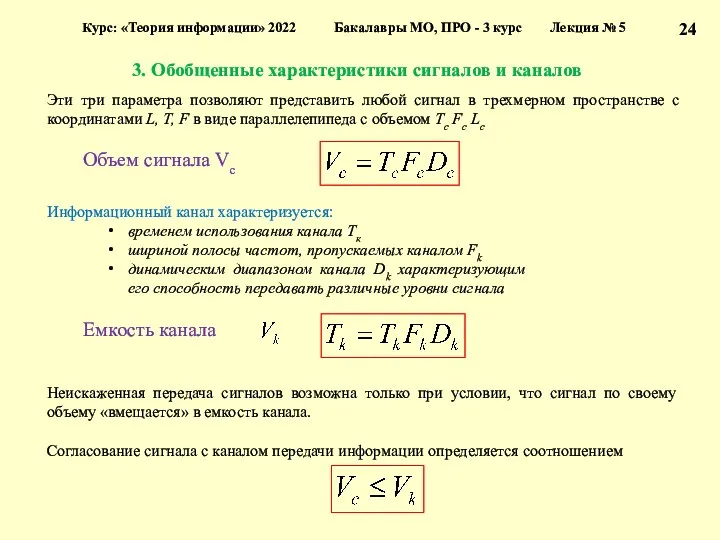

- 24. 3. Обобщенные характеристики сигналов и каналов Курс: «Теория информации» 2022 Бакалавры МО, ПРО - 3 курс

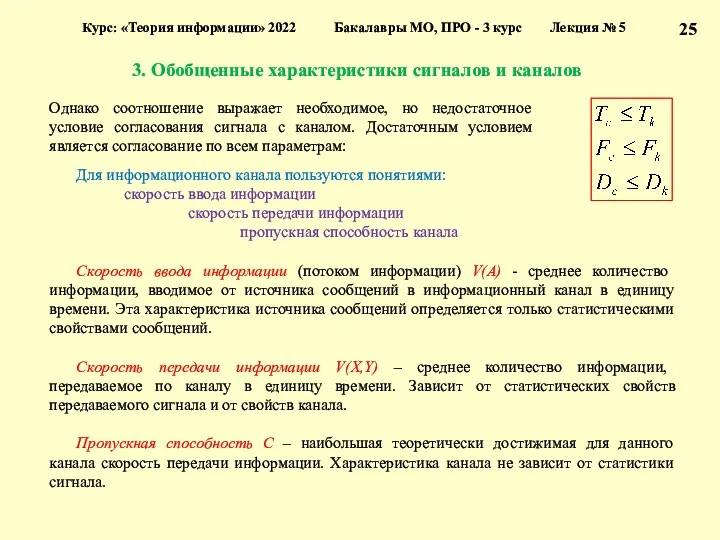

- 25. 3. Обобщенные характеристики сигналов и каналов Курс: «Теория информации» 2022 Бакалавры МО, ПРО - 3 курс

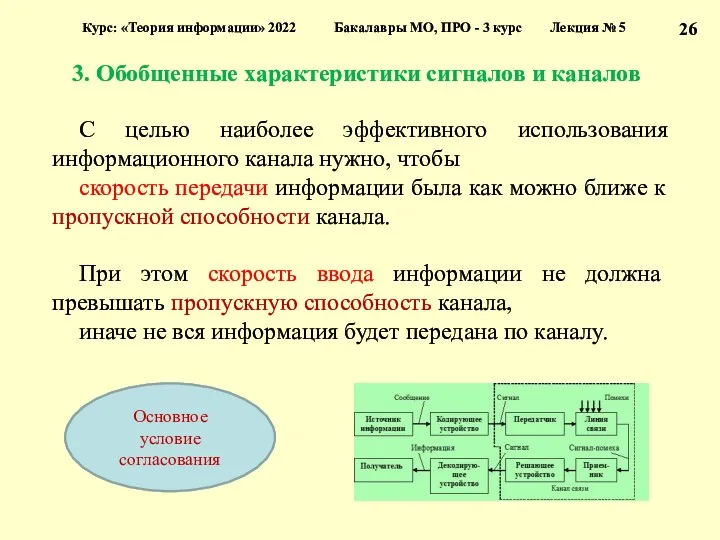

- 26. 3. Обобщенные характеристики сигналов и каналов Курс: «Теория информации» 2022 Бакалавры МО, ПРО - 3 курс

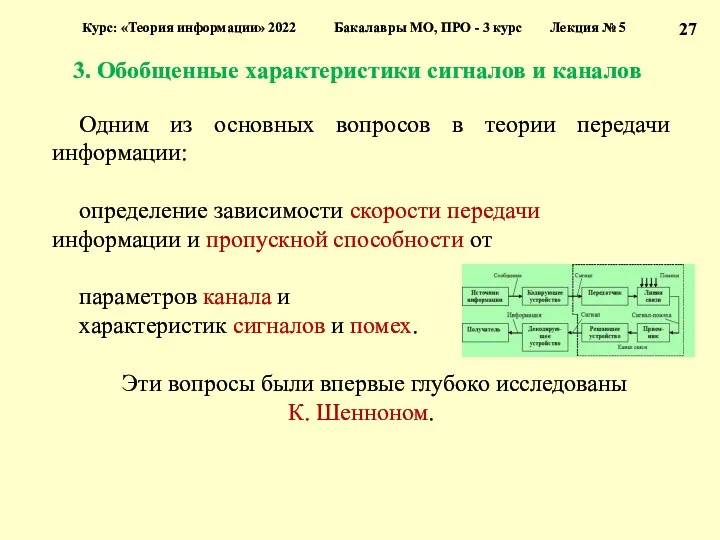

- 27. 3. Обобщенные характеристики сигналов и каналов Курс: «Теория информации» 2022 Бакалавры МО, ПРО - 3 курс

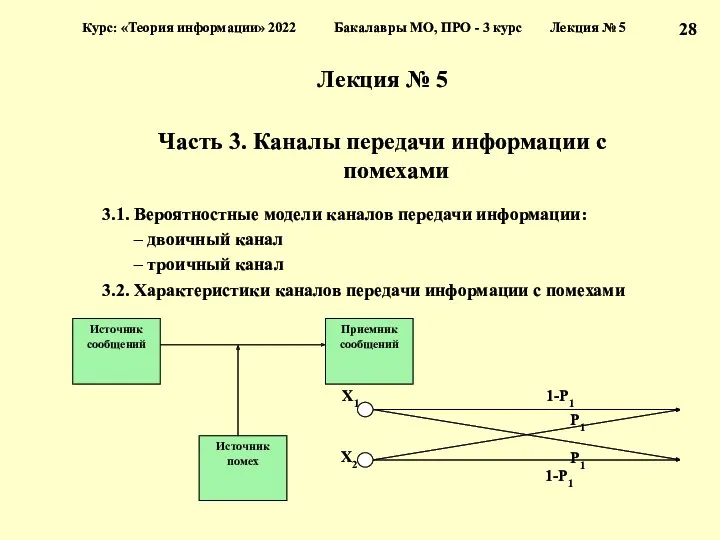

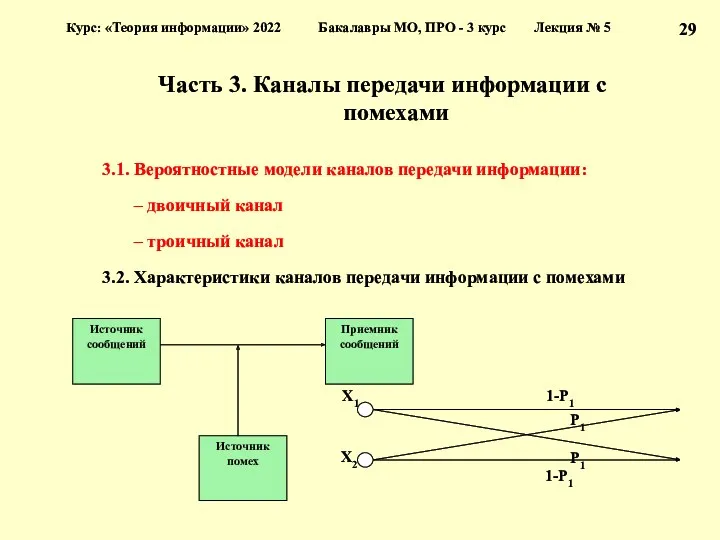

- 28. Лекция № 5 Часть 3. Каналы передачи информации с помехами 3.1. Вероятностные модели каналов передачи информации:

- 29. Часть 3. Каналы передачи информации с помехами 3.1. Вероятностные модели каналов передачи информации: – двоичный канал

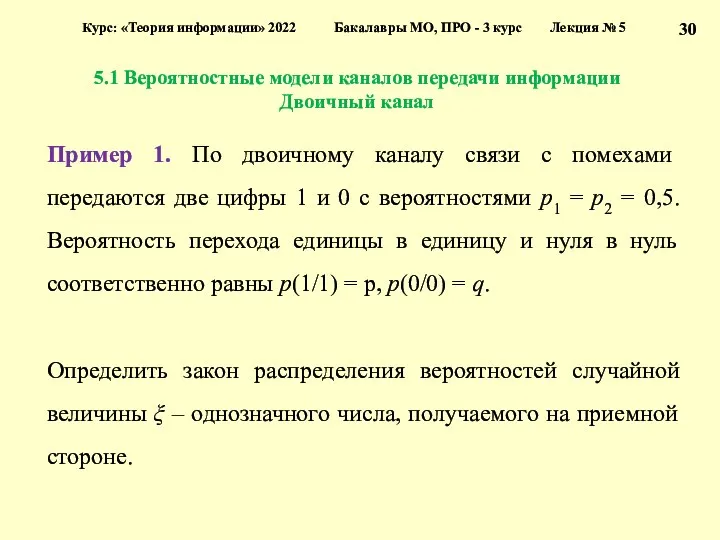

- 30. 5.1 Вероятностные модели каналов передачи информации Двоичный канал Курс: «Теория информации» 2022 Бакалавры МО, ПРО -

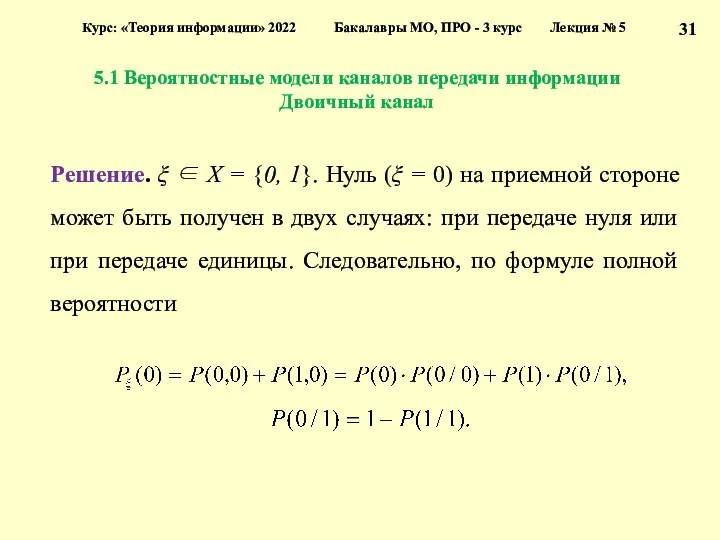

- 31. 5.1 Вероятностные модели каналов передачи информации Двоичный канал Курс: «Теория информации» 2022 Бакалавры МО, ПРО -

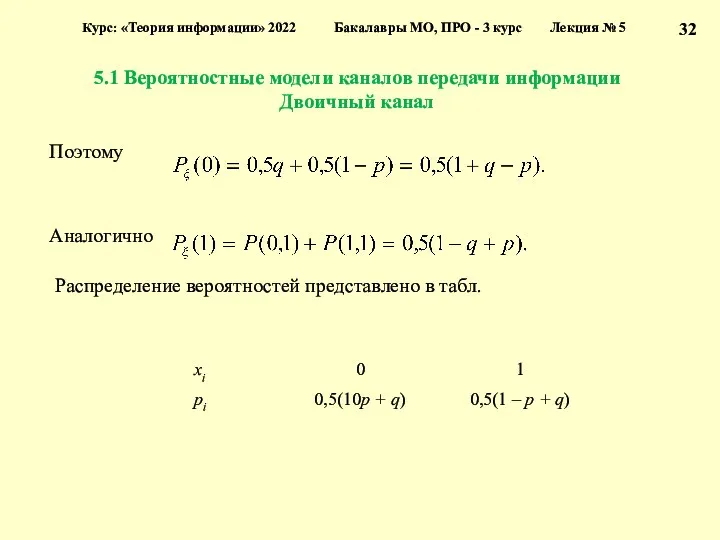

- 32. 5.1 Вероятностные модели каналов передачи информации Двоичный канал Курс: «Теория информации» 2022 Бакалавры МО, ПРО -

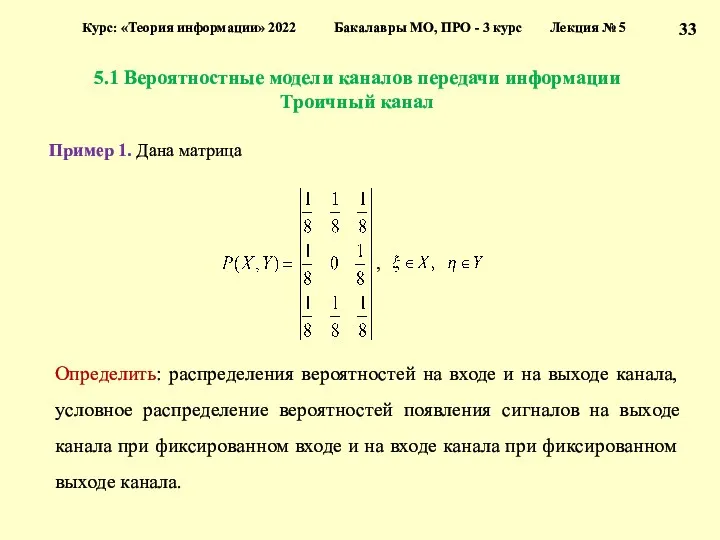

- 33. 5.1 Вероятностные модели каналов передачи информации Троичный канал Курс: «Теория информации» 2022 Бакалавры МО, ПРО -

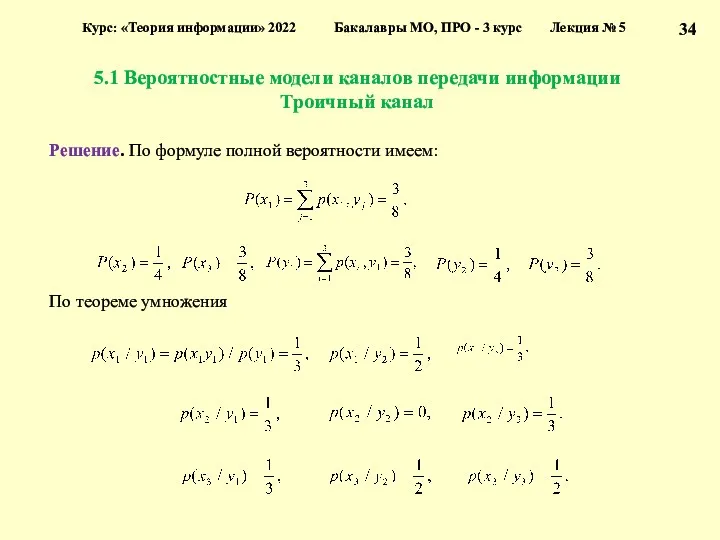

- 34. 5.1 Вероятностные модели каналов передачи информации Троичный канал Курс: «Теория информации» 2022 Бакалавры МО, ПРО -

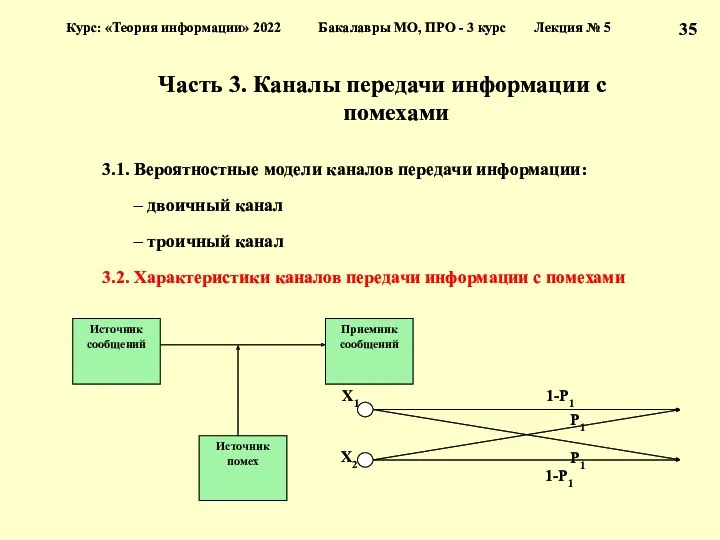

- 35. Часть 3. Каналы передачи информации с помехами 3.1. Вероятностные модели каналов передачи информации: – двоичный канал

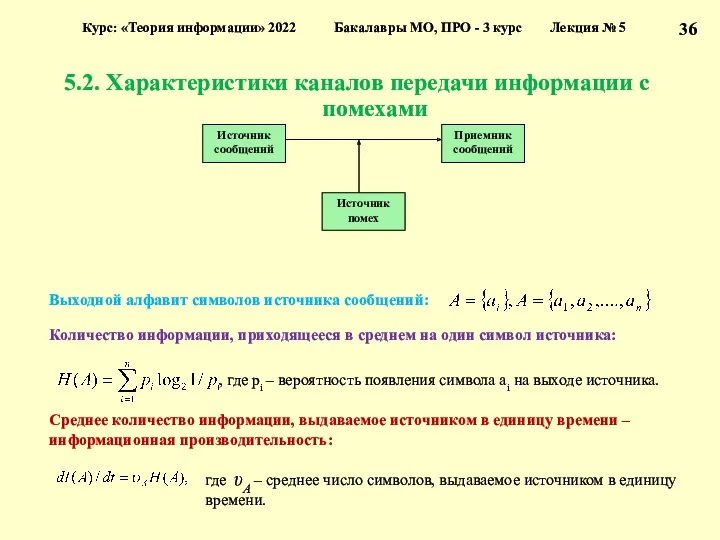

- 36. 5.2. Характеристики каналов передачи информации с помехами Курс: «Теория информации» 2022 Бакалавры МО, ПРО - 3

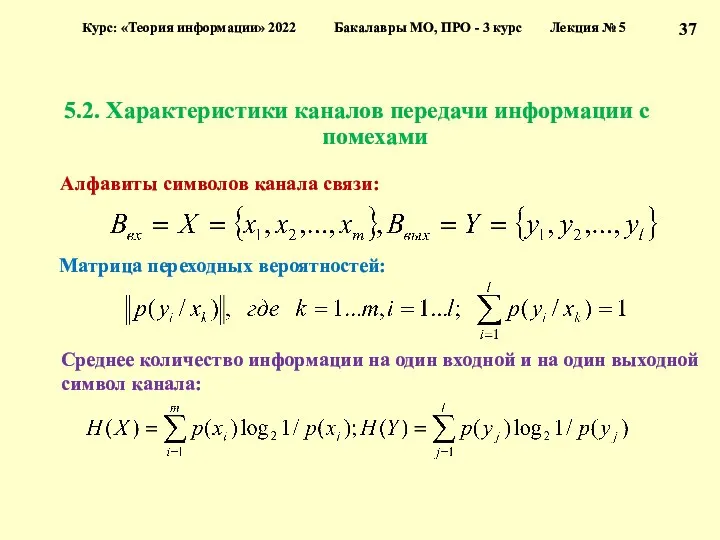

- 37. 5.2. Характеристики каналов передачи информации с помехами Курс: «Теория информации» 2022 Бакалавры МО, ПРО - 3

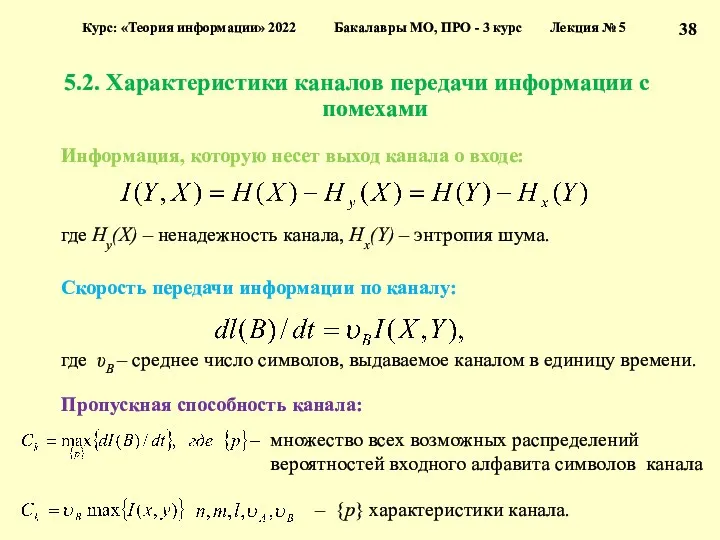

- 38. 5.2. Характеристики каналов передачи информации с помехами Курс: «Теория информации» 2022 Бакалавры МО, ПРО - 3

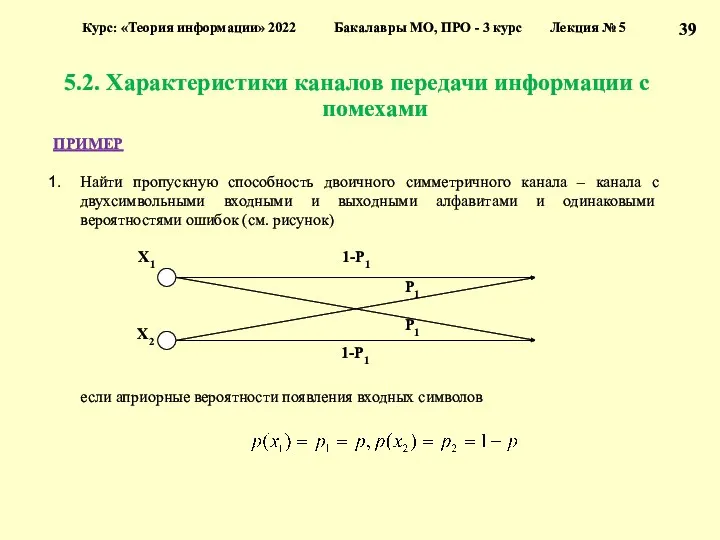

- 39. 5.2. Характеристики каналов передачи информации с помехами Курс: «Теория информации» 2022 Бакалавры МО, ПРО - 3

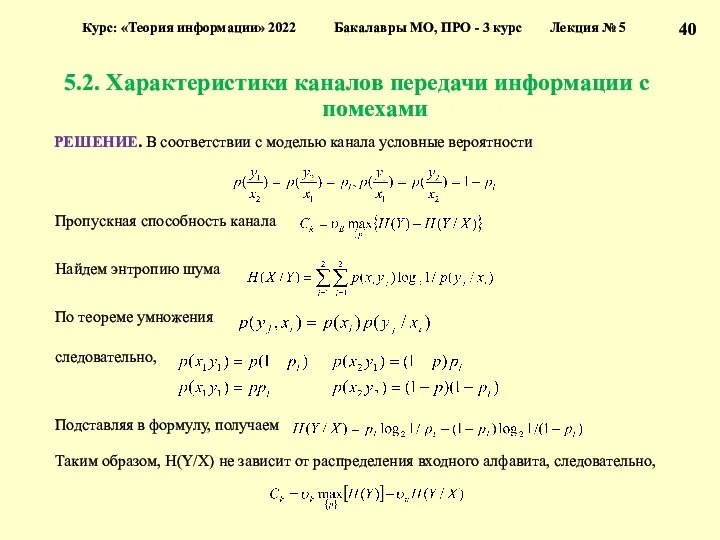

- 40. 5.2. Характеристики каналов передачи информации с помехами Курс: «Теория информации» 2022 Бакалавры МО, ПРО - 3

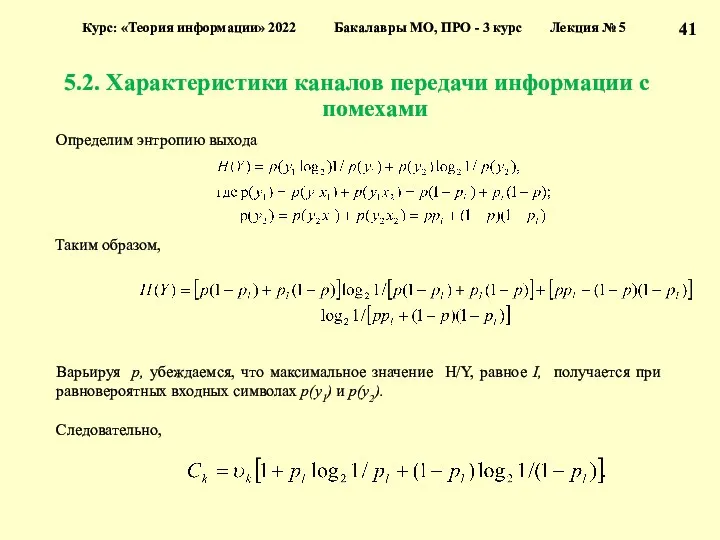

- 41. 5.2. Характеристики каналов передачи информации с помехами Курс: «Теория информации» 2022 Бакалавры МО, ПРО - 3

- 43. Скачать презентацию

Электронные библиотеки

Электронные библиотеки Библиотека: вчера, сегодня, завтра

Библиотека: вчера, сегодня, завтра Компьютерные переводчики

Компьютерные переводчики История вычислительной техники. Поколения ЭВМ

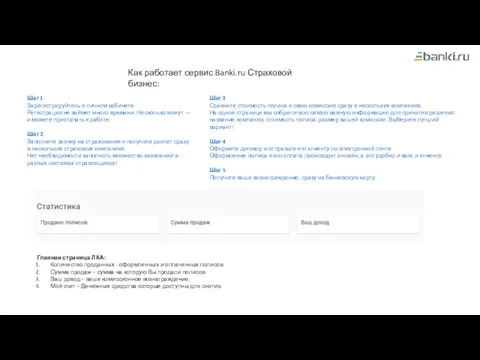

История вычислительной техники. Поколения ЭВМ Как работает сервис Banki.ru Страховой бизнес. Инструкция ЛК-1

Как работает сервис Banki.ru Страховой бизнес. Инструкция ЛК-1 Linux-операциялық жүйесі

Linux-операциялық жүйесі Текстовый процессор Microsoft Word 2010

Текстовый процессор Microsoft Word 2010 Электронная информационно-образовательная среда (ЭИОС). Сибирский институт управления

Электронная информационно-образовательная среда (ЭИОС). Сибирский институт управления HTML. Текст, списки

HTML. Текст, списки Разработка программной платформы для создания и проведения квест-мероприятий

Разработка программной платформы для создания и проведения квест-мероприятий Подходы к понятию информация

Подходы к понятию информация Веб-разработка. История WWW, браузеров и технологий

Веб-разработка. История WWW, браузеров и технологий Конвертирование данных из текстовых файлов в MS EXEL

Конвертирование данных из текстовых файлов в MS EXEL Работа с пакетом Microsoft Office (Word, Excel, PowerPoint)

Работа с пакетом Microsoft Office (Word, Excel, PowerPoint) Проект Создание анимации с помощью программы Power Point@

Проект Создание анимации с помощью программы Power Point@ Интерфейс программы подготовки презентаций

Интерфейс программы подготовки презентаций Табличный процессор Microsoft Excel

Табличный процессор Microsoft Excel Do people communicate better now than in the past?

Do people communicate better now than in the past? Технология программировния. Строки

Технология программировния. Строки Инф.без 9 класс

Инф.без 9 класс Апаратне забезпечення ПК

Апаратне забезпечення ПК Порядок заключения договора ОСАГО в виде электронного документа

Порядок заключения договора ОСАГО в виде электронного документа Основы программирования и баз данных. Модуль 2. Представление информации

Основы программирования и баз данных. Модуль 2. Представление информации Разработка интернет представительства магазина

Разработка интернет представительства магазина Работа с командной строкой Windows

Работа с командной строкой Windows Организация сети. Эталонная модель OSI

Организация сети. Эталонная модель OSI Тестировщик ПО. Блок 6. Тестирование API

Тестировщик ПО. Блок 6. Тестирование API Использование триггеров для создания интерактивных призентаций

Использование триггеров для создания интерактивных призентаций