Содержание

- 2. Введение Информатика возникла сравнительно недавно и по сравнению другими науками еще совсем молода. Причина ее стремительного

- 3. Информатика Термин «информатика» (франц. informatique) происходит французских слов information (информация) и automatique (автоматика) и дословно означает

- 4. Основные направления информатики разработка вычислительных систем и программного обеспечения; теория информации, изучающая процессы, связанные с передачей,

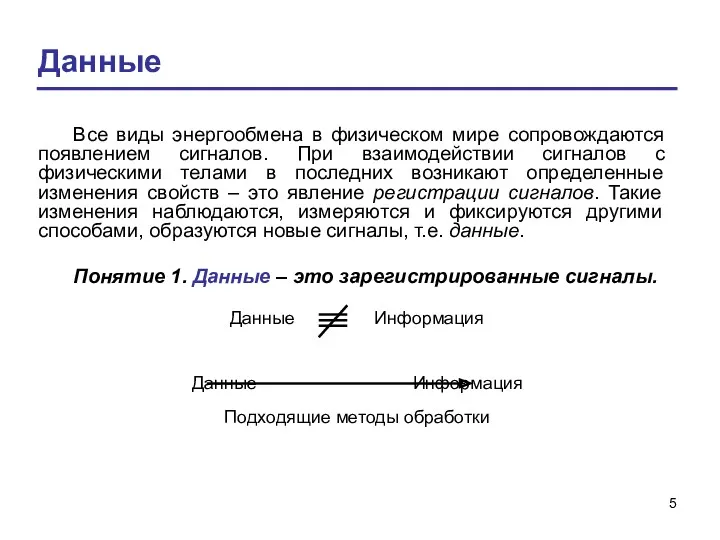

- 5. Данные Все виды энергообмена в физическом мире сопровождаются появлением сигналов. При взаимодействии сигналов с физическими телами

- 6. Понятие информации Источник – тот элемент окружающего мира (объект, процесс, явление, событие), сведения о котором являются

- 7. Понятие информации Понятие 2. Информация – это продукт взаимодействия данных и адекватных им методов. Важны следующие

- 8. Свойства информации Объективность и субъективность информации. Более объективной принято считать ту информацию, в которую методы вносят

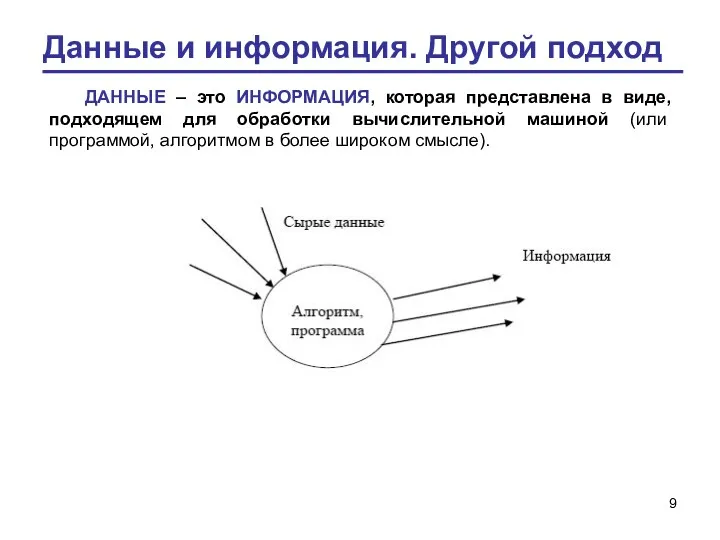

- 9. Данные и информация. Другой подход ДАННЫЕ – это ИНФОРМАЦИЯ, которая представлена в виде, подходящем для обработки

- 10. Данные и информация. Основные операции сбор данных; формализация данных (приведение к одной форме); фильтрация данных (отсеивание

- 11. Структуры данных Для выполнения вышеперечисленных операций необходимо использовать вычислительную технику. При этом данные должны быть структурированы.

- 12. Количество информации Возможно ли объективно измерить количество информации? На этот вопрос отвечает раздел информатики – теория

- 13. Способы измерения информации: объемный подход Названные способы измерения информации можно отнести к мерам синтаксического уровня. На

- 14. Немного о системах счисления Как с помощью цифр можно представить все многообразие чисел, букв, других символов?

- 15. Двоичное кодирование Проблема универсального средства кодирования достаточно успешно реализуется в отдельных отраслях техники, науки и культуры.

- 16. Единицы измерения информации Бит в теории информации — количество информации, необходимое для различения двух равновероятных сообщений.

- 17. Способы измерения информации: энтропийный подход Энтропийный подход принят в теории информации и кодировании. Имеем следующую модель.

- 18. Способы измерения информации: алгоритмический подход В алгоритмической теории предлагается алгоритмический метод оценки количества информации. Любому сообщению

- 19. Другие определения информации В технике под информацией понимают сообщения, передаваемые в форме знаков или сигналов. В

- 20. Информационные технологии Информационная технология — это совокупность методов и устройств, используемых людьми для обработки информации. Человечество

- 21. Немного истории VI - V век до н.э., Средиземноморье – первое счётное устройство – абак, или

- 22. Немного истории Соробан - японские счёты (абак). Происходят от китайского суаньпаня (первое упоминание 190 год, современный

- 23. Немного истории Джон Непер (1550-1617) – изобретатель логарифмов Костяшки Непера – усовершенствованные счетные палочки

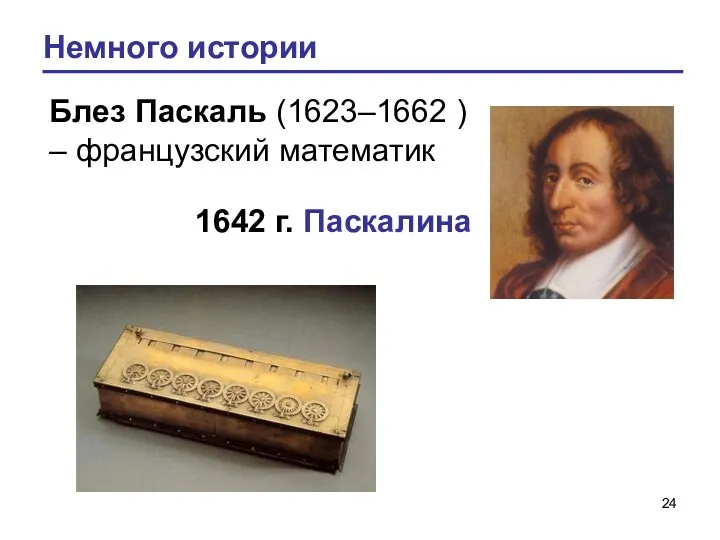

- 24. Немного истории Блез Паскаль (1623–1662 ) – французский математик 1642 г. Паскалина

- 25. Немного истории Готфрид Вильгельм Лейбниц (1646–1716) – немецкий математик, философ, физик 1673 г. ступенчатый вычислитель -

- 26. Немного истории Чарльз Бэббидж (1792–1871) – английский математик и экономист С 1823 г. постройка разностной машины

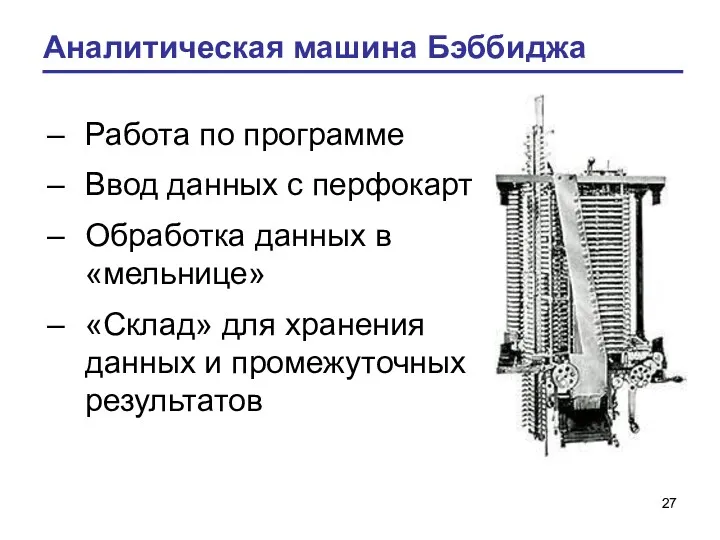

- 27. Аналитическая машина Бэббиджа Работа по программе Ввод данных с перфокарт Обработка данных в «мельнице» «Склад» для

- 28. Немного истории Джордж Буль (1815 – 1864)- английский математик 1847 – 1854 гг. разработал принципиально новый

- 29. Немного истории Герман Холлерит (1860 – 1929) - американский изобретатель В 1890 г. смог полностью воплотить

- 30. Немного истории Клод Элвуд Шеннон (1916 – 2001) – американский инженер и математик Связал двоичное кодирование

- 31. Немного истории Алан Тьюринг (1912 – 1954) – английский математик, логик, криптограф Разработал концепцию абстрактной вычислительной

- 32. Немного истории Джон (Янош Лайош) фон Нейман (1903 – 1957) – венгро-американский математик Первым выделил основные

- 33. Немного истории 5 июля 1943 года ученые Пенсильванского университета в США подписывают контракт, по которому они

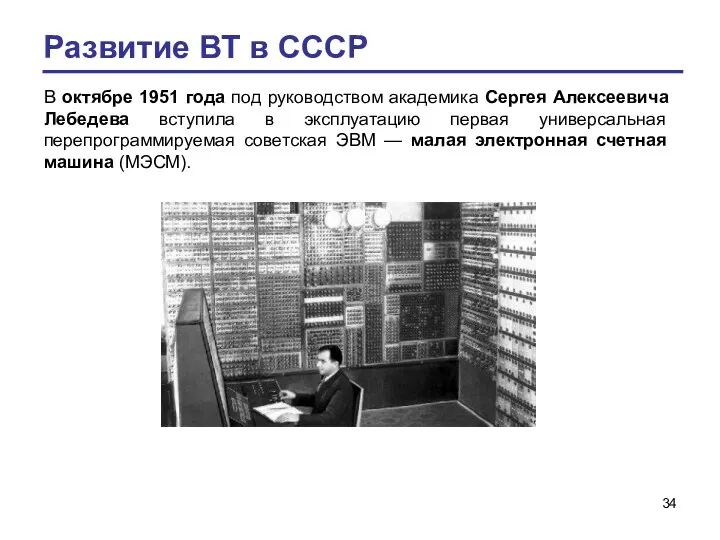

- 34. Развитие ВТ в СССР В октябре 1951 года под руководством академика Сергея Алексеевича Лебедева вступила в

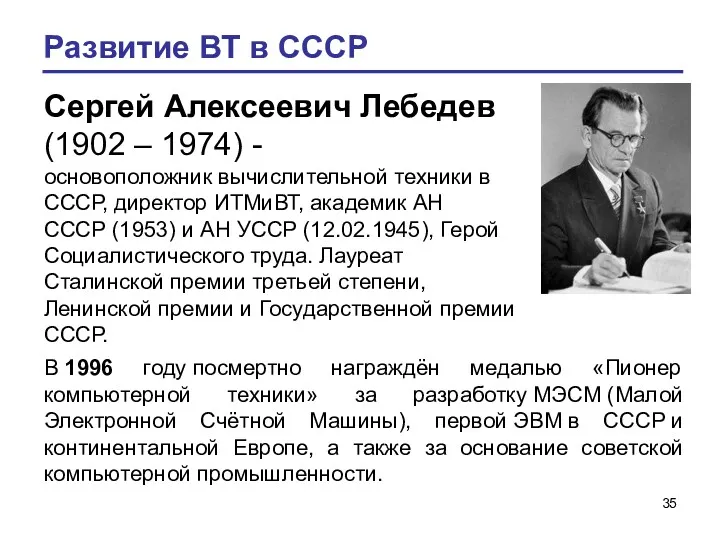

- 35. Развитие ВТ в СССР Сергей Алексеевич Лебедев (1902 – 1974) - основоположник вычислительной техники в СССР,

- 36. Развитие ВТ в СССР На несколько месяцев позже вступила в эксплуатацию ЭВМ М-1, разработанная в лаборатории

- 37. Развитие ВТ в СССР В 1957 году в серию запустили машину «Урал-1». Всего было выпущено 183

- 38. Развитие ВТ в СССР В июле 1961 года в СССР запустили в серию первую полупроводниковую универсальную

- 39. Развитие ВТ в СССР В январе 1959 г. Килби была создана первая интегральная схема. В 1962

- 40. Развитие ВТ в СССР Джек Килби (1923 – 2005) – американский физик, электротехник, лауреат Нобелевской премии

- 41. Развитие ВТ в СССР В ноябре 1962 года перед академиком Глушковым была поставлена задача по созданию

- 42. Развитие ВТ в СССР Виктор Михайлович Глушков (1923 – 1982) – советский математик, кибернетик, академик АН

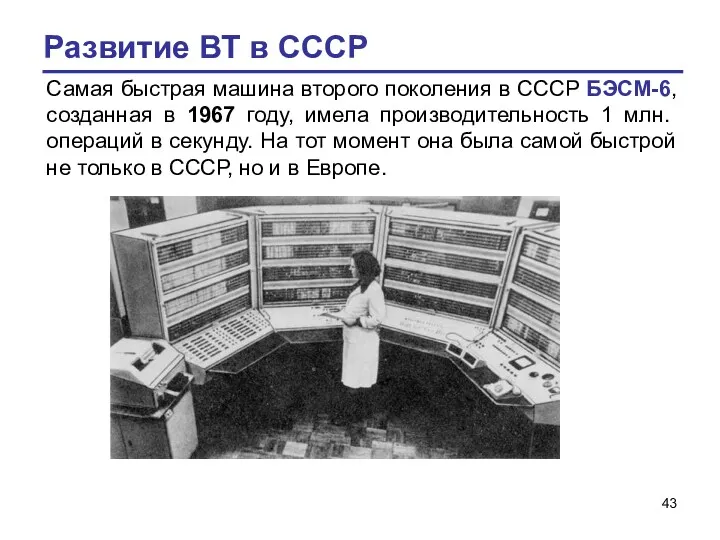

- 43. Развитие ВТ в СССР Самая быстрая машина второго поколения в СССР БЭСМ-6, созданная в 1967 году,

- 44. Развитие ВТ в СССР Всего в 60-годах в СССР было разработано около 30 типов ЭВМ. Возникла

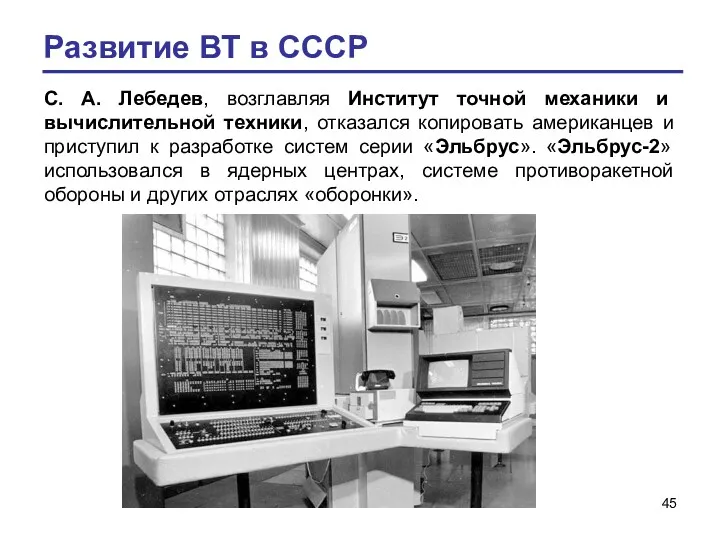

- 45. Развитие ВТ в СССР С. А. Лебедев, возглавляя Институт точной механики и вычислительной техники, отказался копировать

- 47. Скачать презентацию

Сервисы для создания презентаций

Сервисы для создания презентаций Организация защиты информации в локальной сети компании ООО MAN Truck and Bus Rus

Организация защиты информации в локальной сети компании ООО MAN Truck and Bus Rus Алгоритм и его свойства. Понятие алгоритма и исполнителя. Свойства алгоритма

Алгоритм и его свойства. Понятие алгоритма и исполнителя. Свойства алгоритма Модифицированный симплекс метод

Модифицированный симплекс метод Исполнители алгоритмов

Исполнители алгоритмов Python.Основы Циклы While. For. Лекция 3.2

Python.Основы Циклы While. For. Лекция 3.2 Що таке джинса

Що таке джинса Feed back

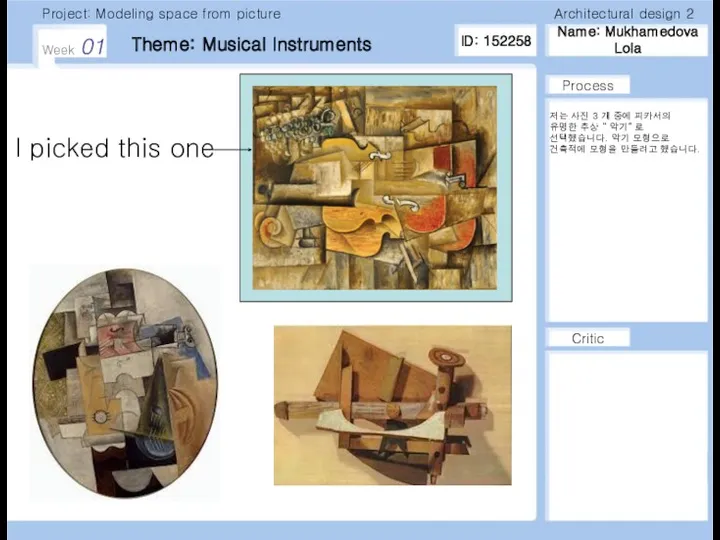

Feed back Modeling space from picture. Musical instruments

Modeling space from picture. Musical instruments Урок на тему Единицы измерения информации 6 класс

Урок на тему Единицы измерения информации 6 класс Зачем человек приходит в этот мир?

Зачем человек приходит в этот мир? Защита от несанкционированного доступа к информации

Защита от несанкционированного доступа к информации Цифровое фото и видео

Цифровое фото и видео Transition headline. Let’s start with the first set of slides

Transition headline. Let’s start with the first set of slides Графический интерфейс. Библиотека Tkinter

Графический интерфейс. Библиотека Tkinter Строковый и символьный тип данных

Строковый и символьный тип данных Виртуальные экскурсии: технологии создания

Виртуальные экскурсии: технологии создания Google. История создания

Google. История создания Криптография. История развития и базовые знания

Криптография. История развития и базовые знания Модель ISO/OSI

Модель ISO/OSI Научно-техническая и патентная информация Часть 2

Научно-техническая и патентная информация Часть 2 Ақпараттық коммуникациялықтехнологияны қолдану негізінде білім сапасын арттыру жолдары

Ақпараттық коммуникациялықтехнологияны қолдану негізінде білім сапасын арттыру жолдары Телеграмм-бот по игре Dota

Телеграмм-бот по игре Dota Подпрограммы в авс pascal

Подпрограммы в авс pascal Інформаційна система Ідентифікації шляхом розпізнавання обличчя

Інформаційна система Ідентифікації шляхом розпізнавання обличчя Методы разработки параллельных программ для многопроцессорных систем с общей памятью OpenMP. (Лекция 16)

Методы разработки параллельных программ для многопроцессорных систем с общей памятью OpenMP. (Лекция 16) Протоколы распределения ключей

Протоколы распределения ключей Сбор данных

Сбор данных