Методы разработки параллельных программ для многопроцессорных систем с общей памятью OpenMP. (Лекция 16) презентация

Содержание

- 2. Содержание Директивы OpenMP Синхронизация Директивы master, critical, barrier, atomic, flush, ordered, threadprivate Управление областью видимости данных

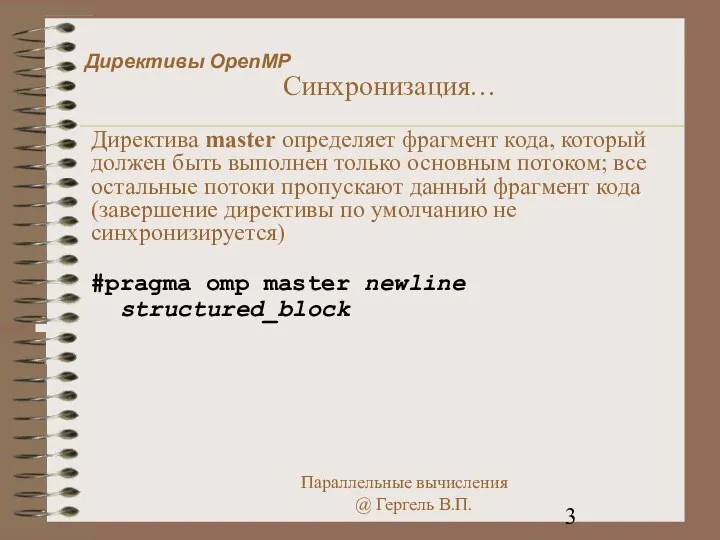

- 3. Директивы OpenMP Синхронизация… Директива master определяет фрагмент кода, который должен быть выполнен только основным потоком; все

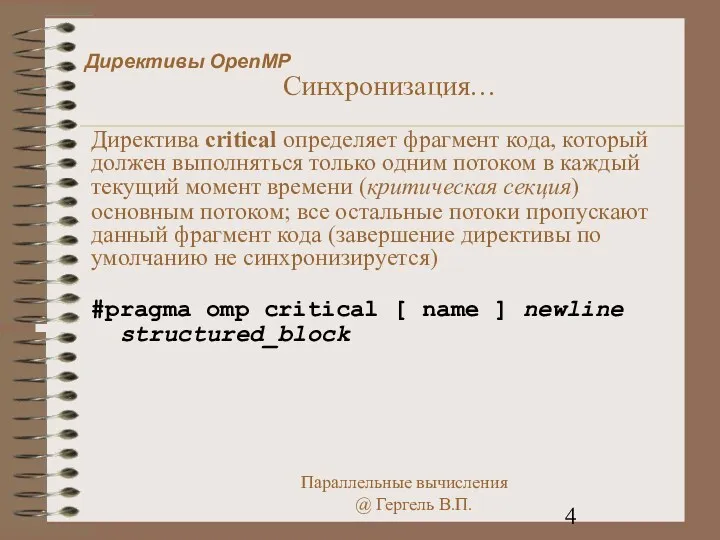

- 4. Директивы OpenMP Синхронизация… Директива critical определяет фрагмент кода, который должен выполняться только одним потоком в каждый

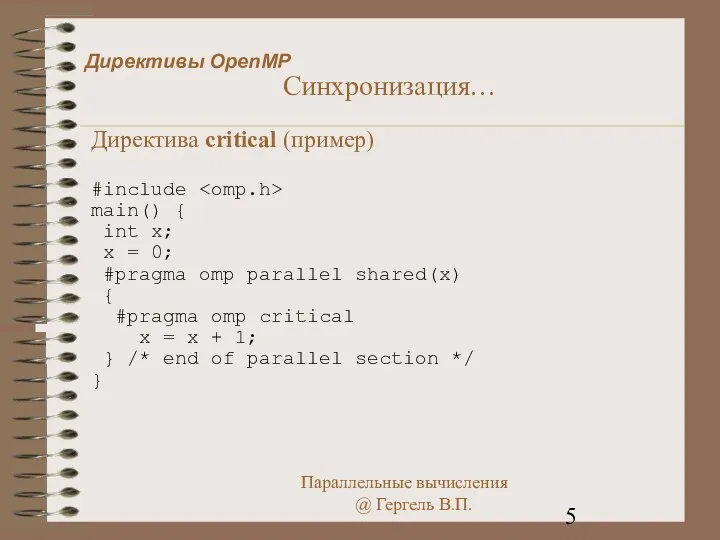

- 5. Директивы OpenMP Синхронизация… Директива critical (пример) #include main() { int x; x = 0; #pragma omp

- 6. Директивы OpenMP Синхронизация… Директива barrier – определяет точку синхронизации, которую должны достигнуть все процессы для продолжения

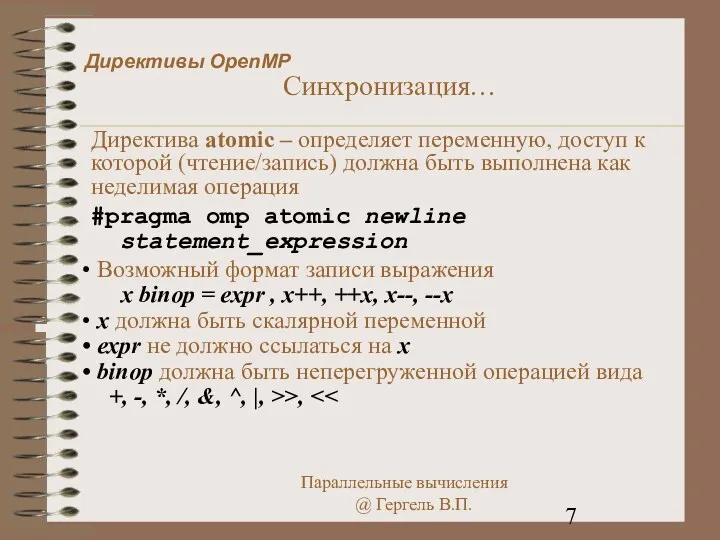

- 7. Директивы OpenMP Синхронизация… Директива atomic – определяет переменную, доступ к которой (чтение/запись) должна быть выполнена как

- 8. Директивы OpenMP Синхронизация… Директива flush – определяет точку синхронизации, в которой системой должно быть обеспечено единое

- 9. Директивы OpenMP Синхронизация… Директива ordered – указывает фрагмент кода параллельного цикла, который должен выполняться точно в

- 10. Директивы OpenMP Синхронизация Директива threadprivate – используется для создания поточных копий для глобальных переменных программы; созданные

- 11. Директивы OpenMP Управление областью видимости данных… Общие (разделяемые между потоками, shared) переменные – static, переменные с

- 12. Директивы OpenMP Управление областью видимости данных… Параметр shared определяет список переменных, которые будут общими для всех

- 13. Директивы OpenMP Управление областью видимости данных… Параметр firstprivate позволяет создать локальные переменные потоков, которые перед использованием

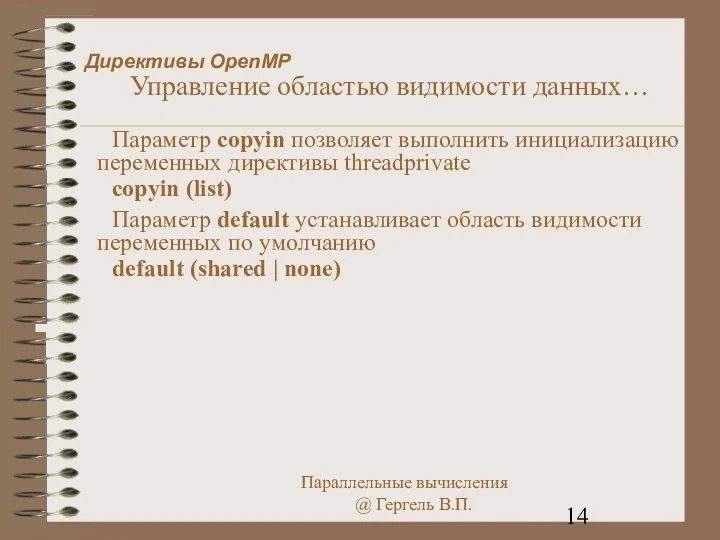

- 14. Директивы OpenMP Управление областью видимости данных… Параметр copyin позволяет выполнить инициализацию переменных директивы threadprivate copyin (list)

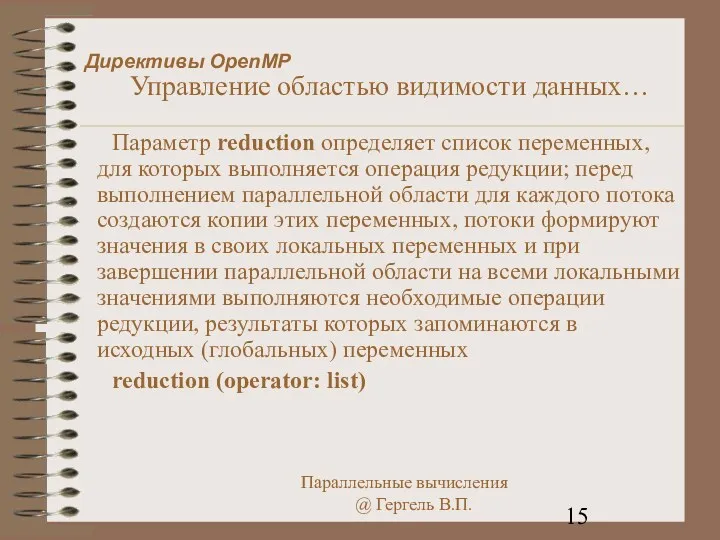

- 15. Директивы OpenMP Управление областью видимости данных… Параметр reduction определяет список переменных, для которых выполняется операция редукции;

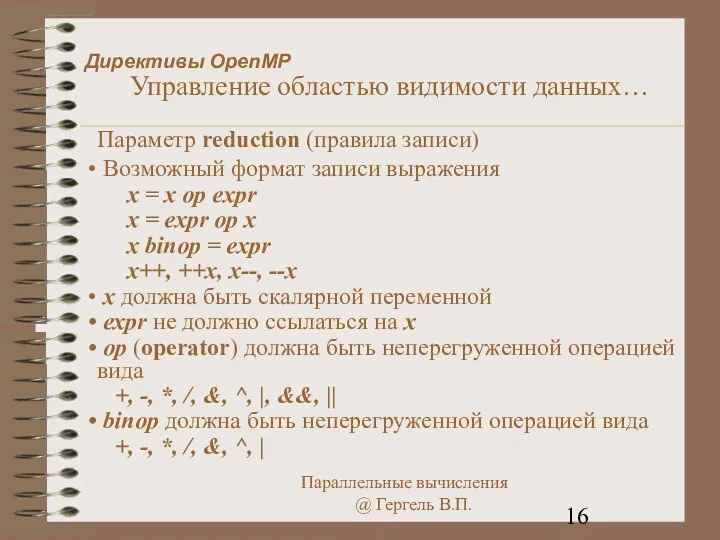

- 16. Директивы OpenMP Управление областью видимости данных… Параметр reduction (правила записи) Возможный формат записи выражения x =

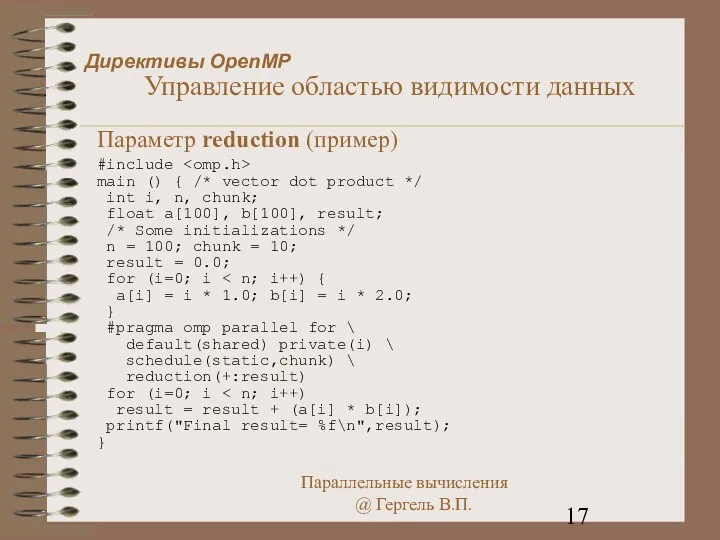

- 17. Директивы OpenMP Управление областью видимости данных Параметр reduction (пример) #include main () { /* vector dot

- 18. Директивы OpenMP Совместимость директив и их параметров

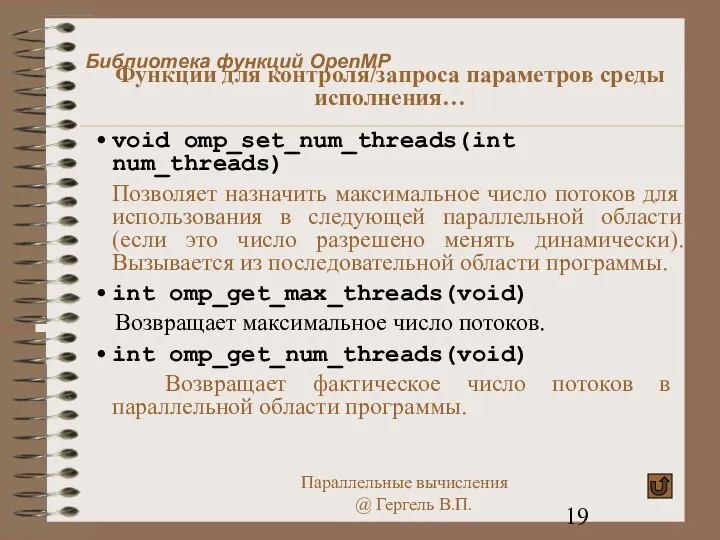

- 19. void omp_set_num_threads(int num_threads) Позволяет назначить максимальное число потоков для использования в следующей параллельной области (если это

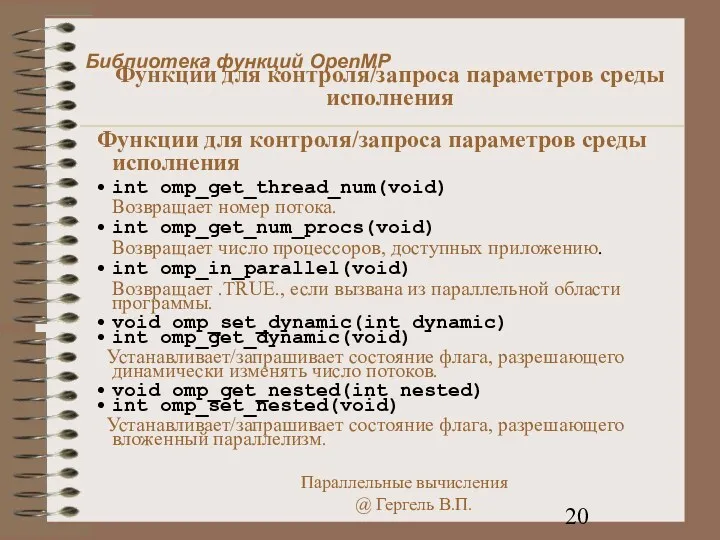

- 20. Функции для контроля/запроса параметров среды исполнения int omp_get_thread_num(void) Возвращает номер потока. int omp_get_num_procs(void) Возвращает число процессоров,

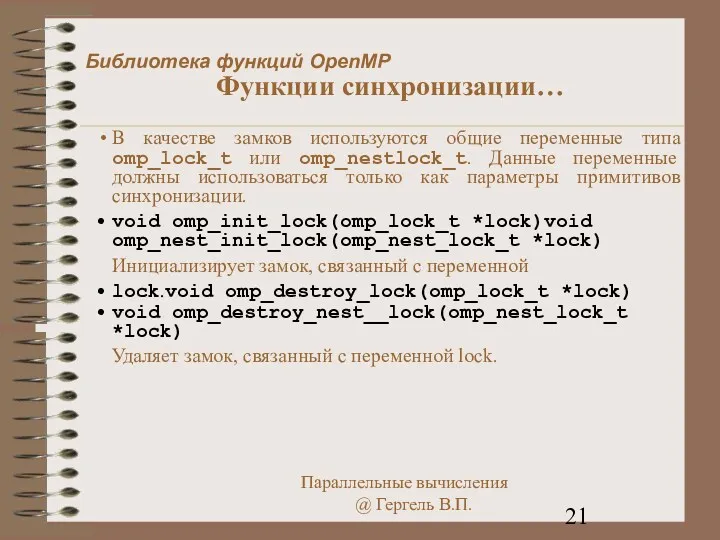

- 21. Функции синхронизации… В качестве замков используются общие переменные типа omp_lock_t или omp_nestlock_t. Данные переменные должны использоваться

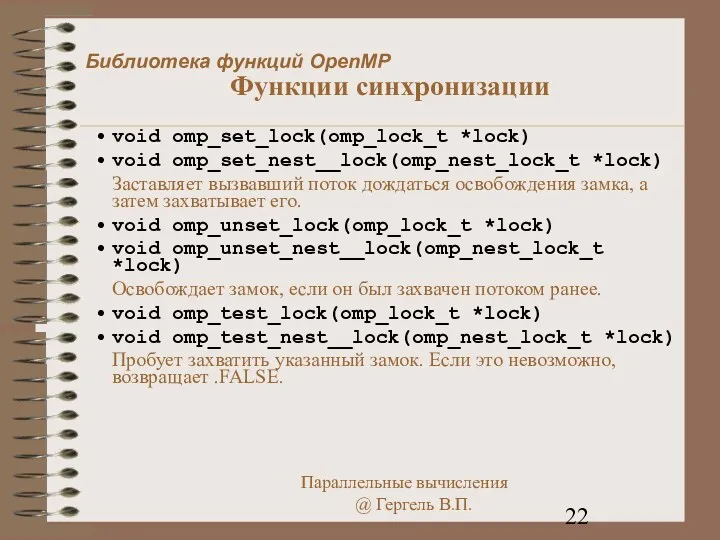

- 22. Функции синхронизации void omp_set_lock(omp_lock_t *lock) void omp_set_nest__lock(omp_nest_lock_t *lock) Заставляет вызвавший поток дождаться освобождения замка, а затем

- 23. Переменные среды OMP_SCHEDULE Определяет способ распределения итераций в цикле, если в директиве DO использована клауза SCHEDULE(RUNTIME).

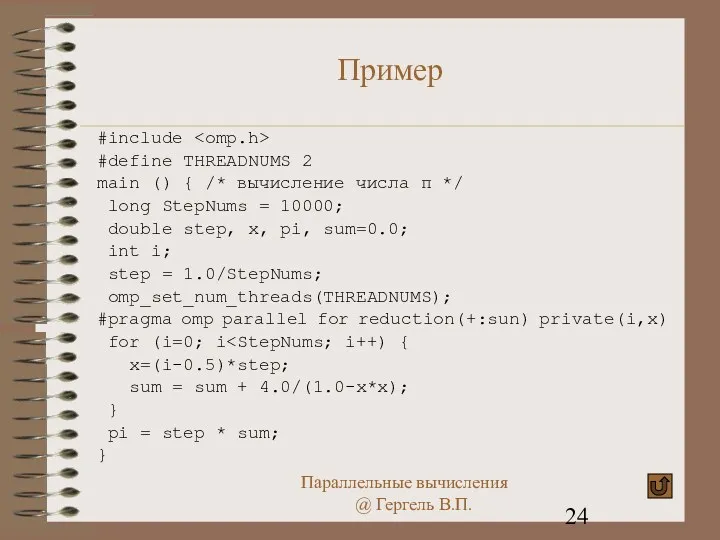

- 24. Пример #include #define THREADNUMS 2 main () { /* вычисление числа π */ long StepNums =

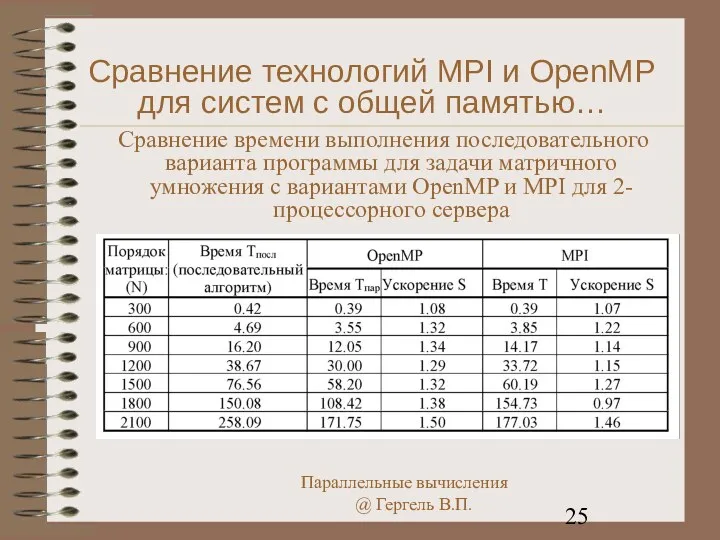

- 25. Сравнение технологий MPI и OpenMP для систем с общей памятью… Сравнение времени выполнения последовательного варианта программы

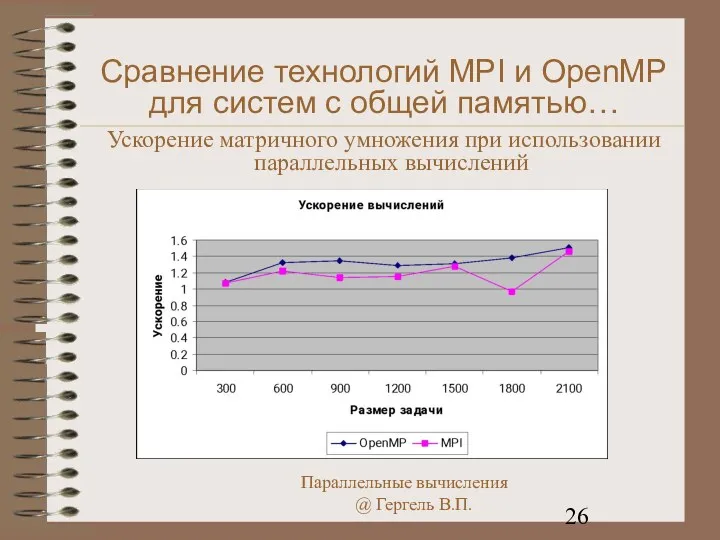

- 26. Сравнение технологий MPI и OpenMP для систем с общей памятью… Ускорение матричного умножения при использовании параллельных

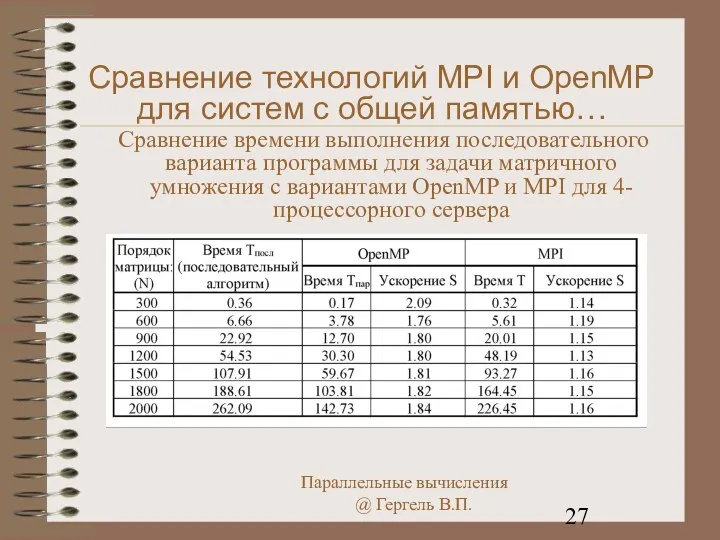

- 27. Сравнение технологий MPI и OpenMP для систем с общей памятью… Сравнение времени выполнения последовательного варианта программы

- 28. Сравнение технологий MPI и OpenMP для систем с общей памятью Ускорение матричного умножения при использовании параллельных

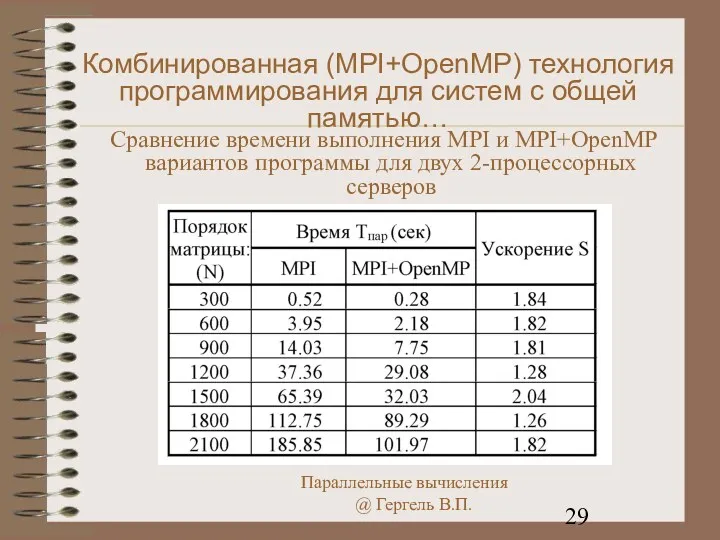

- 29. Комбинированная (MPI+OpenMP) технология программирования для систем с общей памятью… Сравнение времени выполнения MPI и MPI+OpenMP вариантов

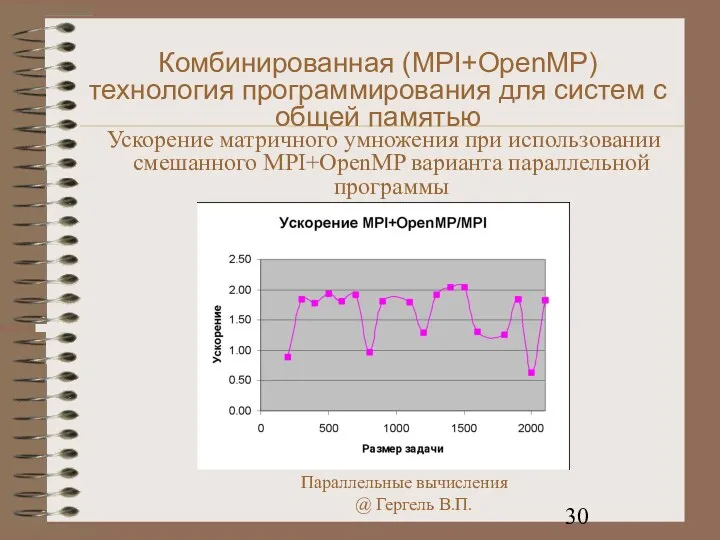

- 30. Комбинированная (MPI+OpenMP) технология программирования для систем с общей памятью Ускорение матричного умножения при использовании смешанного MPI+OpenMP

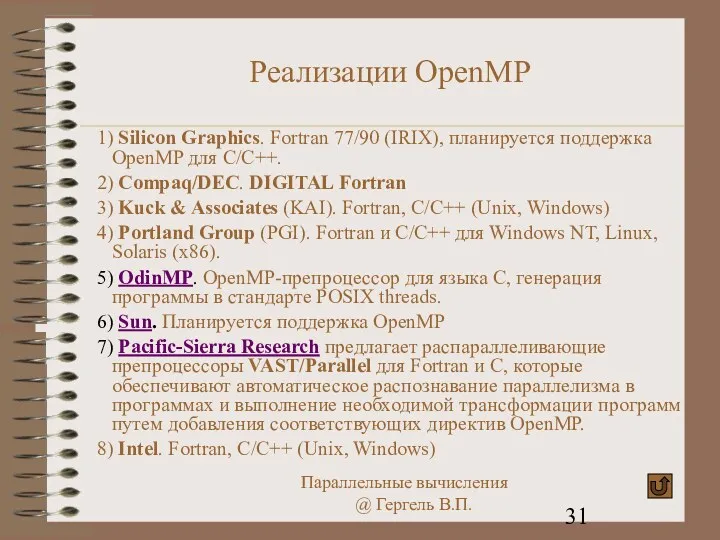

- 31. Реализации OpenMP 1) Silicon Graphics. Fortran 77/90 (IRIX), планируется поддержка OpenMP для C/C++. 2) Compaq/DEC. DIGITAL

- 32. Информационные ресурсы www.openmp.org Что такое OpenMP - http://parallel.ru/tech/tech_dev/openmp.html OpenMP C/C++ specification v1.0 http:// www.openmp.org Introduction to

- 33. Вопросы для обсуждения Методы синхронизации обработки данных в OpenMP Программирование с использованием библиотеки функций OpenMP

- 34. Задания для самостоятельной работы Разработка параллельных методов для задач линейной алгебры при использовании интерфейса OpenMP

- 36. Скачать презентацию

Что такое информация?

Что такое информация? Управление информационной безопасностью (вводная часть)

Управление информационной безопасностью (вводная часть) Теория автоматического управления в картинках

Теория автоматического управления в картинках Понятие ресурса ОС

Понятие ресурса ОС Представление информации. Уровни передачи информации

Представление информации. Уровни передачи информации Диалоги и диалоговые окна. Диалоговые окна Windows

Диалоги и диалоговые окна. Диалоговые окна Windows Растрові та векторні зображення, їхні властивості. 6 клас. Урок 2

Растрові та векторні зображення, їхні властивості. 6 клас. Урок 2 Использование 3D для обогащения опыта пользователя в ПО

Использование 3D для обогащения опыта пользователя в ПО Работа в Ассемблере ТАSМ

Работа в Ассемблере ТАSМ Абылайхан Мультимедия

Абылайхан Мультимедия Основы тестирования

Основы тестирования Есептеу жүйелері және желілік ұйымдастыру. Стандартты бағдарламалар кітапханасы және ассемблер

Есептеу жүйелері және желілік ұйымдастыру. Стандартты бағдарламалар кітапханасы және ассемблер Презентация-игра Продолжи ряд Диск

Презентация-игра Продолжи ряд Диск Сортировка массивов

Сортировка массивов Вреден ли ребенку компьютер?

Вреден ли ребенку компьютер? Архивация и разархивация файлов

Архивация и разархивация файлов Информационные технологии. Основные термины

Информационные технологии. Основные термины Міжнародні наукометричні бази даних та індекси цитування наукових праць

Міжнародні наукометричні бази даних та індекси цитування наукових праць ALLPPT.com _ Free PowerPoint Templates, Diagrams and Charts. Click to add title

ALLPPT.com _ Free PowerPoint Templates, Diagrams and Charts. Click to add title Масштабируемая веб-архитектура и распределенные системы

Масштабируемая веб-архитектура и распределенные системы Информационные технологии в профессиональной деятельности психолога

Информационные технологии в профессиональной деятельности психолога Современные системы автоматизации

Современные системы автоматизации Сетевые операционные системы

Сетевые операционные системы Система управления тестированием Test IT

Система управления тестированием Test IT Занимательная информатика. Конкурс

Занимательная информатика. Конкурс Автоматический перевод. Достижения и проблемы

Автоматический перевод. Достижения и проблемы Введение в Python. Как используется?

Введение в Python. Как используется? Автоматизация аптек

Автоматизация аптек