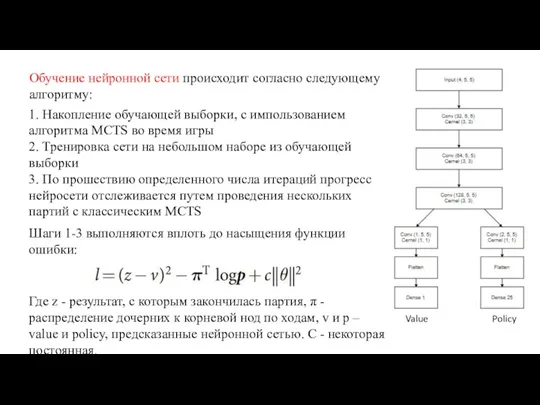

Value Policy

Обучение нейронной сети происходит согласно следующему алгоритму:

1. Накопление обучающей

выборки, с импользованием алгоритма MCTS во время игры

2. Тренировка сети на небольшом наборе из обучающей выборки

3. По прошествию определенного числа итераций прогресс нейросети отслеживается путем проведения нескольких партий с классическим MCTS

Шаги 1-3 выполняются вплоть до насыщения функции ошибки:

Где z - результат, с которым закончилась партия, π - распределение дочерних к корневой нод по ходам, v и p – value и policy, предсказанные нейронной сетью. С - некоторая постоянная.

Основы программирования. Основы языка программирования С/С++

Основы программирования. Основы языка программирования С/С++ Основные понятия информатики

Основные понятия информатики Коммуникациялық технологиялар

Коммуникациялық технологиялар Сервисно-ориентированные архитектуры. Анализ интересов клиента. Выбор вариантов решений

Сервисно-ориентированные архитектуры. Анализ интересов клиента. Выбор вариантов решений Роль и функции IT-инфраструктуры в деятельности организации. Стандарты и методики управления IT-инфраструктурой

Роль и функции IT-инфраструктуры в деятельности организации. Стандарты и методики управления IT-инфраструктурой Основы программирования. Введение

Основы программирования. Введение Количественные параметры информационных объектов. Задания

Количественные параметры информационных объектов. Задания Presentation template

Presentation template Растровая графика – рисование в Paint

Растровая графика – рисование в Paint B и Красно-Черные деревья

B и Красно-Черные деревья Технология WEB страниц

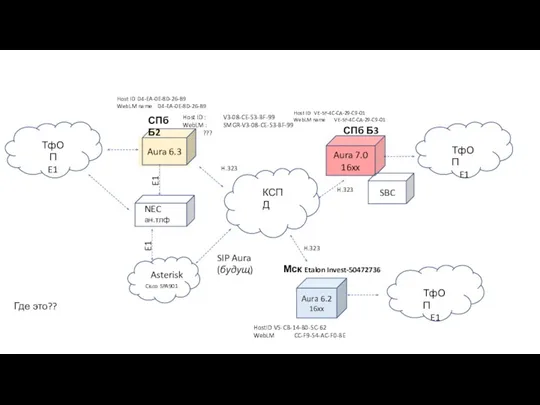

Технология WEB страниц Одна распределённая станция Avaya, все сервисы через SIP. Миграция сервисов NEC и Asterisk на Avaya Aura

Одна распределённая станция Avaya, все сервисы через SIP. Миграция сервисов NEC и Asterisk на Avaya Aura Операторы графики языка программирования QBasic.

Операторы графики языка программирования QBasic. Интеллектуальные информационные системы. Искусственный интеллект

Интеллектуальные информационные системы. Искусственный интеллект Продвижение в Instagram

Продвижение в Instagram Introduction to the course. Managing the application life cycle

Introduction to the course. Managing the application life cycle Открытый урок в 5 классе по теме Кодирование информации

Открытый урок в 5 классе по теме Кодирование информации Инструкция по обновлению BIOS Для win8

Инструкция по обновлению BIOS Для win8 Системы счисления (1, 10, 16)

Системы счисления (1, 10, 16) Разработка приложений в среде MS Office. Лекция 1

Разработка приложений в среде MS Office. Лекция 1 Классификация инженерно-технических средств безопасности

Классификация инженерно-технических средств безопасности Strings. Класс String в Java

Strings. Класс String в Java Ecommerce. Shopping on the Internet

Ecommerce. Shopping on the Internet Алгоритмы обработки массивов

Алгоритмы обработки массивов Использование голосового помощника Маруся в образовании

Использование голосового помощника Маруся в образовании Сетевые информационные системы

Сетевые информационные системы Искусственный интеллект

Искусственный интеллект Бездротові мережі

Бездротові мережі