Содержание

- 2. 1. Мультиколлинеарность Под мультиколлинеарностью понимают высокую взаимную коррелированность объясняющих переменных. Мультиколлинеарность может проявляться в функциональной и

- 3. В первом случае, по крайней мере, одна пара из объясняющих переменных связана линейной функциональной зависимостью и

- 4. В этом случае матрица будет вырожденной и обратной матрицы просто не существует. Оценку параметров модели невозможно

- 5. Чаще связь между объясняющими переменными выражается в стохастичес-кой форме, когда они тесно коррелируют друг с другом.

- 6. Матрица хотя и неособенная, но её определитель близок к нулю. Компоненты вектора оценок обратно пропорциональны величине

- 7. В итоге отметим основные негативные последствия мультиколлинеарности: большие дисперсии оценок параметров приводят к существенным отклонениям оценок

- 8. МНК- оценки коэффициентов модели и их стандартные ошибки становятся очень чувствительными к малейшему изменению исходных данных;

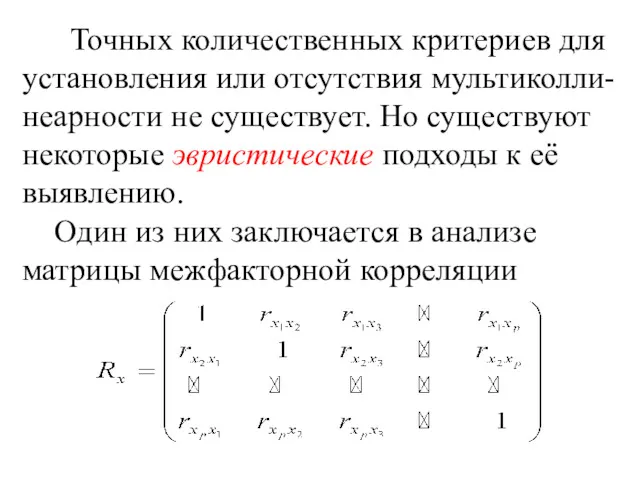

- 9. Точных количественных критериев для установления или отсутствия мультиколли-неарности не существует. Но существуют некоторые эвристические подходы к

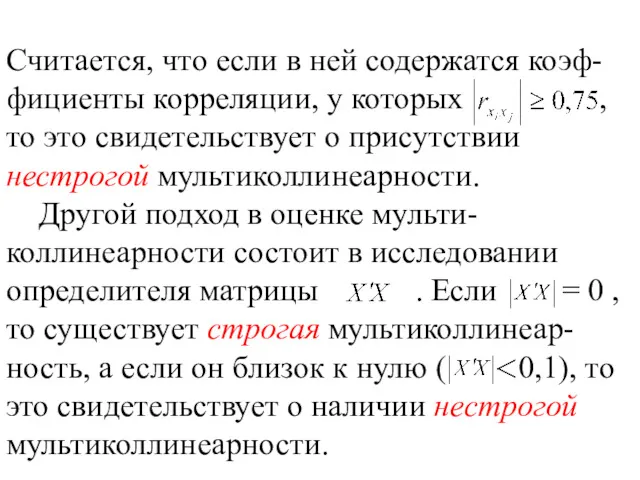

- 10. Считается, что если в ней содержатся коэф-фициенты корреляции, у которых , то это свидетельствует о присутствии

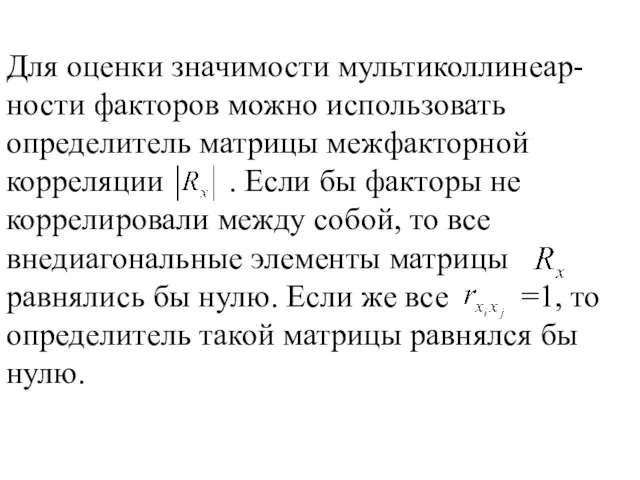

- 11. Для оценки значимости мультиколлинеар-ности факторов можно использовать определитель матрицы межфакторной корреляции . Если бы факторы не

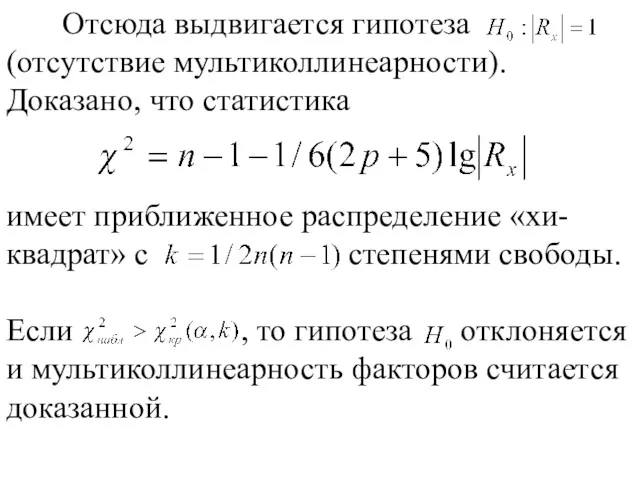

- 12. Отсюда выдвигается гипотеза (отсутствие мультиколлинеарности). Доказано, что статистика имеет приближенное распределение «хи-квадрат» с степенями свободы. Если

- 13. Если мультиколлинеарность установлена, то каким образом её можно устранить? Единого подхода к её устранению не существует,

- 14. Самый простой из них заключается в том, что из двух объясняющих переменных, имеющих высокий коэффициент корреляции

- 15. Другой метод заключается в увеличении объёма выборки, если это возможно: большее количество данных позволяет получить МНК-оценки

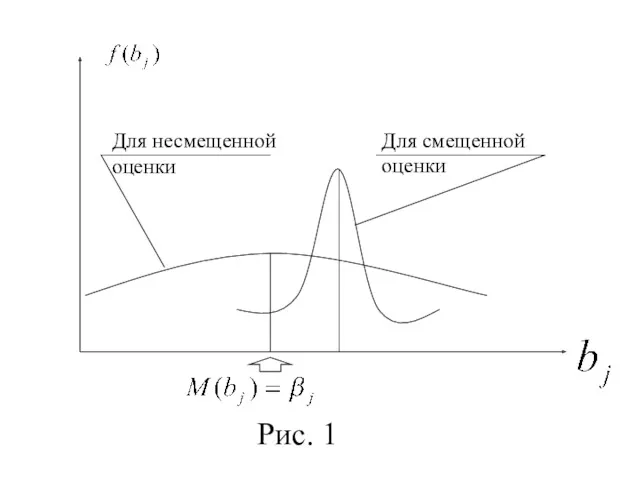

- 16. В следующем методе переходят от несмещенных МНК-оценок параметров к таким смещенным оценкам, которые обладают меньшим рассеиванием

- 17. Рис. 1

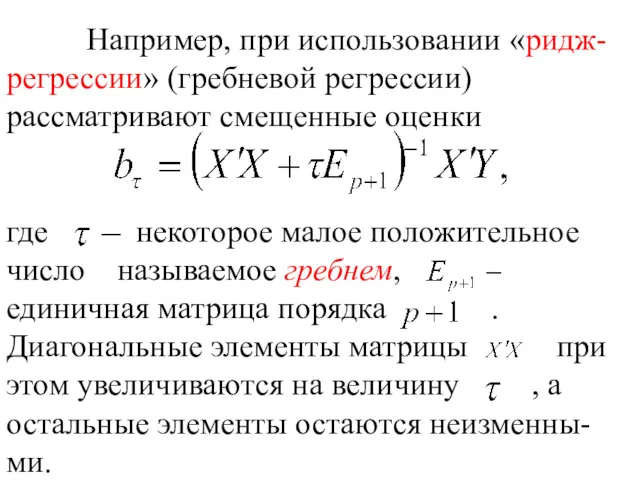

- 18. Например, при использовании «ридж- регрессии» (гребневой регрессии) рассматривают смещенные оценки где некоторое малое положительное число называемое

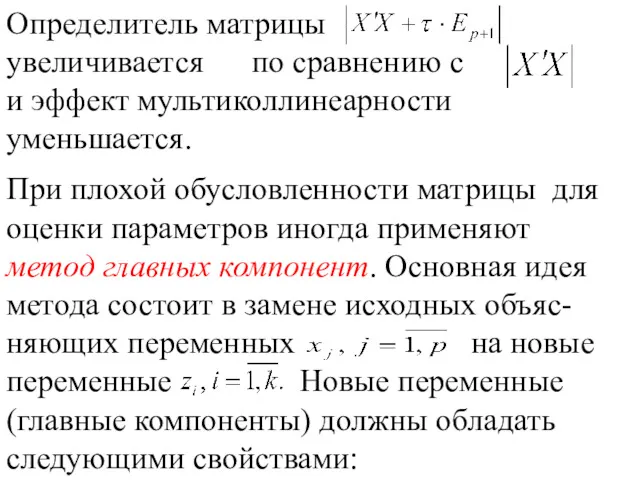

- 19. Определитель матрицы увеличивается по сравнению с и эффект мультиколлинеарности уменьшается. При плохой обусловленности матрицы для оценки

- 20. полная совокупность главных компонент должна содержать в себе всю изменчивость исходных переменных главные компоненты должны быть

- 21. 2. Гетероскедастичность Предпосылка 3° МНК о постоянстве дисперсий случайных составляющих для всех наблюдений на практике не

- 22. оценки коэффициентов модели, оставаясь несмещенными и состоятель-ными, уже не будут эффективными, и при небольших объёмах выборок

- 23. стандартные ошибки параметров , как правило, будут заниженными, а статистики – завышенными, что приводит к признанию

- 24. Для обнаружения гетероскедастичности наиболее простым является визуальный метод. Наличие гетероскедастичности для парной регрессии можно наглядно видеть

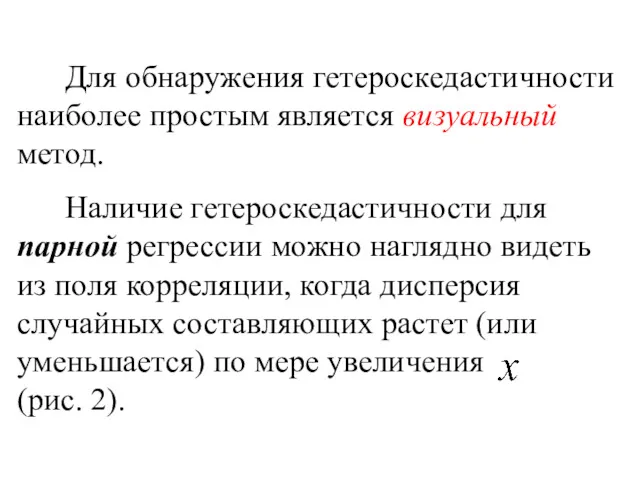

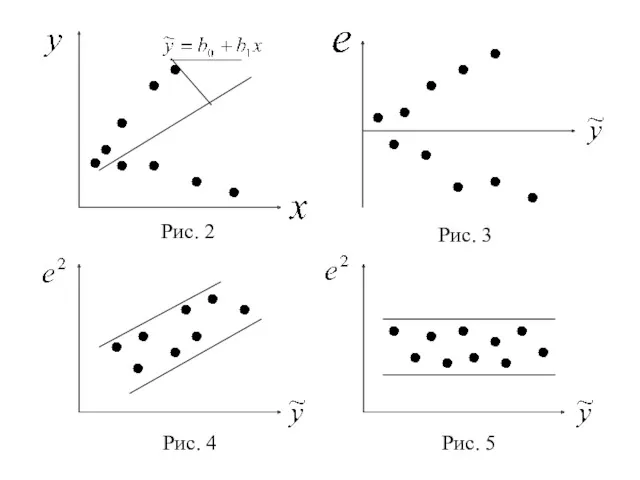

- 25. Рис. 4 Рис. 5

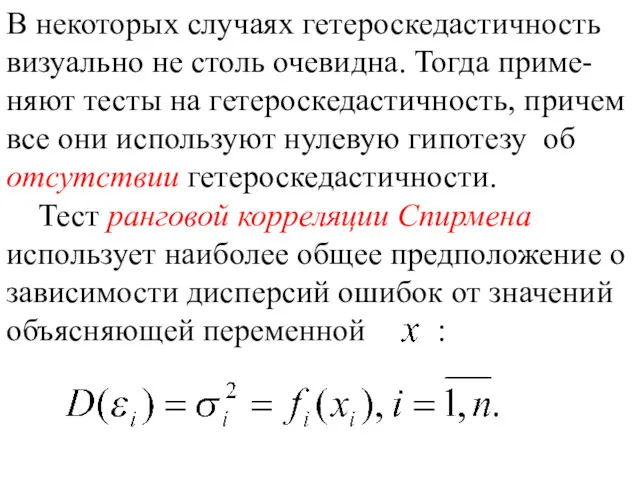

- 26. В некоторых случаях гетероскедастичность визуально не столь очевидна. Тогда приме-няют тесты на гетероскедастичность, причем все они

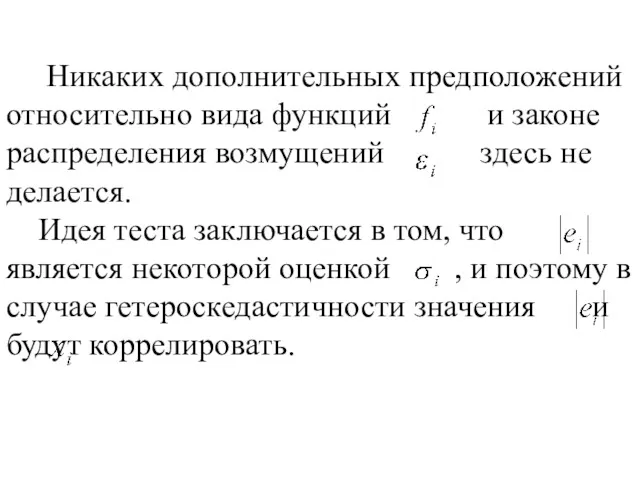

- 27. Никаких дополнительных предположений относительно вида функций и законе распределения возмущений здесь не делается. Идея теста заключается

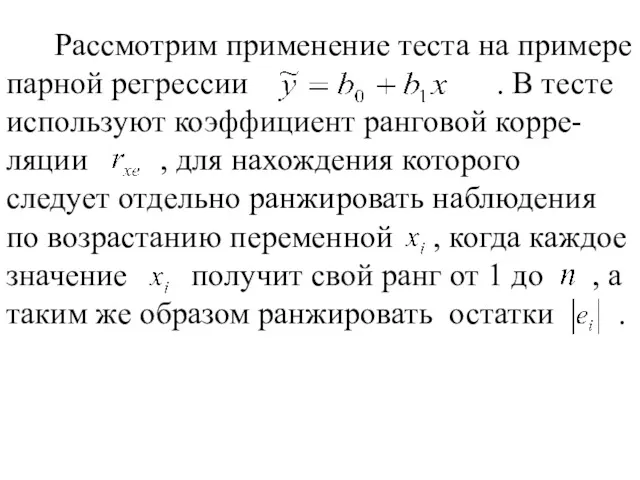

- 28. Рассмотрим применение теста на примере парной регрессии . В тесте используют коэффициент ранговой корре-ляции , для

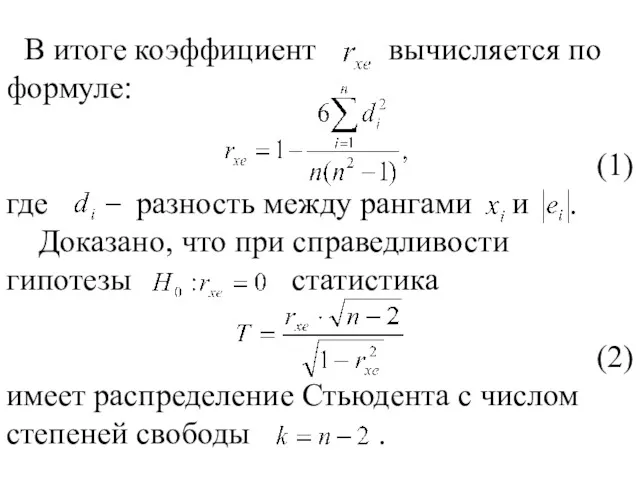

- 29. В итоге коэффициент вычисляется по формуле: (1) где разность между рангами и . Доказано, что при

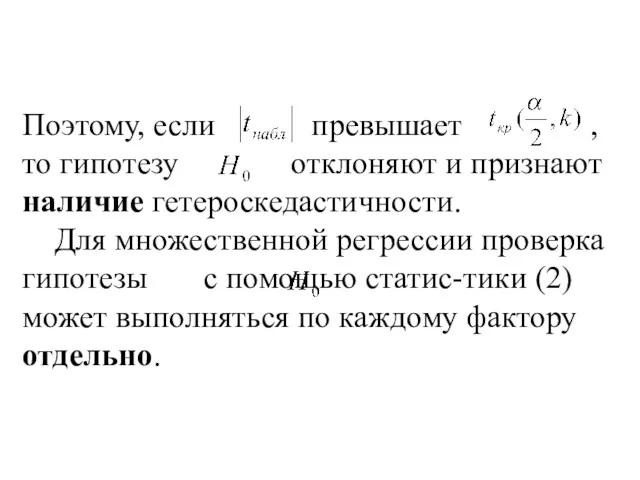

- 30. Поэтому, если превышает , то гипотезу отклоняют и признают наличие гетероскедастичности. Для множественной регрессии проверка гипотезы

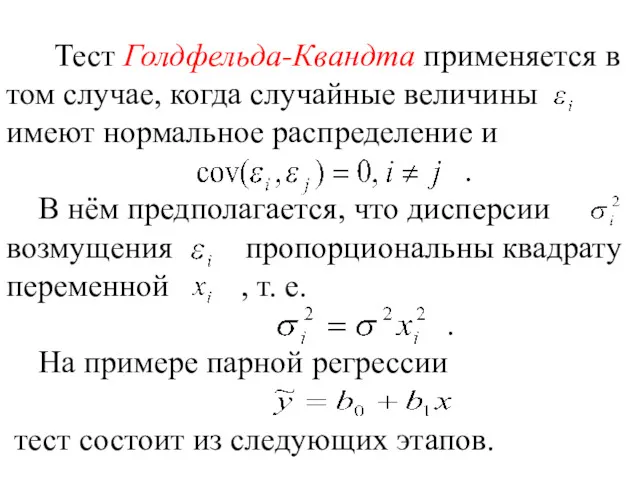

- 31. Тест Голдфельда-Квандта применяется в том случае, когда случайные величины имеют нормальное распределение и . В нём

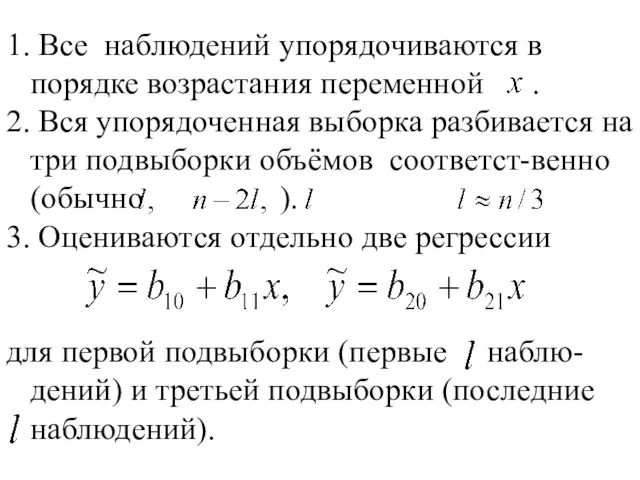

- 32. 1. Все наблюдений упорядочиваются в порядке возрастания переменной . 2. Вся упорядоченная выборка разбивается на три

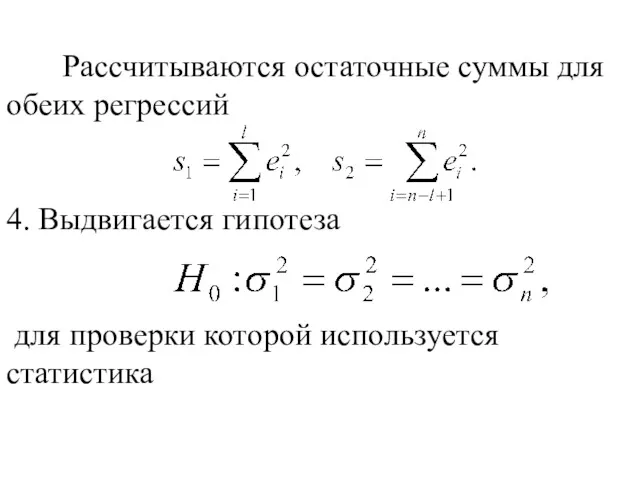

- 33. Рассчитываются остаточные суммы для обеих регрессий 4. Выдвигается гипотеза для проверки которой используется статистика

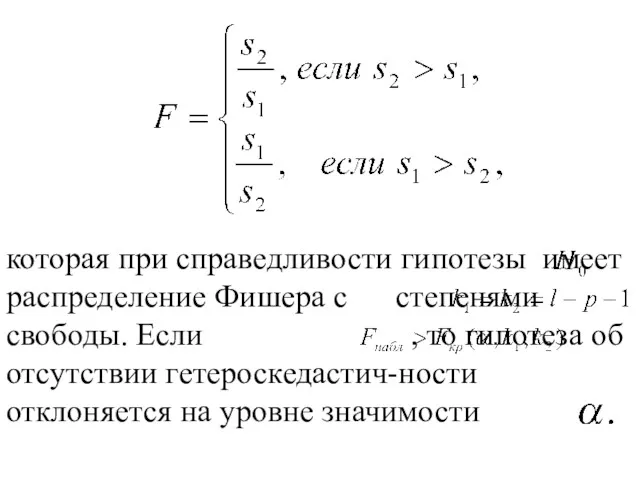

- 34. которая при справедливости гипотезы имеет распределение Фишера с степенями свободы. Если , то гипотеза об отсутствии

- 35. Если в модели более одного фактора, то выборка упорядочивается по тому фактору, который, как предполагается, теснее

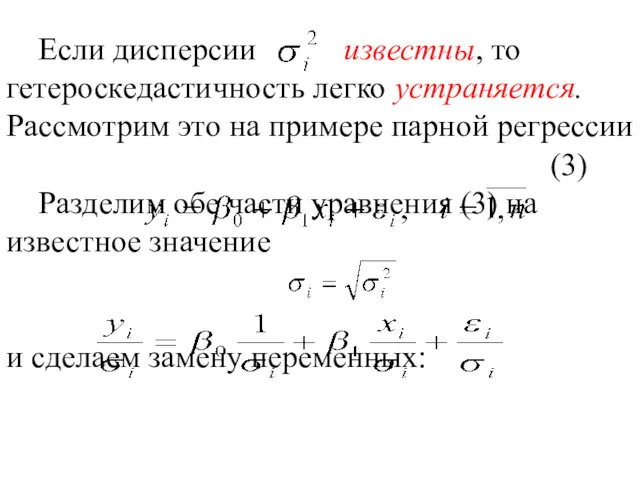

- 36. Если дисперсии известны, то гетероскедастичность легко устраняется. Рассмотрим это на примере парной регрессии (3) Разделим обе

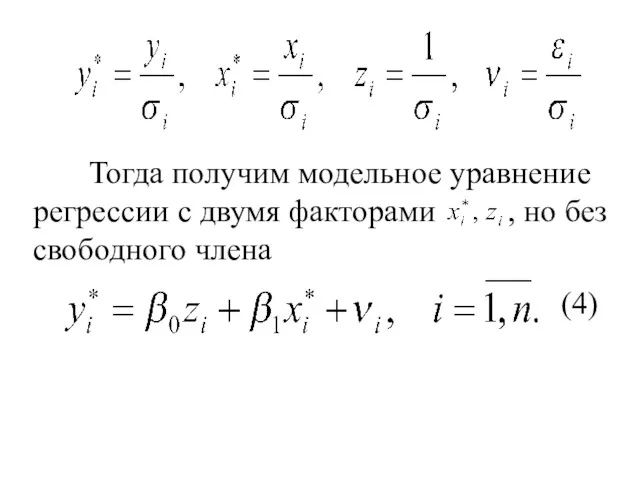

- 37. Тогда получим модельное уравнение регрессии с двумя факторами , но без свободного члена (4)

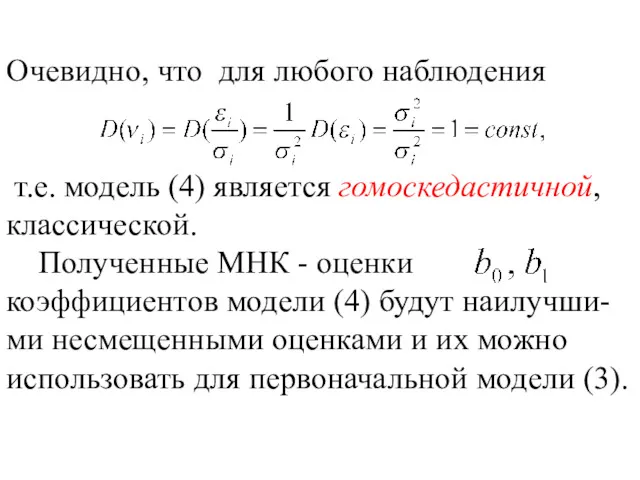

- 38. Очевидно, что для любого наблюдения т.е. модель (4) является гомоскедастичной, классической. Полученные МНК - оценки коэффициентов

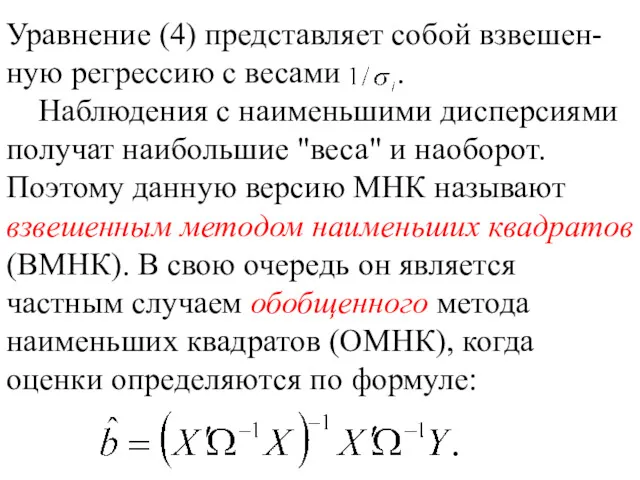

- 39. Уравнение (4) представляет собой взвешен-ную регрессию с весами . Наблюдения с наименьшими дисперсиями получат наибольшие "веса"

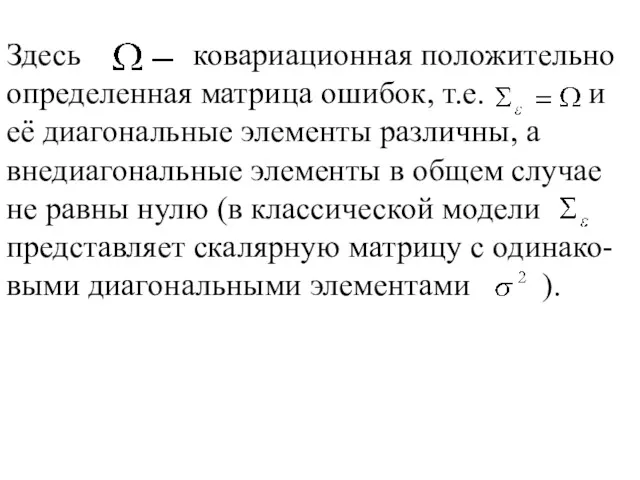

- 40. Здесь ковариационная положительно определенная матрица ошибок, т.е. и её диагональные элементы различны, а внедиагональные элементы в

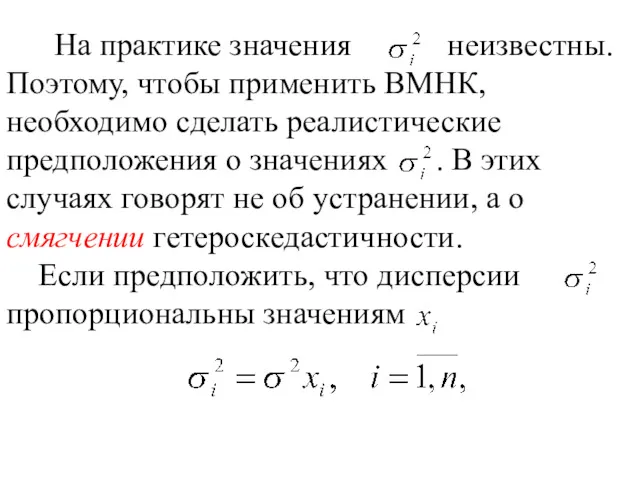

- 41. На практике значения неизвестны. Поэтому, чтобы применить ВМНК, необходимо сделать реалистические предположения о значениях . В

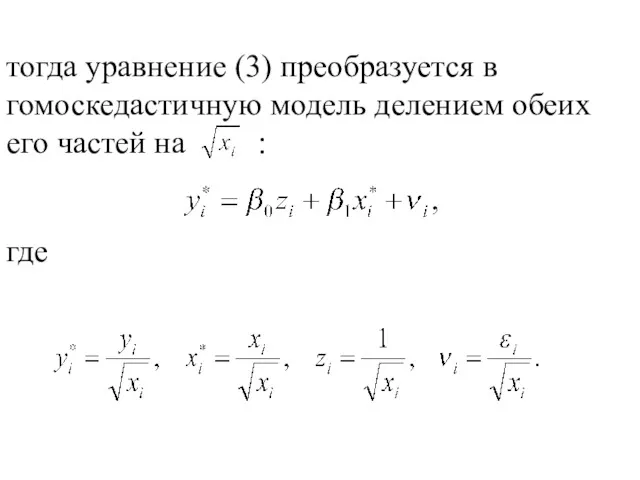

- 42. тогда уравнение (3) преобразуется в гомоскедастичную модель делением обеих его частей на : где

- 44. Скачать презентацию

Математика на железной дороге

Математика на железной дороге Асимптоты функции

Асимптоты функции Дидактическая игра по ФЭМП Помоги Буратино достать ключик (подготовительная группа).

Дидактическая игра по ФЭМП Помоги Буратино достать ключик (подготовительная группа). Презентация. Передача изображений

Презентация. Передача изображений Теория информационных процессов и систем. Лекция 1. Информационный процесс

Теория информационных процессов и систем. Лекция 1. Информационный процесс Противоположные числа

Противоположные числа Обучающая презентация Части суток

Обучающая презентация Части суток 2 продолжение презентации

2 продолжение презентации Приёмы умножения и деления на 10

Приёмы умножения и деления на 10 Из истории числительных. Мозговой штурм по русскому языку и математике

Из истории числительных. Мозговой штурм по русскому языку и математике Игры Воскобовича

Игры Воскобовича Неопределенный интеграл

Неопределенный интеграл Формирование представлений о времени детей старшего дошкольного возраста средствами дидактических игр и занимательных упражнений

Формирование представлений о времени детей старшего дошкольного возраста средствами дидактических игр и занимательных упражнений Понятие предела числовой последовательности. Предел функции в точке и на бесконечности. Теоремы о пределах функции

Понятие предела числовой последовательности. Предел функции в точке и на бесконечности. Теоремы о пределах функции Состав числа до 10

Состав числа до 10 Усеченная пирамида

Усеченная пирамида Відсотки. Математика. 6 клас

Відсотки. Математика. 6 клас Конспекты уроков по математике 1 класс ПНШ Диск

Конспекты уроков по математике 1 класс ПНШ Диск Презентация к уроку Прибавление чисел 7, 8. 9

Презентация к уроку Прибавление чисел 7, 8. 9 Осевая и центральная симметрия

Осевая и центральная симметрия Зеркальное отражение предметов

Зеркальное отражение предметов Прямоугольная система координат в пространстве

Прямоугольная система координат в пространстве Хронология. Счет времени

Хронология. Счет времени Площадь кругового сектора.площадь кругового сегмента. Геометрия. 9 класс

Площадь кругового сектора.площадь кругового сегмента. Геометрия. 9 класс Виды треугольников

Виды треугольников Симплекс-метод

Симплекс-метод Быстрый Поиск. Деревья поиска

Быстрый Поиск. Деревья поиска Тіла обертання. Циліндр

Тіла обертання. Циліндр