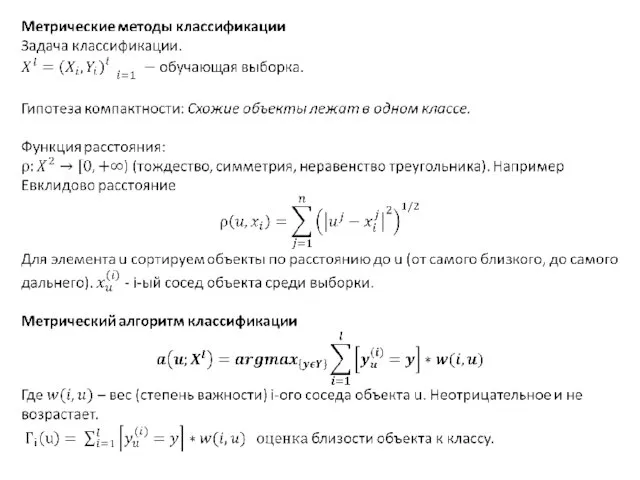

Слайд 2

Слайд 3

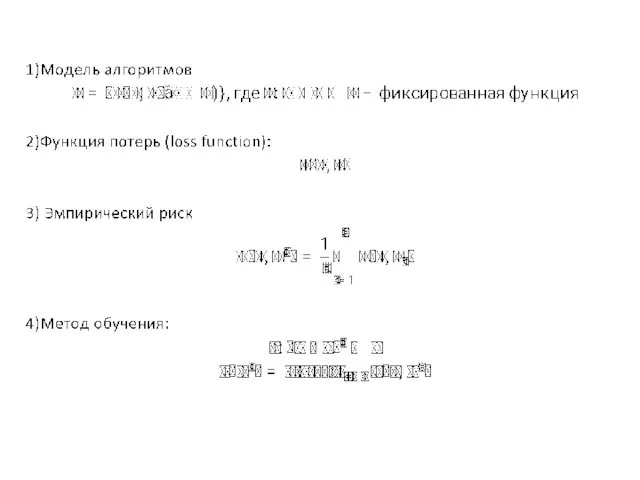

Слайд 4

Слайд 5

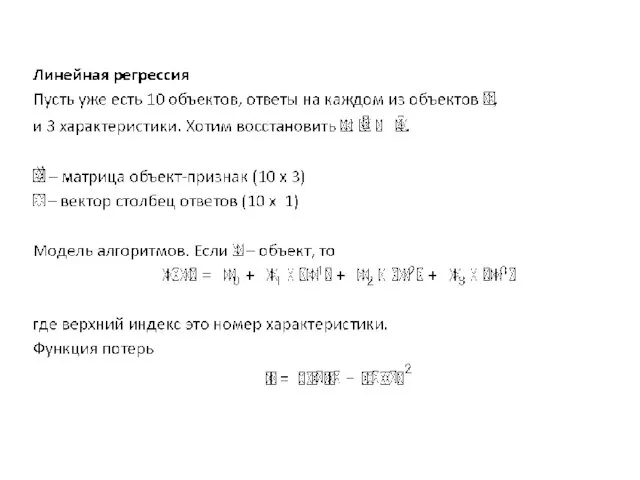

Слайд 6

Слайд 7

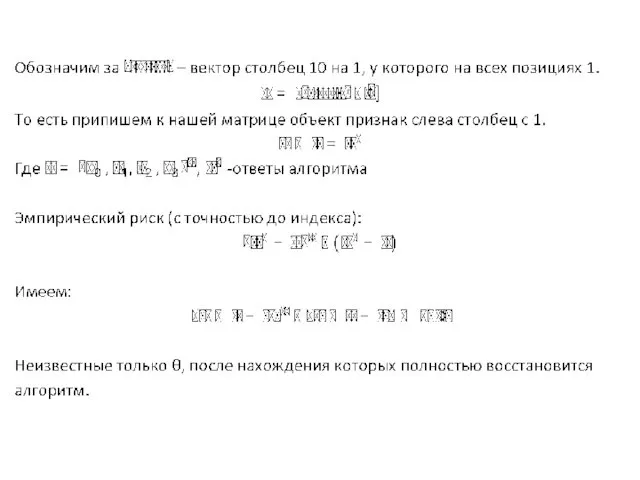

Слайд 8

Слайд 9

Слайд 10

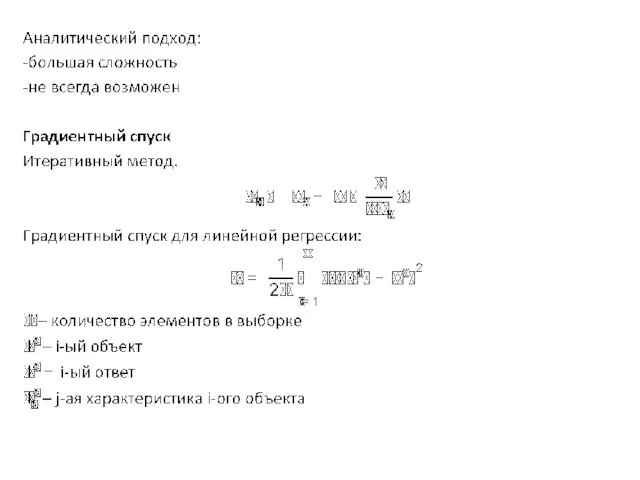

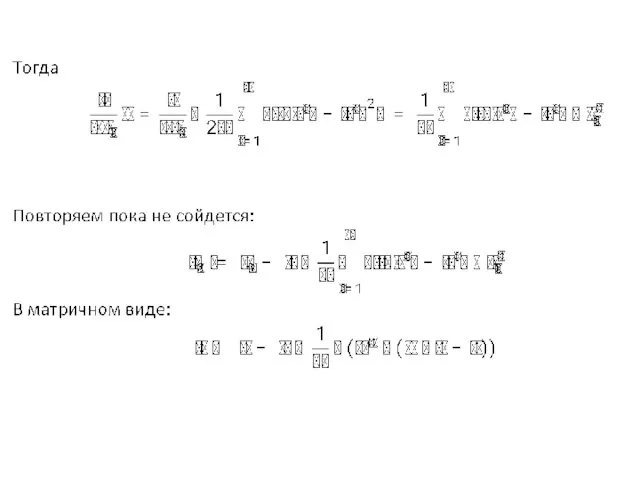

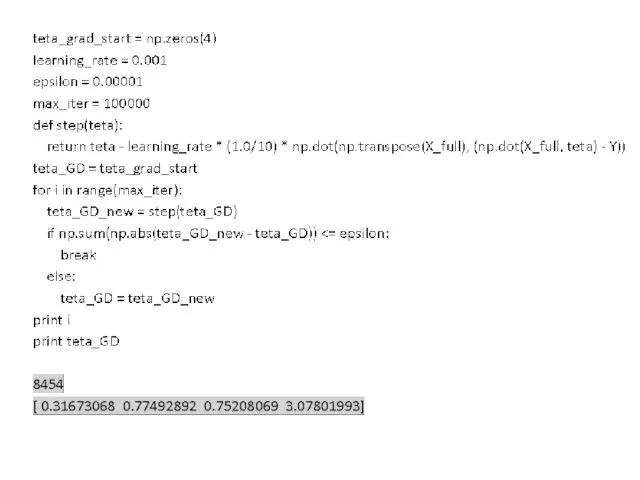

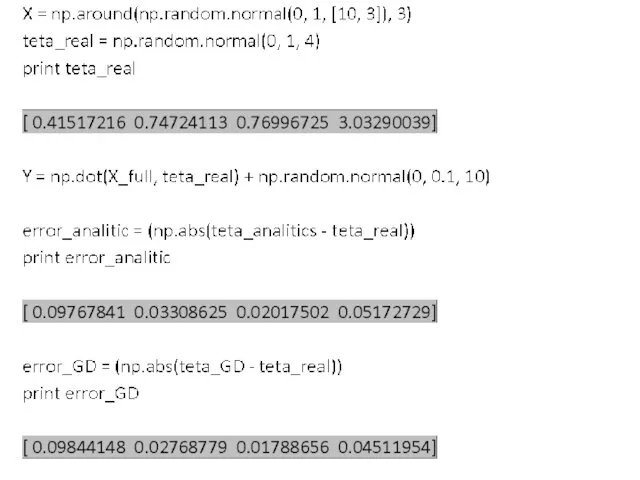

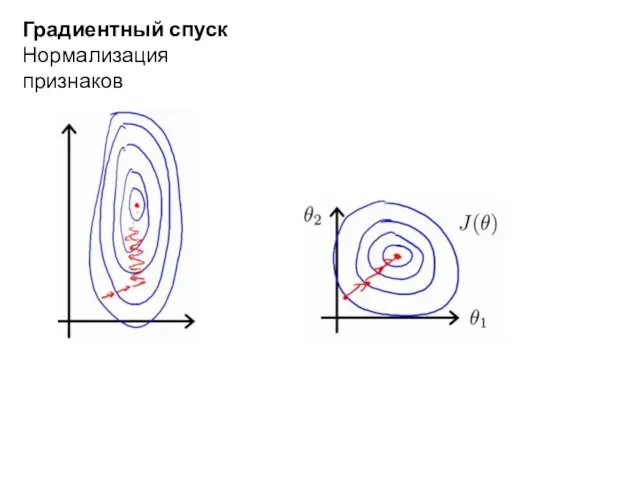

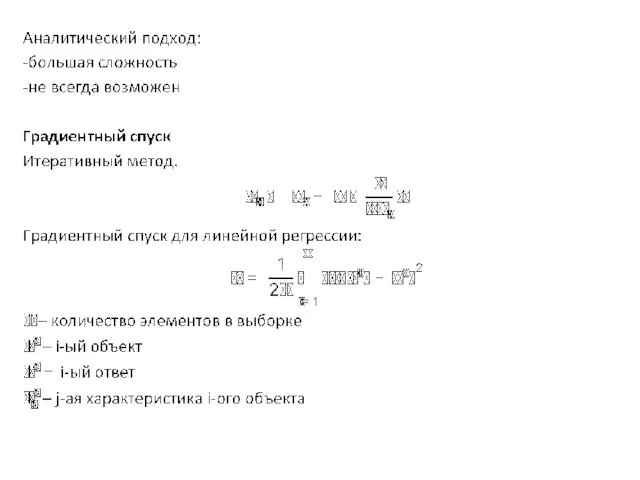

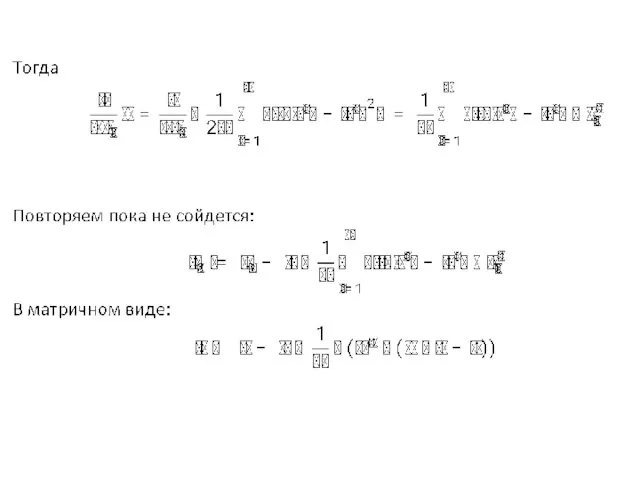

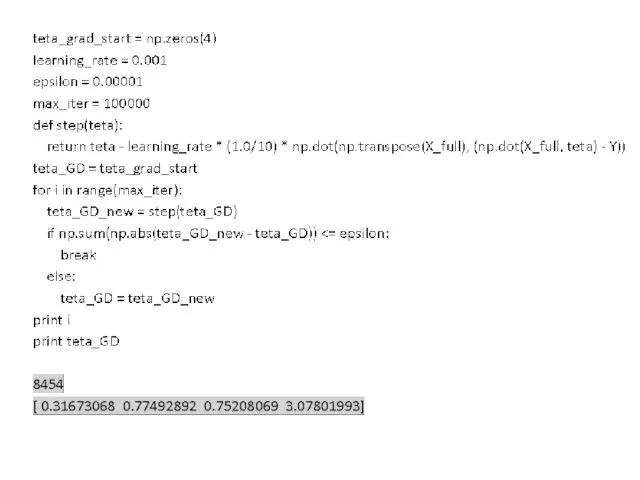

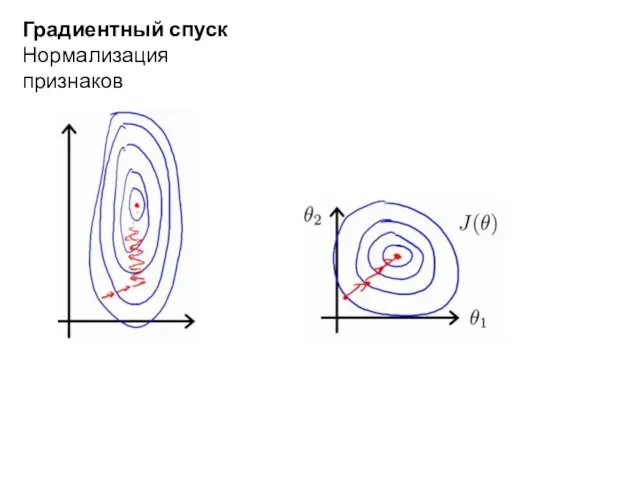

Градиентный спуск

Нормализация признаков

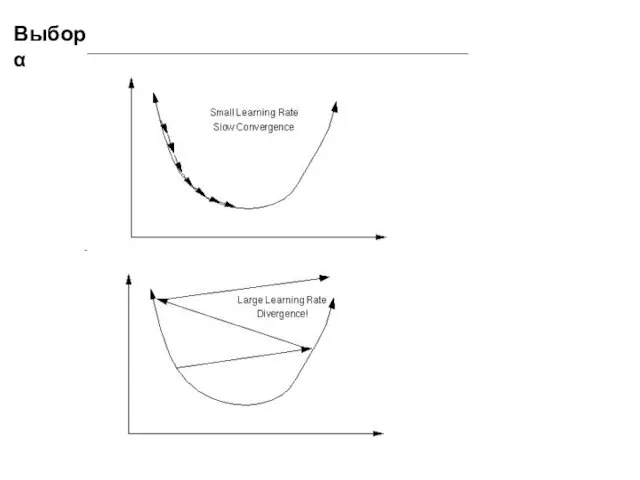

Слайд 11

Слайд 12

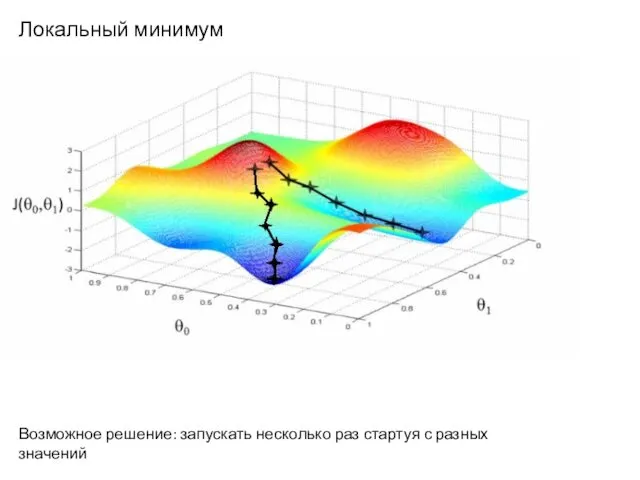

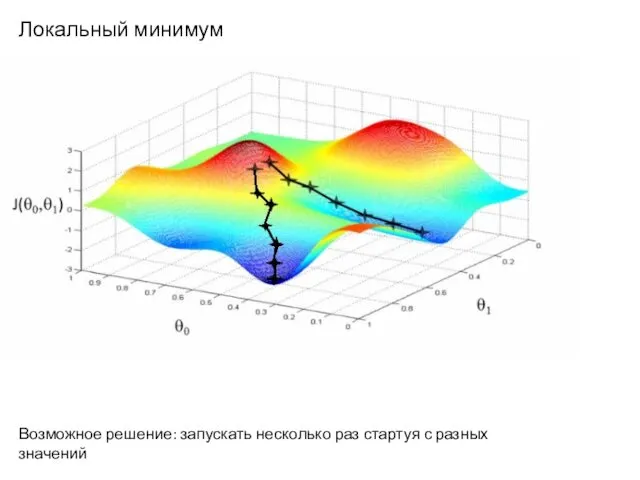

Локальный минимум

Возможное решение: запускать несколько раз стартуя с разных значений

Слайд 13

Итого градиентный спуск.

-подбор многих параметров

-learning rate

-максимальное число итераций

-условие сходимости

-стартовые параметры (сетка)

-легко

реализуем

-хорошо работает на больших выборках

-нет уверенности в том что выдал minimum функции

Подходит для большинства моделей.

Используется (с некоторыми усовершенствованиями) в том числе нейронных сетях.

Слайд 14

Статистическая радиофизика. Модели случайных процессов. (Тема 4)

Статистическая радиофизика. Модели случайных процессов. (Тема 4) Выпускники

Выпускники Библия, правда или ложь

Библия, правда или ложь Энергетические характеристики агрегатов и ГЭС

Энергетические характеристики агрегатов и ГЭС Задания командам. Треугольники. (7 класс)

Задания командам. Треугольники. (7 класс) Принципиальная пневматическая схема вагона ЛМ - 68М

Принципиальная пневматическая схема вагона ЛМ - 68М Анализ имиджа компании на примере турагенства САКВОЯЖ-ТУР

Анализ имиджа компании на примере турагенства САКВОЯЖ-ТУР Гербарий сказочных растений

Гербарий сказочных растений 20200102_splav_po_reke_kurba3

20200102_splav_po_reke_kurba3 Система менеджмента качества в аптечных организациях

Система менеджмента качества в аптечных организациях “Екі жұлдыз, бір тілек” стратегиясы

“Екі жұлдыз, бір тілек” стратегиясы Prezentatsia_Pashnin

Prezentatsia_Pashnin Розничная торговая сеть. Технологические операции в магазине

Розничная торговая сеть. Технологические операции в магазине ШАБЛОН ДЛЯ ПРЕЗ

ШАБЛОН ДЛЯ ПРЕЗ Решение задач по химическим уравнениям

Решение задач по химическим уравнениям Обдирочно-зачистное отделение цеха. Проект электроснабжения

Обдирочно-зачистное отделение цеха. Проект электроснабжения Рококо

Рококо Расчетные модели конструкций, зданий и сооружений

Расчетные модели конструкций, зданий и сооружений Упражнение для глаз. Состроили глазки

Упражнение для глаз. Состроили глазки Цифровая грамотность студентов МОСГУ

Цифровая грамотность студентов МОСГУ Кратковременные механические свойства титановых сплавов. Лекция 3

Кратковременные механические свойства титановых сплавов. Лекция 3 Ремонт силових трансформаторів

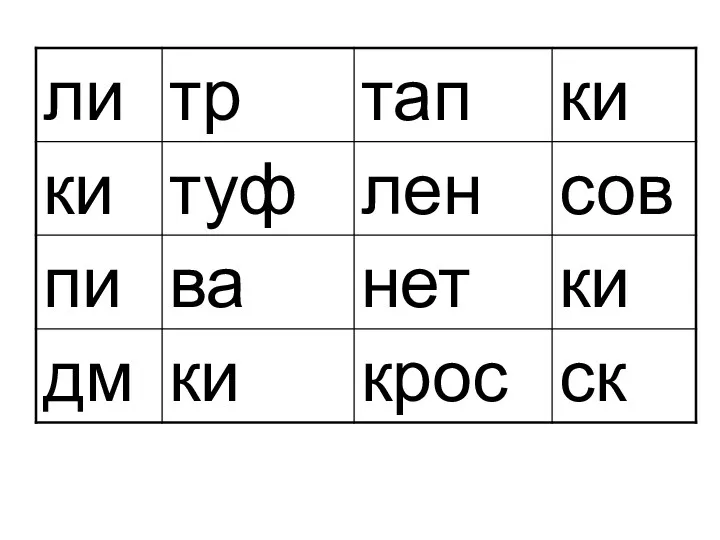

Ремонт силових трансформаторів презентация к уроку Деление слог на слоги

презентация к уроку Деление слог на слоги Конспект образовательной деятельности по экологии в средней группе с использованием ИКТ на тему: Берегите лес

Конспект образовательной деятельности по экологии в средней группе с использованием ИКТ на тему: Берегите лес Мастер-класс по созданию подсвечника из кофейных зерен

Мастер-класс по созданию подсвечника из кофейных зерен Органы чувств

Органы чувств Общие положения реконструкции городского жилого фонда

Общие положения реконструкции городского жилого фонда Правила пожарной безопасности в плакатах.

Правила пожарной безопасности в плакатах.