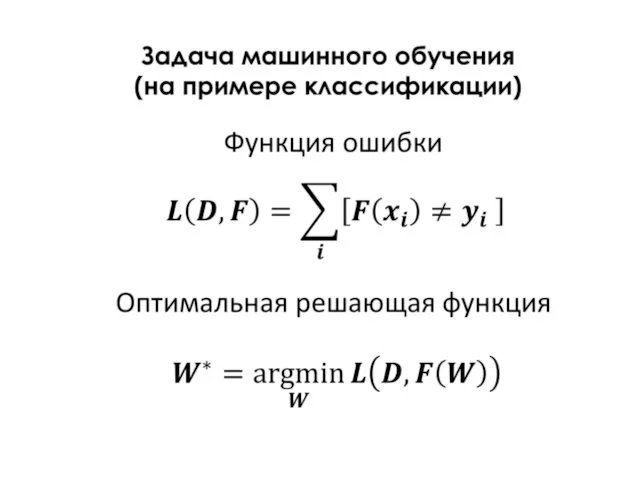

Слайд 2

Слайд 3

Слайд 4

Слайд 5

Слайд 6

Нейронные сети

Модель ЦНС

Линейная функция с нелинейным «принятием решения»

Удобное метод «подбора» коэффициентов

линейной функции

Удобный инструмент обучения

Слайд 7

НС. Применение

Гибкая модель для аппроксимации многомерных функций.

Средство прогнозирования во времени процессов,

зависящих от большого количества переменных.

Средство распознавания образов

Инструмент для поиска по ассоциациям

Модель для поиска закономерностей в массивах данных

Слайд 8

НС. Базисы

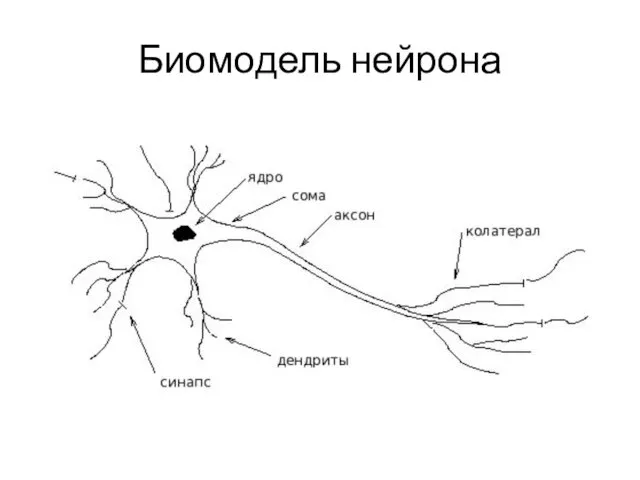

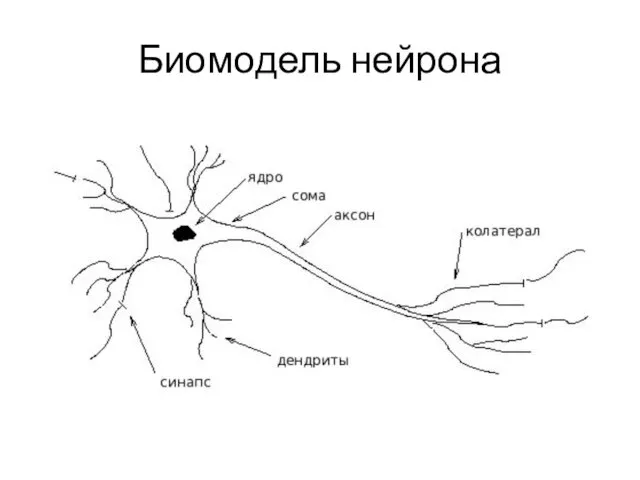

1) ЦНС высших млекопитающих состоит из клеток — нейрон связанных

друг с другом из всевозможными клетками рецепторами (зрительные, слуховые, тд). Общее количество таких клеток порядка 10^10.

Связь между нейронами осуществляется с помощью контактов — сИнапсы.

Сила связи между двумя нейронами пропорциональна концентрации вещества — нейромедиатор.

Деятельность головного мозга высших млекопитающих представляет собой пребывание в возбуждённом состоянии.

Нейрон становиться активным, тогда. когда количество активных нейронов связанных синапсами превышает определенный порог.

Слайд 9

НС. Базисы

2) Концепция обучения.

В процессе обучения с помощью резких внешних стимулов

существенно корректируется картина мира записанная в голове.

Таким образом для осуществления обучения мы должны иметь набор векторов характеризующих картину мира и все возможные реакции на нашу действительность.

Такой набор векторов получил название — обучающая выборка.

Чем более адекватная картина мира записанная в нейронах головного мозга, тем меньше истинная реакция окружающей среды будет отличаться от реакции предсказания.

С нейрофизиологической точки зрение обучение может происходить двояко, это отмирание связей и изменение силы связи.

Слайд 10

Слайд 11

Слайд 12

Слайд 13

Слайд 14

Слайд 15

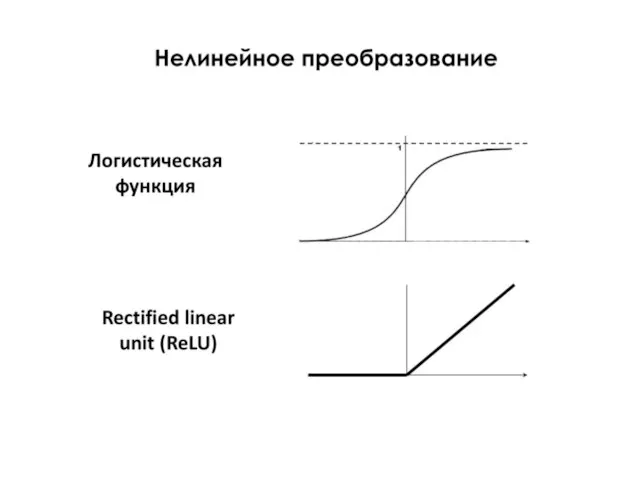

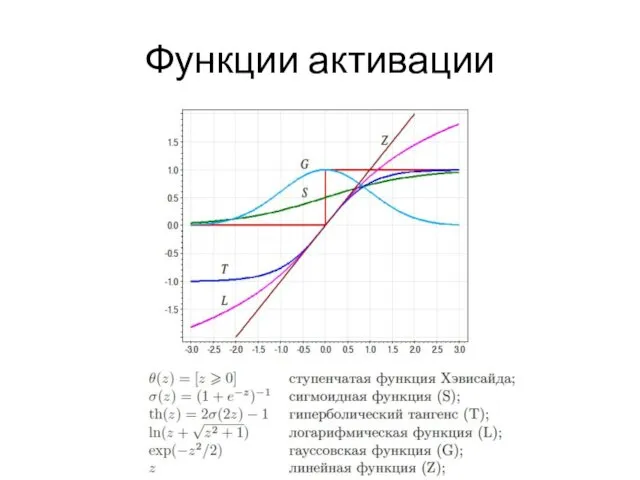

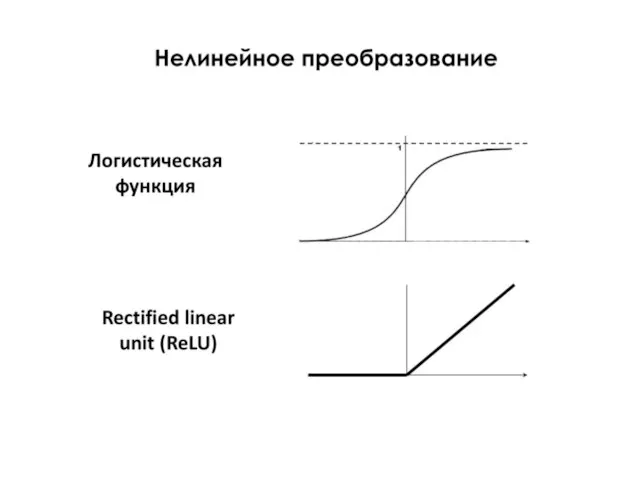

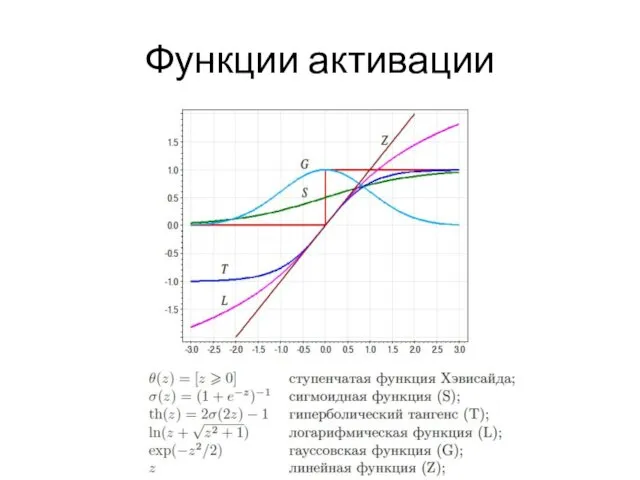

Функции активации

Жесткая ступенька

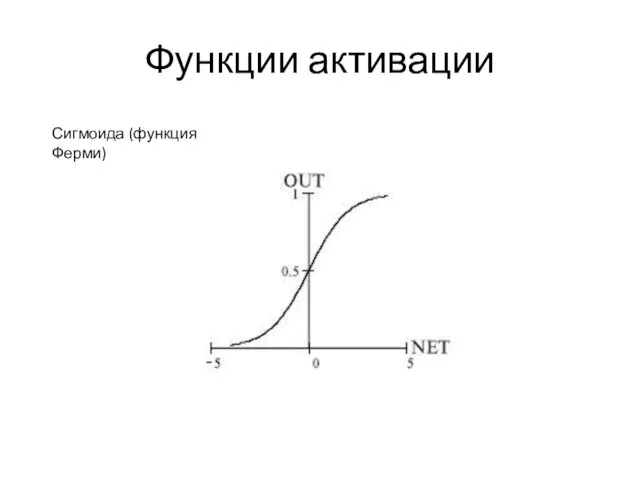

Слайд 16

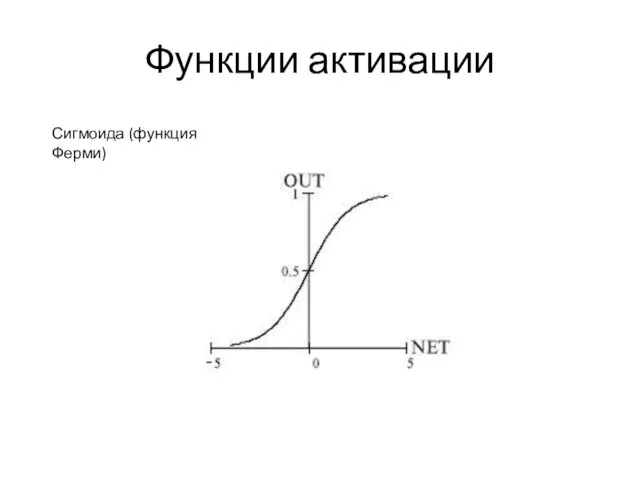

Функции активации

Сигмоида (функция Ферми)

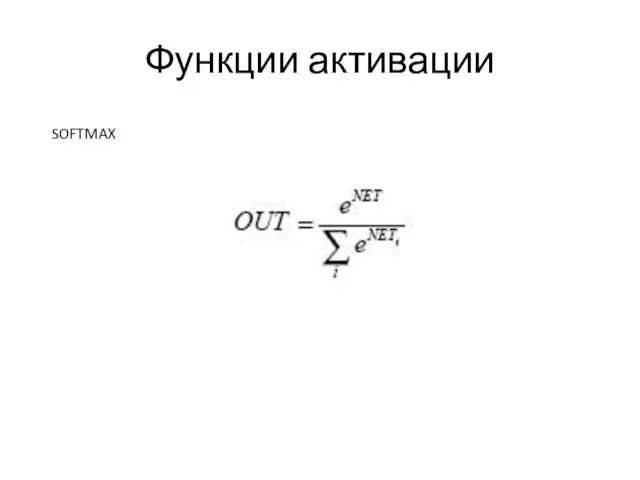

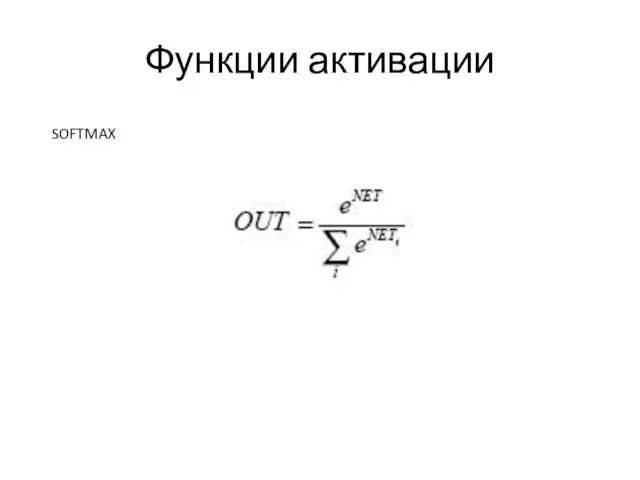

Слайд 17

Функции активации

Гиперболический тангенс

Слайд 18

Слайд 19

Слайд 20

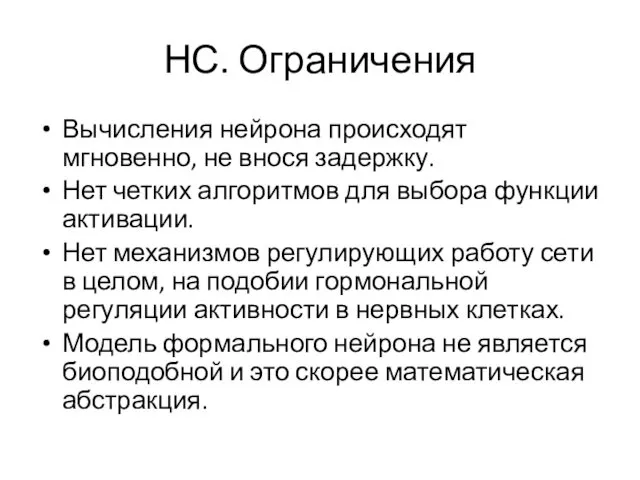

НС. Ограничения

Вычисления нейрона происходят мгновенно, не внося задержку.

Нет четких алгоритмов для

выбора функции активации.

Нет механизмов регулирующих работу сети в целом, на подобии гормональной регуляции активности в нервных клетках.

Модель формального нейрона не является биоподобной и это скорее математическая абстракция.

Слайд 21

Слайд 22

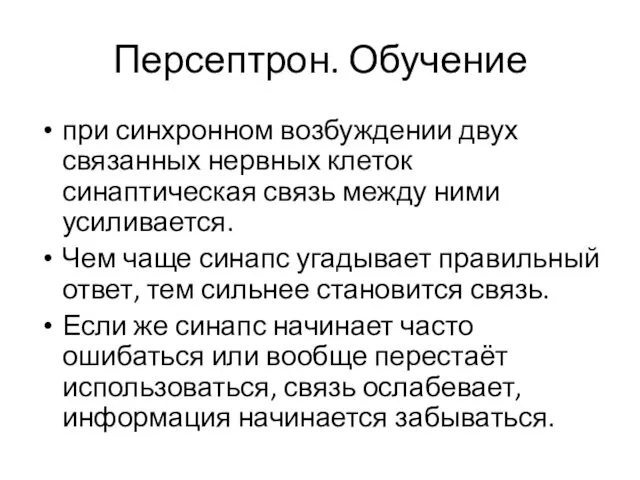

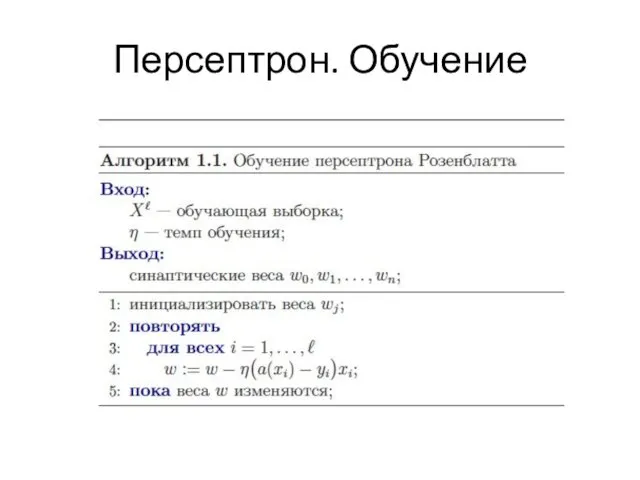

Персептрон. Обучение

при синхронном возбуждении двух связанных нервных клеток синаптическая связь между

ними усиливается.

Чем чаще синапс угадывает правильный ответ, тем сильнее становится связь.

Если же синапс начинает часто ошибаться или вообще перестаёт использоваться, связь ослабевает, информация начинается забываться.

Слайд 23

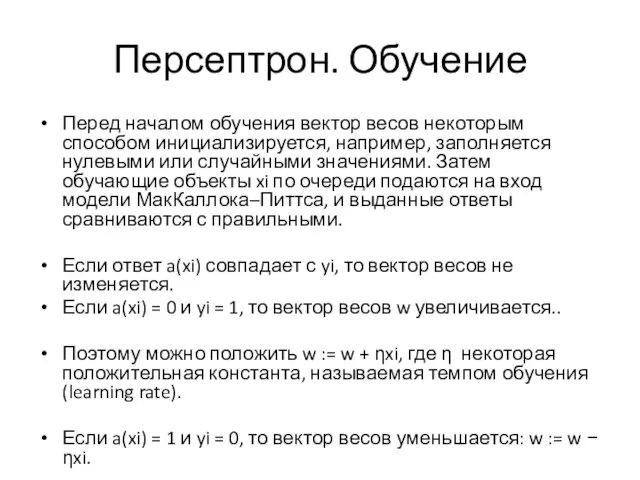

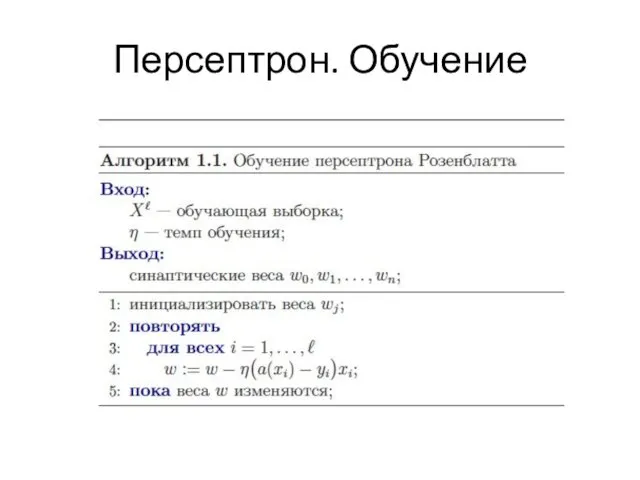

Персептрон. Обучение

Перед началом обучения вектор весов некоторым способом инициализируется, например, заполняется

нулевыми или случайными значениями. Затем обучающие объекты xi по очереди подаются на вход модели МакКаллока–Питтса, и выданные ответы сравниваются с правильными.

Если ответ a(xi) совпадает с yi, то вектор весов не изменяется.

Если a(xi) = 0 и yi = 1, то вектор весов w увеличивается..

Поэтому можно положить w := w + ηxi, где η некоторая положительная константа, называемая темпом обучения (learning rate).

Если a(xi) = 1 и yi = 0, то вектор весов уменьшается: w := w − ηxi.

Слайд 24

Слайд 25

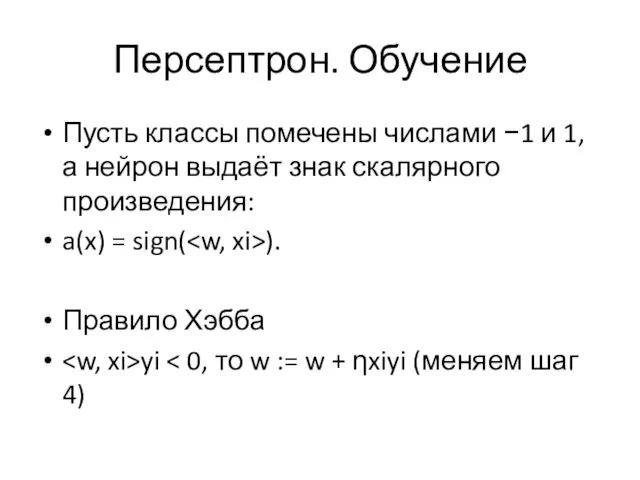

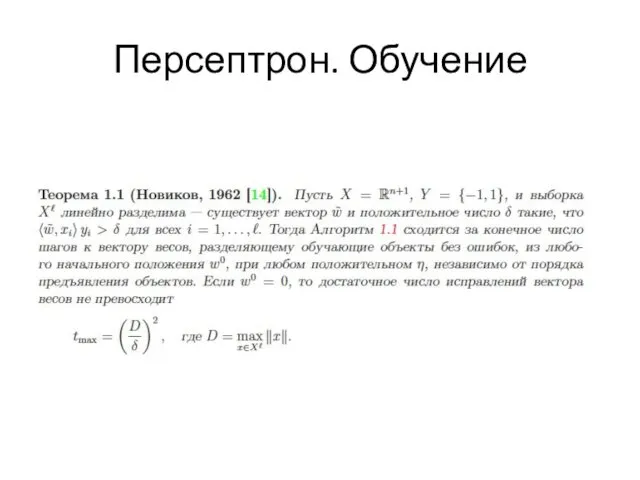

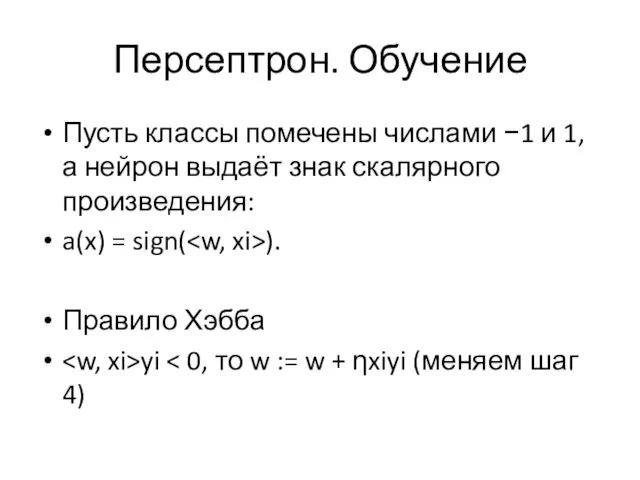

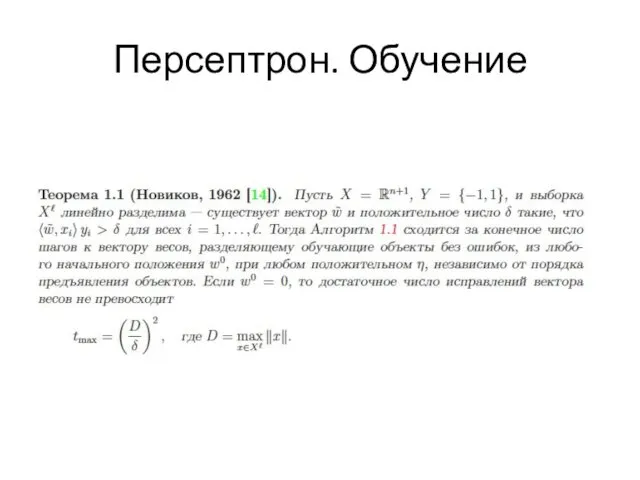

Персептрон. Обучение

Пусть классы помечены числами −1 и 1, а нейрон выдаёт

знак скалярного произведения:

a(x) = sign().

Правило Хэбба

yi < 0, то w := w + ηxiyi (меняем шаг 4)

Слайд 26

Слайд 27

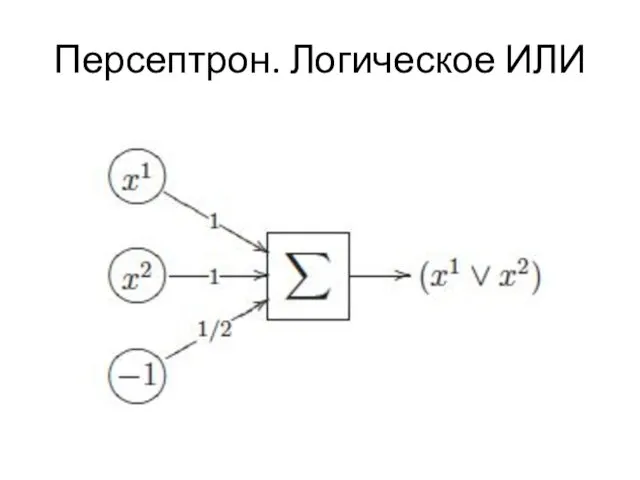

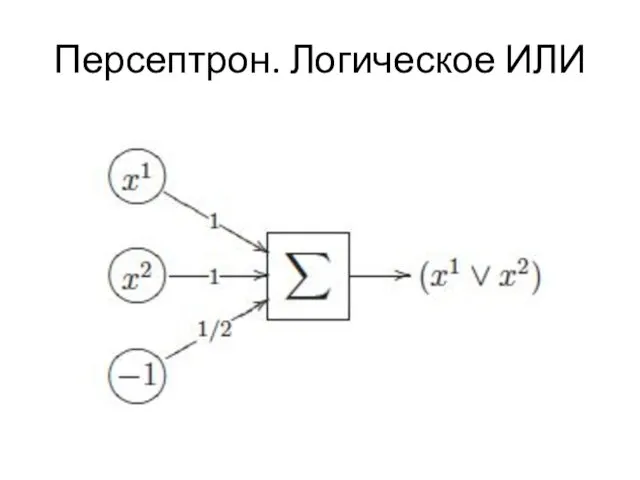

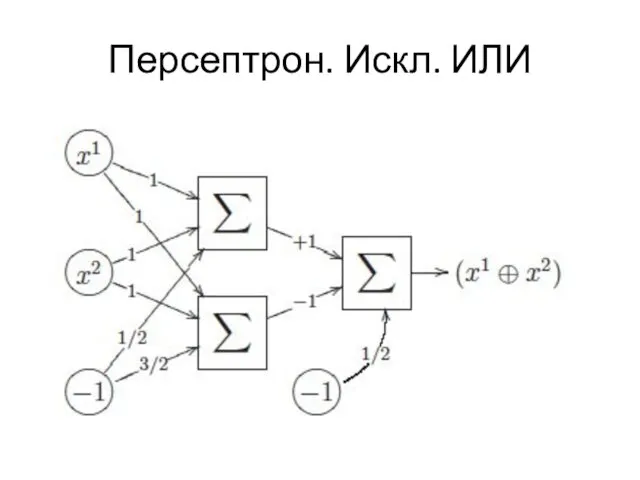

Персептрон. Логическое ИЛИ

Слайд 28

Слайд 29

Гидрографическое и водохозяйственное районирование территории РФ

Гидрографическое и водохозяйственное районирование территории РФ Презентация Детям о Космосе

Презентация Детям о Космосе Инфекционный контроль. Дезинфекция

Инфекционный контроль. Дезинфекция Презентации для уроков Истории и культуры Санкт-Петербурга

Презентации для уроков Истории и культуры Санкт-Петербурга Повторение материала к разделу Обработка материалов 7 класс

Повторение материала к разделу Обработка материалов 7 класс Развитие критического мышления через чтение и письмо при работе с художественным текстом

Развитие критического мышления через чтение и письмо при работе с художественным текстом Физика колебаний. Лекция 7

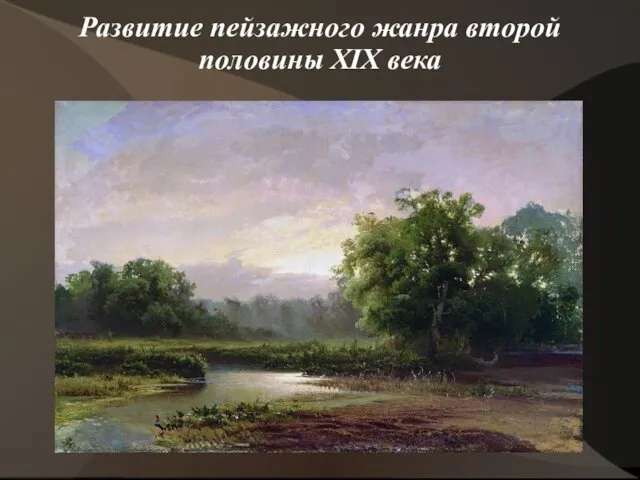

Физика колебаний. Лекция 7 Презентация 14. Пейзаж второй половины XIX в. Часть 2_ Васильев, Куинджи

Презентация 14. Пейзаж второй половины XIX в. Часть 2_ Васильев, Куинджи Презентация Профилактика детского дорожно-транспортного травматизма

Презентация Профилактика детского дорожно-транспортного травматизма Профилактика коронавирусной инфекции

Профилактика коронавирусной инфекции Милосердие, забота о слабых, взаимопомощь

Милосердие, забота о слабых, взаимопомощь Старинные меры длины

Старинные меры длины Крым

Крым Клинико-лабораторные этапы протезирования металлическими штампованными коронками. (Занятие 4)

Клинико-лабораторные этапы протезирования металлическими штампованными коронками. (Занятие 4) Компланарные векторы

Компланарные векторы Презентация : Активные методы обучения

Презентация : Активные методы обучения Использование информационных технологий в работе ДОУ с родителями

Использование информационных технологий в работе ДОУ с родителями Возможности учебных предметов в осознании учащимися ценности здоровья

Возможности учебных предметов в осознании учащимися ценности здоровья Как работает наш организм Диск

Как работает наш организм Диск Нужна ли философия современному человеку

Нужна ли философия современному человеку Трансакционные издержки

Трансакционные издержки Низкопотенциальные внутренние энергоресурсы промышленных предприятий. Определение и классификация

Низкопотенциальные внутренние энергоресурсы промышленных предприятий. Определение и классификация Сердце отдаю детям

Сердце отдаю детям Диффузия

Диффузия С 8 марта

С 8 марта Подсчет запасов и оценка ресурсов нефти и газа

Подсчет запасов и оценка ресурсов нефти и газа Основной пример презентации по результатам практической работы по дисциплине Рынок транспортных услуг

Основной пример презентации по результатам практической работы по дисциплине Рынок транспортных услуг Подготовка к ГИА по географии

Подготовка к ГИА по географии