Содержание

- 2. Постановка задачи Дано растровое изображение с камеры Необходимо определить наличие объекта заданного класса на изображении. Необходимо

- 3. Обзор Общий обзор метода Признаки (особенности) (англ. Features) Интегральное изображение Выделение признаков Слабый классификатор Усиление классификаторов

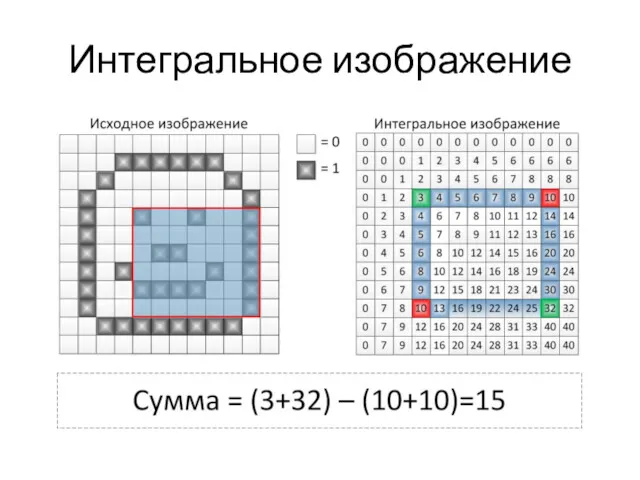

- 4. Интегральное изображение

- 5. Интегральное изображение

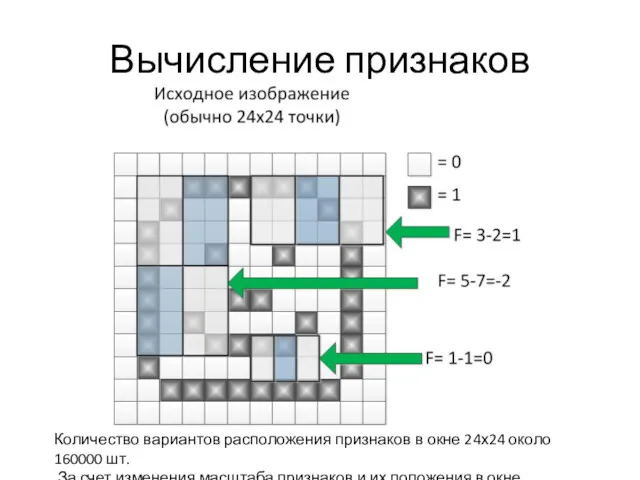

- 6. Признаки Значение признака F = X-Y Где X – сумма значений яркостей точек закрываемых светлой частью

- 7. Вычисление признаков Количество вариантов расположения признаков в окне 24х24 около 160000 шт. За счет изменения масштаба

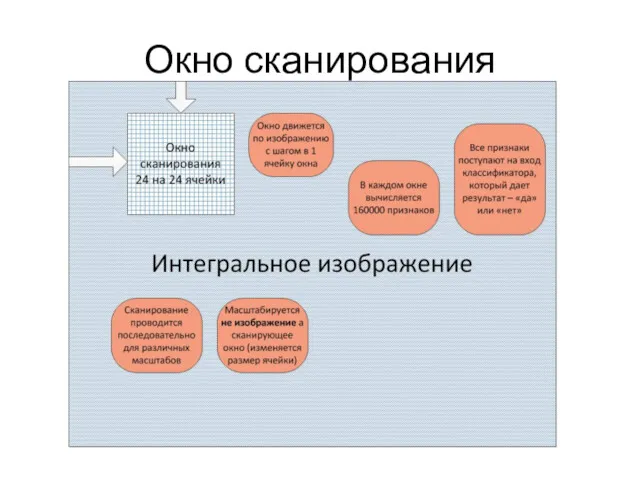

- 8. Окно сканирования

- 9. Окно сканирования

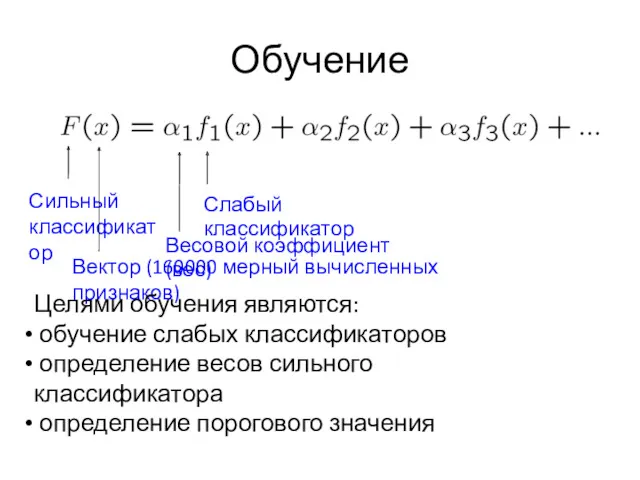

- 10. Классификация F(x) = α1 f1(x) + α2 f2(x) + ...

- 11. Обучение

- 12. Обучение Сильный классификатор Слабый классификатор Весовой коэффициент (вес) Вектор (160000 мерный вычисленных признаков) Целями обучения являются:

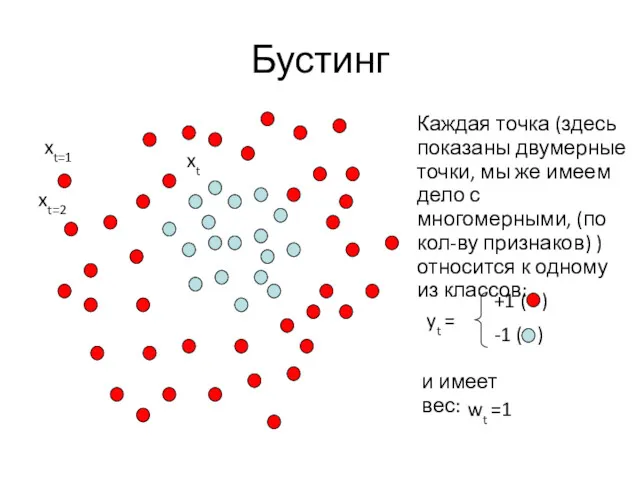

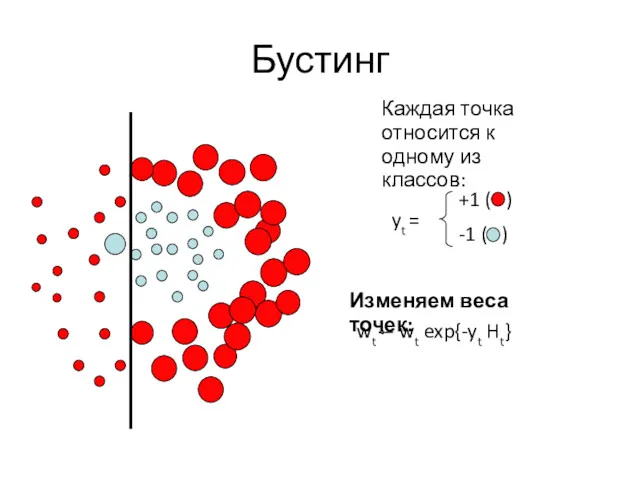

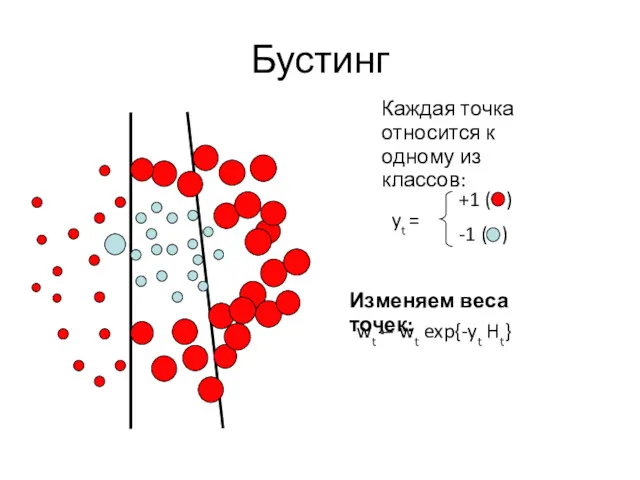

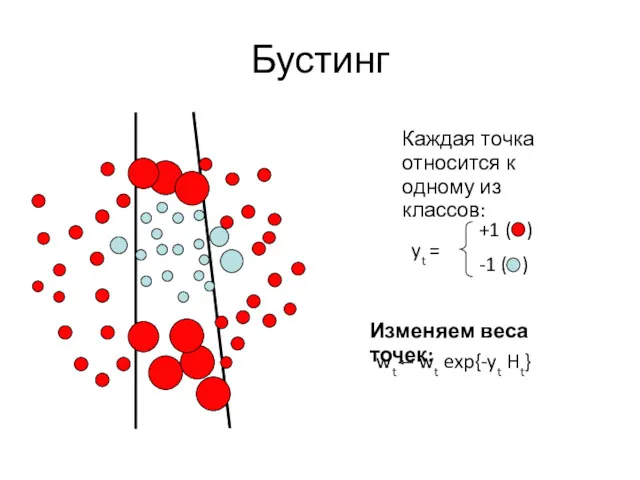

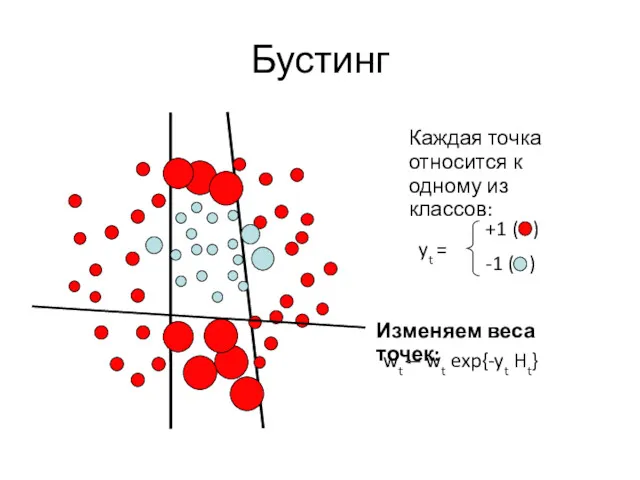

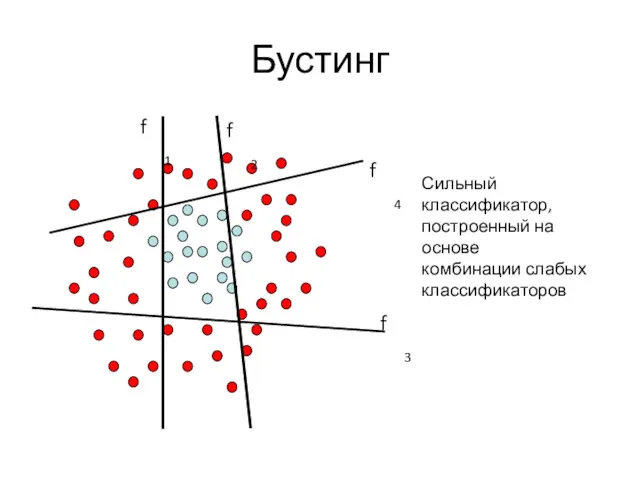

- 13. Бустинг Каждая точка (здесь показаны двумерные точки, мы же имеем дело с многомерными, (по кол-ву признаков)

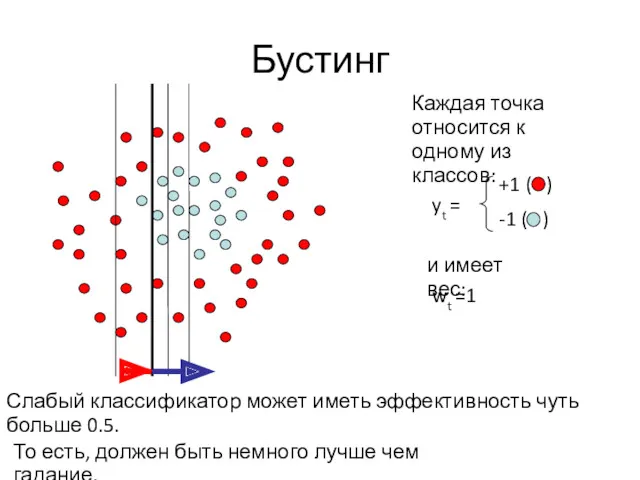

- 14. Бустинг Слабый классификатор может иметь эффективность чуть больше 0.5. То есть, должен быть немного лучше чем

- 15. Бустинг wt wt exp{-yt Ht} Изменяем веса точек: Каждая точка относится к одному из классов:

- 16. Бустинг wt wt exp{-yt Ht} Изменяем веса точек: Каждая точка относится к одному из классов:

- 17. Бустинг wt wt exp{-yt Ht} Изменяем веса точек: Каждая точка относится к одному из классов:

- 18. Бустинг wt wt exp{-yt Ht} Изменяем веса точек: Каждая точка относится к одному из классов:

- 19. Бустинг Сильный классификатор, построенный на основе комбинации слабых классификаторов

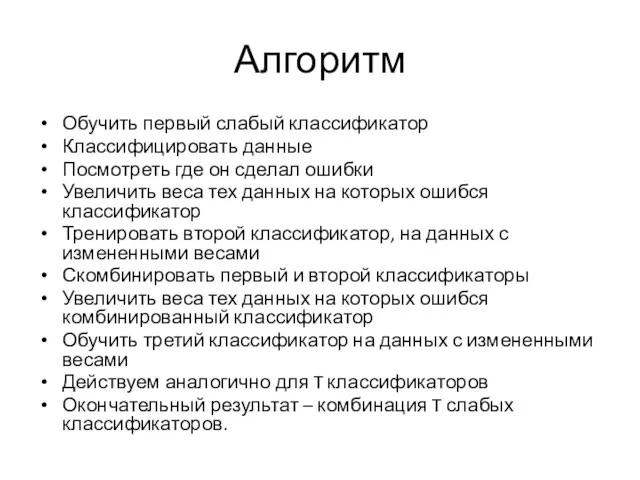

- 20. Алгоритм Обучить первый слабый классификатор Классифицировать данные Посмотреть где он сделал ошибки Увеличить веса тех данных

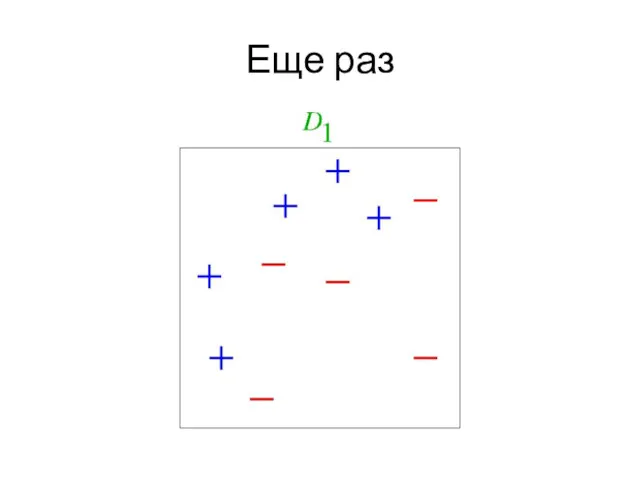

- 21. Еще раз

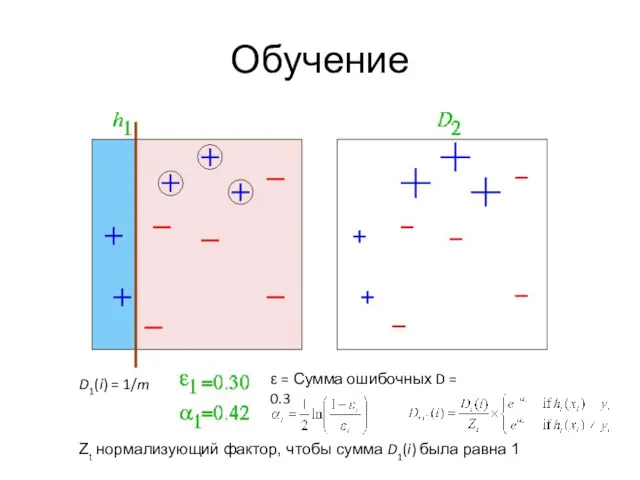

- 22. Обучение ε = Сумма ошибочных D = 0.3 D1(i) = 1/m Zt нормализующий фактор, чтобы сумма

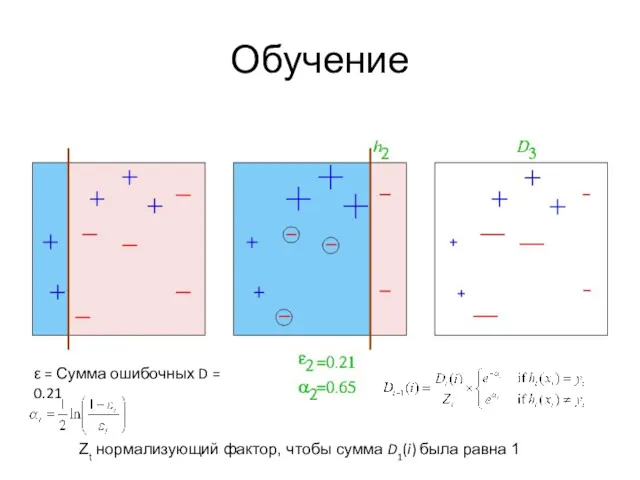

- 23. Обучение ε = Сумма ошибочных D = 0.21 Zt нормализующий фактор, чтобы сумма D1(i) была равна

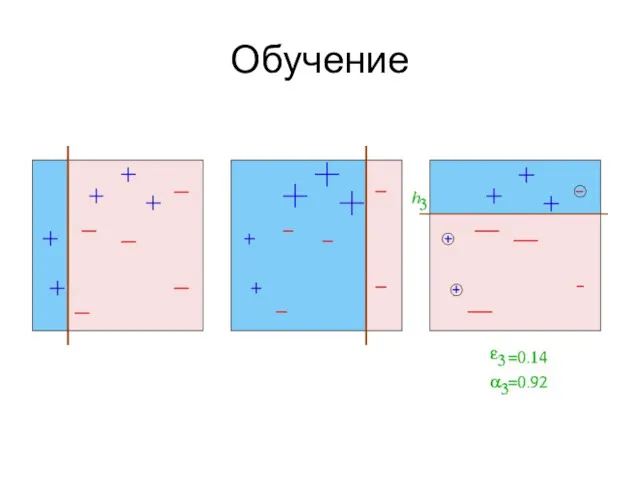

- 24. Обучение

- 26. Скачать презентацию

Комп’ютерна презентація. Етапи роботи з презентацією. Середовище редактора презентацій

Комп’ютерна презентація. Етапи роботи з презентацією. Середовище редактора презентацій Использование Битрикс+React

Использование Битрикс+React Тиждень циклової комісії Комп'ютерної інженерії

Тиждень циклової комісії Комп'ютерної інженерії Сравнительный анализ дизайна интернет-сайтов

Сравнительный анализ дизайна интернет-сайтов Нейронные сети глубокого обучения

Нейронные сети глубокого обучения Раскраскин. Журнал для детей и родителей

Раскраскин. Журнал для детей и родителей Операционные системы. Основные понятия, назначения и функции ОС

Операционные системы. Основные понятия, назначения и функции ОС Язык SQL. Манипулирование структурой данных

Язык SQL. Манипулирование структурой данных Флэш-память

Флэш-память Как понять когда можно бросать работу и уходить в стартап

Как понять когда можно бросать работу и уходить в стартап Урок по темеЛинейные вычислительные алгоритмы.

Урок по темеЛинейные вычислительные алгоритмы. Системы автоматизированного проектирования Autocad

Системы автоматизированного проектирования Autocad Основи програмування – мови програмування

Основи програмування – мови програмування САПР для проектирования электрики, автоматики и систем автоматизации

САПР для проектирования электрики, автоматики и систем автоматизации Agile, Scrum подходы в управлении проектами

Agile, Scrum подходы в управлении проектами Неделя Информатики и Лего-конструирования

Неделя Информатики и Лего-конструирования Логические основы

Логические основы Программный комплекс для гидравлических расчетов

Программный комплекс для гидравлических расчетов Классификация библиографических пособий

Классификация библиографических пособий Autodesk Revit. Эффективный инструмент работы для небольших проектных групп

Autodesk Revit. Эффективный инструмент работы для небольших проектных групп Оператор ветвления или условный оператор. 9 класс

Оператор ветвления или условный оператор. 9 класс Как снимать интересные сториз

Как снимать интересные сториз Файлы в С++

Файлы в С++ Команды ввод-вывод в Турбо Паскале

Команды ввод-вывод в Турбо Паскале Ионное легирование полупроводников

Ионное легирование полупроводников Алогритм Дейкстры

Алогритм Дейкстры Работа с графикой в С++ Bulder

Работа с графикой в С++ Bulder Автоматизация бизнес-процессов

Автоматизация бизнес-процессов