Содержание

- 2. 17 лекций по 2 часа в неделю 17 лабораторных 2 часа в неделю Контрольные работы +

- 3. Лекция1 Измерение информации Лекция2 Коды Лекция3 Сжатие Лекция4 Системы счисления, Кодирование чисел Лекция5 Представление информации в

- 4. ЛИТЕРАТУРА Информатика. Базовый курс / под ред. С.В.Симоновича. 3-е изд. - СПб.: 2011. — 640 с

- 5. ЛЕКЦИЯ 1. ИНФОРМАТИКА: ПРЕДМЕТ И ЗАДАЧИ. Понятие и структура информатики Информация и данные Свойства информации Формы

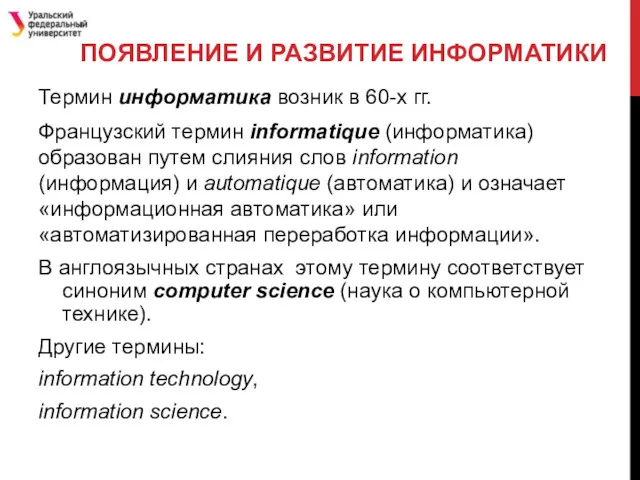

- 6. ПОЯВЛЕНИЕ И РАЗВИТИЕ ИНФОРМАТИКИ Термин информатика возник в 60-х гг. Французский термин informatique (информатика) образован путем

- 7. Информатика – это область человеческой деятельности, связанная с процессами преобразования информации с помощью компьютеров и их

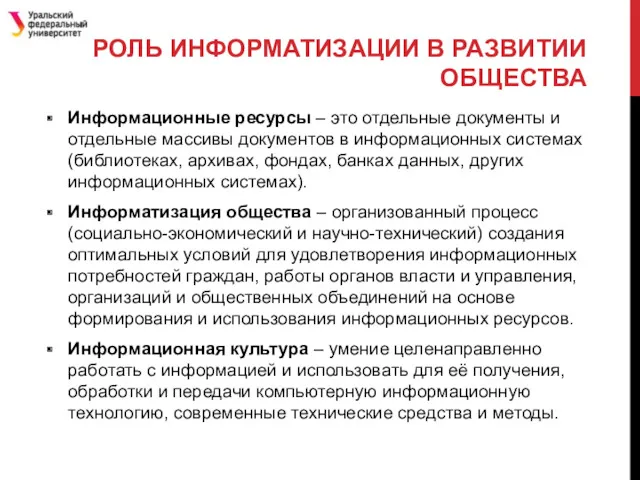

- 8. РОЛЬ ИНФОРМАТИЗАЦИИ В РАЗВИТИИ ОБЩЕСТВА Информационные ресурсы – это отдельные документы и отдельные массивы документов в

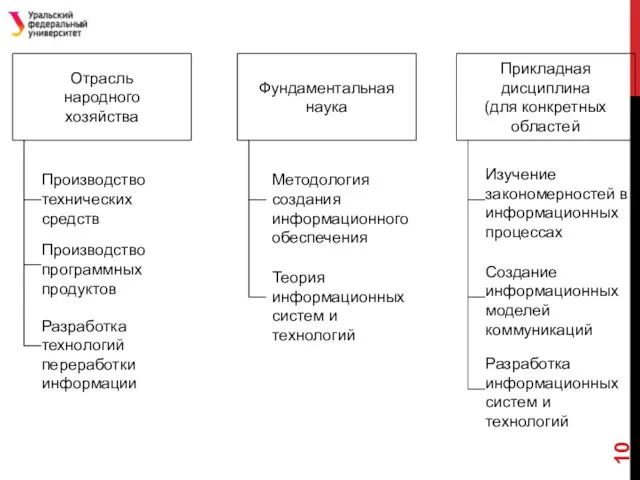

- 9. Структура информатики

- 11. НАПРАВЛЕНИЯ ПРАКТИЧЕСКОЙ ДЕЯТЕЛЬНОСТИ В ОБЛАСТИ ИНФОРМАТИКИ архитектура вычислительных систем; программирование; преобразование данных; защита информации; автоматизация; стандартизация;

- 12. ИНФОРМАЦИЯ И ДАННЫЕ Термин информация происходит от латинского informatio (разъяснение, осведомление, изложение) С позиций материалистической философии

- 13. ВЗАИМОСВЯЗЬ ПОНЯТИЙ «ИНФОРМАЦИЯ» И «ДАННЫЕ» Информация является продуктом взаимодействия данных и соответствующих им методов восприятия. Данные

- 14. Информация – сведения об объектах и явлениях окружающей среды, их параметрах, свойствах и состоянии, которые уменьшают

- 15. ДИАЛЕКТИЧЕСКОЕ ЕДИНСТВО ДАННЫХ И МЕТОДОВ ИХ ОБРАБОТКИ В ИНФОРМАЦИОННОМ ПРОЦЕССЕ Динамический характер информации (существует только в

- 16. СВОЙСТВА ИНФОРМАЦИИ Объективность Полнота Достоверность Доступность Актуальность Адекватность

- 17. АДЕКВАТНОСТЬ ИНФОРМАЦИИ Адекватность информации – это определенный уровень соответствия создаваемого с помощью полученной информации образа реальному

- 19. ИЗМЕРЕНИЕ ИНФОРМАЦИИ

- 20. СИНТАКСИЧЕСКАЯ МЕРА ИНФОРМАЦИИ Не затрагивает смыслового содержания Объем данных VД Объем данных в сообщении измеряется количеством

- 21. ИНФОРМАЦИЯ, НЕОПРЕДЕЛЕННОСТЬ, ВОЗМОЖНОСТЬ ВЫБОРА Количество информации Iβ(α) Любая неопределенность предполагает – возможность выбора. При полной информации

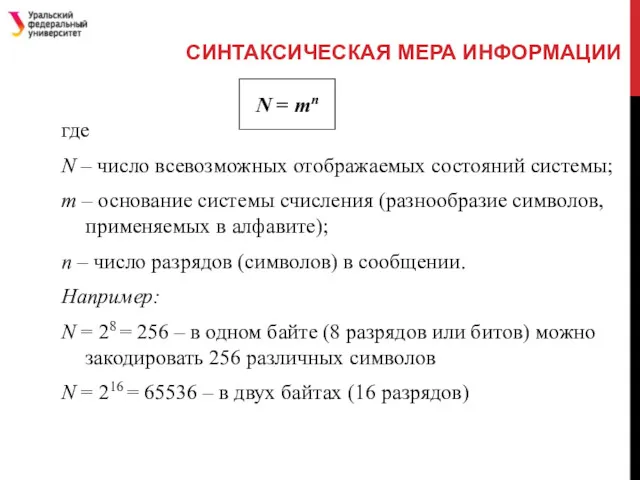

- 22. СИНТАКСИЧЕСКАЯ МЕРА ИНФОРМАЦИИ где N – число всевозможных отображаемых состояний системы; m – основание системы счисления

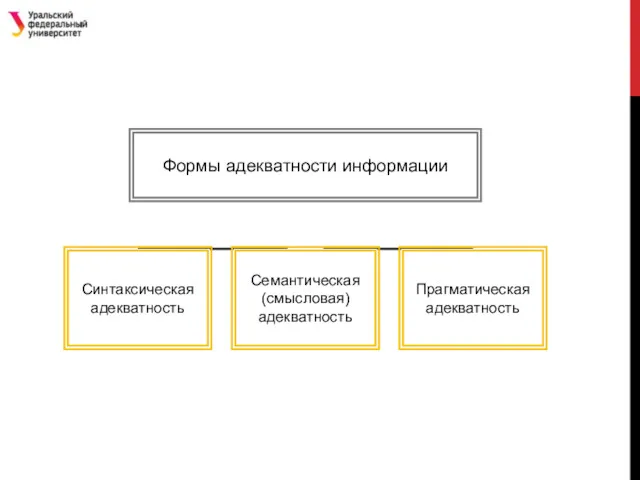

- 23. Синтаксическая адекватность отображает формально-структурные характеристики информации и не затрагивает ее смыслового содержания. Здесь учитываются: тип носителя

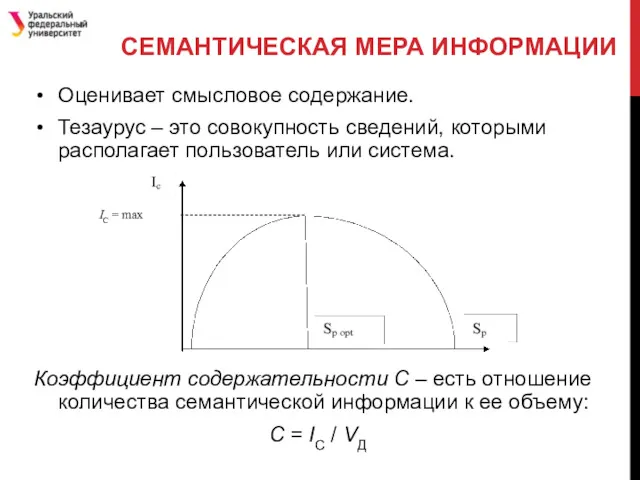

- 24. СЕМАНТИЧЕСКАЯ МЕРА ИНФОРМАЦИИ Оценивает смысловое содержание. Тезаурус – это совокупность сведений, которыми располагает пользователь или система.

- 25. ПРАГМАТИЧЕСКАЯ МЕРА ИНФОРМАЦИИ определяет полезность информации (ценность) для достижения пользователем поставленной цели. величина относительная, обусловленная особенностями

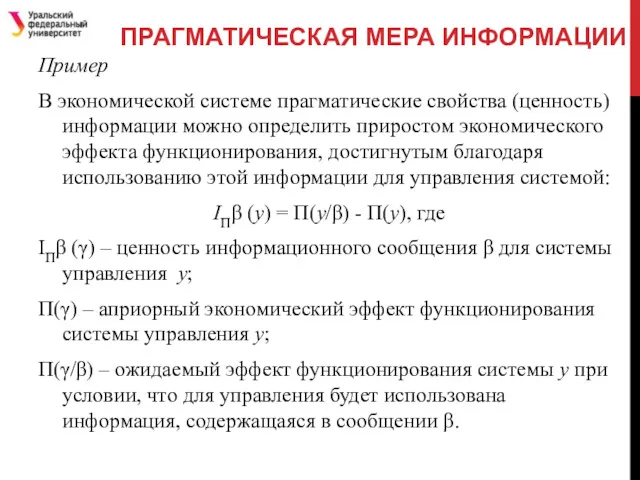

- 26. ПРАГМАТИЧЕСКАЯ МЕРА ИНФОРМАЦИИ Пример В экономической системе прагматические свойства (ценность) информации можно определить приростом экономического эффекта

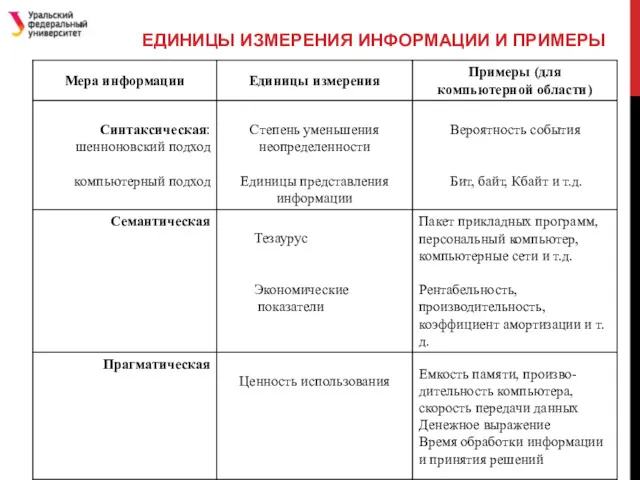

- 27. ЕДИНИЦЫ ИЗМЕРЕНИЯ ИНФОРМАЦИИ И ПРИМЕРЫ

- 28. НОСИТЕЛИ ДАННЫХ Данные – зарегистрированные сигналы. В соответствии с методом регистрации данные могут храниться и транспортироваться

- 29. ХАРАКТЕРИСТИКИ НОСИТЕЛЕЙ ДАННЫХ Разрешающая способность – количество данных, записанных в соответствующей носителю единице измерения. Динамический диапазон

- 30. ОПЕРАЦИИ С ДАННЫМИ сбор данных; формализация данных; фильтрация данных; сортировка данных; архивация; защита данных; передача; преобразование

- 31. ЛЕКЦИЯ 2. ОПРЕДЕЛЕНИЕ И ИЗМЕРЕНИЕ ИНФОРМАЦИИ О Клоде Э. Шенноне Вероятность сообщения и количество информации Понятие

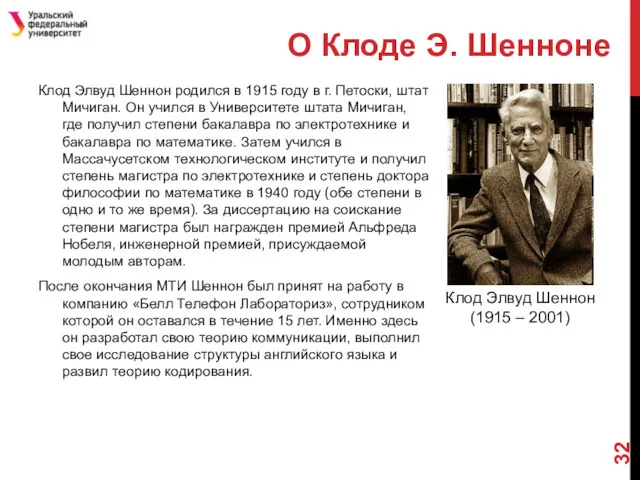

- 32. О Клоде Э. Шенноне Клод Элвуд Шеннон родился в 1915 году в г. Петоски, штат Мичиган.

- 33. Немного о теории информации Шеннона Теория информации Клода Е. Шеннона была опубликована в середине прошлого века.

- 34. ЧТО ТАКОЕ ИЗБЫТОЧНОСТЬ Можно пояснить на примере: связисты во всех странах, передавая буквы голосом, проговаривают не

- 35. МЕРА ИНФОРМАЦИИ

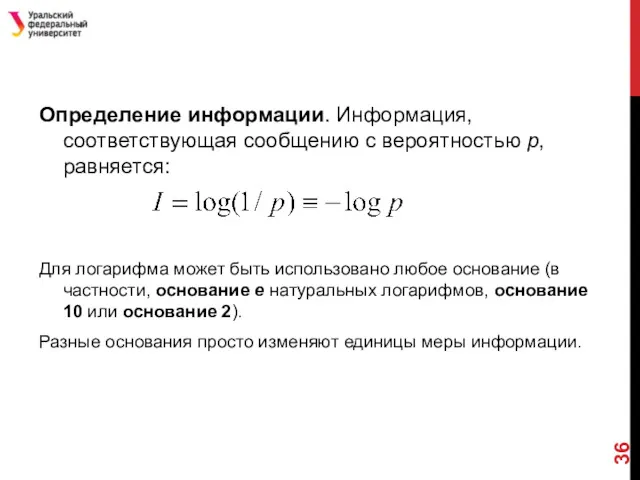

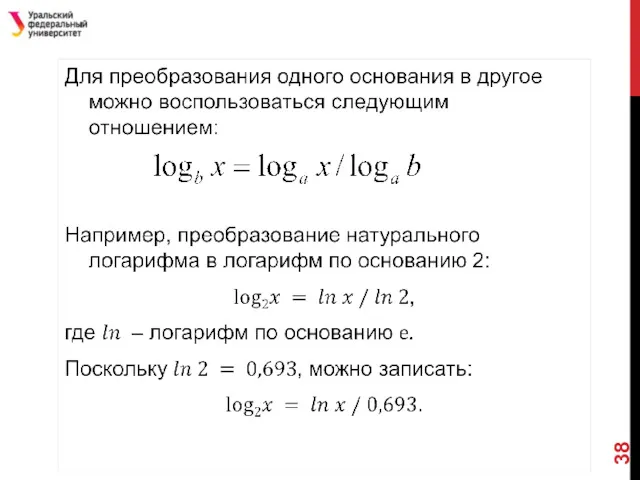

- 36. Определение информации. Информация, соответствующая сообщению с вероятностью р, равняется: Для логарифма может быть использовано любое основание

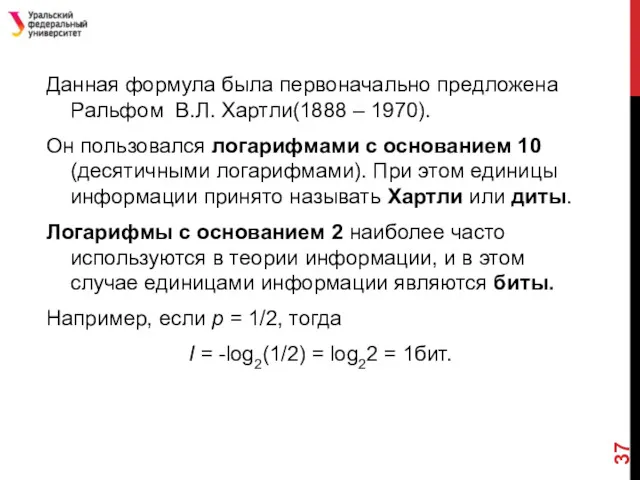

- 37. Данная формула была первоначально предложена Pальфом B.Л. Хартли(1888 – 1970). Он пользовался логарифмами с основанием 10

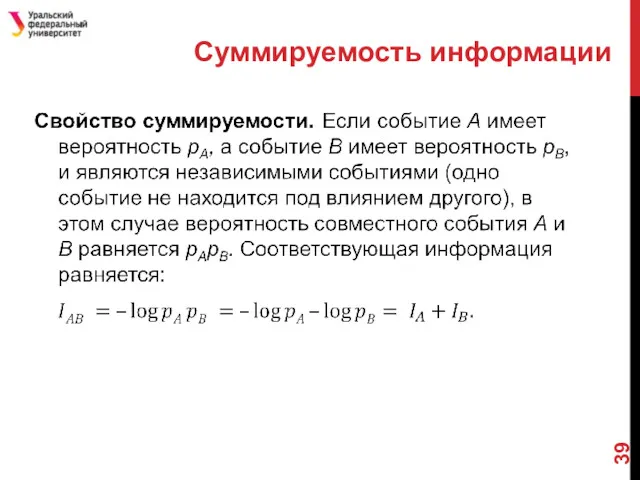

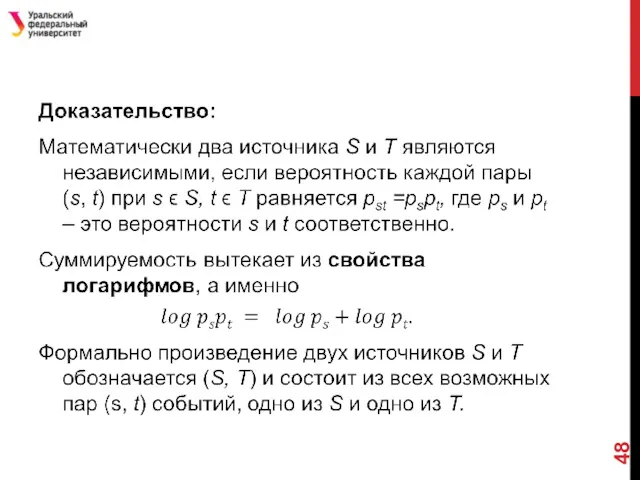

- 39. Суммируемость информации

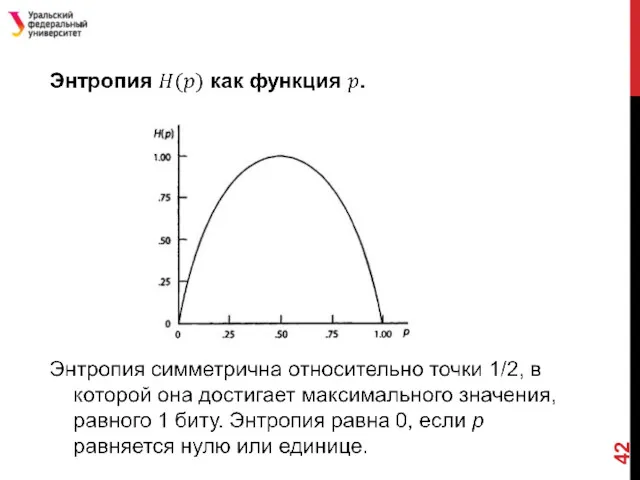

- 40. ЭНТРОПИЯ

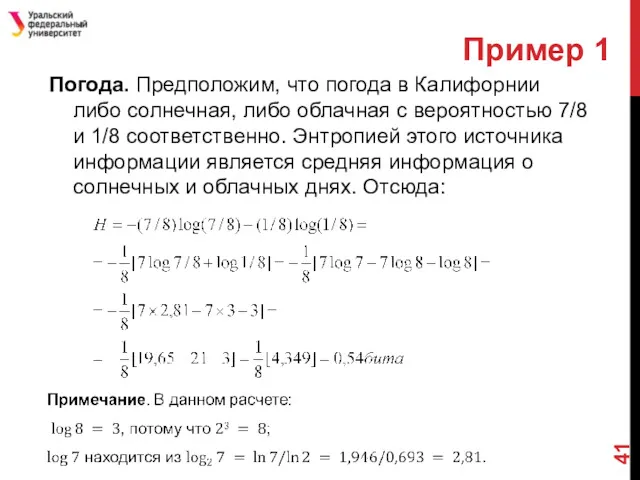

- 41. Пример 1 Погода. Предположим, что погода в Калифорнии либо солнечная, либо облачная с вероятностью 7/8 и

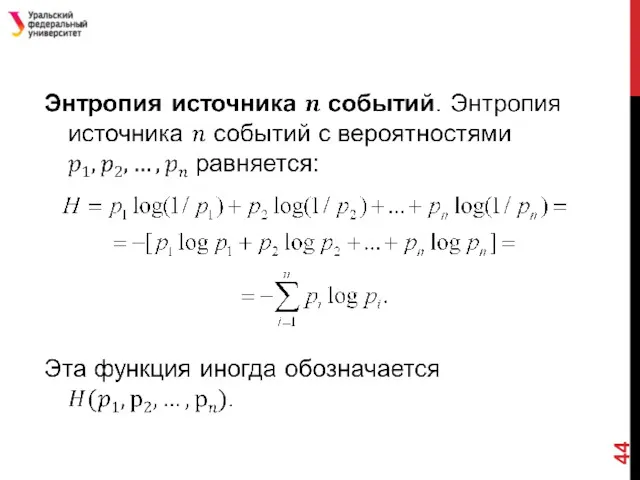

- 43. ИСТОЧНИКИ ИНФОРМАЦИИ

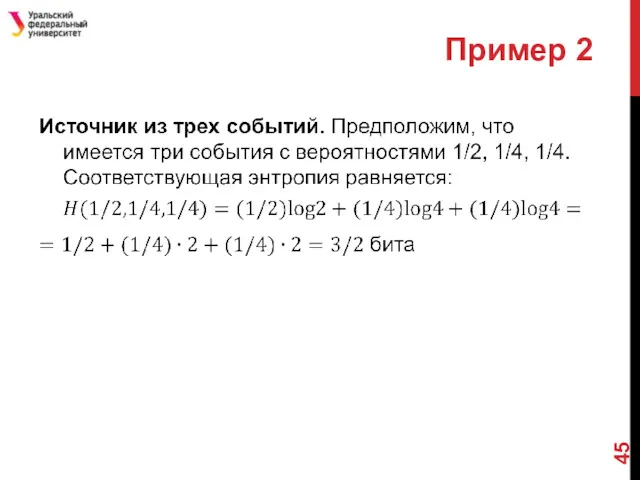

- 45. Пример 2

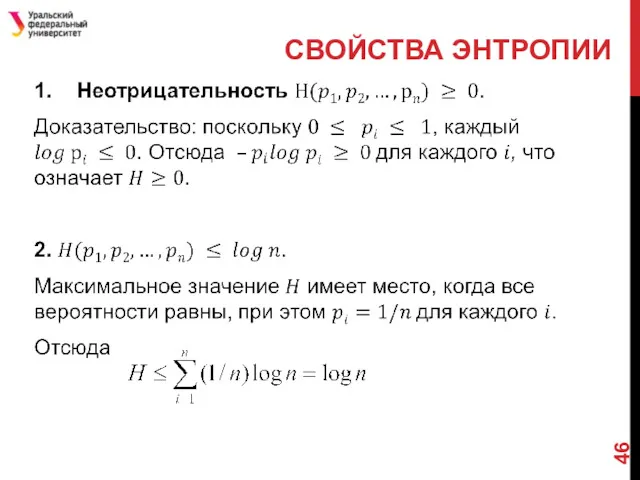

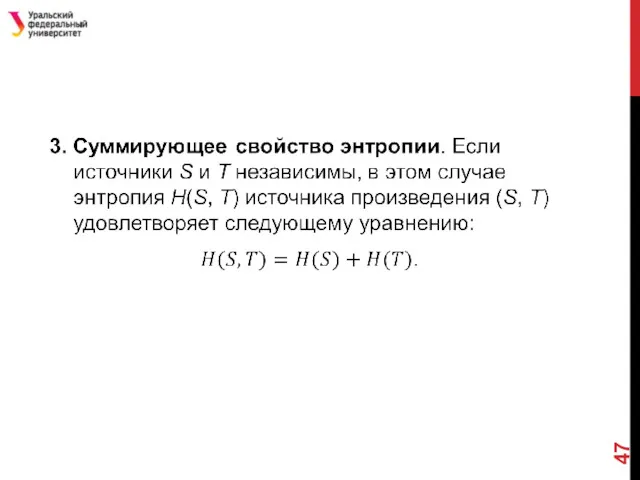

- 46. СВОЙСТВА ЭНТРОПИИ

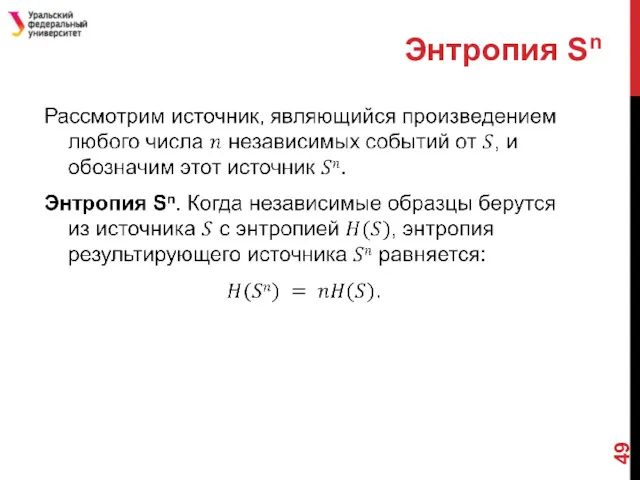

- 49. Энтропия Sn

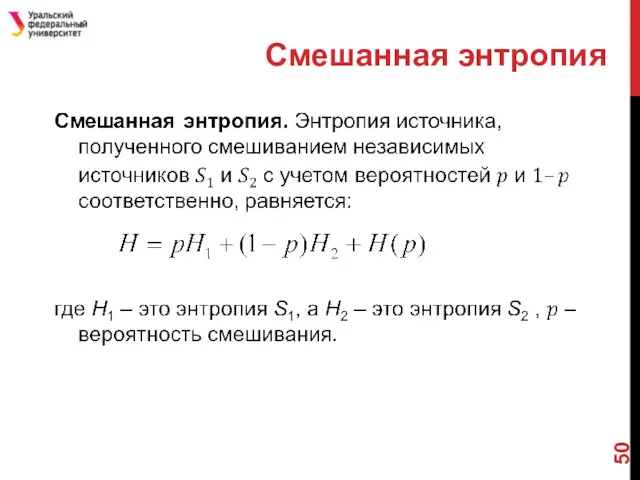

- 50. Смешанная энтропия

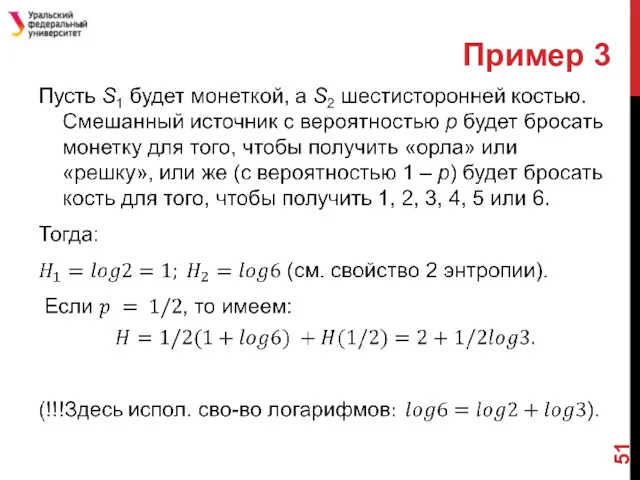

- 51. Пример 3

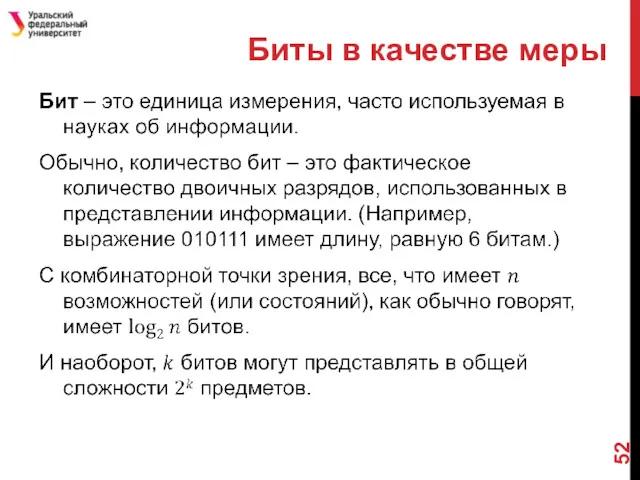

- 52. Биты в качестве меры

- 53. Различие! В общем виде прямая мера битов, когда они приводятся в виде символов, соответствует мере энтропии,

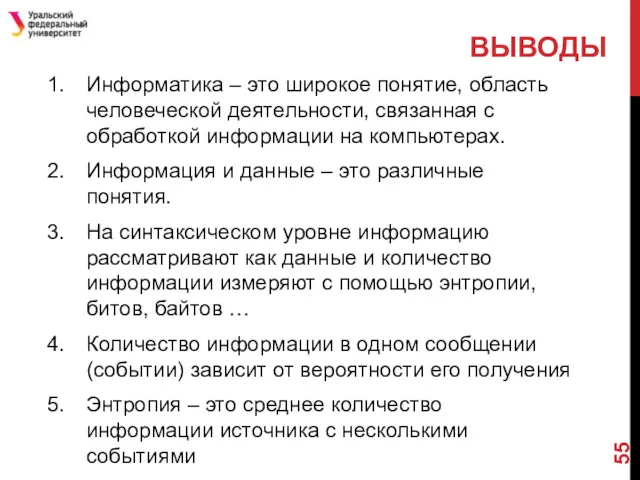

- 55. ВЫВОДЫ Информатика – это широкое понятие, область человеческой деятельности, связанная с обработкой информации на компьютерах. Информация

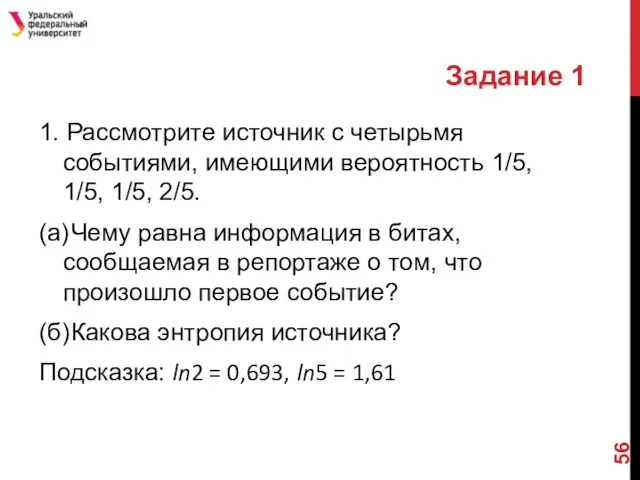

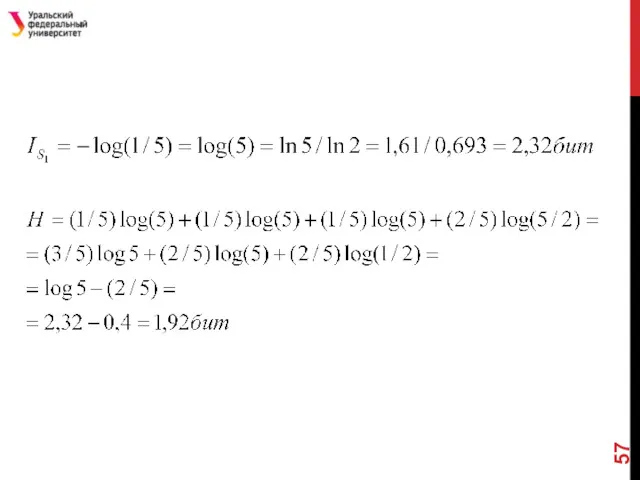

- 56. Задание 1 1. Рассмотрите источник с четырьмя событиями, имеющими вероятность 1/5, 1/5, 1/5, 2/5. (а) Чему

- 58. 2. (Изменение основания.) Какова общая формула энтропии Hb(S) с использованием логарифмов с основанием b относительно энтропии

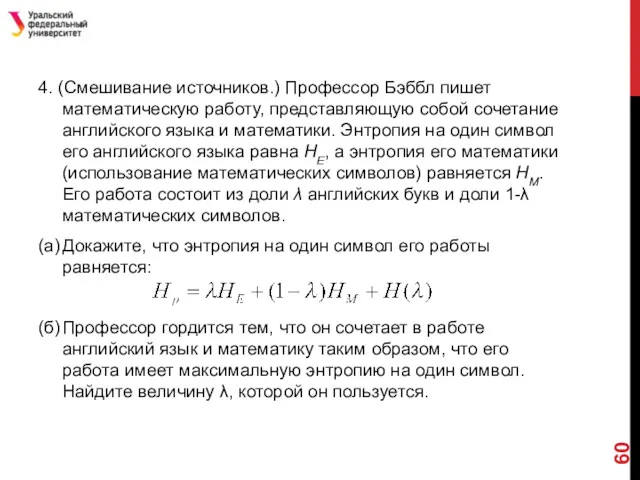

- 60. 4. (Смешивание источников.) Профессор Бэббл пишет математическую работу, представляющую собой сочетание английского языка и математики. Энтропия

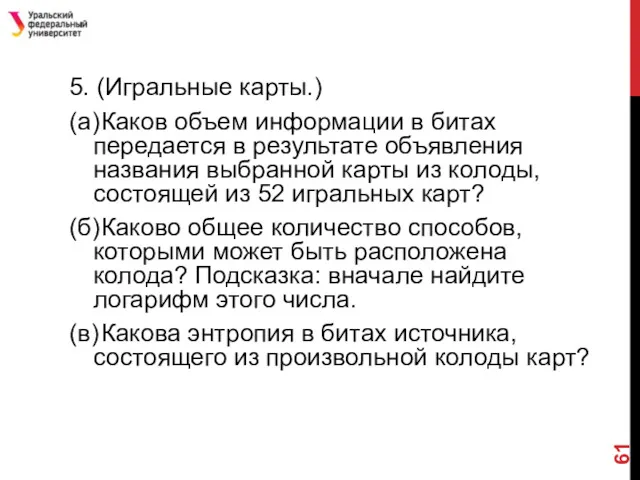

- 61. 5. (Игральные карты.) (а) Каков объем информации в битах передается в результате объявления названия выбранной карты

- 63. Скачать презентацию

Развитие многоуровневых машин

Развитие многоуровневых машин Гугл плей маркет

Гугл плей маркет Файловый ввод-вывод

Файловый ввод-вывод Разметка Android-приложения. Объектно - ориентированное программирование

Разметка Android-приложения. Объектно - ориентированное программирование Введение в ОС_7cf4f868-0df6-48ba-816e-1789eba5764d

Введение в ОС_7cf4f868-0df6-48ba-816e-1789eba5764d Языки описания запросов. Языки запросов. Лекция 9

Языки описания запросов. Языки запросов. Лекция 9 Одномерные массивы. Введение.

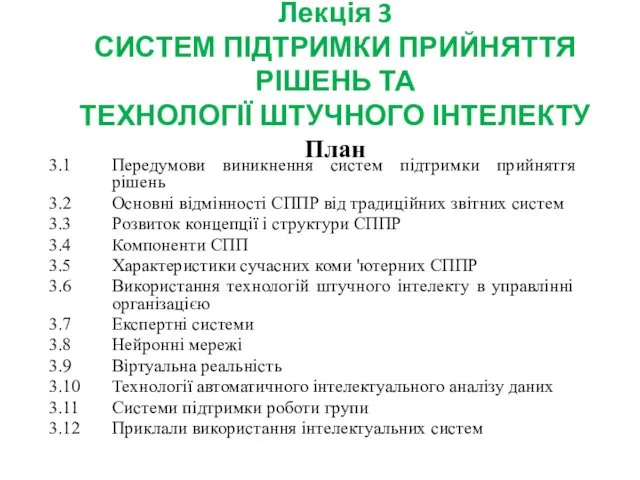

Одномерные массивы. Введение. Системи підтримки прийняття рішень та технології штучного інтелекту

Системи підтримки прийняття рішень та технології штучного інтелекту Логические выражения и таблицы истинности

Логические выражения и таблицы истинности Информация. Виды кодирования. Системы счисления

Информация. Виды кодирования. Системы счисления Аспектно ориентированное программирование. Инструменты для сборки и управления

Аспектно ориентированное программирование. Инструменты для сборки и управления Введение в программную инженерию. Управление рисками проекта

Введение в программную инженерию. Управление рисками проекта Проблемы обеспечения информационной безопасности телекоммуникационных сетей при реализации проекта Цифровая железная дорога

Проблемы обеспечения информационной безопасности телекоммуникационных сетей при реализации проекта Цифровая железная дорога Інформаційні системи та технології

Інформаційні системи та технології 12 Принципов анимации

12 Принципов анимации Летняя практика. Часть 4. Массивы

Летняя практика. Часть 4. Массивы Standard Controls Validation

Standard Controls Validation Управление ИТ-инфраструктурой предприятия

Управление ИТ-инфраструктурой предприятия Розроблення веб-орієнтованої системи професійної орієнтації для майбутніх вступників до закладу вищої освіти Proffsite

Розроблення веб-орієнтованої системи професійної орієнтації для майбутніх вступників до закладу вищої освіти Proffsite Компьютерные вирусы и антивирусные программы

Компьютерные вирусы и антивирусные программы Қaтарлар. Сандық және дәрежелік қатарлал

Қaтарлар. Сандық және дәрежелік қатарлал Базові складові мови С/С++

Базові складові мови С/С++ Информация. Виды информации

Информация. Виды информации Создание 3d-модели современного кабинета информатики

Создание 3d-модели современного кабинета информатики Презентация к аттестации учителя информатики

Презентация к аттестации учителя информатики Измерение информации

Измерение информации Методы быстрого прототипирования

Методы быстрого прототипирования История счета и систем счисления

История счета и систем счисления