Содержание

- 2. ОСНОВНЫЕ ВОПРОСЫ ЛЕКЦИИ Сообщение Уровни изучения сообщений. Синтаксический уровень. Семантический уровень. Прагматический уровень Меры информации Объемный

- 3. 1. УРОВНИ ПРОБЛЕМ ПЕРЕДАЧИ ИНФОРМАЦИИ При реализации информационных процессов всегда происходит перенос информации в пространстве и

- 4. СООБЩЕНИЕ КАК СОВОКУПНОСТЬ ЗНАКОВ МОЖЕТ ИЗУЧАТЬСЯ НА ТРЕХ УРОВНЯХ: Синтаксическом, где рассматриваются внутренние свойства сообщений, т.е.

- 5. СИНТАКСИЧЕСКИЙ УРОВЕНЬ Проблемы синтаксического уровня касаются создания теоретических основ построения ИС и повышения эффективности их использования.

- 6. Современная теория информации исследует в основном проблемы этого уровня. Она опирается на понятие «количество информации», являющееся

- 7. СЕМАНТИЧЕСКИЙ УРОВЕНЬ Проблемы семантического уровня связаны с формализацией и учетом смысла передаваемой информации, определения степени соответствия

- 8. ПРАГМАТИЧЕСКИЙ УРОВЕНЬ На прагматическом уровне интересуют последствия от получения и использования данной информации потребителем. Проблемы этого

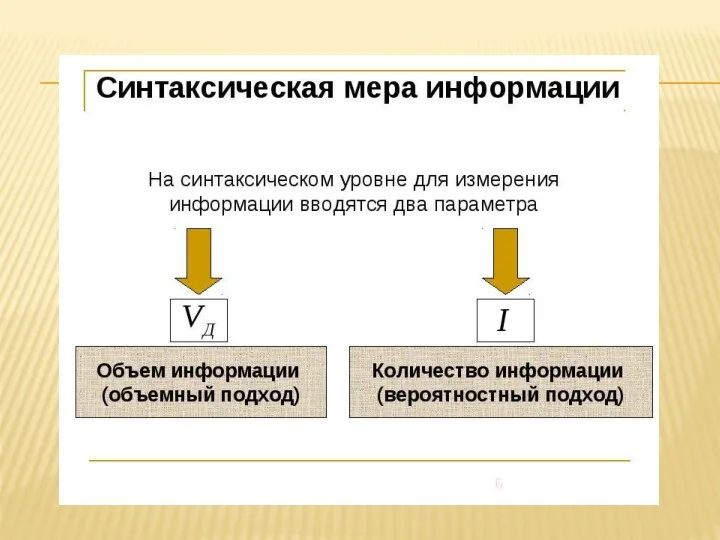

- 9. 2. МЕРЫ ИНФОРМАЦИИ 2.1. МЕРЫ ИНФОРМАЦИИ СИНТАКСИЧЕСКОГО УРОВНЯ Количественная оценка информации этого уровня не связана с

- 11. ОБЪЕМ ИНФОРМАЦИИ- VД При реализации информационных процессов информация передается в виде сообщения, представляющего собой совокупность символов

- 12. ОБЪЕМ ИНФОРМАЦИИ- VД Так в десятичной системе счисления один разряд имеет вес равный 10 и соответственно

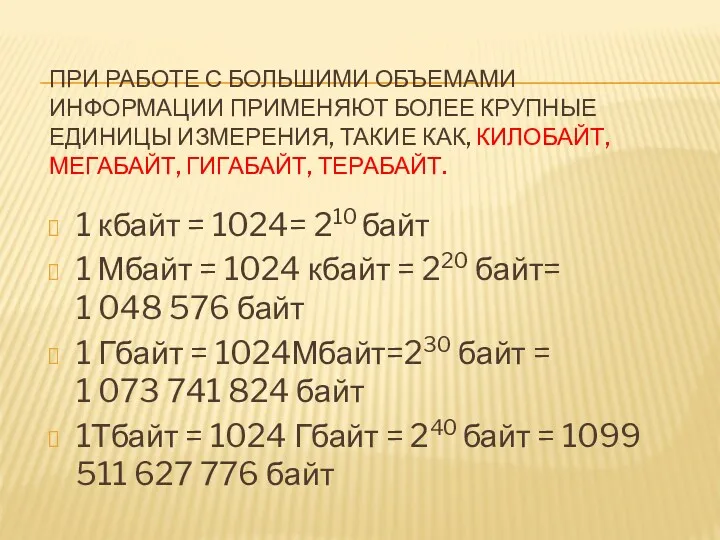

- 13. ПРИ РАБОТЕ С БОЛЬШИМИ ОБЪЕМАМИ ИНФОРМАЦИИ ПРИМЕНЯЮТ БОЛЕЕ КРУПНЫЕ ЕДИНИЦЫ ИЗМЕРЕНИЯ, ТАКИЕ КАК, КИЛОБАЙТ, МЕГАБАЙТ, ГИГАБАЙТ,

- 14. КОЛИЧЕСТВО ИНФОРМАЦИИ – I (ЭНТРОПИЙНЫЙ ПОДХОД) Этот подход основан на том, что факт получения информации всегда

- 16. Неопределенность может иметь разное происхождение. Один из ее видов – неизвестность– рассматривается теорией познания и философией;

- 17. О п ы т А заключается в бросании монеты. В этом опыте возможны два исхода (n=2):

- 18. Таким образом, при энтропийном подходе под информацией понимается количественная величина исчезнувшей в ходе какого-либо процесса (испытания,

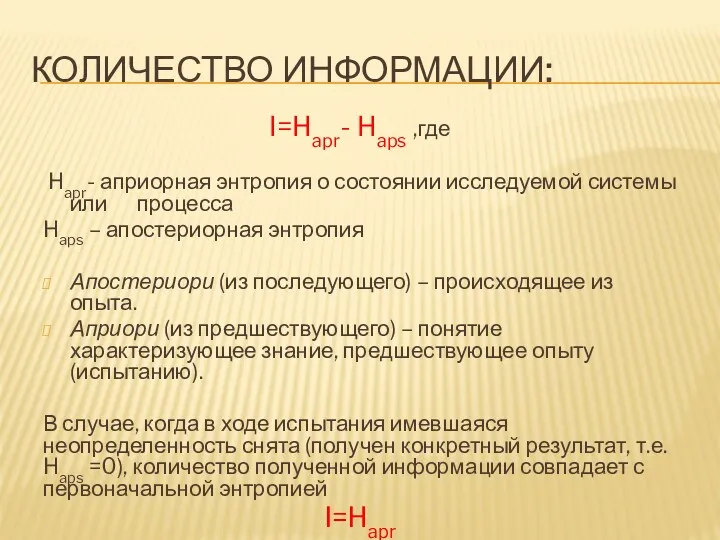

- 19. КОЛИЧЕСТВО ИНФОРМАЦИИ: I=Hapr- Haps ,где Hapr- априорная энтропия о состоянии исследуемой системы или процесса Haps –

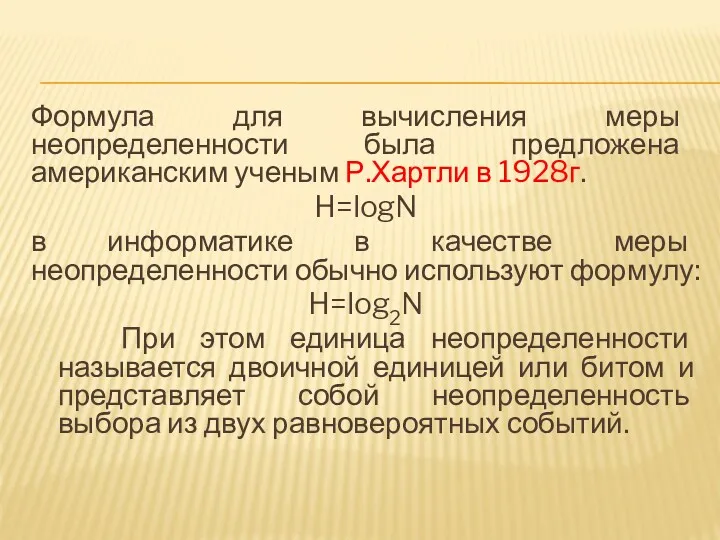

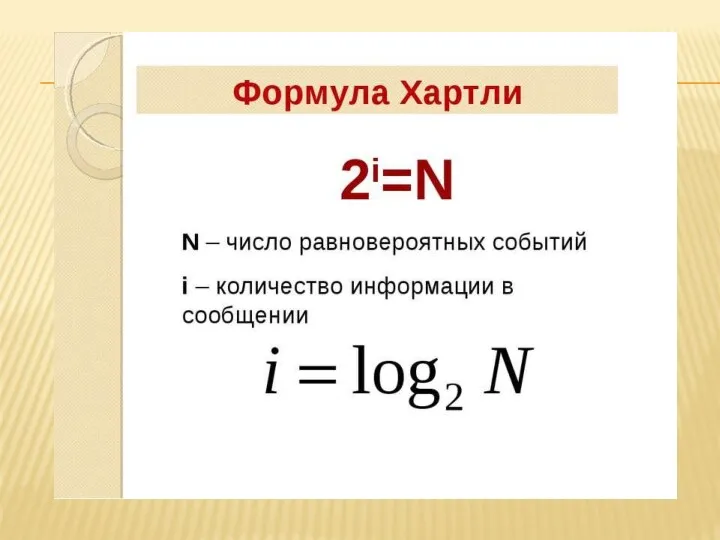

- 20. Формула для вычисления меры неопределенности была предложена американским ученым Р.Хартли в 1928г. H=logN в информатике в

- 21. ФОРМУЛУ ХАРТЛИ МОЖНО СЛОВЕСНО ВЫРАЗИТЬ ИНАЧЕ: количество информации равно степени, в которую необходимо возвести число 2,

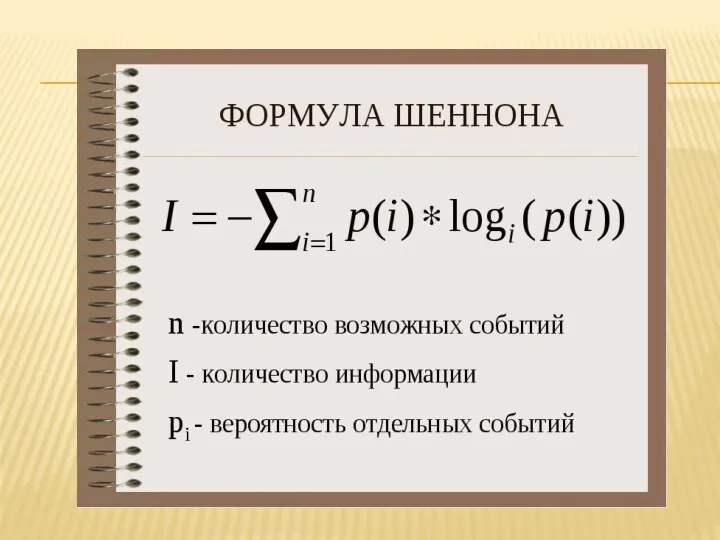

- 23. Предложенная мера позволяет решать определенные практические задачи, когда все возможные состояния источника информации имеют одинаковую вероятность.

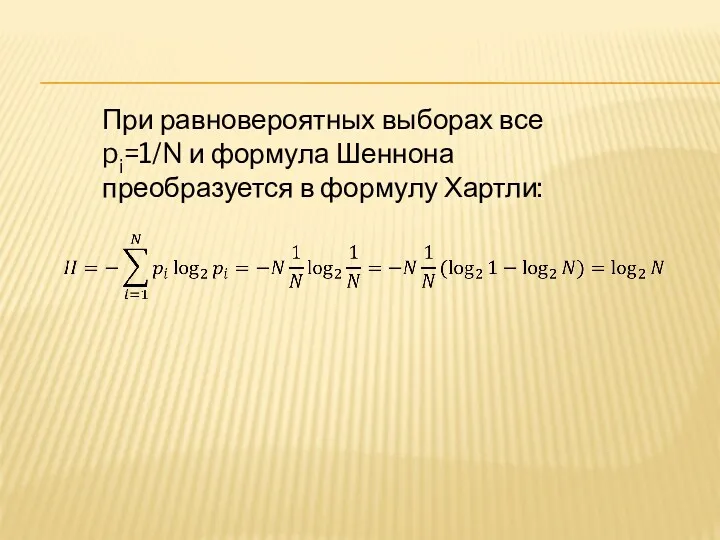

- 25. При равновероятных выборах все pi=1/N и формула Шеннона преобразуется в формулу Хартли:

- 26. 2. МЕРЫ ИНФОРМАЦИИ 2.2. МЕРЫ ИНФОРМАЦИИ СЕМАНТИЧЕСКОГО УРОВНЯ Под семантической информацией понимают смысловое содержание, извлекаемое получателем

- 28. Тезаурус – в широком смысле - совокупность сведений, которыми располагает пользователь (система), в более узком –

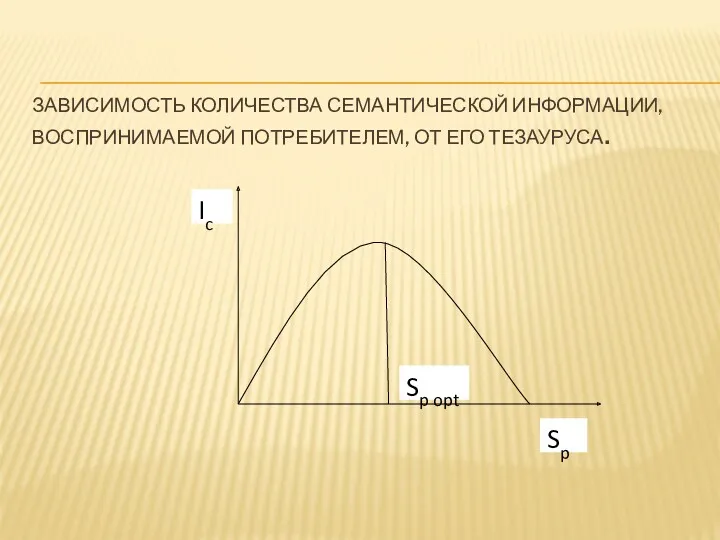

- 29. ЗАВИСИМОСТЬ КОЛИЧЕСТВА СЕМАНТИЧЕСКОЙ ИНФОРМАЦИИ, ВОСПРИНИМАЕМОЙ ПОТРЕБИТЕЛЕМ, ОТ ЕГО ТЕЗАУРУСА.

- 30. Количество семантической информации Ic, извлекаемой получателем из поступающих сообщений и включаемой им в дальнейший свой тезаурус,

- 31. Максимальное количество семантической информации, содержащейся в сообщении, является величиной относительной. Однако одно и то же сообщение

- 32. Относительной мерой количества семантической информации может служить коэффициент содержательности С, который определяется как отношение количества семантической

- 33. 2. МЕРЫ ИНФОРМАЦИИ 2.3. МЕРЫ ИНФОРМАЦИИ ПРАГМАТИЧЕСКОГО УРОВНЯ Эта мера определяет полезность информации (ценность) для достижения

- 34. Одним из первых российских ученых к проблеме оценки информации прагматического уровня обратился Харкевич А.А., который предложил

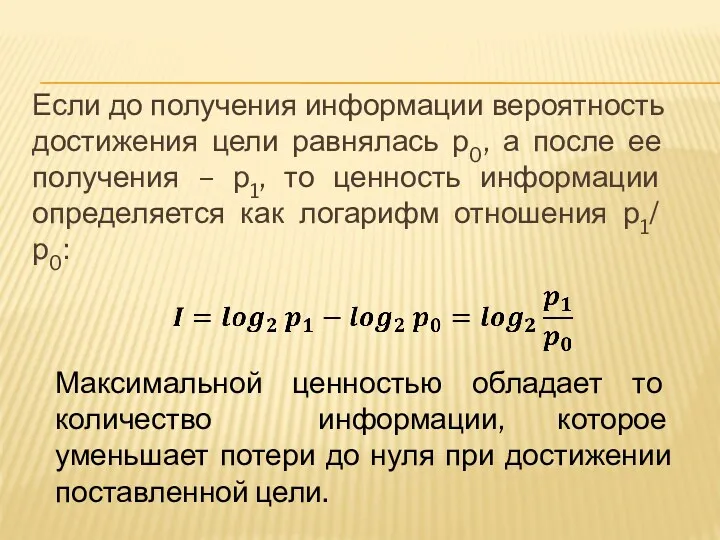

- 35. Если до получения информации вероятность достижения цели равнялась р0, а после ее получения – р1, то

- 38. Скачать презентацию

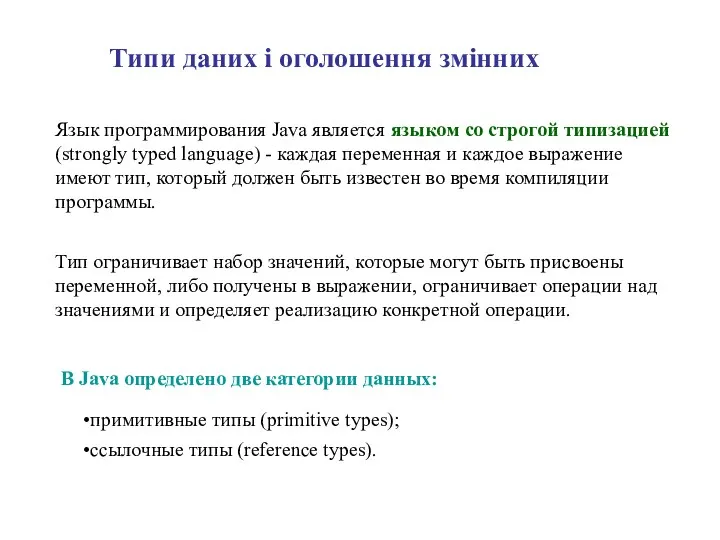

Типи даних і оголошення змінних

Типи даних і оголошення змінних Модули fw Bootstrap, и их предназначение. (Тема 14)

Модули fw Bootstrap, и их предназначение. (Тема 14) Мультимедиа технологии. Назначение мультимедиа-продуктов и области их применения

Мультимедиа технологии. Назначение мультимедиа-продуктов и области их применения Моделирование случайных величин (лекция 4)

Моделирование случайных величин (лекция 4) Welcome to CAD/CAM services

Welcome to CAD/CAM services Презентация по теме Информация

Презентация по теме Информация Подготовка электронных документов

Подготовка электронных документов Циклический алгоритм (для 6 класса)

Циклический алгоритм (для 6 класса) Символы и строки в Pascal

Символы и строки в Pascal Проблемы виртуального общения

Проблемы виртуального общения Автоматизированные системы обработки информации

Автоматизированные системы обработки информации Using Modern Day AI to Solve Traditional Farming Problems

Using Modern Day AI to Solve Traditional Farming Problems Социальные сети

Социальные сети Методология информационного моделирования IDEF1X. Лекции 2.2

Методология информационного моделирования IDEF1X. Лекции 2.2 Презентация внеклассного мероприятия Своя игра

Презентация внеклассного мероприятия Своя игра Самооптимизирующееся производство. Искусственный интеллект. Ожидания и актуальное состояние

Самооптимизирующееся производство. Искусственный интеллект. Ожидания и актуальное состояние Свойства алгоритма, способы описания

Свойства алгоритма, способы описания Характерные черты информационного общества

Характерные черты информационного общества Использование MS Office для автоматизации профессиональной деятельности. Microsoft Word. Microsoft Office XP. ч.1

Использование MS Office для автоматизации профессиональной деятельности. Microsoft Word. Microsoft Office XP. ч.1 Строки.Строковые массивы

Строки.Строковые массивы Программное обеспечение ПК

Программное обеспечение ПК Презентация по информатике 5 класс Виды представления информации.

Презентация по информатике 5 класс Виды представления информации. Компьютерные презентации. Мультимедиа

Компьютерные презентации. Мультимедиа Жесткий диск

Жесткий диск Проектирование АСУ. Комплекс подсистем технической подготовки производства

Проектирование АСУ. Комплекс подсистем технической подготовки производства Влияние компьютера на здоровье школьников

Влияние компьютера на здоровье школьников Риски сбоя в КС. Определения. Переключательный процесс. Гонки по входу. Статические, динамические и функциональные риски сбоя

Риски сбоя в КС. Определения. Переключательный процесс. Гонки по входу. Статические, динамические и функциональные риски сбоя Как нарисовать бейджик в программе ПервоЛого 6.0. Первый урок. Диск

Как нарисовать бейджик в программе ПервоЛого 6.0. Первый урок. Диск