Содержание

- 2. Если для решения задач классификации применять нейронные сети, то необходимо формализовать задачу. Выберем в качестве входных

- 3. Сеть Кохонена Каждый выход можно будет трактовать как вероятность того, что объект принадлежит данному классу. Все

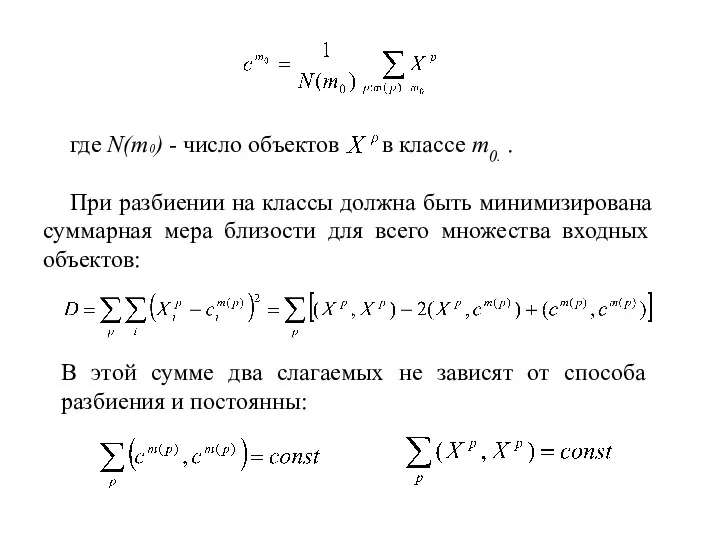

- 4. где N(m0) - число объектов в классе m0. . При разбиении на классы должна быть минимизирована

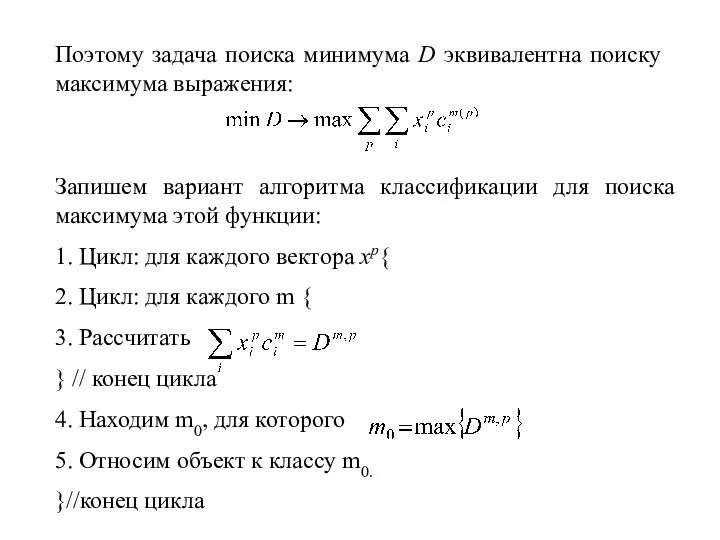

- 5. Поэтому задача поиска минимума D эквивалентна поиску максимума выражения: Запишем вариант алгоритма классификации для поиска максимума

- 6. Данный алгоритм легко реализуется в виде нейронной сети. Для этого требуется M сумматоров, находящих все ,

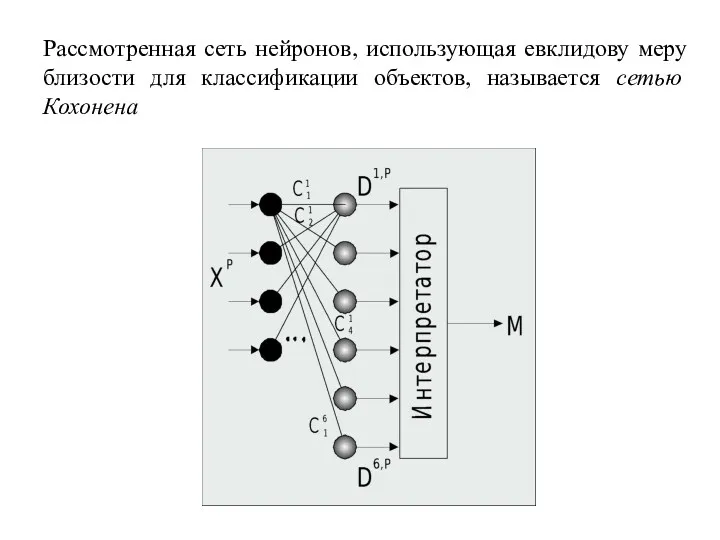

- 7. Рассмотренная сеть нейронов, использующая евклидову меру близости для классификации объектов, называется сетью Кохонена

- 8. Нейроны слоя Кохонена генерируют сигналы . Интерпретатор выбирает максимальный сигнал слоя Кохонена и выдает номер класса

- 9. Входные вектора сети Кохонена чаще всего нормируются: или Обучение слоя Кохонена Задача обучения — научить сеть

- 10. В тех областях, где входных векторов много, плотность ядер окажется недостаточной, и непохожие объекты будут активировать

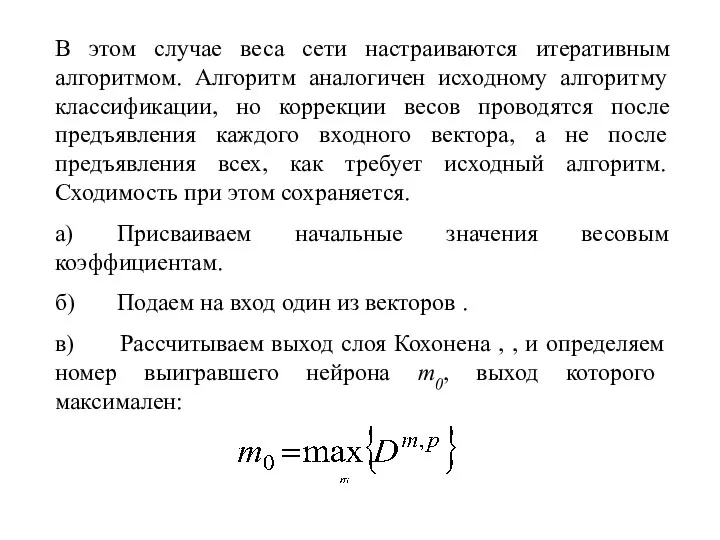

- 11. В этом случае веса сети настраиваются итеративным алгоритмом. Алгоритм аналогичен исходному алгоритму классификации, но коррекции весов

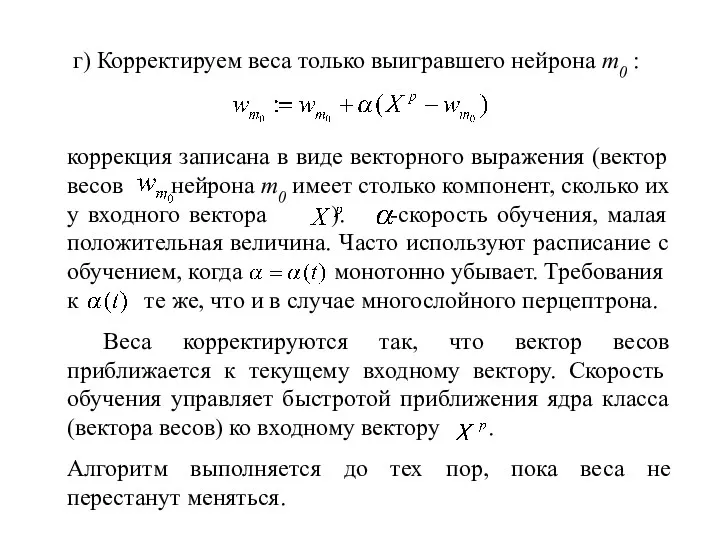

- 12. г) Корректируем веса только выигравшего нейрона m0 : коррекция записана в виде векторного выражения (вектор весов

- 13. Метод выпуклой комбинации Этот метод полезен при обучении, чтобы правильно распределить плотность ядер классов (векторов весов)

- 14. В начале обучения = 0 и все обучающие вектора одинаковы и равны начальному значению весов. По

- 15. Модификации алгоритма обучения сети Кохонена 1. Чувство справедливости: чтобы не допустить отсутствие обучения по любому из

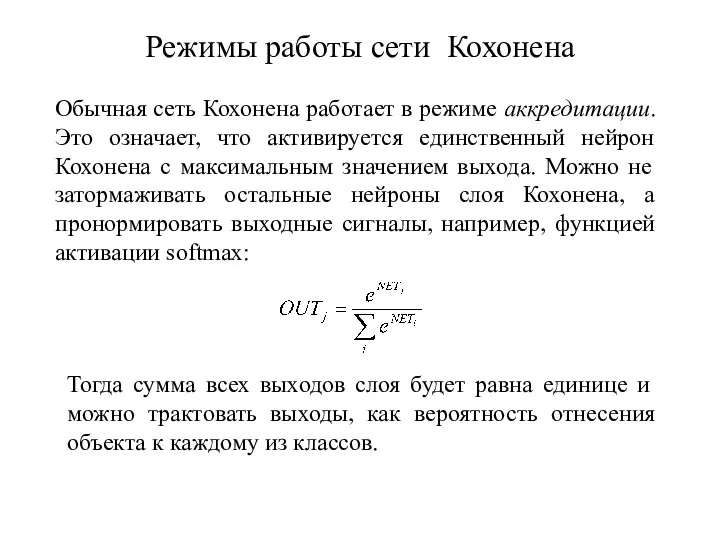

- 16. Режимы работы сети Кохонена Обычная сеть Кохонена работает в режиме аккредитации. Это означает, что активируется единственный

- 18. Скачать презентацию

Групповая разработка телеграм-бота Помощник в поиске тренера по бегу

Групповая разработка телеграм-бота Помощник в поиске тренера по бегу Programming Logic and Design Seventh Edition

Programming Logic and Design Seventh Edition Опасности в интернете. 5 класс

Опасности в интернете. 5 класс Создание элементов управления

Создание элементов управления Логическая и физическая организация БД. Нормальные формы, свойства нормальных форм

Логическая и физическая организация БД. Нормальные формы, свойства нормальных форм Классификация операционных систем

Классификация операционных систем Трансформації видавничого процесу і продукту в умовах дигіталізації медіакомунікацій

Трансформації видавничого процесу і продукту в умовах дигіталізації медіакомунікацій Современные информационные технологии автоматизации офиса

Современные информационные технологии автоматизации офиса Файл и файловые системы

Файл и файловые системы Правила оформления библиографического аппарата в научных публикациях, курсовых работах и ВКР

Правила оформления библиографического аппарата в научных публикациях, курсовых работах и ВКР Сегменты информационного бизнеса

Сегменты информационного бизнеса Основные и дополнительные устройства компьютера

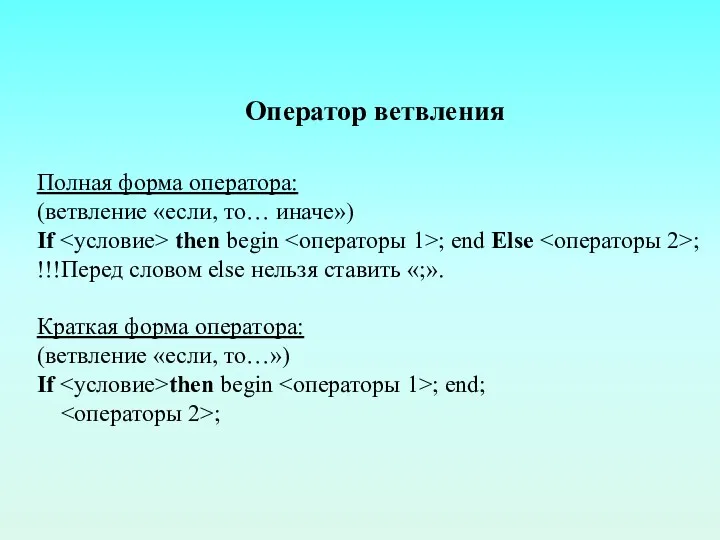

Основные и дополнительные устройства компьютера Условный алгоритм

Условный алгоритм Создание БД в MS Access

Создание БД в MS Access Программа Cocos

Программа Cocos Программирование на языке Python. Циклические алгоритмы

Программирование на языке Python. Циклические алгоритмы Появление термина Веб 2.0

Появление термина Веб 2.0 Конструкторы. Объектно - ориентированное программирование

Конструкторы. Объектно - ориентированное программирование Техническая система. Лекция 4

Техническая система. Лекция 4 Ветвление и циклы в КУМИРе

Ветвление и циклы в КУМИРе Безопасность серверной части веб-приложений. Часть 2. Урок 1. Методологии поиска уязвимостей

Безопасность серверной части веб-приложений. Часть 2. Урок 1. Методологии поиска уязвимостей Информационные ресурсы для научной работы

Информационные ресурсы для научной работы Защита информации

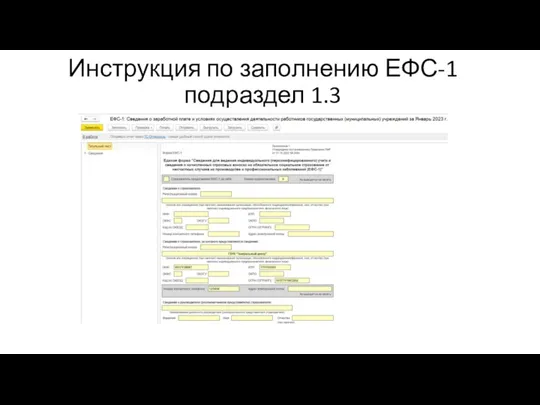

Защита информации Инструкция по заполнению ЕФС-1

Инструкция по заполнению ЕФС-1 Java. (Лекция 4)

Java. (Лекция 4) Информационные преступления и информационная безопасность

Информационные преступления и информационная безопасность Форматирование текста. Обработка текстовой информации. 7 класс

Форматирование текста. Обработка текстовой информации. 7 класс Тестирование ПО. Документирование результатов тестирования

Тестирование ПО. Документирование результатов тестирования