Содержание

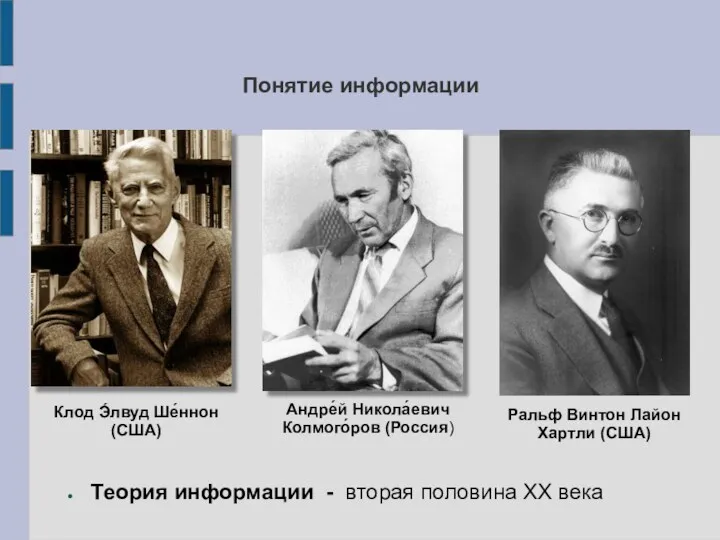

- 2. Понятие информации Теория информации - вторая половина XX века Клод Э́лвуд Ше́ннон (США) Андре́й Никола́евич Колмого́ров

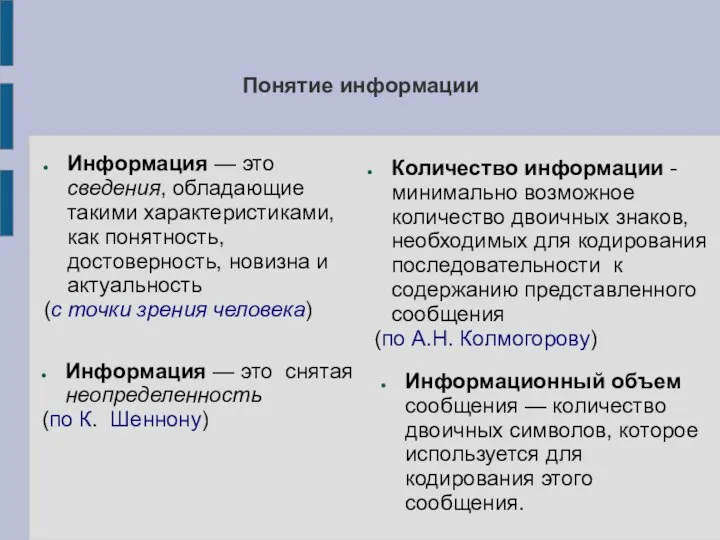

- 3. Понятие информации Информация — это сведения, обладающие такими характеристиками, как понятность, достоверность, новизна и актуальность (с

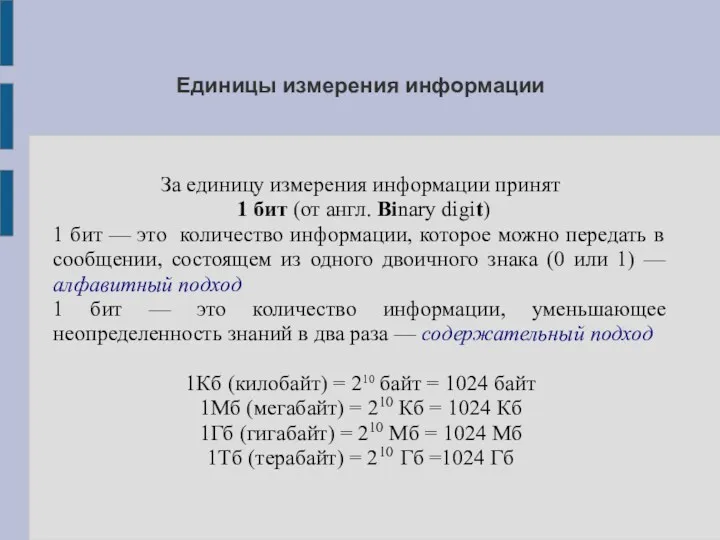

- 4. Единицы измерения информации За единицу измерения информации принят 1 бит (от англ. Binary digit) 1 бит

- 5. ВОПРОСЫ И ЗАДАНИЯ Расскажите, как вы понимаете термин «информация». Что общего и каковы различия между бытовым

- 6. Формула Хартли определения информации. Урок 2.

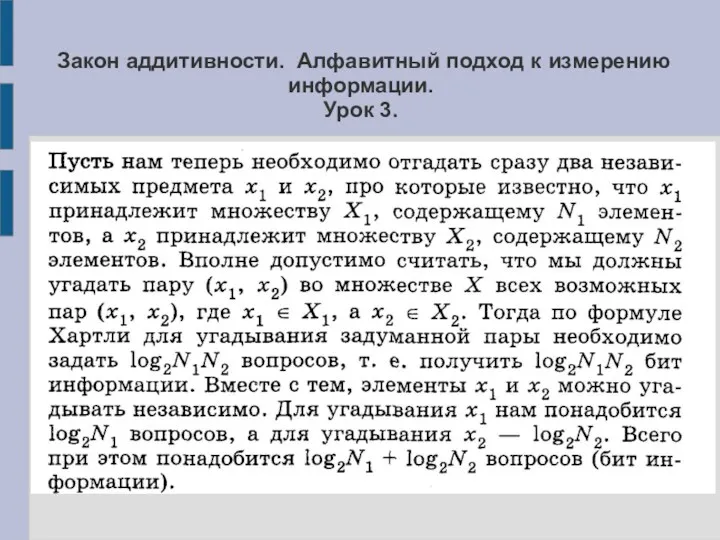

- 7. Закон аддитивности. Алфавитный подход к измерению информации. Урок 3.

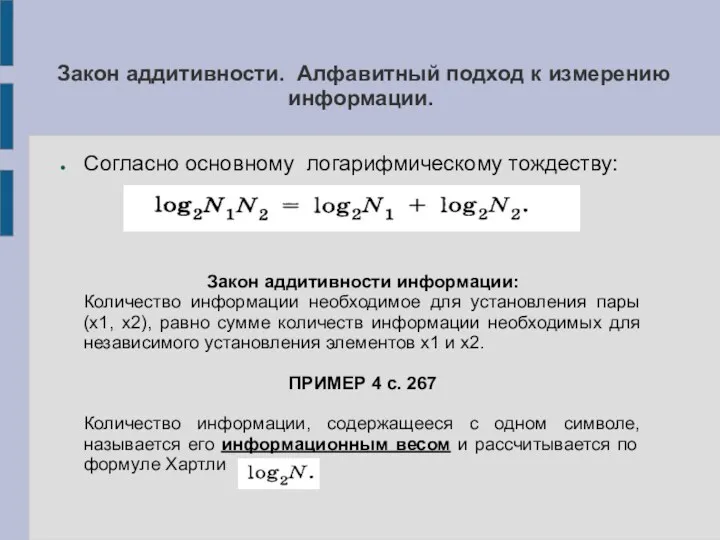

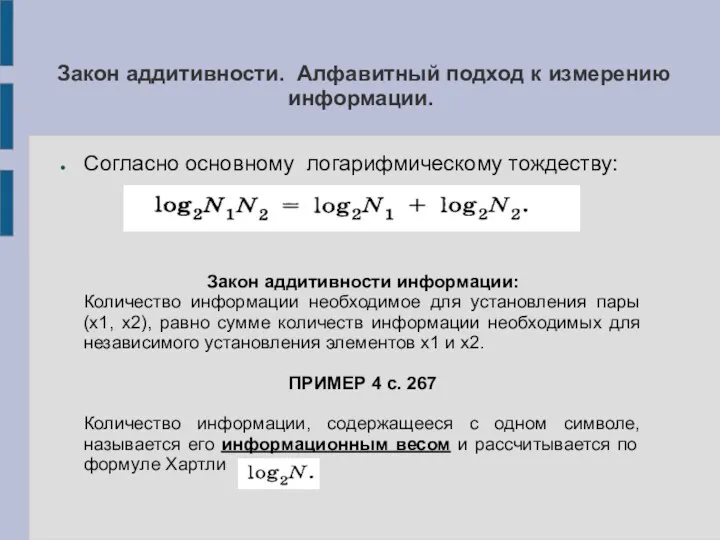

- 8. Закон аддитивности. Алфавитный подход к измерению информации. Согласно основному логарифмическому тождеству: Закон аддитивности информации: Количество информации

- 9. Закон аддитивности. Алфавитный подход к измерению информации. Согласно основному логарифмическому тождеству: Закон аддитивности информации: Количество информации

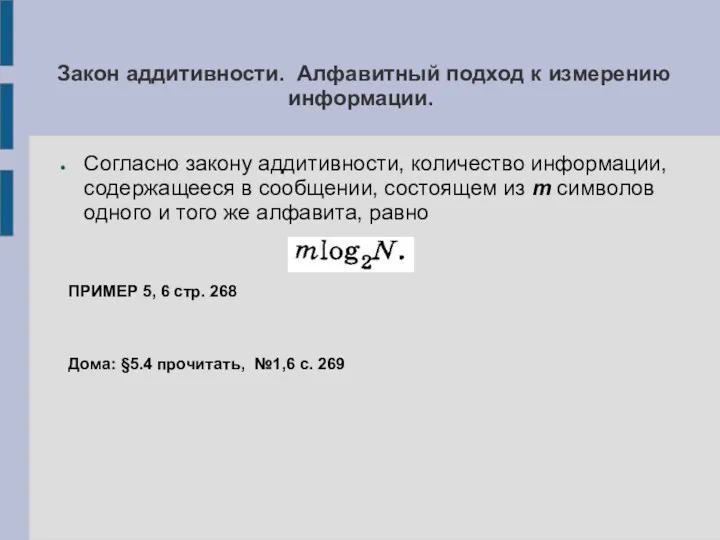

- 10. Закон аддитивности. Алфавитный подход к измерению информации. Согласно закону аддитивности, количество информации, содержащееся в сообщении, состоящем

- 11. Оптимальное кодирование информации и её сложность. Урок 7. ОСНОВЫ ТЕОРИИ ИНФОРМАЦИИ

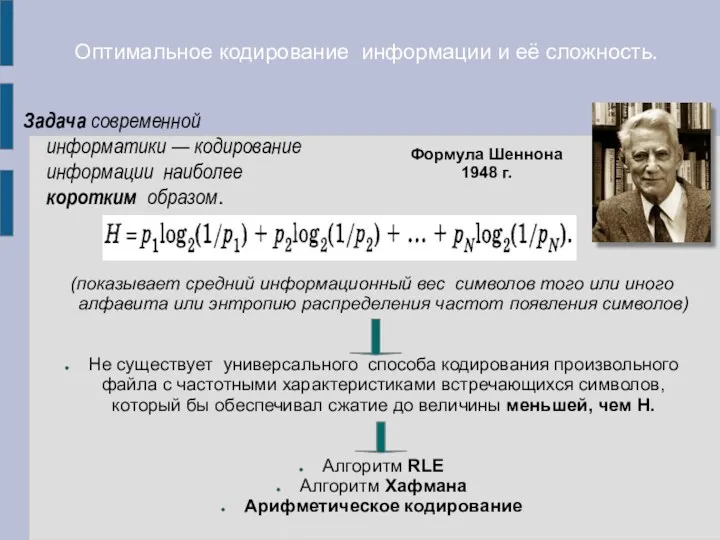

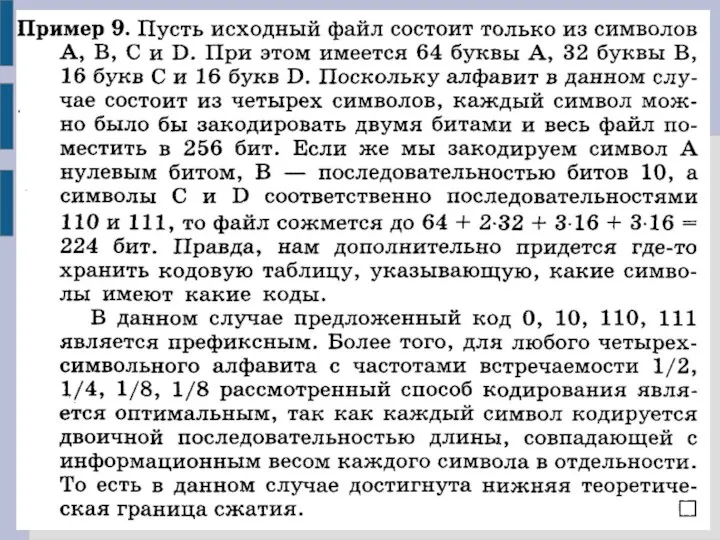

- 12. Оптимальное кодирование информации и её сложность. Задача современной информатики — кодирование информации наиболее коротким образом. (показывает

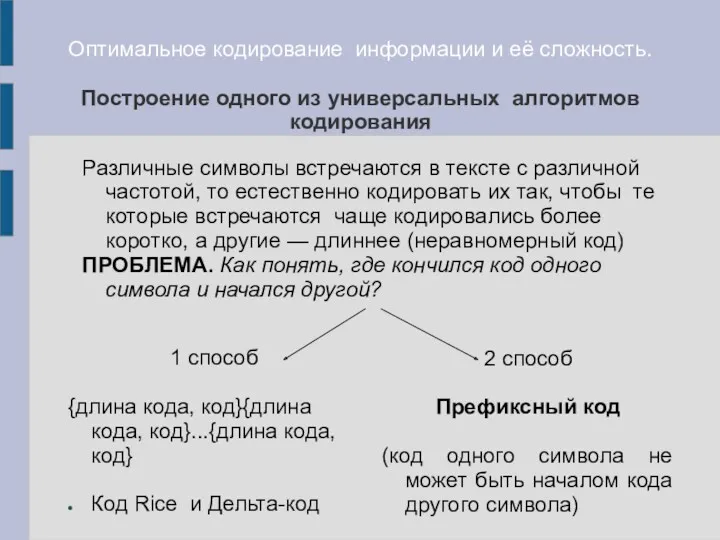

- 13. Оптимальное кодирование информации и её сложность. Построение одного из универсальных алгоритмов кодирования 1 способ {длина кода,

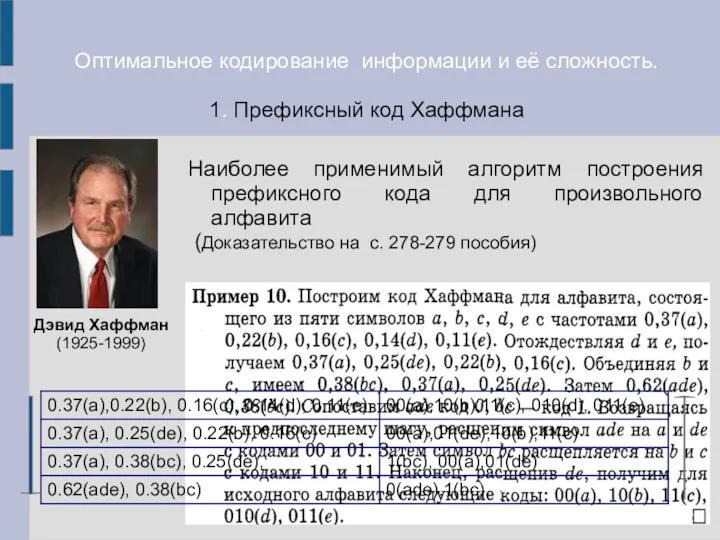

- 15. Оптимальное кодирование информации и её сложность. 1. Префиксный код Хаффмана Наиболее применимый алгоритм построения префиксного кода

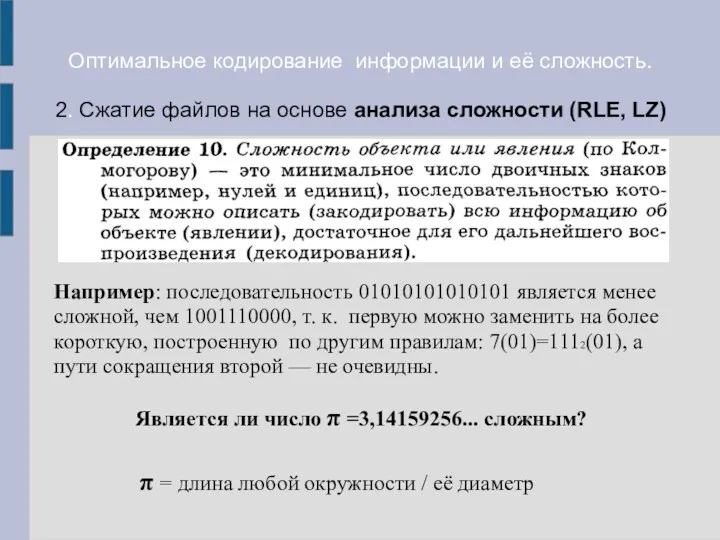

- 16. Оптимальное кодирование информации и её сложность. 2. Сжатие файлов на основе анализа сложности (RLE, LZ) Например:

- 18. Скачать презентацию

Интерактивная компьютерная графика. Часть 1-3 (растеризация)

Интерактивная компьютерная графика. Часть 1-3 (растеризация) Дослідження та проектування Mondex середовище

Дослідження та проектування Mondex середовище Типология СМИ

Типология СМИ Интернет-термины

Интернет-термины Передача информации. Схема передачи информации. Электронная почта

Передача информации. Схема передачи информации. Электронная почта Опасности в интернете. 5 класс

Опасности в интернете. 5 класс Основы программирования. Лабораторная работа №13

Основы программирования. Лабораторная работа №13 Обзор периодической печати для педагогов

Обзор периодической печати для педагогов Простейшие конструкции языка С

Простейшие конструкции языка С Системы управления химико-технологическими процессами (СУХТП)

Системы управления химико-технологическими процессами (СУХТП) Технология быстрого описания бизнес-процессов

Технология быстрого описания бизнес-процессов Разработка сети доступа с применением современного телекоммуникационного оборудования

Разработка сети доступа с применением современного телекоммуникационного оборудования Информационные процессы

Информационные процессы Пристрій керування

Пристрій керування R-язык и вычислительная среда для обработки информации современными статистическими методами

R-язык и вычислительная среда для обработки информации современными статистическими методами По основной программе профессионального обучения Оператор 1С

По основной программе профессионального обучения Оператор 1С Операції над об’єктами та групами об’єктів. Урок 4

Операції над об’єктами та групами об’єктів. Урок 4 Автоматизированные платежные системы. Электронный банкинг

Автоматизированные платежные системы. Электронный банкинг Особенности установки и настройки USB модема MF180

Особенности установки и настройки USB модема MF180 Мектеп сайтын жасау әдістемесі

Мектеп сайтын жасау әдістемесі Компьютер. Техника безопасности при работе с компьютером

Компьютер. Техника безопасности при работе с компьютером Комментарии для дизайнеров

Комментарии для дизайнеров Основы работы с Power Point. Cоздание слайдов

Основы работы с Power Point. Cоздание слайдов Cascading Style Sheets. Веб. CSS. п.9. Лекція 2

Cascading Style Sheets. Веб. CSS. п.9. Лекція 2 Технологии программирования. Индексирование: понятие индекса, типы индексных файлов. Создание, активация и удаление индекса

Технологии программирования. Индексирование: понятие индекса, типы индексных файлов. Создание, активация и удаление индекса Суперскалярные микропроцессоры

Суперскалярные микропроцессоры Интеллектуальная игра “Хакеры”

Интеллектуальная игра “Хакеры” Світові тенденції розвитку засобів телекомунікації та їх стан в Україні

Світові тенденції розвитку засобів телекомунікації та їх стан в Україні