Содержание

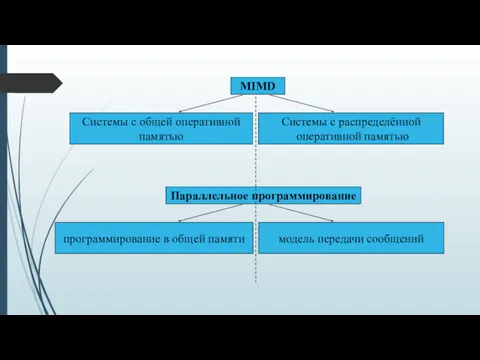

- 2. MIMD Системы с общей оперативной памятью Системы с распределённой оперативной памятью Параллельное программирование программирование в общей

- 3. Программирование в общей памяти Данные … Поток 0 Поток 1 Поток N-1 Параллельное приложение состоит из

- 4. Польза Упрощение программы за счёт вынесения механизмов чередования выполнения различных слабо взаимосвязанных подзадач, требующих одновременного выполнения,

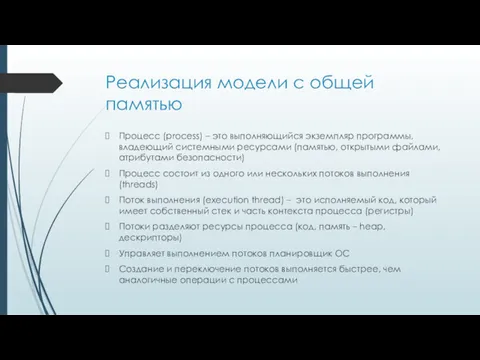

- 5. Реализация модели с общей памятью Процесс (process) – это выполняющийся экземпляр программы, владеющий системными ресурсами (памятью,

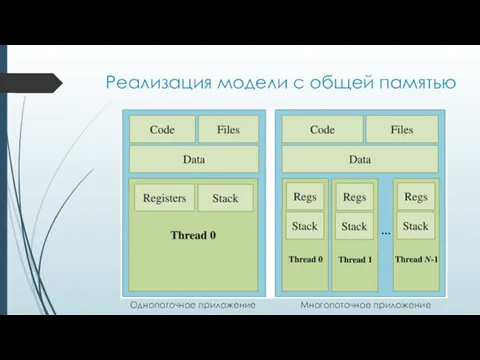

- 6. Реализация модели с общей памятью Однопоточное приложение Многопоточное приложение

- 7. Проблемы Необходимость синхронизации доступа к общим данным Гонки потоков (Data Race) – конкуренция за обращение к

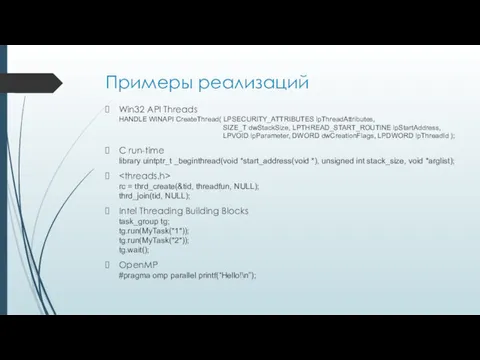

- 8. Примеры реализаций Win32 API Threads HANDLE WINAPI CreateThread( LPSECURITY_ATTRIBUTES lpThreadAttributes, SIZE_T dwStackSize, LPTHREAD_START_ROUTINE lpStartAddress, LPVOID lpParameter,

- 9. Модель передачи сообщений Процесс 0 Процесс 1 Процесс N-1 Параллельное приложение состоит из нескольких процессов, выполняющихся

- 10. Польза Независимость от архитектуры Отсутствие проблем с синхронизацией

- 11. Реализация модели передачи сообщений Процессы могут связываться только через посредника – операционную систему При необходимости в

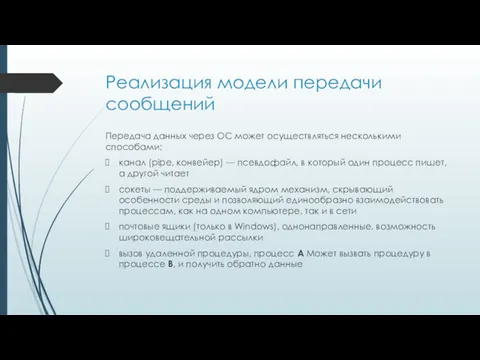

- 12. Реализация модели передачи сообщений Передача данных через ОС может осуществляться несколькими способами: канал (pipe, конвейер) —

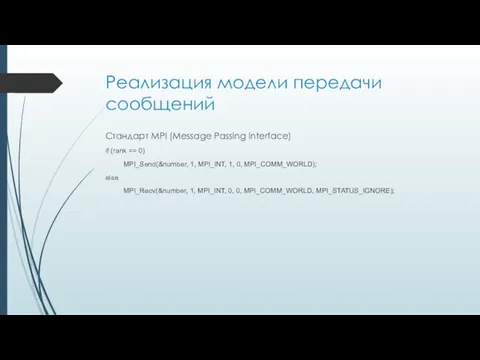

- 13. Реализация модели передачи сообщений Стандарт MPI (Message Passing Interface) if (rank == 0) MPI_Send(&number, 1, MPI_INT,

- 15. Скачать презентацию

Кіберзлочинність

Кіберзлочинність Качество программного обеспечения

Качество программного обеспечения Основные компоненты Microsoft Outlook

Основные компоненты Microsoft Outlook Веб-страницы и веб-сайты (самый крупный) до (самый мелкий).Некоторые тэги имеют атрибуты, которые являются именами свойств и принимают определенные значения.ALIGN =“ center” – тип выравнивания заголовкаС помощью тега FONT можно зад

Веб-страницы и веб-сайты (самый крупный) до (самый мелкий).Некоторые тэги имеют атрибуты, которые являются именами свойств и принимают определенные значения.ALIGN =“ center” – тип выравнивания заголовкаС помощью тега FONT можно зад Sportarena. Сайт спортивных новостей

Sportarena. Сайт спортивных новостей Автоматизированный способ контроля доступа сотрудников к рабочим местам

Автоматизированный способ контроля доступа сотрудников к рабочим местам Енгізіү және тарату құрылғылары

Енгізіү және тарату құрылғылары Интеллектуальная игра Хакеры

Интеллектуальная игра Хакеры Алгоритмизация и программирование. Лекция 1

Алгоритмизация и программирование. Лекция 1 Символьные строки

Символьные строки Поняття моделі. Типи моделей

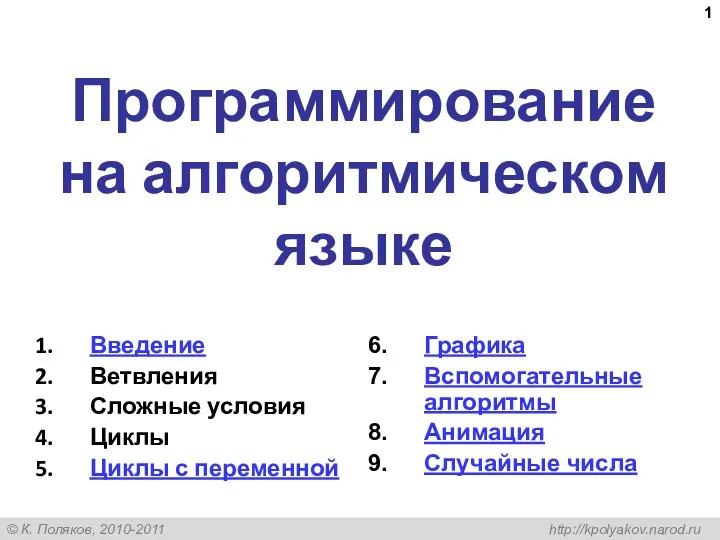

Поняття моделі. Типи моделей Программирование на алгоритмическом языке

Программирование на алгоритмическом языке Инженерия знаний. Лекция 1

Инженерия знаний. Лекция 1 Экспертные системы

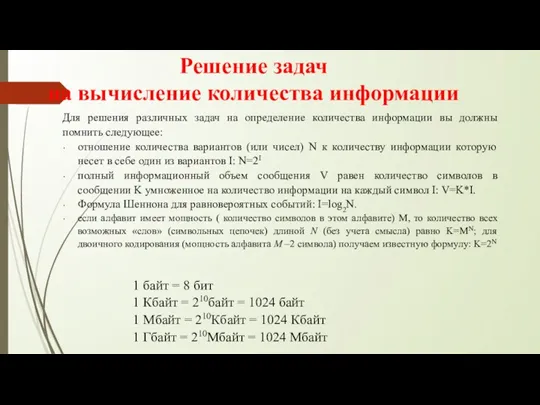

Экспертные системы Вычисление количества информации. Решение задач

Вычисление количества информации. Решение задач Процессор. Процесс обработки данных и управление этим процессом

Процессор. Процесс обработки данных и управление этим процессом Разработка детской настольной игры

Разработка детской настольной игры Технології створення лонгридів

Технології створення лонгридів Серверные операционные системы

Серверные операционные системы Инструкция по регистрации в мобильном приложении НПФ Будущее

Инструкция по регистрации в мобильном приложении НПФ Будущее Самозванец. Игра

Самозванец. Игра Microsoft official course. Creating methods, handling exceptions, and monitoring applications. (Module 2)

Microsoft official course. Creating methods, handling exceptions, and monitoring applications. (Module 2) Обработка информации

Обработка информации Java Generics. Лекция 4

Java Generics. Лекция 4 Интернет. Интернеттің шығу тарихы

Интернет. Интернеттің шығу тарихы Тезаурус Безопасный интернет

Тезаурус Безопасный интернет История возникновения чисел

История возникновения чисел История счета и систем счисления

История счета и систем счисления