Типы параллелизма

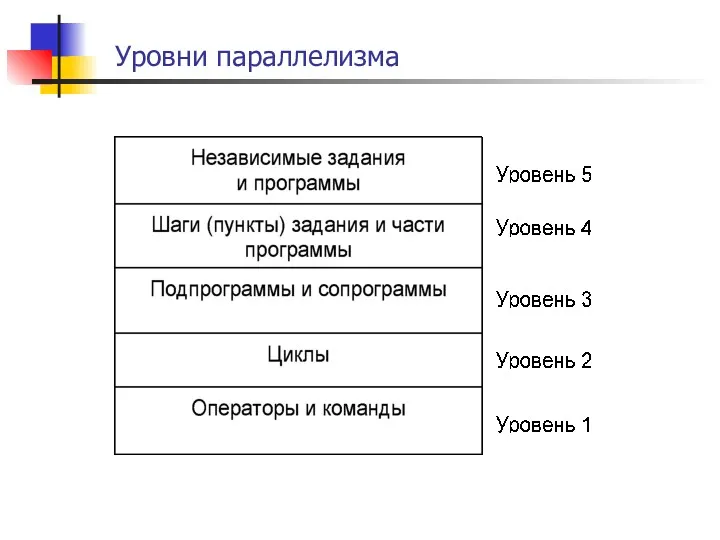

1. Естественный параллелизм независимых задач.

2. Параллелизм объектов или данных.

3. Параллелизм ветвей задачи или программы.

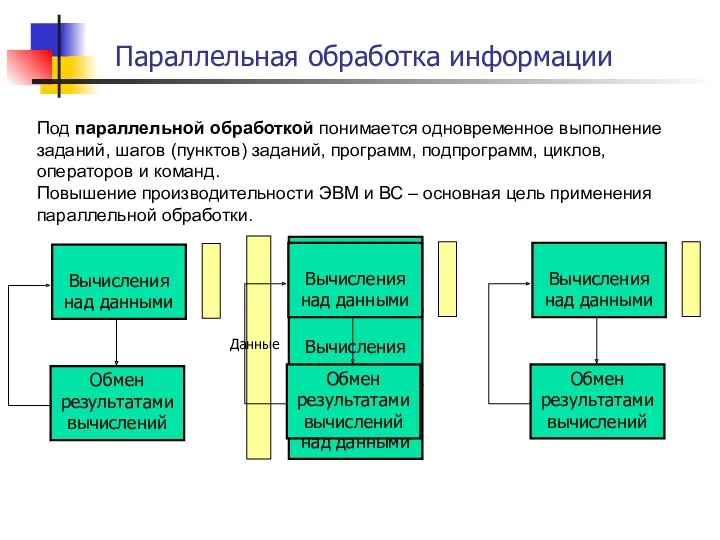

Существует два основных способа организации параллельной обработки:

· совмещение во времени этапов решения разных задач;

· одновременное решение различных задач или частей одной задачи:

Параллелизм ветвей задачи или программы заключается в том, что при решении одной задачи могут быть выделены отдельные ее части - ветви, которые при наличии нескольких обрабатывающих устройств могут выполняться параллельно. При этом одновременно могут обрабатываться только независимые ветви задачи, т.е. такие ее части, для которых соблюдаются следующие условия:

1) ни одна из выходных величин этих ветвей задачи не является входной величиной для другой такой ветви (отсутствие функциональных связей);

2) условия выполнения одной ветви не зависят от результатов или признаков, полученных при выполнении других ветвей (независимость по управлению).

Подготовка к ГИА. Задание 20.1

Подготовка к ГИА. Задание 20.1 Отладка в Visual Studio

Отладка в Visual Studio Строки. Массивы символов в C++. Обзор. (Занятие 8)

Строки. Массивы символов в C++. Обзор. (Занятие 8) Работа в СУБД PostgreSQL

Работа в СУБД PostgreSQL Информационная безопасность. Пассивный вид атаки

Информационная безопасность. Пассивный вид атаки Свойства алгоритмов, презентация, 9 класс

Свойства алгоритмов, презентация, 9 класс Внедрение процессного подхода

Внедрение процессного подхода Рекурсия. Описание подпрограмм

Рекурсия. Описание подпрограмм Динамические структуры данных. Односвязные и двусвязные списки

Динамические структуры данных. Односвязные и двусвязные списки Веб 2.0 у школі

Веб 2.0 у школі Арифметические действия в системах счисления

Арифметические действия в системах счисления Понятие ресурса в операционных системах

Понятие ресурса в операционных системах Архитектуры нейронных сетей. Введение

Архитектуры нейронных сетей. Введение Хмарні технології

Хмарні технології Государственная автоматизированная система Законотворчество

Государственная автоматизированная система Законотворчество Кодирование звуковой информации

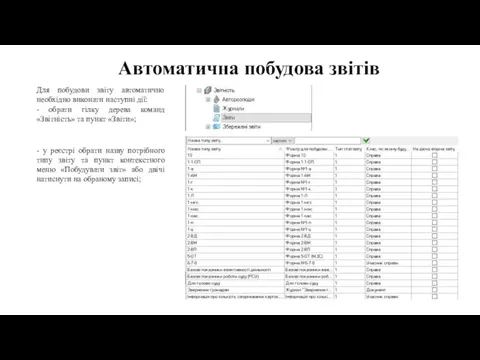

Кодирование звуковой информации Побудова звітів

Побудова звітів Опыт и перспективы работы педагогов дополнительного образования в дистанционном формате

Опыт и перспективы работы педагогов дополнительного образования в дистанционном формате Материал к уроку информатики в 5 классе: Управление компьютером с помощью мыши

Материал к уроку информатики в 5 классе: Управление компьютером с помощью мыши Язык программирования Pascal. Линейные алгоритмы

Язык программирования Pascal. Линейные алгоритмы Создание 3d-модели современного кабинета информатики

Создание 3d-модели современного кабинета информатики Разработка web-сайта для ООО Лидер

Разработка web-сайта для ООО Лидер Структура знаний и образовательных программ по информатике и компьютерным технологиям

Структура знаний и образовательных программ по информатике и компьютерным технологиям Алгоритми роботи з об'єктами та величинами

Алгоритми роботи з об'єктами та величинами Программирование на языке Паскаль (часть2)

Программирование на языке Паскаль (часть2) How to Sell Your Laptop for Cash Instantly – Sell MacBook Pro

How to Sell Your Laptop for Cash Instantly – Sell MacBook Pro Информация, Единицы измерения информации, Количество информации, Системы счисления

Информация, Единицы измерения информации, Количество информации, Системы счисления Створення таблиці

Створення таблиці