Содержание

- 2. MPI Стандарт MPI (MPI –Message Passing Interface). На кластере реализован OpenMPI. Это программная реализация стандарта интерфейса

- 3. MPI В рамках MPI (как и в случае OpenMP) принят более простой подход – разрабатывается одна

- 4. MPI Для организации информационного взаимодействия между процессорами в самом минимальном варианте достаточно операции приема и передачи

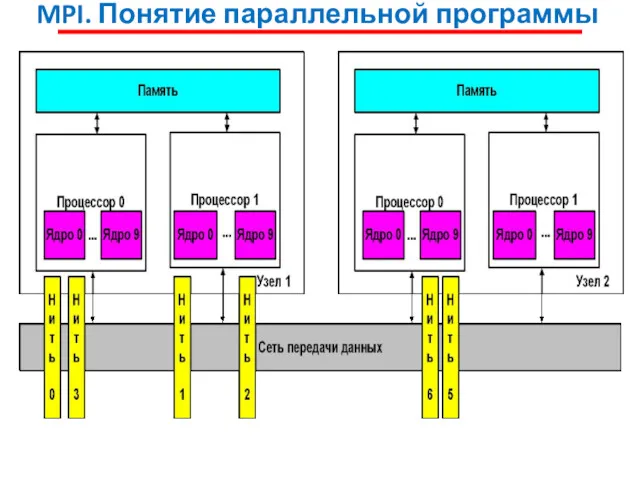

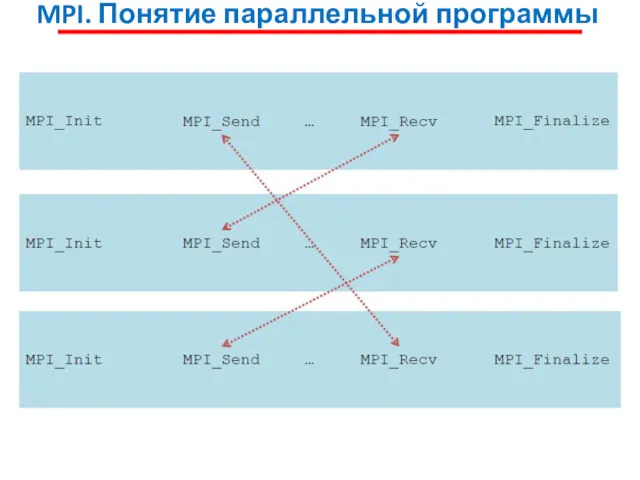

- 5. MPI. Понятие параллельной программы Под параллельной программой в рамках MPI понимается множество одновременно выполняемых процессов. Процессы

- 6. MPI. Понятие параллельной программы Исходный программный код для исполняемой программы разрабатывается на алгоритмических языках C или

- 7. MPI. Понятие параллельной программы

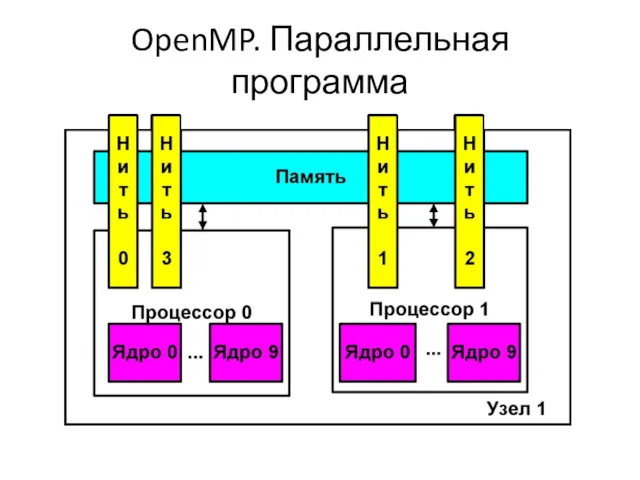

- 8. OpenMP. Параллельная программа

- 9. MPI. Операции передачи данных Основу MPI составляют операции передачи сообщений. Среди предусмотренных в составе MPI функций

- 10. MPI. Понятие коммуникаторов Процессы параллельной программы объединяются в группы. Под коммуникатором в MPI понимается специально создаваемый

- 11. MPI. Типы данных При выполнении операций передачи сообщений для указания передаваемых или получаемых данных в функциях

- 12. MPI. Инициализация и завершение MPI программ Первой вызываемой функцией MPI должна быть функция: int MPI_Init (

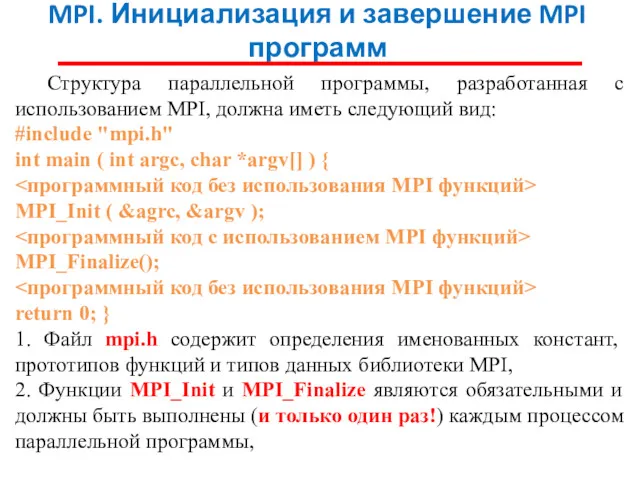

- 13. MPI. Инициализация и завершение MPI программ Структура параллельной программы, разработанная с использованием MPI, должна иметь следующий

- 14. MPI. Определение количества и ранга процессов Определение количества процессов в выполняемой параллельной программе осуществляется при помощи

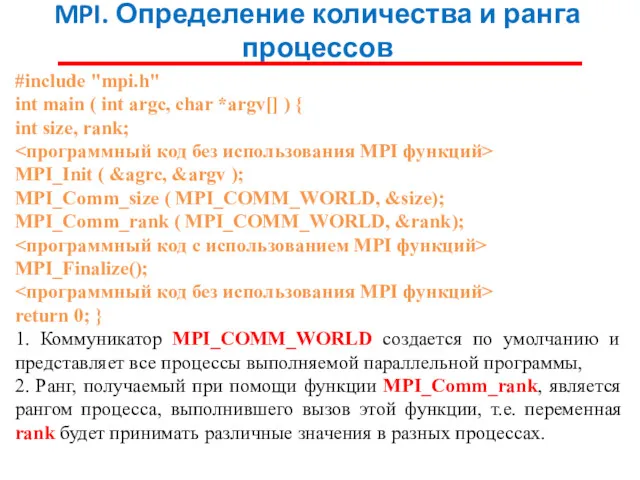

- 15. MPI. Определение количества и ранга процессов #include "mpi.h" int main ( int argc, char *argv[] )

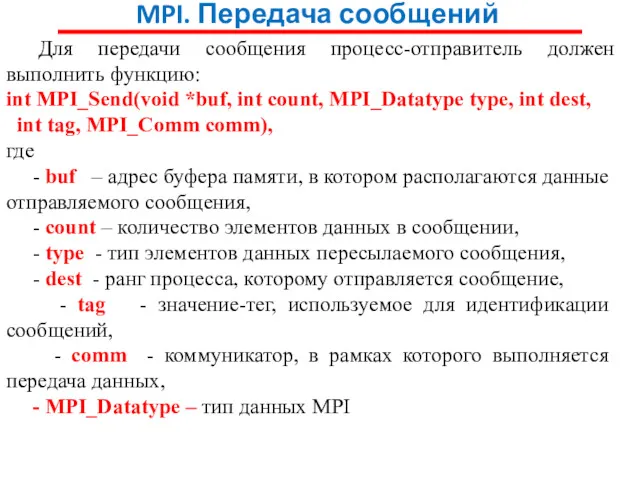

- 16. MPI. Передача сообщений Для передачи сообщения процесс-отправитель должен выполнить функцию: int MPI_Send(void *buf, int count, MPI_Datatype

- 17. MPI. Базовые типы данных

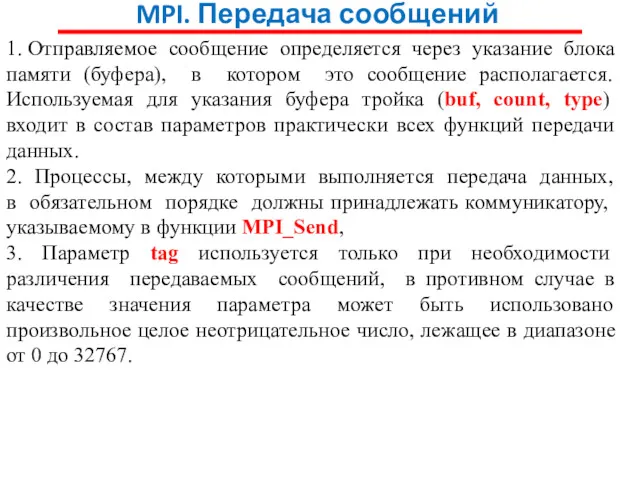

- 18. MPI. Передача сообщений 1. Отправляемое сообщение определяется через указание блока памяти (буфера), в котором это сообщение

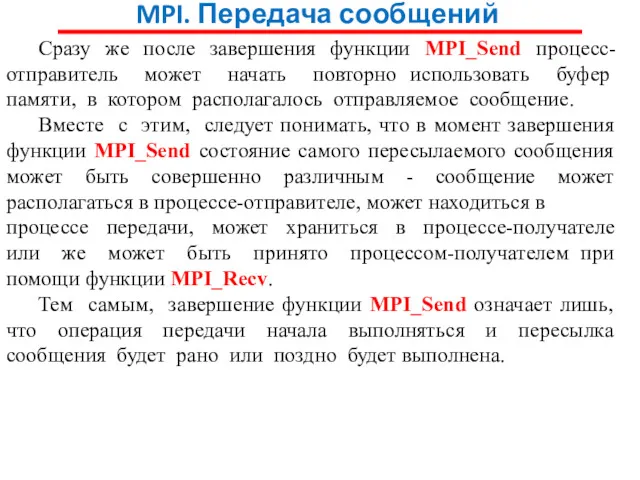

- 19. MPI. Передача сообщений Сразу же после завершения функции MPI_Send процесс-отправитель может начать повторно использовать буфер памяти,

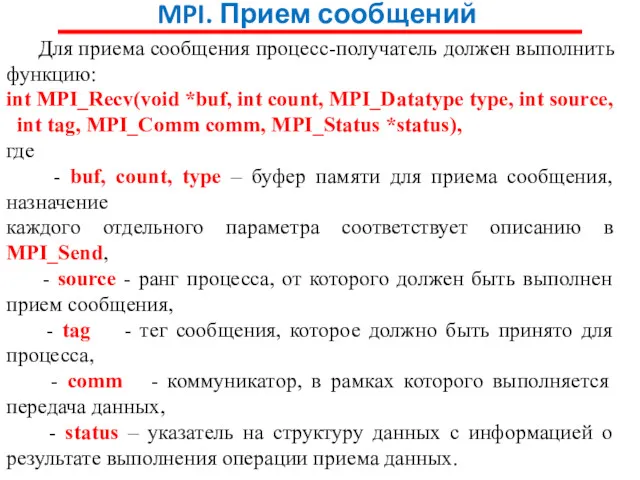

- 20. MPI. Прием сообщений Для приема сообщения процесс-получатель должен выполнить функцию: int MPI_Recv(void *buf, int count, MPI_Datatype

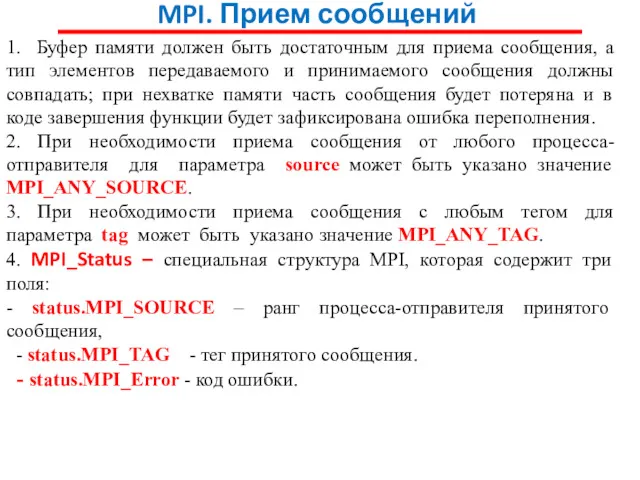

- 21. MPI. Прием сообщений 1. Буфер памяти должен быть достаточным для приема сообщения, а тип элементов передаваемого

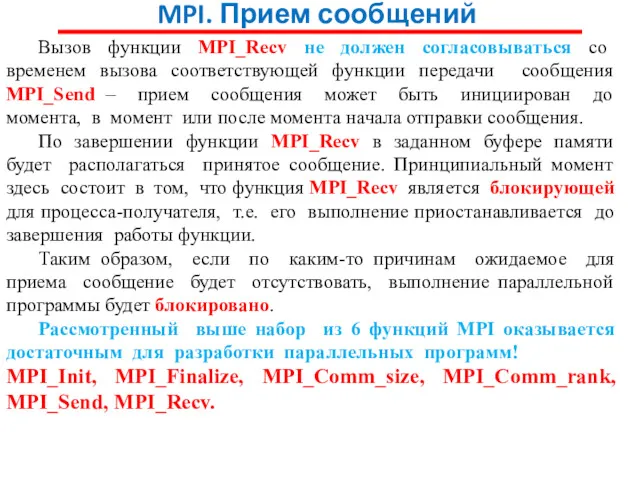

- 22. MPI. Прием сообщений Вызов функции MPI_Recv не должен согласовываться со временем вызова соответствующей функции передачи сообщения

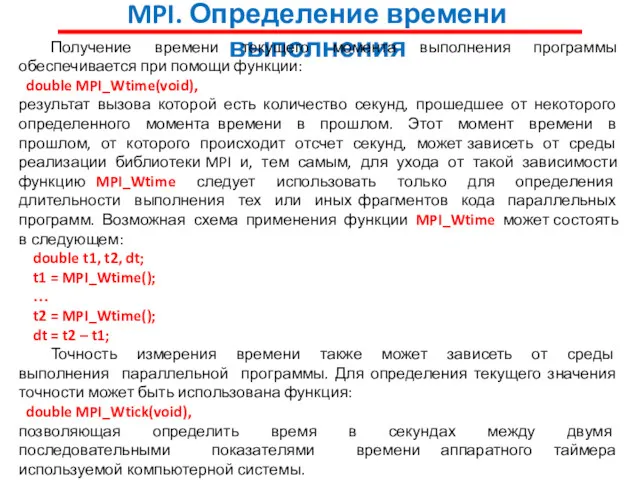

- 23. MPI. Определение времени выполнения Получение времени текущего момента выполнения программы обеспечивается при помощи функции: double MPI_Wtime(void),

- 24. MPI. Коллективные операции пересылки данных Для выполнения коммуникационных коллективных операций, в которых принимают участие все процессы

- 25. MPI. Передача данных от одного процесса всем процессам программы int MPI_Bcast (void *buf, int count, MPI_Datatype

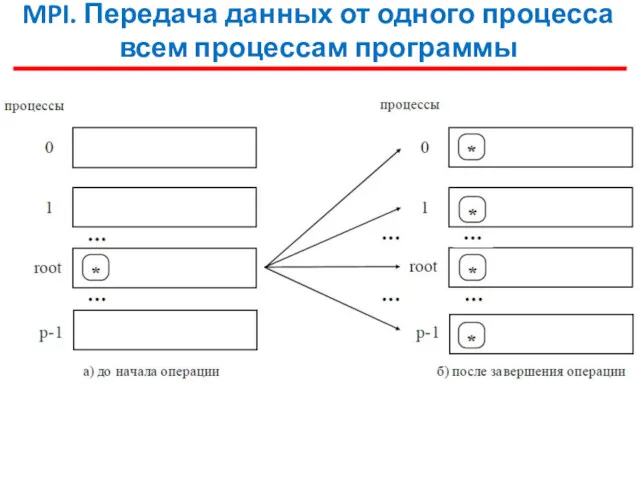

- 26. MPI. Передача данных от одного процесса всем процессам программы

- 27. MPI. Передача данных от одного процесса всем процессам программы Функция MPI_Bcast определяет коллективную операцию и, тем

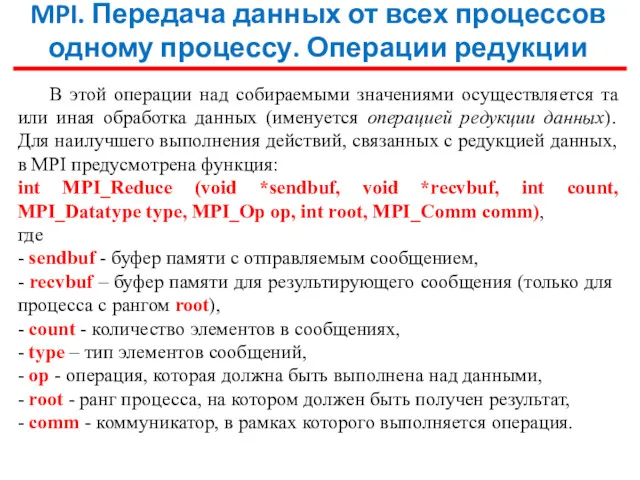

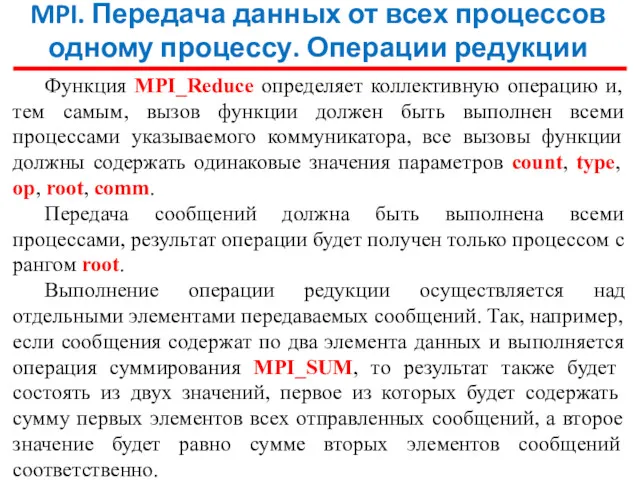

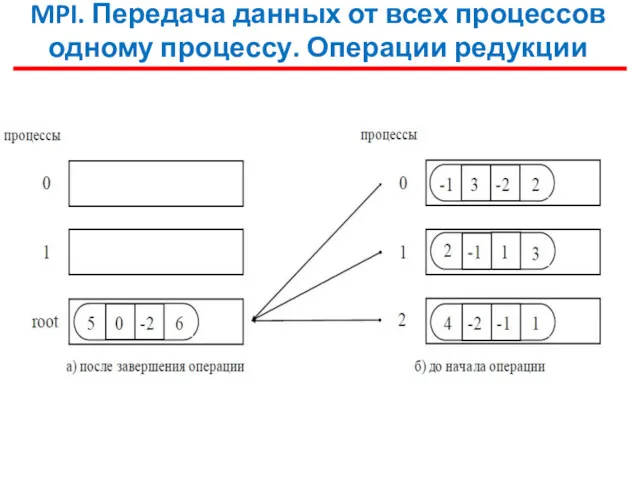

- 28. MPI. Передача данных от всех процессов одному процессу. Операции редукции В этой операции над собираемыми значениями

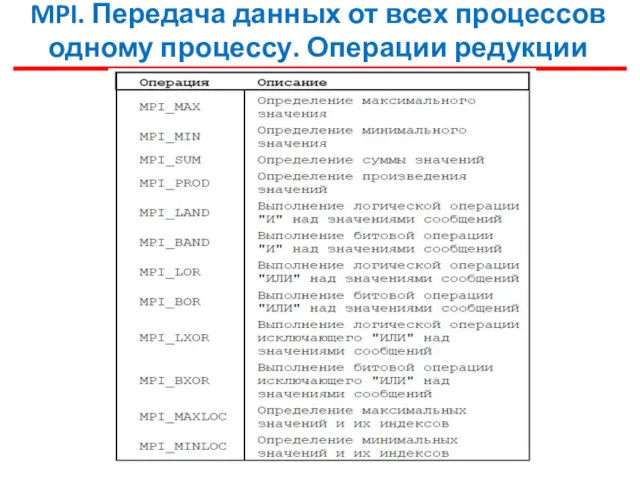

- 29. MPI. Передача данных от всех процессов одному процессу. Операции редукции

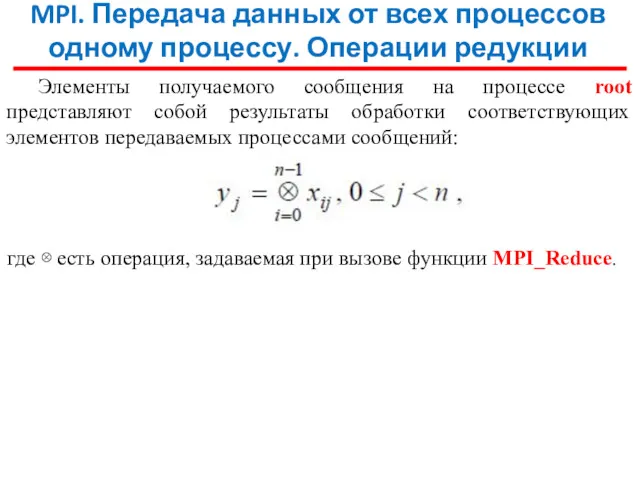

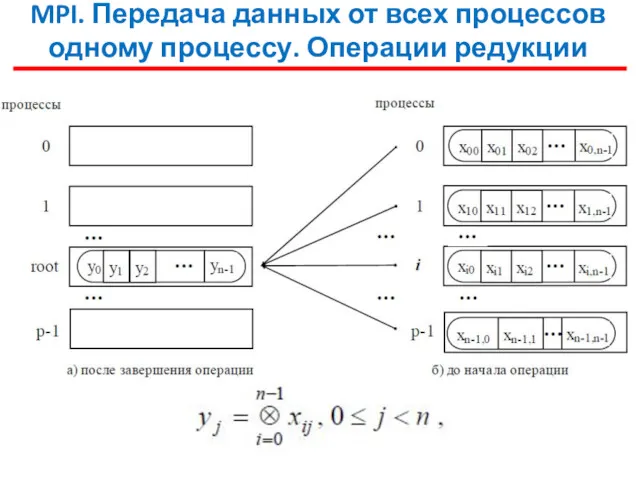

- 30. MPI. Передача данных от всех процессов одному процессу. Операции редукции Элементы получаемого сообщения на процессе root

- 31. MPI. Передача данных от всех процессов одному процессу. Операции редукции

- 32. MPI. Передача данных от всех процессов одному процессу. Операции редукции Функция MPI_Reduce определяет коллективную операцию и,

- 33. MPI. Передача данных от всех процессов одному процессу. Операции редукции

- 34. MPI. Понятие параллельной программы

- 35. MPI. Что осталось «за кадром»? Модификации обмена сообщениями точка-точка. Модификации коллективных обменов сообщениями. Работа с коммуникаторами,

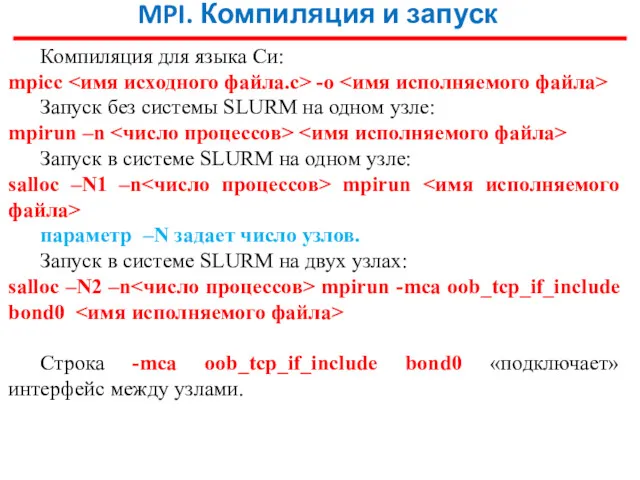

- 36. MPI. Компиляция и запуск Компиляция для языка Си: mpicc -o Запуск без системы SLURM на одном

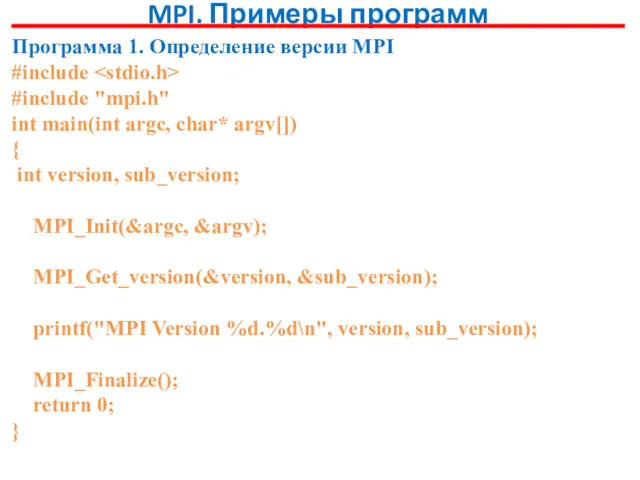

- 37. MPI. Примеры программ Программа 1. Определение версии MPI #include #include "mpi.h" int main(int argc, char* argv[])

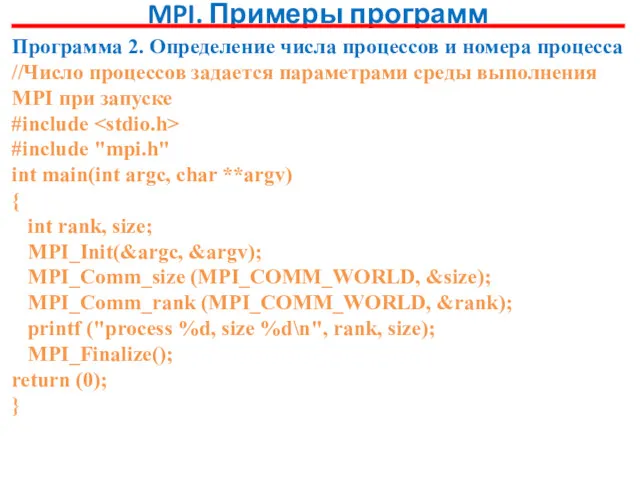

- 38. MPI. Примеры программ Программа 2. Определение числа процессов и номера процесса //Число процессов задается параметрами среды

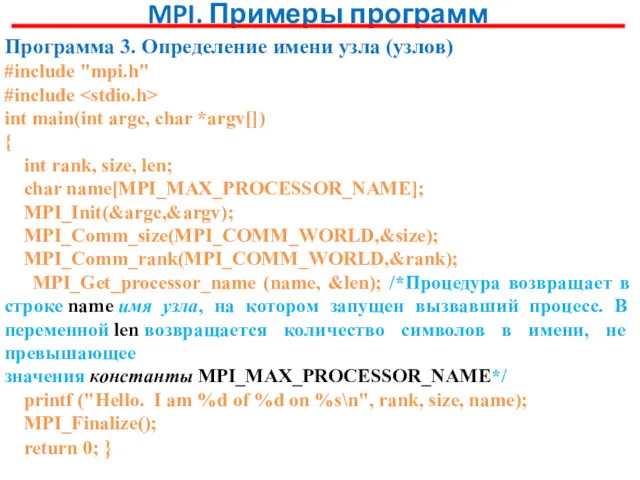

- 39. MPI. Примеры программ Программа 3. Определение имени узла (узлов) #include "mpi.h" #include int main(int argc, char

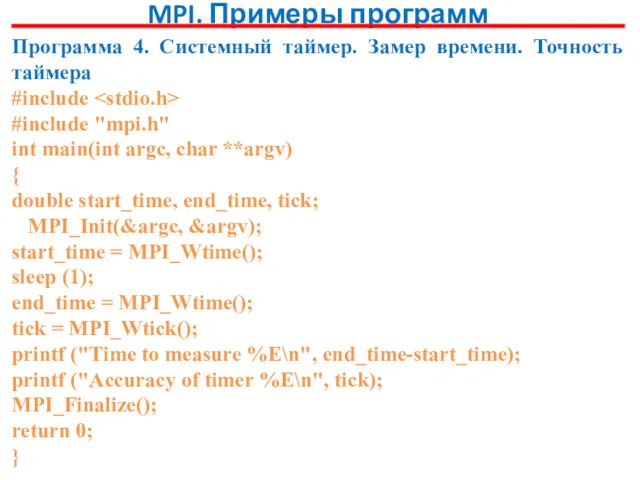

- 40. MPI. Примеры программ Программа 4. Системный таймер. Замер времени. Точность таймера #include #include "mpi.h" int main(int

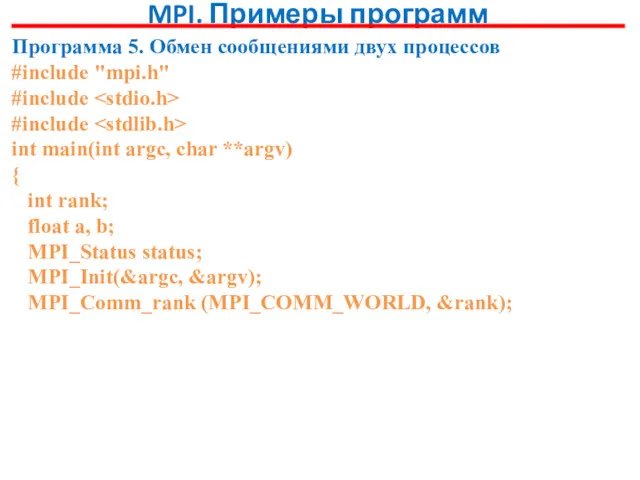

- 41. MPI. Примеры программ Программа 5. Обмен сообщениями двух процессов #include "mpi.h" #include #include int main(int argc,

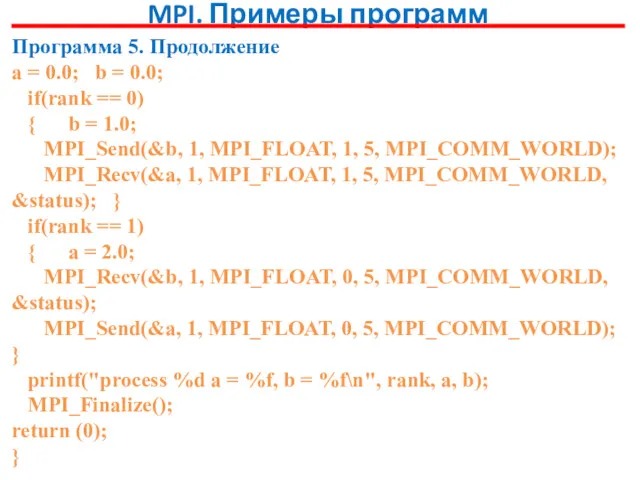

- 42. MPI. Примеры программ Программа 5. Продолжение a = 0.0; b = 0.0; if(rank == 0) {

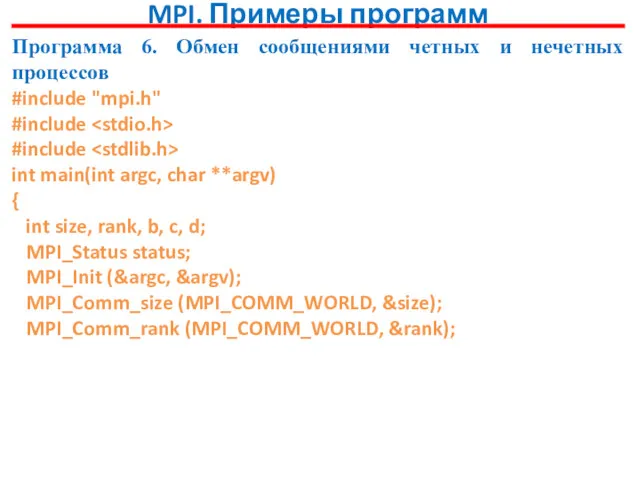

- 43. MPI. Примеры программ Программа 6. Обмен сообщениями четных и нечетных процессов #include "mpi.h" #include #include int

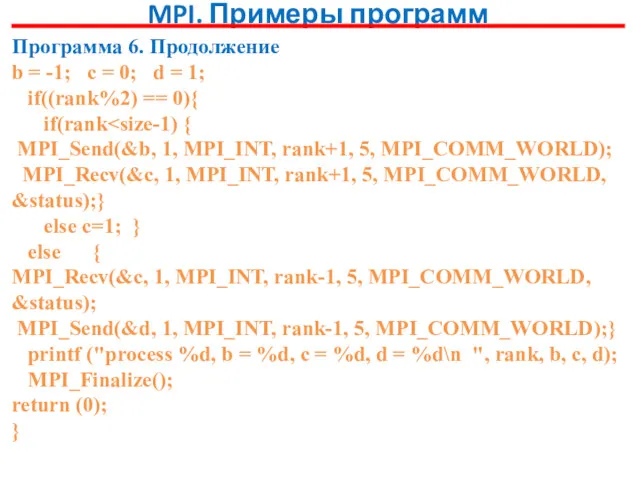

- 44. MPI. Примеры программ Программа 6. Продолжение b = -1; c = 0; d = 1; if((rank%2)

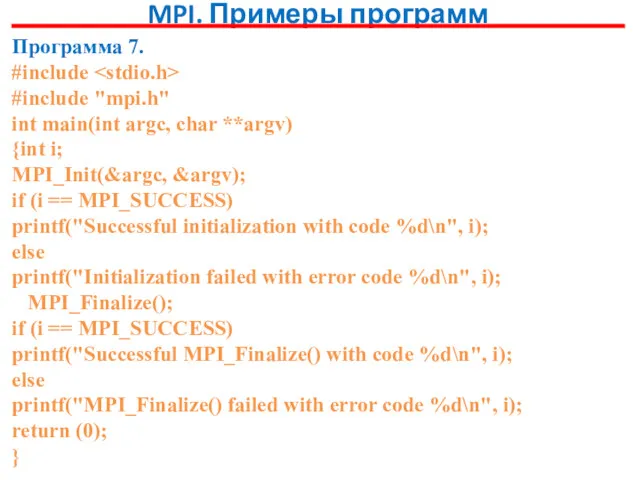

- 45. MPI. Примеры программ Программа 7. #include #include "mpi.h" int main(int argc, char **argv) {int i; MPI_Init(&argc,

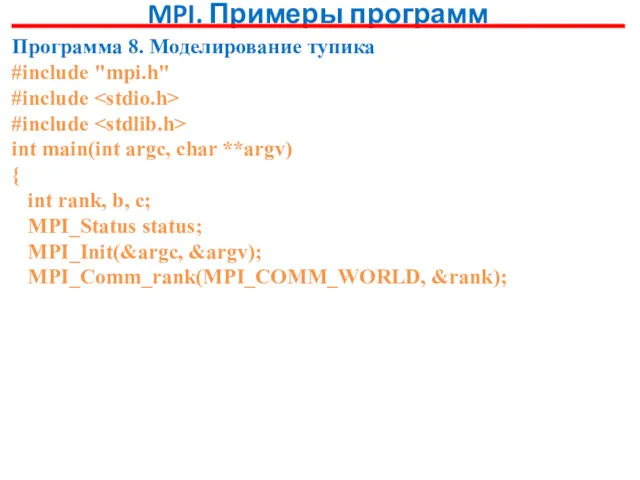

- 46. MPI. Примеры программ Программа 8. Моделирование тупика #include "mpi.h" #include #include int main(int argc, char **argv)

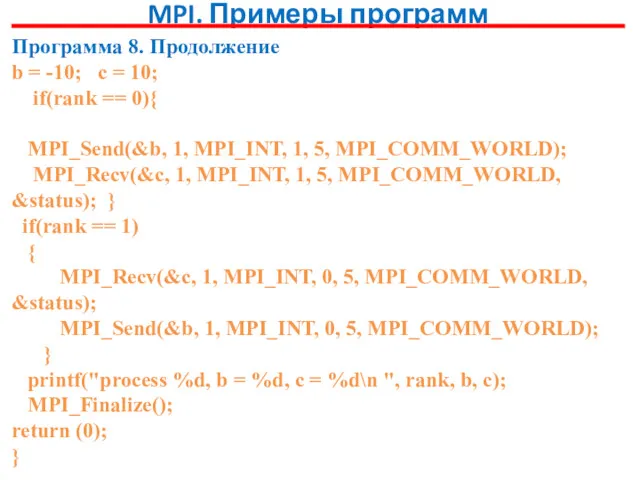

- 47. MPI. Примеры программ Программа 8. Продолжение b = -10; c = 10; if(rank == 0){ MPI_Send(&b,

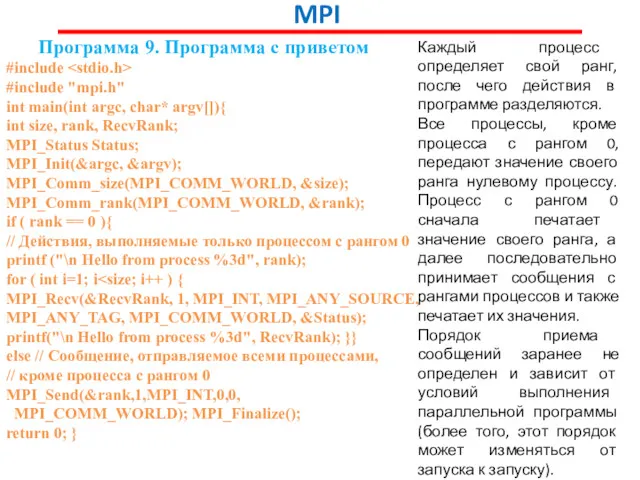

- 48. MPI Программа 9. Программа с приветом #include #include "mpi.h" int main(int argc, char* argv[]){ int size,

- 49. MPI Возможный вариант результатов печати процесса 0 может состоять в следующем (для параллельной программы из четырех

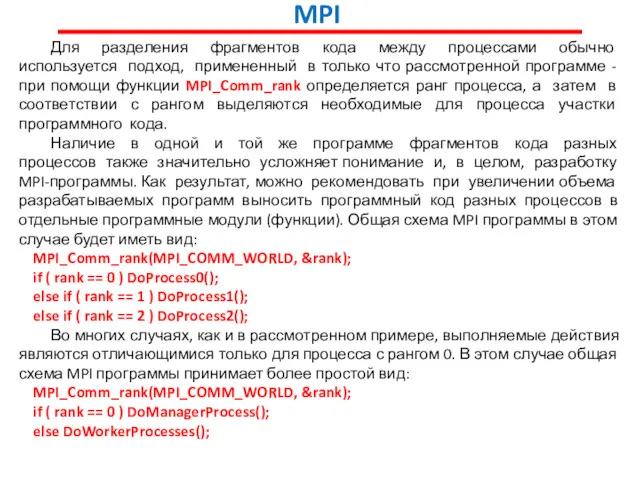

- 50. MPI Для разделения фрагментов кода между процессами обычно используется подход, примененный в только что рассмотренной программе

- 51. MPI и OpenMP Плюсы MPI - Переносимость для систем с общей и распределенной памятью - Масштабируемость

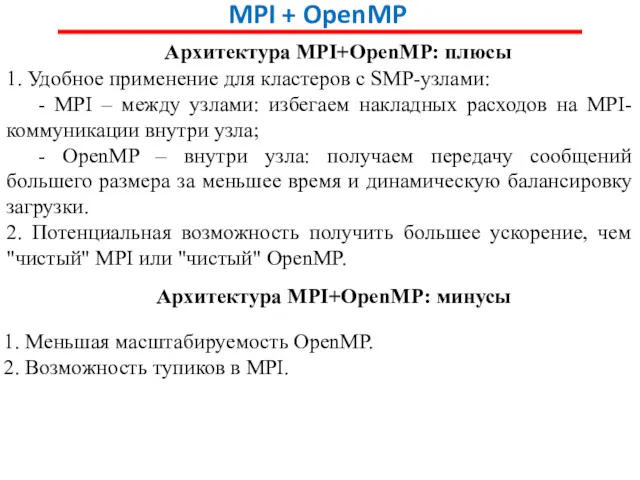

- 52. MPI + OpenMP Архитектура MPI+OpenMP: плюсы 1. Удобное применение для кластеров с SMP-узлами: - MPI –

- 54. Скачать презентацию

Information transfer

Information transfer Клавиатура

Клавиатура Основные понятия программирования

Основные понятия программирования Компьютерные словари и системы машинного перевода текстов

Компьютерные словари и системы машинного перевода текстов RN Videos Edits

RN Videos Edits Операционные системы. Основные понятия. Классификация ОС

Операционные системы. Основные понятия. Классификация ОС Создание экономики в играх

Создание экономики в играх Организация корпоративной сети предприятия

Организация корпоративной сети предприятия Правовые нормы, относящиеся к информации, правонарушения в информационной сфере, меры их предупреждения

Правовые нормы, относящиеся к информации, правонарушения в информационной сфере, меры их предупреждения Математическая логика. 9 класс

Математическая логика. 9 класс Производительность. Варианты увеличения производительности

Производительность. Варианты увеличения производительности Животные и их дети

Животные и их дети Тема урока: Язык разметки гипертекста HTML

Тема урока: Язык разметки гипертекста HTML Опасность интернета

Опасность интернета Безопасность общения в социальных сетях

Безопасность общения в социальных сетях Основы журналистики. Пражурналистика и формирование журналистики

Основы журналистики. Пражурналистика и формирование журналистики Поиск оптимального решения ЗЛП. Лекция (фрагмент)

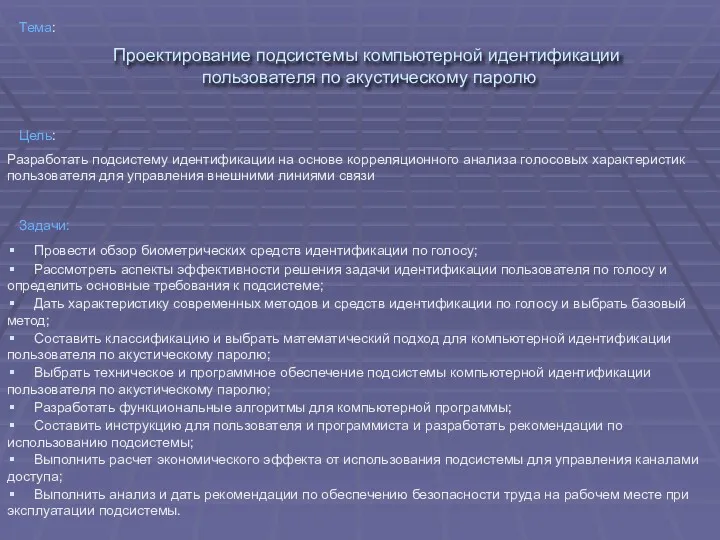

Поиск оптимального решения ЗЛП. Лекция (фрагмент) Проектирование подсистемы компьютерной идентификации пользователя по акустическому паролю

Проектирование подсистемы компьютерной идентификации пользователя по акустическому паролю Базы Данных. Информационные системы

Базы Данных. Информационные системы Электронные таблицы Excel

Электронные таблицы Excel урок Использование сложной анимации в презентации

урок Использование сложной анимации в презентации 5 класс Компьютерная графика. Простейший графический редактор

5 класс Компьютерная графика. Простейший графический редактор SMM-стратегия. Пошаговый план продвижения в социальных сетях

SMM-стратегия. Пошаговый план продвижения в социальных сетях Базы данных и SQL. Нормальные формы

Базы данных и SQL. Нормальные формы Технические и программные средства реализации информационных процессов. Обзор офисных приложений

Технические и программные средства реализации информационных процессов. Обзор офисных приложений Компьютерное моделирование и проектирование машин и агрегатов трубного производства

Компьютерное моделирование и проектирование машин и агрегатов трубного производства Что такое система. Информационные системы и базы данных

Что такое система. Информационные системы и базы данных Компьютерные вирусы. Антивирусные программы. (10 класс)

Компьютерные вирусы. Антивирусные программы. (10 класс)