Содержание

- 2. План лекції 1 Паралелізм 2 Фундаментальні поняття паралельного програмування 3 Моделі розподіленого програмування 4 Застосування паралелізму

- 3. Характеристики традиційних алгоритмів: число операцій, обсяг необхідної пам'яті точність.

- 4. теорія процесів process calculus -процесна алгебра π-calculus- пі-обчислення основна модель поведінки мобільних взаємодіючих систем CCS (Calculus

- 5. Переваги теорії процесів Для формального опису та аналізу поведінки розподілених динамічних систем: компоненти працюють паралельно, взаємодія

- 6. Верифікація процесів Верифікація - побудова формального доказу того, що аналізований процес має задані властивості. Наприклад, безпечна

- 7. Постановка завдання верифікації 1. Побудова процесу, що представляє собою математичну модель поведінки аналізованої системи. 2. Подання

- 8. Паралелізм Паралельна обробка має два різновиди: конвеєрність паралельність Для написання паралельної програми необхідно Виділити групи операцій,

- 9. Неформальне поняття процесу Процес являє собою граф P, де • Вершини графа P називаються станами, і

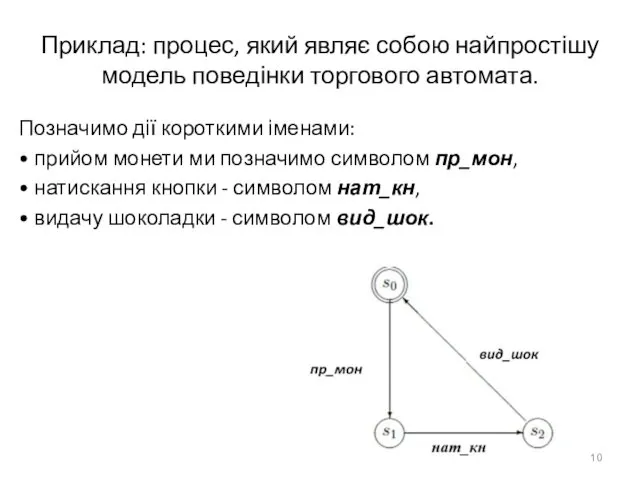

- 10. Приклад: процес, який являє собою найпростішу модель поведінки торгового автомата. Позначимо дії короткими іменами: • прийом

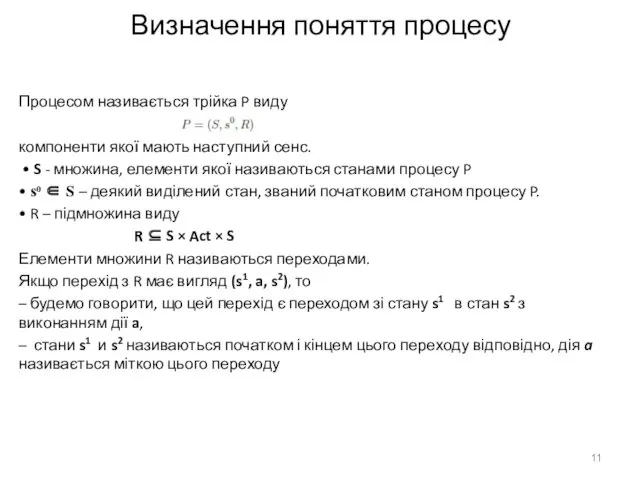

- 11. Визначення поняття процесу Процесом називається трійка P виду компоненти якої мають наступний сенс. • S -

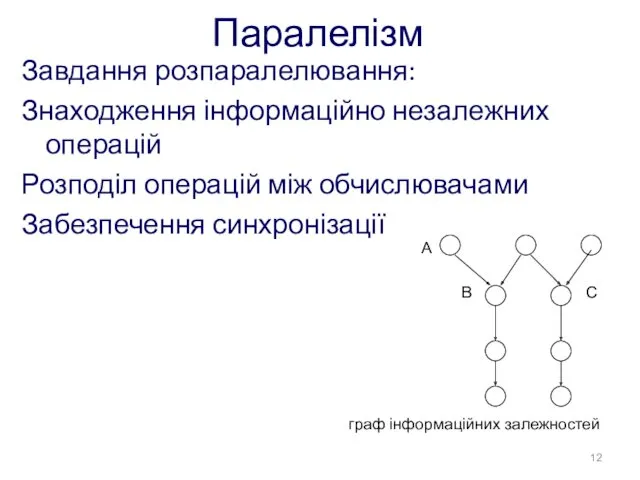

- 12. Паралелізм Завдання розпаралелювання: Знаходження інформаційно незалежних операцій Розподіл операцій між обчислювачами Забезпечення синхронізації граф інформаційних залежностей

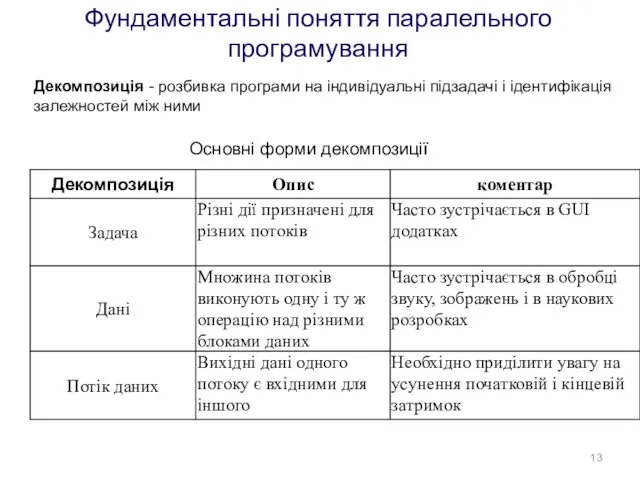

- 13. Фундаментальні поняття паралельного програмування Основні форми декомпозиції Декомпозиція - розбивка програми на індивідуальні підзадачі і ідентифікація

- 14. Паралелізм Завдання декомпозиції - розкладання програми на функції Паралелізм рівня даних, розбиває завдання за умовою їх

- 15. Паралелізм Деякі можливі проблеми: Синхронізація комунікація балансування завантаження масштабованість

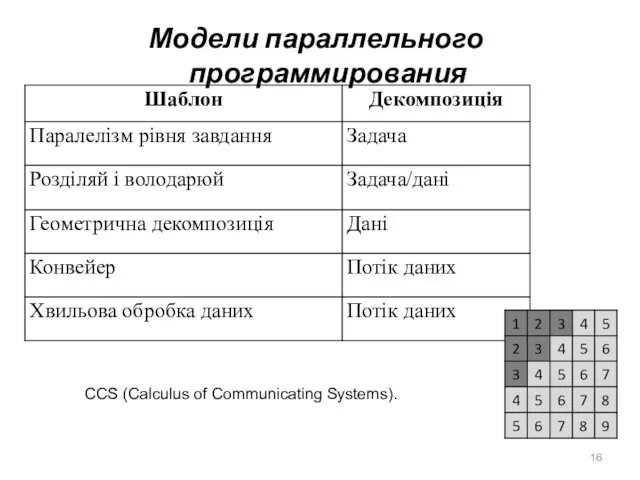

- 16. Модели параллельного программирования CCS (Calculus of Communicating Systems).

- 17. Моделі розподіленого програмування "Клієнт / сервер" "Виробник-споживач" мультиагентні розподілені системи π-calculus

- 18. Використання паралелізму Способи розпаралелювання: великоблочне розпаралелювання розподіл ітерацій циклів блоковий розподіл циклічний розподіл

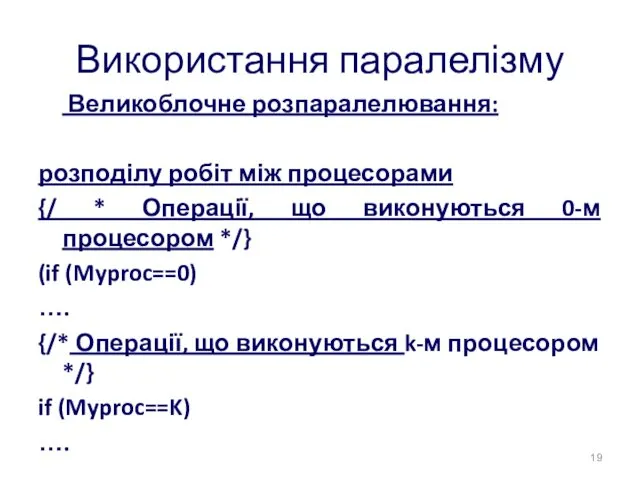

- 19. Використання паралелізму Великоблочне розпаралелювання: розподілу робіт між процесорами {/ * Операції, що виконуються 0-м процесором */}

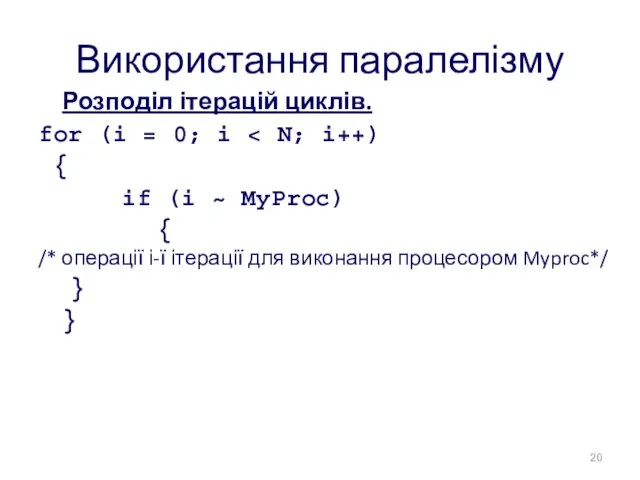

- 20. Використання паралелізму Розподіл ітерацій циклів. for (i = 0; i { if (i ~ MyProc) {

- 21. Використання паралелізму Блоковий розподіл ітерацій Кількість ітерацій циклу N ділиться на число процесорів р, результат округляється

- 22. Використання паралелізмузма for (i = 0; i a[i] = a[i] + b[i];

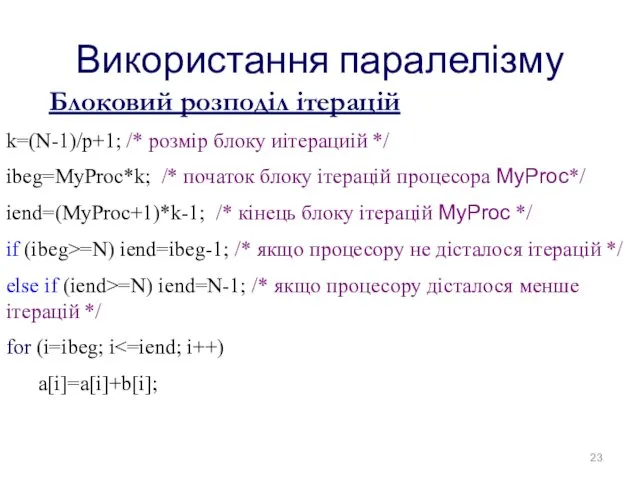

- 23. Використання паралелізму Блоковий розподіл ітерацій k=(N-1)/p+1; /* розмір блоку иітерациій */ ibeg=MyProc*k; /* початок блоку ітерацій

- 24. Використання паралелізму циклічний розподіл : for (i = MyProc; i a[i] = a[i] + b[i];

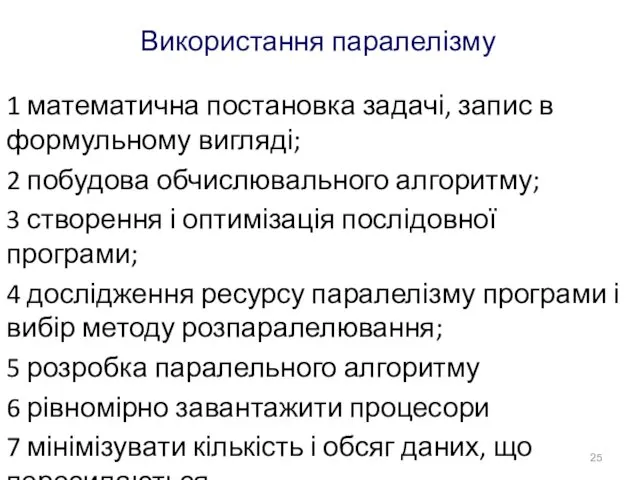

- 25. Використання паралелізму 1 математична постановка задачі, запис в формульному вигляді; 2 побудова обчислювального алгоритму; 3 створення

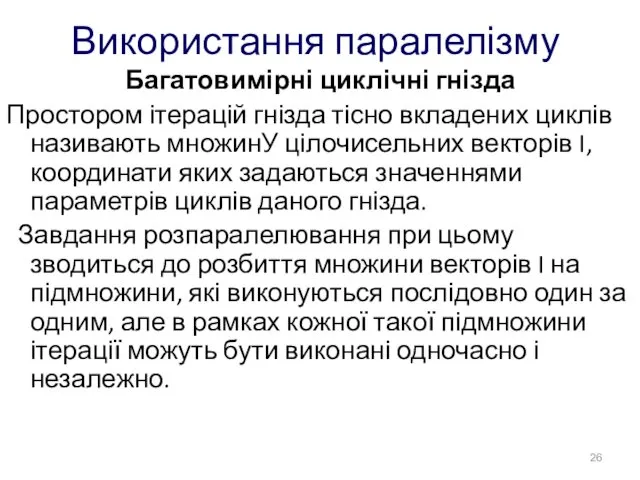

- 26. Використання паралелізму Багатовимірні циклічні гнізда Простором ітерацій гнізда тісно вкладених циклів називають множинУ цілочисельних векторів I,

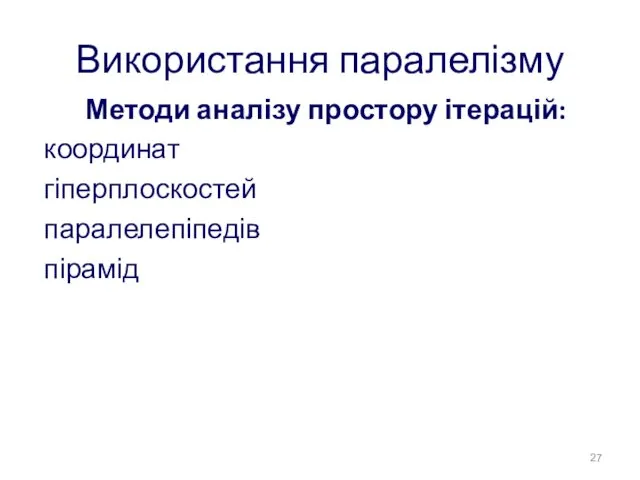

- 27. Використання паралелізму Методи аналізу простору ітерацій: координат гіперплоскостей паралелепіпедів пірамід

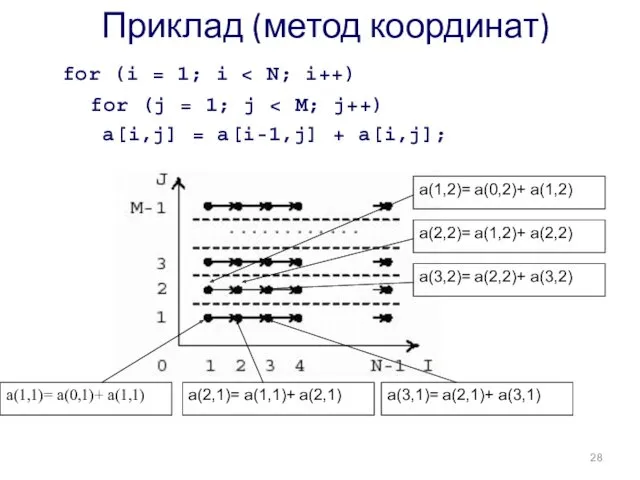

- 28. Приклад (метод координат) for (i = 1; i for (j = 1; j a[i,j] = a[i-1,j]

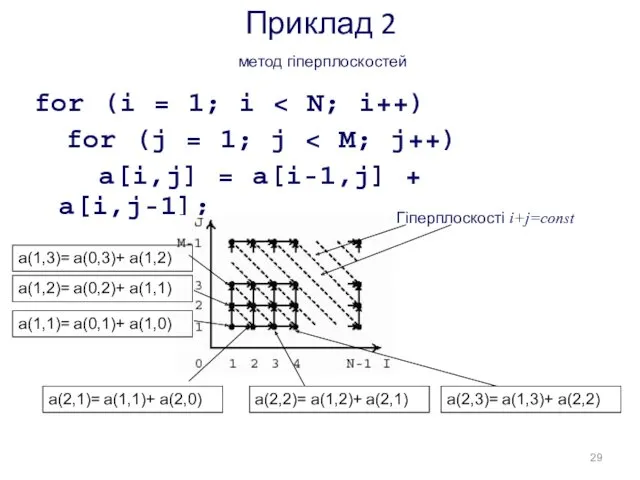

- 29. Приклад 2 for (i = 1; i for (j = 1; j a[i,j] = a[i-1,j] +

- 30. Приклад 3 for (i = 1; i { a[i] = a[i] + b[i]; (3.1) c[i] =

- 32. Скачать презентацию

![Використання паралелізмузма for (i = 0; i a[i] = a[i] + b[i];](/_ipx/f_webp&q_80&fit_contain&s_1440x1080/imagesDir/jpg/20588/slide-21.jpg)

![Використання паралелізму циклічний розподіл : for (i = MyProc; i a[i] = a[i] + b[i];](/_ipx/f_webp&q_80&fit_contain&s_1440x1080/imagesDir/jpg/20588/slide-23.jpg)

![Приклад 3 for (i = 1; i { a[i] =](/_ipx/f_webp&q_80&fit_contain&s_1440x1080/imagesDir/jpg/20588/slide-29.jpg)

Текстовые функции

Текстовые функции Измерение количества информации. Вероятностный подход

Измерение количества информации. Вероятностный подход Структура программы в Паскале. Ввод и вывод данных. (Тема 2)

Структура программы в Паскале. Ввод и вывод данных. (Тема 2) Зустріч лідерів

Зустріч лідерів Сети передачи данных

Сети передачи данных Information and communication technologies

Information and communication technologies Кібербулінг

Кібербулінг Асинхронные операции как часть параллельного программирования. Потоки, примитивы синхронизации в c+ +. Привязка к ядрам

Асинхронные операции как часть параллельного программирования. Потоки, примитивы синхронизации в c+ +. Привязка к ядрам Программирование на PHP 5. Функции

Программирование на PHP 5. Функции Бизнес в Instagram

Бизнес в Instagram Бұлттық технологиялар

Бұлттық технологиялар Збереження даних на знімних носіях

Збереження даних на знімних носіях Составление наборов тестовых данных для структурного тестирования. Стратегия белого ящика

Составление наборов тестовых данных для структурного тестирования. Стратегия белого ящика Project Planning and Configuration. Siemens

Project Planning and Configuration. Siemens Компьютерные коммуникации и их аппаратная основа. (Лекция 1)

Компьютерные коммуникации и их аппаратная основа. (Лекция 1) История развития вычислительной техники

История развития вычислительной техники SEO/SMO для веб-разработчика

SEO/SMO для веб-разработчика Топ-5 самых удивительных достижений в мире машинного обучения

Топ-5 самых удивительных достижений в мире машинного обучения Использование проектного подхода и хакатонов в качестве инструментов ускорения внедрения новых технологий в учебный процесс

Использование проектного подхода и хакатонов в качестве инструментов ускорения внедрения новых технологий в учебный процесс ПЕРЕВОД ЧИСЕЛ ИЗ ДЕСЯТИЧНОЙ СИСТЕМЫ СЧИСЛЕНИЯ

ПЕРЕВОД ЧИСЕЛ ИЗ ДЕСЯТИЧНОЙ СИСТЕМЫ СЧИСЛЕНИЯ Обеспечение безопасности информации на некоторых уязвимых направлениях деятельности предприятия

Обеспечение безопасности информации на некоторых уязвимых направлениях деятельности предприятия Краткий обзор JUnit / JUnit 4

Краткий обзор JUnit / JUnit 4 Разработка плана действий. Разнообразие задач обработки информации

Разработка плана действий. Разнообразие задач обработки информации Cyber security

Cyber security Алгоритмы вокруг нас

Алгоритмы вокруг нас Применение динамических массивов в структурном подходе

Применение динамических массивов в структурном подходе Методика пошуку інформації в науковометричній базі даних Scopus

Методика пошуку інформації в науковометричній базі даних Scopus Транзакции и целостность баз данных

Транзакции и целостность баз данных