Содержание

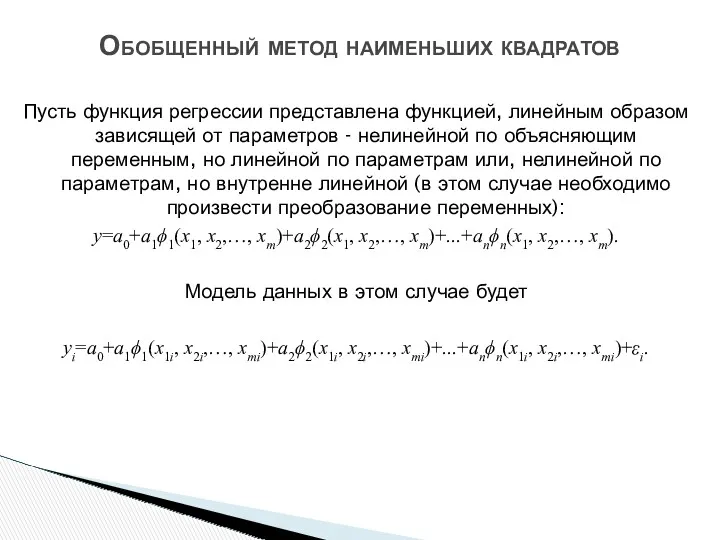

- 2. Пусть функция регрессии представлена функцией, линейным образом зависящей от параметров - нелинейной по объясняющим переменным, но

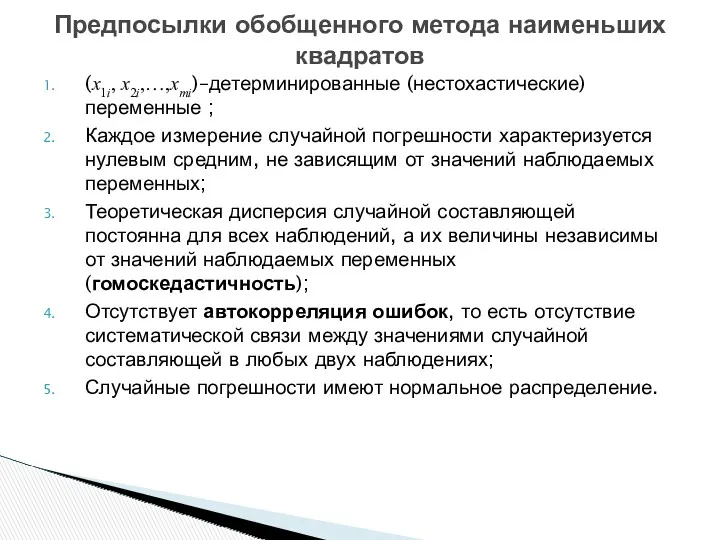

- 3. (x1i, x2i,…,xmi)–детерминированные (нестохастические) переменные ; Каждое измерение случайной погрешности характеризуется нулевым средним, не зависящим от значений

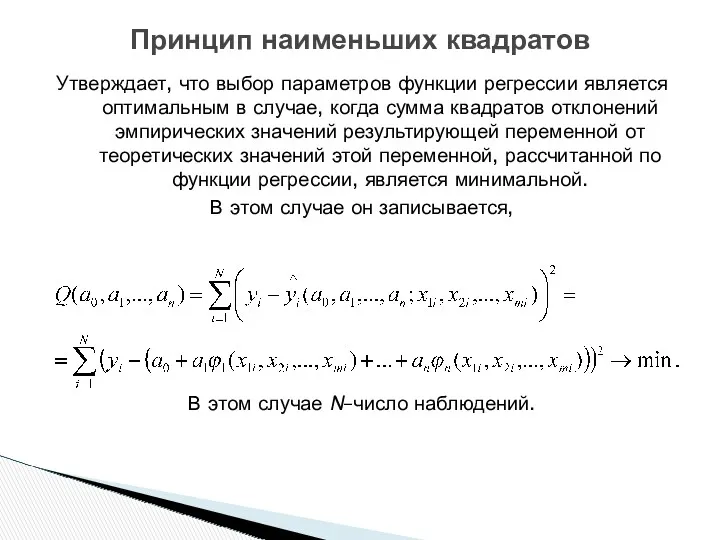

- 4. Утверждает, что выбор параметров функции регрессии является оптимальным в случае, когда сумма квадратов отклонений эмпирических значений

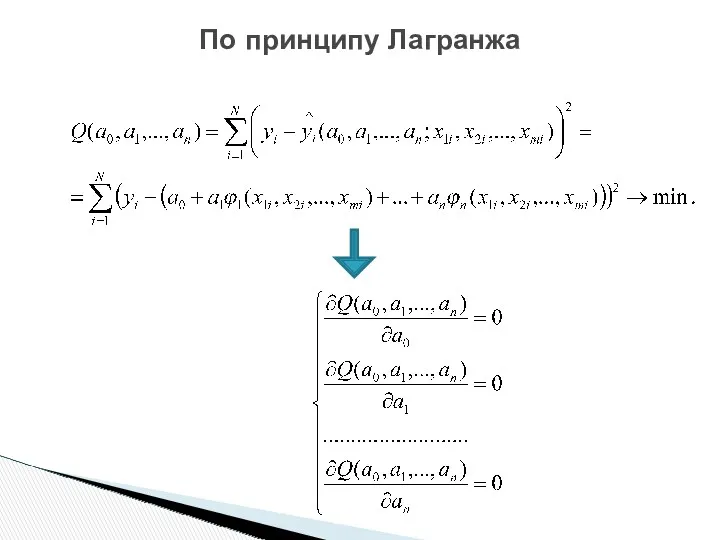

- 5. По принципу Лагранжа

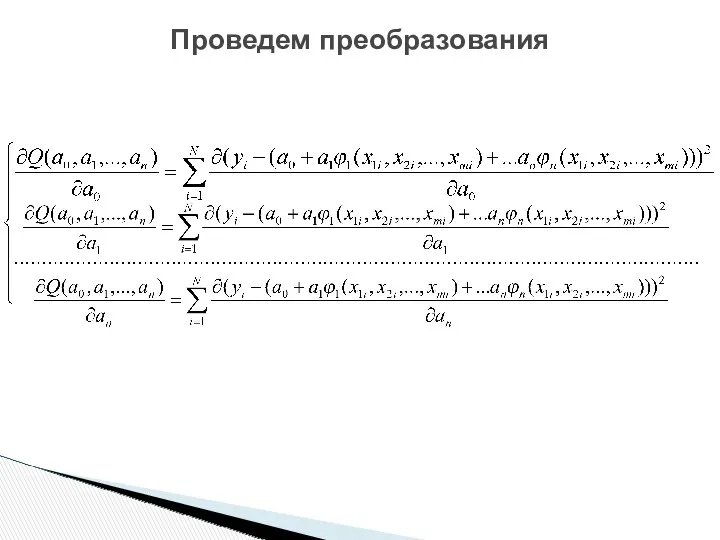

- 6. Проведем преобразования

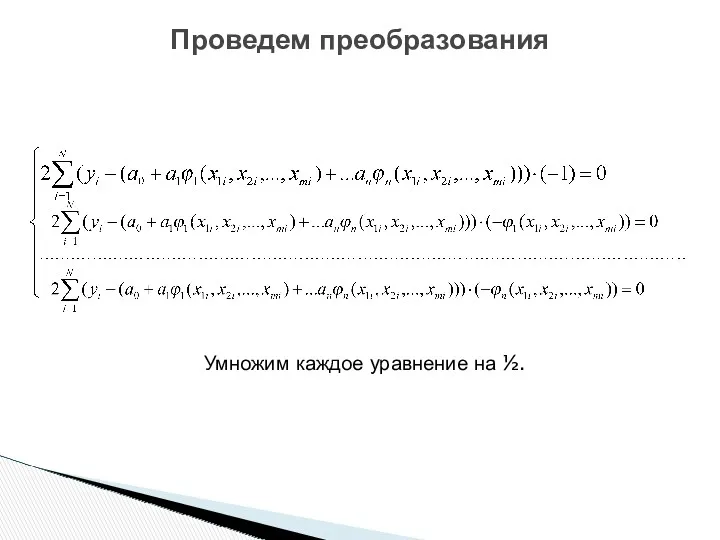

- 7. Умножим каждое уравнение на ½. Проведем преобразования

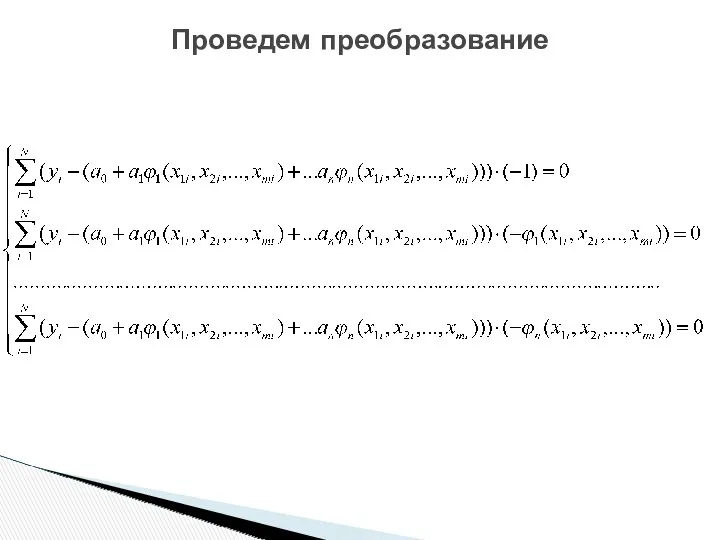

- 8. Проведем преобразование

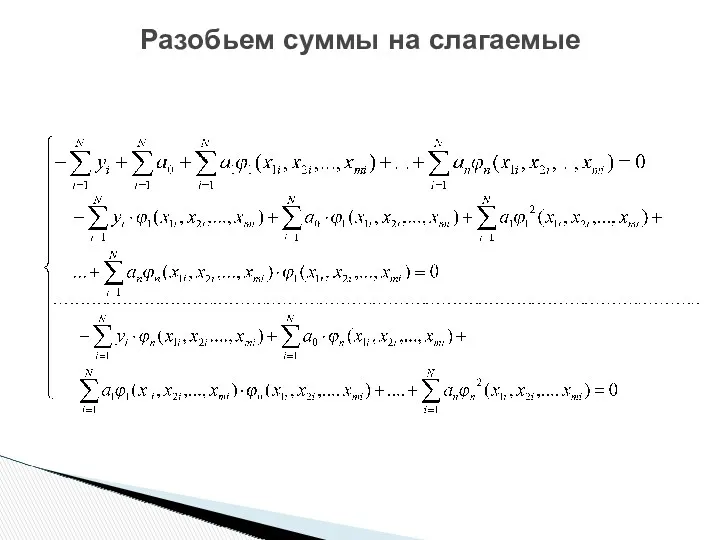

- 9. Разобьем суммы на слагаемые

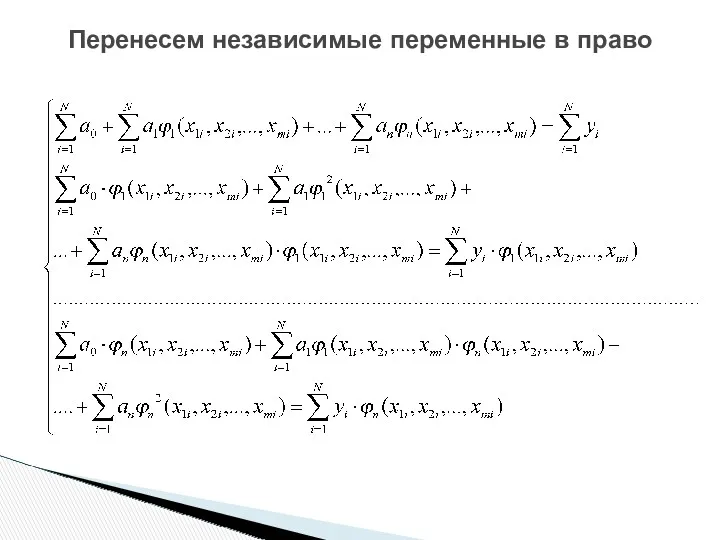

- 10. Перенесем независимые переменные в право

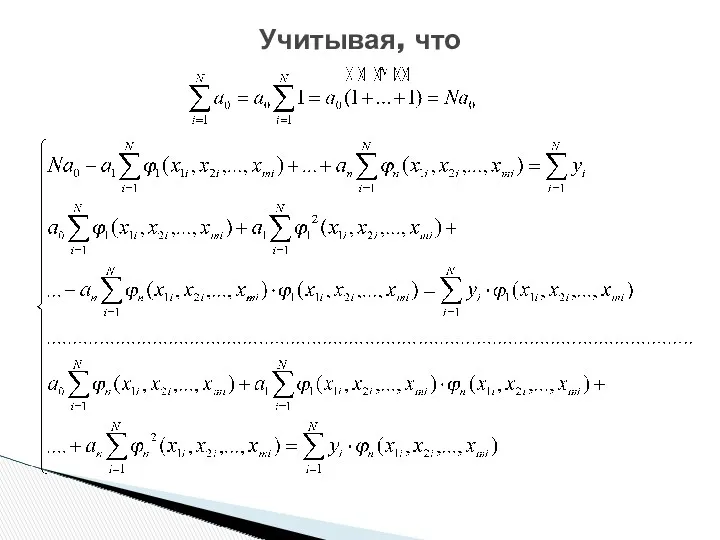

- 11. Учитывая, что

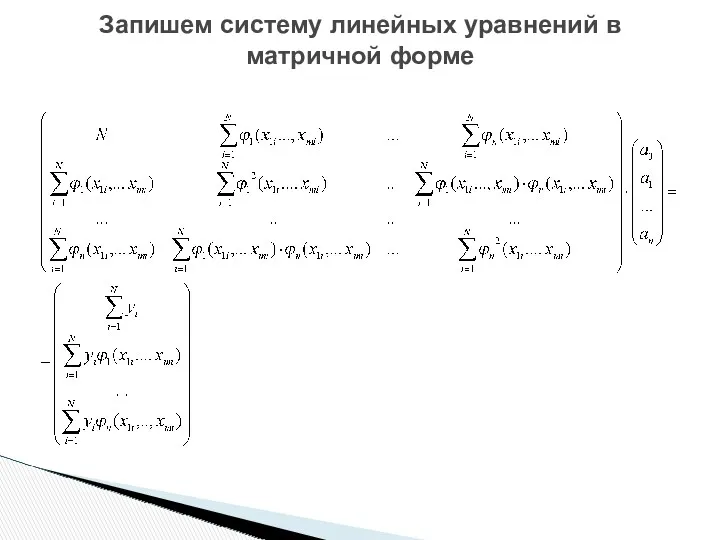

- 12. Запишем систему линейных уравнений в матричной форме

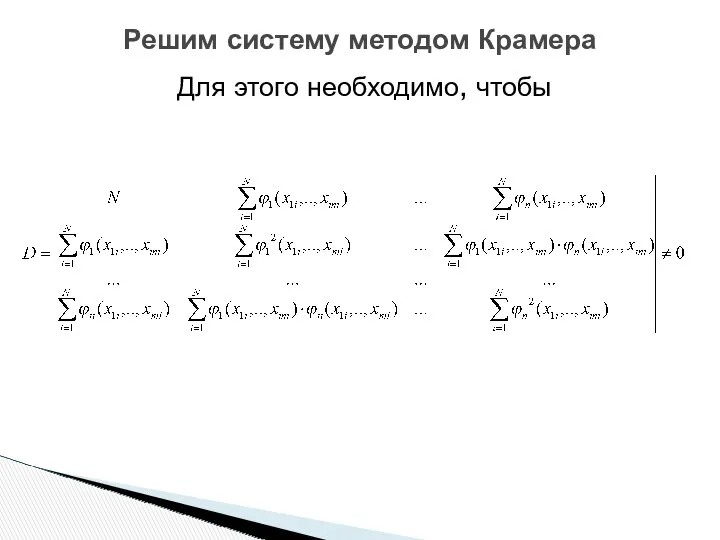

- 13. Решим систему методом Крамера Для этого необходимо, чтобы

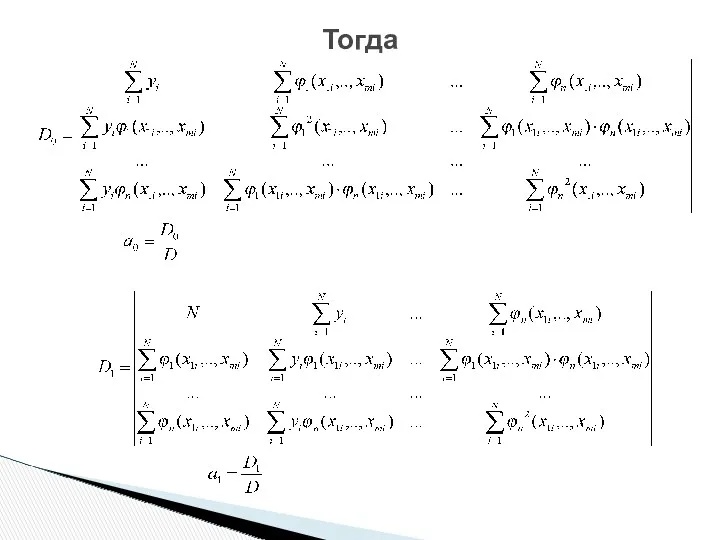

- 14. Тогда

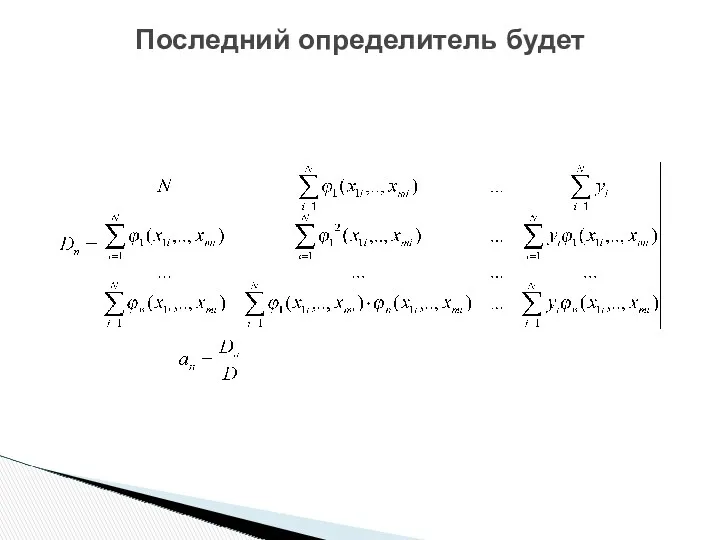

- 15. Последний определитель будет

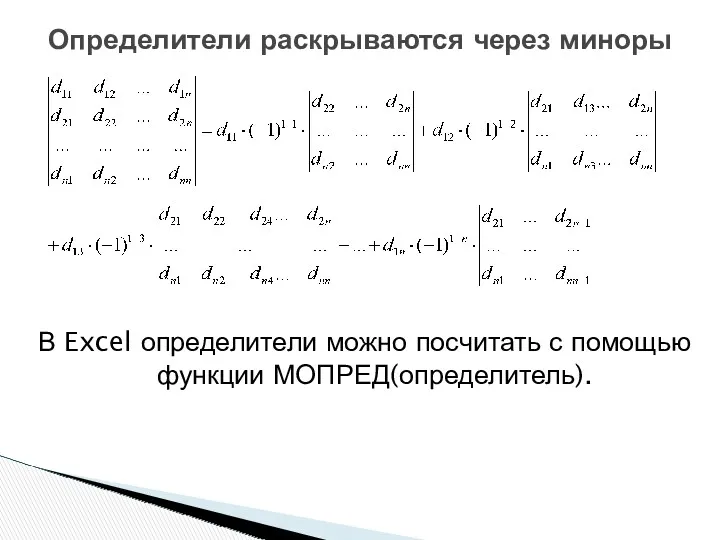

- 16. Определители раскрываются через миноры В Excel определители можно посчитать с помощью функции МОПРЕД(определитель).

- 17. Эконометрика КОРРЕЛЯЦИЯ ДЛЯ НЕЛИНЕЙНОЙ РЕГРЕССИИ. КОЭФФИЦИЕНТЫ ЭЛАСТИЧНОСТИ

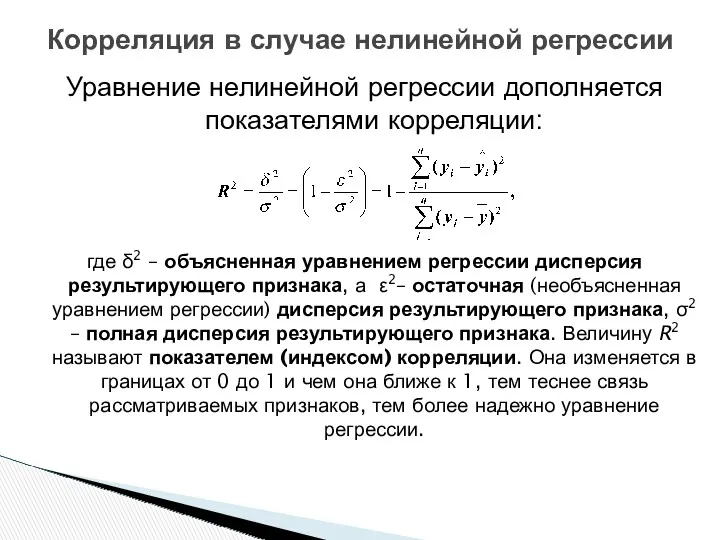

- 18. Корреляция в случае нелинейной регрессии Уравнение нелинейной регрессии дополняется показателями корреляции: где δ2 – объясненная уравнением

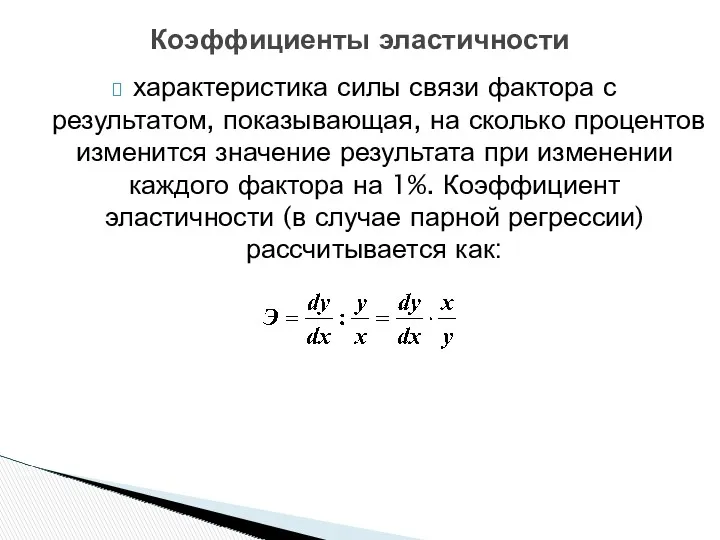

- 19. Коэффициенты эластичности характеристика силы связи фактора с результатом, показывающая, на сколько процентов изменится значение результата при

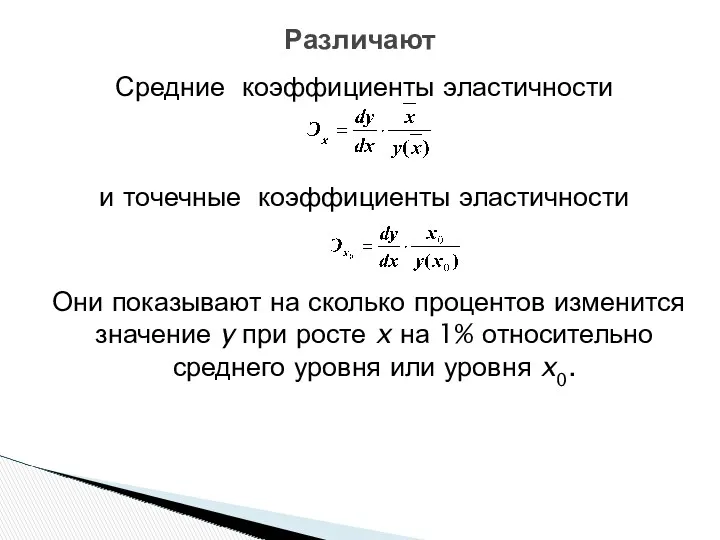

- 20. Различают Средние коэффициенты эластичности и точечные коэффициенты эластичности Они показывают на сколько процентов изменится значение y

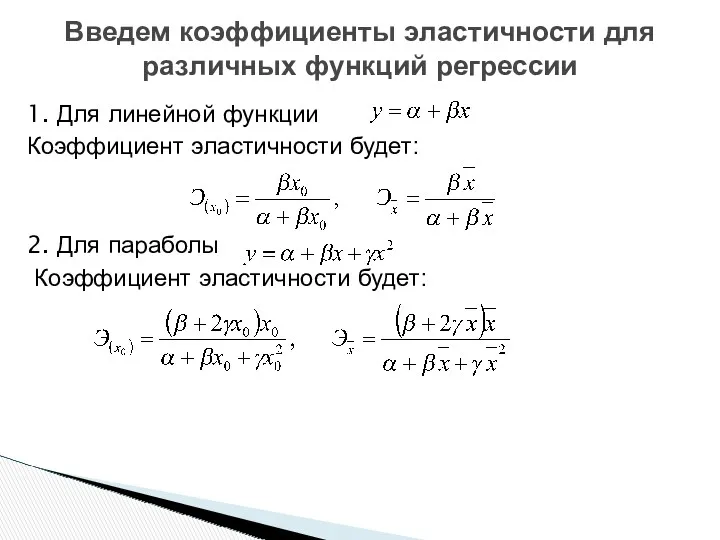

- 21. Введем коэффициенты эластичности для различных функций регрессии 1. Для линейной функции Коэффициент эластичности будет: 2. Для

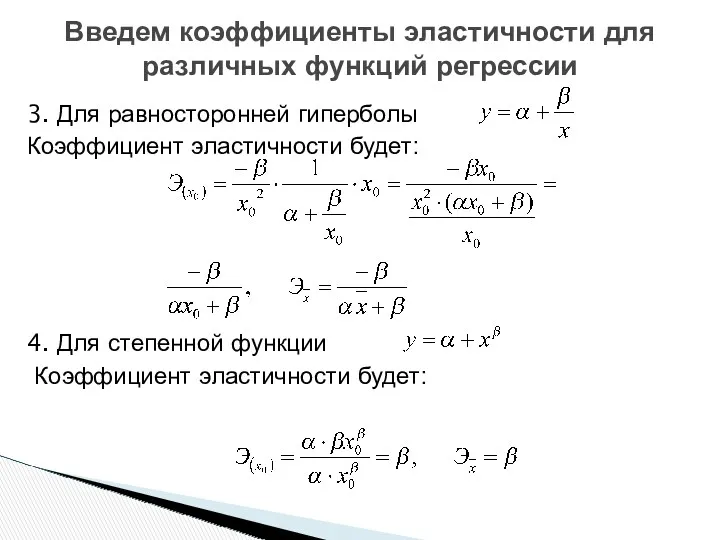

- 22. Введем коэффициенты эластичности для различных функций регрессии 3. Для равносторонней гиперболы Коэффициент эластичности будет: 4. Для

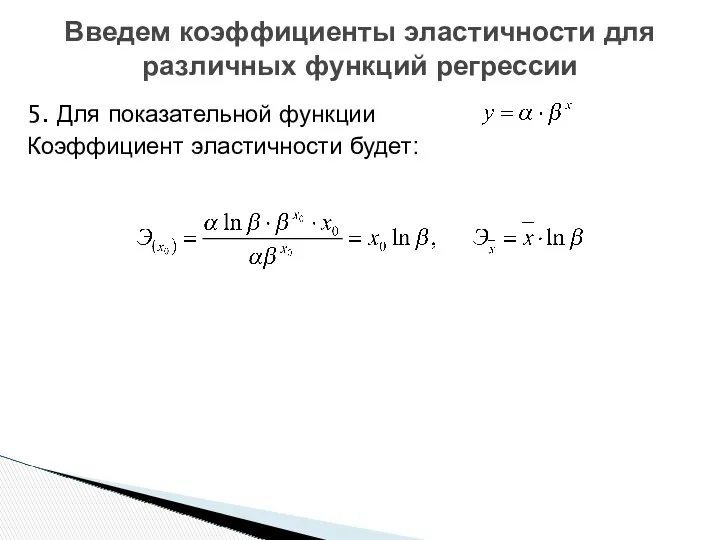

- 23. Введем коэффициенты эластичности для различных функций регрессии 5. Для показательной функции Коэффициент эластичности будет:

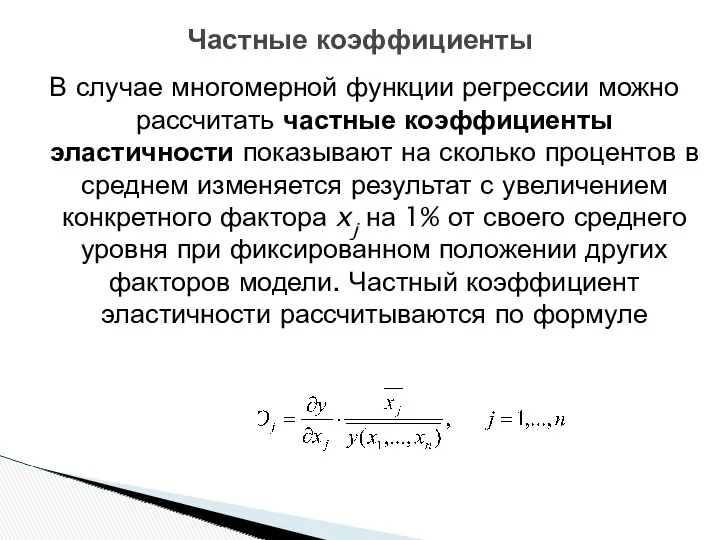

- 24. Частные коэффициенты В случае многомерной функции регрессии можно рассчитать частные коэффициенты эластичности показывают на сколько процентов

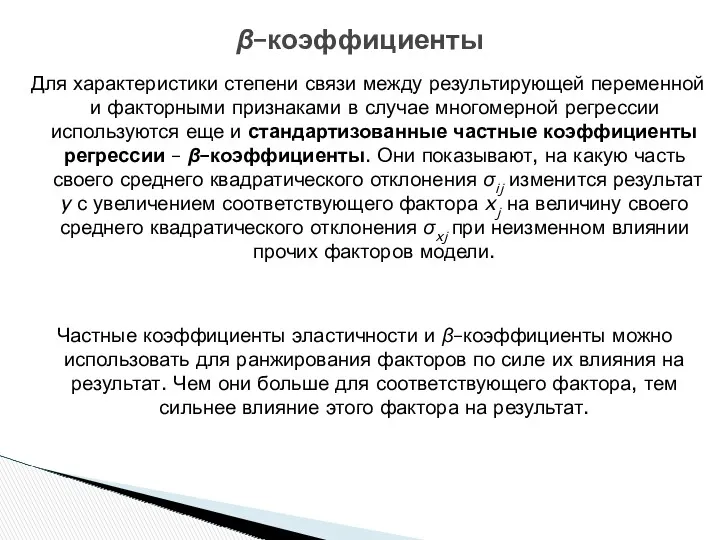

- 25. β–коэффициенты Для характеристики степени связи между результирующей переменной и факторными признаками в случае многомерной регрессии используются

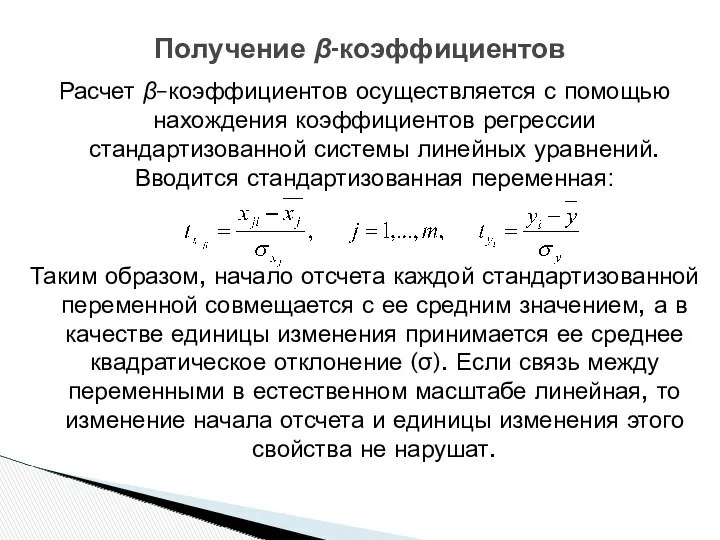

- 26. Получение β-коэффициентов Расчет β–коэффициентов осуществляется с помощью нахождения коэффициентов регрессии стандартизованной системы линейных уравнений. Вводится стандартизованная

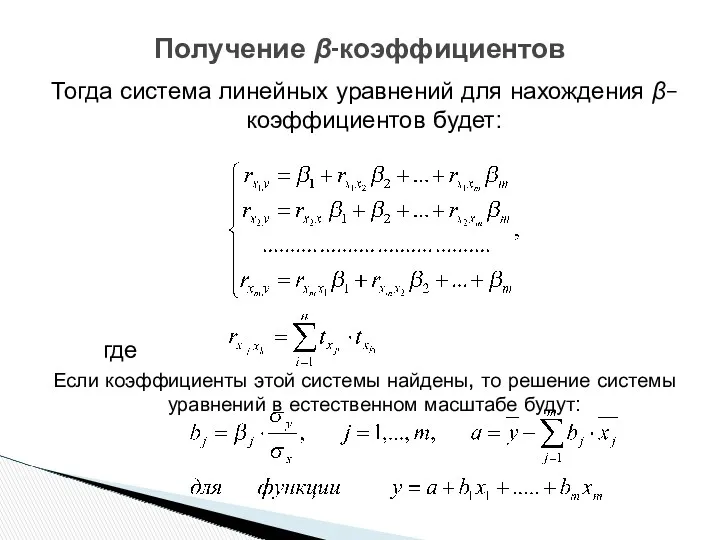

- 27. Получение β-коэффициентов Тогда система линейных уравнений для нахождения β–коэффициентов будет: где Если коэффициенты этой системы найдены,

- 28. Частные коэффициенты эластичности Эмпирические частные коэффициенты эластичности; Частные коэффициенты эластичности или оценки частных коэффициентов эластичности.

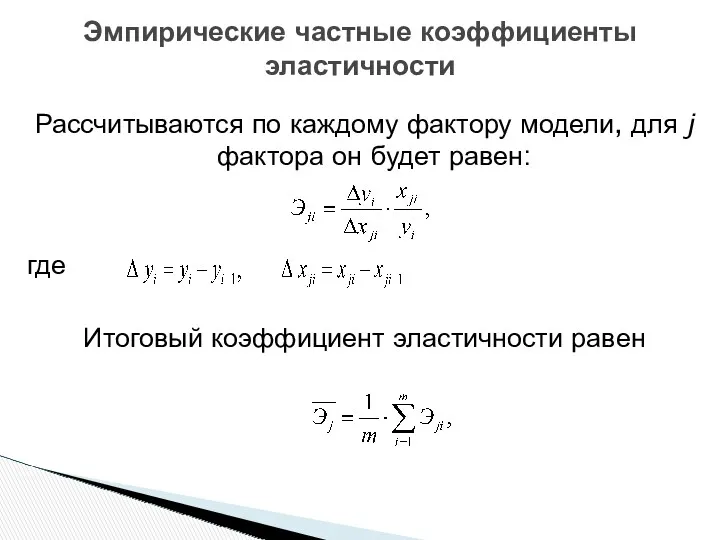

- 29. Эмпирические частные коэффициенты эластичности Рассчитываются по каждому фактору модели, для j фактора он будет равен: где

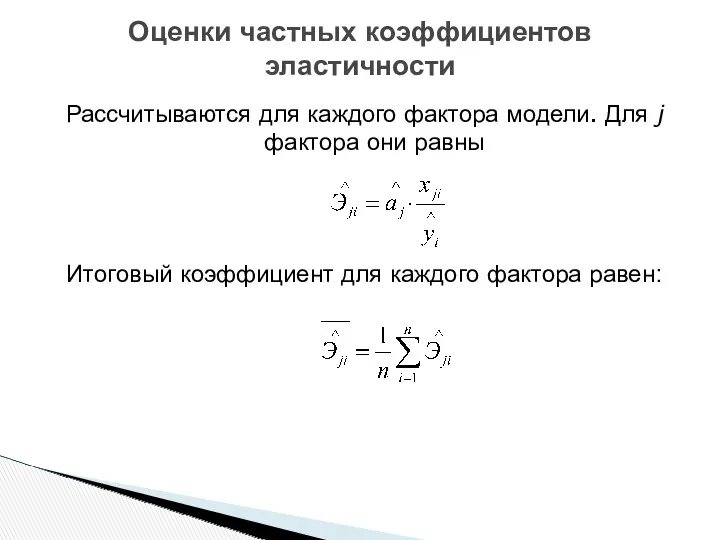

- 30. Оценки частных коэффициентов эластичности Рассчитываются для каждого фактора модели. Для j фактора они равны Итоговый коэффициент

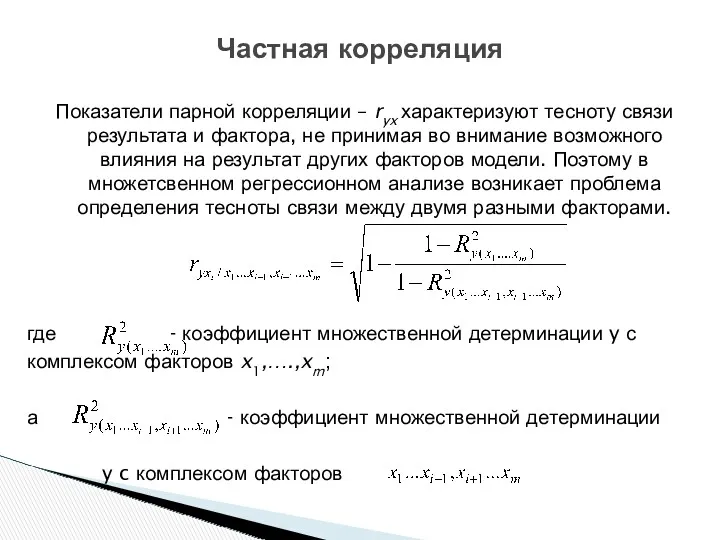

- 31. Частная корреляция Показатели парной корреляции – ryx характеризуют тесноту связи результата и фактора, не принимая во

- 32. Частная корреляция Частные коэффициенты корреляции используются для ранжирования факторов в модели по степени влияния на результат.

- 33. Эконометрика ПРОБЛЕМА МУЛЬТИКОЛЛИНИАРНОСТИ. ФИКТИВНЫЕ ПЕРЕМЕННЫЕ

- 34. Мультиколлинеарность Мультиколлинеарность – это нестрогая линейная зависимость между факторными признаками (что противоречит предпосылкам применения МНК для

- 35. Снижение мультиколлинеарности Мультиколлинеарность не всегда оказывает неблагоприятное влияние, если другие условия благоприятны: Число наблюдений значительно. Выборочные

- 36. Обнаружение мультиколлинеарности На практике о наличии мультиколлинеарности судят: По матрице парных коэффициентов корреляции (корреляционной матрице): ,

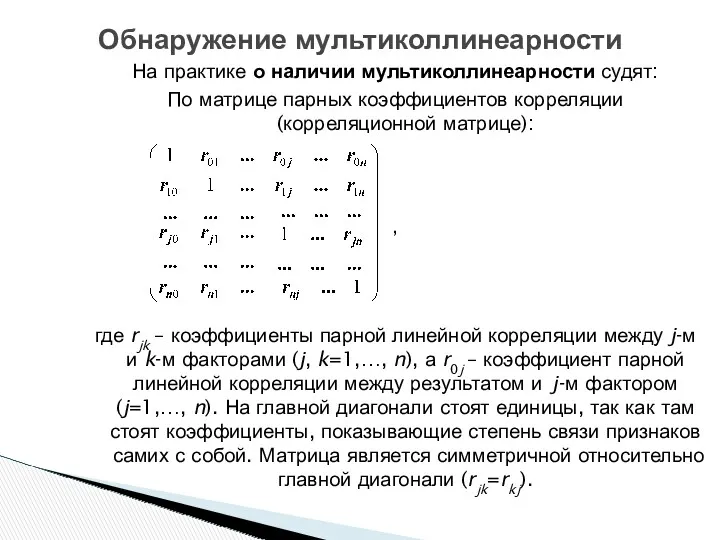

- 37. На практике можно воспользоваться Парными коэффициентами корреляции: Если имеет место мультиколлинеарность, то в модель следует включать

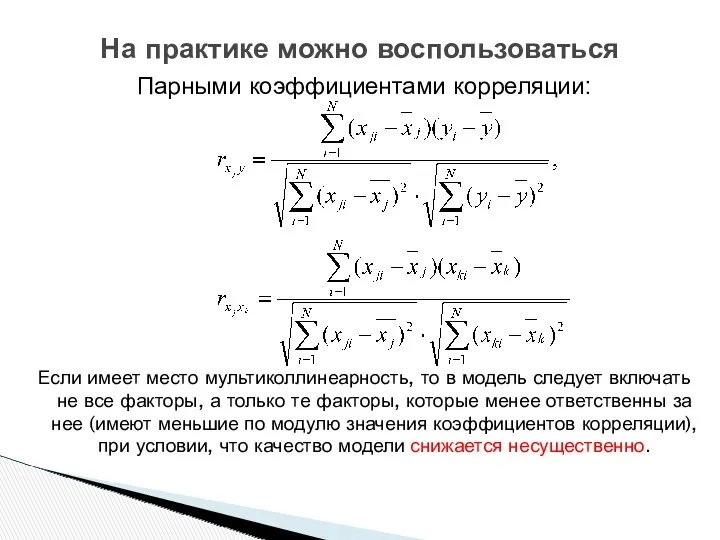

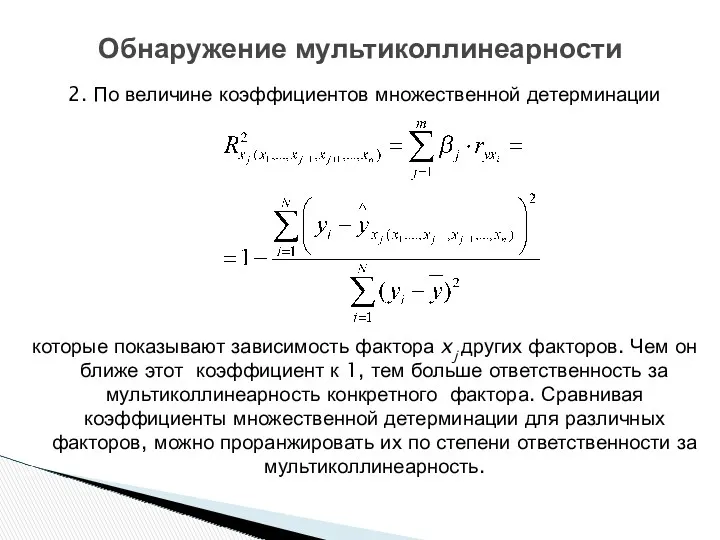

- 38. Обнаружение мультиколлинеарности 2. По величине коэффициентов множественной детерминации которые показывают зависимость фактора xj других факторов. Чем

- 40. Скачать презентацию

фрагменты интегрированных уроков

фрагменты интегрированных уроков Готовимся к ГИА. Элементарные функции

Готовимся к ГИА. Элементарные функции Многочлен - полином

Многочлен - полином Прямая линия в пространстве. Взаимное расположение прямой и плоскости

Прямая линия в пространстве. Взаимное расположение прямой и плоскости График функции

График функции Графы. (Тема 1)

Графы. (Тема 1) Пирамида. Усеченная пирамида

Пирамида. Усеченная пирамида Минимизация стоимости выполнения работ при ограничении на время их выполнения

Минимизация стоимости выполнения работ при ограничении на время их выполнения Переместительное свойство умножения

Переместительное свойство умножения Число и цифра 3.

Число и цифра 3. Решение систем линейных алгебраических уравнений по правилу Крамера, матричным методом, методом Гаусса

Решение систем линейных алгебраических уравнений по правилу Крамера, матричным методом, методом Гаусса Сложение и вычитание векторов

Сложение и вычитание векторов Скорость. Время. Расстояние

Скорость. Время. Расстояние Знаходження площі геометричної фігури

Знаходження площі геометричної фігури Центральная и осевая симметрии

Центральная и осевая симметрии Основы теории вероятности. Основные понятия и определения

Основы теории вероятности. Основные понятия и определения Урок по математике Скорость сближения и удаления

Урок по математике Скорость сближения и удаления Готовимся к ВПР по математике

Готовимся к ВПР по математике Копилка дидактических игр по математике

Копилка дидактических игр по математике Площадь криволинейной трапеции. Определенный интеграл

Площадь криволинейной трапеции. Определенный интеграл Статистичні методи створення математичних моделей. (Лекція 4-5)

Статистичні методи створення математичних моделей. (Лекція 4-5) Шкалы и их типология. Номинальная, ординальная, интервальная и метрическая шкалы. Установочные и оценочные шкалы

Шкалы и их типология. Номинальная, ординальная, интервальная и метрическая шкалы. Установочные и оценочные шкалы Сабақтың тақырыбы: Дискреттік математика негіздері. Лекция 2

Сабақтың тақырыбы: Дискреттік математика негіздері. Лекция 2 Вычитание вида 11 -

Вычитание вида 11 - Есептер шығару. Есеп

Есептер шығару. Есеп Квадратичная функция и её свойства

Квадратичная функция и её свойства Электронно - дидактическая игра Как подружилась кошечка с мышатами.

Электронно - дидактическая игра Как подружилась кошечка с мышатами. Задачи на построение. 7 класс

Задачи на построение. 7 класс