Содержание

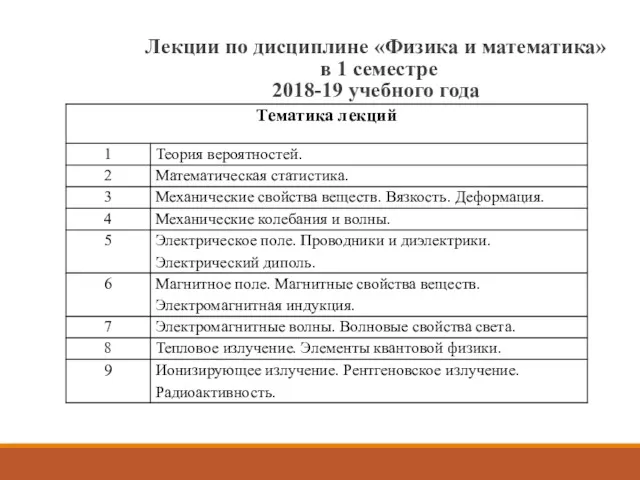

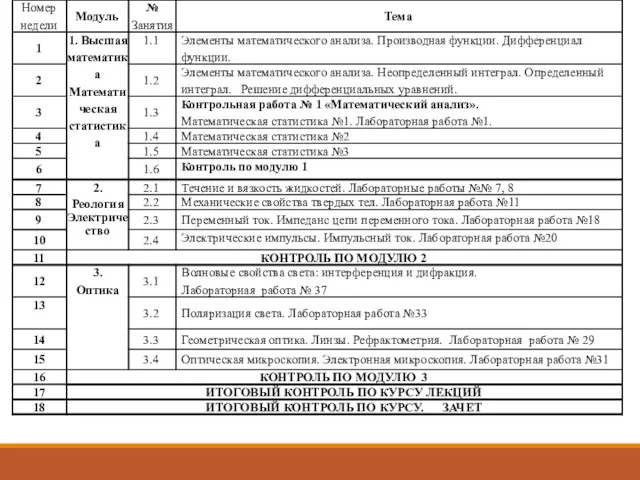

- 2. Лекции по дисциплине «Физика и математика» в 1 семестре 2018-19 учебного года

- 4. ОСНОВНЫЕ ПОНЯТИЯ ТЕОРИИ ВЕРОЯТНОСТЕЙ

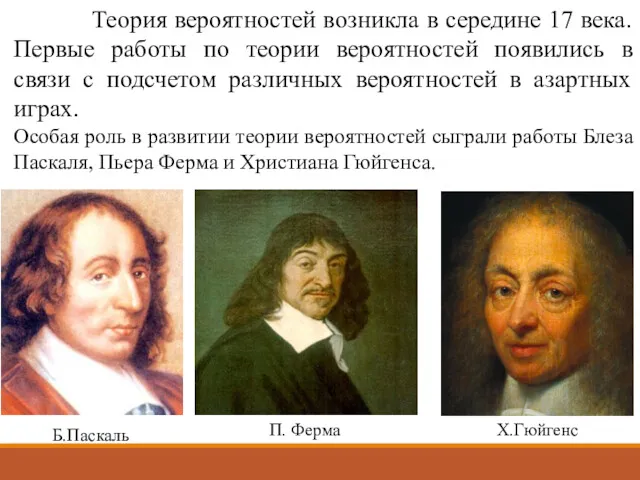

- 6. Теория вероятностей возникла в середине 17 века. Первые работы по теории вероятностей появились в связи с

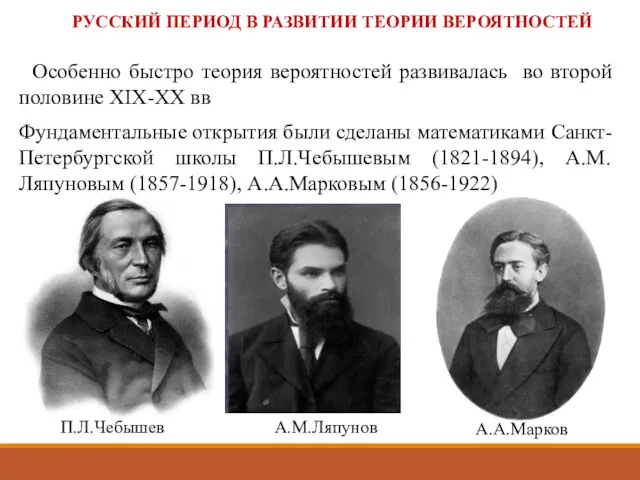

- 7. РУССКИЙ ПЕРИОД В РАЗВИТИИ ТЕОРИИ ВЕРОЯТНОСТЕЙ Особенно быстро теория вероятностей развивалась во второй половине XIX-XX вв

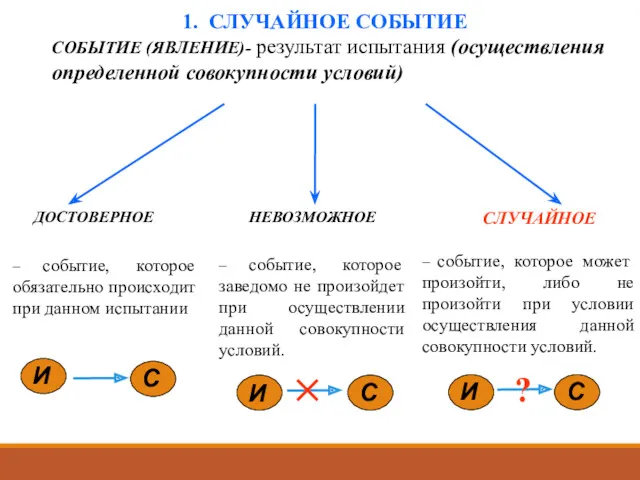

- 8. 1. СЛУЧАЙНОЕ СОБЫТИЕ ДОСТОВЕРНОЕ НЕВОЗМОЖНОЕ СЛУЧАЙНОЕ – событие, которое обязательно происходит при данном испытании – событие,

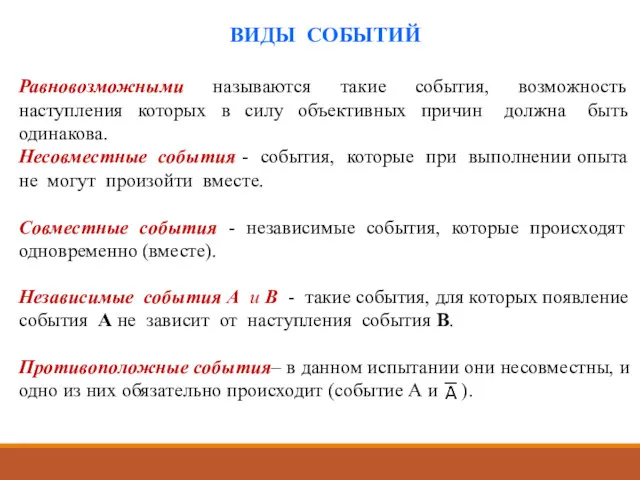

- 9. Равновозможными называются такие события, возможность наступления которых в силу объективных причин должна быть одинакова. Несовместные события

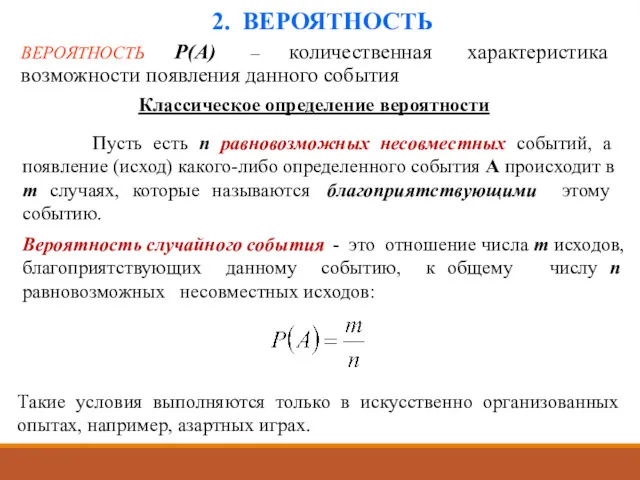

- 10. 2. ВЕРОЯТНОСТЬ ВЕРОЯТНОСТЬ P(А) – количественная характеристика возможности появления данного события Классическое определение вероятности Пусть есть

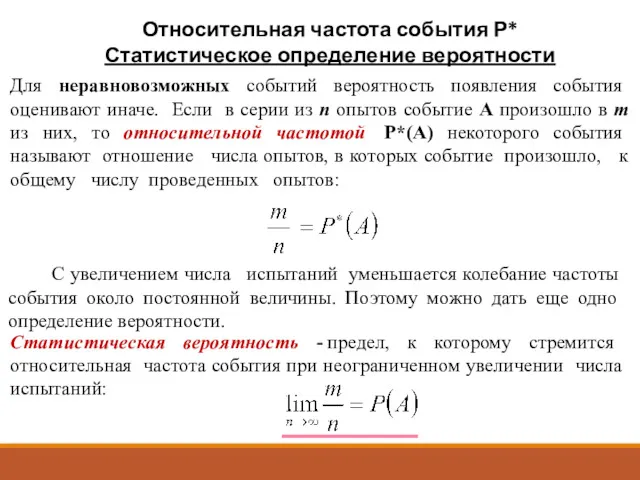

- 11. Относительная частота события Р* Статистическое определение вероятности Для неравновозможных событий вероятность появления события оценивают иначе. Если

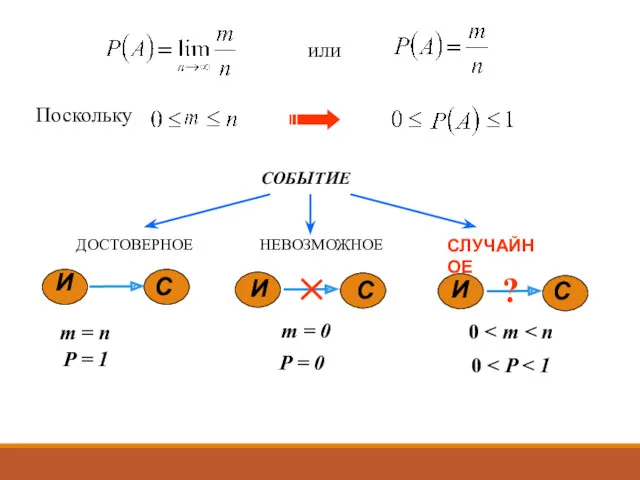

- 12. m = n 0 m = 0 P = 1 P = 0 0 Поскольку

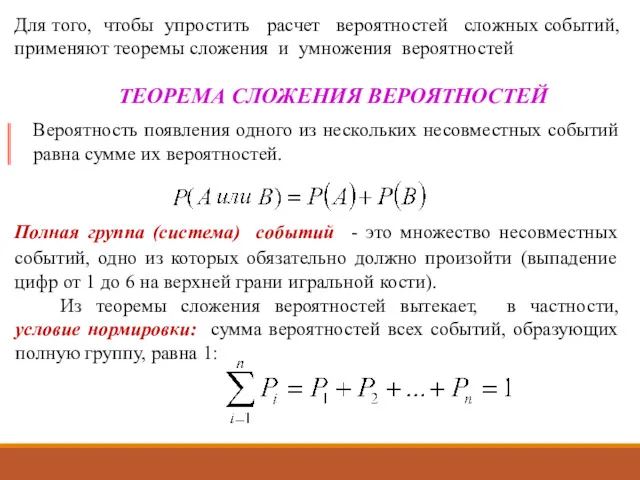

- 13. ТЕОРЕМА СЛОЖЕНИЯ ВЕРОЯТНОСТЕЙ Вероятность появления одного из нескольких несовместных событий равна сумме их вероятностей. Для того,

- 14. Сумма вероятностей двух противоположных несовместных событий равна единице. А - появление герба при бросании монеты; А

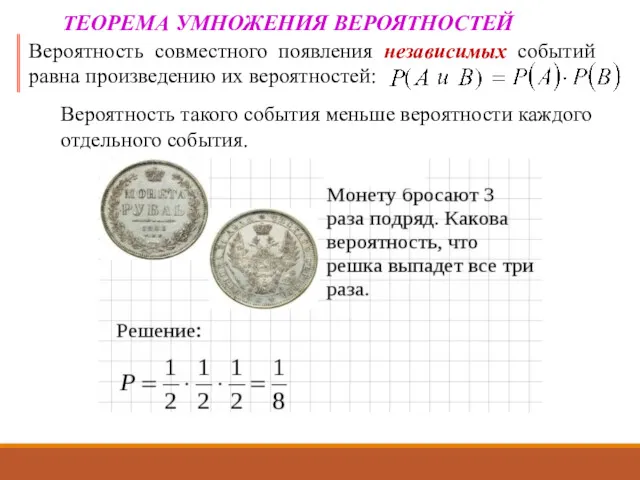

- 15. ТЕОРЕМА УМНОЖЕНИЯ ВЕРОЯТНОСТЕЙ Вероятность такого события меньше вероятности каждого отдельного события.

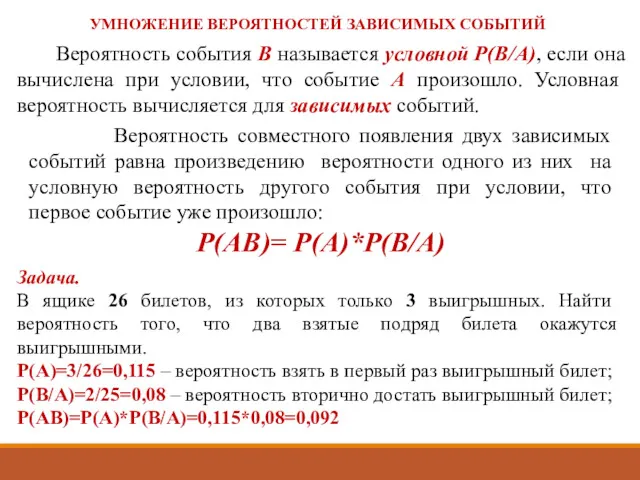

- 16. Вероятность события В называется условной Р(В/А), если она вычислена при условии, что событие А произошло. Условная

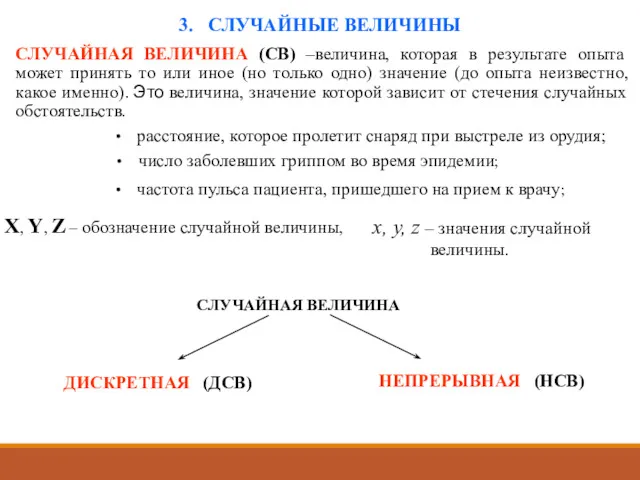

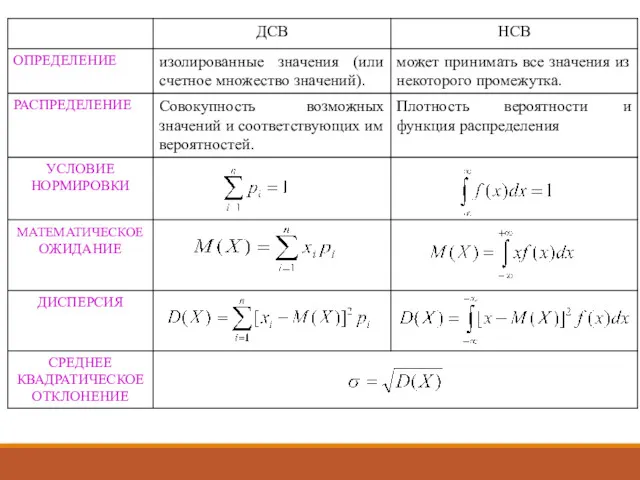

- 17. 3. СЛУЧАЙНЫЕ ВЕЛИЧИНЫ СЛУЧАЙНАЯ ВЕЛИЧИНА (СВ) –величина, которая в результате опыта может принять то или иное

- 18. Дискретными случайными величинами называются такие, которые принимают только отделённые друг от друга значения и могут быть

- 19. СПОСОБЫ ПРЕДСТАВЛЕНИЯ СЛУЧАЙНЫХ ВЕЛИЧИН

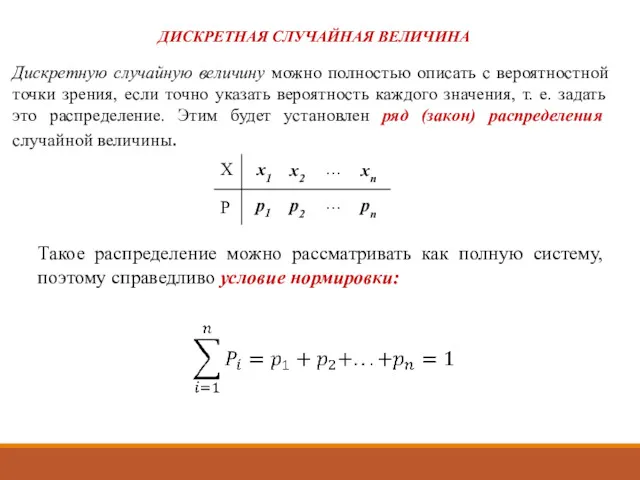

- 20. Дискретную случайную величину можно полностью описать с вероятностной точки зрения, если точно указать вероятность каждого значения,

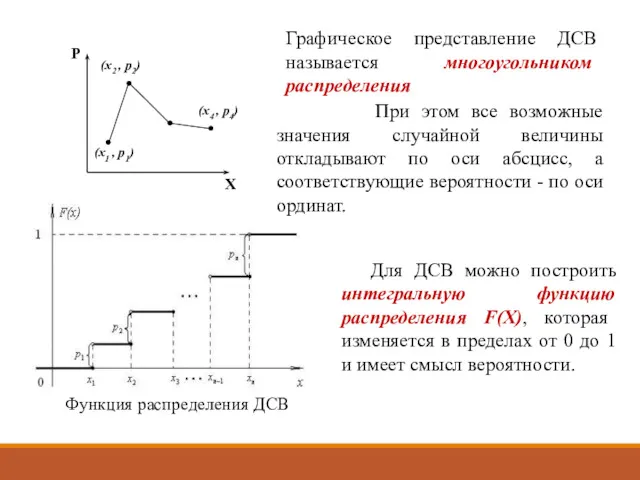

- 21. Графическое представление ДСВ называется многоугольником распределения При этом все возможные значения случайной величины откладывают по оси

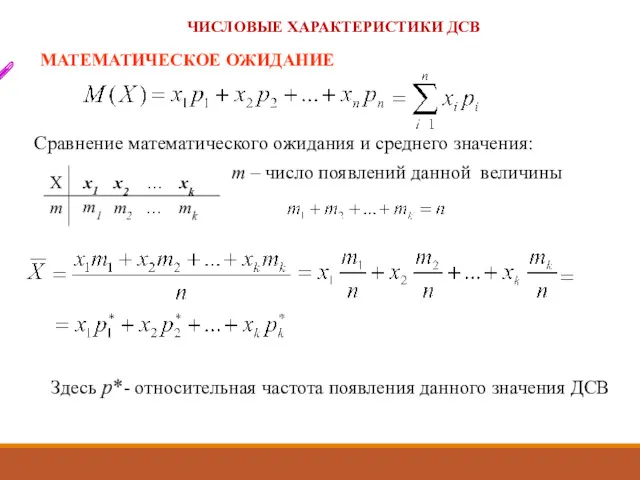

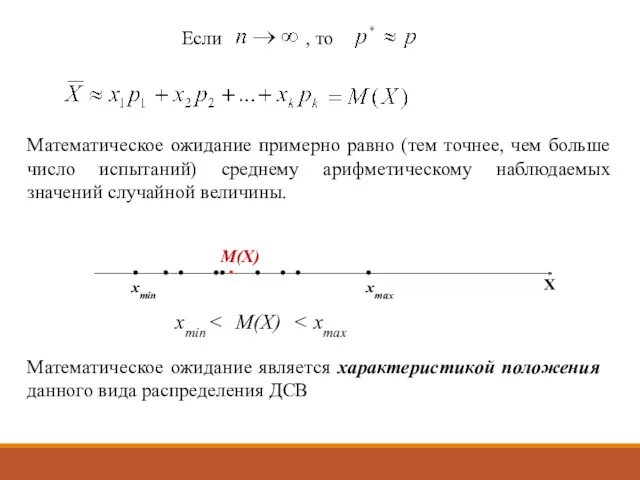

- 22. ЧИСЛОВЫЕ ХАРАКТЕРИСТИКИ ДСВ Сравнение математического ожидания и среднего значения: m – число появлений данной величины Здесь

- 23. Математическое ожидание примерно равно (тем точнее, чем больше число испытаний) среднему арифметическому наблюдаемых значений случайной величины.

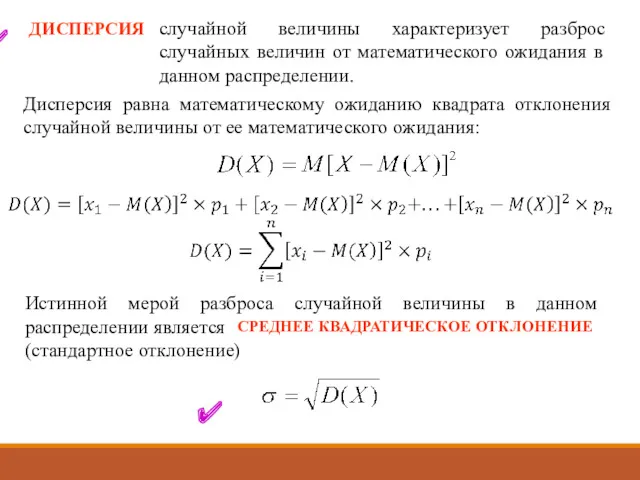

- 24. случайной величины характеризует разброс случайных величин от математического ожидания в данном распределении. Истинной мерой разброса случайной

- 25. НЕПРЕРЫВНАЯ СЛУЧАЙНАЯ ВЕЛИЧИНА НЕПРЕРЫВНАЯ СВ может принимать множество значений в некотором конечном или бесконечном промежутке числовой

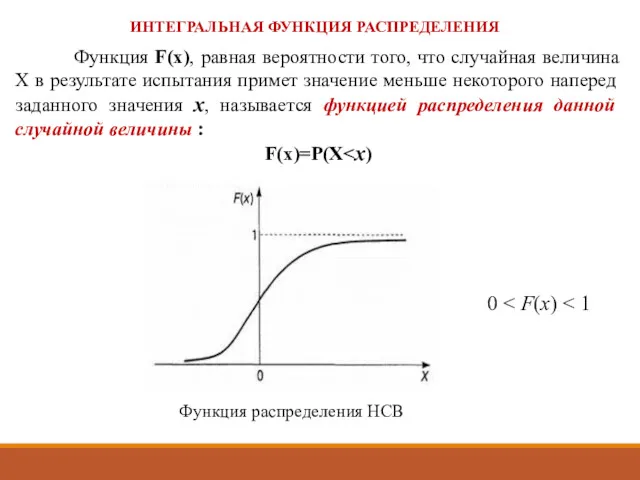

- 26. Функция F(x), равная вероятности того, что случайная величина Х в результате испытания примет значение меньше некоторого

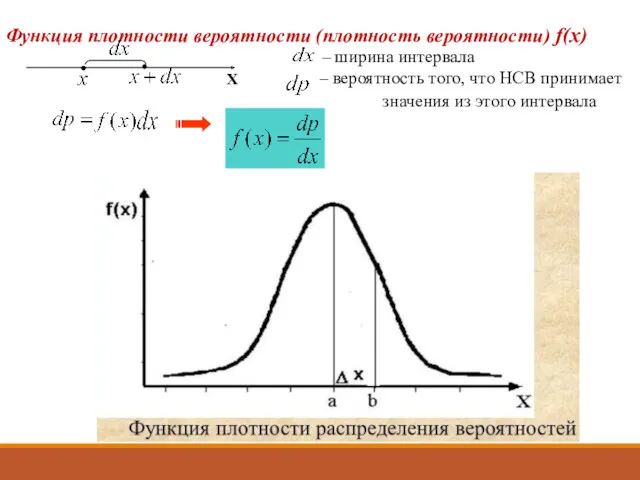

- 27. Функция плотности вероятности (плотность вероятности) f(x)

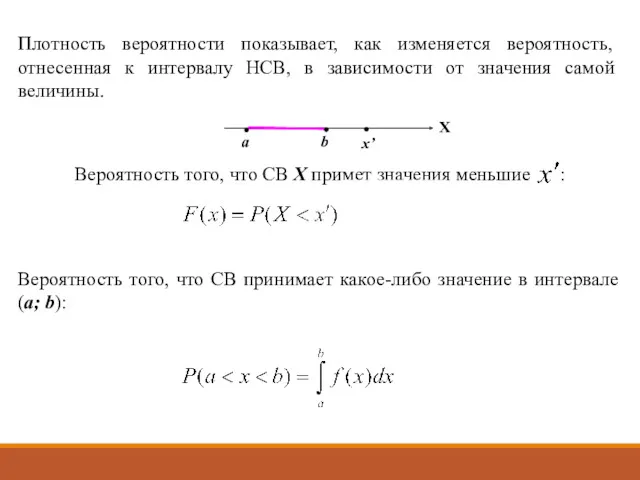

- 28. Вероятность того, что СВ принимает какое-либо значение в интервале (a; b): Вероятность того, что СВ X

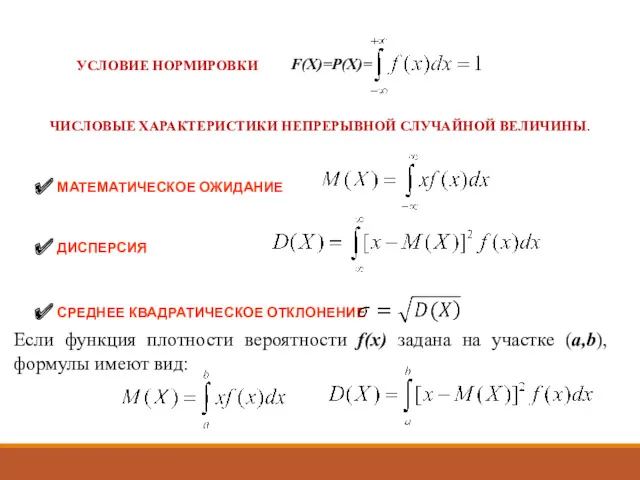

- 29. МАТЕМАТИЧЕСКОЕ ОЖИДАНИЕ ЧИСЛОВЫЕ ХАРАКТЕРИСТИКИ НЕПРЕРЫВНОЙ СЛУЧАЙНОЙ ВЕЛИЧИНЫ. ДИСПЕРСИЯ СРЕДНЕЕ КВАДРАТИЧЕСКОЕ ОТКЛОНЕНИЕ УСЛОВИЕ НОРМИРОВКИ F(X)=P(X)= Если функция

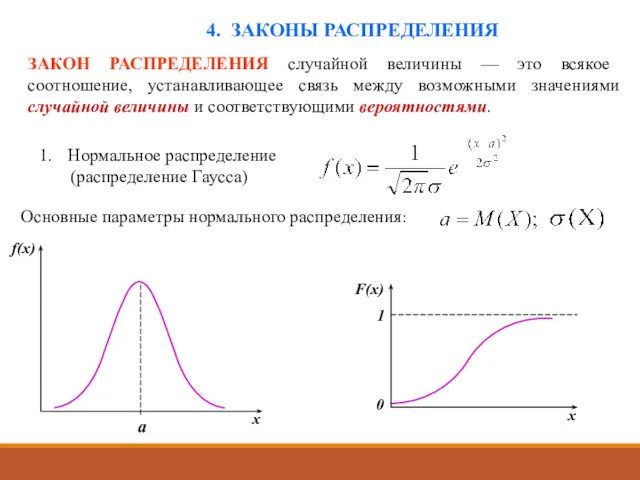

- 31. 4. ЗАКОНЫ РАСПРЕДЕЛЕНИЯ ЗАКОН РАСПРЕДЕЛЕНИЯ случайной величины — это всякое соотношение, устанавливающее связь между возможными значениями

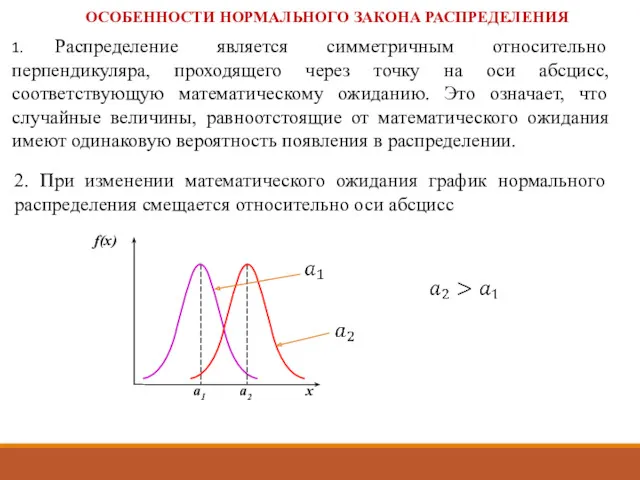

- 32. ОСОБЕННОСТИ НОРМАЛЬНОГО ЗАКОНА РАСПРЕДЕЛЕНИЯ 1. Распределение является симметричным относительно перпендикуляра, проходящего через точку на оси абсцисс,

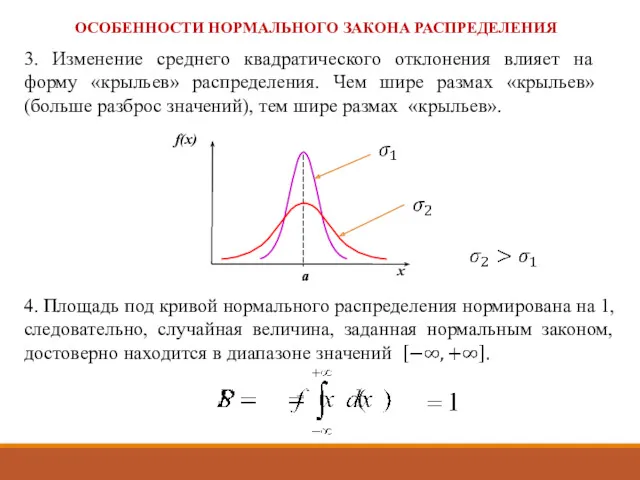

- 33. 3. Изменение среднего квадратического отклонения влияет на форму «крыльев» распределения. Чем шире размах «крыльев» (больше разброс

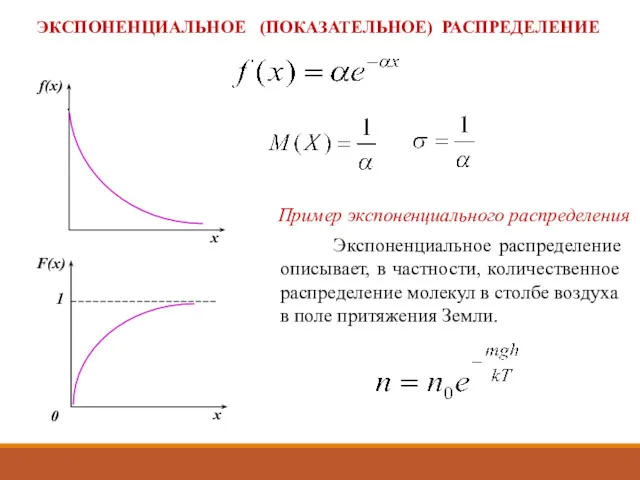

- 34. ЭКСПОНЕНЦИАЛЬНОЕ (ПОКАЗАТЕЛЬНОЕ) РАСПРЕДЕЛЕНИЕ Экспоненциальное распределение описывает, в частности, количественное распределение молекул в столбе воздуха в поле

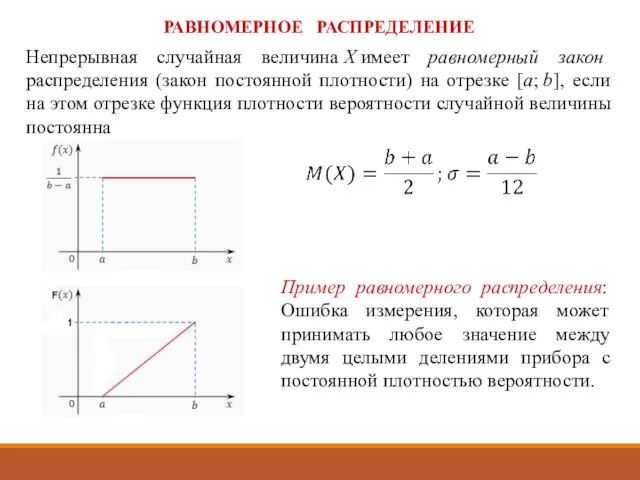

- 35. Непрерывная случайная величина Х имеет равномерный закон распределения (закон постоянной плотности) на отрезке [a; b], если

- 37. ТЕОРИЯ ВЕРОЯТНОСТЕЙ Медицина – наука экспериментальная и носит вероятностный характер: постановка диагноза по комплексу признаков, воздействие

- 40. Скачать презентацию

Умножение целых чисел

Умножение целых чисел Минимизация классических функций в классе ДНФ

Минимизация классических функций в классе ДНФ Множества и операции над ними

Множества и операции над ними Луч, прямая, отрезок.

Луч, прямая, отрезок. Золотое сечение. Геометрические законы гармонии

Золотое сечение. Геометрические законы гармонии Платоновы тела

Платоновы тела Логарифмические неравенства

Логарифмические неравенства Своя игра. Четырехугольники

Своя игра. Четырехугольники Графы

Графы Верно/неверно. Математические примеры

Верно/неверно. Математические примеры Длина окружности и площадь круга

Длина окружности и площадь круга Действия с дробями. Решение задач по теме: нахождение части целого

Действия с дробями. Решение задач по теме: нахождение части целого Отношение двух чисел

Отношение двух чисел Ықтималдылықтар теориясының элементтері дегеніміз не

Ықтималдылықтар теориясының элементтері дегеніміз не Решение задач по теме: Параллельность плоскостей

Решение задач по теме: Параллельность плоскостей Таблица умножения

Таблица умножения Основные моменты тригонометрии

Основные моменты тригонометрии Геометрик фигураларны беләсеңме?

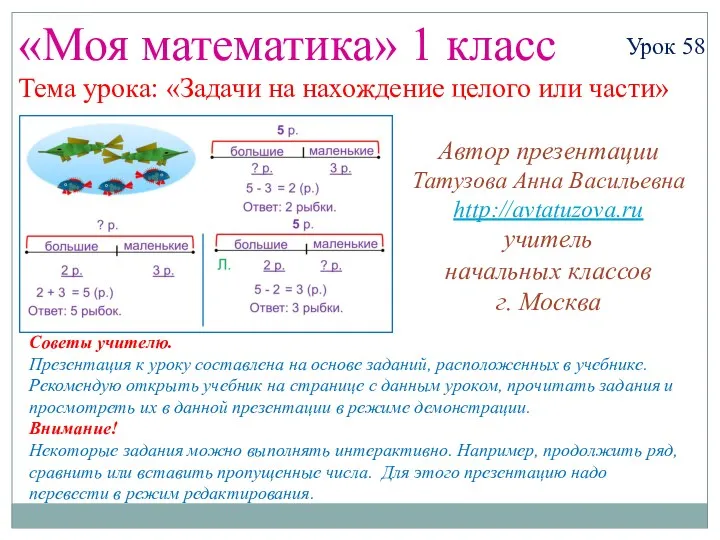

Геометрик фигураларны беләсеңме? Математика. 1 класс. Урок 58. Задачи на нахождение целого или части - Презентация

Математика. 1 класс. Урок 58. Задачи на нахождение целого или части - Презентация Теорема Шеннона

Теорема Шеннона Теория принятия решений. Решение игр MxN

Теория принятия решений. Решение игр MxN Условная оптимизация. Метод штрафных функций

Условная оптимизация. Метод штрафных функций Урок математики 4 класс. Тема Деление числа на произведение

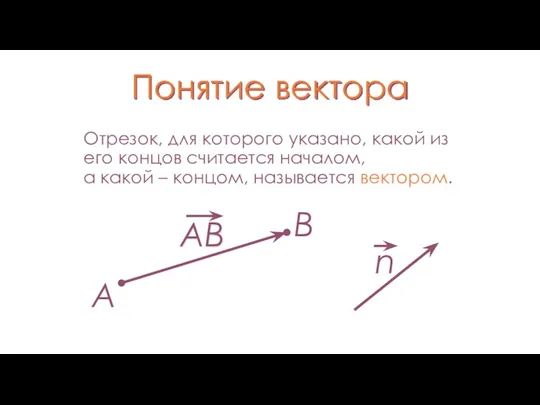

Урок математики 4 класс. Тема Деление числа на произведение Понятие вектора

Понятие вектора Координатная плоскость. Урок 51

Координатная плоскость. Урок 51 презентация по математике 2 класс

презентация по математике 2 класс Логарифмы вокруг нас

Логарифмы вокруг нас Четыре замечательные точки треугольника

Четыре замечательные точки треугольника