Содержание

- 2. Под оптимизацией понимают процесс выбора наилучшего варианта из всех возможных В процессе решения задачи оптимизации обычно

- 3. Выбор оптимального решения или сравнение двух альтернативных решений проводится с помощью некоторой зависимой величины (функции), определя-емой

- 4. Задачи оптимизации. Безусловная задача оптимизации состоит в отыскании максимума или минимума действительной функции от n действительных

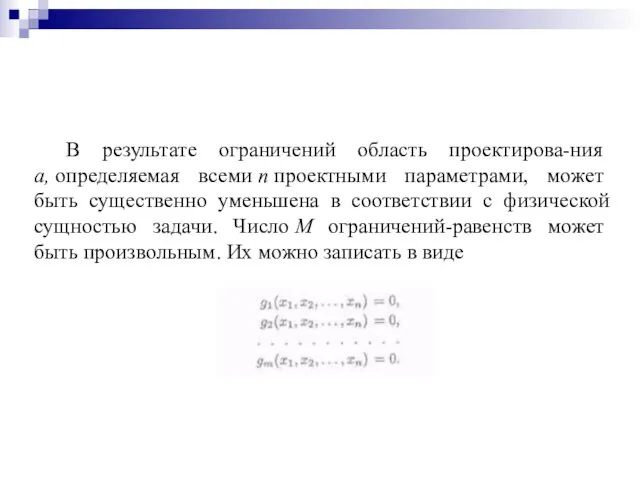

- 5. В результате ограничений область проектирова-ния а, определяемая всеми п проектными параметрами, может быть существенно уменьшена в

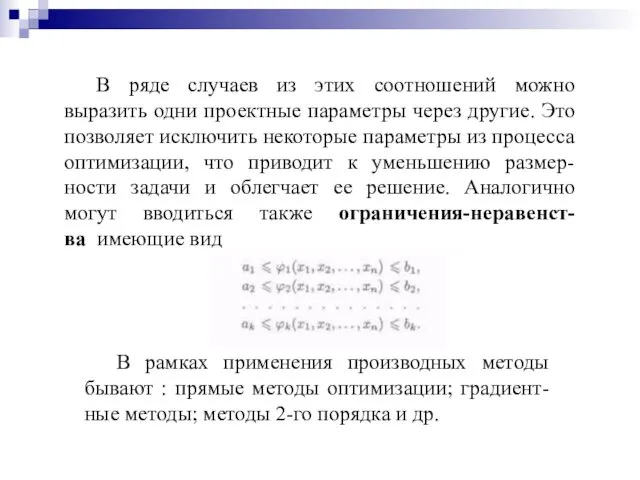

- 6. В ряде случаев из этих соотношений можно выразить одни проектные параметры через другие. Это позволяет исключить

- 7. Одномерная оптимизация. Одномерная задача оптимизации в общем случае формулируется следующим образом: Найти наименьшее (или наибольшее) значение

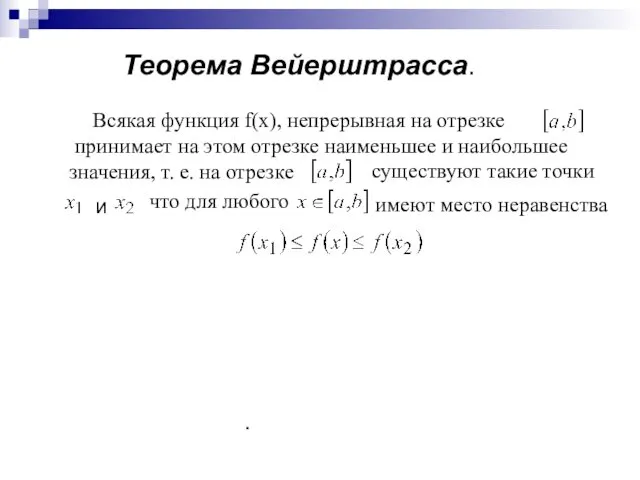

- 8. Теорема Вейерштрасса. Всякая функция f(x), непрерывная на отрезке принимает на этом отрезке наименьшее и наибольшее значения,

- 9. Многомерная оптимизация. Метод нулевого порядка не берет в расчет производные минимизированной функции, ввиду чего их использование

- 10. Методы безусловной оптимизации. Хука и Дживса (осуществление 2 видов поиска – по образцу и исследующий); Минимизации

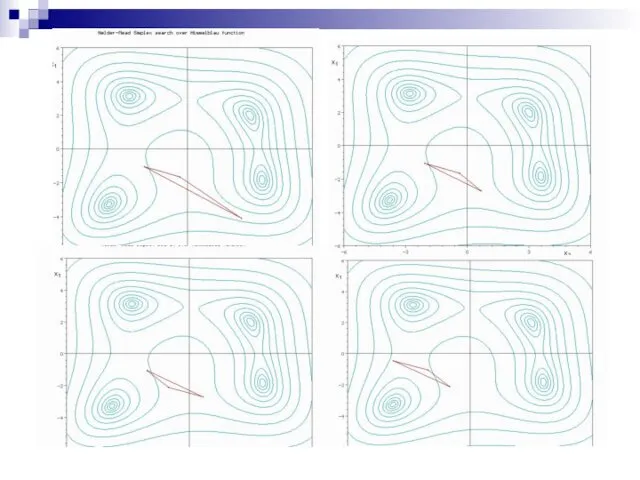

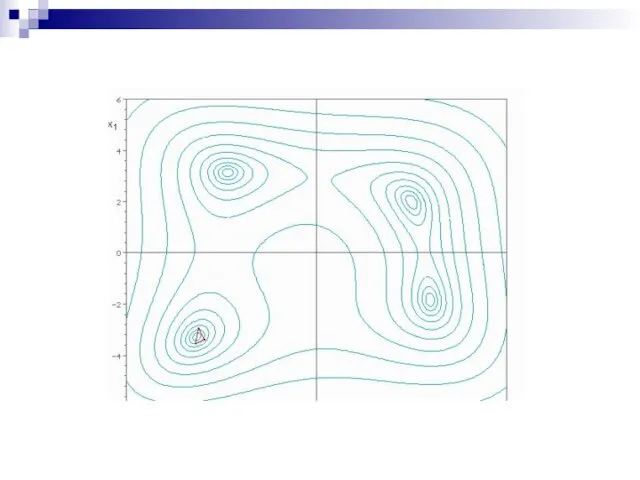

- 11. Метод Нелдера - Мида, также известный как метод деформируемого многогранника и симплекс-метод, метод безусловной оптимизации функции

- 14. Эволюционные алгоритмы Эволюционные алгоритмы - направление в искусственном интеллекте (раздел эволюционного моде-лирования), которое использует и моделирует

- 16. Скачать презентацию

Экономические учения древнего Китая

Экономические учения древнего Китая А.Н.Островский Бедность не порок

А.Н.Островский Бедность не порок Изучение иностранных языков в контексте диалога культур. Межкультурная компетенция

Изучение иностранных языков в контексте диалога культур. Межкультурная компетенция Страна огнедышащих гор презентация

Страна огнедышащих гор презентация Стратегия подготовки к экзаменам

Стратегия подготовки к экзаменам Специальная психология. Нормативное и отклоняющее развитие. Понятие депривации. (Лекция 4)

Специальная психология. Нормативное и отклоняющее развитие. Понятие депривации. (Лекция 4) презентация проекта Детская филармония

презентация проекта Детская филармония 20231013_volgodonskoy_pedagogicheskiy_kolledzh_gbpou_ro_vpk

20231013_volgodonskoy_pedagogicheskiy_kolledzh_gbpou_ro_vpk Основы безопасности жизнедеятельности в сети интернет. Безопасная работа для рук и спины

Основы безопасности жизнедеятельности в сети интернет. Безопасная работа для рук и спины Good health is above wealth

Good health is above wealth Бюджетный федерализм

Бюджетный федерализм Внеклассное мероприятие Здорово быть здоровым!

Внеклассное мероприятие Здорово быть здоровым! Геодезические купола

Геодезические купола Поздравление с Днём рождения

Поздравление с Днём рождения Физиология пищеварения в желудке. Желудочный сок, химус, пища

Физиология пищеварения в желудке. Желудочный сок, химус, пища Инновационные технологии в сохранении биоразнообразия

Инновационные технологии в сохранении биоразнообразия Чуковский

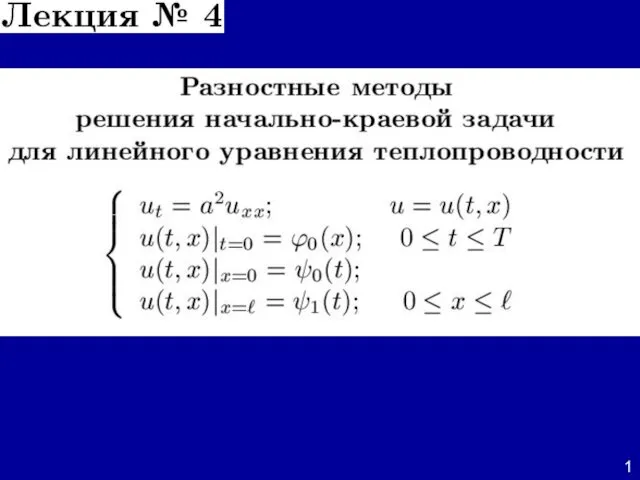

Чуковский Лекция_4_Численное_решение_УрТеплопр

Лекция_4_Численное_решение_УрТеплопр Интеграция предприятий

Интеграция предприятий М. И. Глинка. Вокальное творчество

М. И. Глинка. Вокальное творчество Программное обеспечение АИУС

Программное обеспечение АИУС Уголок экспериментирования в младшей группе

Уголок экспериментирования в младшей группе Online - факудьтет. Дистанционное образование

Online - факудьтет. Дистанционное образование Ауыздың кілегей қабығының гиперкератотикалық өзгерістері бар науқастарға көмекті жоспарлау

Ауыздың кілегей қабығының гиперкератотикалық өзгерістері бар науқастарға көмекті жоспарлау Местоимение – это самостоятельная часть речи

Местоимение – это самостоятельная часть речи В бизнесе всё решают связью. Коммерческое предложение ПАО Ростелеком

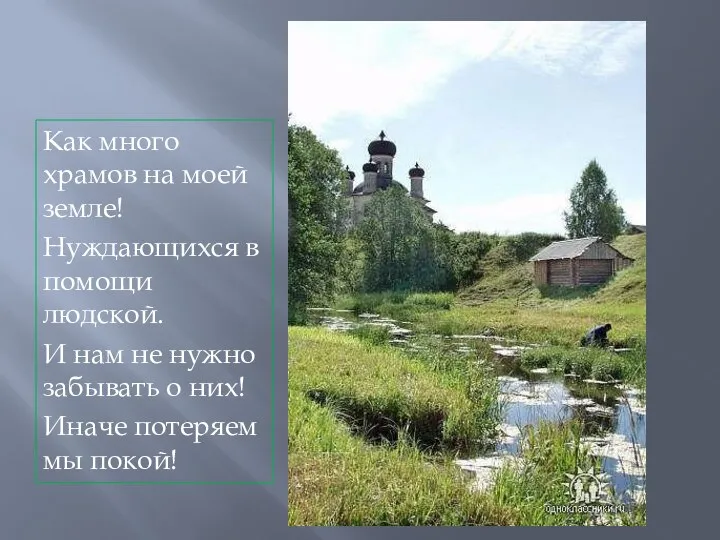

В бизнесе всё решают связью. Коммерческое предложение ПАО Ростелеком История храма Преображения Господня в деревне Монастырская Сямженского района Вологодской области

История храма Преображения Господня в деревне Монастырская Сямженского района Вологодской области Родительское собрание для родителей будущих первоклассников. Ваш ребёнок идёт в школу.

Родительское собрание для родителей будущих первоклассников. Ваш ребёнок идёт в школу.