Содержание

- 2. РЕКУРРЕНТНАЯ НЕЙРОННАЯ СЕТЬ (Recurrent Neural Network, RNN) – это НС с элементами памяти (временной задержки) на

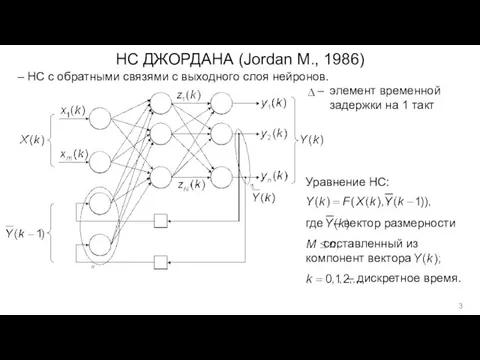

- 3. НС ДЖОРДАНА (Jordan M., 1986) – НС с обратными связями с выходного слоя нейронов. Уравнение НС:

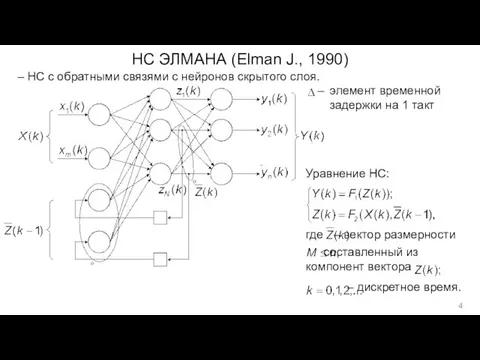

- 4. НС ЭЛМАНА (Elman J., 1990) – НС с обратными связями с нейронов скрытого слоя. Уравнение НС:

- 5. ПРОГНОЗИРОВАНИЕ ВРЕМЕННЫХ РЯДОВ Решение: НС-предиктор на базе персептрона Количество нейронов: Обучающая выборка: СКО: Точность прогноза:

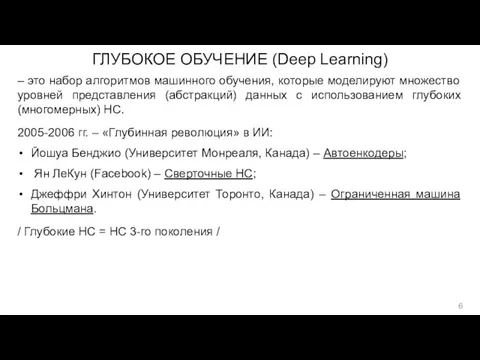

- 6. ГЛУБОКОЕ ОБУЧЕНИЕ (Deep Learning) – это набор алгоритмов машинного обучения, которые моделируют множество уровней представления (абстракций)

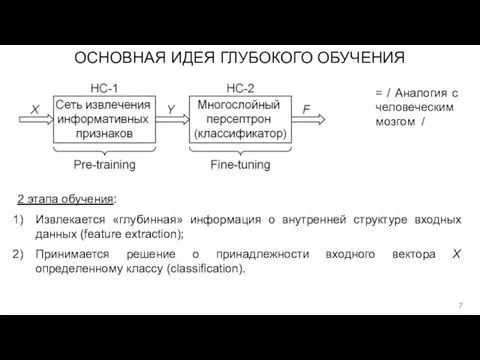

- 7. ОСНОВНАЯ ИДЕЯ ГЛУБОКОГО ОБУЧЕНИЯ 2 этапа обучения: Извлекается «глубинная» информация о внутренней структуре входных данных (feature

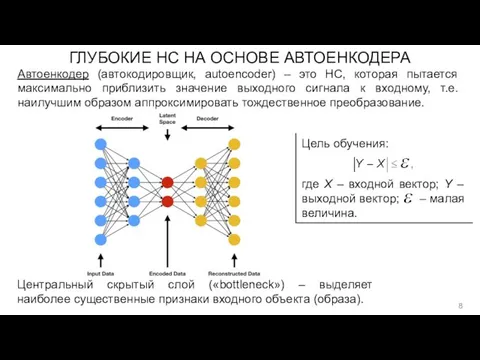

- 8. ГЛУБОКИЕ НС НА ОСНОВЕ АВТОЕНКОДЕРА Автоенкодер (автокодировщик, autoencoder) – это НС, которая пытается максимально приблизить значение

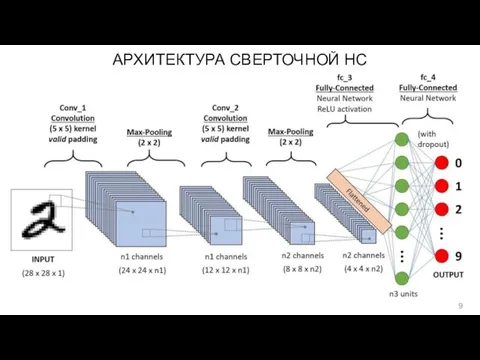

- 9. АРХИТЕКТУРА СВЕРТОЧНОЙ НС

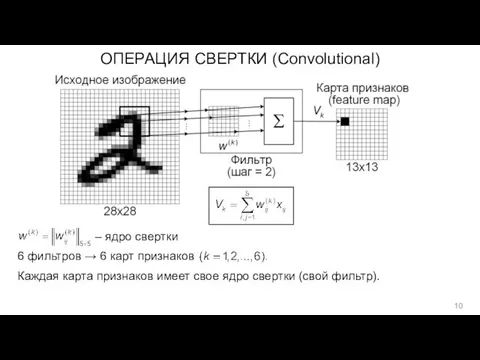

- 10. ОПЕРАЦИЯ СВЕРТКИ (Convolutional) – ядро свертки 6 фильтров → 6 карт признаков Каждая карта признаков имеет

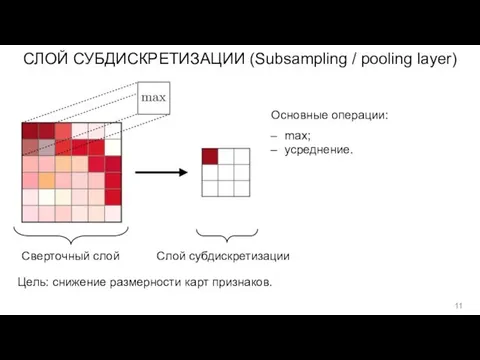

- 11. СЛОЙ СУБДИСКРЕТИЗАЦИИ (Subsampling / pooling layer) Цель: снижение размерности карт признаков. Основные операции: max; усреднение. Сверточный

- 12. ВИЗУАЛИЗАЦИЯ СЛОЕВ СВЕРТОЧНОЙ (иерархия признаков)

- 14. Скачать презентацию

Салыстыру және логикалық операторларды қолдану

Салыстыру және логикалық операторларды қолдану Параллельное программирование для ресурсоёмких задач численного моделирования в физике. Лекция 2

Параллельное программирование для ресурсоёмких задач численного моделирования в физике. Лекция 2 Анализ и мониторинг интернет-СМИ. Базы СМИ. Медиаисследования в интернете

Анализ и мониторинг интернет-СМИ. Базы СМИ. Медиаисследования в интернете CSS. Лекция 10

CSS. Лекция 10 Компьютерные словари и системы машинного перевода текстов

Компьютерные словари и системы машинного перевода текстов Інформаційні системи. Інтелектуальна власність та авторське право

Інформаційні системи. Інтелектуальна власність та авторське право Синхронизация в OpenMP

Синхронизация в OpenMP Counter-Strike: Global Offensive. Разработка компьютерных игр

Counter-Strike: Global Offensive. Разработка компьютерных игр Прийоми забезпечення технологічності програмних продуктів. Низхідне та висхідне програмування. Метод покрокової деталізації

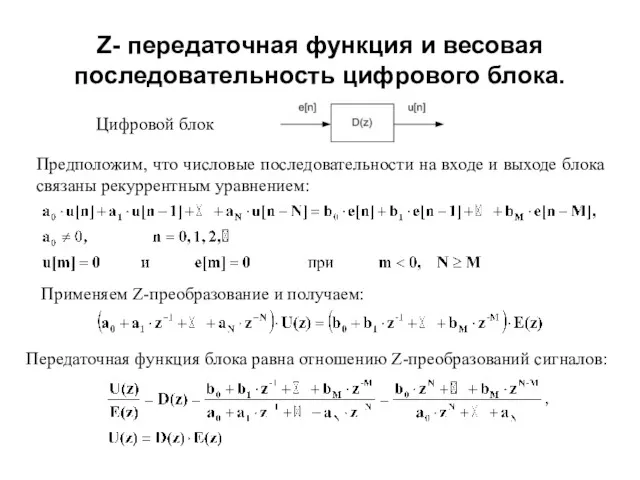

Прийоми забезпечення технологічності програмних продуктів. Низхідне та висхідне програмування. Метод покрокової деталізації Z-передаточная функция и весовая последовательность цифрового блока. (Лекция 6)

Z-передаточная функция и весовая последовательность цифрового блока. (Лекция 6) Масиви. Введення даних у масив

Масиви. Введення даних у масив Қатты диск құрылысы. Жинақтауыштың негізгі түйіндері

Қатты диск құрылысы. Жинақтауыштың негізгі түйіндері Разработка модуля CMS Drupal для создания тестов и оценки знаний пользователей

Разработка модуля CMS Drupal для создания тестов и оценки знаний пользователей Засоби UML для моделювання в програмній інженерії

Засоби UML для моделювання в програмній інженерії Грошові перекази та інтернет- магазини

Грошові перекази та інтернет- магазини Интернет Вещей. Умный дом как пример технологии

Интернет Вещей. Умный дом как пример технологии Розвиток інформатики в Україні

Розвиток інформатики в Україні Сетевая журналистика

Сетевая журналистика Текстовый редактор Microsoft office Word

Текстовый редактор Microsoft office Word Welcome To Epson Printer Customer Care Center

Welcome To Epson Printer Customer Care Center Памятка для школьника. Как создать виртуальную экскурсию в программе Microsoft Office PowerPoint

Памятка для школьника. Как создать виртуальную экскурсию в программе Microsoft Office PowerPoint SAP HANA – платформа для бизнеса в реальном времени

SAP HANA – платформа для бизнеса в реальном времени Моделирование памяти. Информационные объекты MATRIX. Организация циклов

Моделирование памяти. Информационные объекты MATRIX. Организация циклов Вычисления в таблицах Excel

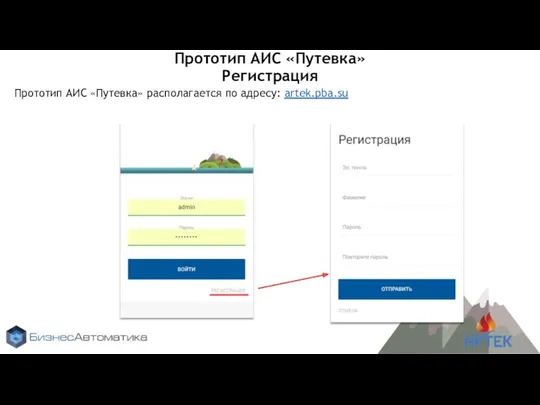

Вычисления в таблицах Excel Прототип АИС Путевка. Регистрация

Прототип АИС Путевка. Регистрация Алгоритм построения орграфа Хаффмана (алгоритм сжатия)

Алгоритм построения орграфа Хаффмана (алгоритм сжатия) Поиск и сортировка информации в базах данных. ЕГЭ

Поиск и сортировка информации в базах данных. ЕГЭ Браузеры и поисковые системы

Браузеры и поисковые системы