Содержание

- 2. Cоціально-економічні явища взаємозв'язані та взаємозумовлені і зв'язок (залежність) між ними носить причинно-наслідковий характер. Фактор - причини

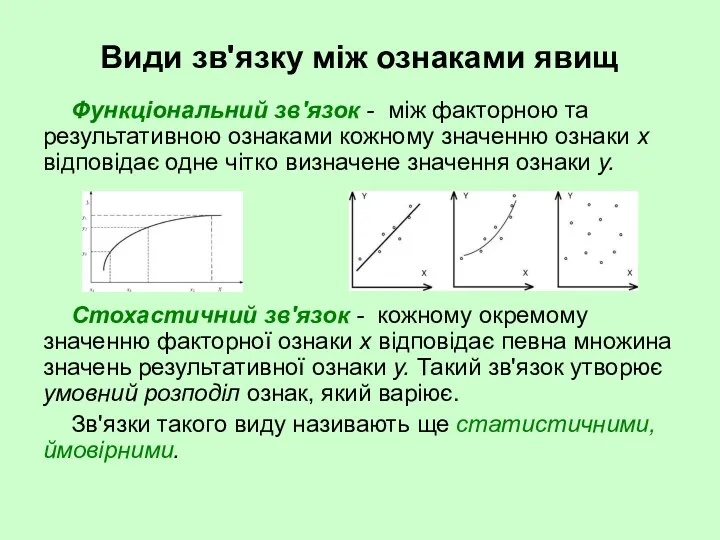

- 3. Види зв'язку між ознаками явищ Функціональний зв'язок - між факторною та результативною ознаками кожному значенню ознаки

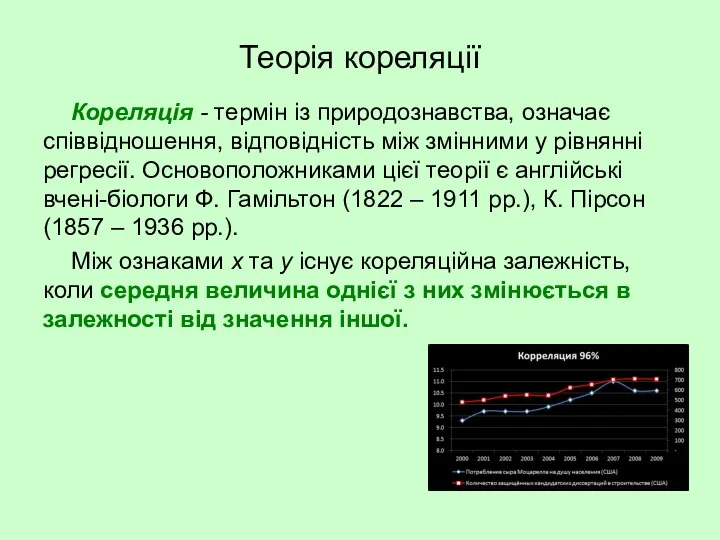

- 4. Теорія кореляції Кореляція - термін із природознавства, означає співвідношення, відповідність між змінними у рівнянні регресії. Основоположниками

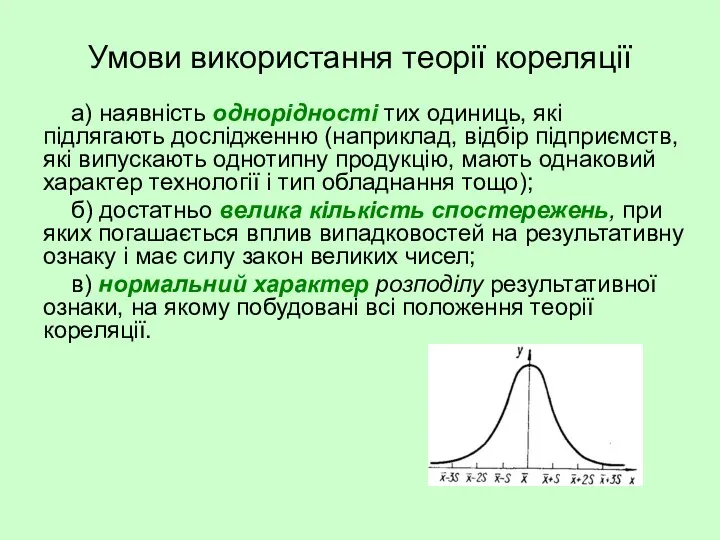

- 5. Умови використання теорії кореляції а) наявність однорідності тих одиниць, які підлягають дослідженню (наприклад, відбір підприємств, які

- 6. Кореляційно-регресійний аналіз КРА полягає у виборі виду рівняння регресії, обчисленні його параметрів та встановленні адекватності (відповідності)

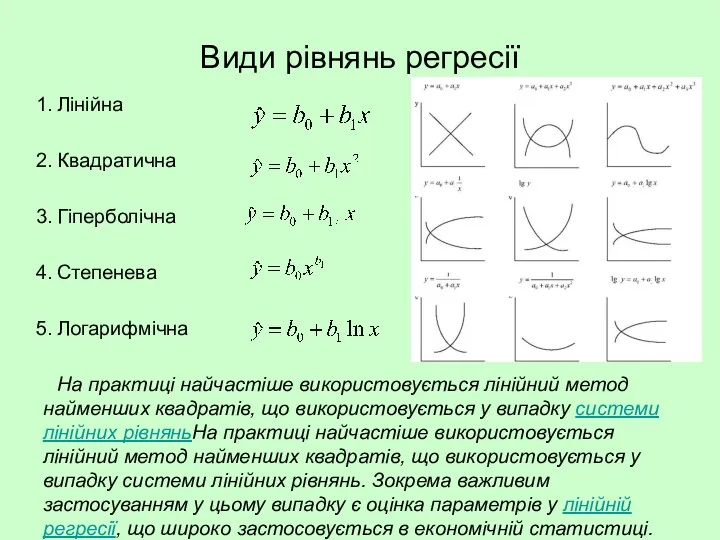

- 7. Види рівнянь регресії Лінійна Квадратична Гіперболічна Степенева Логарифмічна На практиці найчастіше використовується лінійний метод найменших квадратів,

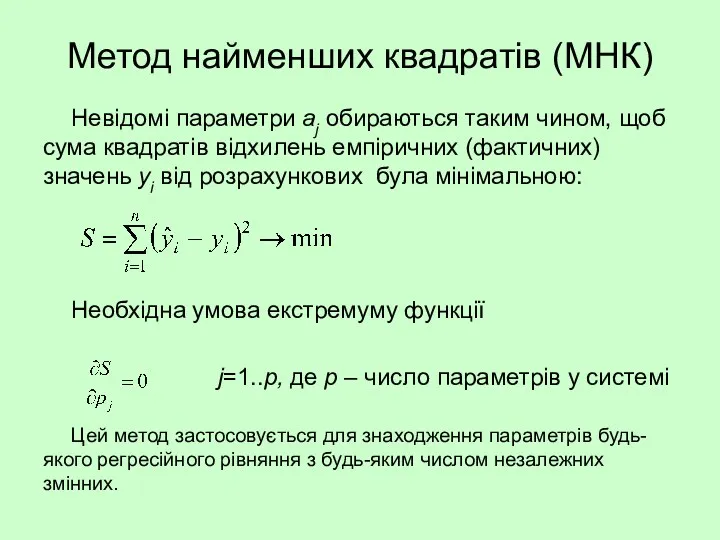

- 8. Метод найменших квадратів (МНК) Невідомі параметри аj обираються таким чином, щоб сума квадратів відхилень емпіричних (фактичних)

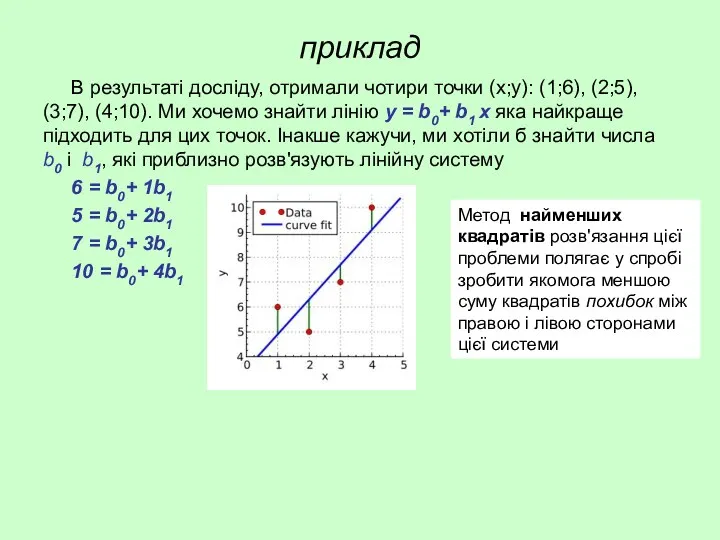

- 9. приклад В результаті досліду, отримали чотири точки (х;у): (1;6), (2;5), (3;7), (4;10). Ми хочемо знайти лінію

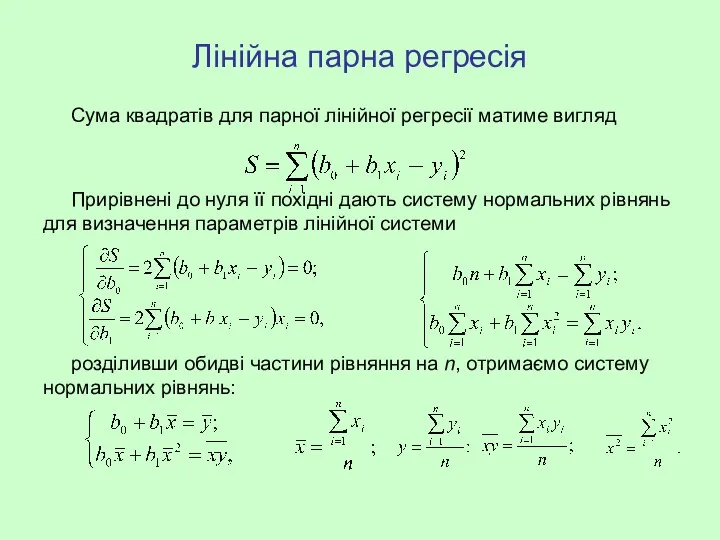

- 10. Лінійна парна регресія Сума квадратів для парної лінійної регресії матиме вигляд Прирівнені до нуля її похідні

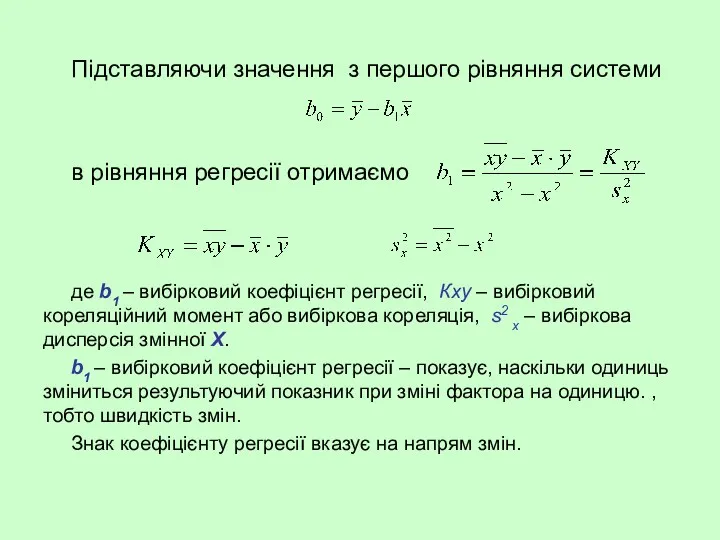

- 11. Підставляючи значення з першого рівняння системи в рівняння регресії отримаємо де b1 – вибірковий коефіцієнт регресії,

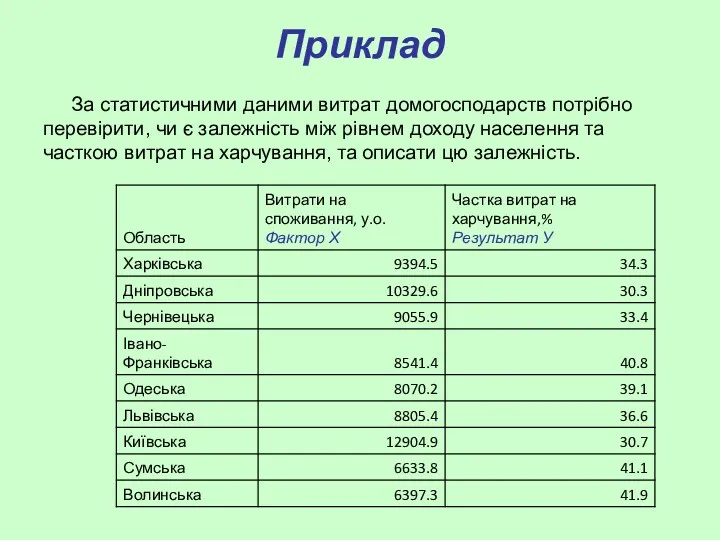

- 12. Приклад За статистичними даними витрат домогосподарств потрібно перевірити, чи є залежність між рівнем доходу населення та

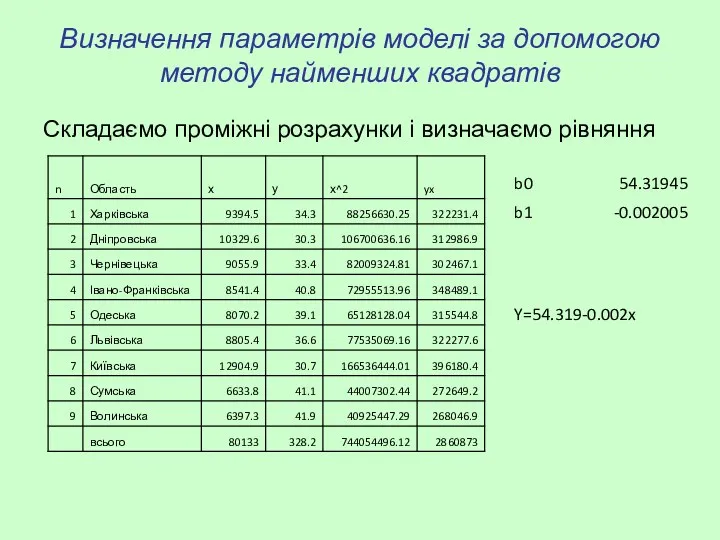

- 13. Визначення параметрів моделі за допомогою методу найменших квадратів Складаємо проміжні розрахунки і визначаємо рівняння

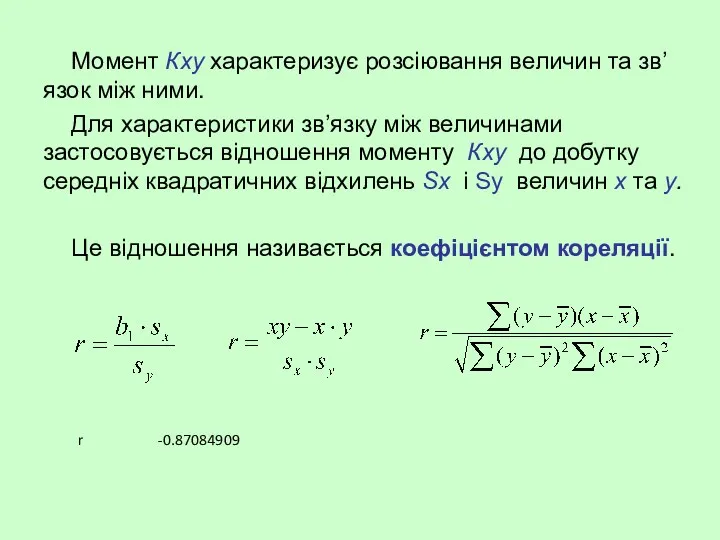

- 14. Момент Кху характеризує розсіювання величин та зв’язок між ними. Для характеристики зв’язку між величинами застосовується відношення

- 15. Властивості коефіцієнта кореляції Коефіцієнт кореляції приймає значення на відрізку [-1;1]. Чим ближче |r| до 1, тим

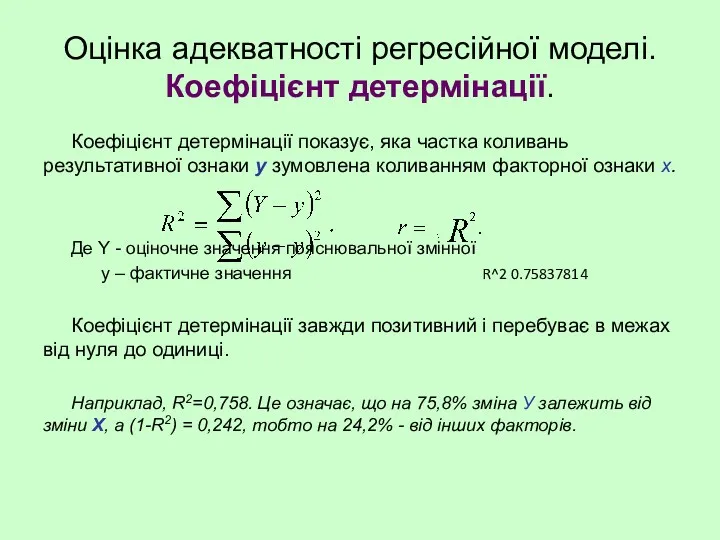

- 16. Оцінка адекватності регресійної моделі. Коефіцієнт детермінації. Коефіцієнт детермінації показує, яка частка коливань результативної ознаки y зумовлена

- 17. Властивості коефіцієнта детермінації Коефіцієнт детермінації приймає значення на відрізку [0;1], тобто 0≤R2≤1. Чим ближче R2 до

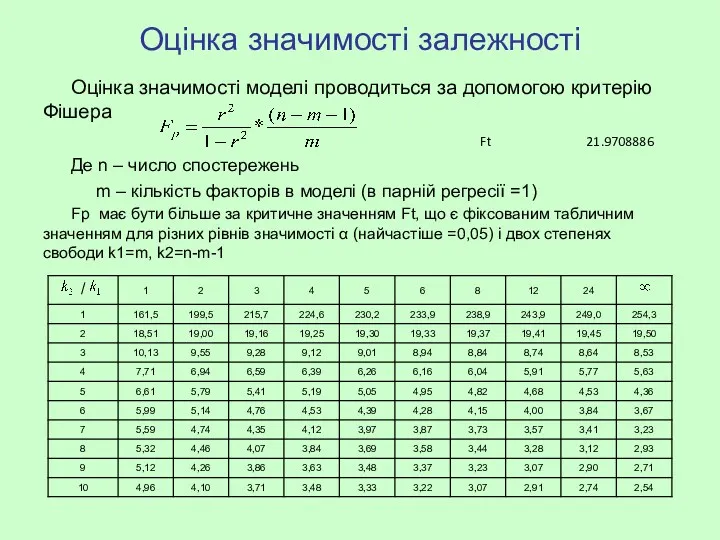

- 18. Оцінка значимості залежності Оцінка значимості моделі проводиться за допомогою критерію Фішера Де n – число спостережень

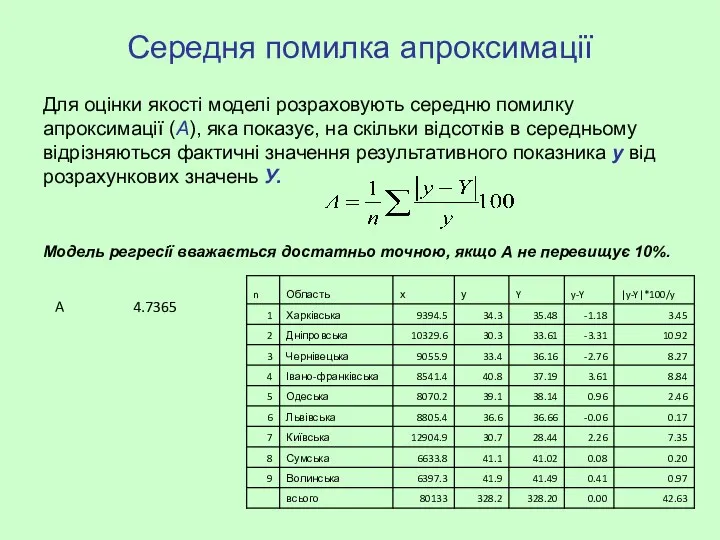

- 19. Середня помилка апроксимації Для оцінки якості моделі розраховують середню помилку апроксимації (А), яка показує, на скільки

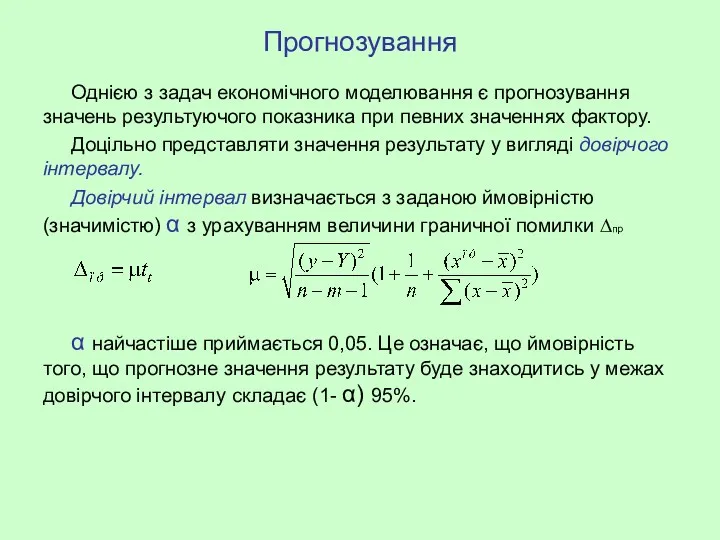

- 20. Прогнозування Однією з задач економічного моделювання є прогнозування значень результуючого показника при певних значеннях фактору. Доцільно

- 22. Скачать презентацию

![Властивості коефіцієнта кореляції Коефіцієнт кореляції приймає значення на відрізку [-1;1].](/_ipx/f_webp&q_80&fit_contain&s_1440x1080/imagesDir/jpg/382896/slide-14.jpg)

![Властивості коефіцієнта детермінації Коефіцієнт детермінації приймає значення на відрізку [0;1],](/_ipx/f_webp&q_80&fit_contain&s_1440x1080/imagesDir/jpg/382896/slide-16.jpg)

Открытый урок математики 3 класс

Открытый урок математики 3 класс Случайная величина (СВ) и закон ее распределения

Случайная величина (СВ) и закон ее распределения Расположите в порядке возрастания числа

Расположите в порядке возрастания числа Перетворення подібності та його властивості. Гомотетія

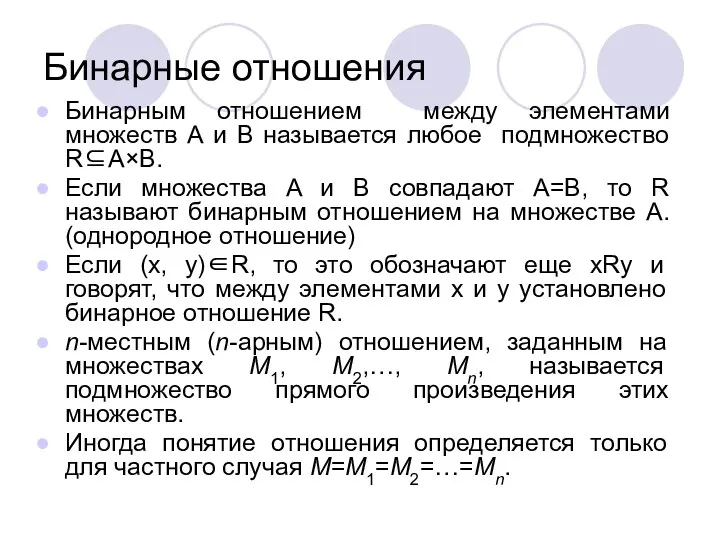

Перетворення подібності та його властивості. Гомотетія Бинарным отношением между элементами

Бинарным отношением между элементами Показательная и логарифмическая функция

Показательная и логарифмическая функция Развитие у детей раннего возраста восприятия цвета, формы и величины

Развитие у детей раннего возраста восприятия цвета, формы и величины Умножение круглых сотен. 3 класс

Умножение круглых сотен. 3 класс Случаи вычитания 12 -

Случаи вычитания 12 - Формулы сокращённого умножения. Урок обобщения. 7 класс

Формулы сокращённого умножения. Урок обобщения. 7 класс Великие математики. Интеллектуальный турнир

Великие математики. Интеллектуальный турнир Введение декартовых координат в пространстве. Формулы середины отрезка и расстояния между двумя точками

Введение декартовых координат в пространстве. Формулы середины отрезка и расстояния между двумя точками Математика в музыке

Математика в музыке Невский проспект Санкт-Петербурга в цифрах. Казанский собор (часть 5)

Невский проспект Санкт-Петербурга в цифрах. Казанский собор (часть 5) еометрические основы построения чертежей. Деление отрезков прямой, углов и окружностей на равные части

еометрические основы построения чертежей. Деление отрезков прямой, углов и окружностей на равные части Решение задач на нахождение дроби от числа. 6 класс

Решение задач на нахождение дроби от числа. 6 класс Модели статистического прогнозирования (11класс)

Модели статистического прогнозирования (11класс) Задачи по математике 5 класс

Задачи по математике 5 класс презентация к уроку математики по теме Устный счет по темеМногозначные числа 2 класс школа 2100

презентация к уроку математики по теме Устный счет по темеМногозначные числа 2 класс школа 2100 Скобки в числовом выражении

Скобки в числовом выражении Симметрия в пространстве. Элементы симметрии правильных многогранников

Симметрия в пространстве. Элементы симметрии правильных многогранников Основы технических измерений

Основы технических измерений Презентация НОД по математике

Презентация НОД по математике Интегральное исчисление

Интегральное исчисление Геометрические задачки на клетчатой бумаге

Геометрические задачки на клетчатой бумаге Состав числа

Состав числа Сравнение чисел. 6 класс

Сравнение чисел. 6 класс Графический метод в изучении коммерческой деятельности

Графический метод в изучении коммерческой деятельности