Содержание

- 2. Методы классификации Метрические методы классификации Логические методы классификации Линейные методы: метод стохастического градиента Линейные методы: метод

- 3. План лекции Минимизация эмпирического риска Линейный классификатор Метод стохастического градиента SG Градиентные методы обучения

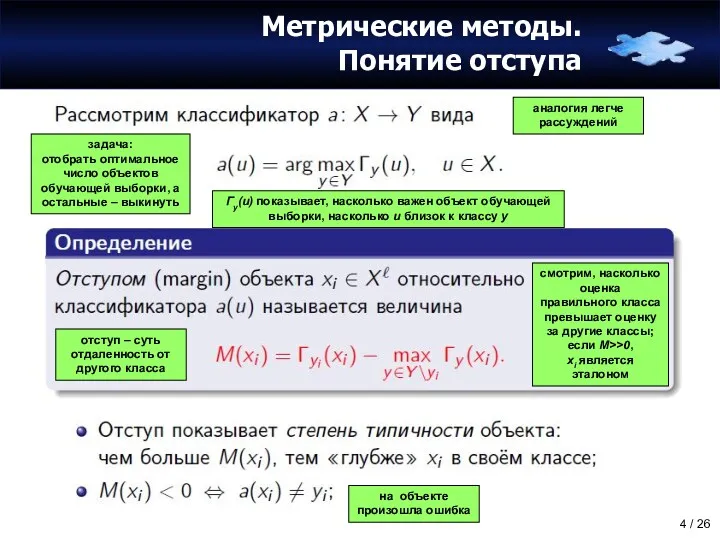

- 4. Метрические методы. Понятие отступа задача: отобрать оптимальное число объектов обучающей выборки, а остальные – выкинуть аналогия

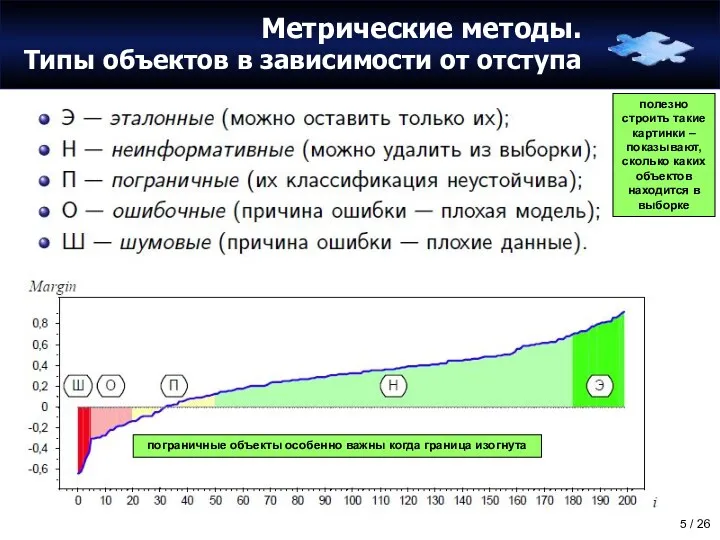

- 5. Метрические методы. Типы объектов в зависимости от отступа полезно строить такие картинки – показывают, сколько каких

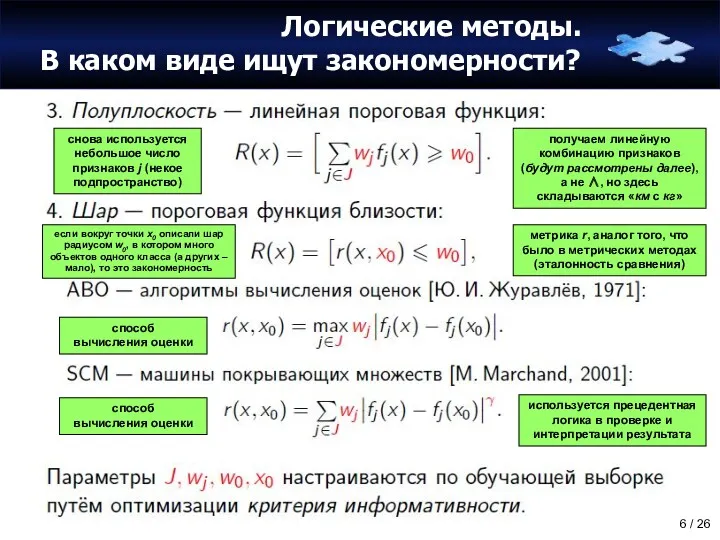

- 6. Логические методы. В каком виде ищут закономерности? получаем линейную комбинацию признаков (будут рассмотрены далее), а не

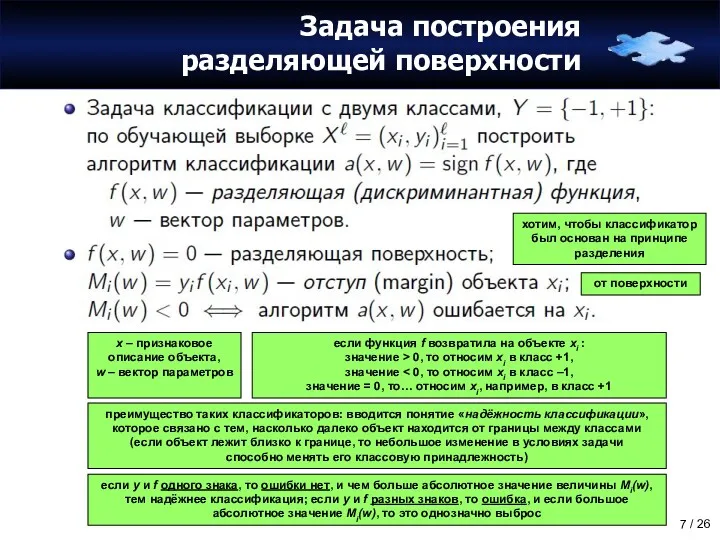

- 7. Задача построения разделяющей поверхности хотим, чтобы классификатор был основан на принципе разделения x – признаковое описание

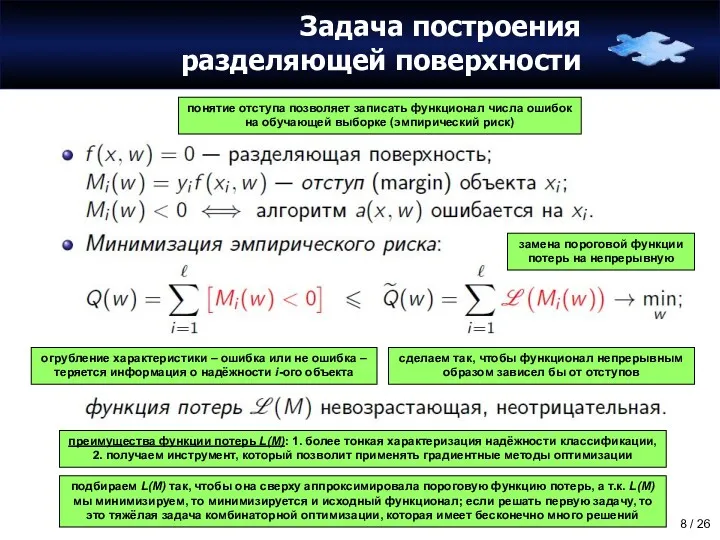

- 8. Задача построения разделяющей поверхности понятие отступа позволяет записать функционал числа ошибок на обучающей выборке (эмпирический риск)

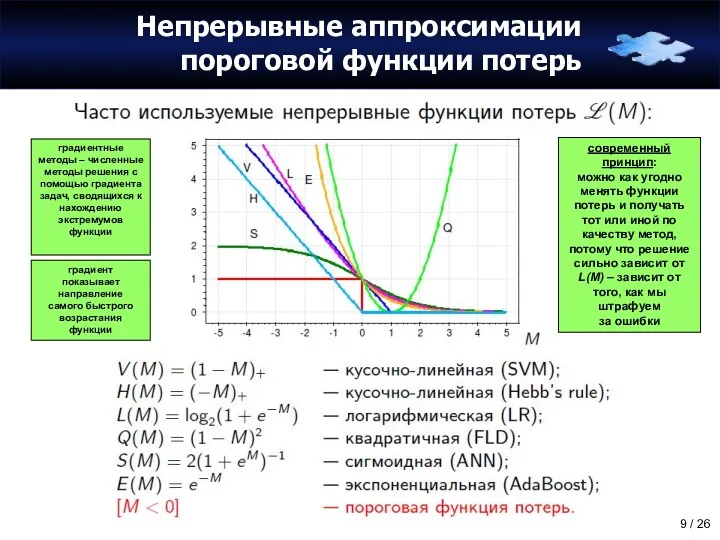

- 9. Непрерывные аппроксимации пороговой функции потерь градиентные методы – численные методы решения с помощью градиента задач, сводящихся

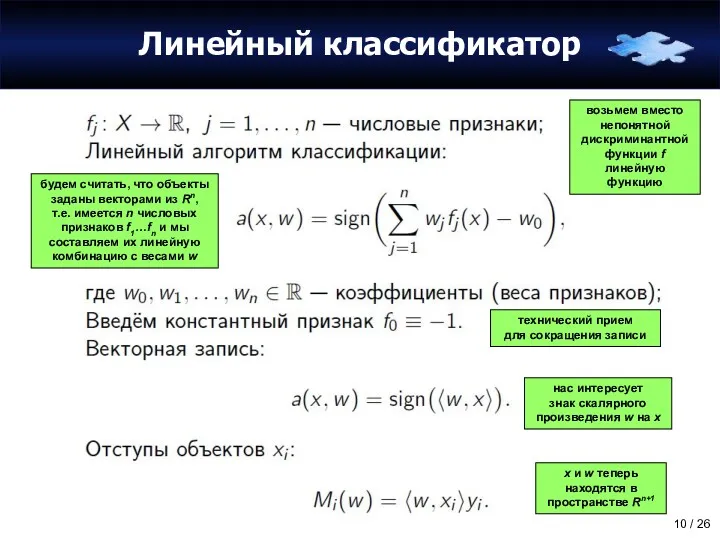

- 10. Линейный классификатор возьмем вместо непонятной дискриминантной функции f линейную функцию будем считать, что объекты заданы векторами

- 11. Похож ли нейрон на линейный классификатор?

- 12. Похож ли нейрон на линейный классификатор? Нейрон – это структурно-функциональная единица нервной системы, представляет собой электрически

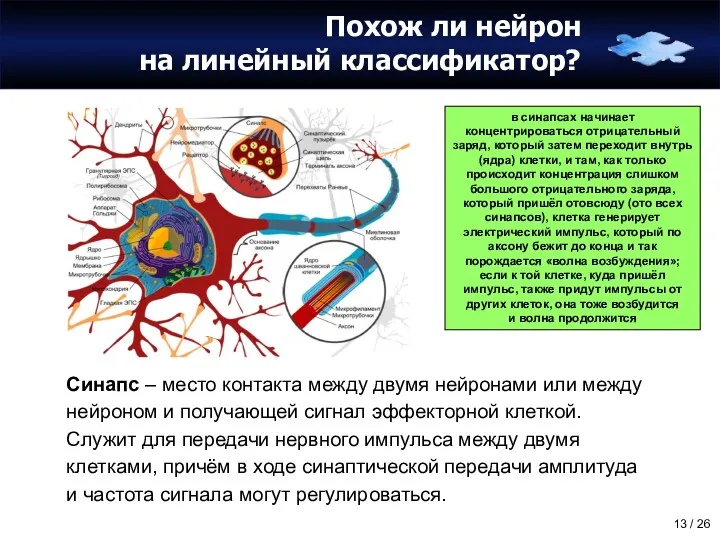

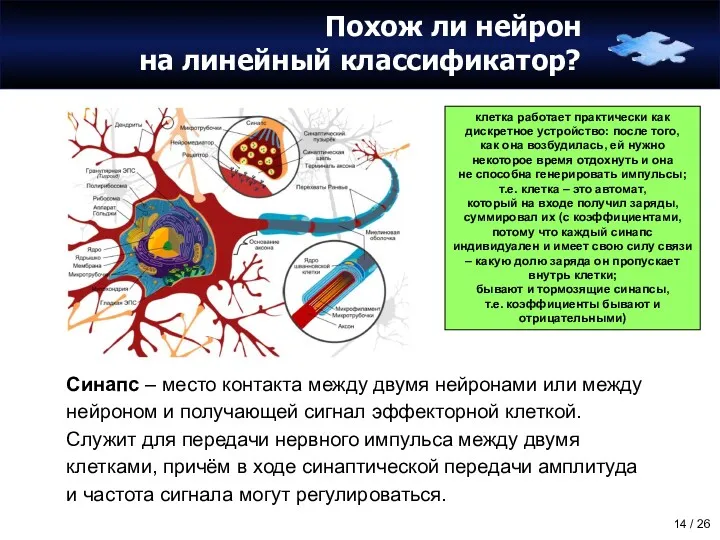

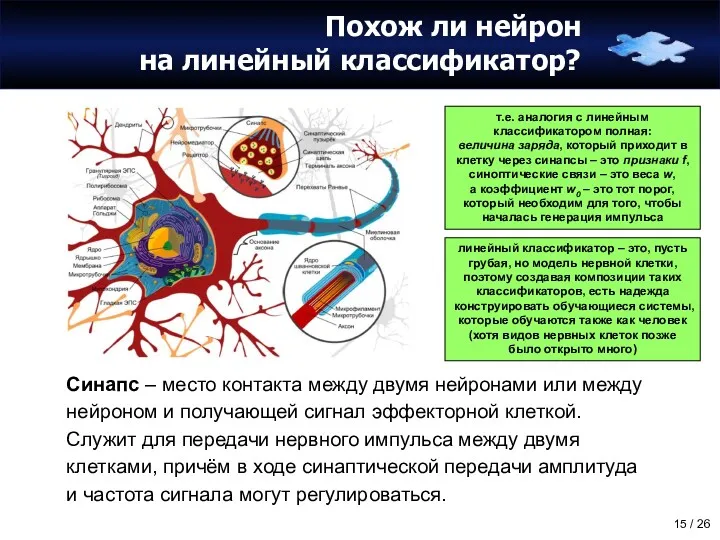

- 13. Похож ли нейрон на линейный классификатор? Синапс – место контакта между двумя нейронами или между нейроном

- 14. Похож ли нейрон на линейный классификатор? Синапс – место контакта между двумя нейронами или между нейроном

- 15. Похож ли нейрон на линейный классификатор? Синапс – место контакта между двумя нейронами или между нейроном

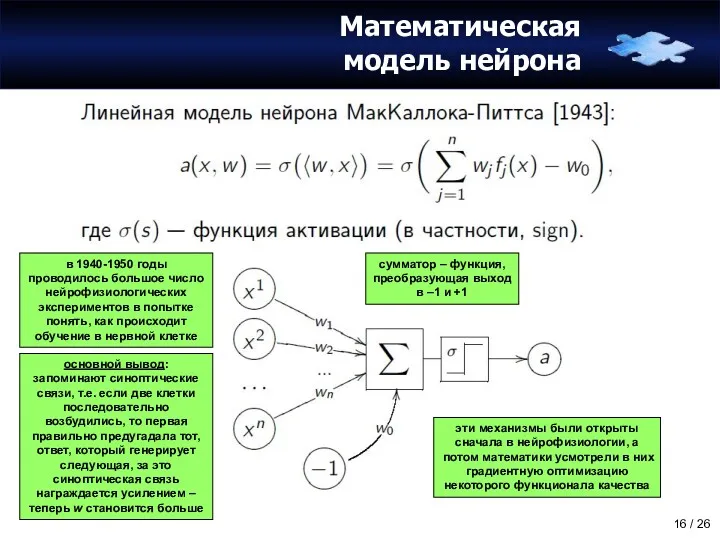

- 16. Математическая модель нейрона сумматор – функция, преобразующая выход в –1 и +1 в 1940-1950 годы проводилось

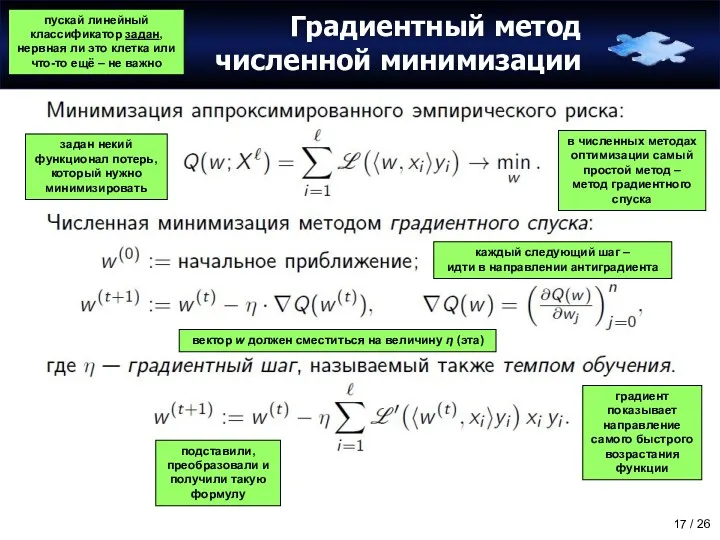

- 17. Градиентный метод численной минимизации пускай линейный классификатор задан, нервная ли это клетка или что-то ещё –

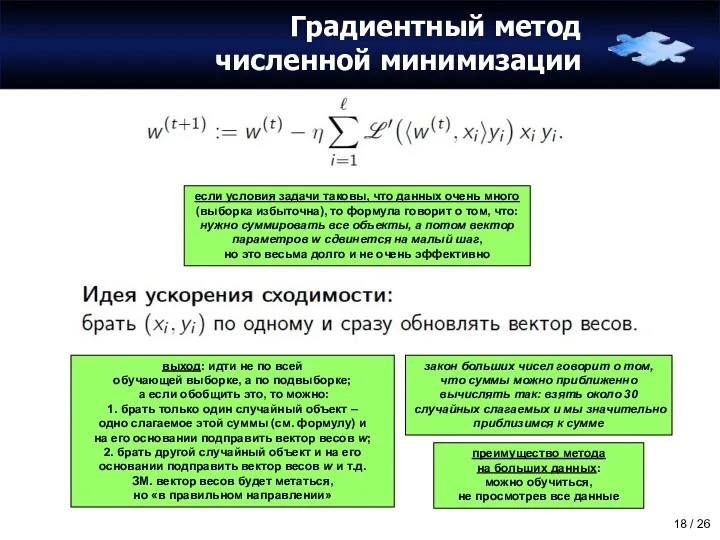

- 18. Градиентный метод численной минимизации если условия задачи таковы, что данных очень много (выборка избыточна), то формула

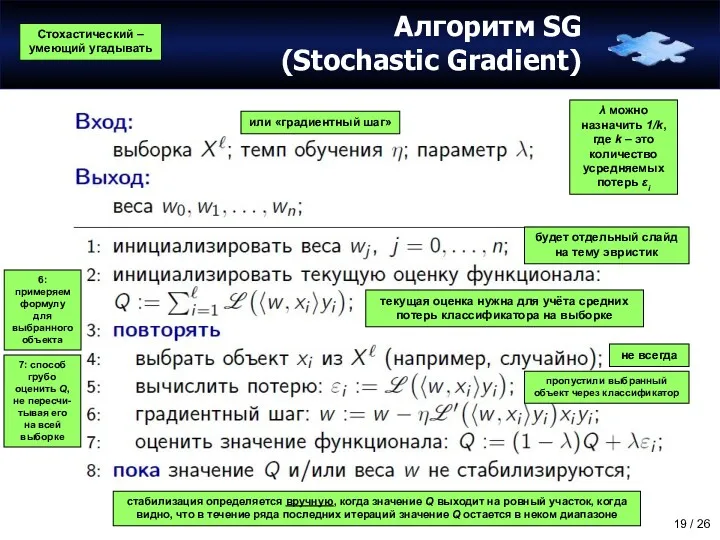

- 19. Алгоритм SG (Stochastic Gradient) Стохастический – умеющий угадывать будет отдельный слайд на тему эвристик или «градиентный

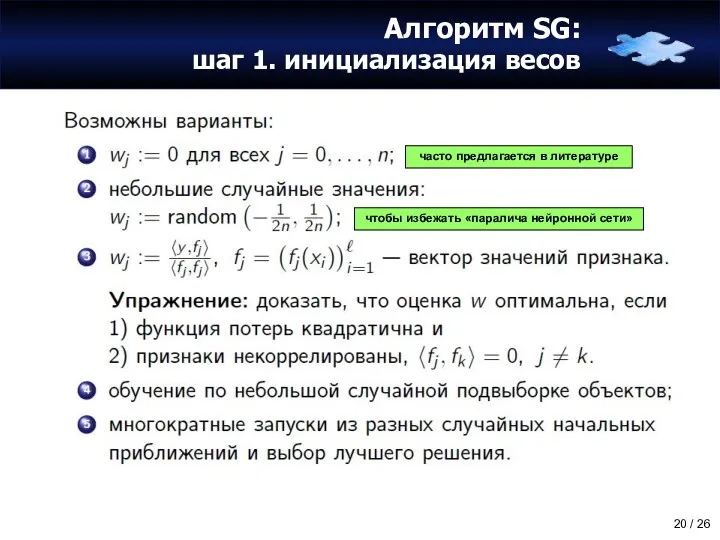

- 20. Алгоритм SG: шаг 1. инициализация весов часто предлагается в литературе чтобы избежать «паралича нейронной сети»

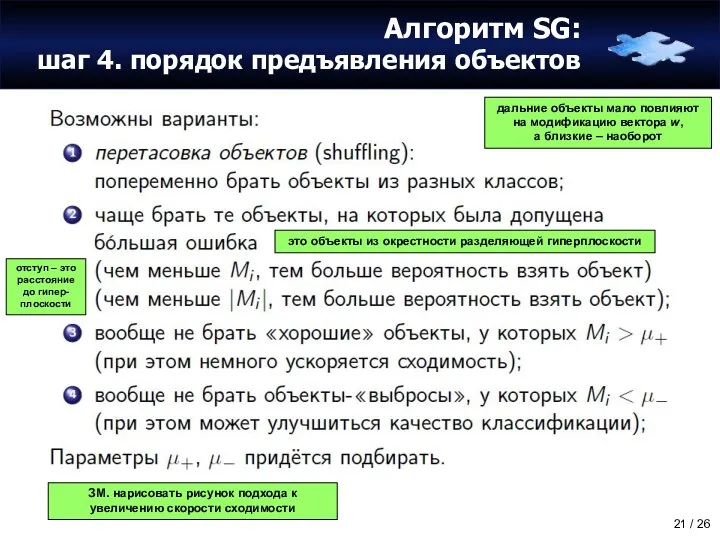

- 21. Алгоритм SG: шаг 4. порядок предъявления объектов дальние объекты мало повлияют на модификацию вектора w, а

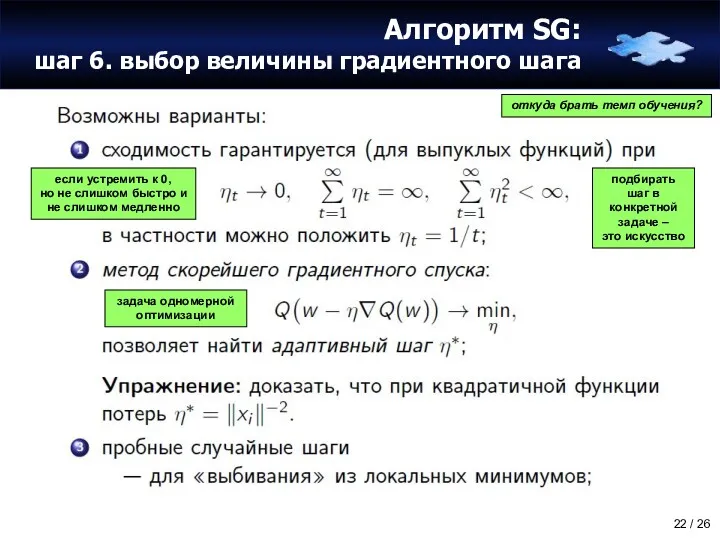

- 22. Алгоритм SG: шаг 6. выбор величины градиентного шага откуда брать темп обучения? если устремить к 0,

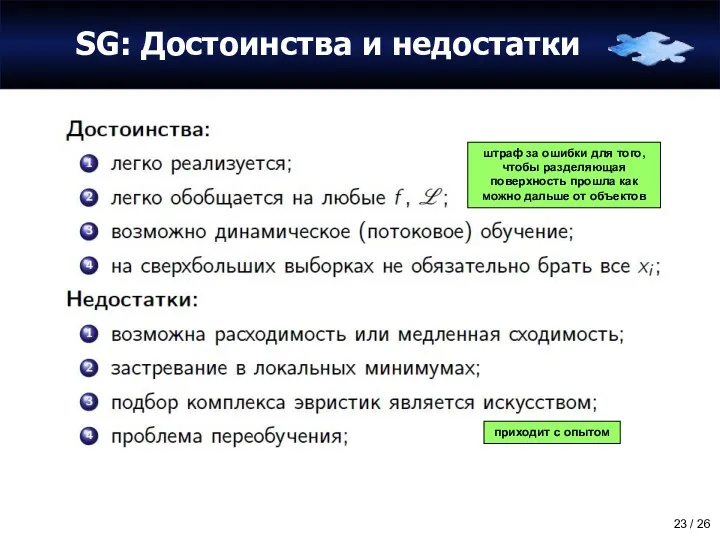

- 23. SG: Достоинства и недостатки штраф за ошибки для того, чтобы разделяющая поверхность прошла как можно дальше

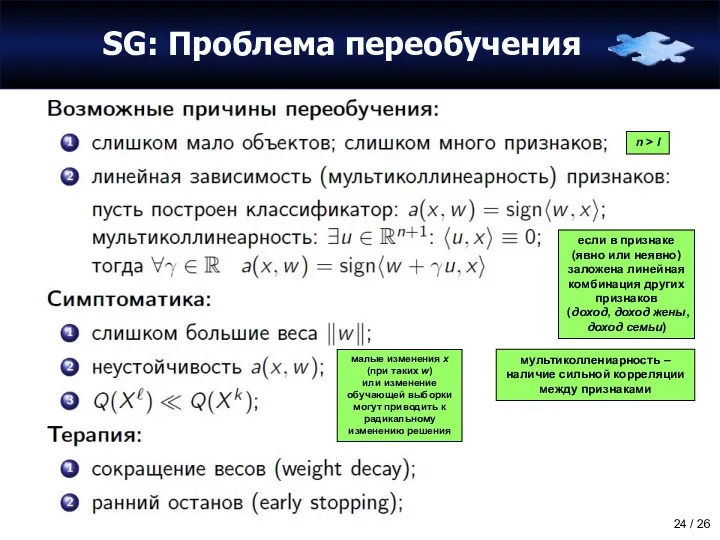

- 24. SG: Проблема переобучения если в признаке (явно или неявно) заложена линейная комбинация других признаков (доход, доход

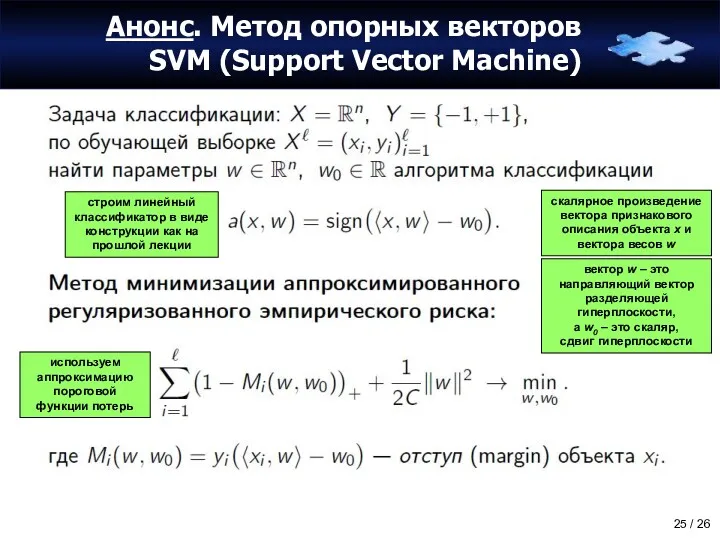

- 25. Анонс. Метод опорных векторов SVM (Support Vector Machine) строим линейный классификатор в виде конструкции как на

- 27. Скачать презентацию

Основы проектирования IP видеонаблюдения

Основы проектирования IP видеонаблюдения C & С++

C & С++ Тестирование как средство контроля знаний обучающихся

Тестирование как средство контроля знаний обучающихся Что такое HTML. PowerPoint

Что такое HTML. PowerPoint Математическое и имитационное моделирование

Математическое и имитационное моделирование CУБД Access

CУБД Access Квантовый компьютер: вчера, сегодня, завтра

Квантовый компьютер: вчера, сегодня, завтра Общие сведения о языке программирования Паскаль. Начала программирования. Информатика. 8 класс

Общие сведения о языке программирования Паскаль. Начала программирования. Информатика. 8 класс Цифровое видео

Цифровое видео Microsoft Visual Studio. Лекция 2

Microsoft Visual Studio. Лекция 2 Информационно-библиографические пособия. Виды и формы

Информационно-библиографические пособия. Виды и формы Тестовая работа_Топология сетей

Тестовая работа_Топология сетей Представление звуковой информации в компьютере

Представление звуковой информации в компьютере Common network attacks

Common network attacks Знакомимся с Paint

Знакомимся с Paint Использование программ в режиме удаленного пользования

Использование программ в режиме удаленного пользования Устройства хранения информации

Устройства хранения информации Автоматизированные системы управления предприятием

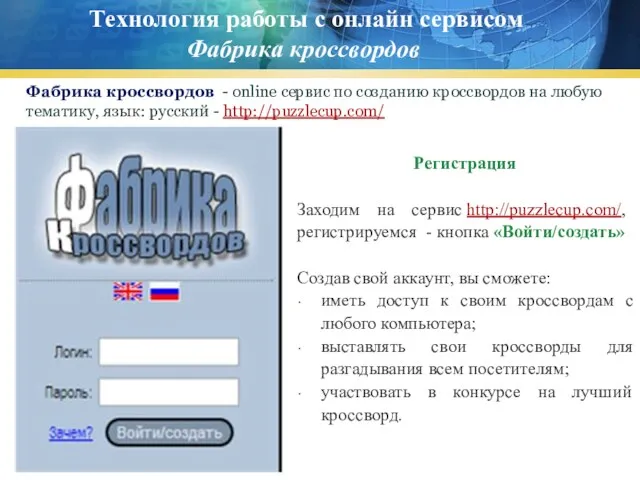

Автоматизированные системы управления предприятием Технология работы с онлайн сервисом. Фабрика кроссвордов

Технология работы с онлайн сервисом. Фабрика кроссвордов Эффективный Яндекс.Директ

Эффективный Яндекс.Директ Архивация данных

Архивация данных Эмпирические методы исследования

Эмпирические методы исследования Распределения итераций и дополнительные сведения о синхронизации. (Лекция 3)

Распределения итераций и дополнительные сведения о синхронизации. (Лекция 3) Локальные компьютерные сети

Локальные компьютерные сети Деловая графика в электронных таблицах

Деловая графика в электронных таблицах VR/AR технологии в играх

VR/AR технологии в играх Графический интерфейс. Библиотека Tkinter

Графический интерфейс. Библиотека Tkinter Облачный сервис Альтап

Облачный сервис Альтап