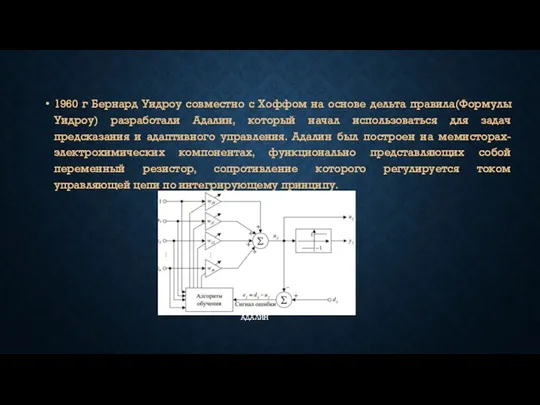

1960 г Бернард Уидроу совместно с Хоффом на основе дельта правила(Формулы

Уидроу) разработали Адалин, который начал использоваться для задач предсказания и адаптивного управления. Адалин был построен на мемисторах-электрохимических компонентах, функционально представляющих собой переменный резистор, сопротивление которого регулируется током управляющей цепи по интегрирующему принципу.

1960 г Бернард Уидроу совместно с Хоффом на основе дельта правила(Формулы Уидроу) разработали Адалин, который начал использоваться для задач предсказания и адаптивного управления. Адалин был построен на мемисторах-электрохимических компонентах, функционально представляющих собой переменный резистор, сопротивление которого регулируется током управляющей цепи по интегрирующему принципу.

АДАЛИН

Разработка системы управления сайтом туристического агентства

Разработка системы управления сайтом туристического агентства Системный администратор

Системный администратор Учебно-ознакомительная практика в пресс- службе ПГНИУ

Учебно-ознакомительная практика в пресс- службе ПГНИУ Системы счисления

Системы счисления Номер қорының бос еместігі туралы есептің үзіндісі

Номер қорының бос еместігі туралы есептің үзіндісі Производственная практика. Информационные системы по отраслям

Производственная практика. Информационные системы по отраслям ИКТ

ИКТ Сжатие информации

Сжатие информации APM FEM Система прочностного анализа для КОМПАС-3D

APM FEM Система прочностного анализа для КОМПАС-3D Презентация Подключение к Интернету

Презентация Подключение к Интернету Что такое CSS

Что такое CSS Теория формальных языков и трансляций. LR(k )-грамматики и трансляции

Теория формальных языков и трансляций. LR(k )-грамматики и трансляции Символьный тип

Символьный тип Europass. Login and two-factor authentication

Europass. Login and two-factor authentication Застосування бази даних магазину Меблі

Застосування бази даних магазину Меблі Защита информации. Классификация каналов утечки информации

Защита информации. Классификация каналов утечки информации Графический интерфейс графического редактора Paint

Графический интерфейс графического редактора Paint virusy-klassifikatsiya-virusov

virusy-klassifikatsiya-virusov Основы телекоммуникаций

Основы телекоммуникаций Маркировка товаров и штриховое кодирование

Маркировка товаров и штриховое кодирование L’oreal enhanced ecommerce guidelines april 22th 2016

L’oreal enhanced ecommerce guidelines april 22th 2016 Системы управления базами данных. Возможности применения СУБД в школе

Системы управления базами данных. Возможности применения СУБД в школе ProfiNet

ProfiNet Язык запросов к данным QBE

Язык запросов к данным QBE Перевод чисел в позиционных системах счисления

Перевод чисел в позиционных системах счисления Программноаппаратный комплекс: Автоматизация учёта товарно-материальных ценностей на складе www.shark.ru

Программноаппаратный комплекс: Автоматизация учёта товарно-материальных ценностей на складе www.shark.ru Принципи побудови комутаторів та комутаційних середовищ паралельних КС. (Тема 15)

Принципи побудови комутаторів та комутаційних середовищ паралельних КС. (Тема 15) Разработка шифратора и дешифратора при наличии ключа меньшего или равного шифруемому тексту

Разработка шифратора и дешифратора при наличии ключа меньшего или равного шифруемому тексту