Содержание

- 2. Метод наименьших квадратов. Уравнение парной регрессии. yt = a0 + a1xt + ut (7.1) Постановка задачи.

- 3. Метод наименьших квадратов Идея метода. Пусть имеем выборку из 4-х точек (n=4): P1 =(x1, y1) P2

- 4. Метод наименьших квадратов P4 Q4 u4 ã0 Y Y Любое значение Y можно представить в виде

- 5. Реализация метода наименьших квадратов Итак, оценки параметров модели парной регрессии согласно МНК будем искать из условия:

- 6. Реализация метода наименьших квадратов Упростим систему нормальных уравнений (7.2) (7.3) Для решения системы (7.3) выразим из

- 7. Реализация метода наименьших квадратов Вычислив с помощью (7.5) оценку ã1, с помощью выражения (7.4) получим значение

- 8. Реализация метода наименьших квадратов Вопрос. Как связано полученное решение со случайными возмущениями? Подставляя (7.7) в (7.6)

- 9. Характеристики точности уравнения парной регрессии Вычислим дисперсии параметров уравнения регрессии и дисперсию прогнозирования эндогенной переменной. 1.

- 10. Характеристики точности уравнения парной регрессии Дисперсия параметра ã0 Дисперсия σ2(ã1) известна (7.8), необходимо вычислить дисперсию y.

- 11. Характеристики точности уравнения парной регрессии Дисперсия прогноза эндогенной переменной. Ковариации между случайными возмущениями и оценками параметров

- 12. Пример применения МНК X-стаж работы сотрудника; Y- часовая оплата труда. Модель: Yt=a0+a1Xt+Ut Σxi=210; Σyi=146.42; Σxi2=2870; Σxiyi=1897.66

- 14. Скачать презентацию

Степенные ряды

Степенные ряды Прибавить и вычесть 1,2,3

Прибавить и вычесть 1,2,3 Задачи на движение по прямой (навстречу и вдогонку)

Задачи на движение по прямой (навстречу и вдогонку) Тела вращения

Тела вращения Единицы массы:тонна и центнер.

Единицы массы:тонна и центнер. Системы двух уравнений с двумя неизвестными

Системы двух уравнений с двумя неизвестными Первообразная. Неопределенный интеграл

Первообразная. Неопределенный интеграл Штангенциркуль

Штангенциркуль Активізація розумової діяльності та розвиток творчості на уроках математики. Творчий звіт

Активізація розумової діяльності та розвиток творчості на уроках математики. Творчий звіт Решение уравнений. Раскрытие скобок

Решение уравнений. Раскрытие скобок Ознакомление с задачей в 2 действия

Ознакомление с задачей в 2 действия Единицы массы. Килограмм. Грамм.

Единицы массы. Килограмм. Грамм. Задания по математике

Задания по математике Предметная неделя

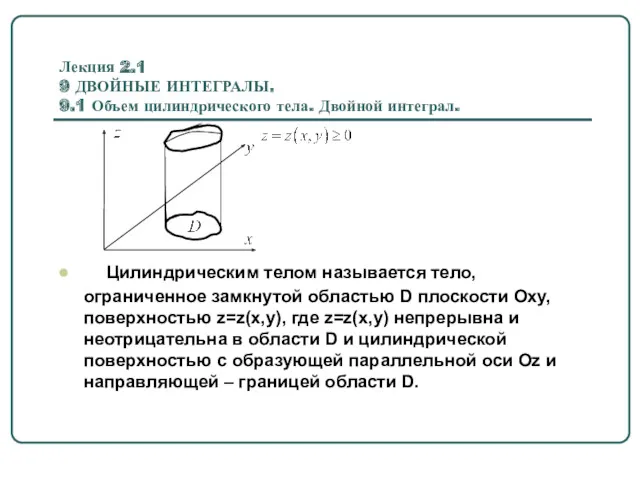

Предметная неделя Объем цилиндрического тела. Двойной интеграл. (Лекция 2.1)

Объем цилиндрического тела. Двойной интеграл. (Лекция 2.1) 20181128_umnozhenie_mnogochlena_na_mnogochlen

20181128_umnozhenie_mnogochlena_na_mnogochlen Сумма углов треугольника

Сумма углов треугольника Презентация.Сложение и вычитание в пределах 20.

Презентация.Сложение и вычитание в пределах 20. Комплексные числа

Комплексные числа Увеличение и уменьшение числа в несколько раз

Увеличение и уменьшение числа в несколько раз Демонстрационный материал для проведения математической игры.

Демонстрационный материал для проведения математической игры. Презентация УСТНЫЕ ЗАДАЧИ НА ГОТОВЫХ ЧЕРТЕЖАХ по теме Признаки равенства прямоугольных треугольников.

Презентация УСТНЫЕ ЗАДАЧИ НА ГОТОВЫХ ЧЕРТЕЖАХ по теме Признаки равенства прямоугольных треугольников. Теорема о равенстве односторонних углов. Теорема о свойстве односторонних углов

Теорема о равенстве односторонних углов. Теорема о свойстве односторонних углов Комбинация шара с другими телами

Комбинация шара с другими телами Измерение углов

Измерение углов Математический КВН

Математический КВН Адаптивная система обучения на уроках математики средствами ИКТ

Адаптивная система обучения на уроках математики средствами ИКТ Уравнения и неравенства с параметрами

Уравнения и неравенства с параметрами