Содержание

- 2. Карл… Карл, я открыл страшную тайну нейронных сетей Это очень интересно, пап!

- 3. Карл… Карл, я специалист по BigData…. Это очень круто, пап! Большая часть населения земли знают математику

- 4. О чем хочется поговорить Ввести в исторический контекст проблемы. Разобраться в причинах. Кратко вспомнить нужную теорию

- 5. О ЧЕМ ПОГОВОРИМ Для менеджеров, без математики! Понятные алгоритмы и техники Полезные для электронной торговли В

- 6. «Золотая» лихорадка Была бигдата Теперь нейронки Завтра будет вторжение инопланетян ☺ Что происходит, успеть или забИть?

- 7. Только правда, только хардкор Клянусь говорить только правду Верьте! Проверить оооочень трудно…

- 8. Что такое бигдата на самом деле? Данные хранят ценную информацию. На данных можно обучать алгоритмы. Как

- 9. Бигдата и веб-студия Чем занимаются в веб-студии. Партнеры Битрикс, фреймворки. Близость к клиенту. Разработка «на бою».

- 10. Наука и (веб) разработка Программирование и теория, computer science Нужно ли писать тесты к коду? На

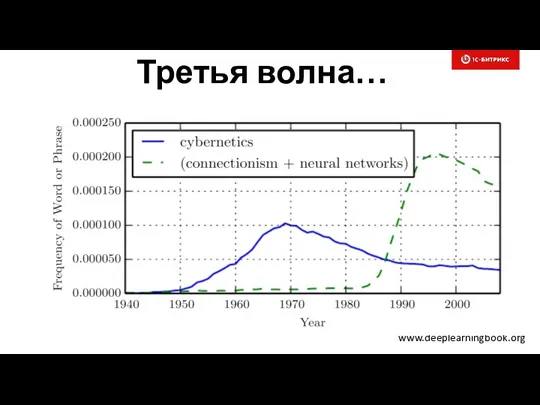

- 11. Третья волна… www.deeplearningbook.org

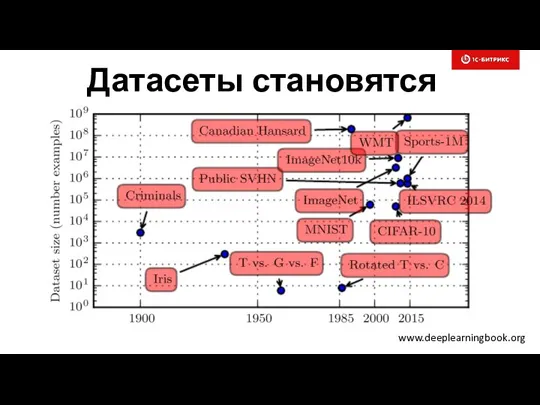

- 12. Датасеты становятся больше… www.deeplearningbook.org

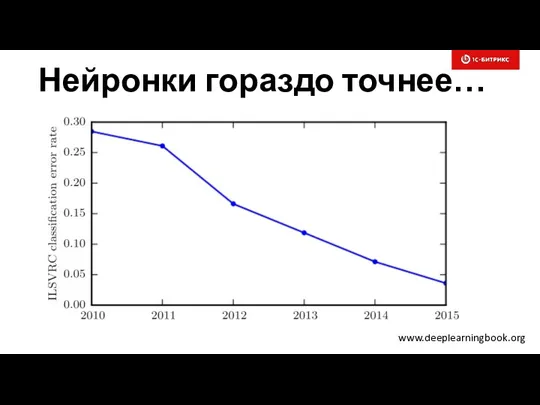

- 13. Нейронки гораздо точнее… www.deeplearningbook.org

- 14. Нейронки становятся больше… www.deeplearningbook.org

- 15. Бигдата и нейронки – созданы друг для друга Машины опорных векторов Факторизация слоев Нелинейность

- 16. А если данных все таки собрано мало? Сколько нужно данных? Простые классические алгоритимы: naïve bayes, logistic

- 17. В чем же принципиальная разница нейронок и традиционных алгоритмов? Иерархия концепций/слоев в нейронке Прорывные результаты в

- 18. Подтянулись GPU и железо Универсальные GPU CUDA Работа с тензорами Диски, кластера: Spark, Hadoop/HDFS, Amazon s3

- 19. Парад бесплатных фреймворков TensorFlow (Google) Torch Theano Keras Deeplearning4j CNTK (Microsoft) DSSTNE (Amazon) Caffe

- 20. Вендоры скупают ученых Facebook (Yann LeCun) Baidu (Andrew Ng, уже правда уходит, достали тупить ☺ )

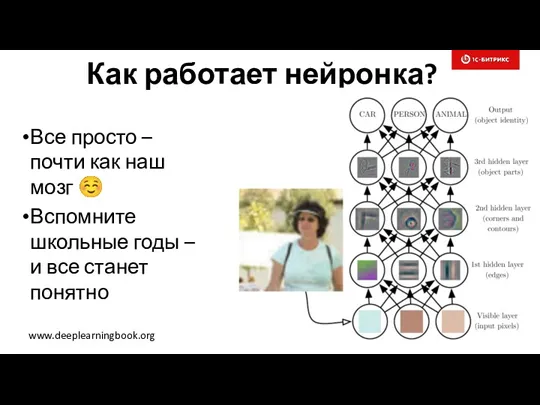

- 21. Как работает нейронка? Все просто – почти как наш мозг ☺ Вспомните школьные годы – и

- 22. Потрясающие возможности нейросетей

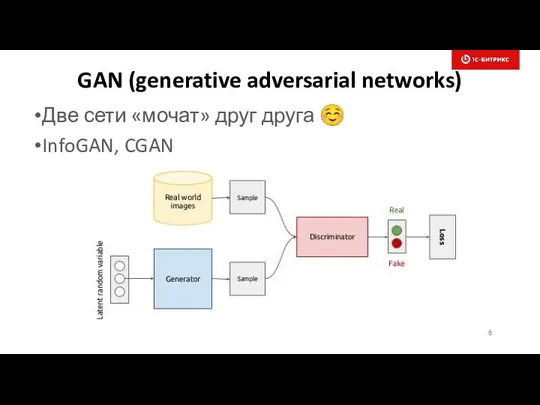

- 23. GAN (generative adversarial networks) Две сети «мочат» друг друга ☺ InfoGAN, CGAN Слайд

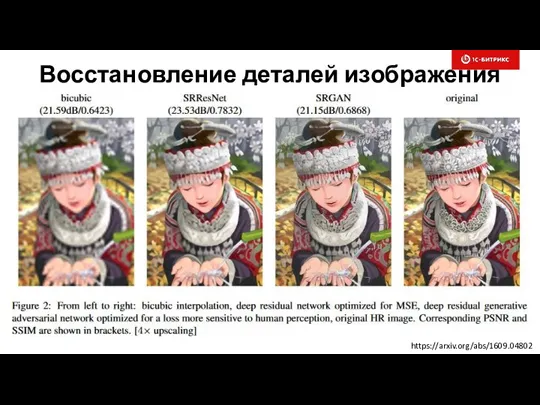

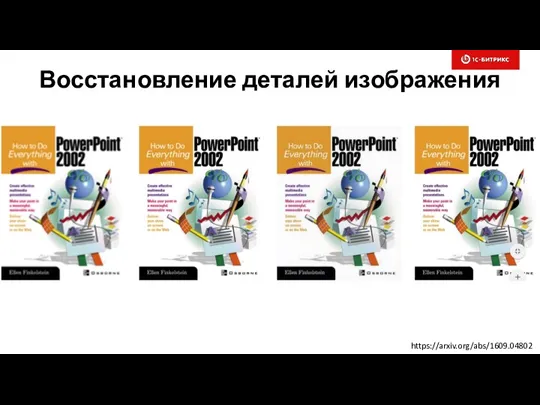

- 24. Восстановление деталей изображения https://arxiv.org/abs/1609.04802

- 25. Восстановление деталей изображения https://arxiv.org/abs/1609.04802

- 26. Восстановление деталей изображения https://arxiv.org/abs/1609.04802

- 27. Фантастические интерьеры https://habrahabr.ru/company/mailru/blog/338248/

- 28. Изменение возраста https://habrahabr.ru/company/mailru/blog/338248/

- 29. Картинка по эскизу Слайд https://habrahabr.ru/company/mailru/blog/338248/

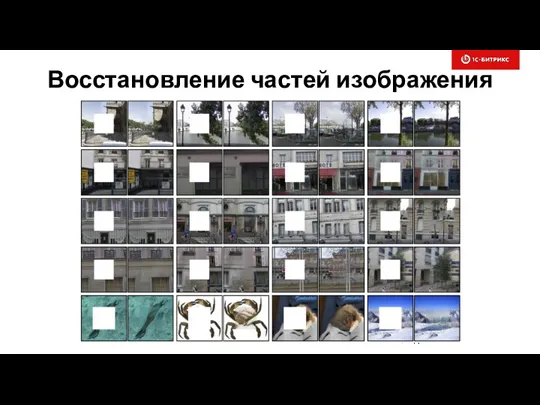

- 30. Восстановление частей изображения Слайд

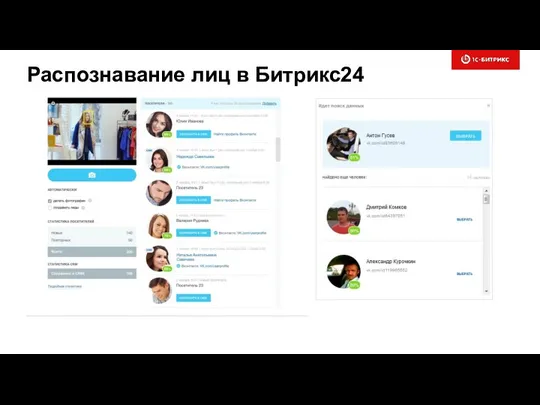

- 31. Распознавание лиц в Битрикс24

- 32. Распознавание лиц в Битрикс24 Face-карт Bitrix24.Time

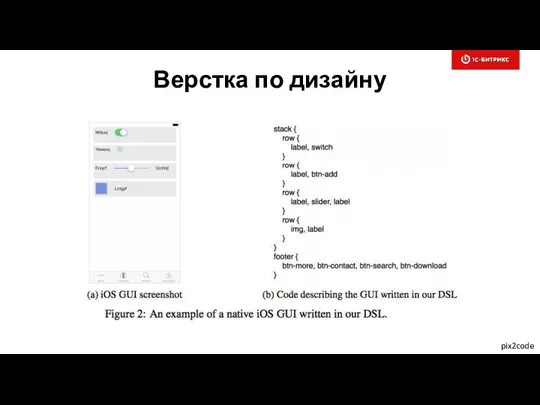

- 33. Верстка по дизайну pix2code

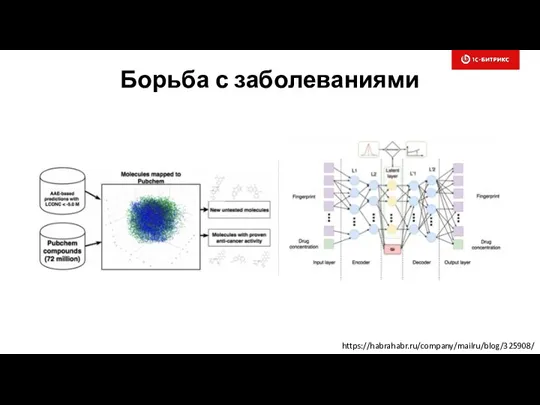

- 34. Борьба с заболеваниями https://habrahabr.ru/company/mailru/blog/325908/

- 35. Рекуррентные нейросети Последовательности событий, модели Маркова http://karpathy.github.io/2015/05/21/rnn-effectiveness/

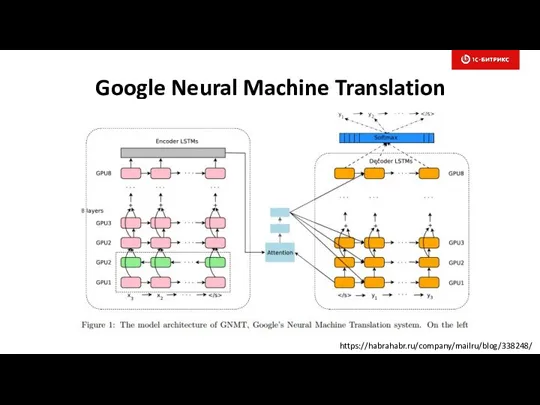

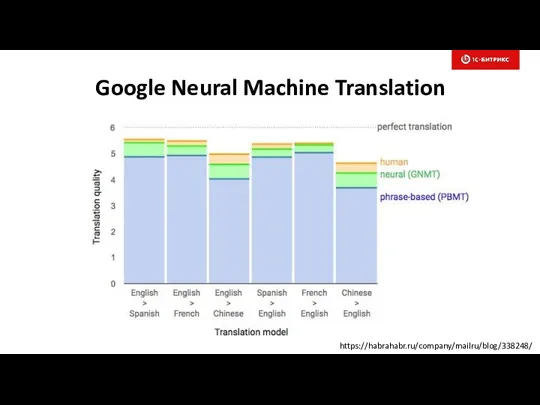

- 36. Google Neural Machine Translation https://habrahabr.ru/company/mailru/blog/338248/

- 37. Google Neural Machine Translation https://habrahabr.ru/company/mailru/blog/338248/

- 38. Чтение по губам Сеть без звука читает по губам – уже 2 раза лучше человека https://habrahabr.ru/company/mailru/blog/338248/

- 39. Ответы на вопросы по картинке В некоторых случаях и датасетах сеть – опережает человека https://habrahabr.ru/company/mailru/blog/338248/

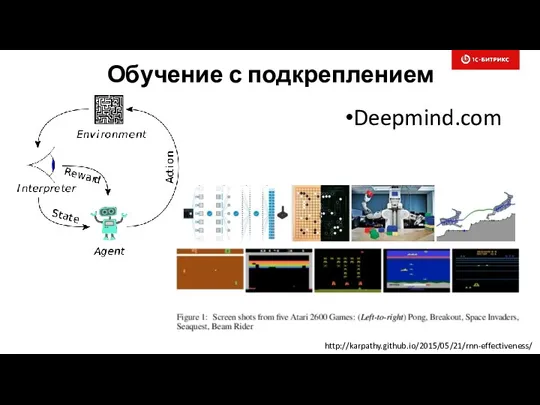

- 40. Обучение с подкреплением Deepmind.com http://karpathy.github.io/2015/05/21/rnn-effectiveness/

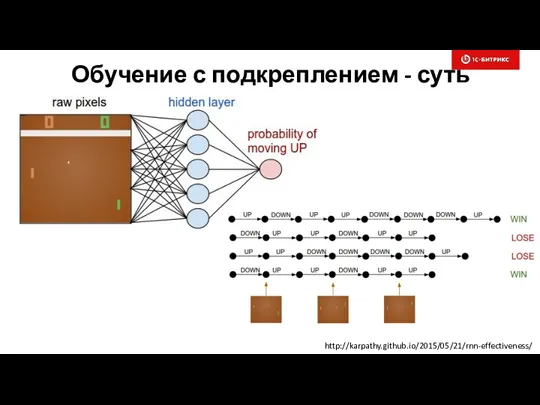

- 41. Обучение с подкреплением - суть http://karpathy.github.io/2015/05/21/rnn-effectiveness/

- 42. Другие кейсы применения нейронок Предсказание следующего действия (RNN, …) Кластеризация (autoencoders) Кто из клиентов уйдет, кто

- 43. Где же подвох? ☺

- 44. А они то есть!!! И не один. ☺

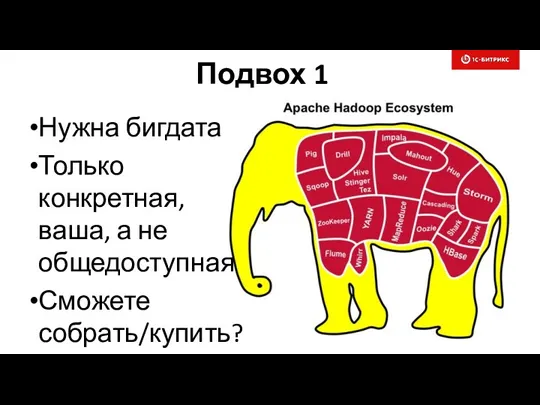

- 45. Подвох 1 Нужна бигдата Только конкретная, ваша, а не общедоступная Сможете собрать/купить?

- 46. Трус не играет в хоккей

- 47. Подвох 2 – семантический разрыв Классификация Регрессия Кластеризация Анализ скрытых факторов в ином измерении Как увеличить

- 48. Машина Тьюринга и … GTA Нужно создавать новые абстракции, нужны «нейронные» программисты, менеджеры и прОдукты

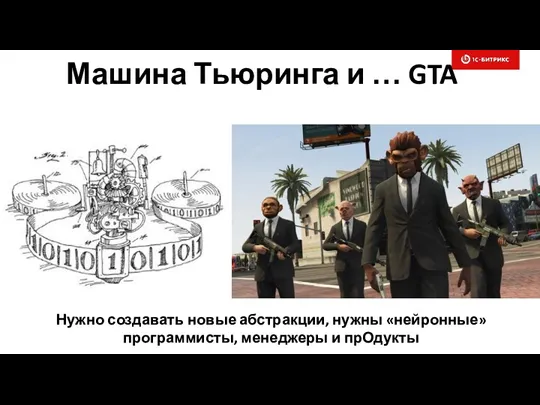

- 49. Подвох 3 – всем тут все понятно? ☺

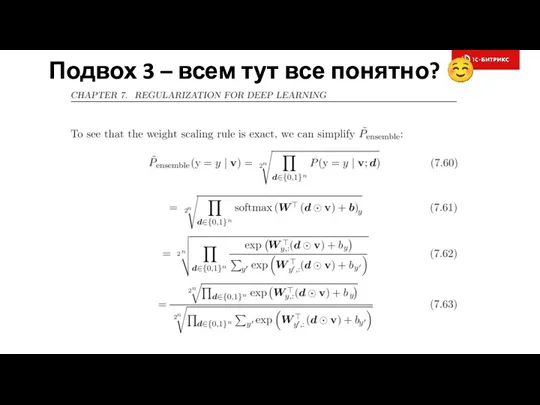

- 50. Подвох 3 – а тут? ☺

- 51. Подвох 3 – нужно долго учиться Хорошая матподготовка выше среднего Уметь писать код Исследовательский дух, много

- 52. Подвох 4 – никаких гарантий В интернете -работает На ваших данных – нет Где ошибка? В

- 53. Подвох 5: полная цепочка - сложна Сбор данных Фильтрация, валидация Обучение модели Раздача предсказаний Контроль качества

- 54. Делаем глубокий вдох…. и улыбаемся!

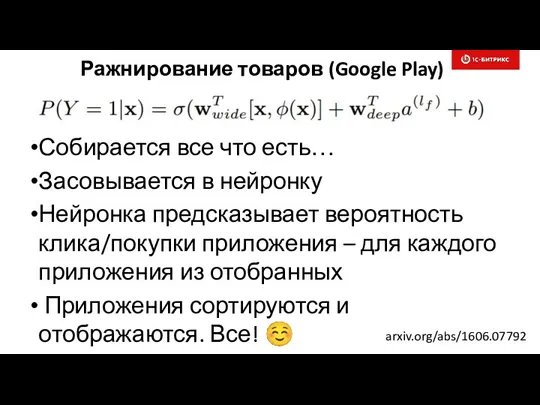

- 55. Ражнирование товаров (Google Play) arxiv.org/abs/1606.07792

- 56. arxiv.org/abs/1606.07792 Ражнирование товаров (Google Play)

- 57. arxiv.org/abs/1606.07792 Собирается все что есть… Засовывается в нейронку Нейронка предсказывает вероятность клика/покупки приложения – для каждого

- 58. Где брать людей в команду? Бигдата: хорошие программисты и опытные сисадмины – 1 штука на проект

- 59. Ну что, нырнем поглубже? Может заболеть голова ☺

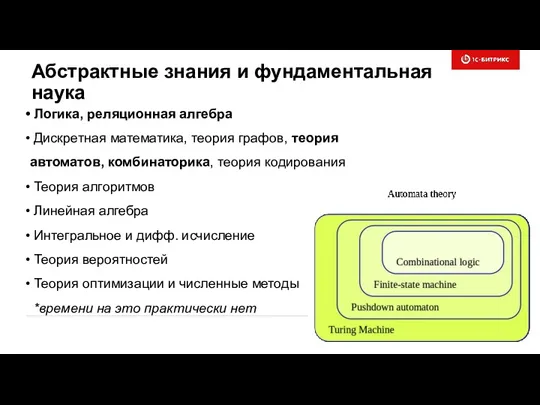

- 60. Абстрактные знания и фундаментальная наука Логика, реляционная алгебра Дискретная математика, теория графов, теория автоматов, комбинаторика, теория

- 61. Восьмая проблема Гильберта и другие штучки До сих пор неясно распределение простых чисел (Гипотеза Римана) Эффективные

- 62. Когда заканчивается наука, «начинается машинное обучение» Четкая кластеризация: K-means (EM) Нечеткая кластеризация: Latent dirichlet allocation Модели

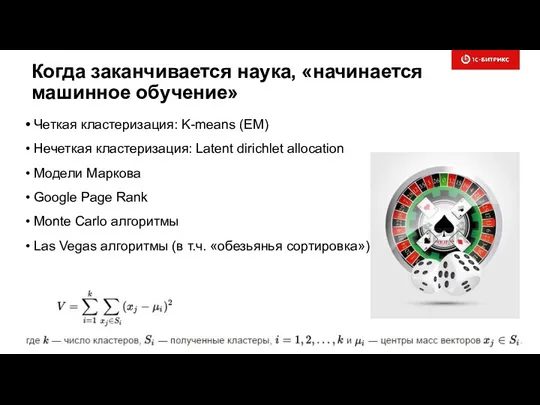

- 63. Машинное обучение и … где-то в конце, нейронки (scikit-learn)

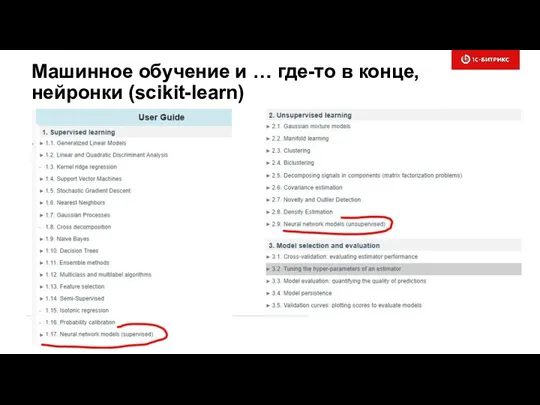

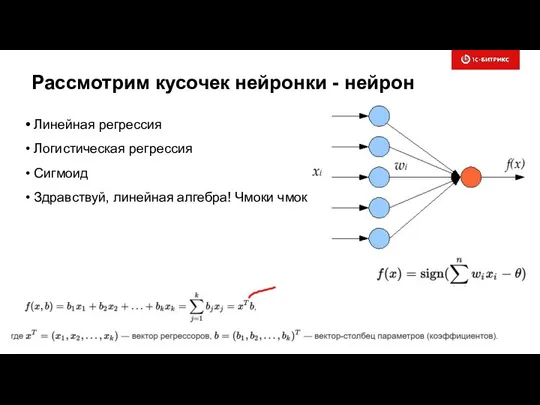

- 64. Рассмотрим кусочек нейронки - нейрон Линейная регрессия Логистическая регрессия Сигмоид Здравствуй, линейная алгебра! Чмоки чмоки

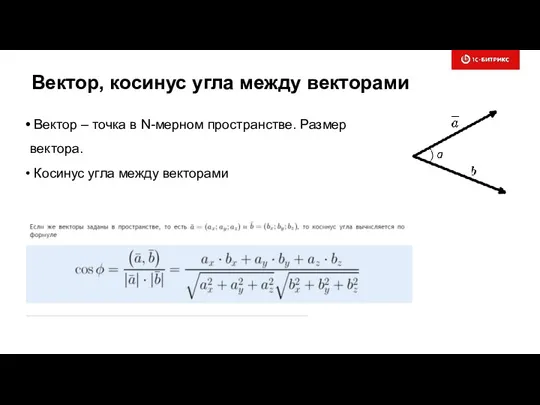

- 65. Вектор, косинус угла между векторами Вектор – точка в N-мерном пространстве. Размер вектора. Косинус угла между

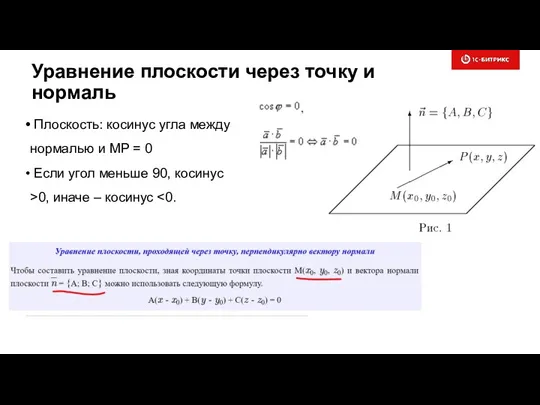

- 66. Уравнение плоскости через точку и нормаль Плоскость: косинус угла между нормалью и MP = 0 Если

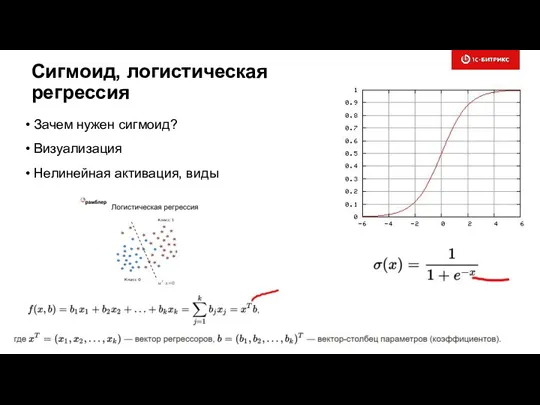

- 67. Сигмоид, логистическая регрессия Зачем нужен сигмоид? Визуализация Нелинейная активация, виды

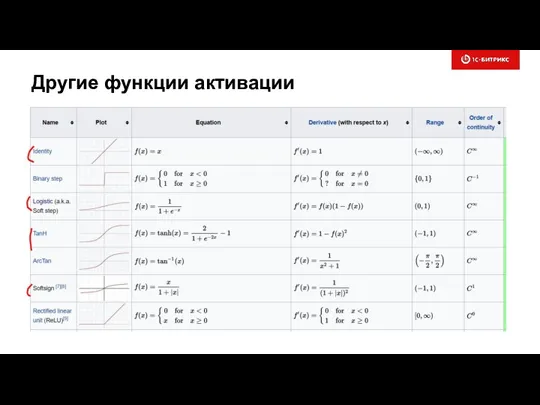

- 68. Другие функции активации

- 69. 25 кадр Твою ж мать, сколько еще это будет продолжаться? ☺

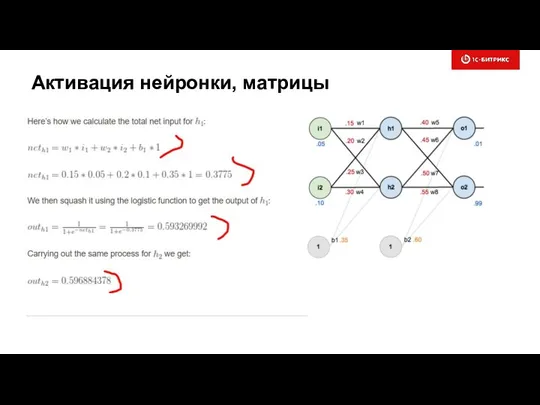

- 70. Активация нейронки, матрицы

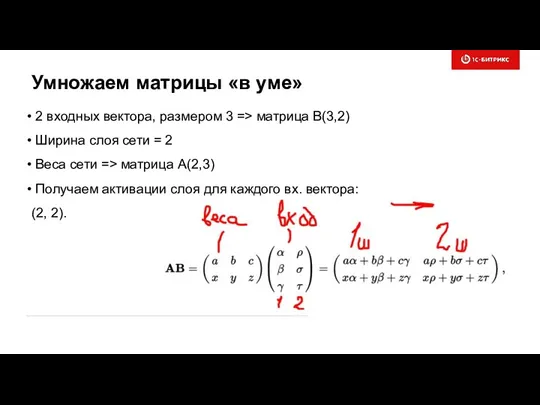

- 71. Умножаем матрицы «в уме» 2 входных вектора, размером 3 => матрица B(3,2) Ширина слоя сети =

- 72. Производная, ее за ногу Отношение приращения функции F(x) к приращению ее аргумента, когда приращение стремиться к

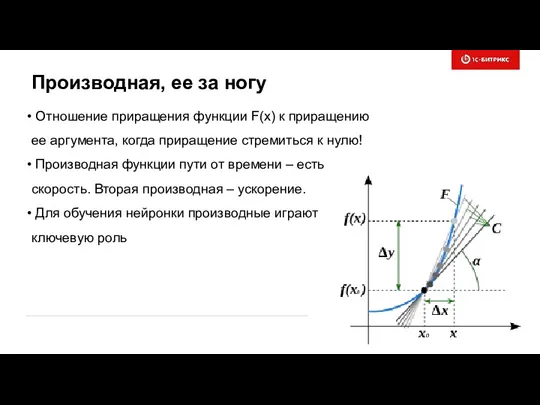

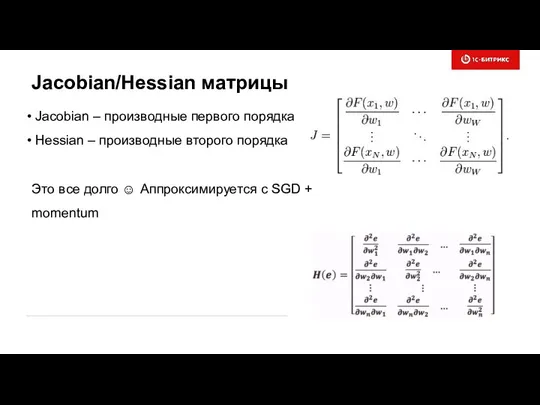

- 73. Jacobian/Hessian матрицы Jacobian – производные первого порядка Hessian – производные второго порядка Это все долго ☺

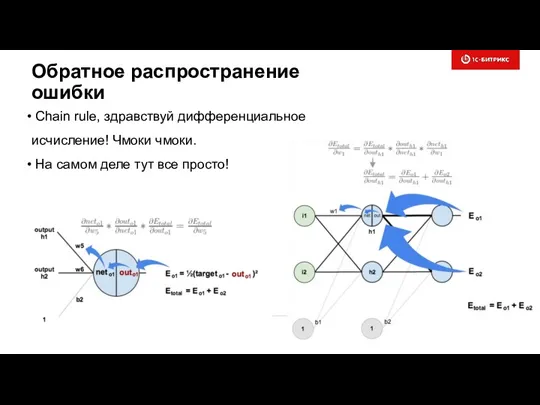

- 74. Обратное распространение ошибки Chain rule, здравствуй дифференциальное исчисление! Чмоки чмоки. На самом деле тут все просто!

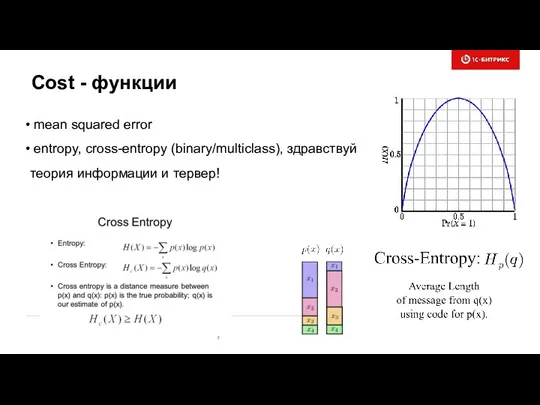

- 75. Cost - функции mean squared error entropy, cross-entropy (binary/multiclass), здравствуй теория информации и тервер!

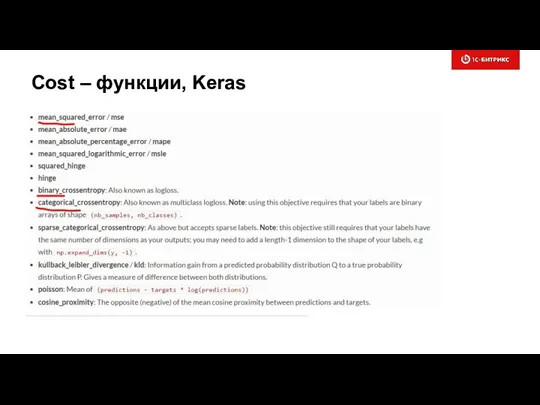

- 76. Cost – функции, Keras

- 77. Автоматическое/ручное дифференцирование Torch7 – ручное, afaik Theano – автоматическое Tensorflow – автоматическое Deeplearning4j – ручное Keras

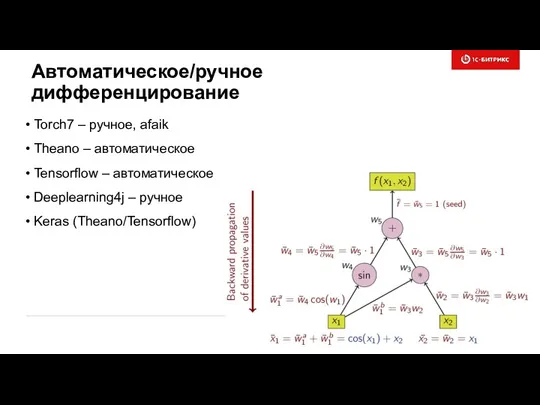

- 78. Методы градиентного спуска (SGD) Stochastic gradient descent Mini-batch gradient descent Momentum: Nesterov accelerated gradient Adagrad Adadelta

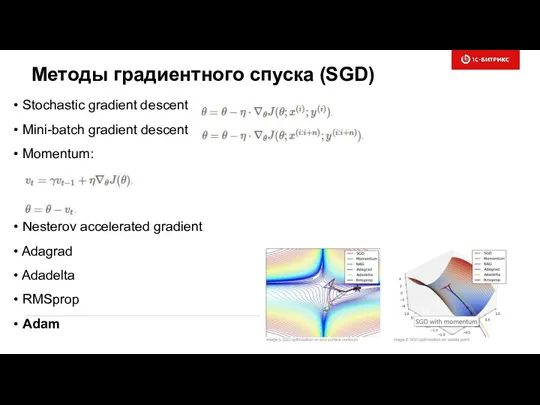

- 79. Тензоры. Проще SQL. В терминологии нейронок – это многомерные массивы элементов одного типа. Требуется их складывать,

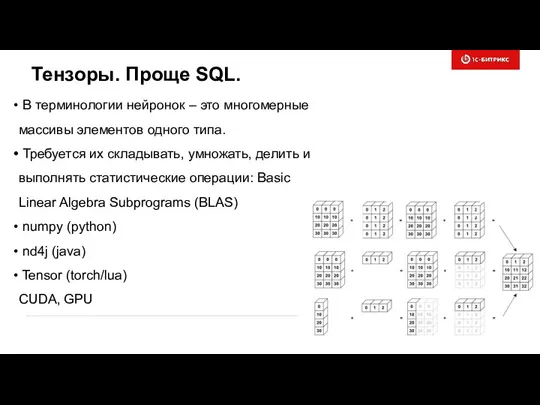

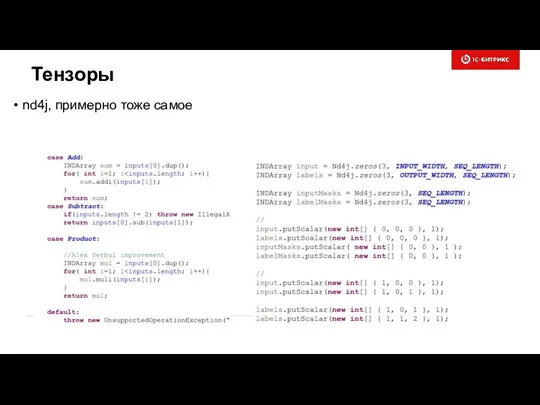

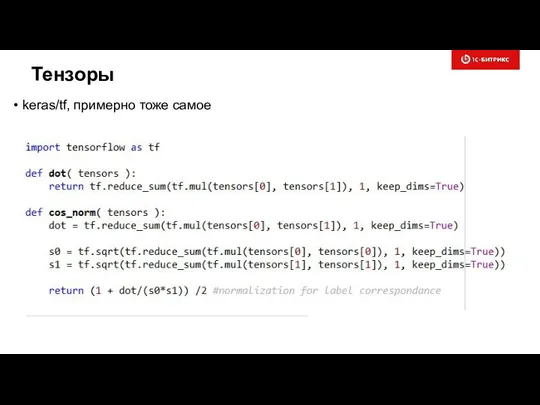

- 80. Тензоры Песочница на python, 15 минут и результат

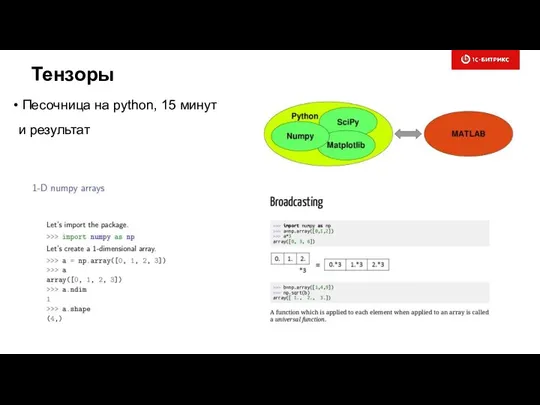

- 81. Тензоры nd4j, примерно тоже самое

- 82. Тензоры keras/tf, примерно тоже самое

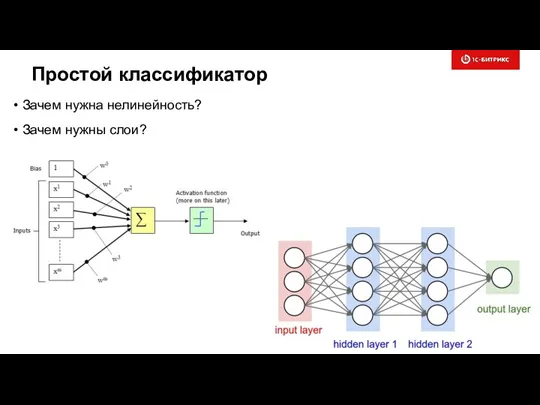

- 83. Простой классификатор Зачем нужна нелинейность? Зачем нужны слои?

- 84. Врач никому не нужен? ☺ Ныряем в прикладные кейсы

- 85. Полезные (готовые) инструменты Rapidminer SAS SPSS … Готовые блоки, серверные редакции (hadoop), графики

- 86. Полезные библиотеки (бесплатные) Spark MLlib (scala/java/python) – много данных scikit-learn.org (python) – мало данных R

- 87. Рабочее место аналитика

- 88. Аналитик Организовать сбор данных Минимум программирования Работа в инструментах (Rapidminer, R, SAS, SPSS) Bigdata – как

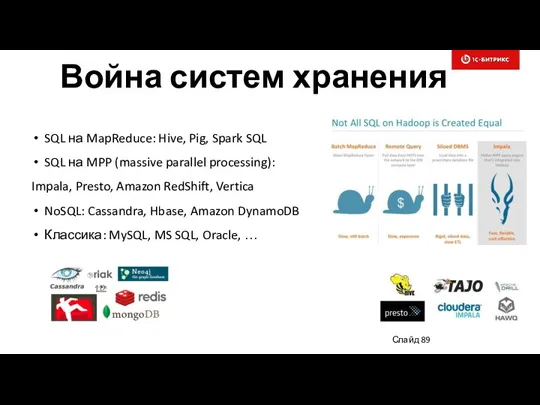

- 89. Война систем хранения Слайд SQL на MapReduce: Hive, Pig, Spark SQL SQL на MPP (massive parallel

- 90. Визуализация

- 91. Визуализация!

- 92. Визуализация! Кто мои клиенты (возраст, средний чек, интересы)? Тренды, графы Корреляция значений 2-3, иногда больше измерений

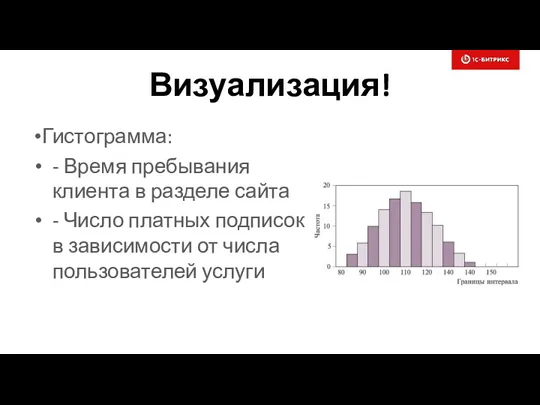

- 93. Визуализация! Гистограмма: - Время пребывания клиента в разделе сайта - Число платных подписок в зависимости от

- 94. Кластерный анализ

- 95. Кластерный анализ Когда измерений много Если «повезет» Четкая/нечеткая Иерархическая Графы Данных много/мало Интерпретация

- 96. Кластерный анализ Иерархическая K-means C-means Spectral Density-based (DBSCAN) Вероятностные Для «больших данных»

- 97. Кластерный анализ – бизнес-кейсы Сегментация клиентов, типов использования сервиса, … Кластеризация «общего» товарного каталога Кластеризация графа

- 98. Кластерный анализ – оценки на программирование Данные должны быть уже собраны Анализ в Rapidminer (0.1-2 часа)

- 99. Кластерный анализ – риски Много данных – медленно! Тексты, каталоги товаров … Как интерпретировать? Рецепты: Spark

- 100. Персонализация

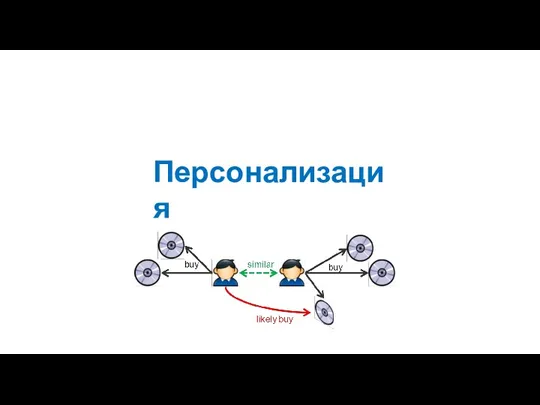

- 101. Персонализация Релевантный контент – «угадываем мысли» Релевантный поиск Предлагаем то, что клиенту нужно как раз сейчас

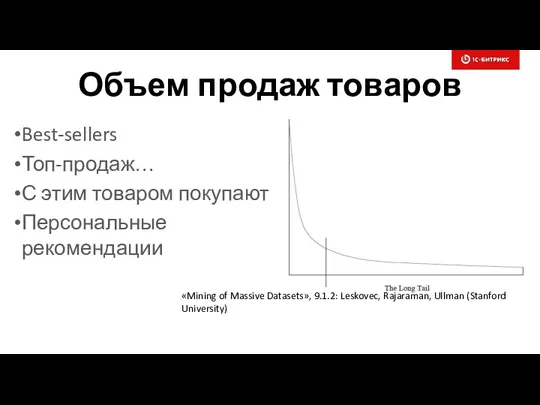

- 102. Объем продаж товаров Best-sellers Топ-продаж… С этим товаром покупают Персональные рекомендации «Mining of Massive Datasets», 9.1.2:

- 103. Коллаборативная фильтрация Предложи Товары/Услуги, которые есть у твоих друзей (User-User) Предложи к твоим Товарам другие связанные

- 104. Как работает коллаборативная фильтрация Матрица: Пользователь Товар Похожие Пользователи Похожие Товары

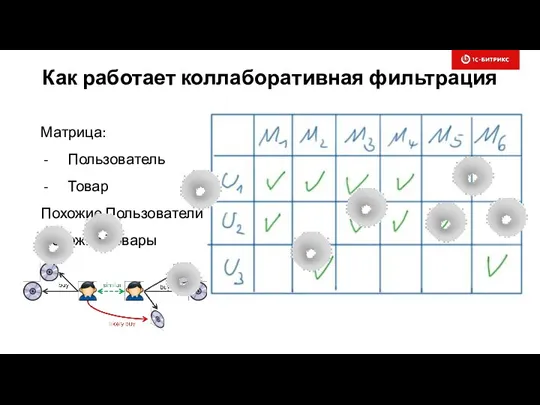

- 105. Возможности коллаборативной фильтрации (Item-Item) Персональная рекомендация (рекомендуем посмотреть эти Товары) С этим Товаром покупают/смотрят/… (глобальная) Топ

- 106. Коллаборативная фильтрация (Item-Item) – сроки, риски Apache Spark MLlib (als), Apache Mahout (Taste) + неделька Объем

- 107. Content-based рекомендации Купил пластиковые окна – теперь их предлагают на всех сайтах и смартфоне. Купил Toyota,

- 108. Content-based рекомендации – реализация, риски Поисковый «движок»: Sphinx, Lucene (Solr) «Обвязка» для данных Хранение профиля Клиента

- 109. Content-based, collaborative рекомендации - разумно Рекомендовать постоянно «возобновляемые» Товары (молоко, носки, …) Рекомендовать фильм/телевизор – один

- 110. Классификация

- 111. Классификация – это не кластеризация! Не путать! Кластеризация – автоматическая и если повезет Классификация – учим

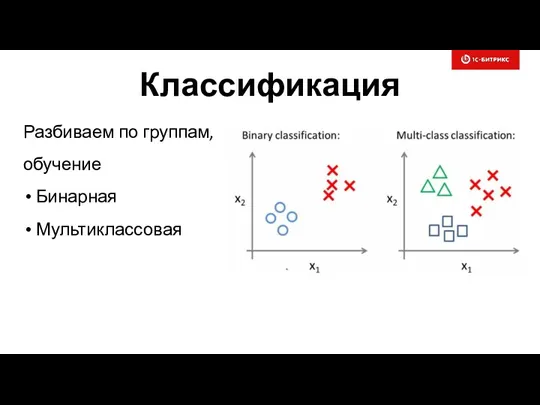

- 112. Классификация Разбиваем по группам, обучение Бинарная Мультиклассовая

- 113. Классификация – бизнес-кейсы Удержание: найти клиентов, которые скоро уйдут (churn-rate) Найти клиентов, готовых стать платными Найти

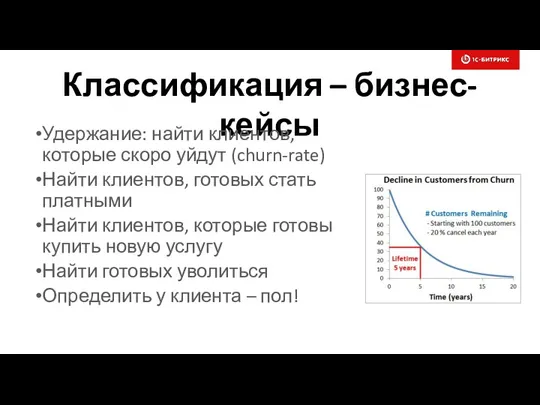

- 114. Классификация – тонкости А как/чем удержать клиентов? Определение релевантных групп – зондирование (рассылки, опросы), база моделей

- 115. Классификация – реализация, риски Определение, нормализация атрибутов Feature engineering Выбор алгоритма, kernel Spark MLlib, scikit-learn –

- 116. Классификация – качество Confusion matrix Recall/precision Kappa AUC > 0.5

- 117. Регрессия

- 118. Регрессия Предсказать «циферку» Стоимость квартиры, автомобиля на рынке Ценность клиента для магазина Зарплата на данную вакансию

- 119. Регрессия – customer lifetime value (CLV) Пришел клиент, а он потенциально прибыльный! Система лояльности, удержания Подарки,

- 120. Регрессия – реализация, риски Выявление атрибутов Выбор алгоритма Spark MLlib – не работает, scikit-learn – 1-2

- 121. Reinforcement learning

- 122. Автоматическое A/B-тестирование Создаем наборы: главной, баннеров, корзины, мастера заказа Ставим цель – оформление заказа Клиенты обучают

- 123. Reinforcement learning

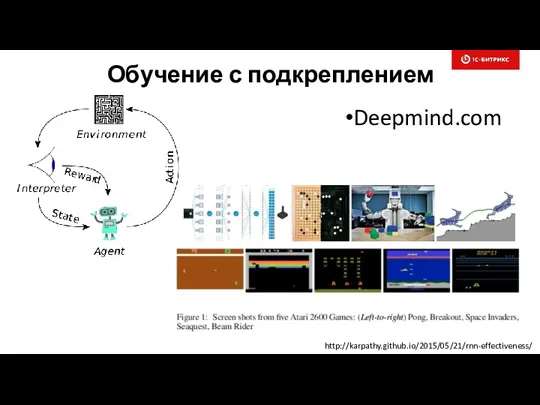

- 124. Обучение с подкреплением Deepmind.com http://karpathy.github.io/2015/05/21/rnn-effectiveness/

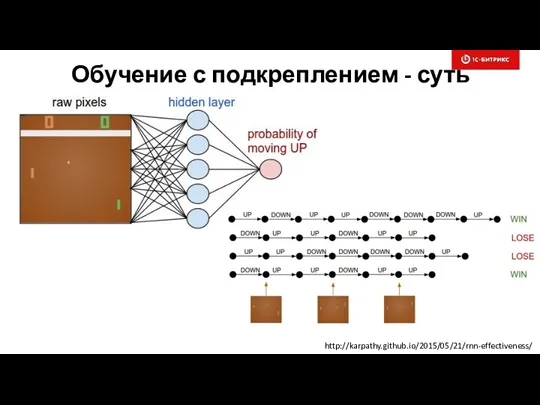

- 125. Обучение с подкреплением - суть http://karpathy.github.io/2015/05/21/rnn-effectiveness/

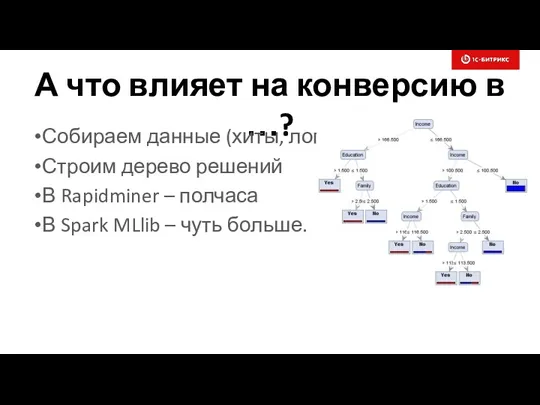

- 126. А что влияет на конверсию в …? Собираем данные (хиты, логи, анкетирование) Строим дерево решений В

- 127. Стратегии увеличения прибыли

- 128. Стратегии Изучаем клиентов (кластерный анализ, зондирование) Привлечь нового дороже чем удержать старого? Высокий churn-rate и CLV

- 129. Типы нейросетей в 1С-Битрикс

- 130. Классификатор обращений техподдержки Глубокий классификатор, использующий ngrams3 векторизатор и сжимающее хэширование входного вектора. Используем взвешенную cost-функцию

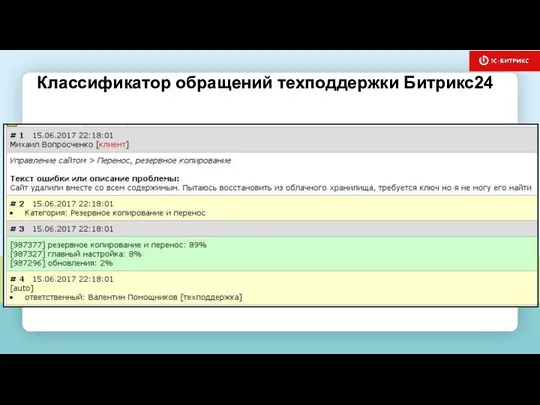

- 131. 1D свертка для классификации текстов Глубокий аналог ngrams, очень быстрое обучение на GPU Word/char-based 1D convolution

- 132. Классификатор обращений техподдержки Битрикс24

- 133. «Нейробот» Кластер веб-серверов, Кэширование, REST-API GPUs (TitanX) Глубокая нейронная сеть с двумя входами и одним выходом

- 134. Наши эксперименты Наши эксперименты: Ф.М. Достоевский, "Преступление и наказание“ Число слоев сети: 2 Число нейронов в

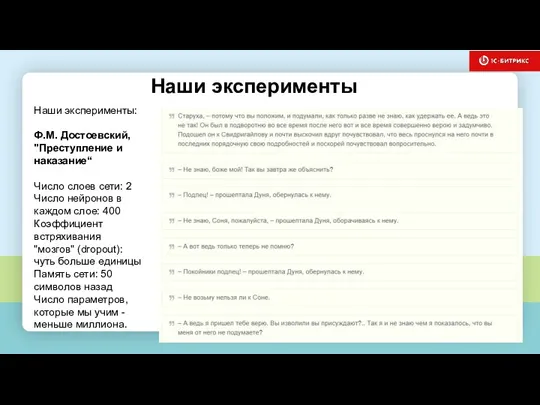

- 135. Наши эксперименты: Л.Н. Толстой, "Война и мир" Число слоев сети: 3 Число нейронов в каждом слое:

- 136. Наши эксперименты: Код ядра Битрикс 3-х слойная сеть, размер слоя: 400 нейронов, несколько миллионов параметров, память:

- 137. Интересные тренды и техники Semi-supervised learning. Когда данных мало… One-shot learning Переобучение Neural turing machine/memory networks

- 138. Выводы Можно брать готовые модели в фреймворках и применять в различных бизнес-задачах уже сейчас Собирать данные

- 140. Скачать презентацию

Ресурсный анализ. Материальные и нематериальные ресурсы

Ресурсный анализ. Материальные и нематериальные ресурсы Деловые совещания

Деловые совещания Алло-замер 2016

Алло-замер 2016 Правила корпорации Ritz – Carlton Hotel Company

Правила корпорации Ritz – Carlton Hotel Company Управление продуктом

Управление продуктом Управление рисками, системный анализ и моделирование. Лекции 1-2-3-4

Управление рисками, системный анализ и моделирование. Лекции 1-2-3-4 Основные понятия в области научно-исследовательских работ. Лекция 1

Основные понятия в области научно-исследовательских работ. Лекция 1 Принятие решений в условиях неопределенности, риска и конфликта

Принятие решений в условиях неопределенности, риска и конфликта Тема 6. Оценка эффективности проектов

Тема 6. Оценка эффективности проектов Персоналды басқару туралы ұғым. Басқару стильдері

Персоналды басқару туралы ұғым. Басқару стильдері Work hard, play hard

Work hard, play hard Лидерство – важнейший компонент эффективного руководства

Лидерство – важнейший компонент эффективного руководства Понятие, цели и задачи управления инфраструктурой предприятия. (Лекция 1)

Понятие, цели и задачи управления инфраструктурой предприятия. (Лекция 1) Интеллектуальный капитал. Управление знаниями

Интеллектуальный капитал. Управление знаниями Анализ рыночной ситуации и конкуренции в отрасли. (Лекция 3)

Анализ рыночной ситуации и конкуренции в отрасли. (Лекция 3) Кадровая стратегия и кадровая политика организации

Кадровая стратегия и кадровая политика организации Прогнозирование инноваций и выбор оптимальной инновационной стратегии

Прогнозирование инноваций и выбор оптимальной инновационной стратегии Оргструктура и приципы взаимодействия фирмы Семейное фото и НКО Мама

Оргструктура и приципы взаимодействия фирмы Семейное фото и НКО Мама Базові функції управління

Базові функції управління Определение деловых коммуникаций

Определение деловых коммуникаций Smart и KPI

Smart и KPI Кросс-культурный менеджмент. (Тема 15)

Кросс-культурный менеджмент. (Тема 15) Планирование и эффективность. От генерации идей к структурированию информации

Планирование и эффективность. От генерации идей к структурированию информации Деловая этика менеджера гостиничного предприятия

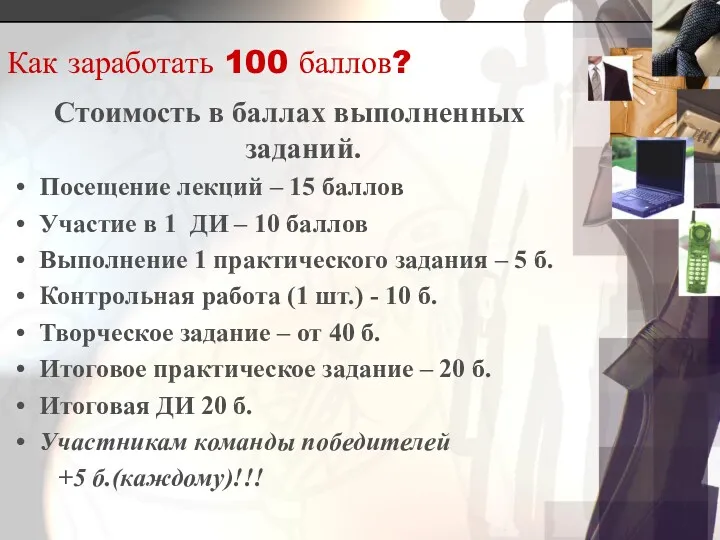

Деловая этика менеджера гостиничного предприятия Директор ОУ как менеджер

Директор ОУ как менеджер Требования к PR-специалистам. Виды PR-профессионалов

Требования к PR-специалистам. Виды PR-профессионалов Управление проектами: основные понятия. Понятия проект и управление проектами. Методология управления

Управление проектами: основные понятия. Понятия проект и управление проектами. Методология управления Основы управления (менеджмента) в системе здравоохранения

Основы управления (менеджмента) в системе здравоохранения