Содержание

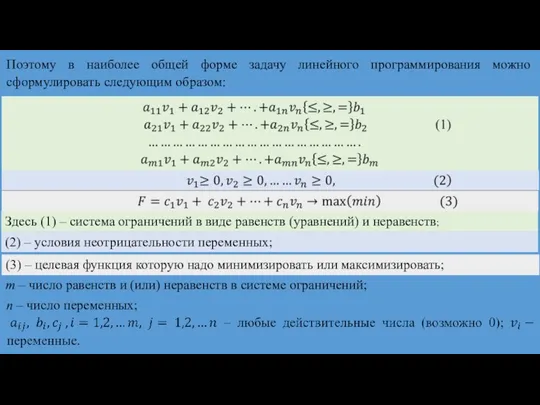

- 2. Поэтому в наиболее общей форме задачу линейного программирования можно сформулировать следующим образом: Здесь (1) – система

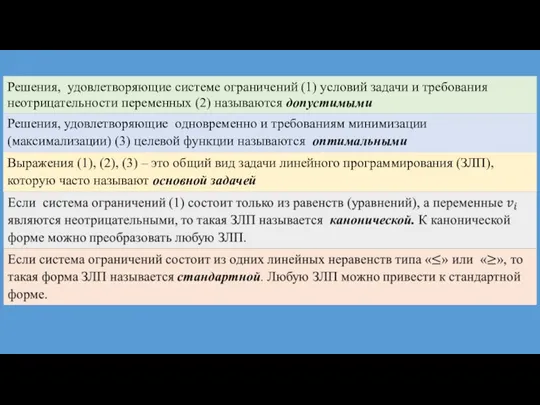

- 3. Решения, удовлетворяющие системе ограничений (1) условий задачи и требования неотрицательности переменных (2) называются допустимыми Решения, удовлетворяющие

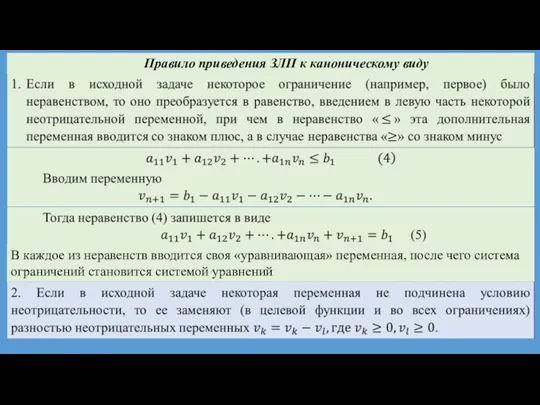

- 4. Правило приведения ЗЛП к каноническому виду В каждое из неравенств вводится своя «уравнивающая» переменная, после чего

- 5. 3. Если в ограничениях правая часть отрицательная, то следует умножить это ограничение на (-1)

- 6. 7.2. Симплекс-метод и основные утверждения линейного программирования Геометрическая интерпретация ЗЛП и метода ее решения для двух

- 7. 5 20 15 10 5 10 15 20 0 C B A 8 12

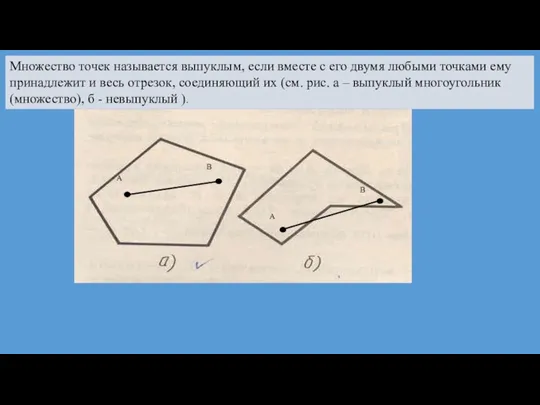

- 8. Множество точек называется выпуклым, если вместе с его двумя любыми точками ему принадлежит и весь отрезок,

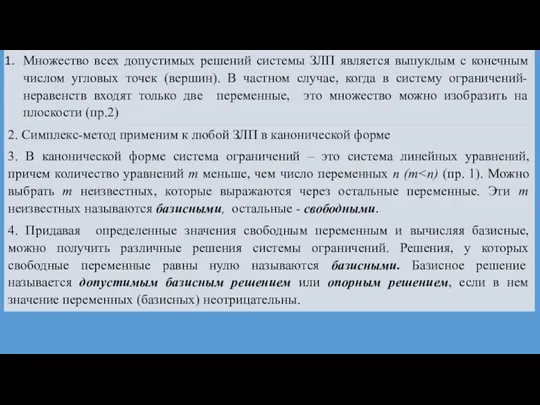

- 9. Множество всех допустимых решений системы ЗЛП является выпуклым с конечным числом угловых точек (вершин). В частном

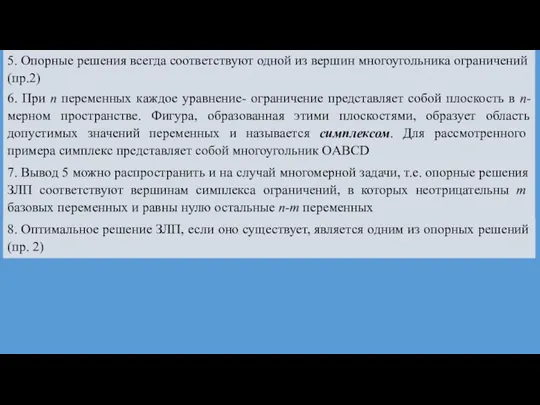

- 10. 5. Опорные решения всегда соответствуют одной из вершин многоугольника ограничений (пр.2) 6. При n переменных каждое

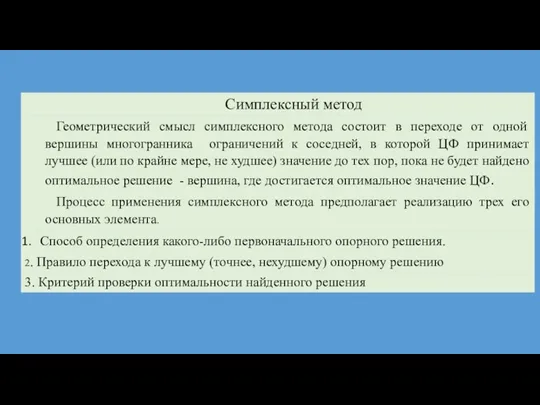

- 11. Симплексный метод Геометрический смысл симплексного метода состоит в переходе от одной вершины многогранника ограничений к соседней,

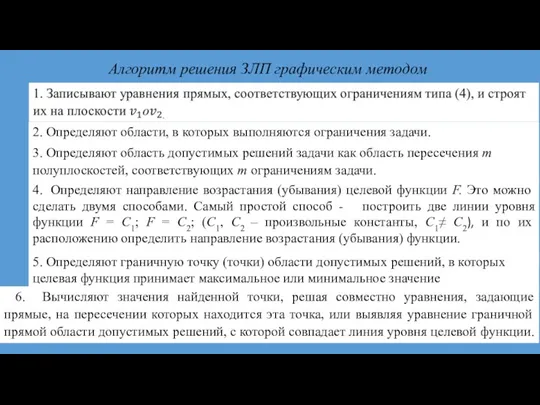

- 12. Алгоритм решения ЗЛП графическим методом 2. Определяют области, в которых выполняются ограничения задачи. 3. Определяют область

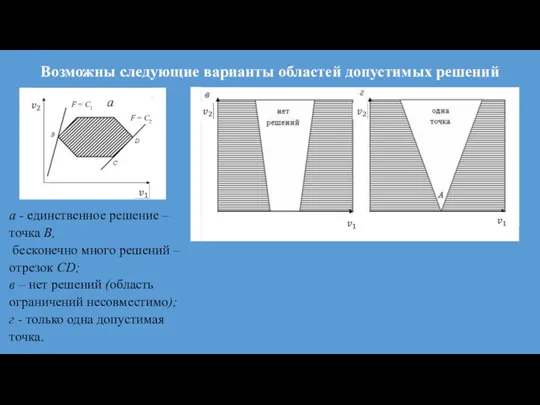

- 13. Возможны следующие варианты областей допустимых решений а - единственное решение – точка В, бесконечно много решений

- 14. 9. Оптимальное проектирование на основе решения задачи нелинейного программирования 9.1. Общие сведения Нелинейное программирование (НП) –

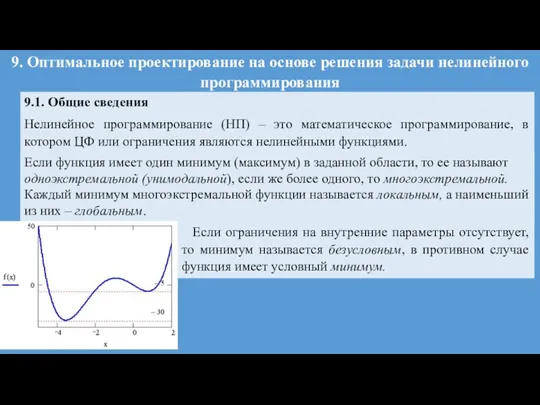

- 15. Поиск минимума в n-мерном пространстве осуществляется итерационными методами. На каждой итерации необходимо решить две задачи: 1

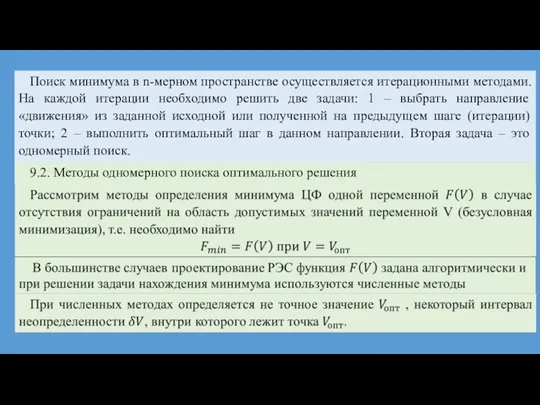

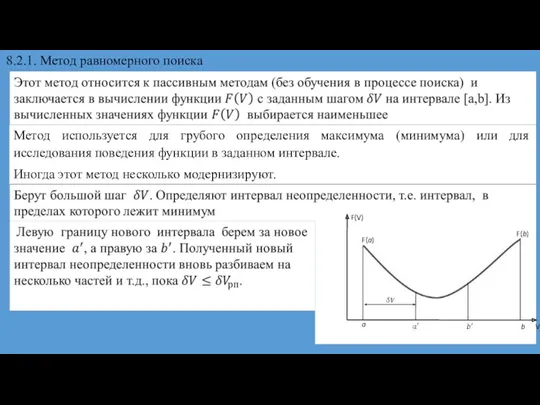

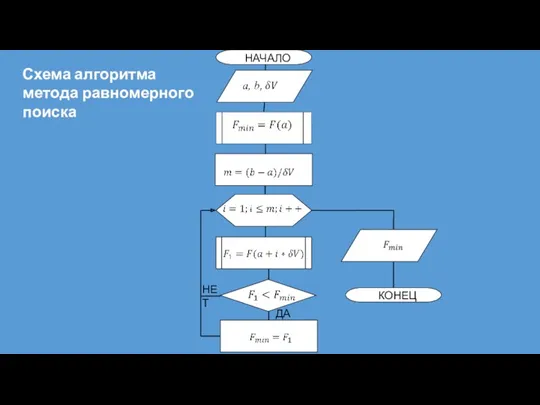

- 17. 8.2.1. Метод равномерного поиска Метод используется для грубого определения максимума (минимума) или для исследования поведения функции

- 18. НЕТ ДА Схема алгоритма метода равномерного поиска

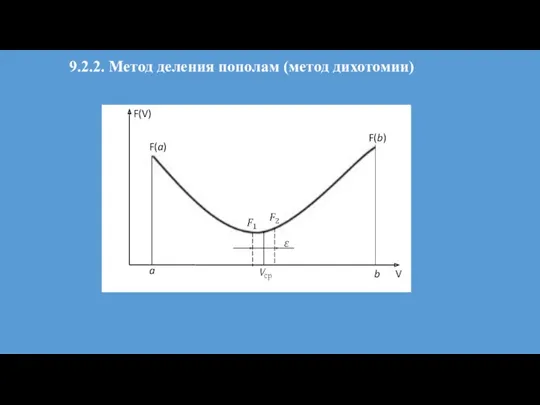

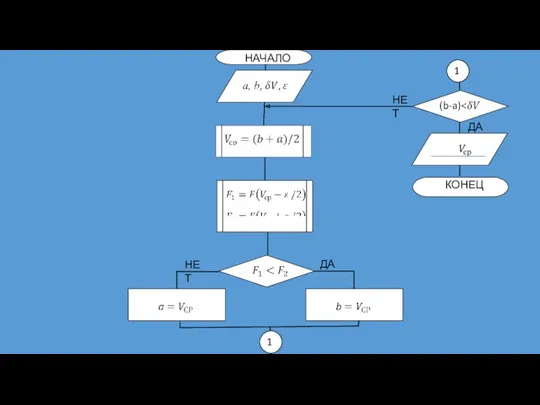

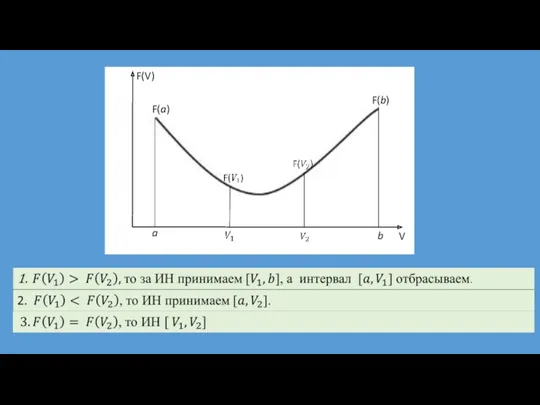

- 19. 9.2.2. Метод деления пополам (метод дихотомии)

- 20. НЕТ НЕТ ДА ДА

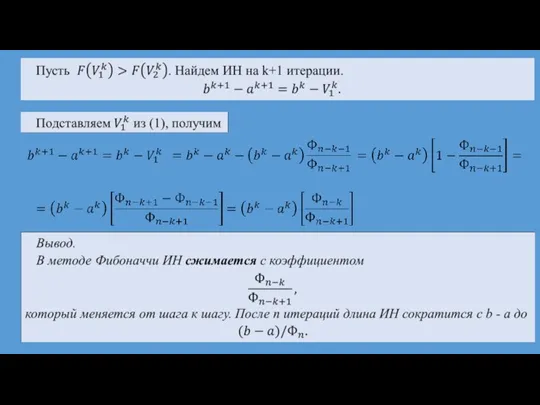

- 21. Так при m = 10 это выигрыш составит 3,2, т.е. в 3,2 раза ИН в методе

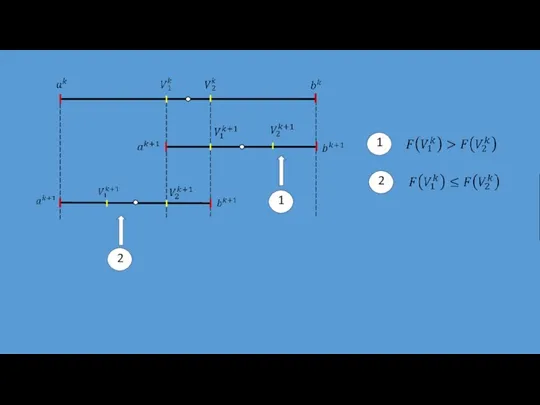

- 23. 9.2.3. Метод Фибоначчи где n – заданное общее число вычислений функции.

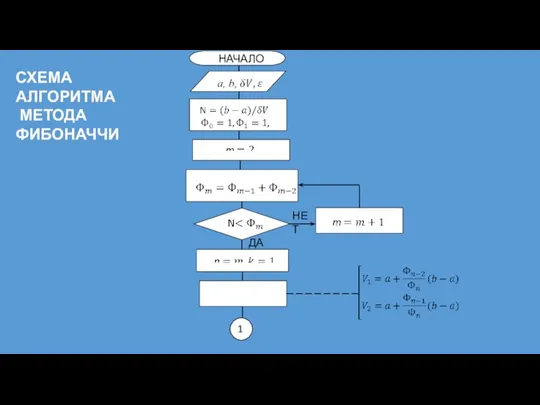

- 26. НЕТ ДА СХЕМА АЛГОРИТМА МЕТОДА ФИБОНАЧЧИ

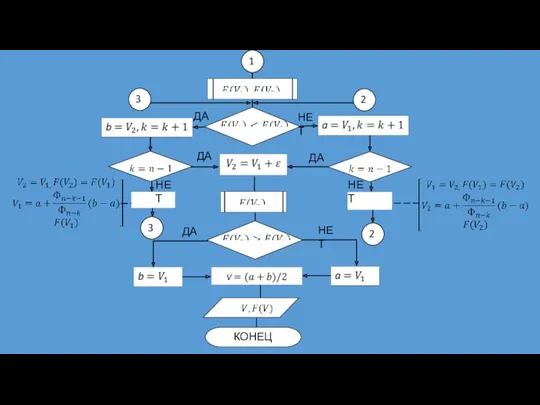

- 27. ДА ДА ДА ДА НЕТ НЕТ НЕТ НЕТ

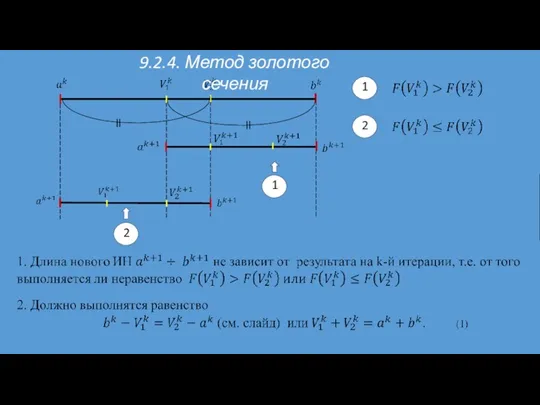

- 28. 9.2.4. Метод золотого сечения

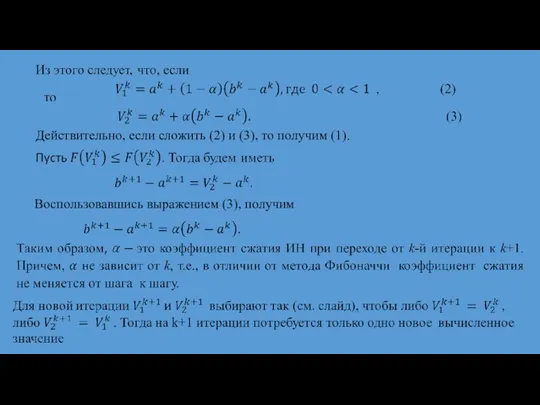

- 29. Действительно, если сложить (2) и (3), то получим (1). Воспользовавшись выражением (3), получим

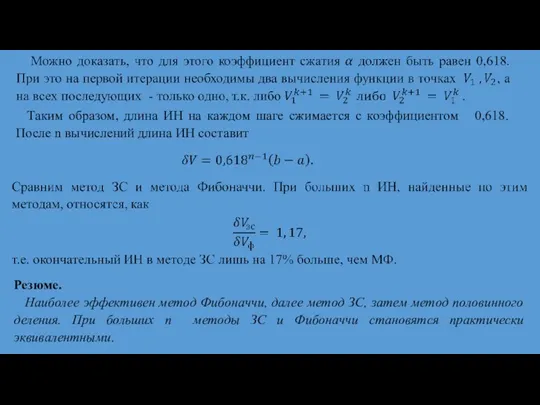

- 30. Таким образом, длина ИН на каждом шаге сжимается с коэффициентом 0,618. После n вычислений длина ИН

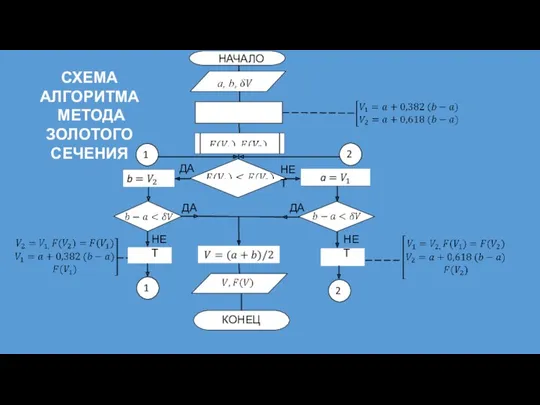

- 31. СХЕМА АЛГОРИТМА МЕТОДА ЗОЛОТОГО СЕЧЕНИЯ ДА НЕТ ДА ДА НЕТ НЕТ

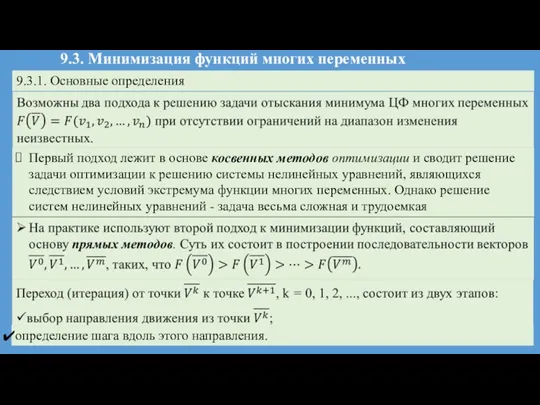

- 32. 9.3. Минимизация функций многих переменных 9.3.1. Основные определения Первый подход лежит в основе косвенных методов оптимизации

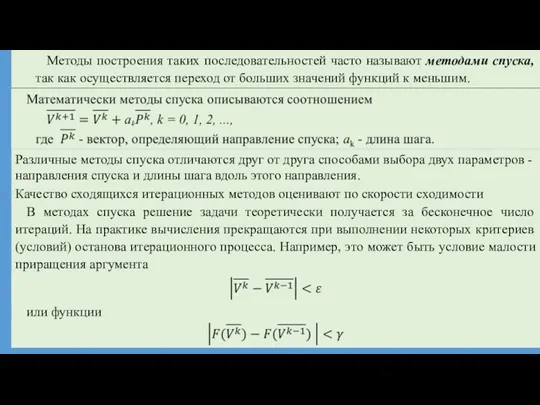

- 33. Методы построения таких последовательностей часто называют методами спуска, так как осуществляется переход от больших значений функций

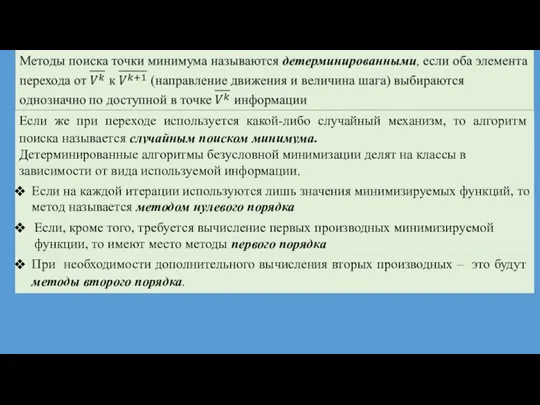

- 34. Если же при переходе используется какой-либо случайный механизм, то алгоритм поиска называется случайным поиском минимума. Детерминированные

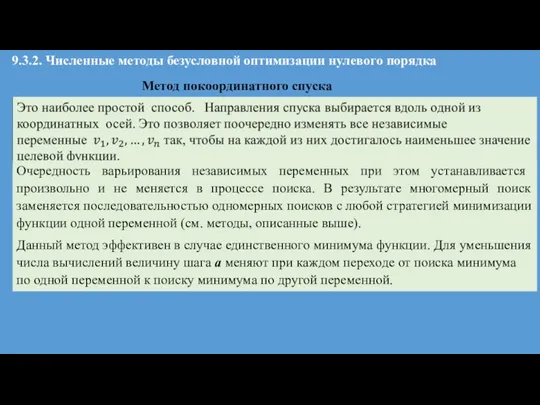

- 35. 9.3.2. Численные методы безусловной оптимизации нулевого порядка Метод покоординатного спуска Очередность варьирования независимых переменных при этом

- 37. Скачать презентацию

Microsoft Office Еxcel бағдарламасы

Microsoft Office Еxcel бағдарламасы Диаграмма деятельности. Применение языка UML при разработке информационных систем

Диаграмма деятельности. Применение языка UML при разработке информационных систем G2A

G2A Учебная практика в фотосалоне ИП Нечаева Е.А

Учебная практика в фотосалоне ИП Нечаева Е.А Программирование на языке Python

Программирование на языке Python Практика React

Практика React UX Scenario Document File Version 4.3 (Please Write Your App Title)

UX Scenario Document File Version 4.3 (Please Write Your App Title) Поняття каналу зв’язку

Поняття каналу зв’язку Речь персонажа компьютерной игры как способ создания его образа

Речь персонажа компьютерной игры как способ создания его образа Методы построения калибровочных моделей для прогнозирования свойств индивидуальных углеводородов

Методы построения калибровочных моделей для прогнозирования свойств индивидуальных углеводородов Как создать анимацию в PowerPoint

Как создать анимацию в PowerPoint Деловая игра Текстовый редактор MS WORD

Деловая игра Текстовый редактор MS WORD MVP UI2FUX for DEV

MVP UI2FUX for DEV Тема: Автоматическая обработка информации. Машина Поста. 10 класс

Тема: Автоматическая обработка информации. Машина Поста. 10 класс Локальная сеть_урок в 11 классе

Локальная сеть_урок в 11 классе Язык программирования C#

Язык программирования C# An Introduction to GNSS_rev2_SD

An Introduction to GNSS_rev2_SD Правила компьютерного набора текста

Правила компьютерного набора текста The Verilog Language

The Verilog Language Кодирование графической информации

Кодирование графической информации Історія комп'ютерної техніки

Історія комп'ютерної техніки Типы, переменные, управляющие инструкции. (Тема 2.1)

Типы, переменные, управляющие инструкции. (Тема 2.1) Becherovka, SMM report

Becherovka, SMM report 3D-моделирование

3D-моделирование Решение логических задач

Решение логических задач Интегрированный урок Информатика+English: FACE to FACE

Интегрированный урок Информатика+English: FACE to FACE Интерфейс среды разработчика

Интерфейс среды разработчика Компания IT-Center

Компания IT-Center